Deep Learning(深度学习)学习笔记整理系列

zouxy09@qq.com

http://blog.csdn.net/zouxy09

作者:Zouxy

version 1.0 2013-04-08

声明:

1)该 Deep Learning 的学习系列是整理自网上很大牛和机器学习专家

所无私奉献的资料的。具体引用的资料请看参考文献。具体的版本声

明也参考原文献。

2)本文仅供学术交流,非商用。所以每一部分具体的参考资料并没有

详细对应。如果某部分不小心侵犯了大家的利益,还望海涵,并联系

博主删除。

3)本人才疏学浅,整理总结的时候难免出错,还望各位前辈不吝指正,

谢谢。

4)阅读本文需要机器学习、计算机视觉、神经网络等等基础(如果没

有也没关系了,没有就看看,能不能看懂,呵呵)。

5)此属于第一版本,若有错误,还需继续修正与增删。还望大家多多

指点。大家都共享一点点,一起为祖国科研的推进添砖加瓦(呵呵,

好高尚的目标啊)。请联系:zouxy09@qq.com

�

目录

一、概述 ............................................................................................................ 3

二、背景 ............................................................................................................ 5

三、人脑视觉机理 ............................................................................................... 8

四、关于特征 ................................................................................................... 11

4.1、特征表示的粒度 ................................................................................. 11

4.2、初级(浅层)特征表示 ........................................................................ 12

4.3、结构性特征表示 ................................................................................. 14

4.4、需要有多少个特征? ........................................................................... 16

五、Deep Learning 的基本思想 ........................................................................ 17

六、浅层学习(Shallow Learning)和深度学习(Deep Learning) .................... 18

七、Deep learning 与 Neural Network .............................................................. 20

八、Deep learning 训练过程 ............................................................................. 21

8.1、传统神经网络的训练方法为什么不能用在深度神经网络 .......................... 21

8.2、deep learning 训练过程 ..................................................................... 22

九、Deep Learning 的常用模型或者方法 ........................................................... 23

9.1、AutoEncoder 自动编码器 ................................................................... 23

9.2、Sparse Coding 稀疏编码 ................................................................... 28

9.3、Restricted Boltzmann Machine (RBM)限制波尔兹曼机 ....................... 31

9.4、Deep Belief Networks 深信度网络 ...................................................... 35

9.5、Convolutional Neural Networks 卷积神经网络 ................................... 38

十、总结与展望 ................................................................................................ 50

十一、参考文献和 Deep Learning 学习资源(持续更新……) ............................. 51

�

一、概述

Artificial Intelligence,也就是人工智能,就像长生不老和星际漫

游一样,是人类最美好的梦想之一。虽然计算机技术已经取得了长足

的进步,但是到目前为止,还没有一台电脑能产生“自我”的意识。是的,

在人类和大量现成数据的帮助下,电脑可以表现的十分强大,但是离

开了这两者,它甚至都不能分辨一个喵星人和一个汪星人。

图灵(图灵,大家都知道吧。计算机和人工智能的鼻祖,分别对

应于其著名的“图灵机”和“图灵测试”)在 1950 年的论文里,提出图灵

试验的设想,即,隔墙对话,你将不知道与你谈话的,是人还是电脑。

这无疑给计算机,尤其是人工智能,预设了一个很高的期望值。但是

半个世纪过去了,人工智能的进展,远远没有达到图灵试验的标准。

这不仅让多年翘首以待的人们,心灰意冷,认为人工智能是忽悠,相

关领域是“伪科学”。

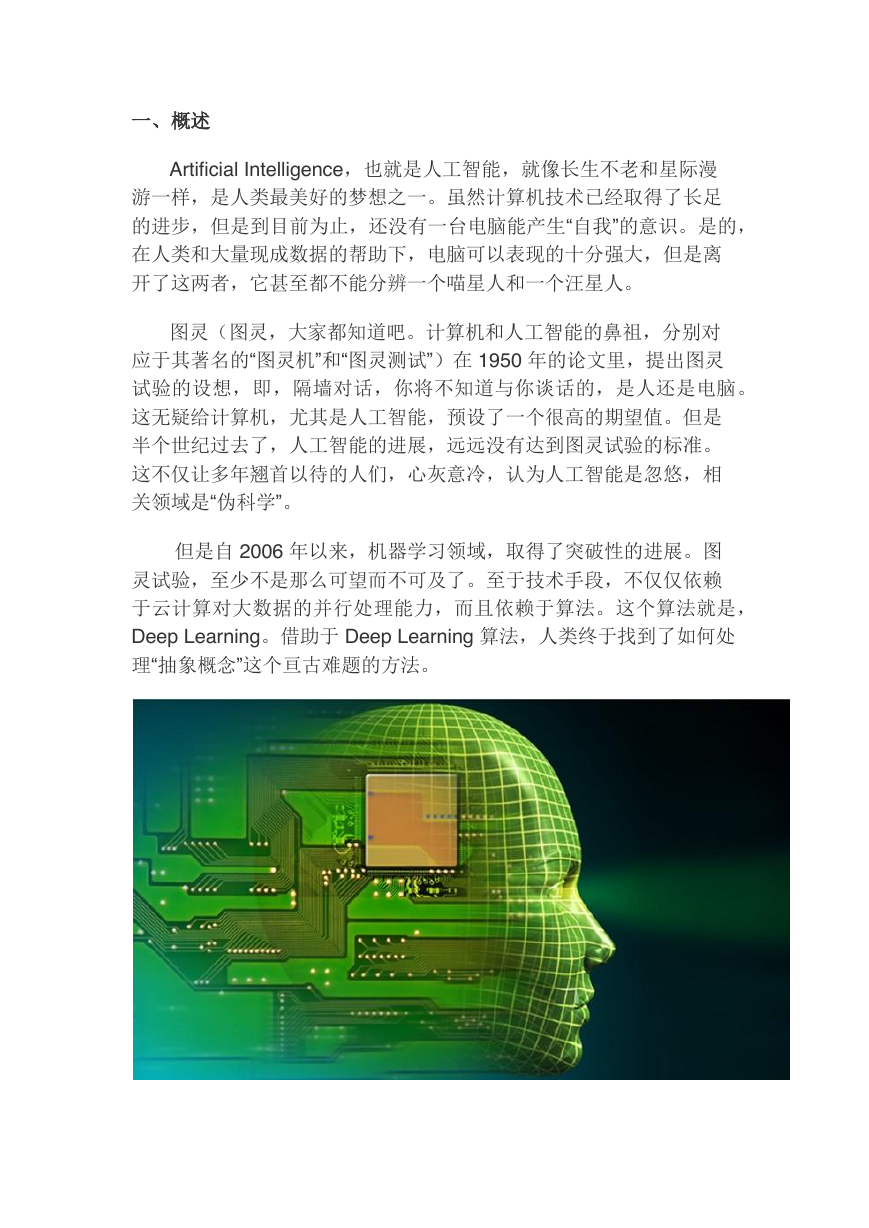

但是自 2006 年以来,机器学习领域,取得了突破性的进展。图

灵试验,至少不是那么可望而不可及了。至于技术手段,不仅仅依赖

于云计算对大数据的并行处理能力,而且依赖于算法。这个算法就是,

Deep Learning。借助于 Deep Learning 算法,人类终于找到了如何处

理“抽象概念”这个亘古难题的方法。

�

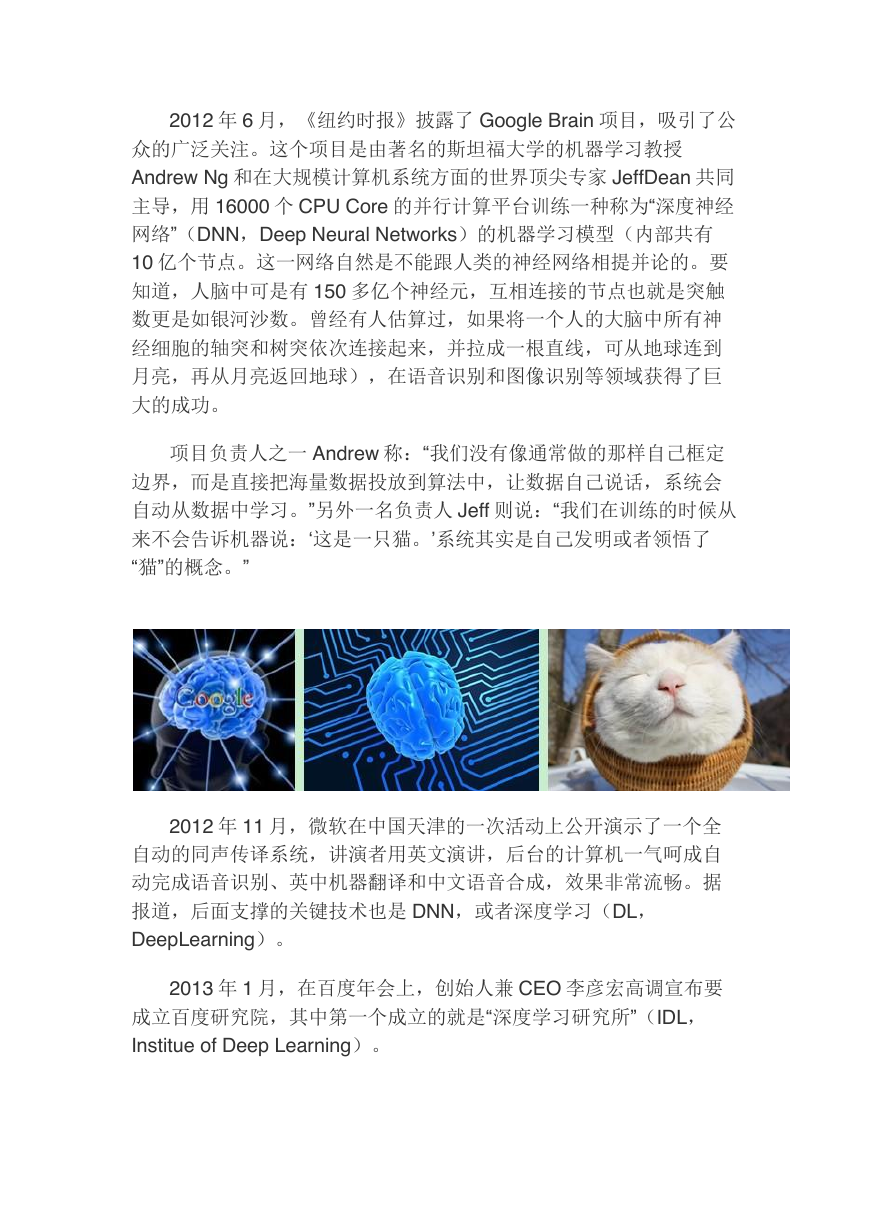

2012 年 6 月,《纽约时报》披露了 Google Brain 项目,吸引了公

众的广泛关注。这个项目是由著名的斯坦福大学的机器学习教授

Andrew Ng 和在大规模计算机系统方面的世界顶尖专家 JeffDean 共同

主导,用 16000 个 CPU Core 的并行计算平台训练一种称为“深度神经

网络”(DNN,Deep Neural Networks)的机器学习模型(内部共有

10 亿个节点。这一网络自然是不能跟人类的神经网络相提并论的。要

知道,人脑中可是有 150 多亿个神经元,互相连接的节点也就是突触

数更是如银河沙数。曾经有人估算过,如果将一个人的大脑中所有神

经细胞的轴突和树突依次连接起来,并拉成一根直线,可从地球连到

月亮,再从月亮返回地球),在语音识别和图像识别等领域获得了巨

大的成功。

项目负责人之一 Andrew 称:“我们没有像通常做的那样自己框定

边界,而是直接把海量数据投放到算法中,让数据自己说话,系统会

自动从数据中学习。”另外一名负责人 Jeff 则说:“我们在训练的时候从

来不会告诉机器说:‘这是一只猫。’系统其实是自己发明或者领悟了

“猫”的概念。”

2012 年 11 月,微软在中国天津的一次活动上公开演示了一个全

自动的同声传译系统,讲演者用英文演讲,后台的计算机一气呵成自

动完成语音识别、英中机器翻译和中文语音合成,效果非常流畅。据

报道,后面支撑的关键技术也是 DNN,或者深度学习(DL,

DeepLearning)。

2013 年 1 月,在百度年会上,创始人兼 CEO 李彦宏高调宣布要

成立百度研究院,其中第一个成立的就是“深度学习研究所”(IDL,

Institue of Deep Learning)。

�

为什么拥有大数据的互联网公司争相投入大量资源研发深度学习

技术。听起来感觉 deeplearning 很牛那样。那什么是 deep learning?

为什么有 deep learning?它是怎么来的?又能干什么呢?目前存在哪

些困难呢?这些问题的简答都需要慢慢来。咱们先来了解下机器学习

(人工智能的核心)的背景。

二、背景

机器学习(Machine Learning)是一门专门研究计算机怎样模拟或

实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识

结构使之不断改善自身的性能的学科。机器能否像人类一样能具有学

习能力呢?1959 年美国的塞缪尔(Samuel)设计了一个下棋程序,这个

程序具有学习能力,它可以在不断的对弈中改善自己的棋艺。4 年后,

这个程序战胜了设计者本人。又过了 3 年,这个程序战胜了美国一个

保持 8 年之久的常胜不败的冠军。这个程序向人们展示了机器学习的

能力,提出了许多令人深思的社会问题与哲学问题(呵呵,人工智能

正常的轨道没有很大的发展,这些什么哲学伦理啊倒发展的挺快。什

么未来机器越来越像人,人越来越像机器啊。什么机器会反人类啊,

ATM 是开第一枪的啊等等。人类的思维无穷啊)。

机器学习虽然发展了几十年,但还是存在很多没有良好解决的问

题:

�

例如图像识别、语音识别、自然语言理解、天气预测、基因表达、

内容推荐等等。目前我们通过机器学习去解决这些问题的思路都是这

样的(以视觉感知为例子):

从开始的通过传感器(例如 CMOS)来获得数据。然后经过预处

理、特征提取、特征选择,再到推理、预测或者识别。最后一个部分,

也就是机器学习的部分,绝大部分的工作是在这方面做的,也存在很

多的 paper 和研究。

而中间的三部分,概括起来就是特征表达。良好的特征表达,对

最终算法的准确性起了非常关键的作用,而且系统主要的计算和测试

工作都耗在这一大部分。但,这块实际中一般都是人工完成的。靠人

工提取特征。

�

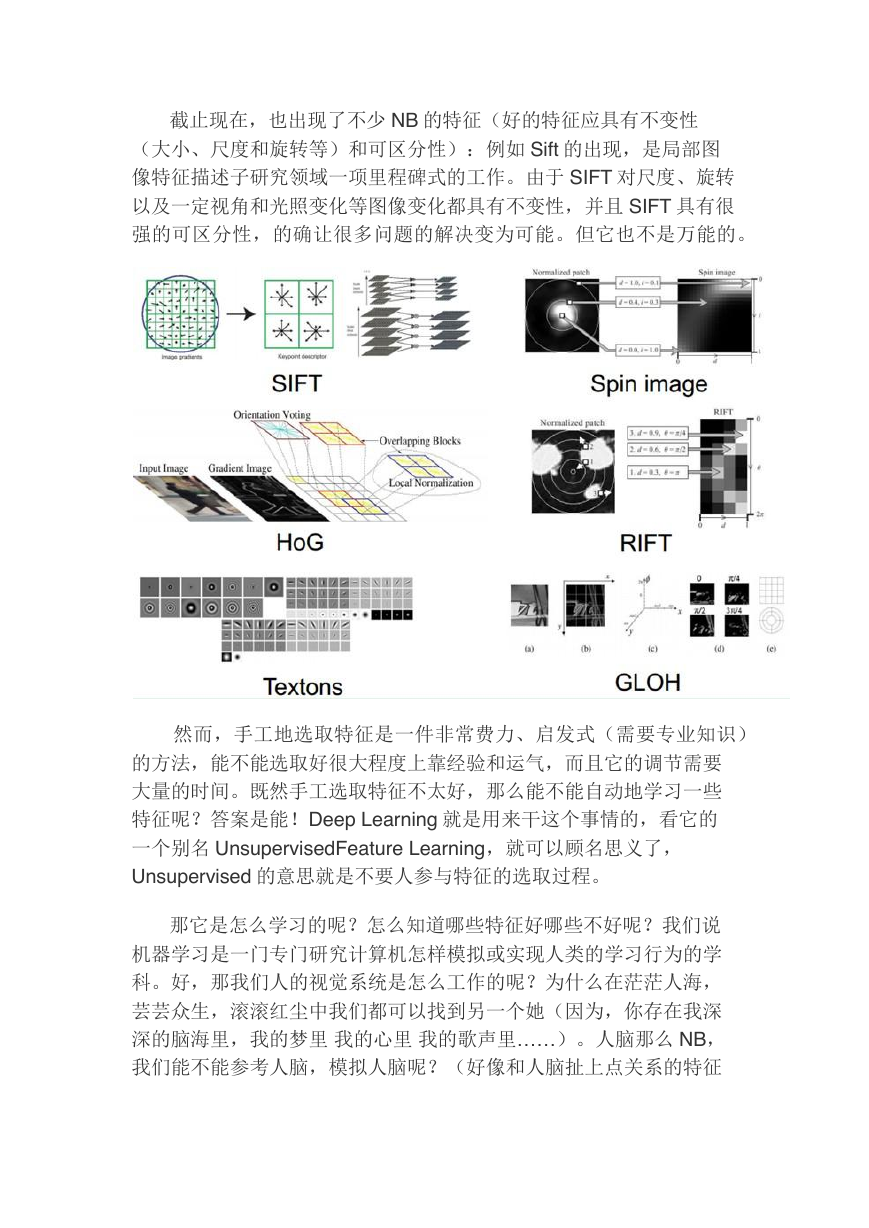

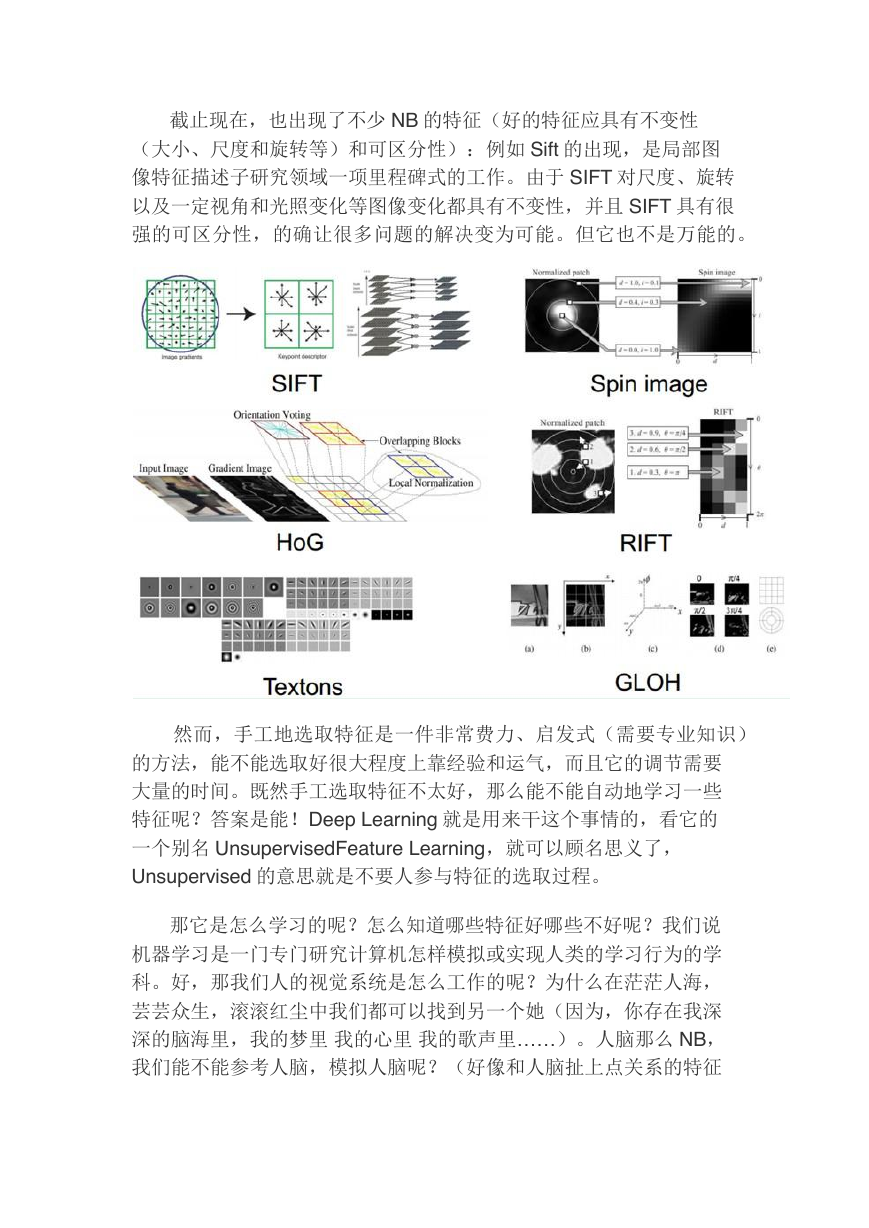

截止现在,也出现了不少 NB 的特征(好的特征应具有不变性

(大小、尺度和旋转等)和可区分性):例如 Sift 的出现,是局部图

像特征描述子研究领域一项里程碑式的工作。由于 SIFT 对尺度、旋转

以及一定视角和光照变化等图像变化都具有不变性,并且 SIFT 具有很

强的可区分性,的确让很多问题的解决变为可能。但它也不是万能的。

然而,手工地选取特征是一件非常费力、启发式(需要专业知识)

的方法,能不能选取好很大程度上靠经验和运气,而且它的调节需要

大量的时间。既然手工选取特征不太好,那么能不能自动地学习一些

特征呢?答案是能!Deep Learning 就是用来干这个事情的,看它的

一个别名 UnsupervisedFeature Learning,就可以顾名思义了,

Unsupervised 的意思就是不要人参与特征的选取过程。

那它是怎么学习的呢?怎么知道哪些特征好哪些不好呢?我们说

机器学习是一门专门研究计算机怎样模拟或实现人类的学习行为的学

科。好,那我们人的视觉系统是怎么工作的呢?为什么在茫茫人海,

芸芸众生,滚滚红尘中我们都可以找到另一个她(因为,你存在我深

深的脑海里,我的梦里 我的心里 我的歌声里……)。人脑那么 NB,

我们能不能参考人脑,模拟人脑呢?(好像和人脑扯上点关系的特征

�

啊,算法啊,都不错,但不知道是不是人为强加的,为了使自己的作

品变得神圣和高雅。)

近几十年以来,认知神经科学、生物学等等学科的发展,让我们

对自己这个神秘的而又神奇的大脑不再那么的陌生。也给人工智能的

发展推波助澜。

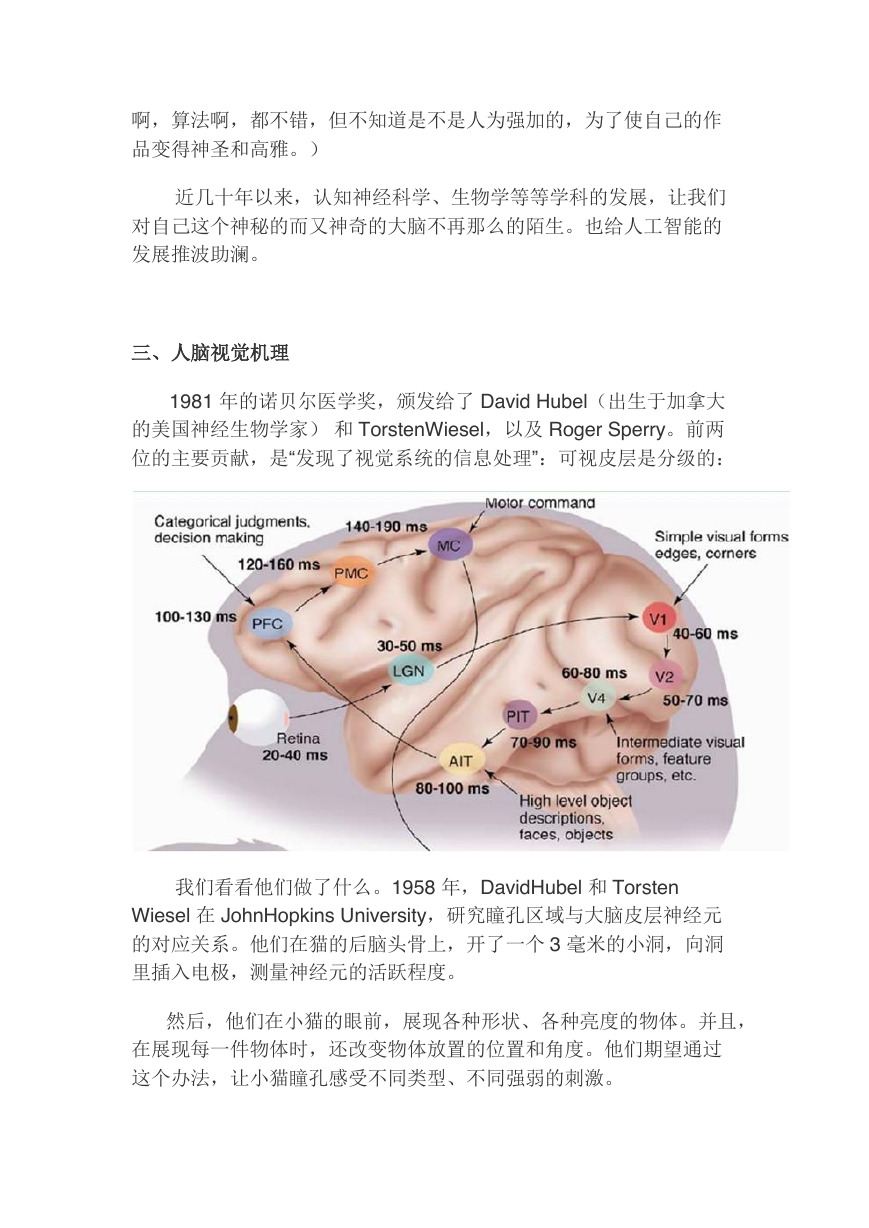

三、人脑视觉机理

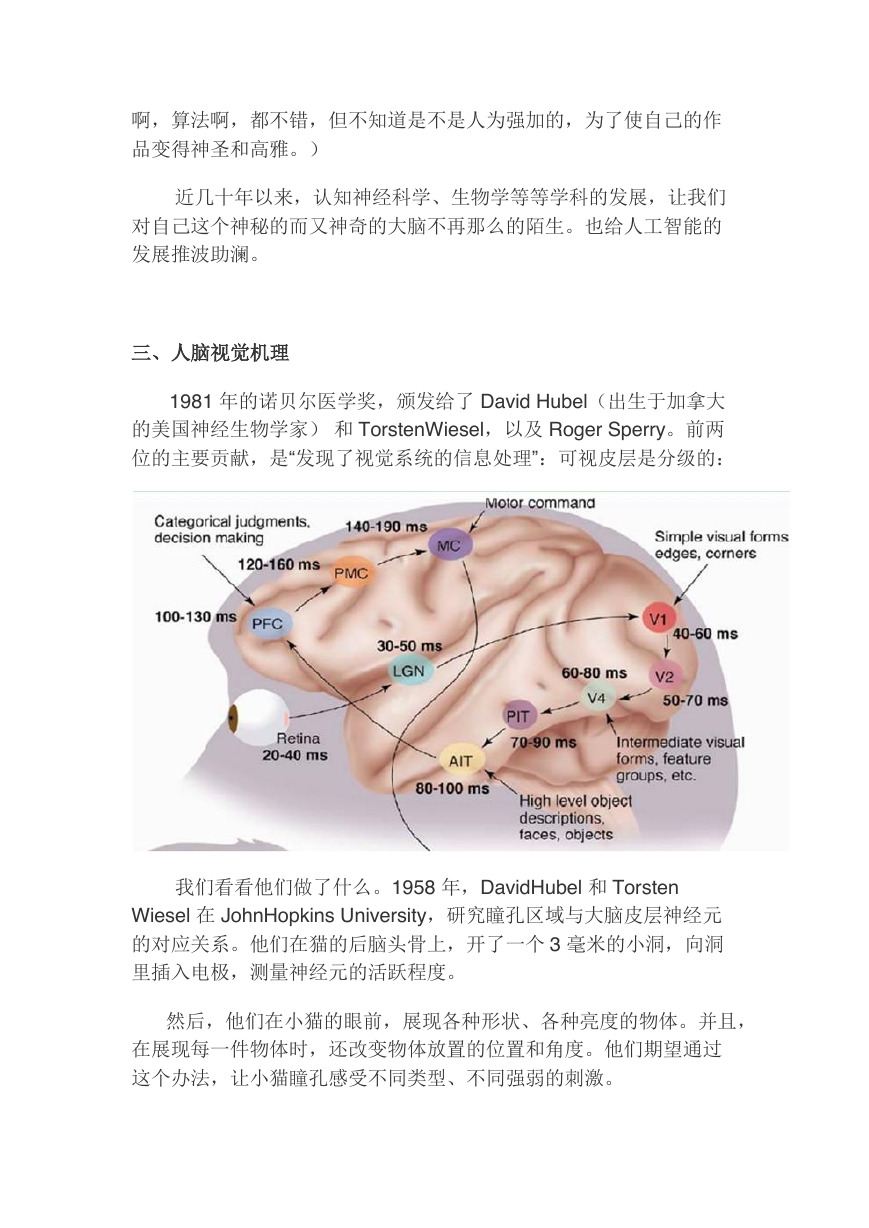

1981 年的诺贝尔医学奖,颁发给了 David Hubel(出生于加拿大

的美国神经生物学家) 和 TorstenWiesel,以及 Roger Sperry。前两

位的主要贡献,是“发现了视觉系统的信息处理”:可视皮层是分级的:

我们看看他们做了什么。1958 年,DavidHubel 和 Torsten

Wiesel 在 JohnHopkins University,研究瞳孔区域与大脑皮层神经元

的对应关系。他们在猫的后脑头骨上,开了一个 3 毫米的小洞,向洞

里插入电极,测量神经元的活跃程度。

然后,他们在小猫的眼前,展现各种形状、各种亮度的物体。并且,

在展现每一件物体时,还改变物体放置的位置和角度。他们期望通过

这个办法,让小猫瞳孔感受不同类型、不同强弱的刺激。

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc