软件学报ISSN 1000-9825, CODEN RUXUEW E-mail: jos@iscas.ac.cn Journal of Software,2019,30(6):1793−1818 [doi: 10.13328/j.cnki.jos.005817] http://www.jos.org.cn ©中国科学院软件研究所版权所有. Tel: +86-10-62562563 深度学习实体关系抽取研究综述∗ 鄂海红1,2, 张文静1,2, 肖思琪1,2, 程 瑞1,2, 胡莺夕1,2, 周筱松1,2, 牛佩晴1,2 1(北京邮电大学 计算机学院 数据科学与服务中心,北京 100876) 2(教育部信息网络工程研究中心(北京邮电大学),北京 100876) 通讯作者: 鄂海红, E-mail: ehaihong@bupt.edu.cn 摘 要: 实体关系抽取作为信息抽取、自然语言理解、信息检索等领域的核心任务和重要环节,能够从文本中抽取实体对间的语义关系.近年来,深度学习在联合学习、远程监督等方面上的应用,使关系抽取任务取得了较为丰富的研究成果.目前,基于深度学习的实体关系抽取技术,在特征提取的深度和模型的精确度上已经逐渐超过了传统基于特征和核函数的方法.围绕有监督和远程监督两个领域,系统总结了近几年来中外学者基于深度学习的实体关系抽取研究进展,并对未来可能的研究方向进行了探讨和展望. 关键词: 实体关系抽取;深度学习;联合学习;远程监督;生成对抗网络 中图法分类号: TP183 中文引用格式: 鄂海红,张文静,肖思琪,程瑞,胡莺夕,周筱松,牛佩晴.深度学习实体关系抽取研究综述.软件学报,2019,30(6): 1793−1818. http://www.jos.org.cn/1000-9825/5817.htm 英文引用格式: E HH, Zhang WJ, Xiao SQ, Cheng R, Hu YX, Zhou XS, Niu PQ. Survey of entity relationship extraction based on deep learning. Ruan Jian Xue Bao/Journal of Software, 2019,30(6):1793−1818 (in Chinese). http://www.jos.org.cn/1000-9825/ 5817.htm Survey of Entity Relationship Extraction Based on Deep Learning E Hai-Hong1,2, ZHANG Wen-Jing1,2, XIAO Si-Qi1,2, CHENG Rui1,2, HU Ying-Xi1,2, ZHOU Xiao-Song1,2, NIU Pei-Qing1,2 1(Data Science and Service Center, School of Computer Science, Beijing University of Posts and Telecommunications, Beijing 100876, China) 2(Engineering Research Center of Information Networks of Ministry of Education (Beijing University of Posts and Telecommunications), Beijing 100876, China) Abstract: Entity relation extraction is a core task and an important part in the fields of information extraction, natural language understanding, and information retrieval. It can extract the semantic relationships between entity pairs from the texts. In recent years, the application of deep learning in the fields of joint learning, remote supervision has resulted in relatively abundant research results in relation extraction tasks. At present, entity relationship extraction technology based on deep learning has gradually exceeded the traditional methods which are based on features and kernel functions in terms of the depth of feature extraction and the accuracy. This paper focuses on the two fields of supervision and remote supervision. It systematically summarizes the research progress of Chinese and overseas scholars’ deep relationship-based entity relationship extraction in recent years, and discusses and prospects future possible research directions as well. Key words: entity relationship extraction; deep learning; joint learning; remote supervision; generative adversarial network ∗ 基金项目: 国家重点研发计划(2018YFB1403501) Foundation item: National Key R&D Program of China (2018YFB1403501) 收稿时间: 2018-04-25; 修改时间: 2018-07-08, 2018-09-02, 2018-10-13; 采用时间: 2018-12-29; jos在线出版时间: 2019-03-27 CNKI网络优先出版: 2019-03-28 07:32:30, http://kns.cnki.net/kcms/detail/11.2560.TP.20190327.2337.016.html �

1794 Journal of Software 软件学报 Vol.30, No.6, June 2019 随着互联网技术的发展,人们需要处理的数据量激增,领域交叉现象突出.如何快速高效地从开放领域的文本中抽取出有效信息,成为摆在人们面前的重要问题.实体关系抽取作为文本挖掘和信息抽取[1]的核心任务,其主要通过对文本信息建模,自动抽取出实体对之间的语义关系,提取出有效的语义知识.其研究成果主要应用在文本摘要、自动问答[2]、机器翻译[3]、语义网标注、知识图谱[4]等.随着近年来对信息抽取的兴起,实体关系抽取问题进一步得到广泛关注和深入研究,一些研究成果及时出现在近几年人工智能、自然语言处理等相关领域的国际会议上,如ACL[5−13]、EMNLP[14−22]、ICLR[23,24]、AAAI[25]、KDD[26]、NAACL[27]、 ECML-PKDD[28]等. 经典的实体关系抽取方法主要分为有监督、半监督、弱监督和无监督这4类.有监督的实体关系抽取主要分为基于特征和基于核函数的方法.Zhou[29]和郭喜跃[6]等人利用SVM作为分类器,分别研究词汇、句法和语义特征对实体语义关系抽取的影响.有监督方法需要手工标注大量的训练数据,浪费时间精力,因此,人们[30]继而提出了基于半监督[31]、弱监督和无监督的关系抽取方法来解决人工标注语料问题,其中:Brin[32]利用Bootstrapping方法对命名实体之间的关系进行抽取;Craven等人[33]在研究从文本中抽取结构化数据、建立生物学知识库的过程中,首次提出了弱监督机器学习思想;Hasegawa等人[34]在ACL会议上首次提出了一种无监督的命名实体之间关系抽取方法. 经典方法存在特征提取误差传播问题,极大影响实体关系抽取效果.随着近些年深度学习的崛起,学者们逐渐将深度学习应用到实体关系抽取任务中[7].基于数据集标注量级的差异,深度学习的实体关系抽取任务分为有监督和远程监督两类.基于深度学习的有监督实体关系抽取方法是近年来关系抽取的研究热点,该方法能避免经典方法中人工特征选择等步骤,减少并改善特征抽取过程中的误差积累问题.根据实体识别及关系分类两个子任务完成的先后顺序不同,基于深度学习的有监督实体关系抽取方法可以分为流水线(pipeline)方法和联合学习(joint learning)方法.Zeng等人[20]在2014年首次提出使用CNN进行关系分类,Katiyar等人[13]在2017年首次将注意力机制Attention与递归神经网络Bi-LSTM一起用于联合提取实体和分类关系,神经网络模型在有监督领域的拓展皆取得不错效果.同时,基于深度学习的远程监督实体关系抽取方法因具有缓解经典方法中错误标签和特征抽取误差传播问题的能力而成为研究热点,主要基础方法包括CNN,RNN,LSTM等网络结 构[35,36].近年来,学者们在基础方法之上提出了多种改进,如PCNN与多示例学习的融合方法[37]、PCNN与注意力机制的融合方法[10]等.Ji等人[38]提出在PCNN和Attention的基础上添加实体的描述信息来辅助学习实体的表示,Ren等人[39]提出的COTYPE模型、Huang[40]提出的残差网络皆增强了关系提取效果. 为了能够系统综述相关研究成果,我们查阅了近年来的综述论文[30,35,41−43],从中可看出,基于深度学习的实体关系抽取方法与经典抽取方法相比,其主要优势在于深度学习的神经网络模型可以自动学习句子特征,无需复杂的特征工程.所以,本文重点围绕深度学习来深入探讨实体关系抽取方法. 本文首先在第1节给出实体关系抽取的问题定义和解决框架.着重在第2节、第3节介绍基于深度学习的有监督和远程监督领域的实体关系抽取研究进展.之后,在第4节介绍基于深度学习的实体关系抽取新模型与新思路.并在第5节介绍基于深度学习的实体关系抽取在领域知识图谱构建中的研究进展.最后,在第6节、第7节给出数据集、评测效果以及对未来研究方向的展望. 1 深度学习实体关系抽取的问题定义和解决框架 1.1 问题定义 实体关系抽取作为信息抽取的重要任务,是指在实体识别的基础上,从非结构化文本中抽取出预先定义的实体关系.实体对的关系可被形式化描述为关系三元组〈e1,r,e2〉,其中,e1和e2是实体,r属于目标关系集R{r1,r2, r3,...,ri}.关系抽取的任务是从自然语言文本中抽取出关系三元组〈e1,r,e2〉,从而提取文本信息. 基于深度学习实体关系抽取主要分为有监督和远程监督两类.在有监督中,解决实体关系抽取的方法可以分为流水线学习和联合学习两种:流水线学习方法是指在实体识别已经完成的基础上直接进行实体之间关系的抽取;联合学习方法主要是基于神经网络的端到端模型,同时完成实体的识别和实体间关系的抽取.与有监督实体关系抽取相比,远程监督方法缺少人工标注数据集,因此,远程监督方法比有监督多一步远程对齐知识库给�

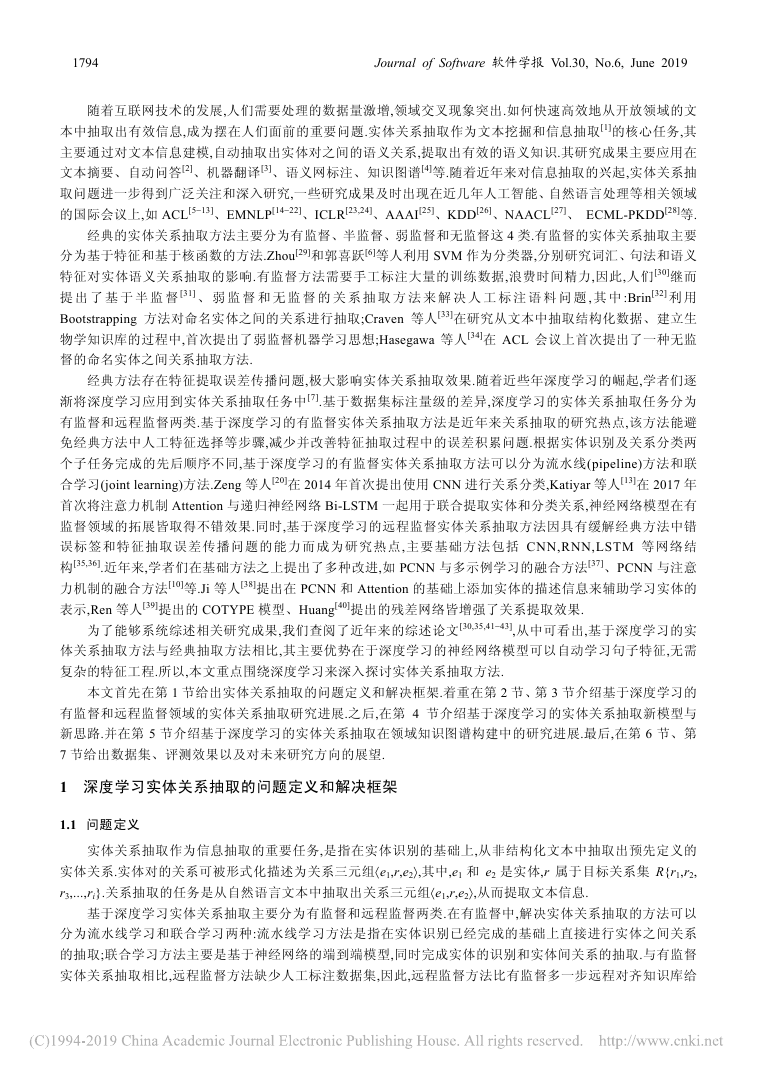

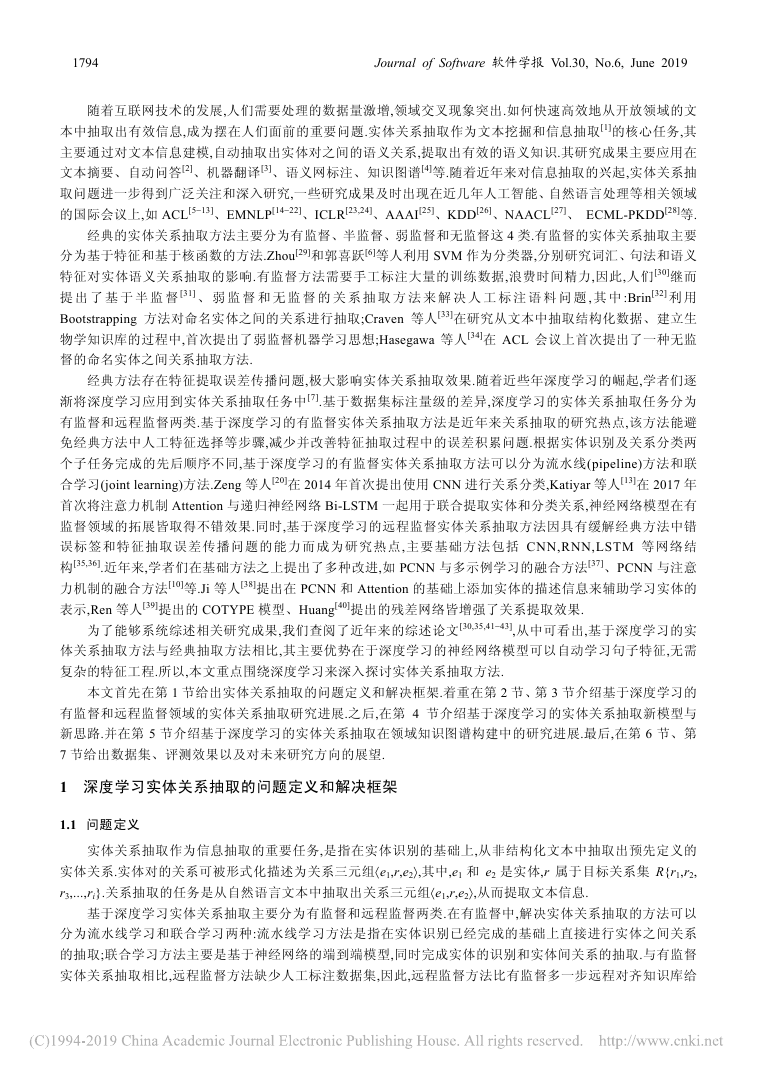

鄂海红 等:深度学习实体关系抽取研究综述 1795 无标签数据打标的过程.而构建关系抽取模型的部分,与有监督领域的流水线方法差别不大. 基于深度学习的实体关系抽取、实体关系识别、实体关系分类是3个任务相近、彼此有关联的概念.具体而言,关系抽取[7]在其流水线处理场景中与关系分类处理着相同的任务,此时,关系抽取具体是指在句子中的命名实体对已经被识别的情况下,直接进行实体对的关系分类;而关系抽取在联合学习场景中是将关系分类作为自己的一个子任务,此时,关系抽取具体是指:将实体关系抽取任务分为命名实体识别和关系分类两个子任务,用联合学习模型同时解决这两个子任务.而实体关系识别任务与关系抽取任务相同,在实际处理时也是发现和识别实体间的语义关系[44,45],因此在部分中外综述文献里,实体关系抽取有时也被称为实体关系识别. 1.2 解决问题框架 针对实体关系抽取任务,基于深度学习的抽取框架如图1所示. (1) 获取有标签数据:有监督方法通过人工标记获取有标签数据集,远程监督方法通过自动对齐远程知识库获取有标签数据集; (2) 构建词语向量表示:将有标签句子分词,将每个词语编码成计算机可以接受的词向量,并求出每个词语与句子中实体对的相对位置,作为这个词语的位置向量,将词向量与位置向量组合作为这个词语的最终向量表示; (3) 进行特征提取:将句子中每一个词语的向量表示输入神经网络中,利用神经网络模型提取句子特征,进而训练一个特征提取器; (4) 关系分类:测试时根据预先定义好的关系种类,将特征提取出的向量放入非线性层进行分类,提取最终的实体对关系; (5) 评估分类性能:最后,对关系分类结果进行评估,评测指标和相关数据集详见第6节. Fig.1 Entity relationship extraction framework based on deep learning 图1 基于深度学习的实体关系抽取框架 2 基于深度学习的有监督实体关系抽取方法 2.1 有监督实体关系抽取框架演化流程 基于深度学习方法中的有监督方法进行关系抽取,是近年来关系抽取的研究热点,其能解决经典方法中存在的人工特征选择、特征提取误差传播两大主要问题,将低层特征进行组合,形成更加抽象的高层特征,用来寻找数据的分布式特征表示.从基于监督学习的神经网络模型来看,研究主要集中在融合多种自然语言特征来提高识别精确度.有监督的实体关系抽取框架的演化流程如图2所示. 基于深度学习的实体关系抽取框架 �

1796 Journal of Software 软件学报 Vol.30, No.6, June 2019 Fig.2 Solution framework based on supervised entity relationship extraction 图2 基于有监督的实体关系抽取的解决框架 基于深度学习的有监督实体关系抽取可以分为:1) 流水线方法;2) 联合学习方法.这两种方法都基于CNN, RNN,LSTM这3种框架进行扩展优化. • 流水线方法中,基于RNN模型的扩展包括在RNN基础之上增加依存分析树信息、词依存矩阵信息;基于CNN模型的扩展包括在CNN基础之上增加类别排名信息、依存分析树、注意力机制;基于LSTM模型的扩展包括在LSTM基础之上增加最短依存路径(SDP)或将LSTM与CNN结合.流水线方法存在错误累积传播、忽视子任务间关系依赖、产生冗余实体等问题,因此,联合模型逐渐开始受到重视; • 联合学习方法根据其建模对象不同,可分为参数共享和序列标注两类子方法:参数共享方法的编码层均使用Bi-LSTM,解码层则基于Bi-LSTM、依赖树和注意力机制等方法纷纷进行优化扩展;序列标注方法则用一种新标注策略的端到端模型解决流水线模型中冗余实体的问题. 下面依照流水线方法(基于RNN模型的实体关系抽取方法、基于CNN模型的实体关系抽取方法、基于LSTM模型的实体关系抽取方法)、联合学习方法(基于参数共享的实体关系抽取方法、基于序列标注的实体关系抽取方法)的顺序来介绍有监督领域实体关系抽取方法. 2.2 流水线方法 2.2.1 主要流程 基于流水线的方法进行关系抽取的主要流程可以描述为:针对已经标注好目标实体对的句子进行关系抽取,最后把存在实体关系的三元组作为预测结果输出.一些基于流水线方法的关系抽取模型被陆续提出,其中,采用基于RNN,CNN,LSTM及其改进模型的网络结构,因其高精度获得了学术界的大量关注. 2.2.2 主流方法介绍 (1) 基于RNN模型的实体关系抽取方法 RNN在处理单元之间既有内部的反馈连接又有前馈连接,可以利用其内部的记忆来处理任意时序的序列信息,具有学习任意长度的各种短语和句子的组合向量表示的能力,已成功应用在多种NLP任务中. 基于RNN模型进行关系抽取的方法由Socher等人[46]于2012年首次提出,此方法为分析树中的每个节点分配一个向量和一个矩阵,其中,向量捕获组成部分的固有含义,而矩阵捕捉它如何改变相邻单词或短语的含义.这种矩阵向量RNN可以在命题逻辑和自然语言中学习操作符的含义,解决了单词向量空间模型(single- word vector space models)无法捕捉到长短语的构成意义,阻碍了它们更深入地理解语言的问题. Hashimoto等人[19]在2013年提出了基于句法树的递归神经网络(RNN)模型,与Socher等人提出的模型不同的是,Hashimoto没有使用需要昂贵计算成本的词依存矩阵,而是使用了词性(POS)标签、短语类别和句法头�

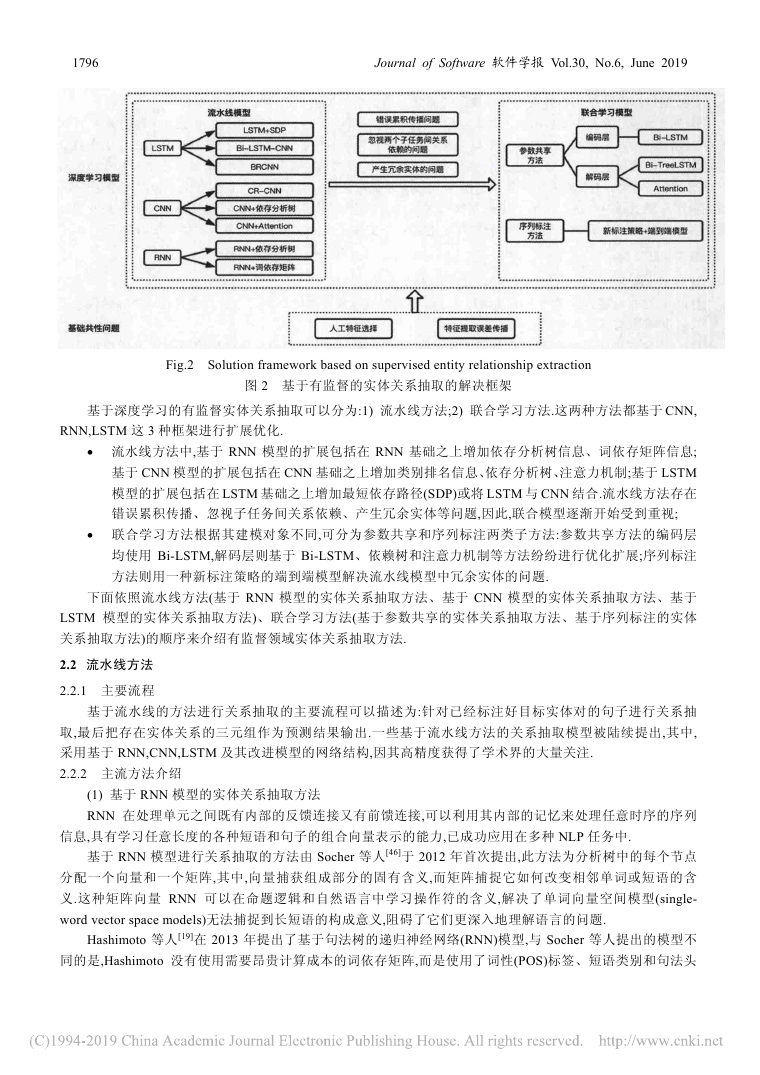

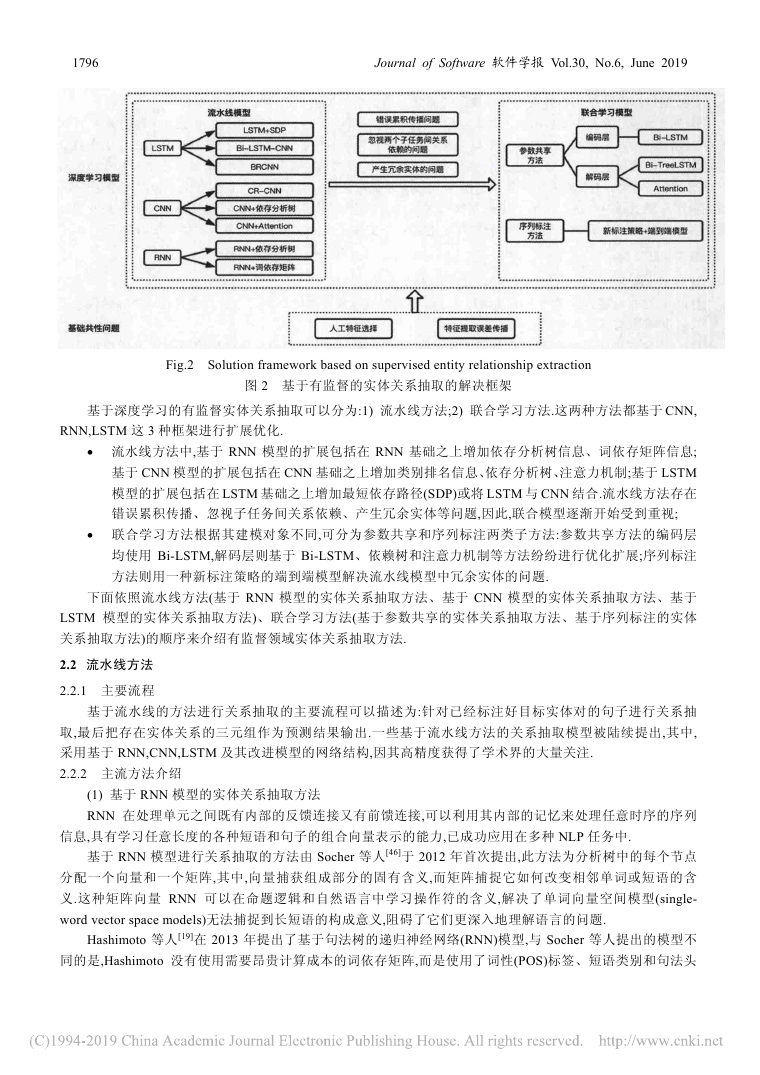

鄂海红 等:深度学习实体关系抽取研究综述 1797 等附加特征,并向RNN模型中引入平均参数,为目标任务的重要短语增加权重,Hashimoto的模型证明了增加特征及引入平均参数的有效性. RNN相比于前馈网络更适合处理序列化输入,但RNN也存在着以下两个缺点:(1) 在网络训练时,RNN容易出现梯度消失、梯度爆炸的问题,因此,传统RNN在实际中很难处理长期依赖,这一点在LSTM网络中有所改进;(2) 由于RNN的内部结构复杂,网络训练周期较长,而CNN结构相对简单,主要包括前置的卷积层和后置的全连接层,训练更快速. (2) 基于CNN模型的实体关系抽取方法 CNN的基本结构包括两层:其一为特征提取层,每个神经元的输入与前一层的局部接受域相连,并提取该局部的特征;其二是特征映射层,网络的每个计算层由多个特征映射组成,每个特征映射是一个平面,平面上所有神经元的权值相等,减少了网络中自由参数的个数.由于同一特征映射面上的神经元权值相同,所以CNN网络可以并行学习. Zeng等人[20]在2014年首次提出了使用CNN进行关系抽取,利用卷积深度神经网络(CDNN)来提取词汇和句子层次的特征,将所有的单词标记作为输入,而无需复杂的预处理,解决了从预处理系统中提取的特征可能会导致错误传播并阻碍系统性能的问题.图3描述了该论文用于关系分类的神经网络的体系结构.网络对输入句子提取多个级别的特征向量,它主要包括以下3个组件:词向量表示、特征提取和输出.图3右部分显示了句子级特征向量构建过程:每个词语向量由词特征(WF)和位置特征(PF)共同组成,将词语向量放入卷积层提取句子级特征.图3左上部分为提取词汇级和句子级特征的过程,然后直接连接以形成最终的句子特征向量.最后如图3左下部分,通过隐藏层和Softmax层得到最终的分类结果. Fig.3 Relationship extraction frameworkbased on convolutional deep neural network 图3 基于DNN的关系抽取框架 Xu等人[47]于2015年在Zeng等人工作的基础上提出了基于依存分析树的卷积神经网络的实体关系抽取模型,该模型与Zeng等人的CNN模型不同的是将输入文本经过了依存分析树,同时提出了一种负采样策略:首先,利用依存路径来学习关系的方向性;然后,使用负采样方法来学习主体和对象的位置分配,采用从对象到主体的最短依存路径作为负样本,并将负样本送到模型中学习,以解决实体对距离较远时,依存分析树引入的无关信息问题.同时,显著提高了关系抽取的性能. Santos等人[21]在2015年提出了CR-CNN模型,与Zeng等人的模型相比,CR-CNN将最后的Softmax输出层替换为利用排名进行分类输出:对于给定的输入文本段,网络使用卷积层产生文本的分布向量表示,并将其与文本表示进行比较,以便为每个类生成分数;同时提出了一种新的排名损失函数,能够给予正确的预测类更高的评分、错误的预测类更低的评分.与Xu等人的模型相比,本文仅将词向量作为输入特征,而不需要依存分析树等�

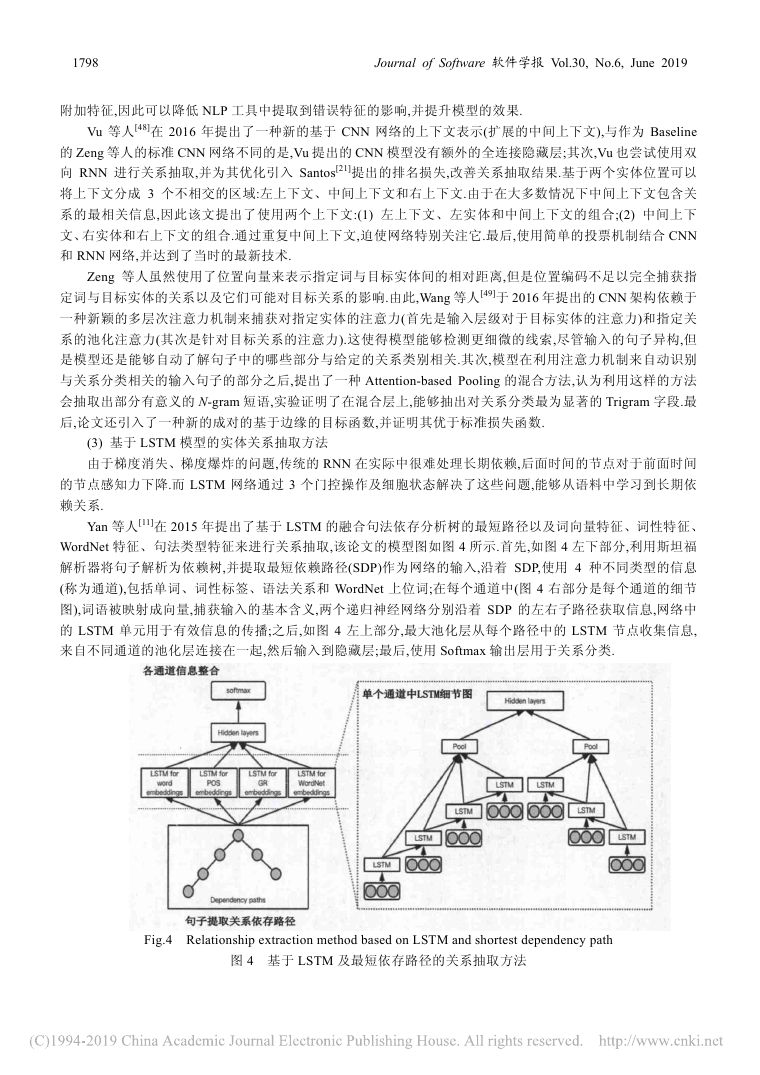

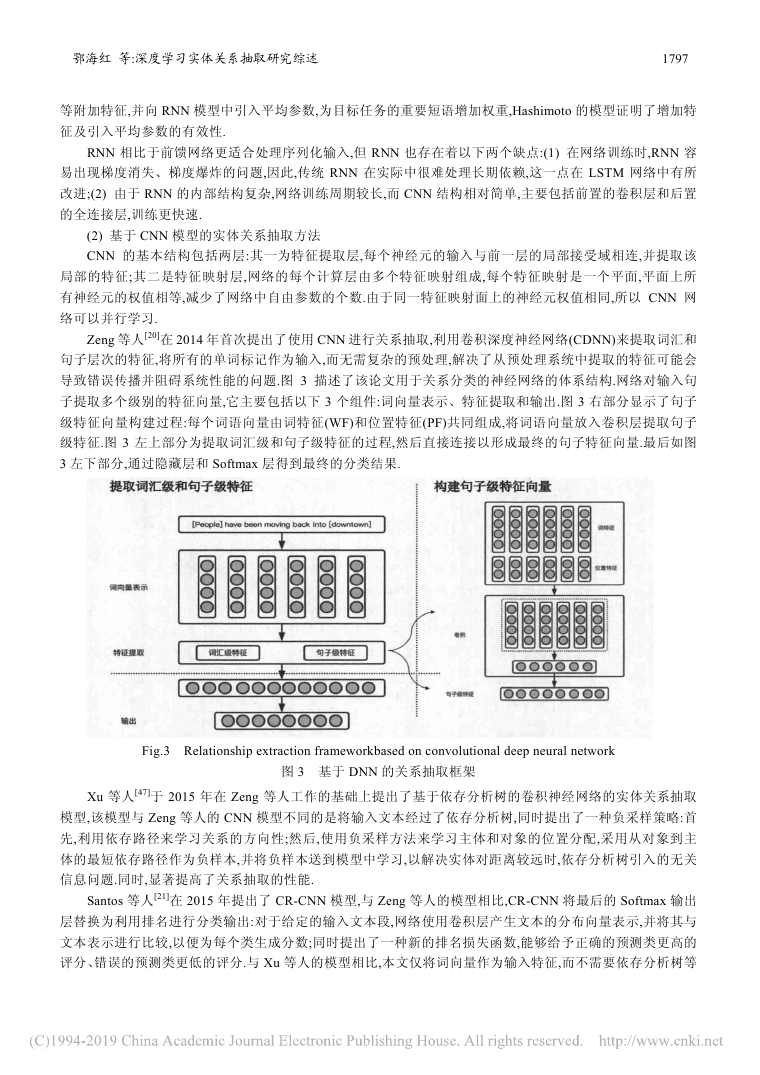

1798 Journal of Software 软件学报 Vol.30, No.6, June 2019 附加特征,因此可以降低NLP工具中提取到错误特征的影响,并提升模型的效果. Vu等人[48]在2016年提出了一种新的基于CNN网络的上下文表示(扩展的中间上下文),与作为Baseline的Zeng等人的标准CNN网络不同的是,Vu提出的CNN模型没有额外的全连接隐藏层;其次,Vu也尝试使用双向RNN进行关系抽取,并为其优化引入Santos[21]提出的排名损失,改善关系抽取结果.基于两个实体位置可以将上下文分成3个不相交的区域:左上下文、中间上下文和右上下文.由于在大多数情况下中间上下文包含关系的最相关信息,因此该文提出了使用两个上下文:(1) 左上下文、左实体和中间上下文的组合;(2) 中间上下文、右实体和右上下文的组合.通过重复中间上下文,迫使网络特别关注它.最后,使用简单的投票机制结合CNN和RNN网络,并达到了当时的最新技术. Zeng等人虽然使用了位置向量来表示指定词与目标实体间的相对距离,但是位置编码不足以完全捕获指定词与目标实体的关系以及它们可能对目标关系的影响.由此,Wang等人[49]于2016年提出的CNN架构依赖于一种新颖的多层次注意力机制来捕获对指定实体的注意力(首先是输入层级对于目标实体的注意力)和指定关系的池化注意力(其次是针对目标关系的注意力).这使得模型能够检测更细微的线索,尽管输入的句子异构,但是模型还是能够自动了解句子中的哪些部分与给定的关系类别相关.其次,模型在利用注意力机制来自动识别与关系分类相关的输入句子的部分之后,提出了一种Attention-based Pooling的混合方法,认为利用这样的方法会抽取出部分有意义的N-gram短语,实验证明了在混合层上,能够抽出对关系分类最为显著的Trigram字段.最后,论文还引入了一种新的成对的基于边缘的目标函数,并证明其优于标准损失函数. (3) 基于LSTM模型的实体关系抽取方法 由于梯度消失、梯度爆炸的问题,传统的RNN在实际中很难处理长期依赖,后面时间的节点对于前面时间的节点感知力下降.而LSTM网络通过3个门控操作及细胞状态解决了这些问题,能够从语料中学习到长期依赖关系. Yan等人[11]在2015年提出了基于LSTM的融合句法依存分析树的最短路径以及词向量特征、词性特征、WordNet特征、句法类型特征来进行关系抽取,该论文的模型图如图4所示.首先,如图4左下部分,利用斯坦福解析器将句子解析为依赖树,并提取最短依赖路径(SDP)作为网络的输入,沿着SDP,使用4种不同类型的信息(称为通道),包括单词、词性标签、语法关系和WordNet上位词;在每个通道中(图4右部分是每个通道的细节图),词语被映射成向量,捕获输入的基本含义,两个递归神经网络分别沿着SDP的左右子路径获取信息,网络中的LSTM单元用于有效信息的传播;之后,如图4左上部分,最大池化层从每个路径中的LSTM节点收集信息,来自不同通道的池化层连接在一起,然后输入到隐藏层;最后,使用Softmax输出层用于关系分类. Fig.4 Relationship extraction method based on LSTM and shortest dependency path 图4 基于LSTM及最短依存路径的关系抽取方法 �

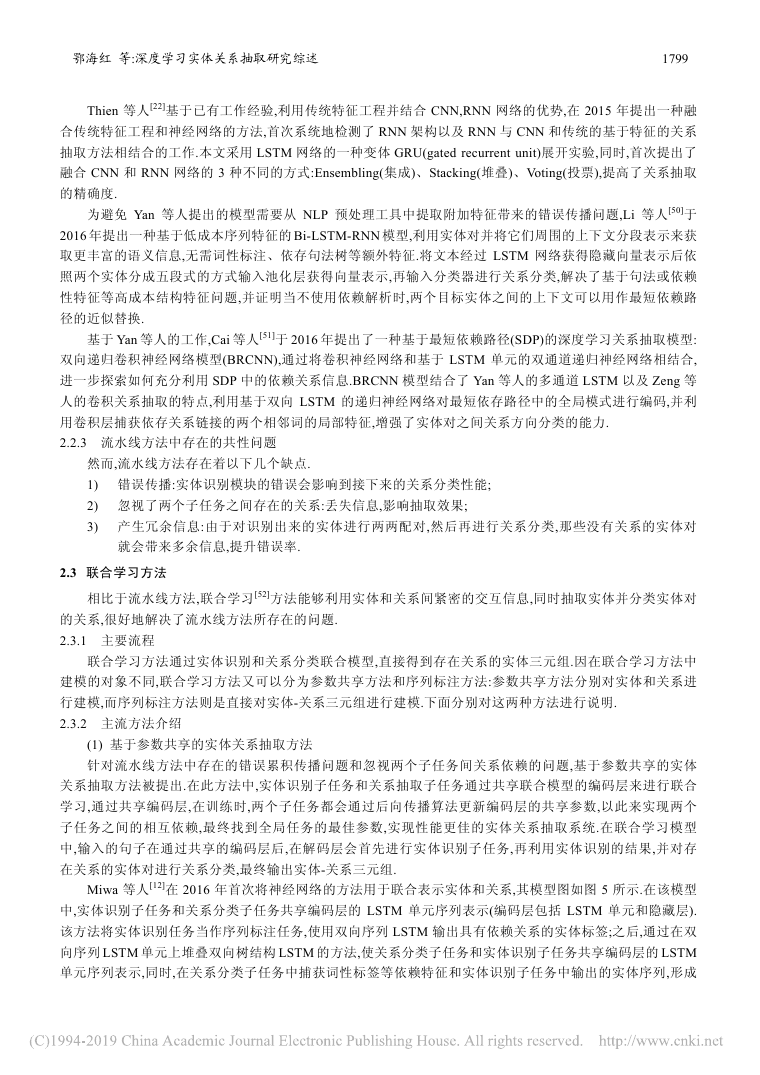

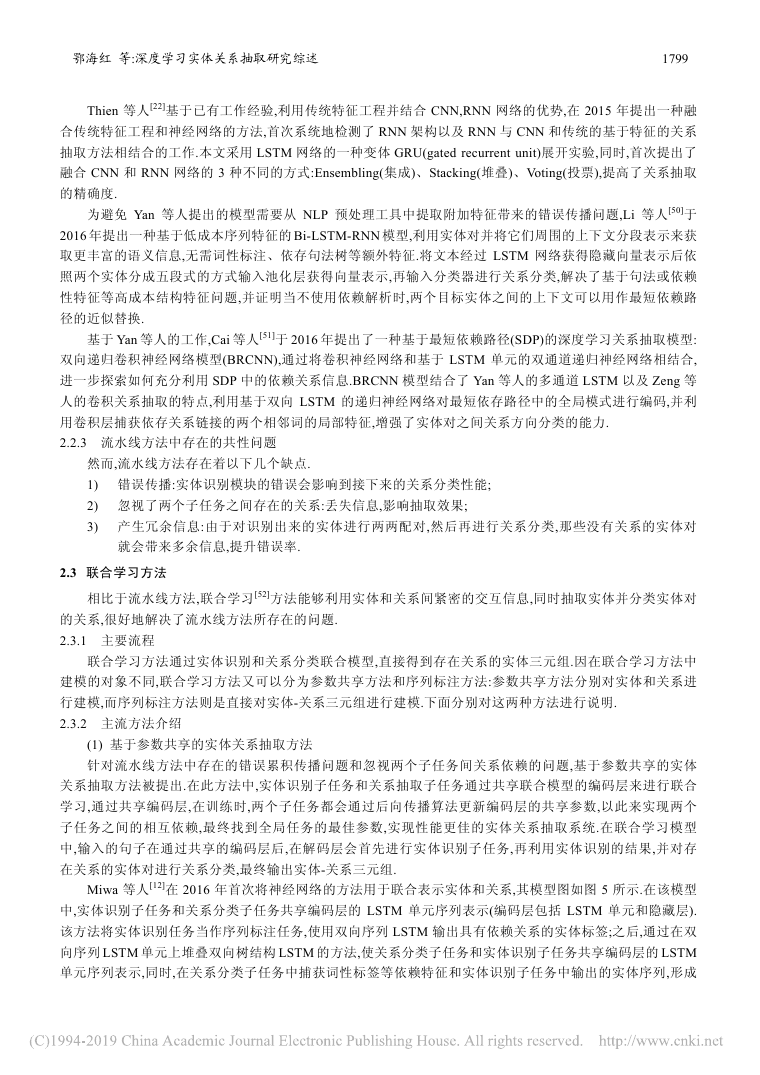

鄂海红 等:深度学习实体关系抽取研究综述 1799 Thien等人[22]基于已有工作经验,利用传统特征工程并结合CNN,RNN网络的优势,在2015年提出一种融合传统特征工程和神经网络的方法,首次系统地检测了RNN架构以及RNN与CNN和传统的基于特征的关系抽取方法相结合的工作.本文采用LSTM网络的一种变体GRU(gated recurrent unit)展开实验,同时,首次提出了融合CNN和RNN网络的3种不同的方式:Ensembling(集成)、Stacking(堆叠)、Voting(投票),提高了关系抽取的精确度. 为避免Yan等人提出的模型需要从NLP预处理工具中提取附加特征带来的错误传播问题,Li等人[50]于2016年提出一种基于低成本序列特征的Bi-LSTM-RNN模型,利用实体对并将它们周围的上下文分段表示来获取更丰富的语义信息,无需词性标注、依存句法树等额外特征.将文本经过LSTM网络获得隐藏向量表示后依照两个实体分成五段式的方式输入池化层获得向量表示,再输入分类器进行关系分类,解决了基于句法或依赖性特征等高成本结构特征问题,并证明当不使用依赖解析时,两个目标实体之间的上下文可以用作最短依赖路径的近似替换. 基于Yan等人的工作,Cai等人[51]于2016年提出了一种基于最短依赖路径(SDP)的深度学习关系抽取模型:双向递归卷积神经网络模型(BRCNN),通过将卷积神经网络和基于LSTM单元的双通道递归神经网络相结合,进一步探索如何充分利用SDP中的依赖关系信息.BRCNN模型结合了Yan等人的多通道LSTM以及Zeng等人的卷积关系抽取的特点,利用基于双向LSTM的递归神经网络对最短依存路径中的全局模式进行编码,并利用卷积层捕获依存关系链接的两个相邻词的局部特征,增强了实体对之间关系方向分类的能力. 2.2.3 流水线方法中存在的共性问题 然而,流水线方法存在着以下几个缺点. 1) 错误传播:实体识别模块的错误会影响到接下来的关系分类性能; 2) 忽视了两个子任务之间存在的关系:丢失信息,影响抽取效果; 3) 产生冗余信息:由于对识别出来的实体进行两两配对,然后再进行关系分类,那些没有关系的实体对就会带来多余信息,提升错误率. 2.3 联合学习方法 相比于流水线方法,联合学习[52]方法能够利用实体和关系间紧密的交互信息,同时抽取实体并分类实体对的关系,很好地解决了流水线方法所存在的问题. 2.3.1 主要流程 联合学习方法通过实体识别和关系分类联合模型,直接得到存在关系的实体三元组.因在联合学习方法中建模的对象不同,联合学习方法又可以分为参数共享方法和序列标注方法:参数共享方法分别对实体和关系进行建模,而序列标注方法则是直接对实体-关系三元组进行建模.下面分别对这两种方法进行说明. 2.3.2 主流方法介绍 (1) 基于参数共享的实体关系抽取方法 针对流水线方法中存在的错误累积传播问题和忽视两个子任务间关系依赖的问题,基于参数共享的实体关系抽取方法被提出.在此方法中,实体识别子任务和关系抽取子任务通过共享联合模型的编码层来进行联合学习,通过共享编码层,在训练时,两个子任务都会通过后向传播算法更新编码层的共享参数,以此来实现两个子任务之间的相互依赖,最终找到全局任务的最佳参数,实现性能更佳的实体关系抽取系统.在联合学习模型中,输入的句子在通过共享的编码层后,在解码层会首先进行实体识别子任务,再利用实体识别的结果,并对存在关系的实体对进行关系分类,最终输出实体-关系三元组. Miwa等人[12]在2016年首次将神经网络的方法用于联合表示实体和关系,其模型图如图5所示.在该模型中,实体识别子任务和关系分类子任务共享编码层的LSTM单元序列表示(编码层包括LSTM单元和隐藏层).该方法将实体识别任务当作序列标注任务,使用双向序列LSTM输出具有依赖关系的实体标签;之后,通过在双向序列LSTM单元上堆叠双向树结构LSTM的方法,使关系分类子任务和实体识别子任务共享编码层的LSTM单元序列表示,同时,在关系分类子任务中捕获词性标签等依赖特征和实体识别子任务中输出的实体序列,形成�

1800 Journal of Software 软件学报 Vol.30, No.6, June 2019 依存树,最终根据依存树中目标实体间的最短路径对文本进行关系抽取.但该模型中的关系分类子任务和实体识别子任务仅共享了编码层的双向序列LSTM表示,从严格意义上来说不是真正的联合模型.但是该模型的提出,为之后真正意义上联合学习模型的提出奠定了基础,是基于深度学习方法做联合学习模型的启发者. Fig.5 Relational extraction model diagram based on parameter sharing method 图5 基于参数共享方法的关系抽取模型图 Li等人[53]在2017年将该模型用于提取细菌和细菌位置之间存在的“Live-In”关系,并基于实际应用对Miwa模型做出了两点改进:1) 为改善从实体识别子任务到关系分类子任务可能会产生的错误累积传播问题,在关系分类子任务中引入一种新的关系“Invalid_Entity”,对实体识别子任务中产生的实体进行验证,以区分有效实体和无效实体,之后对有效实体再进行“Lives_In”和“not Lives_In”关系的分类;2) 在实体识别子任务中,因贪婪的从左到右逐步预测实体标签的方式可能会在这些标签之间带来错误传播,即先前预测中的错误可能会在随后的预测中引起新的错误,故将模型中原来的贪婪搜索解码换为波束搜索,因波束搜索中的每一步都可以有多个候选预测,在最佳预测不正确的情况下,可以根据全局分数排序来选择候选预测,并在波束搜索中用早期更新技术来训练模型,以缓解实体标签间的错误传播问题. Katiyar等人[54]在2016年首次将深度双向LSTM序列标注的方法用于联合提取观点实体和IS-FROM,IS- ABOUT关系,同时还提出了在输出层上添加句子级别的限制和关系级别的优化来提高模型的精确度.但这种方法只能识别观点实体和IS-FROM,IS-ABOUT关系,无法提取实体间的关系类型,模型也不能扩展用于抽取其他关系类型.之后,为改进模型无法扩展应用的问题,Katiyar等人[13]在自己2016年模型的基础上,于2017年首次将注意力机制与双向LSTM一起用于联合提取实体和分类关系.该方法的模型图如图5所示,实体识别子任务和关系分类子任务共享编码层表示(编码层包括LSTM单元和隐藏层).该模型在实体识别子任务中和Miwa等人[12]的模型一致,将实体识别子任务当作序列标注任务,使用多层双向LSTM网络来进行实体检测;在关系分类子任务上,该方法改善了Miwa等人[12]依赖于词性标签、依赖树等特征的缺点,基于实体识别子任务输出的实体序列表示和共享的编码层表示,使用注意力模型进行关系分类;同时,该模型还可以扩展提取各种定义好的关系类型,是真正意义上的第一个神经网络联合抽取模型. 其中,Miwa等人[12]和Katiyar等人[13]的模型图如图5所示.二者在实体识别子任务上的模型图基本相同,�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc