线性回归

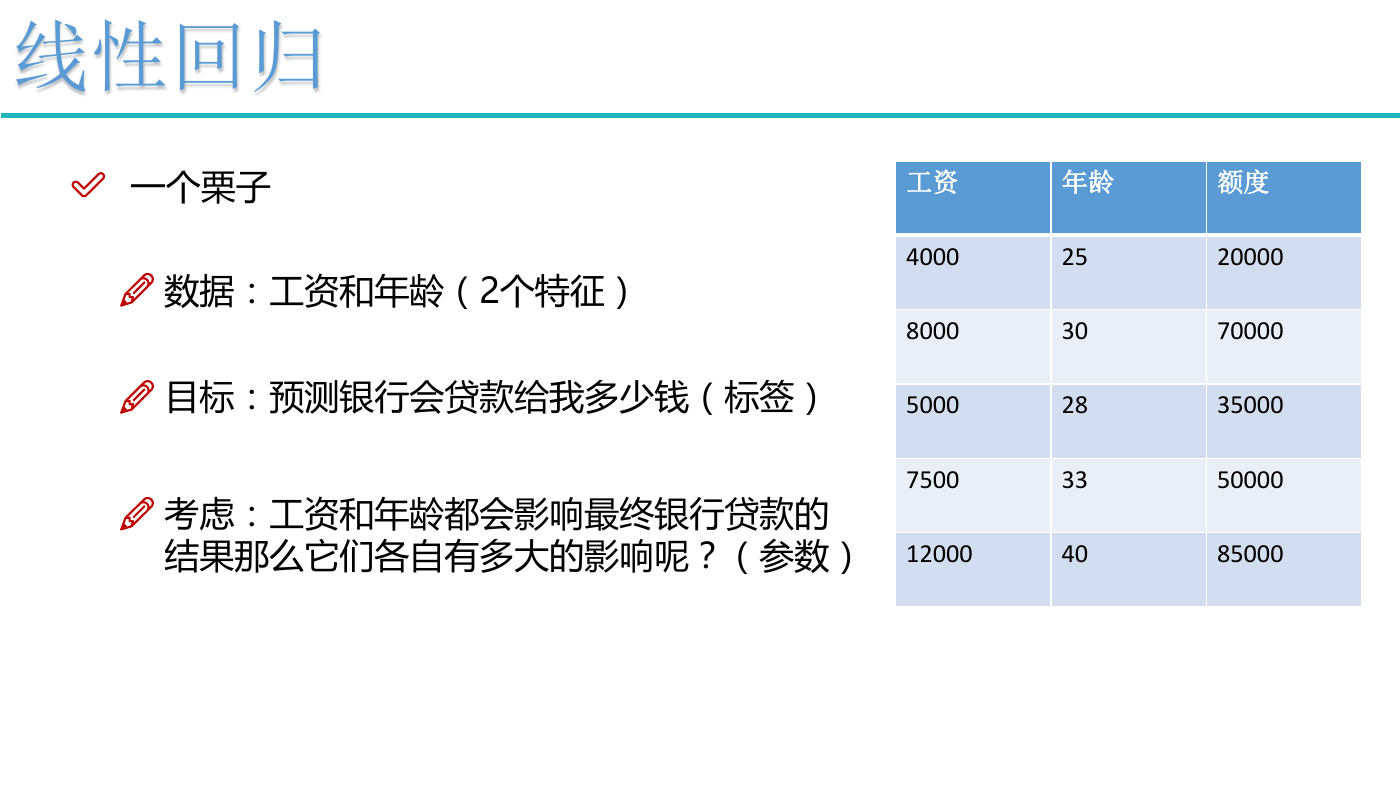

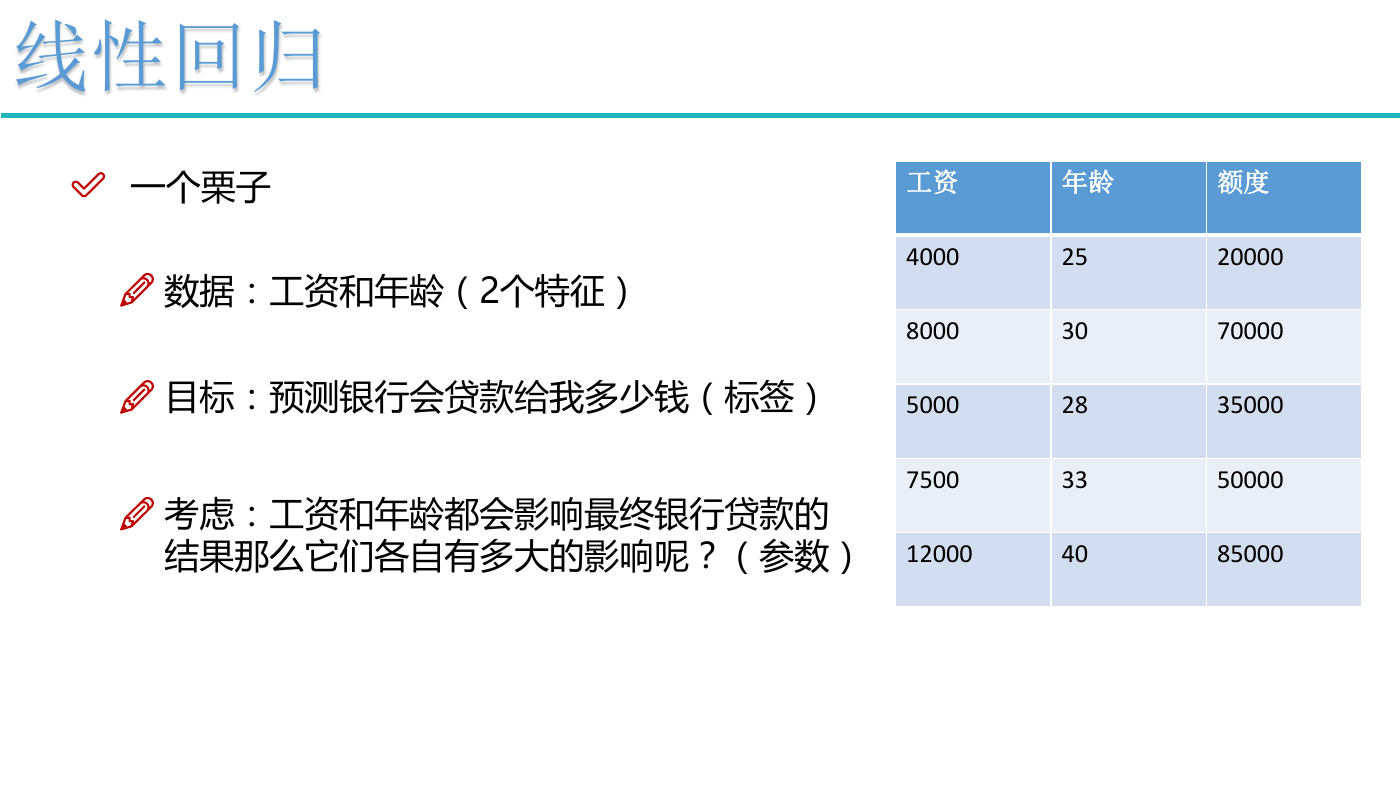

一个栗子

数据:工资和年龄(2个特征)

目标:预测银行会贷款给我多少钱(标签)

考虑:工资和年龄都会影响最终银行贷款的

结果那么它们各自有多大的影响呢?(参数)

工资

年龄

额度

4000

8000

5000

7500

12000

25

30

28

33

40

20000

70000

35000

50000

85000

�

线性回归

通俗解释

X1,X2就是我们的两个特征(年龄,工资)

Y是银行最终会借给我们多少钱

找到最合适的一条线(想象一个高维)来

最好的拟合我们的数据点

�

线性回归

数学来了

假设 是年龄的参数, 是工资的参数

拟合的平面:

( 是偏置项)

整合:

�

线性回归

误差

真实值和预测值之间肯定是要存在差异的

(用 来表示该误差)

对于每个样本:

�

线性回归

误差

误差 是独立并且具有相同的分布,

并且服从均值为0方差为 的高斯分布

独立:张三和李四一起来贷款,他俩没关系

同分布:他俩都来得是我们假定的这家银行

高斯分布:银行可能会多给,也可能会少给,但是绝大多数情况下

这个浮动不会太大,极小情况下浮动会比较大,符合正常情况

�

线性回归

误差

预测值与误差:

由于误差服从高斯分布:

将(1)式带入(2)式:

(1)

(2)

�

线性回归

误差

似然函数:

解释:什么样的参数跟我们的数据组合后恰好是真实值

对数似然:

解释:乘法难解,加法就容易了,对数里面乘法可以转换成加法

�

线性回归

误差

展开化简:

目标:让似然函数(对数变换后也一样)越大越好

(最小二乘法)

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc