系统工程与电子技术

Systems Engineering and Electronics

ISSN 1001-506X,CN 11-2422/TN

《系统工程与电子技术》网络首发论文

题目:

融合零样本学习和小样本学习的弱监督机器学习方法综述

作者:

潘崇煜,黄健,郝建国,龚建兴,张中杰

收稿日期:

2020-01-10

网络首发日期: 2020-03-19

引用格式:

潘崇煜,黄健,郝建国,龚建兴,张中杰.融合零样本学习和小样本学习的

弱监督机器学习方法综述[J/OL].系统工程与电子技术.

http://kns.cnki.net/kcms/detail/11.2422.tn.20200318.1046.030.html

网络首发:在编辑部工作流程中,稿件从录用到出版要经历录用定稿、排版定稿、整期汇编定稿等阶

段。录用定稿指内容已经确定,且通过同行评议、主编终审同意刊用的稿件。排版定稿指录用定稿按照期

刊特定版式(包括网络呈现版式)排版后的稿件,可暂不确定出版年、卷、期和页码。整期汇编定稿指出

版年、卷、期、页码均已确定的印刷或数字出版的整期汇编稿件。录用定稿网络首发稿件内容必须符合《出

版管理条例》和《期刊出版管理规定》的有关规定;学术研究成果具有创新性、科学性和先进性,符合编

辑部对刊文的录用要求,不存在学术不端行为及其他侵权行为;稿件内容应基本符合国家有关书刊编辑、

出版的技术标准,正确使用和统一规范语言文字、符号、数字、外文字母、法定计量单位及地图标注等。

为确保录用定稿网络首发的严肃性,录用定稿一经发布,不得修改论文题目、作者、机构名称和学术内容,

只可基于编辑规范进行少量文字的修改。

出版确认:纸质期刊编辑部通过与《中国学术期刊(光盘版)》电子杂志社有限公司签约,在《中国

学术期刊(网络版)》出版传播平台上创办与纸质期刊内容一致的网络版,以单篇或整期出版形式,在印刷

出版之前刊发论文的录用定稿、排版定稿、整期汇编定稿。因为《中国学术期刊(网络版)》是国家新闻出

版广电总局批准的网络连续型出版物(ISSN 2096-4188,CN 11-6037/Z),所以签约期刊的网络版上网络首

发论文视为正式出版。

�

网络首发时间:2020-03-19 10:27:07

网络首发地址:http://kns.cnki.net/kcms/detail/11.2422.tn.20200318.1046.030.html

系统工程与电子技术

Systems Engineering and Electronics

融合零样本学习和小样本学习的

弱监督机器学习方法综述

潘崇煜,黄 健,郝建国,龚建兴,张中杰

(国防科技大学智能科学学院,湖南 长沙 410073)

摘 要:近年来,深度学习模型在图像、语音、文本识别等领域内取得了显著成就。然而,

深度学习模型严重依赖于大量标签数据,使得其在数据缺乏的特殊领域内应用严重受限。面

对数据缺乏等现实挑战,很多学者针对数据依赖小的弱监督机器学习方法开展研究,出现了

很多典型研究方向,如小样本学习、零样本学习等。针对弱监督机器学习方法,系统阐述了

小样本学习、零样本学习、零—小样本学习的问题定义、当前主要方法以及主流实验设计,

最后基于当前研究中出现的问题,对下一阶段研究方向进行了总结展望。

关键词: 弱监督机器学习;小样本学习;零样本学习;零—小样本学习

中图分类号: TP 391.41 文献标志码: A

Survey of semi-supervised learning including few-shot and

zero-shot learning

PAN Chongyu, HUANG Jian, HAO Jianguo, GONG Jianxing, ZHANG Zhongjie

( College of Intelligence Science, National University of Defense Technology, Changsha 410073, China)

Abstract: Recently, deep learning has achieved significant achievements among image, video

and even textual domains. However, it heavily depends on huge amount of human-annotated data,

making it seriously limited to some domains where there is no large number of labeled samples.

Due to the data deficiency problem in practice, some researches are carried out to semi-supervised

learning which does not depend on large labeled data. In this paper, some semi-supervised learning

issues are

learning and even novel

zero-to-few-shot learning. Especially, the problem definition, the current researches and main

experimental settings are introduced. Finally, some further research directions towards more

human-like intelligence are figured out.

including few-shot

investigated,

learning, zero-shot

Keywords: semi-supervised learning; few-shot learning; zero-shot learning; zero-to-few-shot

learning

0 引 言

近年来,深度学习模型在诸多领域取得了引

人瞩目的成就,如图像分类、语音识别以及棋类

对弈等。然而,包括深度学习在内,以大数据为

基础的传统监督学习模型严重依赖于大量人工

标注的高质量标签数据,在很多领域内,数据缺

乏,这些模型很难取得应有成效。针对数据缺乏

———————————————

收稿日期:2020-01-10;修回日期:2020-02-25

基金项目:国家自然科学基金(61906202)资助课题

的现实情况,当前很多研究[1-2]关注数据依赖小

的弱监督机器学习方法,如小样本学习以及零样

本学习等。

小样本学习试图在有限样本条件下实现对

新类别或新概念的有效认知。通过度量学习、样

本生成等途径,已有一些方法在少量支持样本情

况下实现了新概念识别。尽管取得了一定成效,

每个新类别中的几个支持样本仍然难以准确表

�

系统工程与电子技术

Systems Engineering and Electronics

征整个类别的特征分布,这使得小样本学习任务

仍然充满了挑战性。

相对于小样本学习,零样本学习试图识别训

练过程中从未见过的新类别概念。特别地,这需

要额外的语义特征辅助信息,如训练集和待分类

的测试集类别语义特征描述向量,借此实现从训

练集向测试集类别的知识迁移。由于其内在固有

的域适应及枢纽度问题[3],零样本学习也面临着

识别精度不高等问题。

基于零样本学习和小样本学习面临的诸多

问题,正如文献[3]指出,在当前小样本学习中融

合额外的语义文本信息是一个重要的研究方向,

即零-小样本学习。零-小样本学习既包含了小样

本学习中若干支持样本特征,同时考虑了语义特

征辅助信息,可以有效提高弱监督机器学习的识

别性能,同时也更加符合人类对新概念、新事物

举一反三、多方融合的认知原理。

本文从小样本学习和零样本学习入手,重点

开展了问题描述、典型方法介绍、实验设计以及

性能对比。基于小样本学习和零样本学习之间的

信息互补,本文介绍了零-小样本学习这一新问

题。在此基础上,本文指出了多种弱监督学习方

法融合发展、基础理论探索以及多领域上扩展等

重要发展方向。

1 小样本学习

小样本学习(Few-Shot Learning, FSL)旨在

通过有限样本对新的类别或者概念进行识别,本

节首先给出明确问题描述,之后回顾目前主流方

法和模型,最后介绍具体的实验设计和部分基准

结果。

1.1 问题描述

s,

给定由 Ns 个训练样本构成的训练集 Ds={(Ii

s ϵ Cs

s), i=1,2.. Ns},其中 Ii

zi

是其类别标签,Cs 是训练集标签集合。Ds 通常

由大量训练样本构成。

s 是第 i 个样本图像,zi

在测试阶段,对于新的类别 Ct(测试类别与

训练集类别不同,即 Cs ∩ Ct = Ø.),每个类别给

t), j=1,2….Nt},小样本识

定几个支持样本{(Ij

t 进行识别,确定

别的任务是对新的测试样本 Ik

其对应的类别标签 zj

1.2 当前主流模型

t ϵ Ct。

t, zj

小样本学习领域目前已经出现很多方法和

模型,这些方法可以概括为基于度量的方法、基

于优化的方法、基于生成式模型的方法、基于图

神经网络的方法以及基于记忆单元的方法。表 1

对这几种主流方法进行了简要列举和分析。

表 1 小样本学习方法对比分析

Table 1 Comparisions of the different methods for few-shot learning

方法

机制

优点

缺点

适用范围

基于度量的方法

在某一度量空间中直

接进行对比匹配;

模型直观,易于理解;

基于优化的方法

基 于 生 成 式 模 型 的

方法

基 于 图 神 经 网 络 的

方法

基 于 记 忆 单 元 的 方

法

通过模型自适应优化

使之适应新任务;

通 过 生 成 新 类 别 样

本,转化为监督学习

问题;

通过边和节点迭代更

新各样本及其之间关

系;

通过动态更新内存状

态实现新类别学习;

训练集样本数量要求相对

较高;

性 能 对 模 型 结 构 敏 感 度

高;

测试任务需和训练任务实

验设置相同,灵活性较差;

支持样本数据量较大的

情况;

测试环境和训练环境具

有相同设置的情况;

生成样本代表性问题;

模型训练困难;

类别数及支持样本数量

较小的情况;

模型具备快速适应新任

务的能力;

分步执行,易于追溯;

模型结构简单;

计算量随支持样本数增加

激增;

类别数及支持样本数量

较小的情况;

模型可动态更新;

额外增加外置记忆单元,

增大内存需求;

类别数及支持样本数量

较小的情况;

(1)基于度量的方法

基于度量的方法核心思想是学习样本之间

的相似度。孪生网络[4]是最早的基于度量学习的

小样本学习模型,该模型通过卷积神经网络直接

学习两个样本之间的相似度。之后,文献[5]提出

了基于元学习的匹配网络,元学习是一种训练策

略,具体算法流程如表 2 所示。

表 2 元学习训练范式

Table 2 Training paradigm of the meta-learning

算法 1:Episode-Based Meta Training

2

�

系统工程与电子技术

Systems Engineering and Electronics

步骤 1: 在训练集中构建M-way N-shot Q-query 子任务数

据集 Dtr;

步骤 2: 基于设计好的模型及 Dtr,前向计算模型损失函

数 Loss;

步骤 3: 基于子任务损失函数 Loss 更新模型参数;

步骤 4: 返回步骤 1,直至达到迭代次数。

匹 配 网 络 利 用 了 双 向 长 短 时 记 忆 (long

short-term memory, LSTM)网络模型以及注意力

机制来学习样本之间的度量函数。原型网络[6]

也是一种典型的度量学习模型,将图像特征映射

到一度量空间中,在该空间中,将同类多个样本

均值作为代表该类别的原型样本点,对于待识别

的样本,通过在多类的原型样本点之间进行最近

邻距离实现分类,该方法直接用欧氏距离作为距

离度量,仅学习图像编码网络。值得一提的是,

文献[7]和文献[8]提出了包含图像编码模块及关系

度量模块的关系网络,原始图像经过卷积神经网

络(convolutional neural network,CNN)编码模块

形成图像特征向量,之后待测试样本与支持样本

连接形成图像对,经过关系网络度量每一图像对

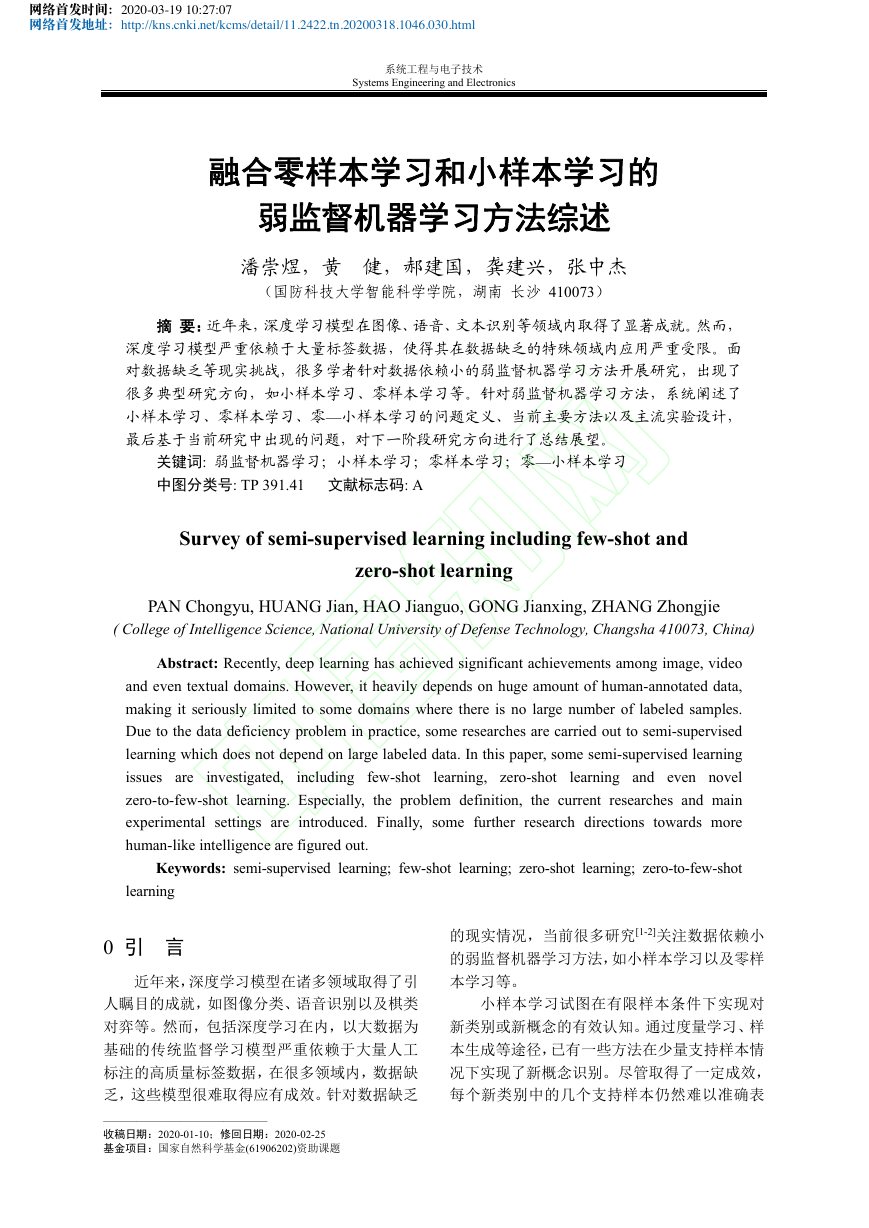

的相似度。如图 1 所示[7],该模型同时学习编码

网络和度量函数,与以往使用某一固定度量函数

不同,该模型通过训练学习了一个非线性的度量

函数,提高了模型的适应性。

基于度量的小样本学习方法模型通常较为

直观,易于理解,具备较强的可解释性,但往往

需要大量训练数据,对于训练集样本数量要求较

高,且最终性能对模型结构敏感度较高,模型细

节设计对性能影响较大。

图 1 基于度量的小样本学习模型—关系网络

Fig. 1 Metric based method for few-shot learning—relation network

(2)基于优化的方法

基于优化的方法基于元学习的思想,旨在学

习一组元分类器,这些分类器可以在新的任务上

通过参数微调实现较好的分类性能。最典型的优

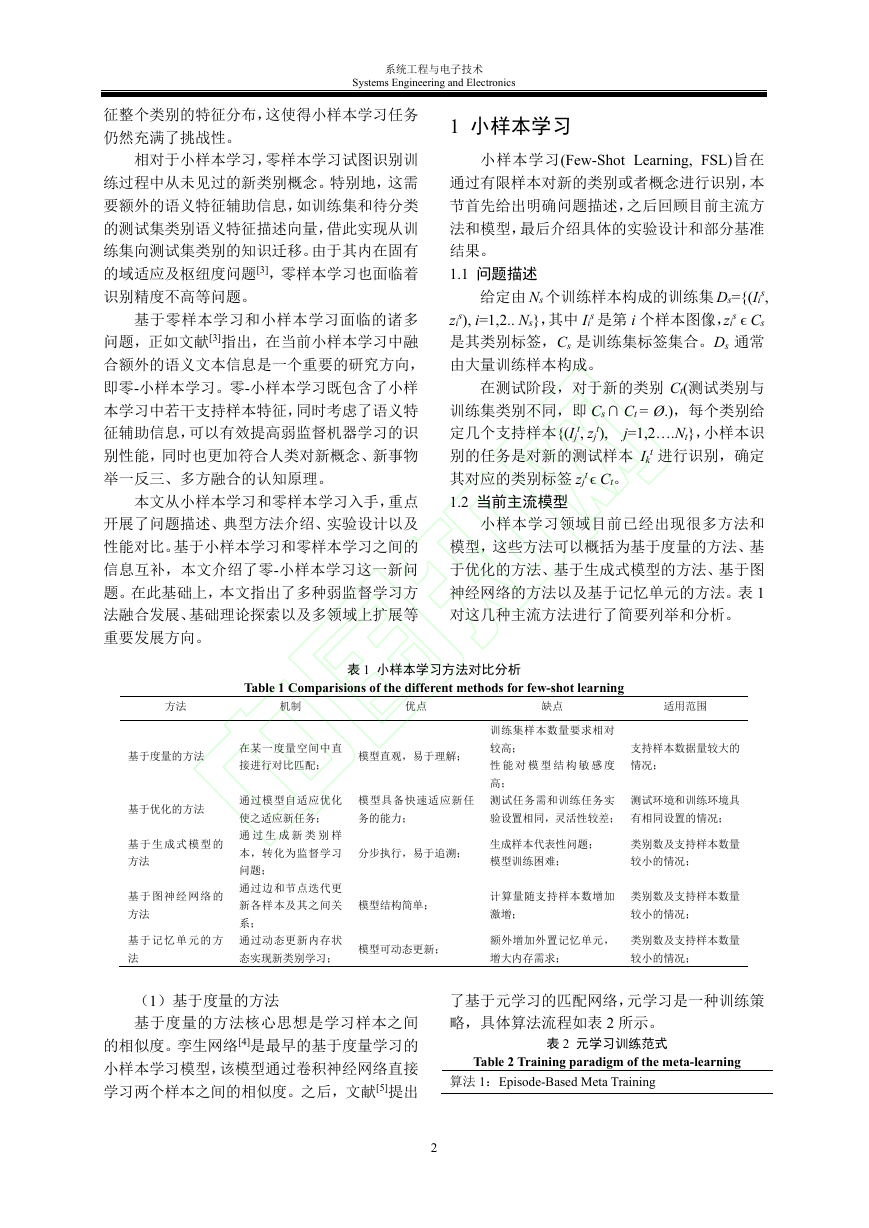

化 方 法 是 模 型 无 关 元 学 习(model-agnostic

meta-learning, MAML)算法[9],如图 2 所示,该方

法通过大量训练数据学习到一组好的初始化参数,

在新任务测试时,仅通过很少的参数迭代步数,

模型即可自适应到该新任务上。基于元学习思想,

之后又出现了很多基于优化的小样本学习方法,

包括 meta network[10], meta-SGD[11], meta-learner

LSTM[12]以及其他变种[13]。

基于优化的小样本学习模型具备快速适应

新任务的能力,但却存在明显的缺陷,即模型只

3

能在固定任 务上预训练 和迁移,如 在 5-way

1-shot 分类任务上训练的模型只能适应 5-way

1-shot 的任务,缺乏灵活性。

图 2 基于优化的小样本学习方法—模型无关元学习方法

Fig. 2 Optimization based method

few-shot

learning—MAM

for

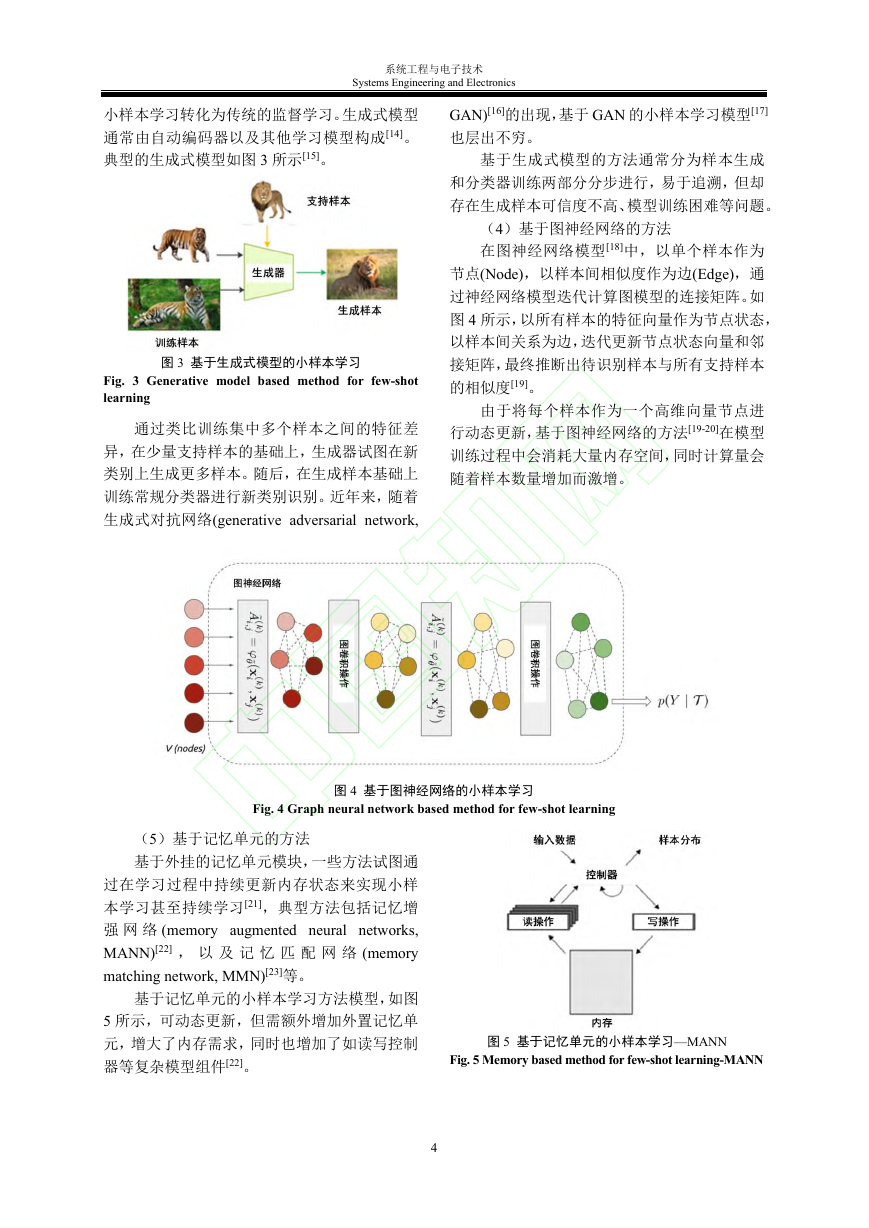

(3)基于生成式模型的方法

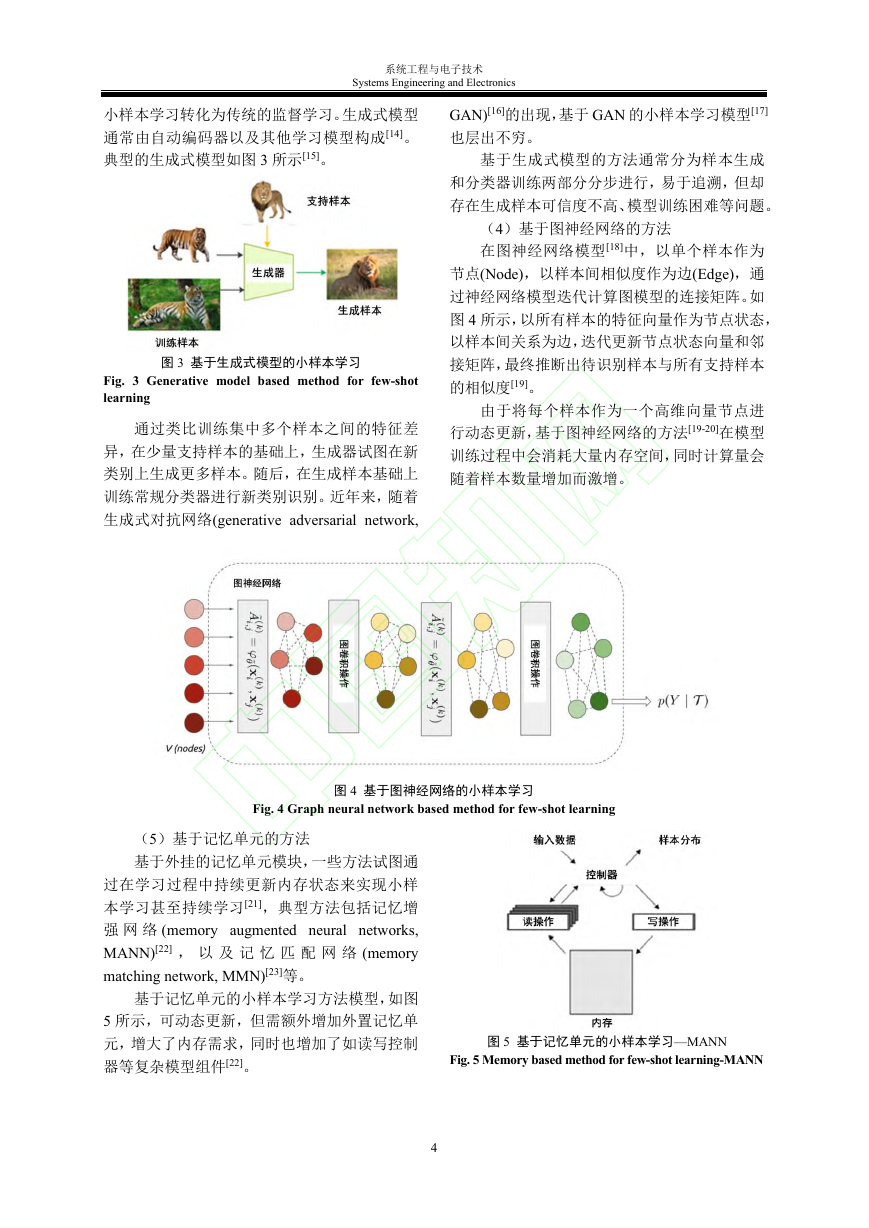

基于大量训练数据以及少量的支持样本,生

成式模型期望生成大量新类别数据样本,进而将

�

系统工程与电子技术

Systems Engineering and Electronics

小样本学习转化为传统的监督学习。生成式模型

通常由自动编码器以及其他学习模型构成[14]。

典型的生成式模型如图 3 所示[15]。

图 3 基于生成式模型的小样本学习

Fig. 3 Generative model based method for few-shot

learning

通过类比训练集中多个样本之间的特征差

异,在少量支持样本的基础上,生成器试图在新

类别上生成更多样本。随后,在生成样本基础上

训练常规分类器进行新类别识别。近年来,随着

生成式对抗网络(generative adversarial network,

GAN)[16]的出现,基于 GAN 的小样本学习模型[17]

也层出不穷。

基于生成式模型的方法通常分为样本生成

和分类器训练两部分分步进行,易于追溯,但却

存在生成样本可信度不高、模型训练困难等问题。

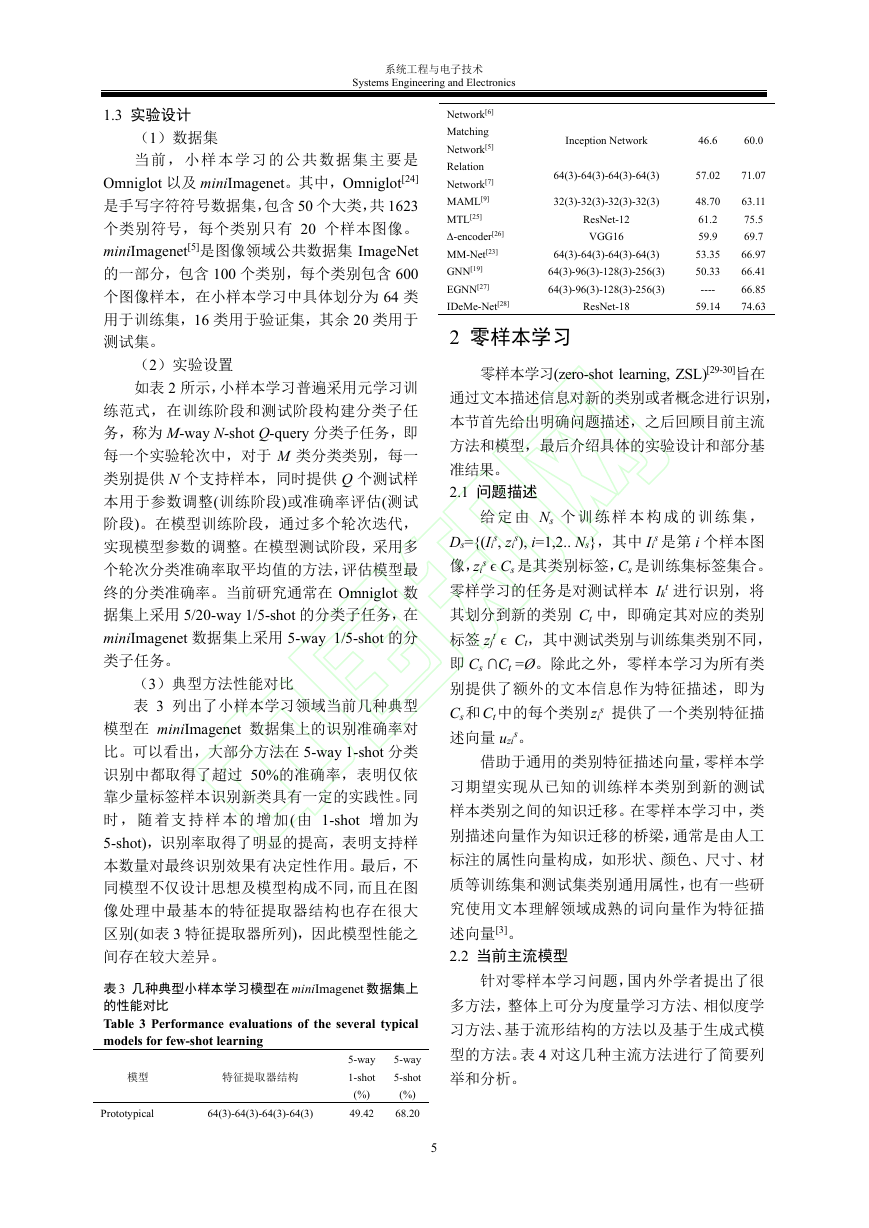

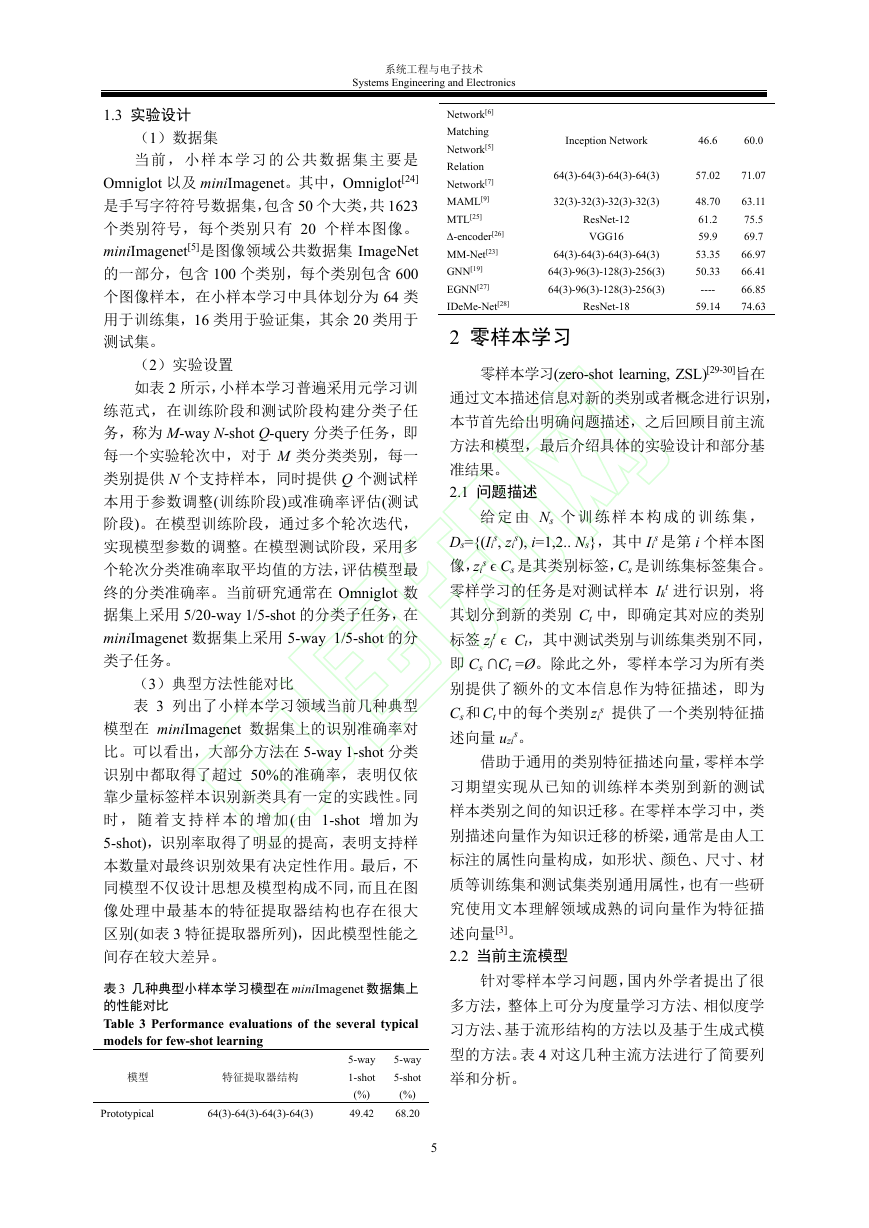

(4)基于图神经网络的方法

在图神经网络模型[18]中,以单个样本作为

节点(Node),以样本间相似度作为边(Edge),通

过神经网络模型迭代计算图模型的连接矩阵。如

图 4 所示,以所有样本的特征向量作为节点状态,

以样本间关系为边,迭代更新节点状态向量和邻

接矩阵,最终推断出待识别样本与所有支持样本

的相似度[19]。

由于将每个样本作为一个高维向量节点进

行动态更新,基于图神经网络的方法[19-20]在模型

训练过程中会消耗大量内存空间,同时计算量会

随着样本数量增加而激增。

图 4 基于图神经网络的小样本学习

Fig. 4 Graph neural network based method for few-shot learning

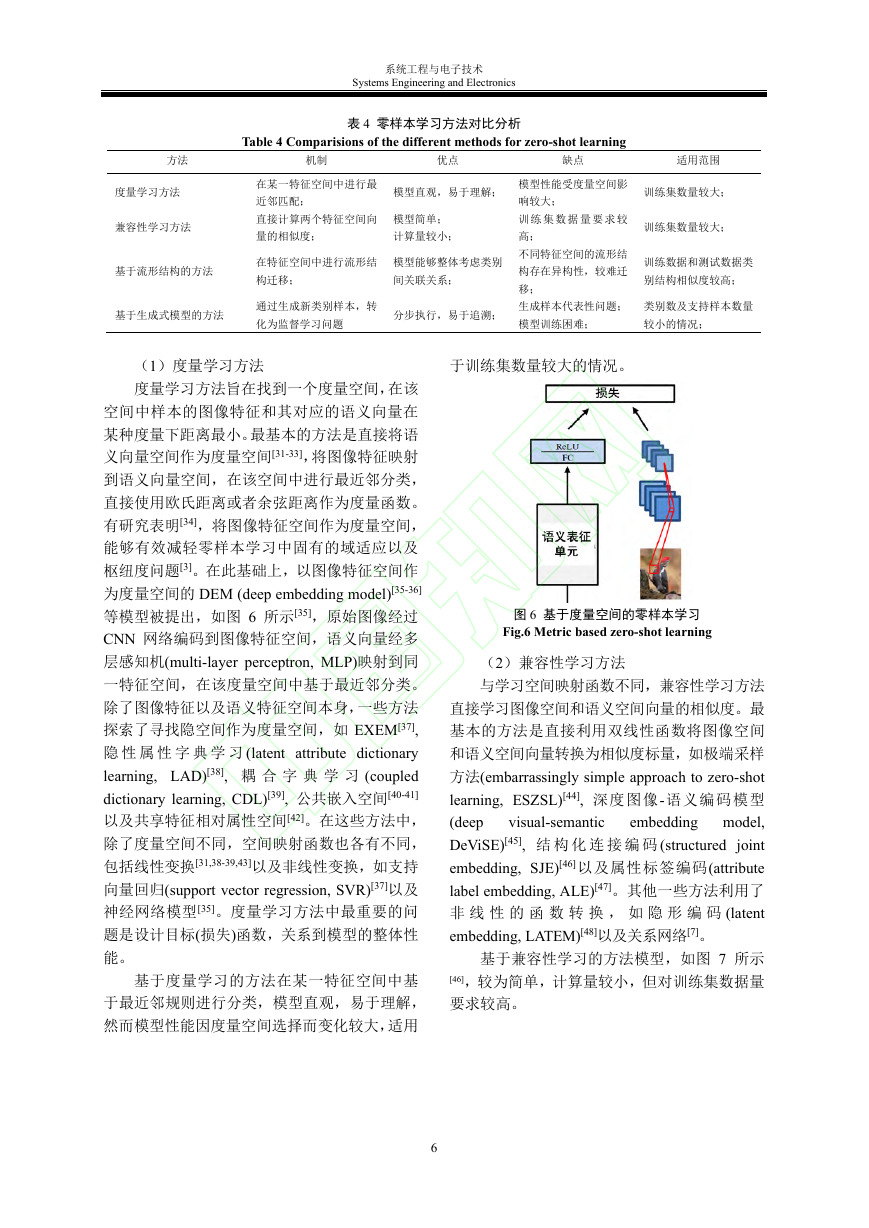

(5)基于记忆单元的方法

基于外挂的记忆单元模块,一些方法试图通

过在学习过程中持续更新内存状态来实现小样

本学习甚至持续学习[21],典型方法包括记忆增

强 网 络(memory augmented neural networks,

MANN)[22] , 以 及 记 忆 匹 配 网 络(memory

matching network, MMN)[23]等。

基于记忆单元的小样本学习方法模型,如图

5 所示,可动态更新,但需额外增加外置记忆单

元,增大了内存需求,同时也增加了如读写控制

器等复杂模型组件[22]。

图 5 基于记忆单元的小样本学习—MANN

Fig. 5 Memory based method for few-shot learning-MANN

4

�

系统工程与电子技术

Systems Engineering and Electronics

1.3 实验设计

(1)数据集

当前,小样 本学习的公 共数据集主 要 是

Omniglot 以及 miniImagenet。其中,Omniglot[24]

是手写字符符号数据集,包含 50 个大类,共 1623

个类别符号,每个类别只有 20 个样本图像。

miniImagenet[5]是图像领域公共数据集 ImageNet

的一部分,包含 100 个类别,每个类别包含 600

个图像样本,在小样本学习中具体划分为 64 类

用于训练集,16 类用于验证集,其余 20 类用于

测试集。

(2)实验设置

如表 2 所示,小样本学习普遍采用元学习训

练范式,在训练阶段和测试阶段构建分类子任

务,称为 M-way N-shot Q-query 分类子任务,即

每一个实验轮次中,对于 M 类分类类别,每一

类别提供 N 个支持样本,同时提供 Q 个测试样

本用于参数调整(训练阶段)或准确率评估(测试

阶段)。在模型训练阶段,通过多个轮次迭代,

实现模型参数的调整。在模型测试阶段,采用多

个轮次分类准确率取平均值的方法,评估模型最

终的分类准确率。当前研究通常在 Omniglot 数

据集上采用 5/20-way 1/5-shot 的分类子任务,在

miniImagenet 数据集上采用 5-way 1/5-shot 的分

类子任务。

(3)典型方法性能对比

表 3 列出了小样本学习领域当前几种典型

模型在 miniImagenet 数据集上的识别准确率对

比。可以看出,大部分方法在 5-way 1-shot 分类

识别中都取得了超过 50%的准确率,表明仅依

靠少量标签样本识别新类具有一定的实践性。同

时 , 随 着 支 持 样 本 的 增 加( 由 1-shot 增 加 为

5-shot),识别率取得了明显的提高,表明支持样

本数量对最终识别效果有决定性作用。最后,不

同模型不仅设计思想及模型构成不同,而且在图

像处理中最基本的特征提取器结构也存在很大

区别(如表 3 特征提取器所列),因此模型性能之

间存在较大差异。

表 3 几种典型小样本学习模型在 miniImagenet 数据集上

的性能对比

Table 3 Performance evaluations of the several typical

models for few-shot learning

模型

特征提取器结构

Prototypical

64(3)-64(3)-64(3)-64(3)

5-way

1-shot

(%)

49.42

5-way

5-shot

(%)

68.20

5

64(3)-64(3)-64(3)-64(3)

32(3)-32(3)-32(3)-32(3)

ResNet-12

VGG16

Network[6]

Matching

Network[5]

Relation

Network[7]

MAML[9]

MTL[25]

∆-encoder[26]

MM-Net[23]

GNN[19]

EGNN[27]

IDeMe-Net[28]

2 零样本学习

Inception Network

64(3)-64(3)-64(3)-64(3)

64(3)-96(3)-128(3)-256(3)

64(3)-96(3)-128(3)-256(3)

ResNet-18

46.6

60.0

57.02

71.07

48.70

61.2

59.9

53.35

50.33

----

59.14

63.11

75.5

69.7

66.97

66.41

66.85

74.63

零样本学习(zero-shot learning, ZSL)[29-30]旨在

通过文本描述信息对新的类别或者概念进行识别,

本节首先给出明确问题描述,之后回顾目前主流

方法和模型,最后介绍具体的实验设计和部分基

准结果。

2.1 问题描述

s, zi

s), i=1,2.. Ns},其中 Ii

给 定 由 Ns 个 训 练 样 本 构 成 的 训 练 集 ,

s 是第 i 个样本图

Ds={(Ii

s ϵ Cs 是其类别标签,Cs 是训练集标签集合。

像,zi

t 进行识别,将

零样学习的任务是对测试样本 Ik

其划分到新的类别 Ct 中,即确定其对应的类别

t ϵ Ct,其中测试类别与训练集类别不同,

标签 zj

即 Cs ∩Ct =Ø。除此之外,零样本学习为所有类

别提供了额外的文本信息作为特征描述,即为

s 提供了一个类别特征描

Cs和 Ct中的每个类别 zi

述向量 uzi

s。

借助于通用的类别特征描述向量,零样本学

习期望实现从已知的训练样本类别到新的测试

样本类别之间的知识迁移。在零样本学习中,类

别描述向量作为知识迁移的桥梁,通常是由人工

标注的属性向量构成,如形状、颜色、尺寸、材

质等训练集和测试集类别通用属性,也有一些研

究使用文本理解领域成熟的词向量作为特征描

述向量[3]。

2.2 当前主流模型

针对零样本学习问题,国内外学者提出了很

多方法,整体上可分为度量学习方法、相似度学

习方法、基于流形结构的方法以及基于生成式模

型的方法。表 4 对这几种主流方法进行了简要列

举和分析。

�

系统工程与电子技术

Systems Engineering and Electronics

表 4 零样本学习方法对比分析

Table 4 Comparisions of the different methods for zero-shot learning

方法

机制

优点

缺点

适用范围

度量学习方法

兼容性学习方法

在某一特征空间中进行最

近邻匹配;

直接计算两个特征空间向

量的相似度;

模型直观,易于理解;

模型简单;

计算量较小;

基于流形结构的方法

在特征空间中进行流形结

构迁移;

模型能够整体考虑类别

间关联关系;

基于生成式模型的方法

通过生成新类别样本,转

化为监督学习问题

分步执行,易于追溯;

模型性能受度量空间影

响较大;

训 练 集 数 据 量 要 求 较

高;

不同特征空间的流形结

构存在异构性,较难迁

移;

生成样本代表性问题;

模型训练困难;

训练集数量较大;

训练集数量较大;

训练数据和测试数据类

别结构相似度较高;

类别数及支持样本数量

较小的情况;

于训练集数量较大的情况。

图 6 基于度量空间的零样本学习

Fig.6 Metric based zero-shot learning

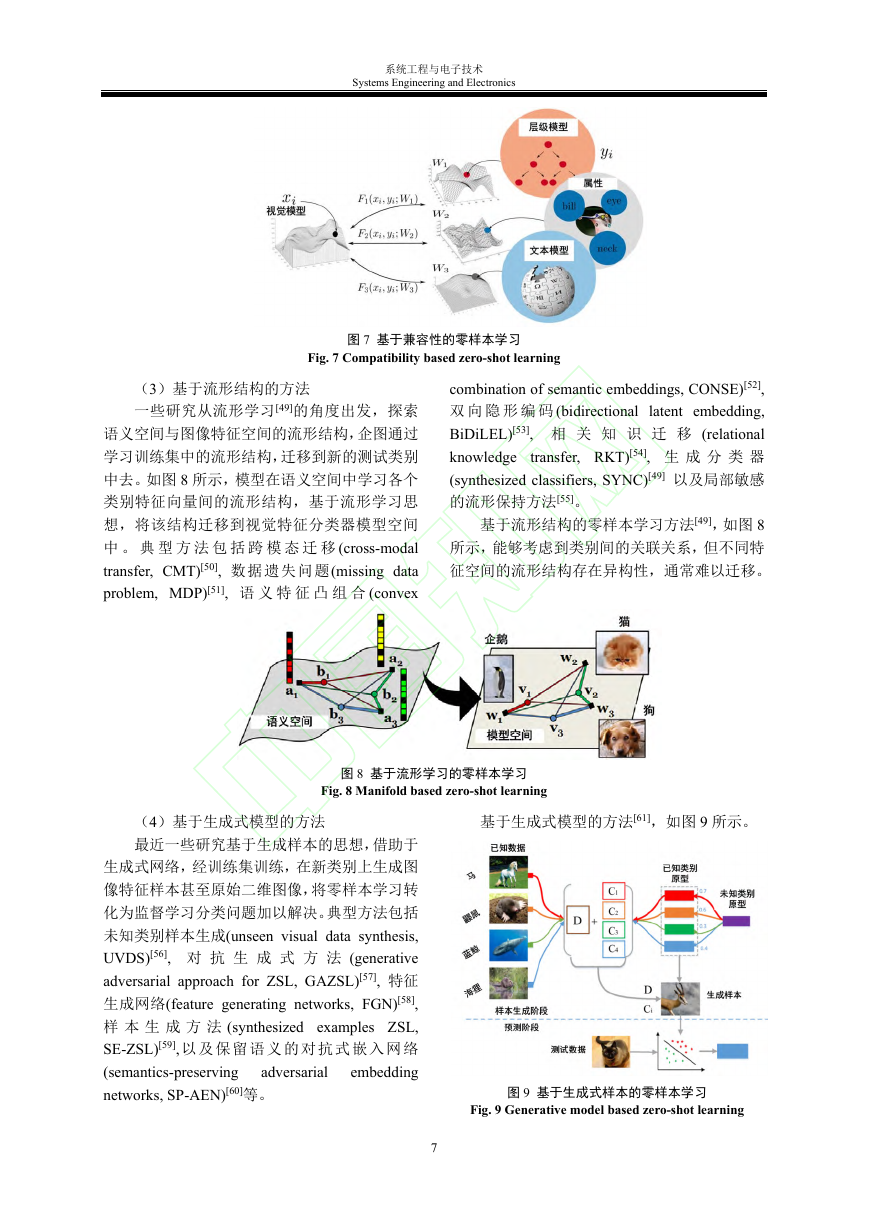

(2)兼容性学习方法

与学习空间映射函数不同,兼容性学习方法

直接学习图像空间和语义空间向量的相似度。最

基本的方法是直接利用双线性函数将图像空间

和语义空间向量转换为相似度标量,如极端采样

方法(embarrassingly simple approach to zero-shot

learning, ESZSL)[44], 深度图像- 语义编码模型

(deep

embedding model,

DeViSE)[45], 结 构 化 连 接 编 码(structured joint

embedding, SJE)[46]以及属性标签编码(attribute

label embedding, ALE)[47]。其他一些方法利用了

非 线 性 的 函 数 转 换 , 如 隐 形 编 码 (latent

embedding, LATEM)[48]以及关系网络[7]。

visual-semantic

基于兼容性学习的方法模型,如图 7 所示

[46],较为简单,计算量较小,但对训练集数据量

要求较高。

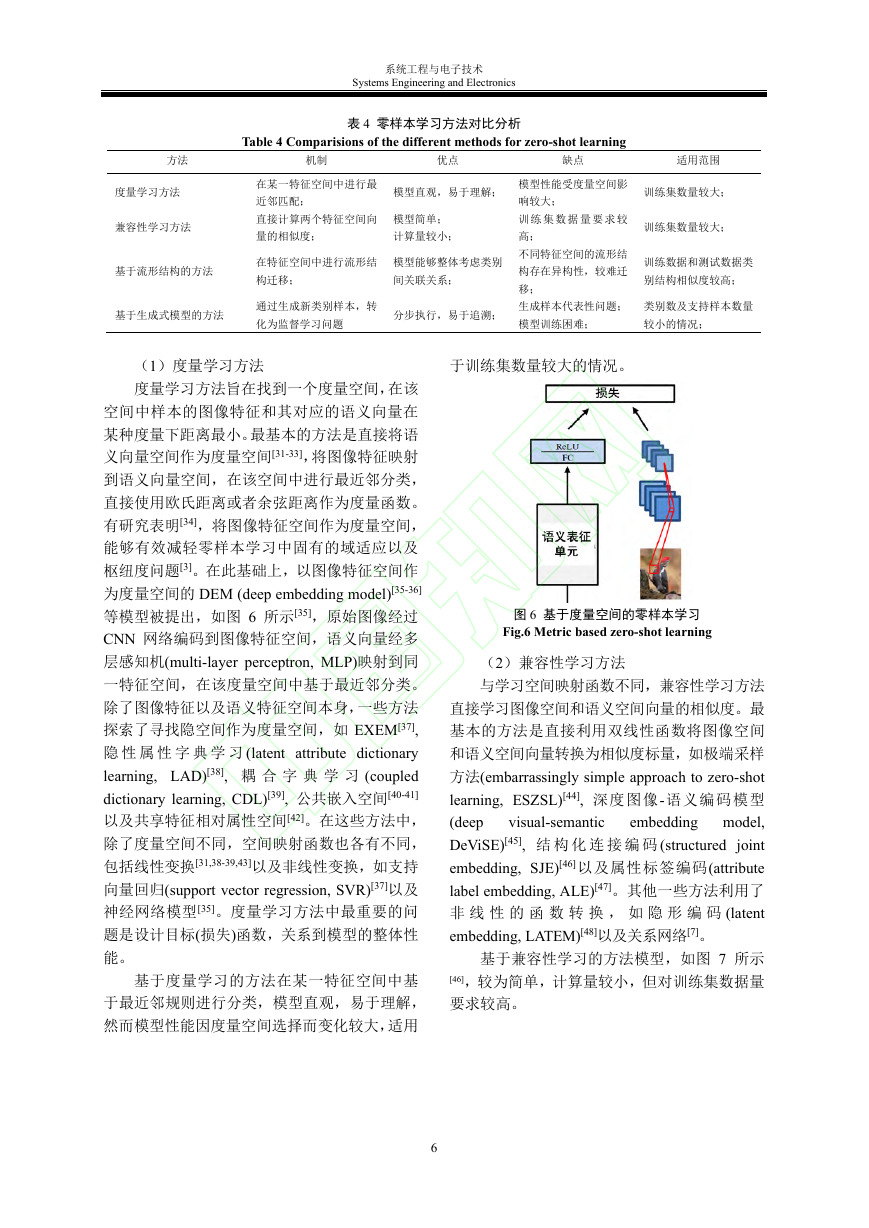

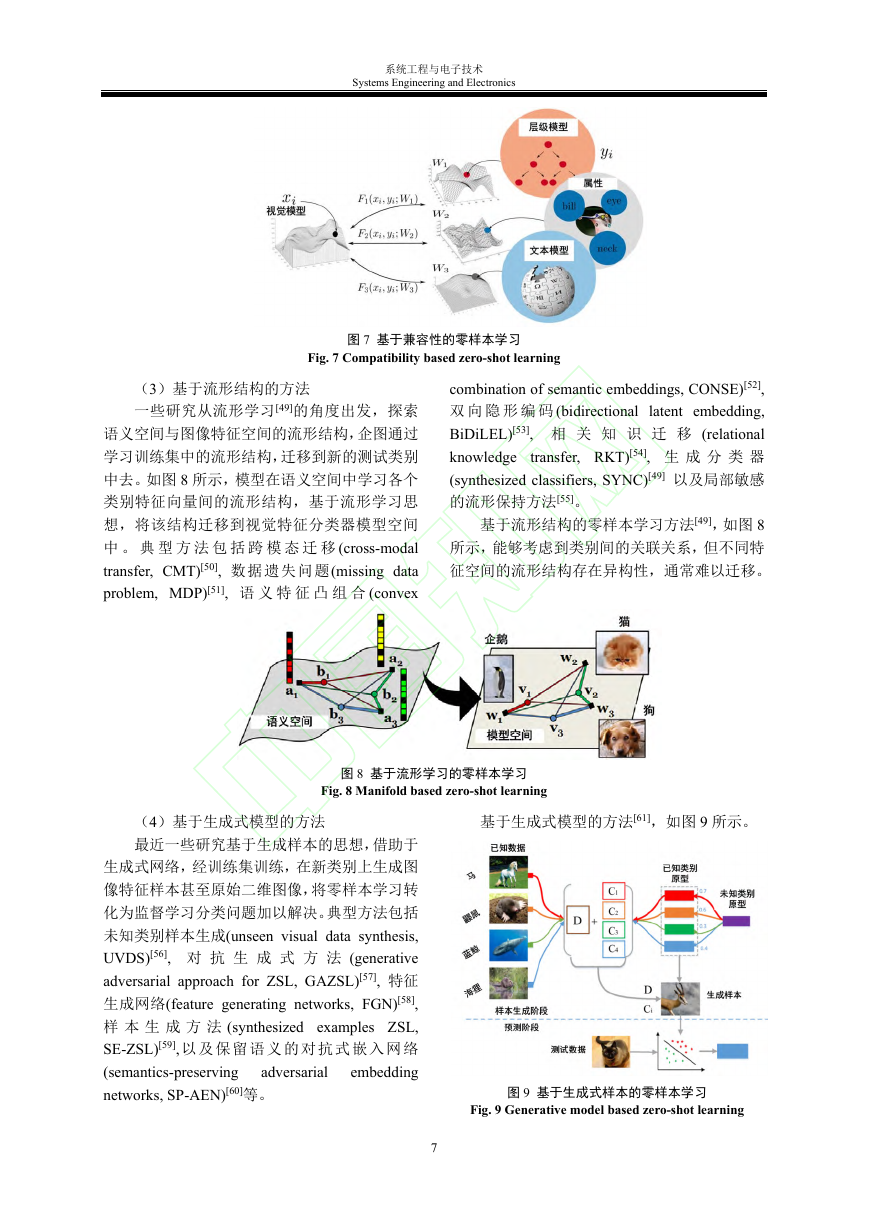

(1)度量学习方法

度量学习方法旨在找到一个度量空间,在该

空间中样本的图像特征和其对应的语义向量在

某种度量下距离最小。最基本的方法是直接将语

义向量空间作为度量空间[31-33],将图像特征映射

到语义向量空间,在该空间中进行最近邻分类,

直接使用欧氏距离或者余弦距离作为度量函数。

有研究表明[34],将图像特征空间作为度量空间,

能够有效减轻零样本学习中固有的域适应以及

枢纽度问题[3]。在此基础上,以图像特征空间作

为度量空间的 DEM (deep embedding model)[35-36]

等模型被提出,如图 6 所示[35],原始图像经过

CNN 网络编码到图像特征空间,语义向量经多

层感知机(multi-layer perceptron, MLP)映射到同

一特征空间,在该度量空间中基于最近邻分类。

除了图像特征以及语义特征空间本身,一些方法

探索了寻找隐空间作为度量空间,如 EXEM[37],

隐 性 属 性 字 典 学 习(latent attribute dictionary

learning, LAD)[38], 耦 合 字 典 学 习 (coupled

dictionary learning, CDL)[39], 公共嵌入空间[40-41]

以及共享特征相对属性空间[42]。在这些方法中,

除了度量空间不同,空间映射函数也各有不同,

包括线性变换[31,38-39,43]以及非线性变换,如支持

向量回归(support vector regression, SVR)[37]以及

神经网络模型[35]。度量学习方法中最重要的问

题是设计目标(损失)函数,关系到模型的整体性

能。

基于度量学习的方法在某一特征空间中基

于最近邻规则进行分类,模型直观,易于理解,

然而模型性能因度量空间选择而变化较大,适用

6

�

系统工程与电子技术

Systems Engineering and Electronics

图 7 基于兼容性的零样本学习

Fig. 7 Compatibility based zero-shot learning

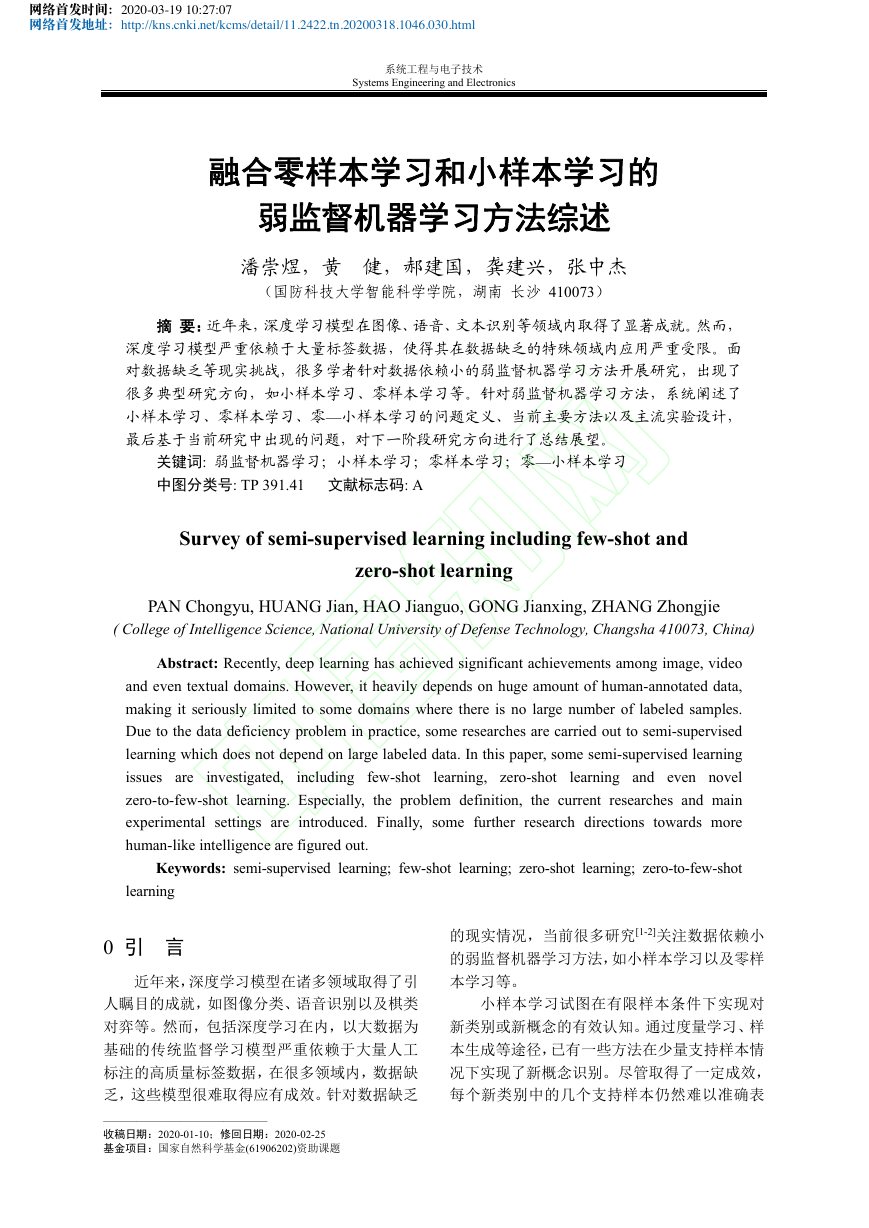

(3)基于流形结构的方法

一些研究从流形学习[49]的角度出发,探索

语义空间与图像特征空间的流形结构,企图通过

学习训练集中的流形结构,迁移到新的测试类别

中去。如图 8 所示,模型在语义空间中学习各个

类别特征向量间的流形结构,基于流形学习思

想,将该结构迁移到视觉特征分类器模型空间

中 。 典 型 方 法 包 括 跨 模 态 迁 移(cross-modal

transfer, CMT)[50], 数据遗失问题(missing data

problem, MDP)[51], 语 义 特 征 凸 组 合(convex

combination of semantic embeddings, CONSE)[52],

双 向 隐 形 编 码(bidirectional latent embedding,

BiDiLEL)[53], 相 关 知 识 迁 移(relational

transfer, RKT)[54], 生 成 分 类 器

knowledge

(synthesized classifiers, SYNC)[49] 以及局部敏感

的流形保持方法[55]。

基于流形结构的零样本学习方法[49],如图 8

所示,能够考虑到类别间的关联关系,但不同特

征空间的流形结构存在异构性,通常难以迁移。

图 8 基于流形学习的零样本学习

Fig. 8 Manifold based zero-shot learning

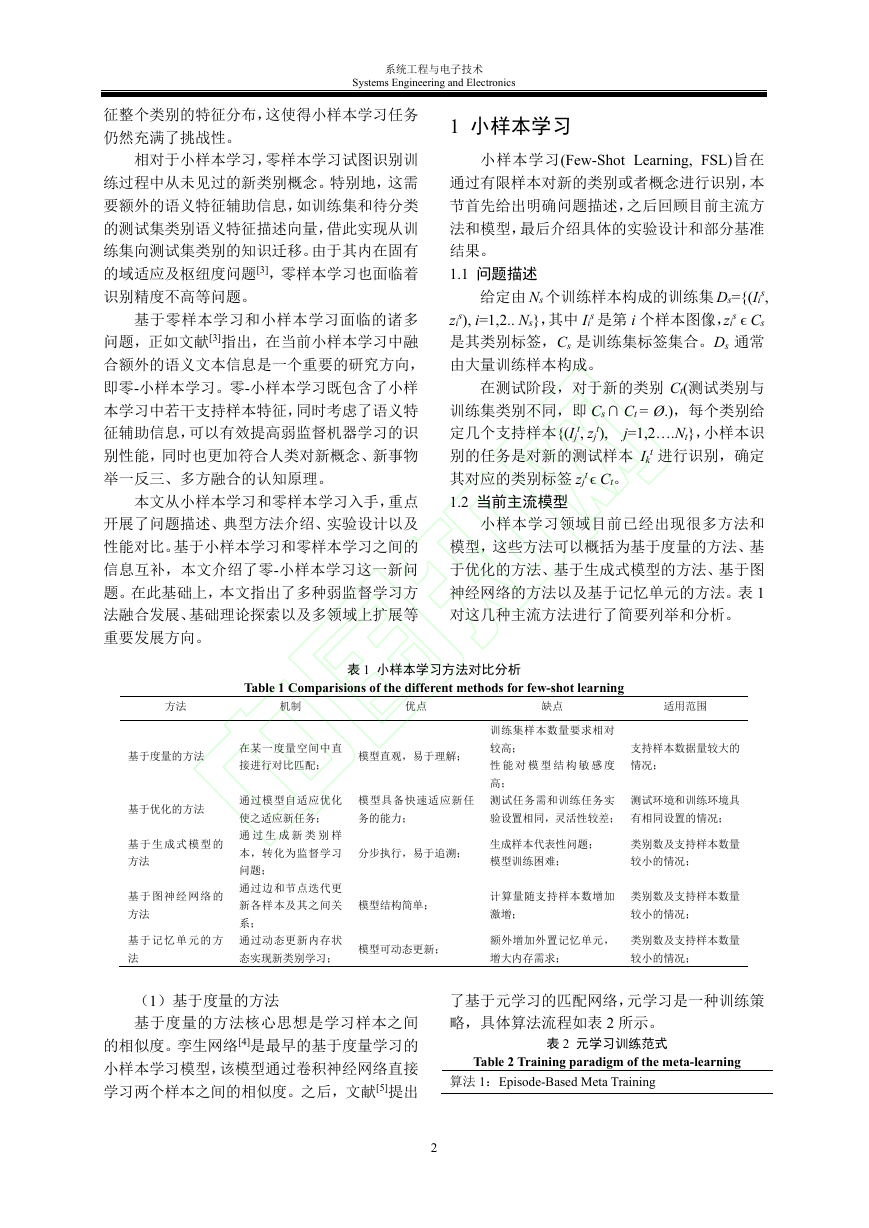

(4)基于生成式模型的方法

最近一些研究基于生成样本的思想,借助于

生成式网络,经训练集训练,在新类别上生成图

像特征样本甚至原始二维图像,将零样本学习转

化为监督学习分类问题加以解决。典型方法包括

未知类别样本生成(unseen visual data synthesis,

UVDS)[56], 对 抗 生 成 式 方 法(generative

adversarial approach for ZSL, GAZSL)[57], 特征

生成网络(feature generating networks, FGN)[58],

样 本 生 成 方 法(synthesized examples ZSL,

SE-ZSL)[59], 以 及 保 留 语 义 的 对 抗 式 嵌 入 网 络

(semantics-preserving

embedding

networks, SP-AEN)[60]等。

adversarial

基于生成式模型的方法[61],如图 9 所示。

图 9 基于生成式样本的零样本学习

Fig. 9 Generative model based zero-shot learning

7

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc