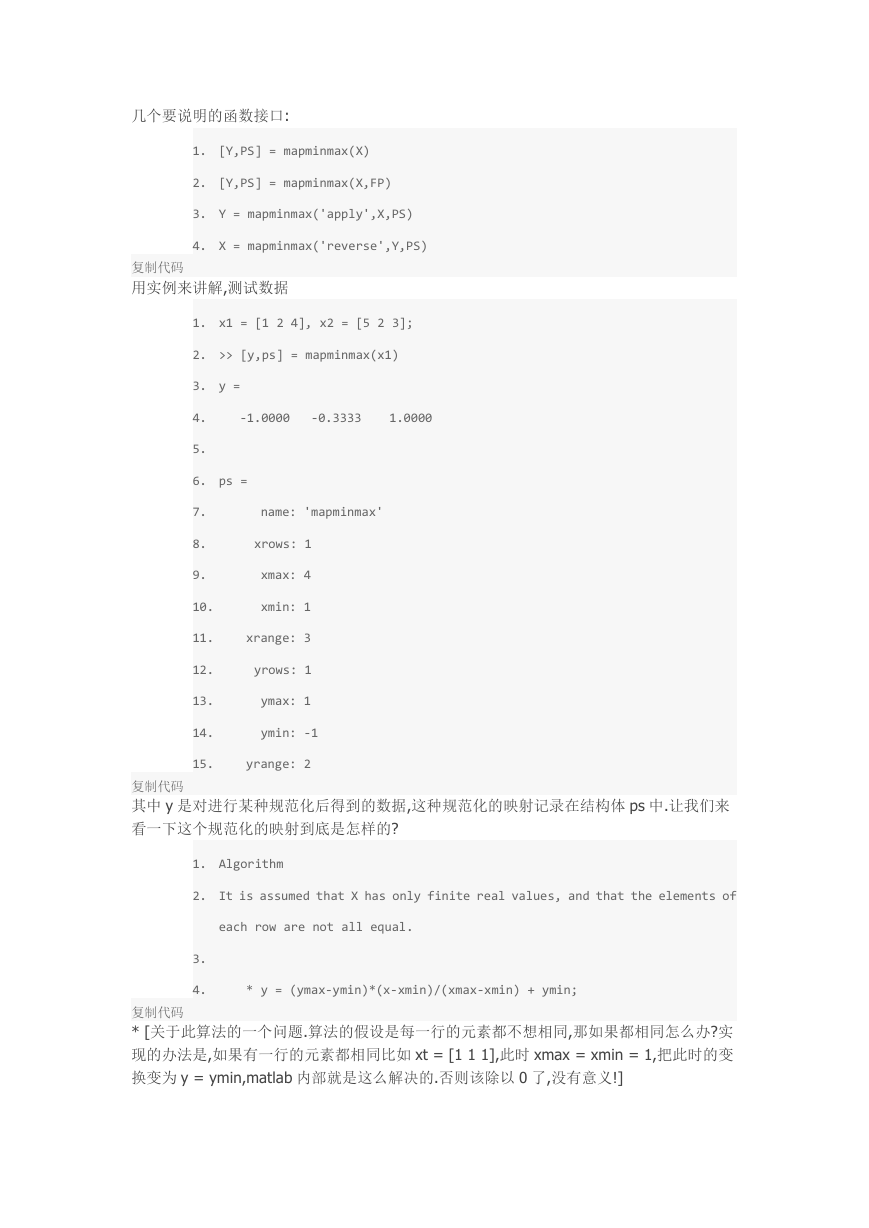

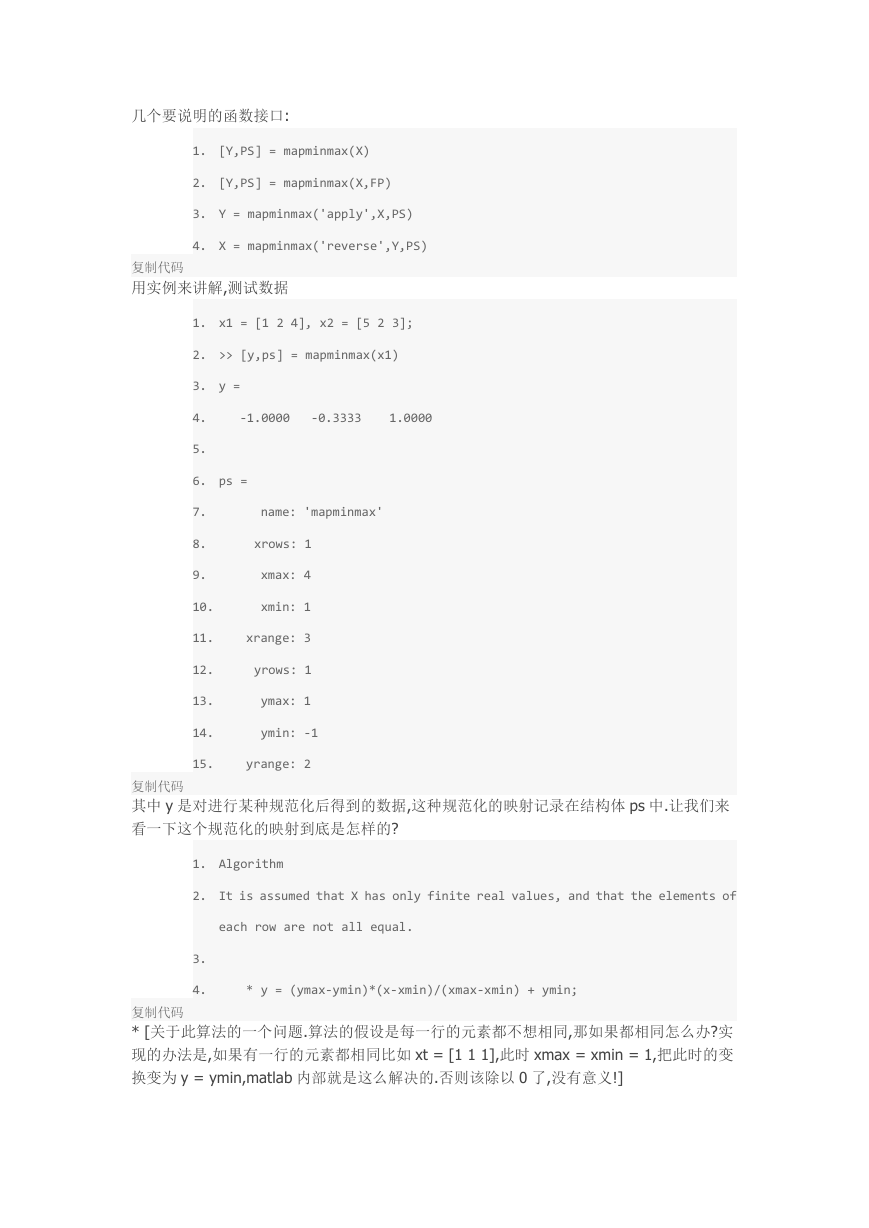

几个要说明的函数接口:

1. [Y,PS] = mapminmax(X)

2. [Y,PS] = mapminmax(X,FP)

3. Y = mapminmax('apply',X,PS)

4. X = mapminmax('reverse',Y,PS)

复制代码

用实例来讲解,测试数据

1. x1 = [1 2 4], x2 = [5 2 3];

2. >> [y,ps] = mapminmax(x1)

3. y =

-1.0000

-0.3333

1.0000

4.

5.

6. ps =

7.

8.

9.

10.

11.

12.

13.

14.

15.

name: 'mapminmax'

xrows: 1

xmax: 4

xmin: 1

xrange: 3

yrows: 1

ymax: 1

ymin: -1

yrange: 2

复制代码

其中 y 是对进行某种规范化后得到的数据,这种规范化的映射记录在结构体 ps 中.让我们来

看一下这个规范化的映射到底是怎样的?

1. Algorithm

2. It is assumed that X has only finite real values, and that the elements of

each row are not all equal.

3.

4.

* y = (ymax-ymin)*(x-xmin)/(xmax-xmin) + ymin;

复制代码

* [关于此算法的一个问题.算法的假设是每一行的元素都不想相同,那如果都相同怎么办?实

现的办法是,如果有一行的元素都相同比如 xt = [1 1 1],此时 xmax = xmin = 1,把此时的变

换变为 y = ymin,matlab 内部就是这么解决的.否则该除以 0 了,没有意义!]

�

也就是说对 x1 = [1 2 4]采用这个映射 f: 2*(x-xmin)/(xmax-xmin)+(-1),就可以得到 y =

[ -1.0000

我们来看一下是不是: 对于 x1 而言 xmin = 1,xmax = 4;

则 y(1) = 2*(1 - 1)/(4-1)+(-1) = -1;

1.0000]

-0.3333

y(2) = 2*(2 - 1)/(4-1)+(-1) = -1/3 = -0.3333;

y(3) = 2*(4-1)/(4-1)+(-1) = 1;

看来的确就是这个映射来实现的.

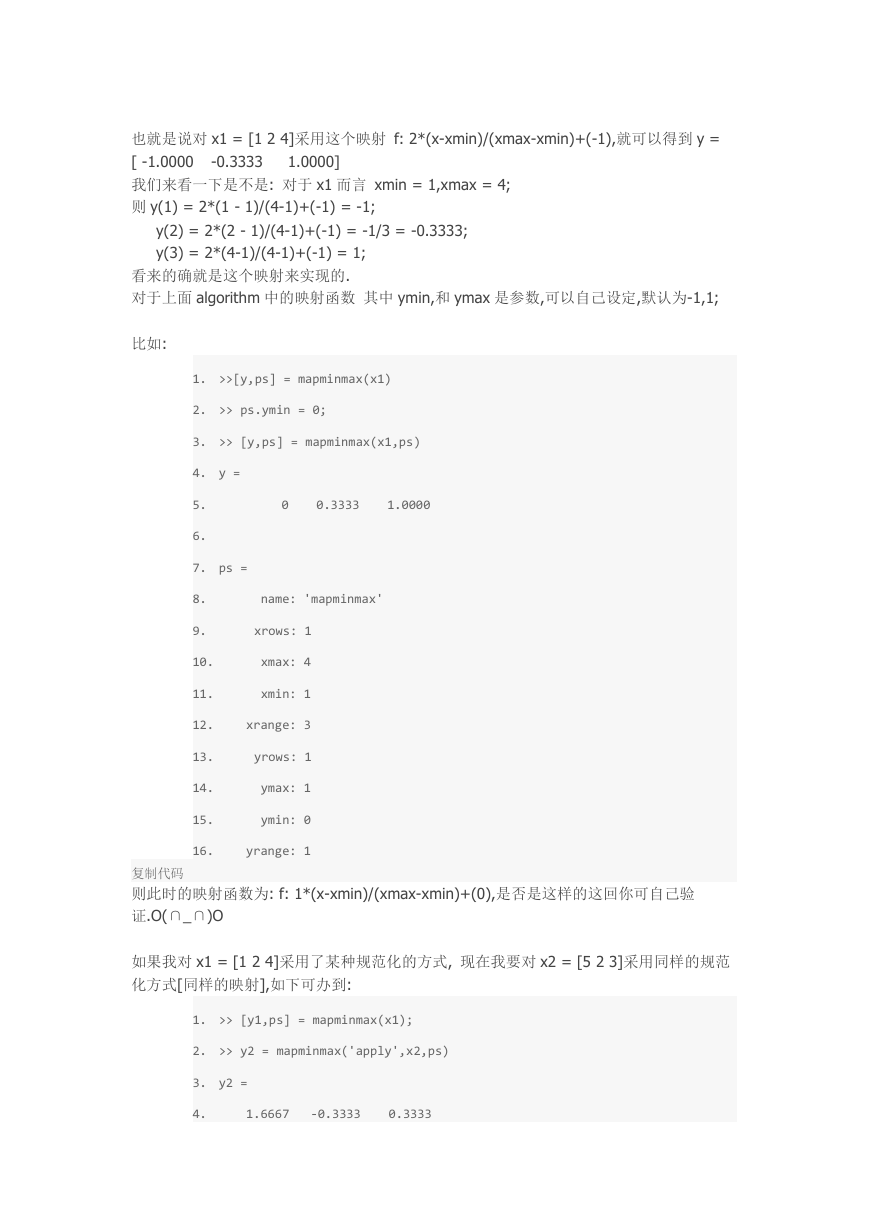

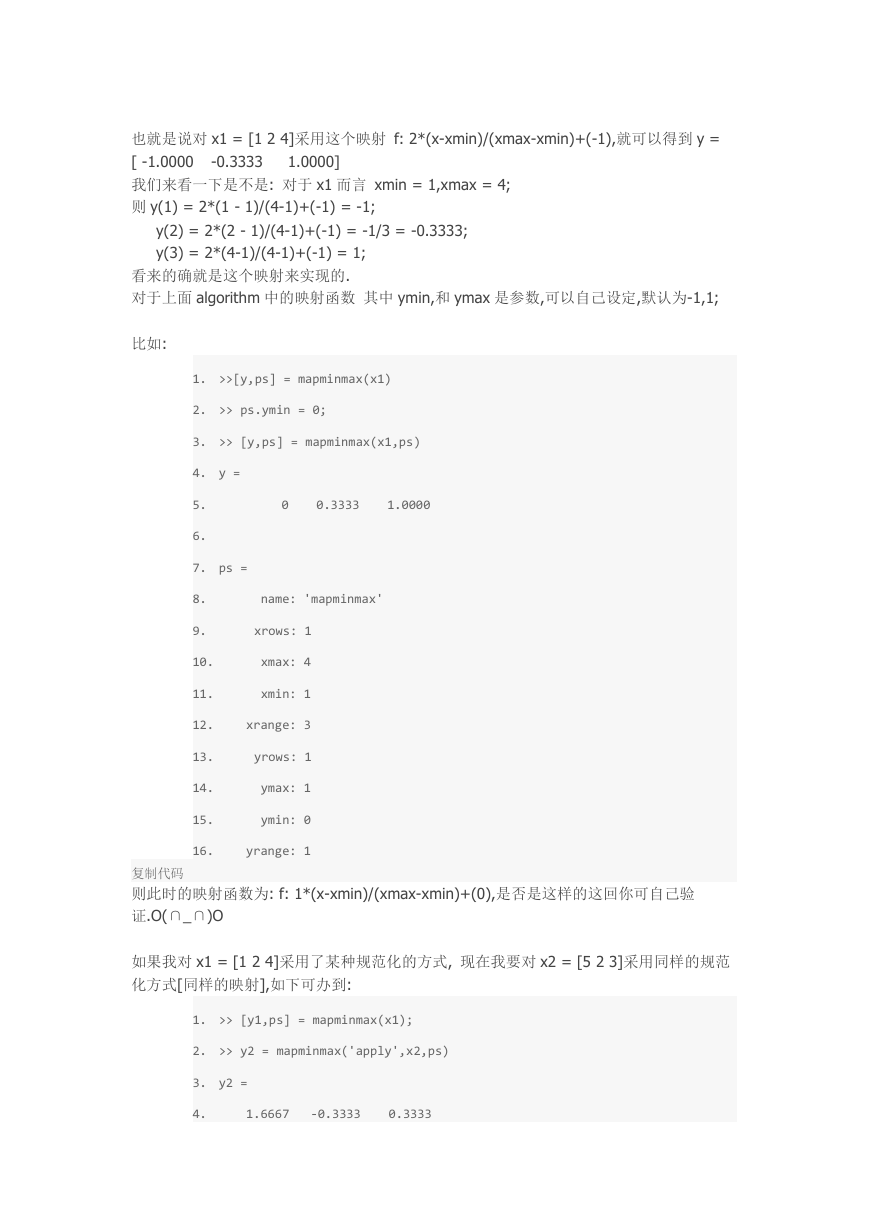

对于上面 algorithm 中的映射函数 其中 ymin,和 ymax 是参数,可以自己设定,默认为-1,1;

比如:

1. >>[y,ps] = mapminmax(x1)

2. >> ps.ymin = 0;

3. >> [y,ps] = mapminmax(x1,ps)

4. y =

5.

6.

7. ps =

0

0.3333

1.0000

name: 'mapminmax'

8.

9.

10.

11.

12.

13.

14.

15.

16.

xrows: 1

xmax: 4

xmin: 1

xrange: 3

yrows: 1

ymax: 1

ymin: 0

yrange: 1

复制代码

则此时的映射函数为: f: 1*(x-xmin)/(xmax-xmin)+(0),是否是这样的这回你可自己验

证.O(∩_∩)O

如果我对 x1 = [1 2 4]采用了某种规范化的方式, 现在我要对 x2 = [5 2 3]采用同样的规范

化方式[同样的映射],如下可办到:

1. >> [y1,ps] = mapminmax(x1);

2. >> y2 = mapminmax('apply',x2,ps)

3. y2 =

4.

1.6667

-0.3333

0.3333

�

复制代码

即对 x1 采用的规范化映射为: f: 2*(x-1)/(4-1)+(-1),(记录在 ps 中),对 x2 也要采取这个映射.

x2 = [5,2,3],用这个映射我们来算一下.

1. y2(1) = 2(5-1)/(4-1)+(-1) = 5/3 = 1+2/3 = 1.66667

2. y2(2) = 2(2-1)/(4-1)+(-1) = -1/3 = -0.3333

3. y2(3) = 2(3-1)/(4-1)+(-1) = 1/3 = 0.3333

复制代码

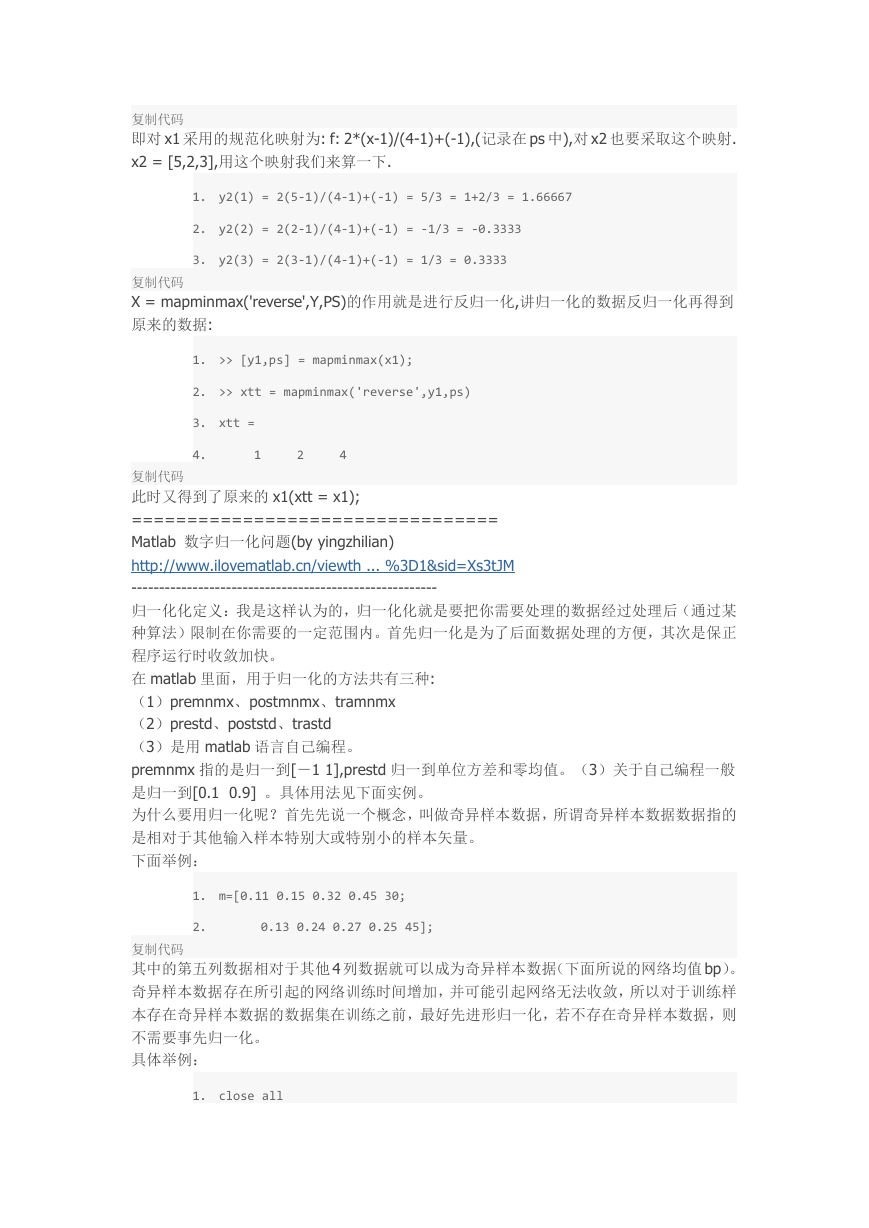

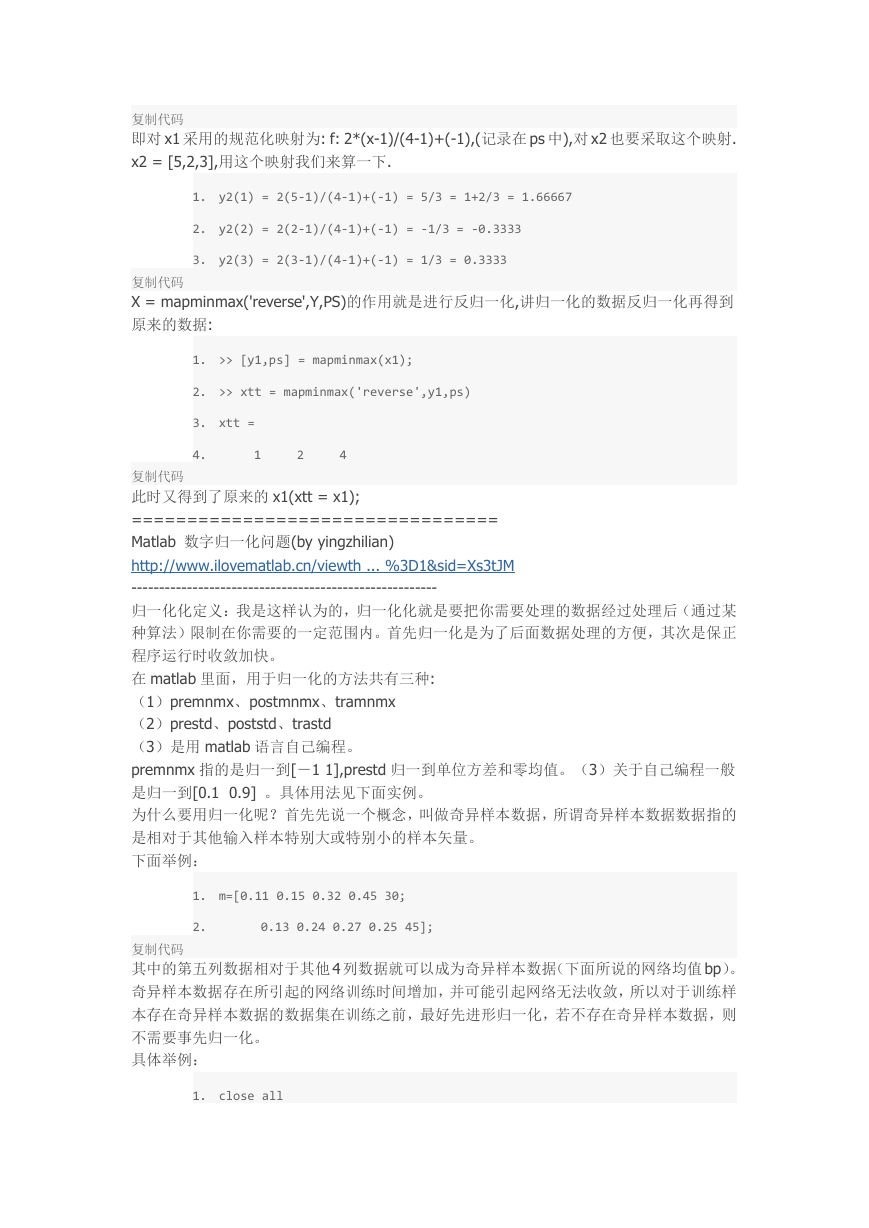

X = mapminmax('reverse',Y,PS)的作用就是进行反归一化,讲归一化的数据反归一化再得到

原来的数据:

1. >> [y1,ps] = mapminmax(x1);

2. >> xtt = mapminmax('reverse',y1,ps)

3. xtt =

4.

1

2

4

复制代码

此时又得到了原来的 x1(xtt = x1);

=================================

Matlab 数字归一化问题(by yingzhilian)

http://www.ilovematlab.cn/viewth ... %3D1&sid=Xs3tJM

-------------------------------------------------------

归一化化定义:我是这样认为的,归一化化就是要把你需要处理的数据经过处理后(通过某

种算法)限制在你需要的一定范围内。首先归一化是为了后面数据处理的方便,其次是保正

程序运行时收敛加快。

在 matlab 里面,用于归一化的方法共有三种:

(1)premnmx、postmnmx、tramnmx

(2)prestd、poststd、trastd

(3)是用 matlab 语言自己编程。

premnmx 指的是归一到[-1 1],prestd 归一到单位方差和零均值。(3)关于自己编程一般

是归一到[0.1 0.9] 。具体用法见下面实例。

为什么要用归一化呢?首先先说一个概念,叫做奇异样本数据,所谓奇异样本数据数据指的

是相对于其他输入样本特别大或特别小的样本矢量。

下面举例:

1. m=[0.11 0.15 0.32 0.45 30;

2.

0.13 0.24 0.27 0.25 45];

复制代码

其中的第五列数据相对于其他4 列数据就可以成为奇异样本数据(下面所说的网络均值bp)。

奇异样本数据存在所引起的网络训练时间增加,并可能引起网络无法收敛,所以对于训练样

本存在奇异样本数据的数据集在训练之前,最好先进形归一化,若不存在奇异样本数据,则

不需要事先归一化。

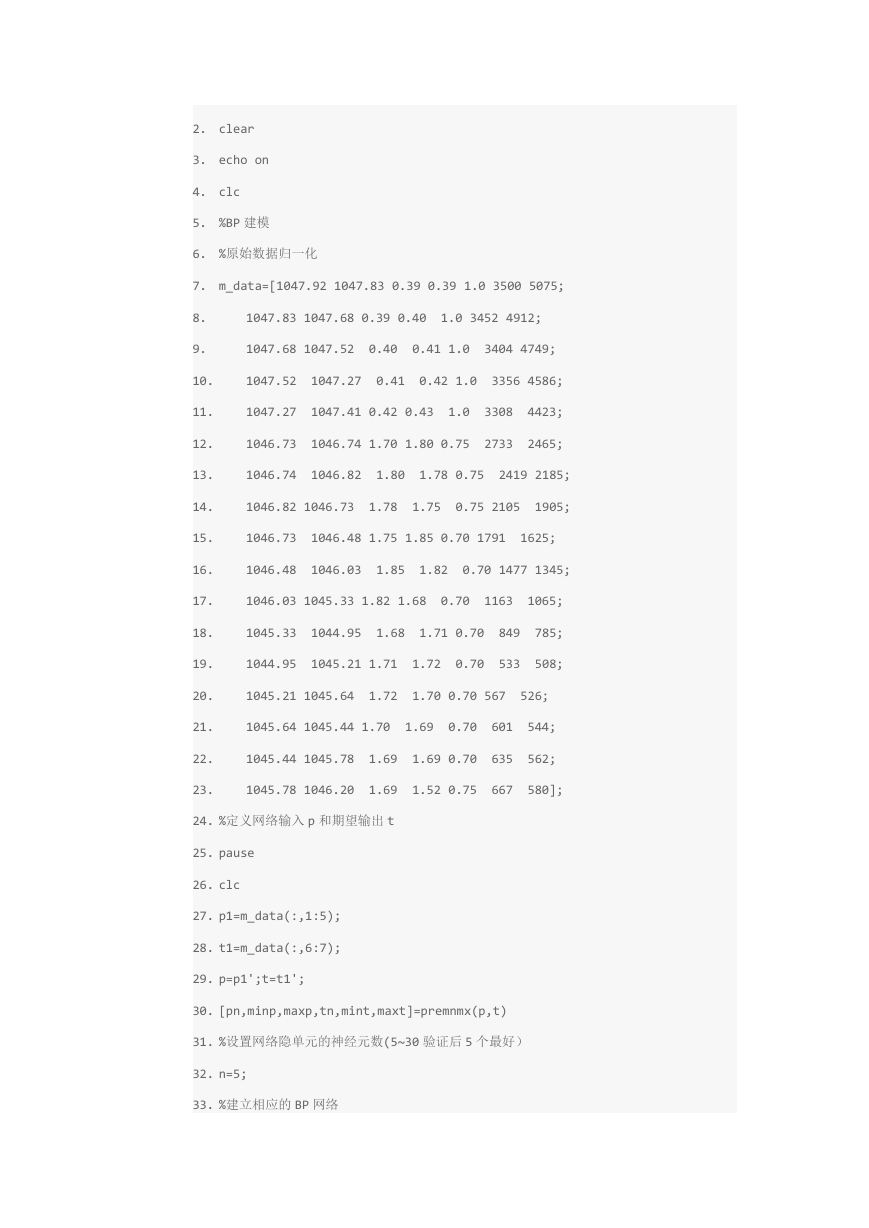

具体举例:

1. close all

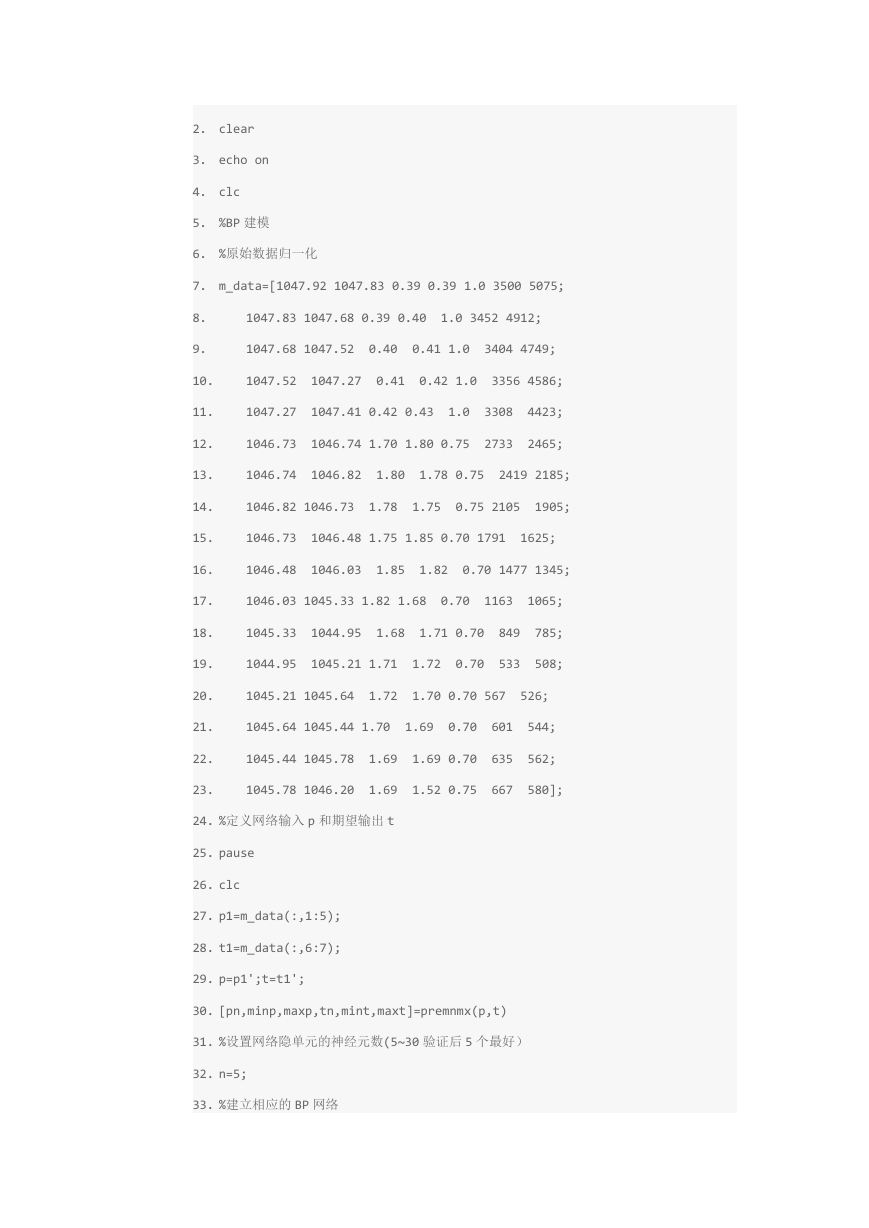

�

2. clear

3. echo on

4. clc

5. %BP 建模

6. %原始数据归一化

7. m_data=[1047.92 1047.83 0.39 0.39 1.0 3500 5075;

8.

9.

10.

11.

12.

13.

14.

15.

16.

17.

18.

19.

20.

21.

22.

23.

1047.83 1047.68 0.39 0.40

1.0 3452 4912;

1047.68 1047.52

0.40

0.41 1.0

3404 4749;

1047.52

1047.27

0.41

0.42 1.0

3356 4586;

1047.27

1047.41 0.42 0.43

1.0

3308

4423;

1046.73

1046.74 1.70 1.80 0.75

2733

2465;

1046.74

1046.82

1.80

1.78 0.75

2419 2185;

1046.82 1046.73

1.78

1.75

0.75 2105

1905;

1046.73

1046.48 1.75 1.85 0.70 1791

1625;

1046.48

1046.03

1.85

1.82

0.70 1477 1345;

1046.03 1045.33 1.82 1.68

0.70

1163

1065;

1045.33

1044.95

1.68

1.71 0.70

849

785;

1044.95

1045.21 1.71

1.72

0.70

533

508;

1045.21 1045.64

1.72

1.70 0.70 567

526;

1045.64 1045.44 1.70

1.69

0.70

601

544;

1045.44 1045.78

1.69

1.69 0.70

635

562;

1045.78 1046.20

1.69

1.52 0.75

667

580];

24. %定义网络输入 p 和期望输出 t

25. pause

26. clc

27. p1=m_data(:,1:5);

28. t1=m_data(:,6:7);

29. p=p1';t=t1';

30. [pn,minp,maxp,tn,mint,maxt]=premnmx(p,t)

31. %设置网络隐单元的神经元数(5~30 验证后 5 个最好)

32. n=5;

33. %建立相应的 BP 网络

�

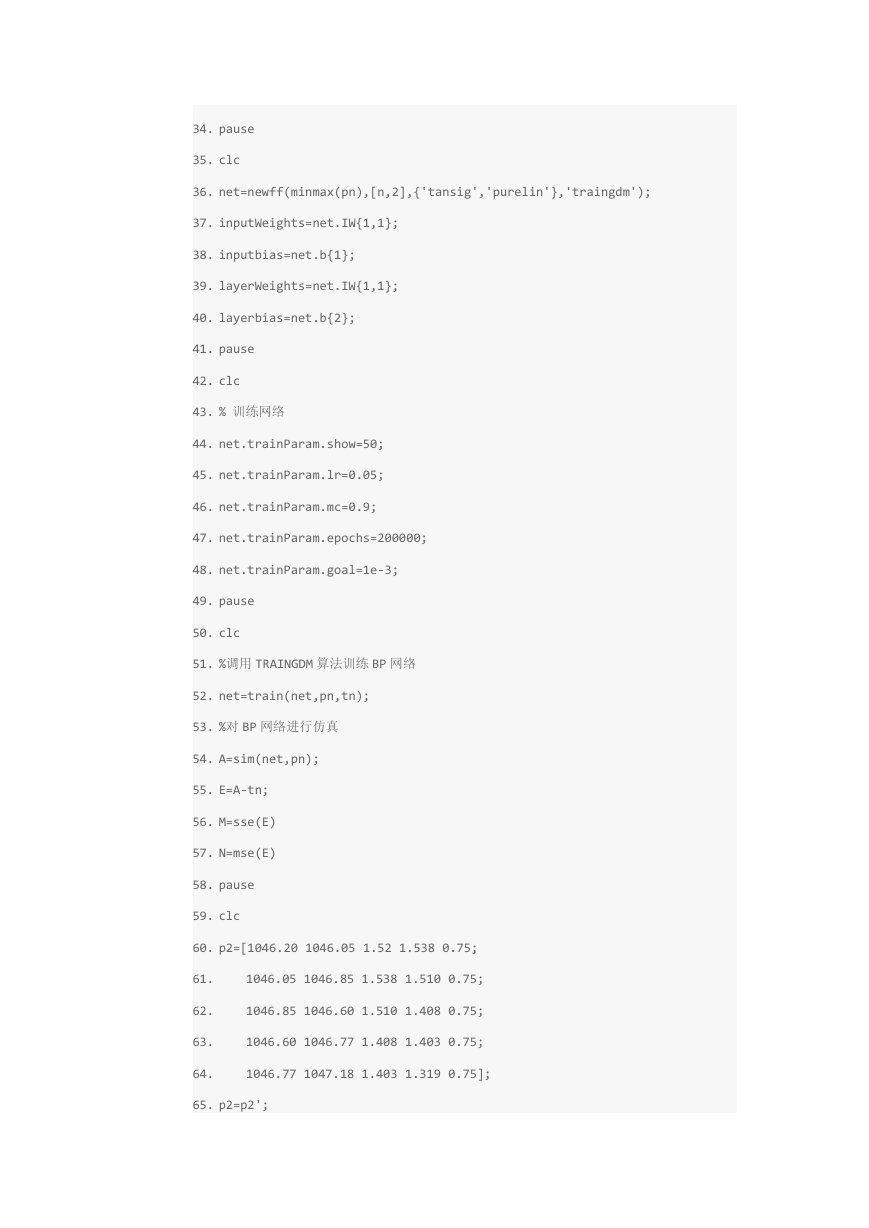

34. pause

35. clc

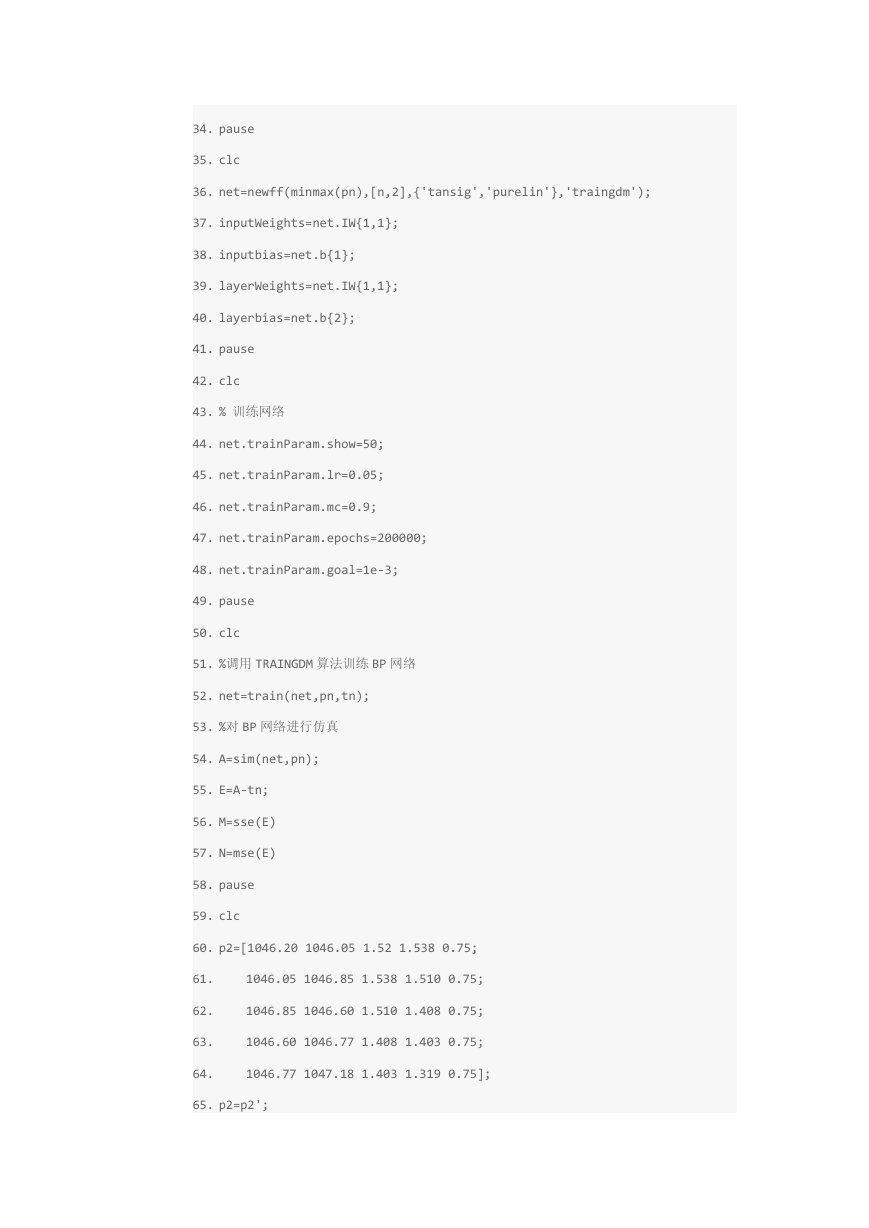

36. net=newff(minmax(pn),[n,2],{'tansig','purelin'},'traingdm');

37. inputWeights=net.IW{1,1};

38. inputbias=net.b{1};

39. layerWeights=net.IW{1,1};

40. layerbias=net.b{2};

41. pause

42. clc

43. % 训练网络

44. net.trainParam.show=50;

45. net.trainParam.lr=0.05;

46. net.trainParam.mc=0.9;

47. net.trainParam.epochs=200000;

48. net.trainParam.goal=1e-3;

49. pause

50. clc

51. %调用 TRAINGDM 算法训练 BP 网络

52. net=train(net,pn,tn);

53. %对 BP 网络进行仿真

54. A=sim(net,pn);

55. E=A-tn;

56. M=sse(E)

57. N=mse(E)

58. pause

59. clc

60. p2=[1046.20 1046.05 1.52 1.538 0.75;

61.

62.

63.

64.

1046.05 1046.85 1.538 1.510 0.75;

1046.85 1046.60 1.510 1.408 0.75;

1046.60 1046.77 1.408 1.403 0.75;

1046.77 1047.18 1.403 1.319 0.75];

65. p2=p2';

�

66. p2n=tramnmx(p2,minp,maxp);

67. a2n=sim(net,p2n);

68. a2=postmnmx(a2n,mint,maxt)

69. echo off

70. pause

71. clc

复制代码

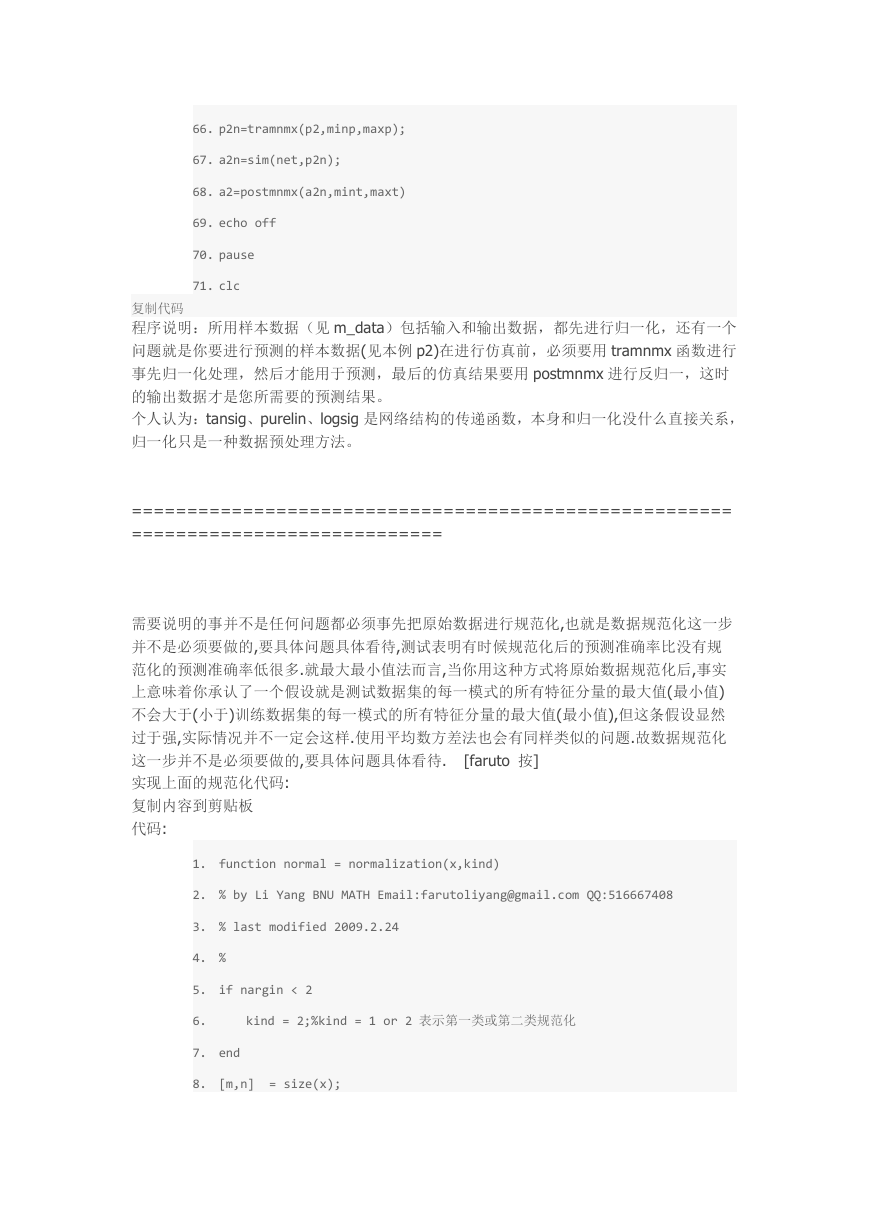

程序说明:所用样本数据(见 m_data)包括输入和输出数据,都先进行归一化,还有一个

问题就是你要进行预测的样本数据(见本例 p2)在进行仿真前,必须要用 tramnmx 函数进行

事先归一化处理,然后才能用于预测,最后的仿真结果要用 postmnmx 进行反归一,这时

的输出数据才是您所需要的预测结果。

个人认为:tansig、purelin、logsig 是网络结构的传递函数,本身和归一化没什么直接关系,

归一化只是一种数据预处理方法。

======================================================

============================

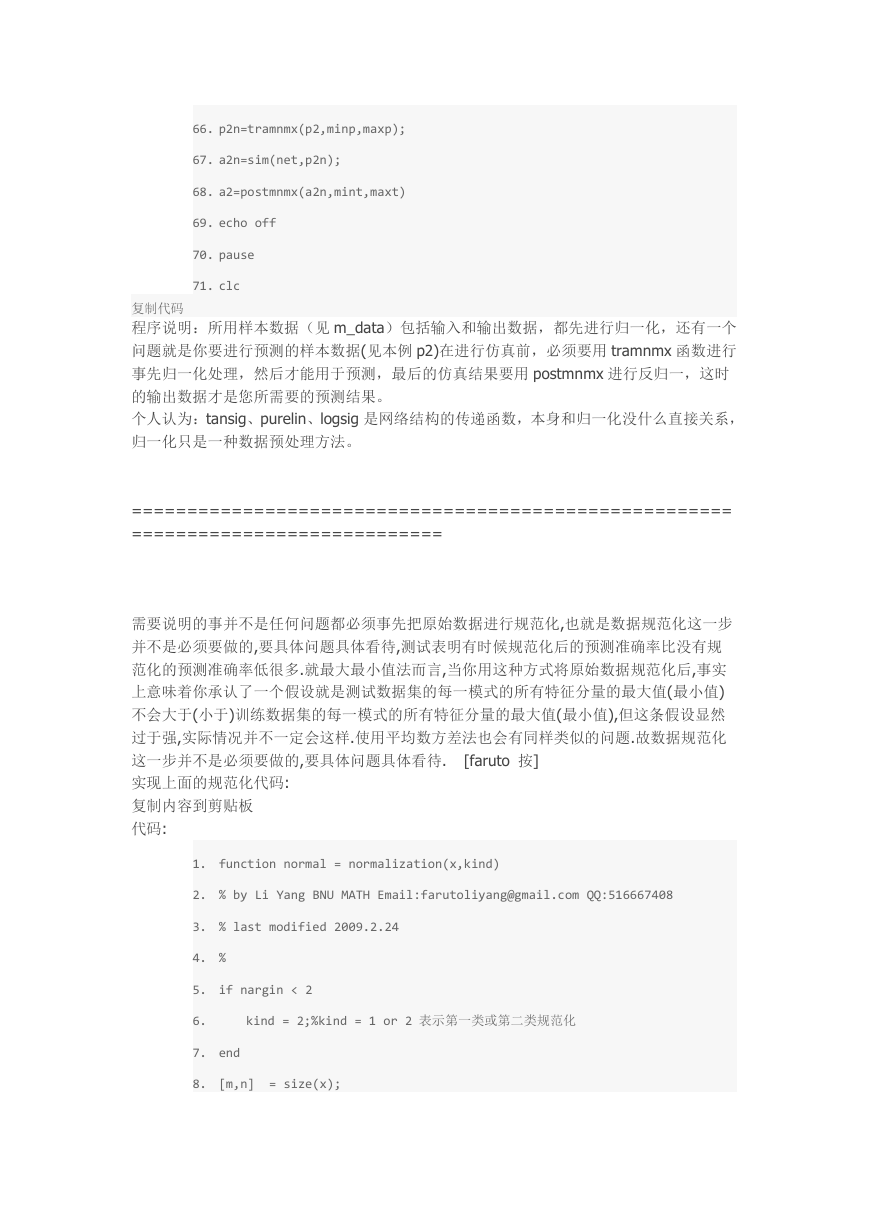

需要说明的事并不是任何问题都必须事先把原始数据进行规范化,也就是数据规范化这一步

并不是必须要做的,要具体问题具体看待,测试表明有时候规范化后的预测准确率比没有规

范化的预测准确率低很多.就最大最小值法而言,当你用这种方式将原始数据规范化后,事实

上意味着你承认了一个假设就是测试数据集的每一模式的所有特征分量的最大值(最小值)

不会大于(小于)训练数据集的每一模式的所有特征分量的最大值(最小值),但这条假设显然

过于强,实际情况并不一定会这样.使用平均数方差法也会有同样类似的问题.故数据规范化

这一步并不是必须要做的,要具体问题具体看待.

实现上面的规范化代码:

复制内容到剪贴板

代码:

[faruto 按]

1. function normal = normalization(x,kind)

2. % by Li Yang BNU MATH Email:farutoliyang@gmail.com QQ:516667408

3. % last modified 2009.2.24

4. %

5. if nargin < 2

6.

kind = 2;%kind = 1 or 2 表示第一类或第二类规范化

7. end

8. [m,n]

= size(x);

�

9. normal = zeros(m,n);

10. %% normalize the data x to [0,1]

11. if kind == 1

for i = 1:m

ma = max( x(i,:) );

mi = min( x(i,:) );

normal(i,:) = ( x(i,:)-mi )./( ma-mi );

end

12.

13.

14.

15.

16.

17. end

18. %% normalize the data x to [-1,1]

19. if kind == 2

for i = 1:m

mea = mean( x(i,:) );

va = var( x(i,:) );

normal(i,:) = ( x(i,:)-mea )/va;

end

20.

21.

22.

23.

24.

25. end

复制代码

======================================================

====================

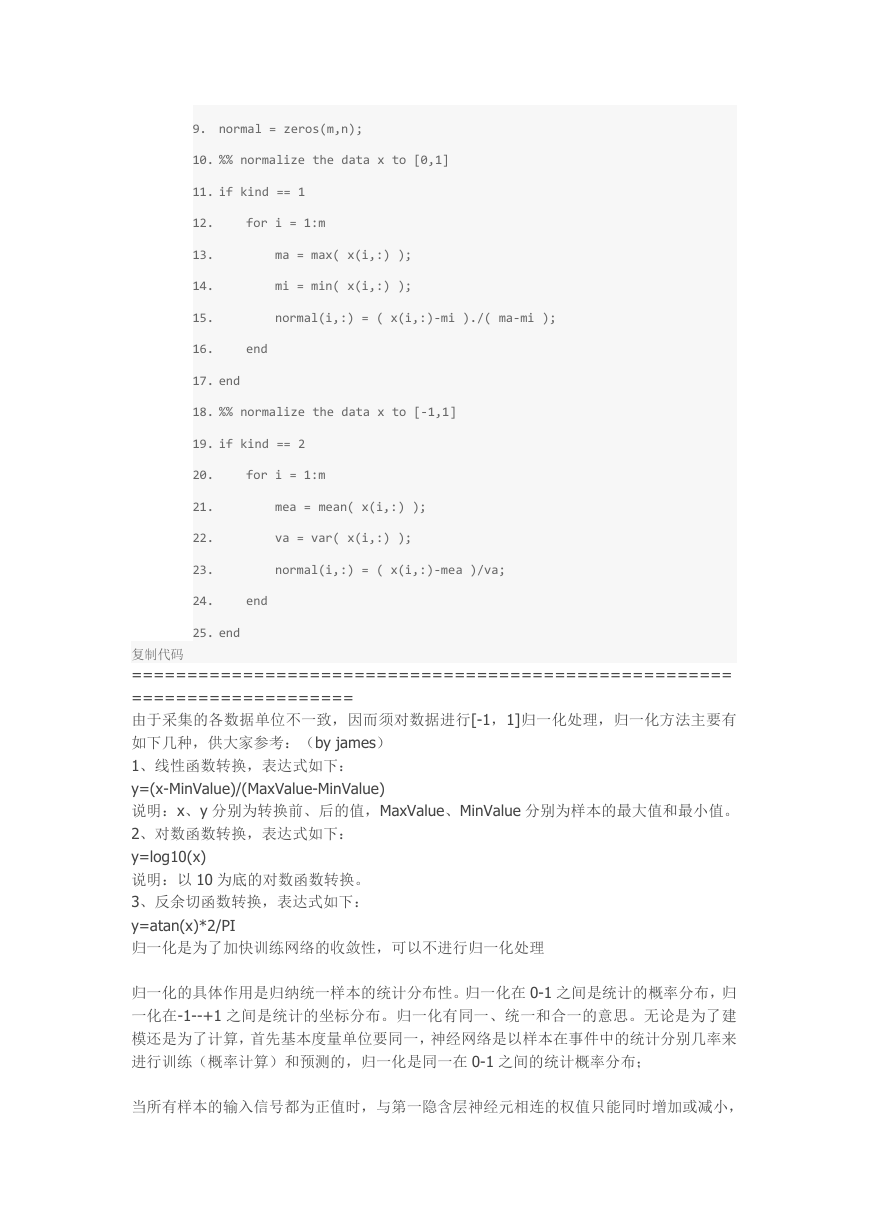

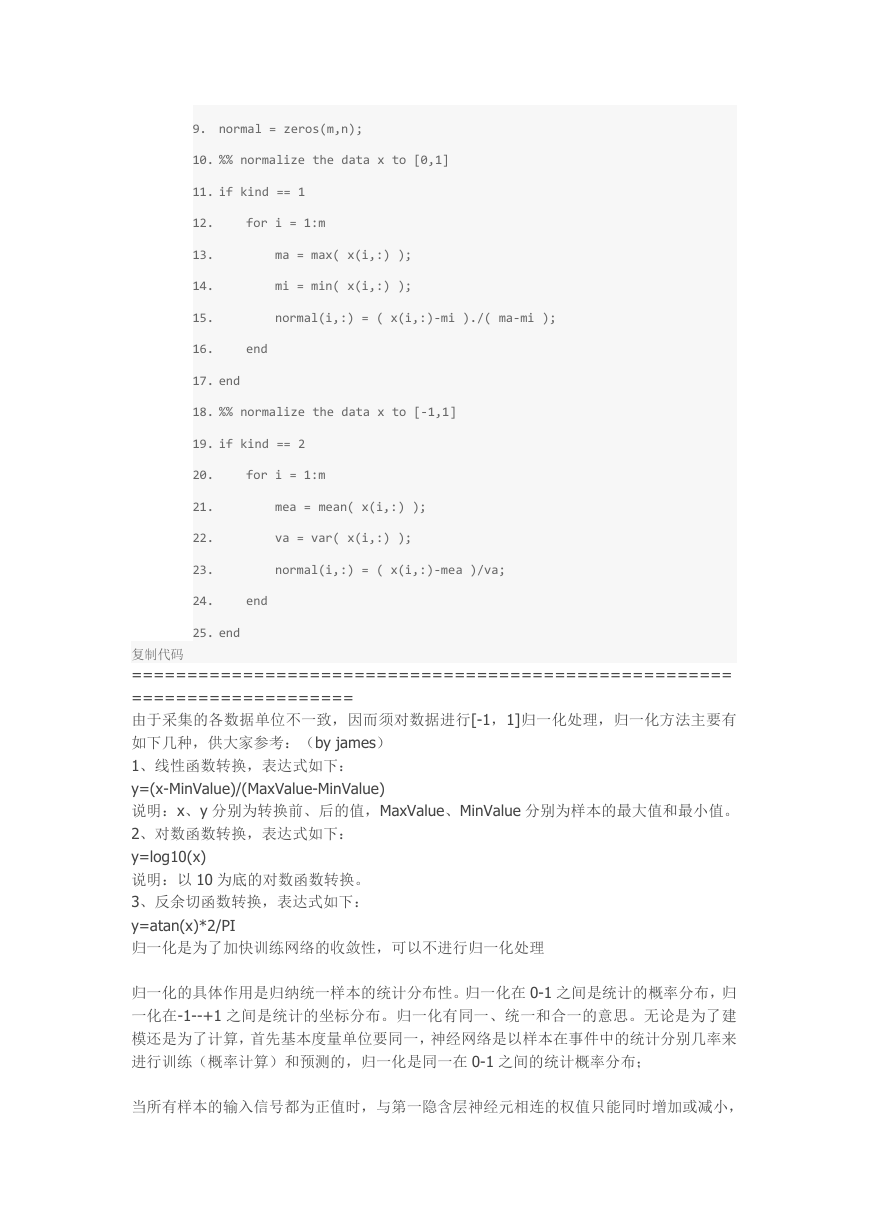

由于采集的各数据单位不一致,因而须对数据进行[-1,1]归一化处理,归一化方法主要有

如下几种,供大家参考:(by james)

1、线性函数转换,表达式如下:

y=(x-MinValue)/(MaxValue-MinValue)

说明:x、y 分别为转换前、后的值,MaxValue、MinValue 分别为样本的最大值和最小值。

2、对数函数转换,表达式如下:

y=log10(x)

说明:以 10 为底的对数函数转换。

3、反余切函数转换,表达式如下:

y=atan(x)*2/PI

归一化是为了加快训练网络的收敛性,可以不进行归一化处理

归一化的具体作用是归纳统一样本的统计分布性。归一化在 0-1 之间是统计的概率分布,归

一化在-1--+1 之间是统计的坐标分布。归一化有同一、统一和合一的意思。无论是为了建

模还是为了计算,首先基本度量单位要同一,神经网络是以样本在事件中的统计分别几率来

进行训练(概率计算)和预测的,归一化是同一在 0-1 之间的统计概率分布;

当所有样本的输入信号都为正值时,与第一隐含层神经元相连的权值只能同时增加或减小,

�

从而导致学习速度很慢。为了避免出现这种情况,加快网络学习速度,可以对输入信号进行

归一化,使得所有样本的输入信号其均值接近于 0 或与其均方差相比很小。

归一化是因为 sigmoid 函数的取值是 0 到 1 之间的,网络最后一个节点的输出也是如此,所

以经常要对样本的输出归一化处理。所以这样做分类的问题时用[0.9 0.1 0.1]就要比用[1 0 0]

要好。

但是归一化处理并不总是合适的,根据输出值的分布情况,标准化等其它统计变换方法有时

可能更好。

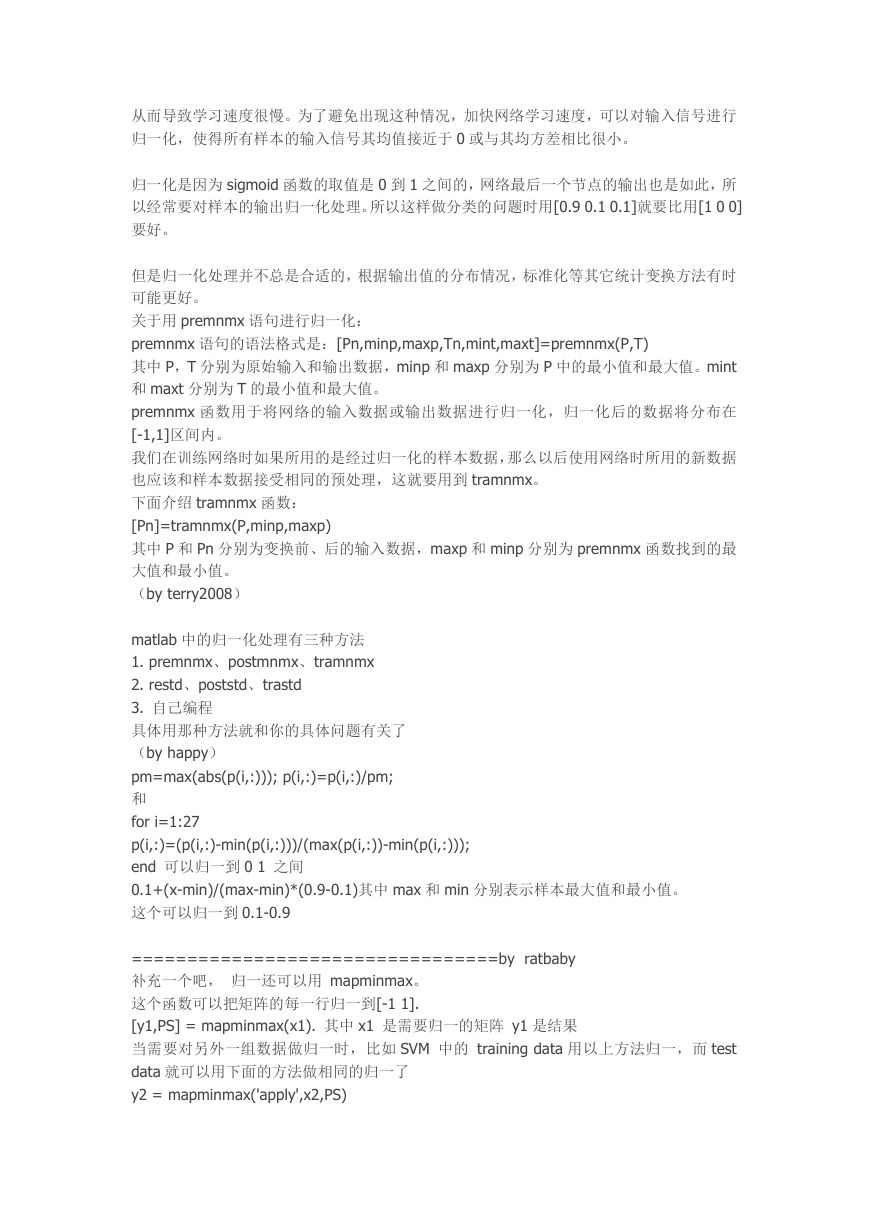

关于用 premnmx 语句进行归一化:

premnmx 语句的语法格式是:[Pn,minp,maxp,Tn,mint,maxt]=premnmx(P,T)

其中 P,T 分别为原始输入和输出数据,minp 和 maxp 分别为 P 中的最小值和最大值。mint

和 maxt 分别为 T 的最小值和最大值。

premnmx 函数用于将网络的输入数据或输出数据进行归一化,归一化后的数据将分布在

[-1,1]区间内。

我们在训练网络时如果所用的是经过归一化的样本数据,那么以后使用网络时所用的新数据

也应该和样本数据接受相同的预处理,这就要用到 tramnmx。

下面介绍 tramnmx 函数:

[Pn]=tramnmx(P,minp,maxp)

其中 P 和 Pn 分别为变换前、后的输入数据,maxp 和 minp 分别为 premnmx 函数找到的最

大值和最小值。

(by terry2008)

matlab 中的归一化处理有三种方法

1. premnmx、postmnmx、tramnmx

2. restd、poststd、trastd

3. 自己编程

具体用那种方法就和你的具体问题有关了

(by happy)

pm=max(abs(p(i,:))); p(i,:)=p(i,:)/pm;

和

for i=1:27

p(i,:)=(p(i,:)-min(p(i,:)))/(max(p(i,:))-min(p(i,:)));

end 可以归一到 0 1 之间

0.1+(x-min)/(max-min)*(0.9-0.1)其中 max 和 min 分别表示样本最大值和最小值。

这个可以归一到 0.1-0.9

=================================by ratbaby

补充一个吧, 归一还可以用 mapminmax。

这个函数可以把矩阵的每一行归一到[-1 1].

[y1,PS] = mapminmax(x1). 其中 x1 是需要归一的矩阵 y1 是结果

当需要对另外一组数据做归一时,比如 SVM 中的 training data 用以上方法归一,而 test

data 就可以用下面的方法做相同的归一了

y2 = mapminmax('apply',x2,PS)

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc