使⽤sklearn优雅地进⾏数据挖掘

⺫录

1 使⽤sklearn进⾏数据挖掘

1.1 数据挖掘的步骤

1.2 数据初貌

1.3 关键技术

2 并⾏处理

2.1 整体并⾏处理

2.2 部分并⾏处理

3 流⽔线处理

4 ⾃动化调参

5 持久化

6 回顾

7 总结

8 参考资料

1 使⽤sklearn进⾏数据挖掘

1.1 数据挖掘的步骤

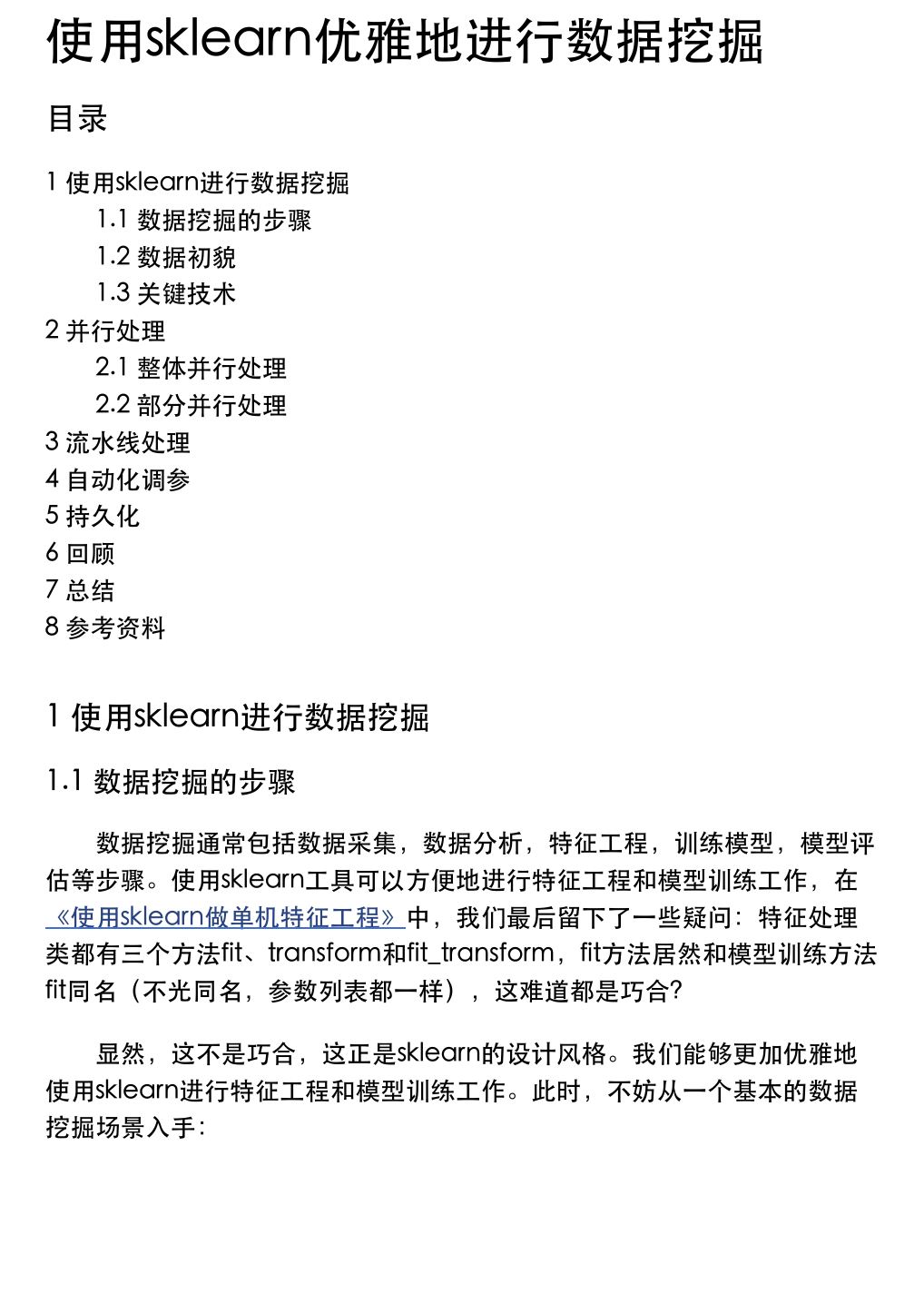

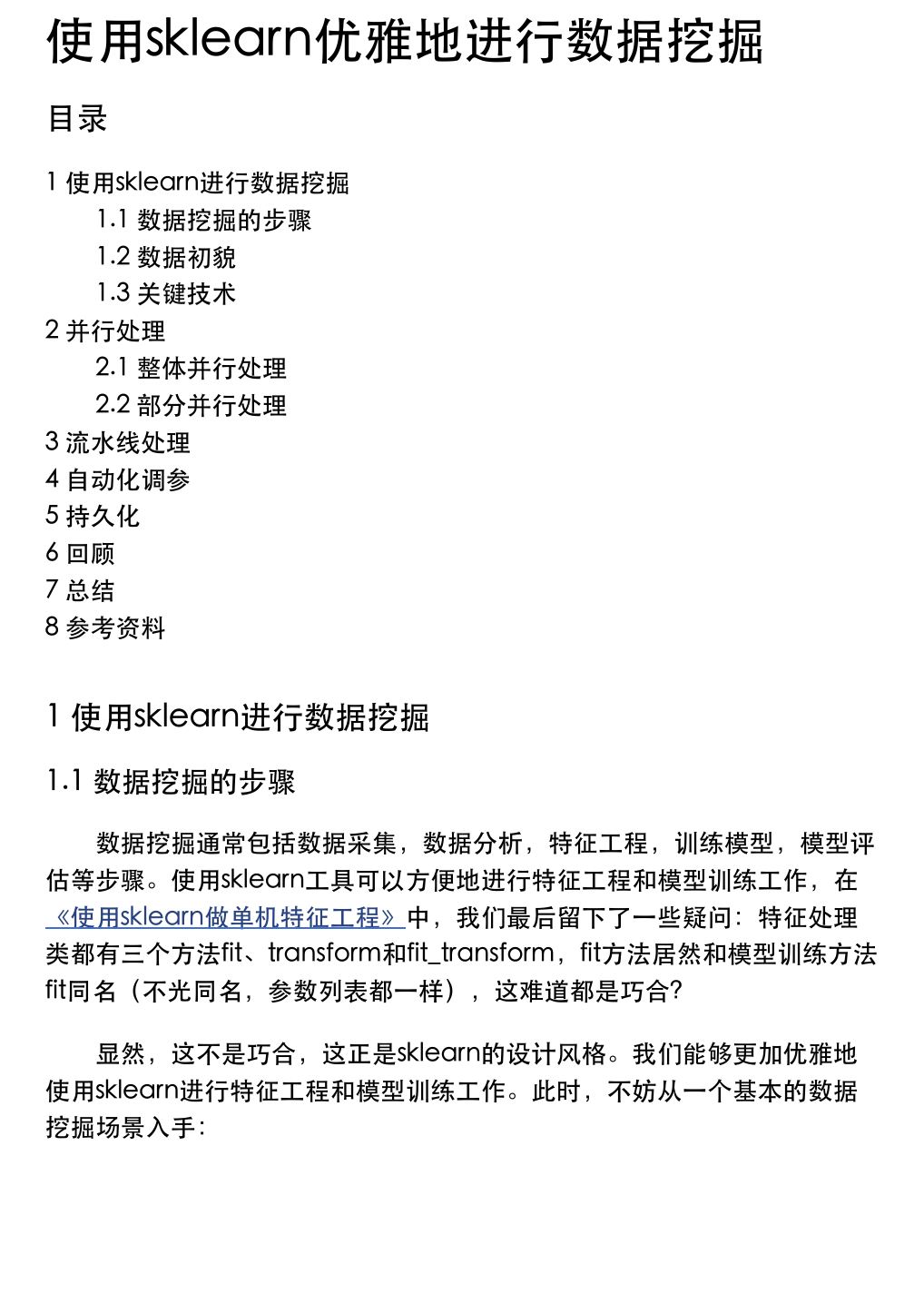

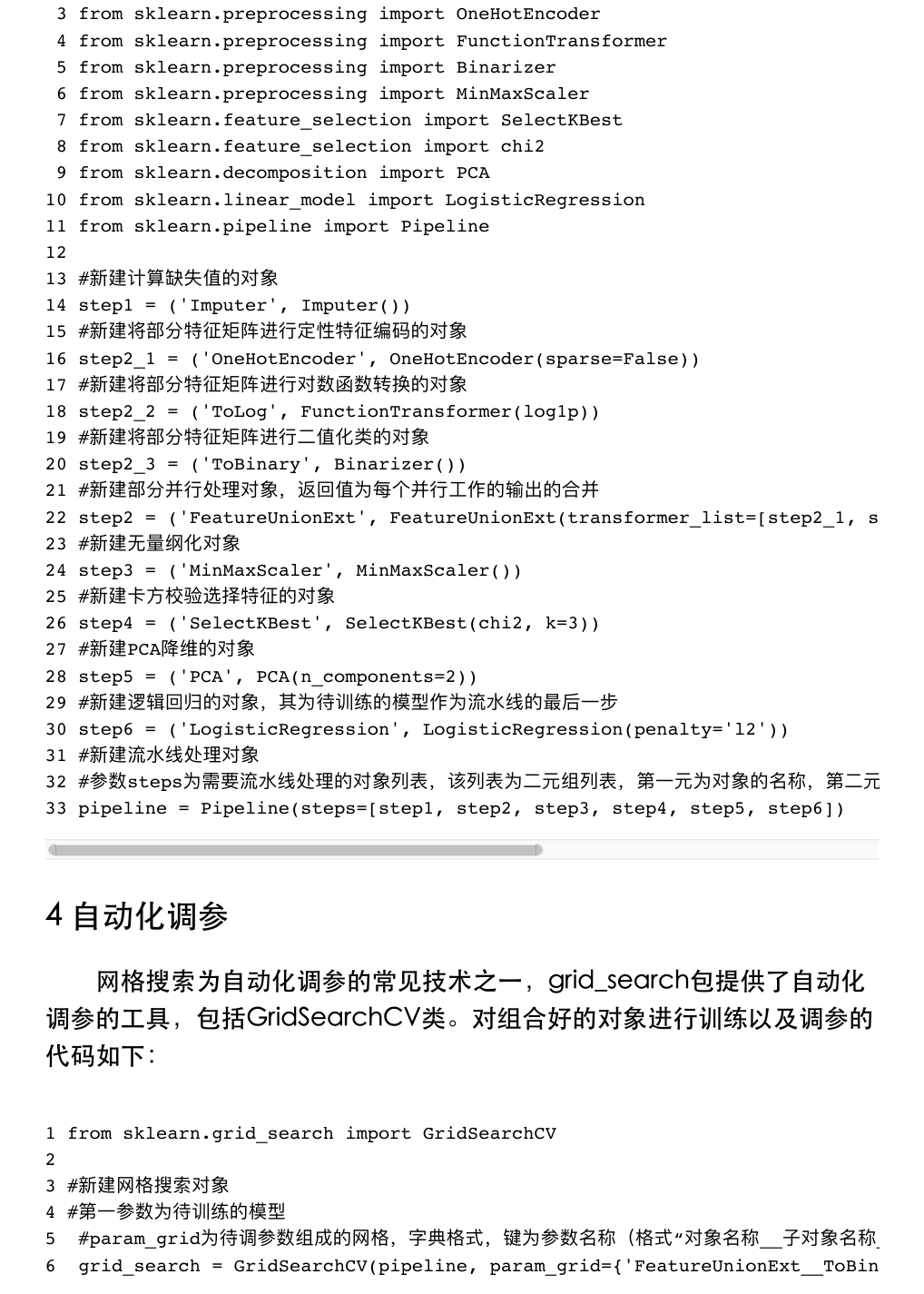

数据挖掘通常包括数据采集,数据分析,特征⼯程,训练模型,模型评

估等步骤。使⽤sklearn⼯具可以⽅便地进⾏特征⼯程和模型训练⼯作,在

《使⽤sklearn做单机特征⼯程》中,我们最后留下了⼀些疑问:特征处理

类都有三个⽅法fit、transform和fit_transform,fit⽅法居然和模型训练⽅法

fit同名(不光同名,参数列表都⼀样),这难道都是巧合?

显然,这不是巧合,这正是sklearn的设计⻛格。我们能够更加优雅地

使⽤sklearn进⾏特征⼯程和模型训练⼯作。此时,不妨从⼀个基本的数据

挖掘场景⼊⼿:

�

我们使⽤sklearn进⾏虚线框内的⼯作(sklearn也可以进⾏⽂本特征提

取)。通过分析sklearn源码,我们可以看到除训练,预测和评估以外,处

理其他⼯作的类都实现了3个⽅法:fit、transform和fit_transform。从命名

中可以看到,fit_transform⽅法是先调⽤fit然后调⽤transform,我们只需

要关注fit⽅法和transform⽅法即可。

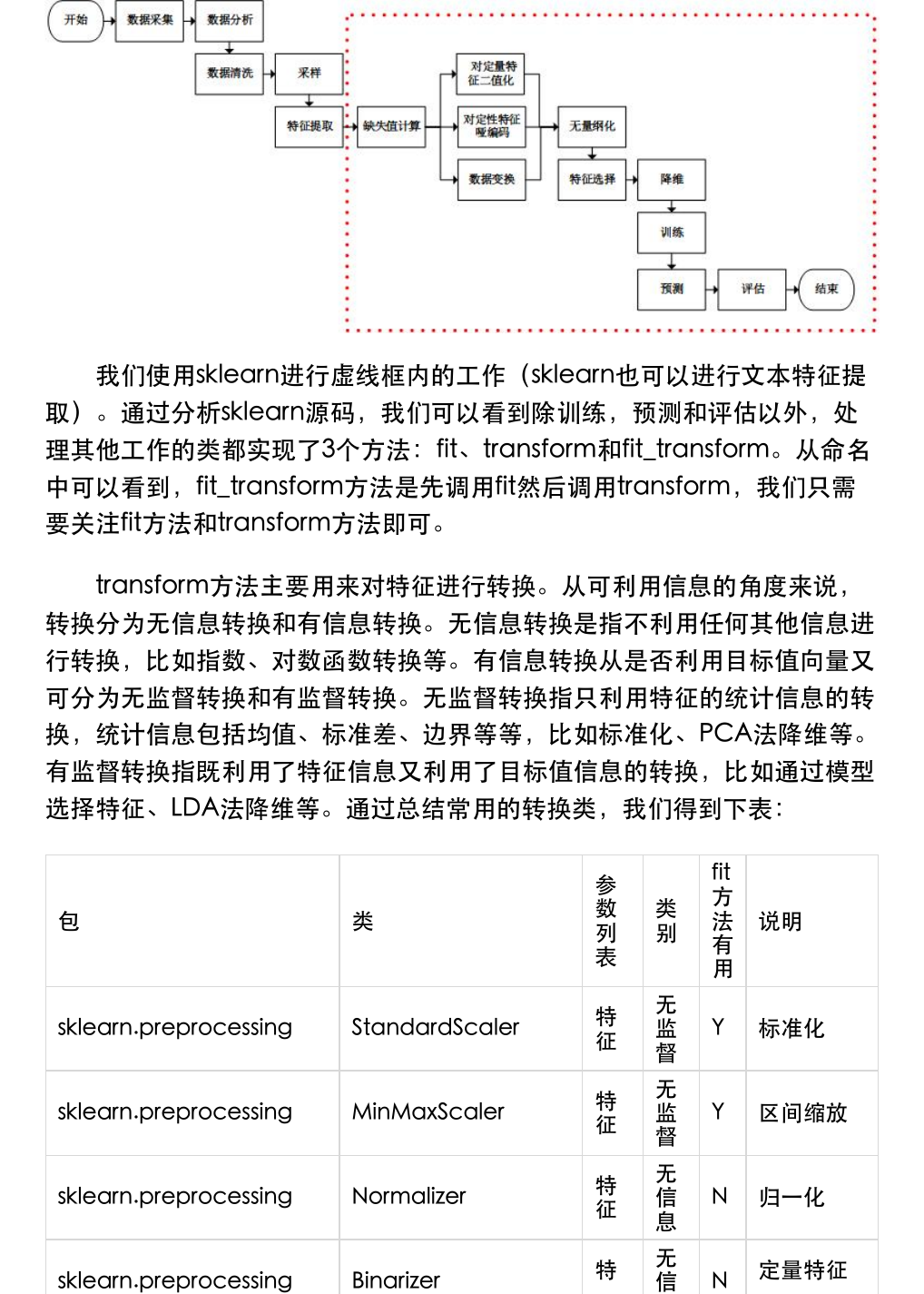

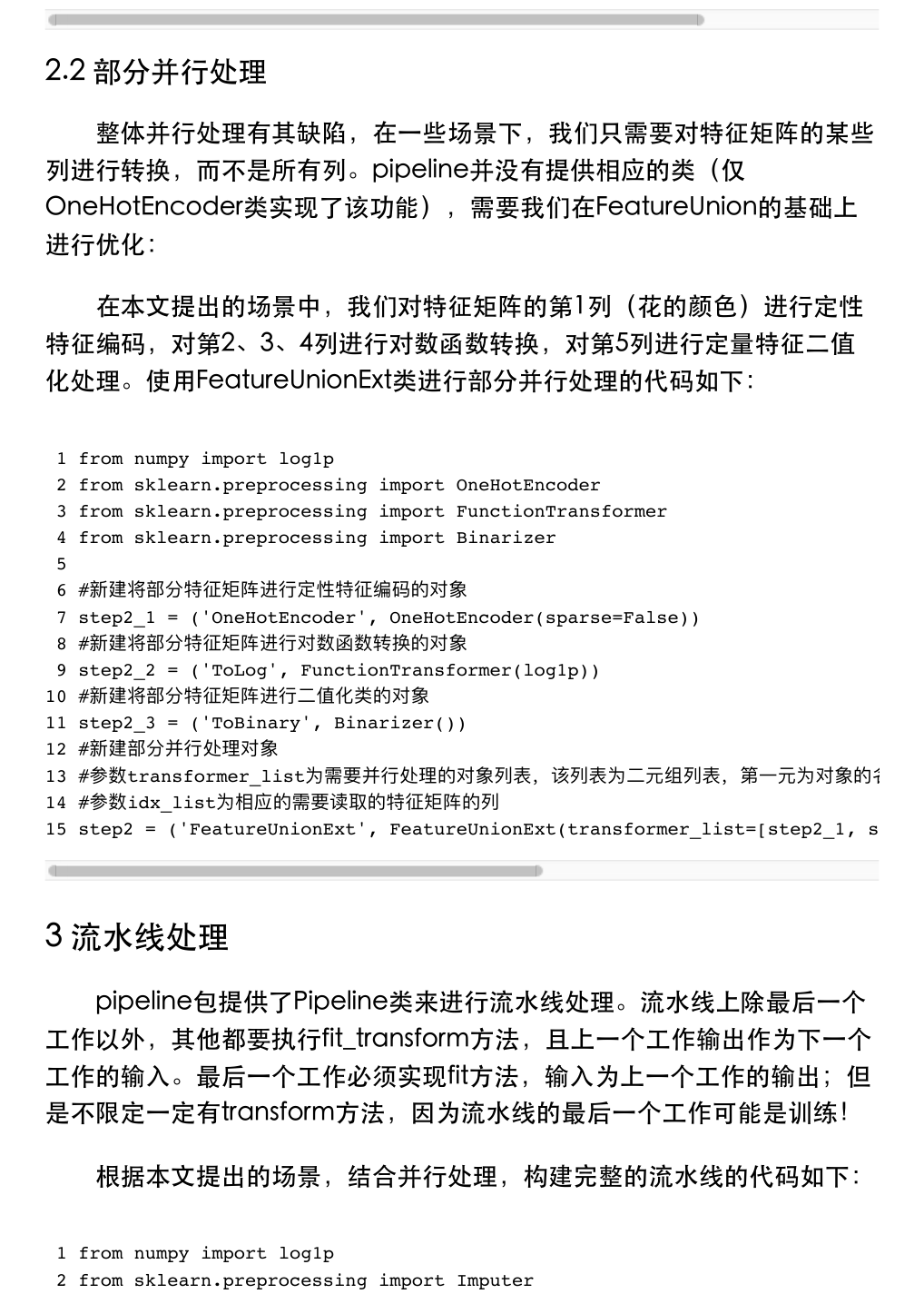

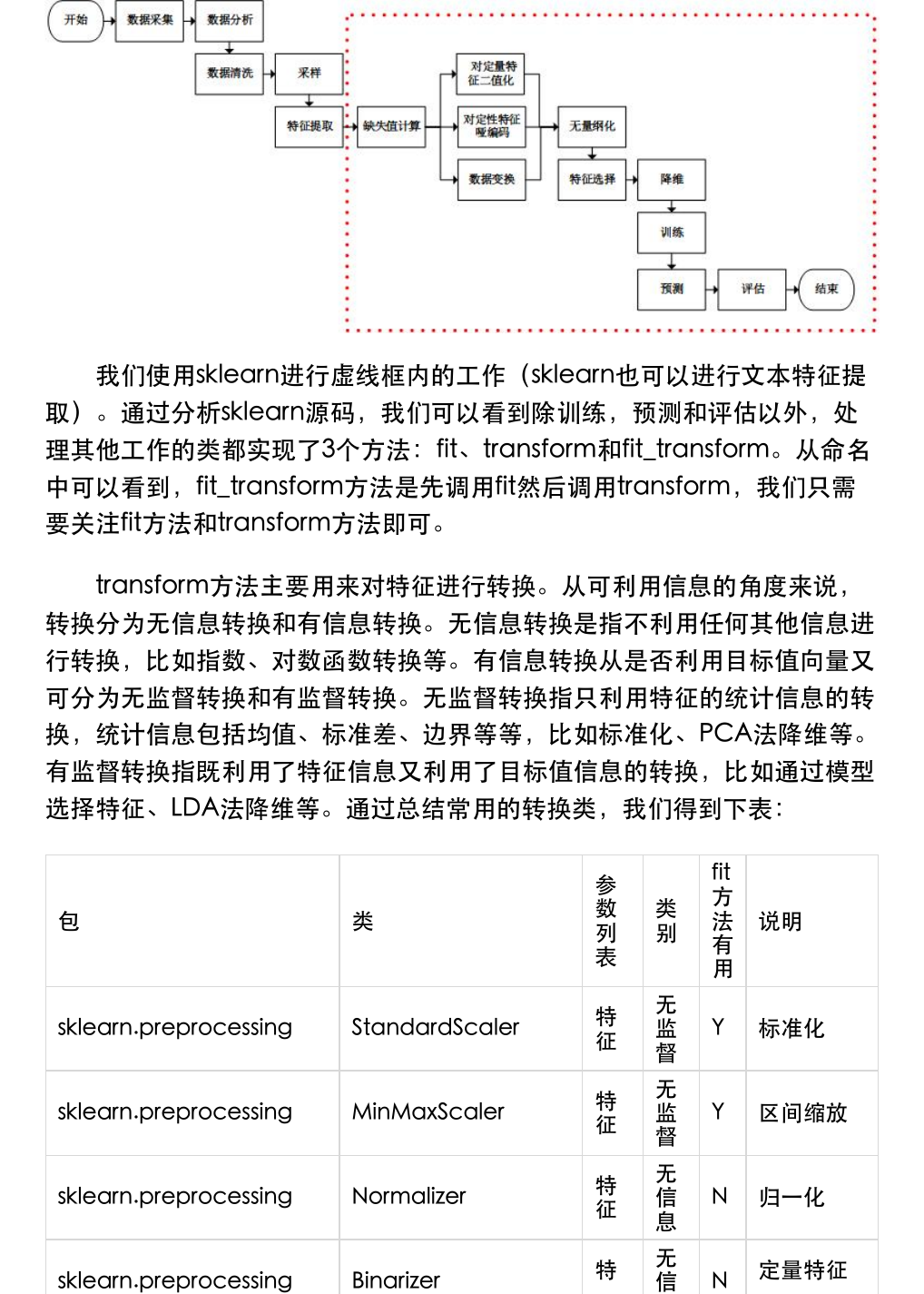

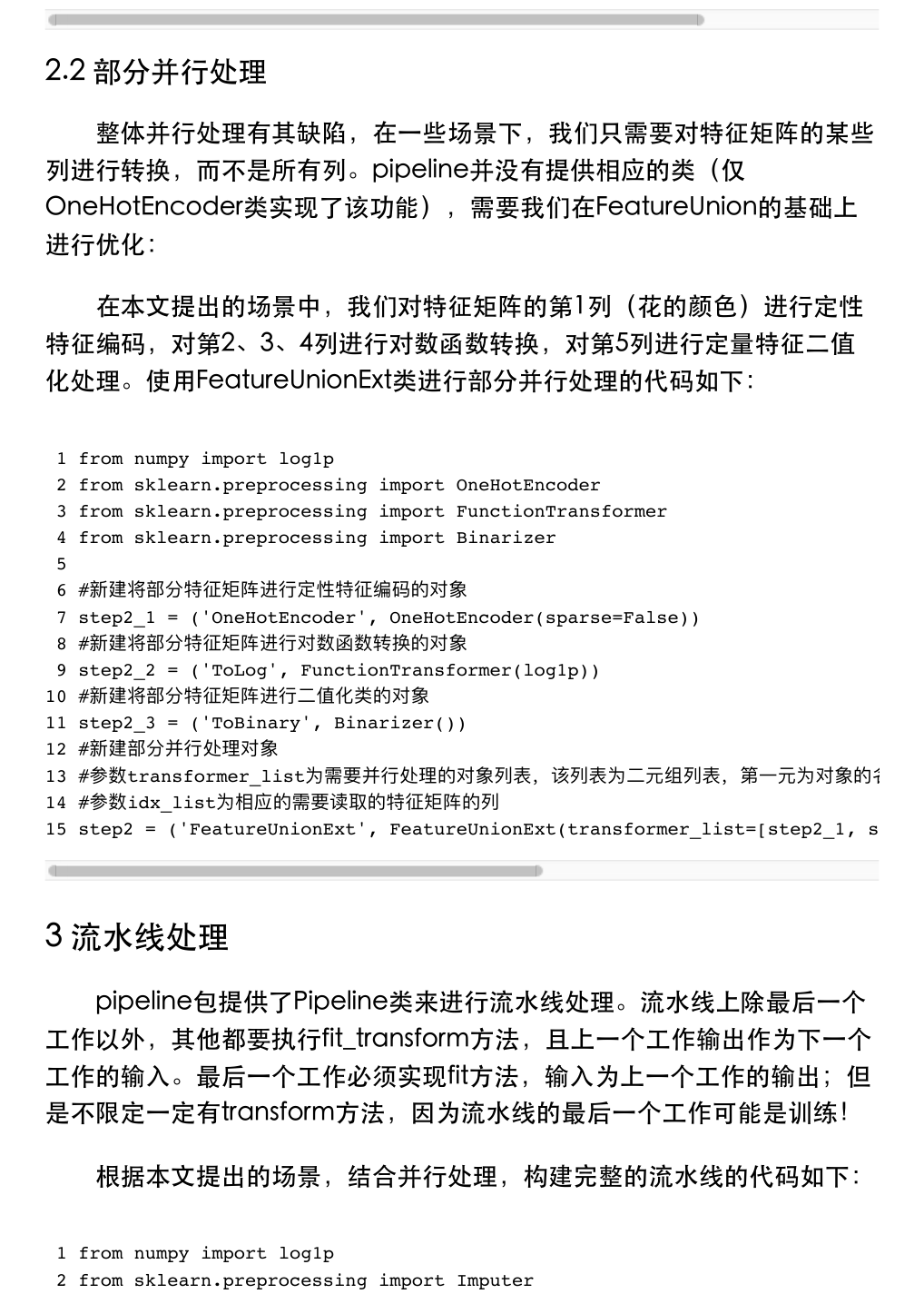

transform⽅法主要⽤来对特征进⾏转换。从可利⽤信息的⾓度来说,

转换分为⽆信息转换和有信息转换。⽆信息转换是指不利⽤任何其他信息进

⾏转换,⽐如指数、对数函数转换等。有信息转换从是否利⽤⺫标值向量⼜

可分为⽆监督转换和有监督转换。⽆监督转换指只利⽤特征的统计信息的转

换,统计信息包括均值、标准差、边界等等,⽐如标准化、PCA法降维等。

有监督转换指既利⽤了特征信息⼜利⽤了⺫标值信息的转换,⽐如通过模型

选择特征、LDA法降维等。通过总结常⽤的转换类,我们得到下表:

包

类

sklearn.preprocessing

StandardScaler

sklearn.preprocessing

MinMaxScaler

sklearn.preprocessing

Normalizer

sklearn.preprocessing

Binarizer

参

数

列

表

特

征

特

征

特

征

特

fit

⽅

法

有

⽤

说明

Y 标准化

Y 区间缩放

N 归⼀化

类

别

⽆

监

督

⽆

监

督

⽆

信

息

⽆

信 N

定量特征

�

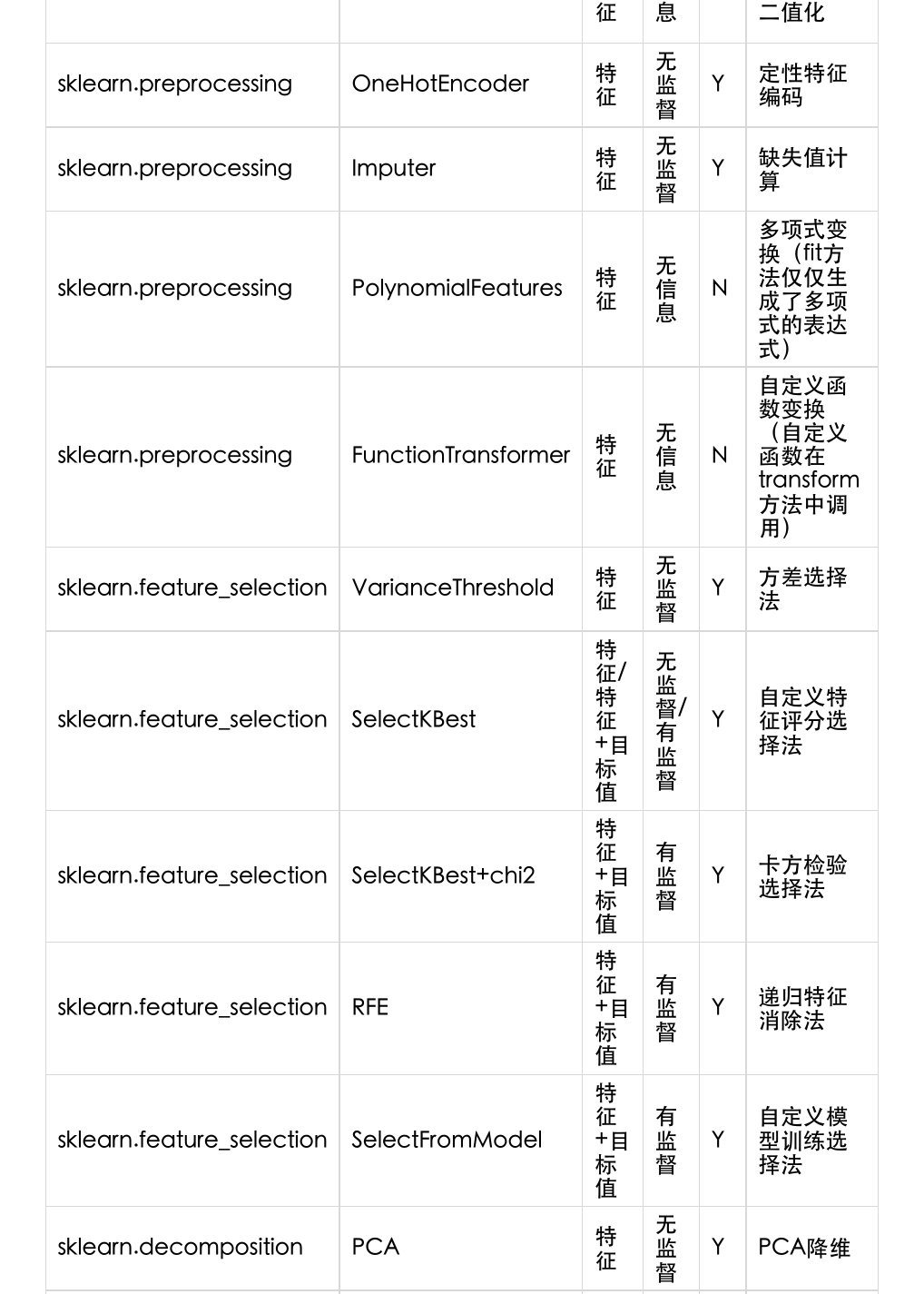

sklearn.preprocessing

OneHotEncoder

sklearn.preprocessing

Imputer

sklearn.preprocessing

PolynomialFeatures

sklearn.preprocessing

FunctionTransformer

sklearn.feature_selection VarianceThreshold

sklearn.feature_selection SelectKBest

sklearn.feature_selection SelectKBest+chi2

sklearn.feature_selection RFE

sklearn.feature_selection SelectFromModel

sklearn.decomposition

PCA

征 息

⼆值化

特

征

特

征

特

征

特

征

特

征

特

征/

特

征

+⺫

标

值

特

征

+⺫

标

值

特

征

+⺫

标

值

特

征

+⺫

标

值

特

征

⽆

监

督

⽆

监

督

⽆

信

息

⽆

信

息

⽆

监

督

⽆

监

督/

有

监

督

有

监

督

有

监

督

有

监

督

⽆

监

督

Y

Y

N

N

Y

Y

Y

Y

Y

定性特征

编码

缺失值计

算

多项式变

换(fit⽅

法仅仅⽣

成了多项

式的表达

式)

⾃定义函

数变换

(⾃定义

函数在

transform

⽅法中调

⽤)

⽅差选择

法

⾃定义特

征评分选

择法

卡⽅检验

选择法

递归特征

消除法

⾃定义模

型训练选

择法

Y

PCA降维

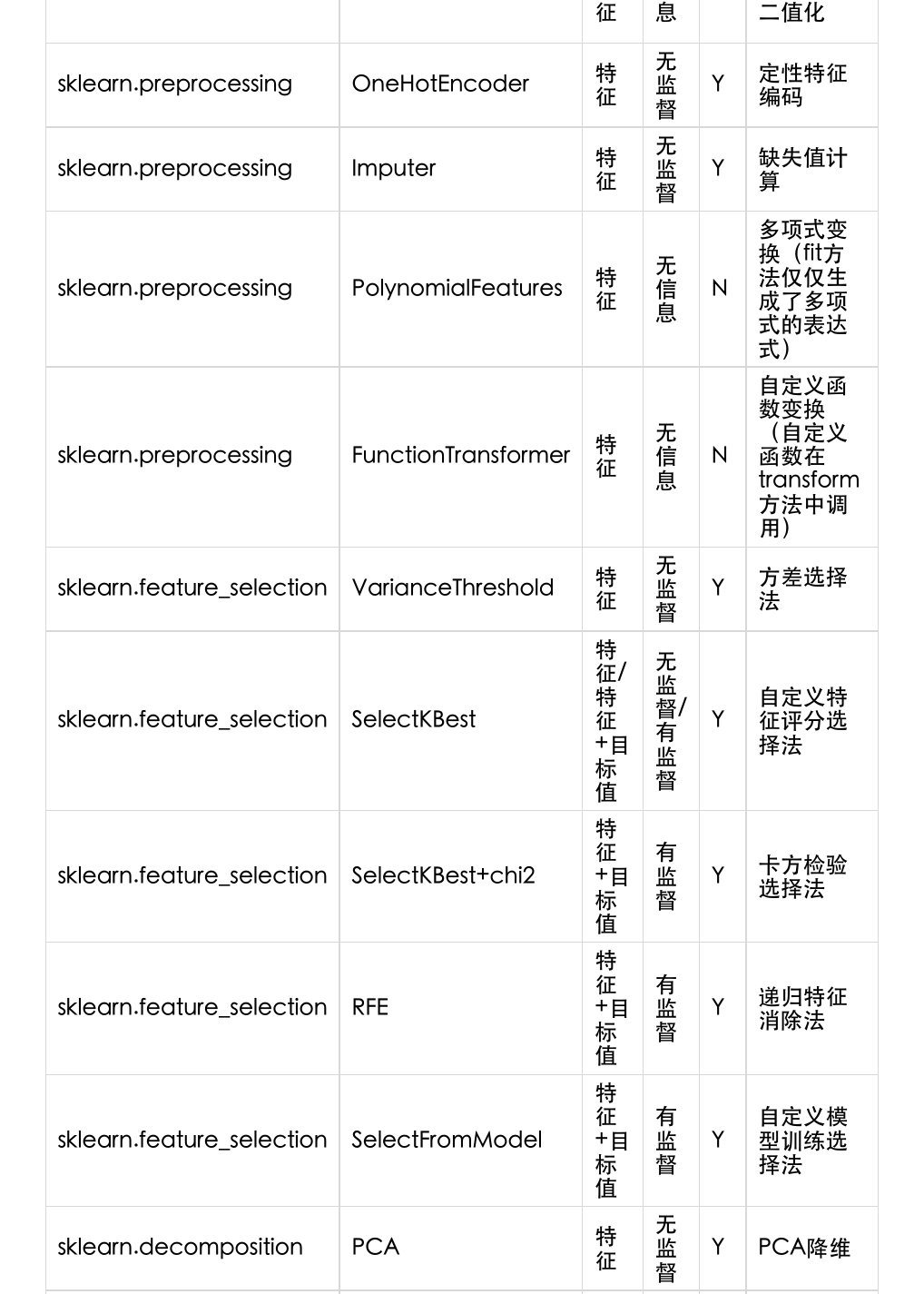

�

sklearn.lda

LDA

特

征

+⺫

标

值

有

监

督

Y

LDA降维

不难看到,只有有信息的转换类的fit⽅法才实际有⽤,显然fit⽅法的主

要⼯作是获取特征信息和⺫标值信息,在这点上,fit⽅法和模型训练时的fit

⽅法就能够联系在⼀起了:都是通过分析特征和⺫标值,提取有价值的信

息,对于转换类来说是某些统计量,对于模型来说可能是特征的权值系数

等。另外,只有有监督的转换类的fit和transform⽅法才需要特征和⺫标值

两个参数。fit⽅法⽆⽤不代表其没实现,⽽是除合法性校验以外,其并没有

对特征和⺫标值进⾏任何处理,Normalizer的fit⽅法实现如下:

1 def fit(self, X, y=None):

2 """Do nothing and return the estimator unchanged

3 This method is just there to implement the usual API and hence

4 work in pipelines.

5 """

6 X = check_array(X, accept_sparse='csr')

7 return self

基于这些特征处理⼯作都有共同的⽅法,那么试想可不可以将他们组合

在⼀起?在本⽂假设的场景中,我们可以看到这些⼯作的组合形式有两种:

流⽔线式和并⾏式。基于流⽔线组合的⼯作需要依次进⾏,前⼀个⼯作的输

出是后⼀个⼯作的输⼊;基于并⾏式的⼯作可以同时进⾏,其使⽤同样的输

⼊,所有⼯作完成后将各⾃的输出合并之后输出。sklearn提供了包

pipeline来完成流⽔线式和并⾏式的⼯作。

1.2 数据初貌

在此,我们仍然使⽤IRIS数据集来进⾏说明。为了适应提出的场景,对

原数据集需要稍微加⼯:

1 from numpy import hstack, vstack, array, median, nan

2 from numpy.random import choice

3 from sklearn.datasets import load_iris

4

5 #特征矩阵加⼯工

�

6 #使⽤用vstack增加⼀一⾏行行含缺失值的样本(nan, nan, nan, nan)

7 #使⽤用hstack增加⼀一列列表示花的颜⾊色(0-⽩白、1-⻩黄、2-红),花的颜⾊色是随机的,意味着颜⾊色并不不影响花的分类

8 iris.data = hstack((choice([0, 1, 2], size=iris.data.shape[0]+1).reshape(-1,1), vstack((iris.data, array([nan, nan, nan, nan]).reshape(1,-1

9 #⽬目标值向量量加⼯工

10 #增加⼀一个⽬目标值,对应含缺失值的样本,值为众数

11 iris.target = hstack((iris.target, array([median(iris.target)])))

1.3 关键技术

并⾏处理,流⽔线处理,⾃动化调参,持久化是使⽤sklearn优雅地进

⾏数据挖掘的核⼼。并⾏处理和流⽔线处理将多个特征处理⼯作,甚⾄包括

模型训练⼯作组合成⼀个⼯作(从代码的⾓度来说,即将多个对象组合成了

⼀个对象)。在组合的前提下,⾃动化调参技术帮我们省去了⼈⼯调参的反

锁。训练好的模型是贮存在内存中的数据,持久化能够将这些数据保存在⽂

件系统中,之后使⽤时⽆需再进⾏训练,直接从⽂件系统中加载即可。

2 并⾏处理

并⾏处理使得多个特征处理⼯作能够并⾏地进⾏。根据对特征矩阵的读

取⽅式不同,可分为整体并⾏处理和部分并⾏处理。整体并⾏处理,即并⾏

处理的每个⼯作的输⼊都是特征矩阵的整体;部分并⾏处理,即可定义每个

⼯作需要输⼊的特征矩阵的列。

2.1 整体并⾏处理

pipeline包提供了FeatureUnion类来进⾏整体并⾏处理:

1 from numpy import log1p

2 from sklearn.preprocessing import FunctionTransformer

3 from sklearn.preprocessing import Binarizer

4 from sklearn.pipeline import FeatureUnion

5

6 #新建将整体特征矩阵进⾏行行对数函数转换的对象

7 step2_1 = ('ToLog', FunctionTransformer(log1p))

8 #新建将整体特征矩阵进⾏行行⼆二值化类的对象

9 step2_2 = ('ToBinary', Binarizer())

10 #新建整体并⾏行行处理理对象

11 #该对象也有fit和transform⽅方法,fit和transform⽅方法均是并⾏行行地调⽤用需要并⾏行行处理理的对象的fit和transform⽅方法

12 #参数transformer_list为需要并⾏行行处理理的对象列列表,该列列表为⼆二元组列列表,第⼀一元为对象的名称,第⼆二元为对象

13 step2 = ('FeatureUnion', FeatureUnion(transformer_list=[step2_1, step2_2, step2_3]))

�

2.2 部分并⾏处理

整体并⾏处理有其缺陷,在⼀些场景下,我们只需要对特征矩阵的某些

列进⾏转换,⽽不是所有列。pipeline并没有提供相应的类(仅

OneHotEncoder类实现了该功能),需要我们在FeatureUnion的基础上

进⾏优化:

在本⽂提出的场景中,我们对特征矩阵的第1列(花的颜⾊)进⾏定性

特征编码,对第2、3、4列进⾏对数函数转换,对第5列进⾏定量特征⼆值

化处理。使⽤FeatureUnionExt类进⾏部分并⾏处理的代码如下:

1 from numpy import log1p

2 from sklearn.preprocessing import OneHotEncoder

3 from sklearn.preprocessing import FunctionTransformer

4 from sklearn.preprocessing import Binarizer

5

6 #新建将部分特征矩阵进⾏行行定性特征编码的对象

7 step2_1 = ('OneHotEncoder', OneHotEncoder(sparse=False))

8 #新建将部分特征矩阵进⾏行行对数函数转换的对象

9 step2_2 = ('ToLog', FunctionTransformer(log1p))

10 #新建将部分特征矩阵进⾏行行⼆二值化类的对象

11 step2_3 = ('ToBinary', Binarizer())

12 #新建部分并⾏行行处理理对象

13 #参数transformer_list为需要并⾏行行处理理的对象列列表,该列列表为⼆二元组列列表,第⼀一元为对象的名称,第⼆二元为对象

14 #参数idx_list为相应的需要读取的特征矩阵的列列

15 step2 = ('FeatureUnionExt', FeatureUnionExt(transformer_list=[step2_1, step2_2, step2_3], idx_list=[[0], [1, 2, 3], [4]]))

3 流⽔线处理

pipeline包提供了Pipeline类来进⾏流⽔线处理。流⽔线上除最后⼀个

⼯作以外,其他都要执⾏fit_transform⽅法,且上⼀个⼯作输出作为下⼀个

⼯作的输⼊。最后⼀个⼯作必须实现fit⽅法,输⼊为上⼀个⼯作的输出;但

是不限定⼀定有transform⽅法,因为流⽔线的最后⼀个⼯作可能是训练!

根据本⽂提出的场景,结合并⾏处理,构建完整的流⽔线的代码如下:

1 from numpy import log1p

2 from sklearn.preprocessing import Imputer

�

3 from sklearn.preprocessing import OneHotEncoder

4 from sklearn.preprocessing import FunctionTransformer

5 from sklearn.preprocessing import Binarizer

6 from sklearn.preprocessing import MinMaxScaler

7 from sklearn.feature_selection import SelectKBest

8 from sklearn.feature_selection import chi2

9 from sklearn.decomposition import PCA

10 from sklearn.linear_model import LogisticRegression

11 from sklearn.pipeline import Pipeline

12

13 #新建计算缺失值的对象

14 step1 = ('Imputer', Imputer())

15 #新建将部分特征矩阵进⾏行行定性特征编码的对象

16 step2_1 = ('OneHotEncoder', OneHotEncoder(sparse=False))

17 #新建将部分特征矩阵进⾏行行对数函数转换的对象

18 step2_2 = ('ToLog', FunctionTransformer(log1p))

19 #新建将部分特征矩阵进⾏行行⼆二值化类的对象

20 step2_3 = ('ToBinary', Binarizer())

21 #新建部分并⾏行行处理理对象,返回值为每个并⾏行行⼯工作的输出的合并

22 step2 = ('FeatureUnionExt', FeatureUnionExt(transformer_list=[step2_1, step2_2, step2_3], idx_list=[[0], [1, 2, 3], [4

23 #新建⽆无量量纲化对象

24 step3 = ('MinMaxScaler', MinMaxScaler())

25 #新建卡⽅方校验选择特征的对象

26 step4 = ('SelectKBest', SelectKBest(chi2, k=3))

27 #新建PCA降维的对象

28 step5 = ('PCA', PCA(n_components=2))

29 #新建逻辑回归的对象,其为待训练的模型作为流⽔水线的最后⼀一步

30 step6 = ('LogisticRegression', LogisticRegression(penalty='l2'))

31 #新建流⽔水线处理理对象

32 #参数steps为需要流⽔水线处理理的对象列列表,该列列表为⼆二元组列列表,第⼀一元为对象的名称,第⼆二元为对象

33 pipeline = Pipeline(steps=[step1, step2, step3, step4, step5, step6])

4 ⾃动化调参

⺴格搜索为⾃动化调参的常⻅技术之⼀,grid_search包提供了⾃动化

调参的⼯具,包括GridSearchCV类。对组合好的对象进⾏训练以及调参的

代码如下:

1 from sklearn.grid_search import GridSearchCV

2

3 #新建⽹网格搜索对象

4 #第⼀一参数为待训练的模型

5 #param_grid为待调参数组成的⽹网格,字典格式,键为参数名称(格式“对象名称__⼦子对象名称__参数名称”),值为可取的参数值列列表

6 grid_search = GridSearchCV(pipeline, param_grid={'FeatureUnionExt__ToBinary__threshold

�

7 #训练以及调参

8 grid_search.fit(iris.data, iris.target)

5 持久化

externals.joblib包提供了dump和load⽅法来持久化和加载内存数

据:

1 #持久化数据

2 #第⼀一个参数为内存中的对象

3 #第⼆二个参数为保存在⽂文件系统中的名称

4 #第三个参数为压缩级别,0为不不压缩,3为合适的压缩级别

5 dump(grid_search, 'grid_search.dmp', compress=3)

6 #从⽂文件系统中加载数据到内存中

7 grid_search = load('grid_search.dmp')

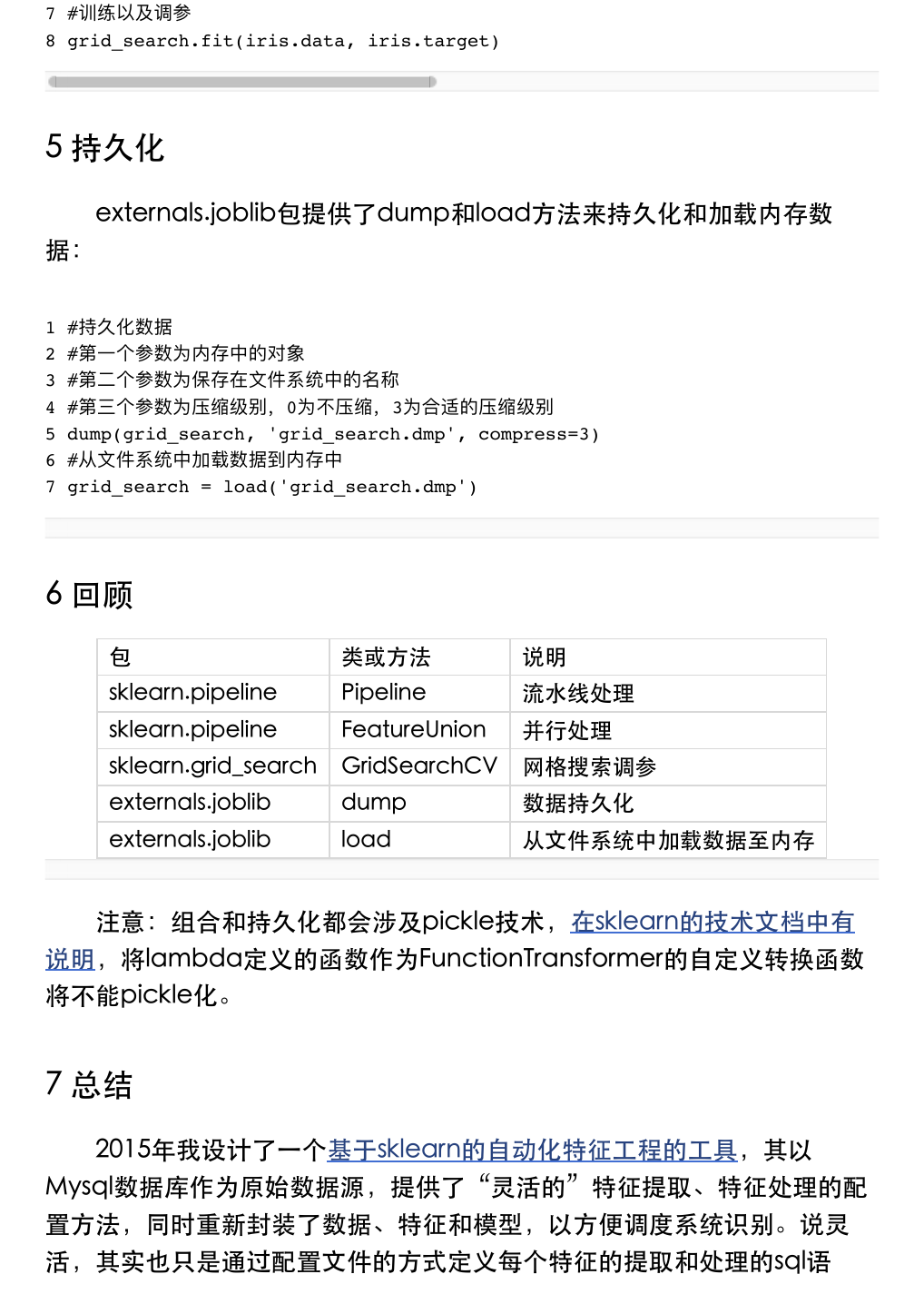

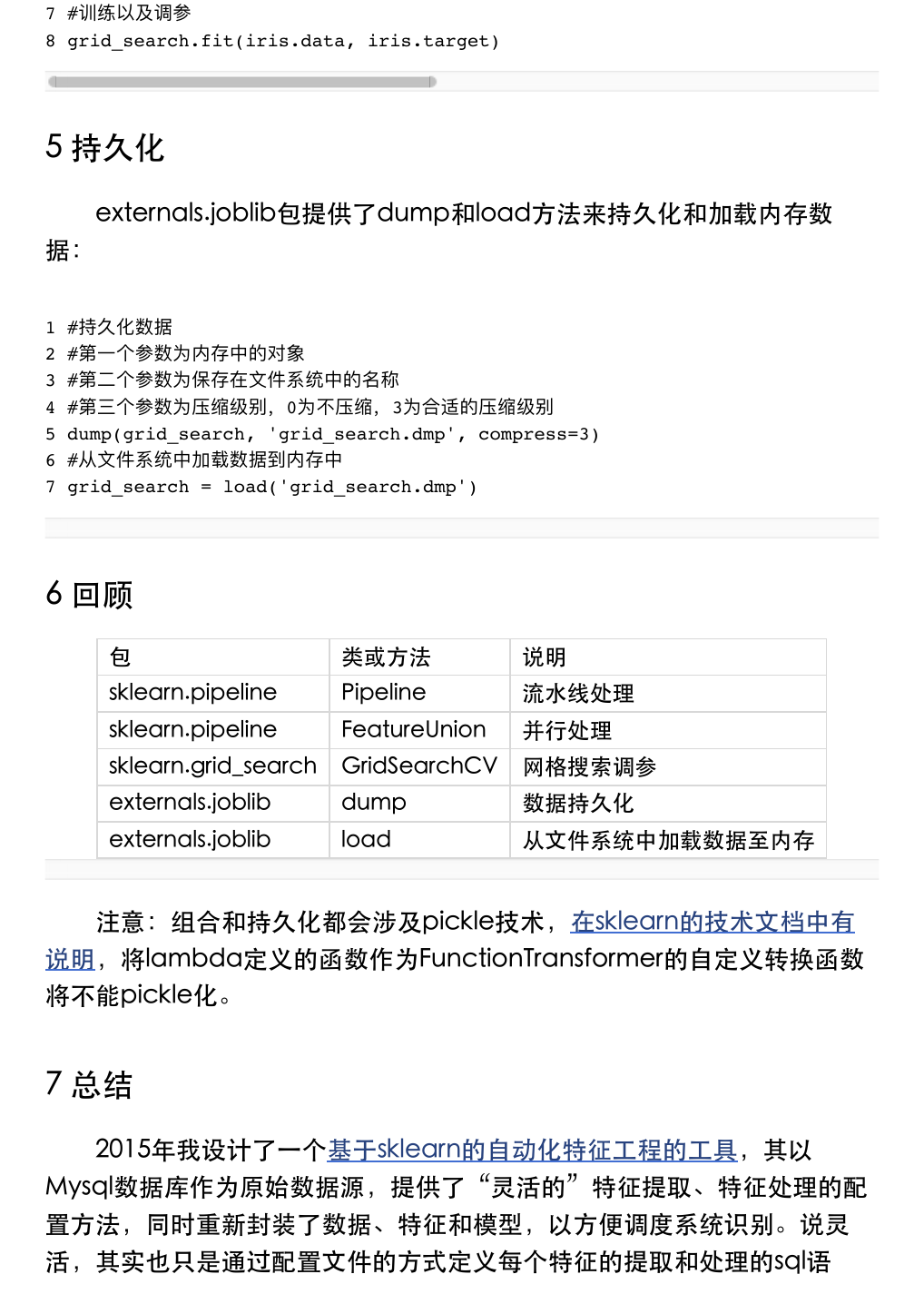

6 回顾

包

sklearn.pipeline

类或⽅法

Pipeline

说明

流⽔线处理

sklearn.pipeline

FeatureUnion 并⾏处理

sklearn.grid_search GridSearchCV ⺴格搜索调参

externals.joblib

externals.joblib

dump

load

数据持久化

从⽂件系统中加载数据⾄内存

注意:组合和持久化都会涉及pickle技术,在sklearn的技术⽂档中有

说明,将lambda定义的函数作为FunctionTransformer的⾃定义转换函数

将不能pickle化。

7 总结

2015年我设计了⼀个基于sklearn的⾃动化特征⼯程的⼯具,其以

Mysql数据库作为原始数据源,提供了“灵活的”特征提取、特征处理的配

置⽅法,同时重新封装了数据、特征和模型,以⽅便调度系统识别。说灵

活,其实也只是通过配置⽂件的⽅式定义每个特征的提取和处理的sql语

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc