北京交通大学 2019-2020 学年第一学期

计算机与信息技术学院 硕士研究生《机器学习》试题(参考答案)

班级:

姓名:___________ 学号:____________ 上课教师:______________

一

二

三

四

总分

题号

得分

阅卷人

一、单项选择题(每题 2 分,共 30 分)

【1】___ A ____ 【2】___ C ___【3】____ C ___【4】____ D _____【5】____ D _____

【6】___ C ____ 【7】____ A __【8】____B____【9】____C______【10】__C______

【11】__D_____ 【12】___A___【13】___B____【14】____D_____【15】__A_______

二、判断题(每题 2 分,共 20 分)

【1】___√____ 【2】___√____【3】____√____【4】_____√____【5】____×____

【6】___√_____ 【7】__×_____【8】____×___【9】____×____【10】___√____

三、计算题(共 50 分)

第 1 题(3 分)

计算向量(1,−1,2,3)的1、2和∞范数。

解:该向量的1范数是1+−1+2+3 =7,2范数是 12+(−1)2+22+32= 15

,∞范数是max1,|−1|,2,3 =3。【每个范数各 1 分】

给定平面上的四个点(1,2)、(3,5)、(4,6)和(6,12),使用最小二乘法给出其线性拟合函数。

解:假定其线性拟合函数为=+【1 分】,我们通过极小化下述函数求解和

(2−−)2+(5−3−)2+(6−4−)2+(12−6−)2【2 分】。

第 2 题(7 分)

1

�

方法将其降为一维。

第 3 题(10 分)

由上述函数对和求导等于 0 可知113=62+14以及25=14+4【2 分】。从而=5126

和=− 813【2 分】。

求出三维空间数据集{(0,1,2),(0,2,1),(1,1,1),(−1,0,0)}的中心并将其中心化,再使用 PCA

解:由于这四个向量的均值是(0,1,1)【2 分】,于是中心化之后的数据集是

{1=(0,0,1),2=(0,1,0),3=(1,0,0),4=(−1,−1,−1)}【2 分】。

使用 PCA 方法将其降为一维,只需找到三维空间中的单位向量,使得每个向量在其上

投影得到的均方误差达到最小,即在条件<,>=1 之下极小化

�

|−<,>|2

=14

�

注意上述目标函数可以进一步简化为− =14 <,>2

该优化问题的拉格朗日函数是− =14 <,>2

�

−<,>,对求导等于 0 可知

�

=【2 分】。

=14

计算可知,矩阵 =14

2 1 1

1 2 1

1 1 2

由此可得该矩阵的最大特征值是 4,对应的特征向量是(1,1,1),即=(1,1,1)【2 分】。

。

【2 分】。

�

为

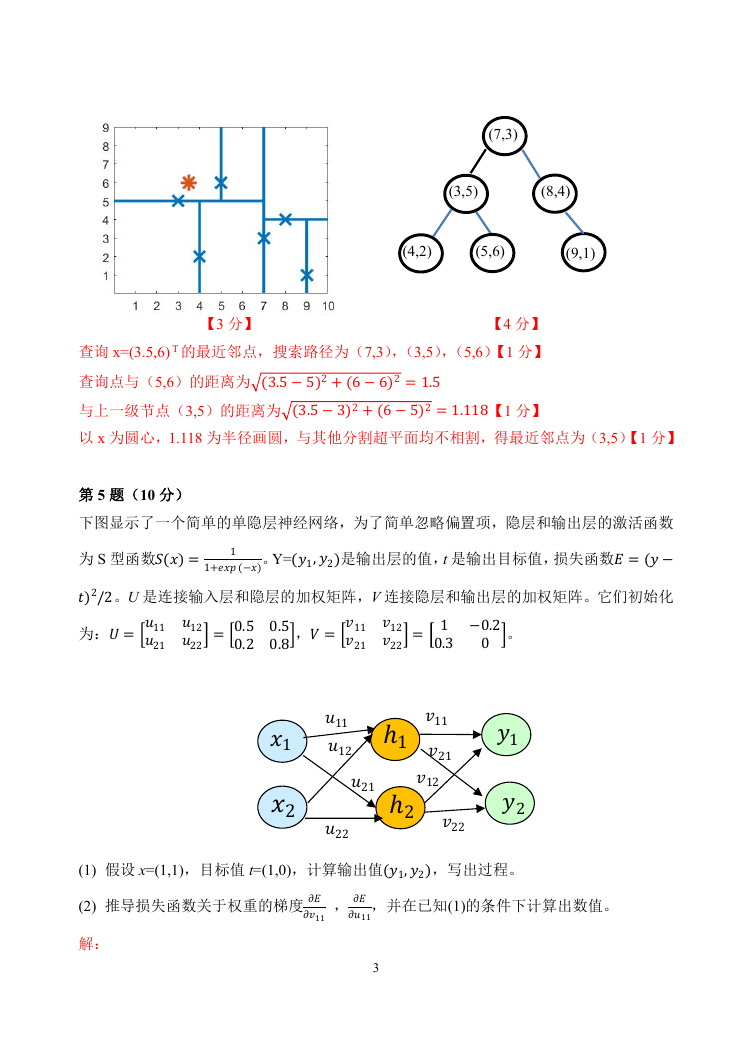

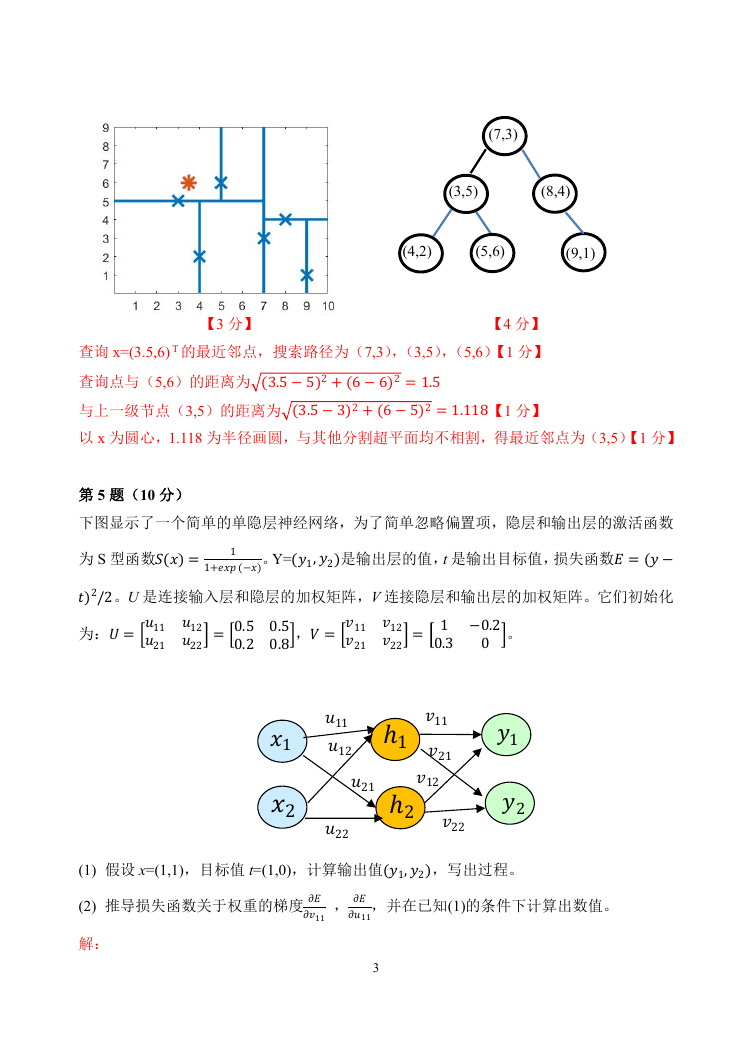

第 4 题(10 分)

给定一个二维空间的数据集:T={(3,5)T, (7,3)T, (8,4)T, (5,6)T, (4,2)T, (9,1)T},试构造 kd 树,给

出空间划分图,并查询 x=(3.5,6) T 的最近邻点。

答:

2

�

(7,3)

(3,5)

(8,4)

(4,2)

(5,6)

(9,1)

【3 分】

【4 分】

查询 x=(3.5,6) T 的最近邻点,搜索路径为(7,3),(3,5),(5,6)【1 分】

查询点与(5,6)的距离为 (3.5−5)2+(6−6)2=1.5

与上一级节点(3,5)的距离为 (3.5−3)2+(6−5)2=1.118【1 分】

以 x 为圆心,1.118 为半径画圆,与其他分割超平面均不相割,得最近邻点为(3,5)【1 分】

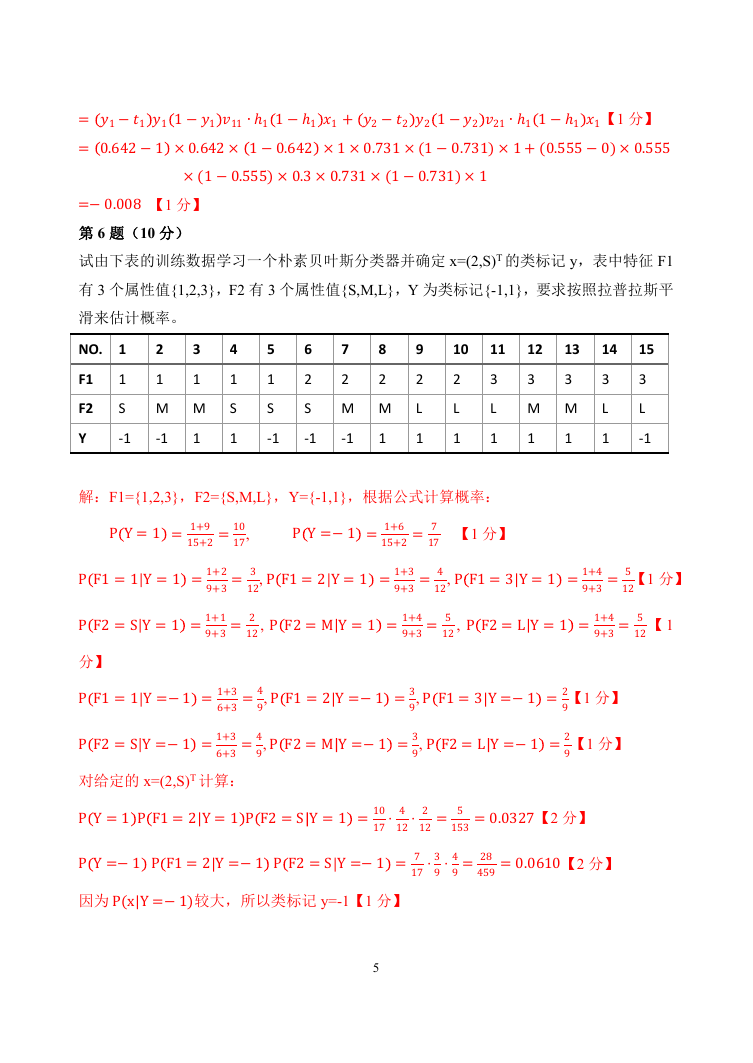

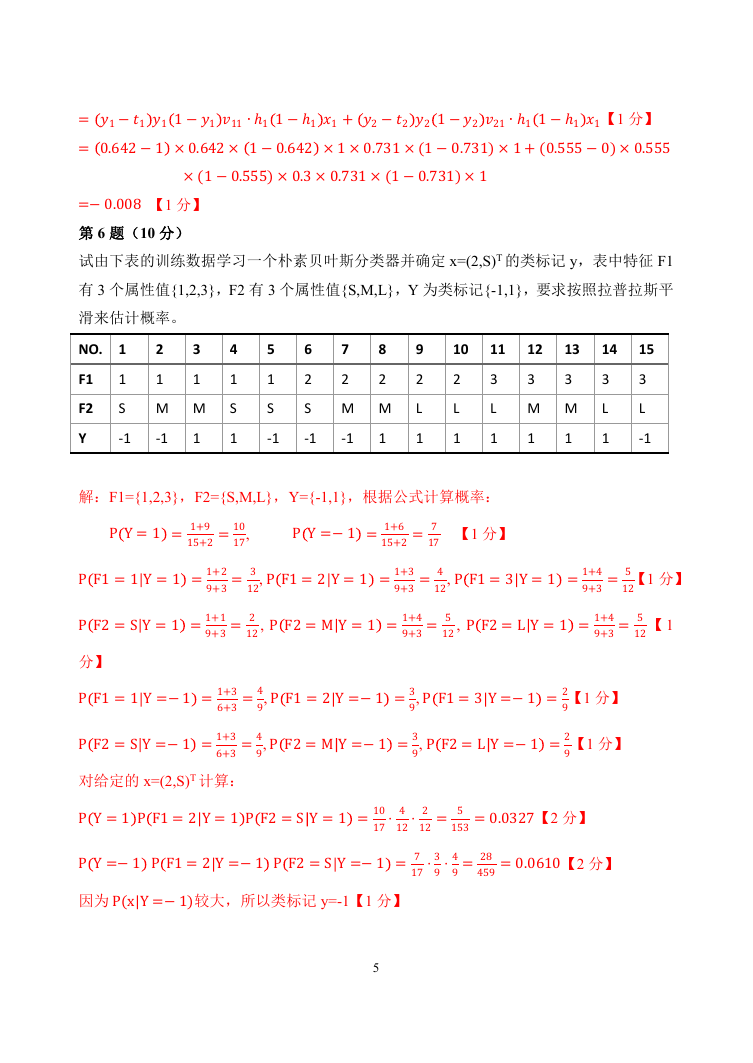

第 5 题(10 分)

下图显示了一个简单的单隐层神经网络,为了简单忽略偏置项,隐层和输出层的激活函数

21 22 = 0.5 0.5

1+(−)。Y=(1,2)是输出层的值,t 是输出目标值,损失函数=(−

为 S 型函数()=

1

)2/2。U 是连接输入层和隐层的加权矩阵,V 连接隐层和输出层的加权矩阵。它们初始化

0.2 0.8 ,= 11 12

为:= 11 12

21 22 = 1 −0.2

0.3

0 。

11

1

111221

12

21

12

2

22

22

(1) 假设 x=(1,1),目标值 t=(1,0),计算输出值(1,2),写出过程。

(2) 推导损失函数关于权重的梯度11 ,11,并在已知(1)的条件下计算出数值。

ℎ1ℎ2

解:

3

�

【1 分】

(1)=+, =+

= (+)

= (+++) 【1分】

=S(S0.5×1+0.5×1 ×1+S(1×0.2+1×0.8)×(−0.2))

=(1 +1 × −0.2)

11+−1− 0.2

=S(

1+−1)

=S(0.585)

1

1

=

1+−0.585=

1+0.557

=0.642

= (+)

= (+++)【1 分】

=S(S1 ×0.3+S(1)×0)

=(S1 ×0.3)

=(0.731×0.3)

1

=

1+−0.219

=0.555

【1 分】

故1,2 =(0.642,0.555)

(2)E=(−)22

1= (+)

ℎ1=111+212 =(1)

11= 1∙111

= 1−1 ∙'+ ∙

= 1−1 ∙1−1 ∙ 【1 分】

11+−1

=(0.642−1)×0.642×(1−0.642)×

=−0.0602【1 分】

11= 1∙1ℎ1∙ℎ111+2∙2ℎ1∙ℎ111 【1 分】

【1 分】

4

�

= 1−111−111∙ℎ11−ℎ11+ 2−221−221∙ℎ11−ℎ11【1 分】

= 0.642−1 ×0.642× 1−0.642 ×1×0.731×(1−0.731)×1+(0.555−0)×0.555

=−0.008 【1 分】

×(1−0.555)×0.3×0.731×(1−0.731)×1

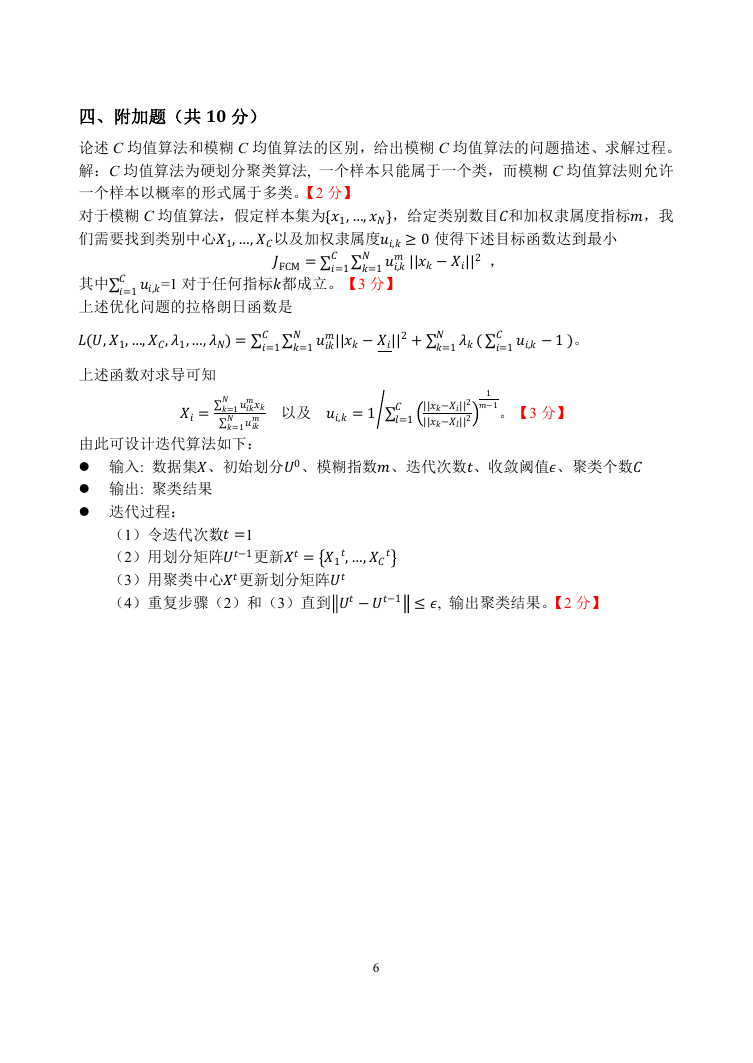

第 6 题(10 分)

试由下表的训练数据学习一个朴素贝叶斯分类器并确定 x=(2,S)T 的类标记 y,表中特征 F1

有 3 个属性值{1,2,3},F2 有 3 个属性值{S,M,L},Y 为类标记{-1,1},要求按照拉普拉斯平

滑来估计概率。

NO.

F1

F2

Y

1

1

S

-1

3

1

4

2

1

1

M M S

-1

1

1

5

1

S

-1

6

2

S

-1

8

2

9

7

2

2

M M L

-1

1

1

10

2

L

1

11

3

L

1

13

3

14

12

3

3

M M L

1

1

1

15

3

L

-1

解:F1={1,2,3},F2={S,M,L},Y={-1,1},根据公式计算概率:

PY=−1 = 1+615+2= 717 【1 分】

PY=1 = 1+915+2=1017,

PF1=1Y=1 =1+29+3= 312,PF1=2Y=1 =1+39+3= 412,PF1=3Y=1 =1+49+3= 512【1 分】

PF2=SY=1 =1+19+3= 212 ,PF2=MY=1 =1+49+3= 512 ,PF2=LY=1 =1+49+3= 512 【 1

分】PF1=1Y=−1 =1+36+3=49,PF1=2Y=−1 =39,PF1=3Y=−1 =29【1 分】

PF2=SY=−1 =1+36+3=49,PF2=MY=−1 =39,PF2=LY=−1 =29【1 分】

PY=1PF1=2Y=1PF2=SY=1 =1017⋅ 412⋅ 212= 5153=0.0327【2 分】

PY=−1 PF1=2Y=−1 PF2=SY=−1 = 717⋅39⋅49= 28459=0.0610【2 分】

因为P(x|Y=−1)较大,所以类标记 y=-1【1 分】

对给定的 x=(2,S)T 计算:

5

�

上述优化问题的拉格朗日函数是

四、附加题(共 10 分)

论述 C 均值算法和模糊 C 均值算法的区别,给出模糊 C 均值算法的问题描述、求解过程。

解:C 均值算法为硬划分聚类算法, 一个样本只能属于一个类,而模糊 C 均值算法则允许

一个样本以概率的形式属于多类。【2 分】

对于模糊 C 均值算法,假定样本集为{1,…,},给定类别数目和加权隶属度指标,我

们需要找到类别中心1,…,以及加权隶属度,≥0 使得下述目标函数达到最小

�

||−||2

�

FCM= =1

=1 ,

�

其中 =1 ,

=1 对于任何指标都成立。【3 分】

=1 ||−||2

��

�

�

(,1,…,,1,…,)= =1

+ =1

=1 ,−1

)。

(

上述函数对求导可知= =1

1−1

�

以及 ,=1

� =1

||−||2

=1

||−||2

�

输入: 数据集、初始划分0、模糊指数、迭代次数、收敛阈值、聚类个数

(1)令迭代次数=1

(2)用划分矩阵−1更新= 1,…,

(3)用聚类中心更新划分矩阵

(4)重复步骤(2)和(3)直到−−1 ≤, 输出聚类结果。【2 分】

由此可设计迭代算法如下:

输出: 聚类结果

迭代过程:

,

。【3 分】

6

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc