考查课程报告

课程名称:

Python 程序设计

学

院:

信息工程与自动化学院

专业年级:

数科 171

学

号:

201710415124

学生姓名:

指导教师:

吴睿姗

王红斌

日

期:

2018-6-19

�

期末考查结果评定

得分

评分项目

○1 报告条理清晰,内容详实,体会

深刻

○2 报告格式符合规范

○3 程序符合要求

○4 界面美观,功能有扩充

评语:

分值

40

10

40

10

成绩:

指导教师签字:

评定日期:

年

月

日

�

目

录

1 需求分析.................................................................................................1

1.1 系统背景介绍...............................................................................1

1.2 功能需求分析...............................................................................2

2 总体设计.................................................................................................2

2.1 系统功能结构...............................................................................2

2.2 系统流程图...................................................................................3

2.3 开发及运行环境...........................................................................3

3 详细设计.................................................................................................3

4 代码实现.................................................................................................4

4.1 业务模型图...................................................................................4

4.2 程序运行截图...............................................................................4

5 测试.........................................................................................................5

6 总结.........................................................................................................5

0

�

1 需求分析

1.1 系统背景介绍

随着互联网技术的发展与应用的普及,网络信息突发式暴增,作为信息的载体的

网络,已经成为社会大众参与社会生活的一种重要信息渠道。互联网是开放的,已成

为思想文化信息的集散地,并具有传统媒体无法相比的优势:便捷性,虚拟性,互动

性,多元性。

网络蜘蛛即 Web

Spider,是一个非常形象的名字。网络爬虫,是一种按照一定

的规则,自动地抓取万维网信息的程序或者脚本,是搜索引擎的重要组成部分。把互

联网比喻成一个蜘蛛网,那么 Spider 程序就是在网上爬来爬去的蜘蛛。网络蜘蛛是

通过网页的链接地址来寻找网页,从网站的某一个页面(通常是首页)开始,读取网

页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,

这样一直循环下去,直到把这个网站所有的网页都抓取完为止。如果把整个互联网当

成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。

搜索引擎作为一个辅助人们检索信息的工具成为用户访问万维网的入口和指南,

通用搜索引擎便具有了很大的局限性。由此,定向抓取相关网页资源的爬虫应运而生,

并且还出现了很多强大功能的爬虫系统,例如爬取动态视频、天猫物品、爱奇艺等需

VIP 观看的电影、12306 抢票等,本文只是爬取网页中的文本并进行分词、实现词云

展示进行程序设计。

1

�

1.2 功能需求分析

(1)网页蜘蛛

新闻爬虫的具体功能包括对新闻标题、新闻 ID、新闻来源、新闻内容等信息进

行抓取并存入数据库中。而本次课题要求我们对人民网云南板块的新闻文本进行爬取

储存。

(2)结巴分词

分词是文本挖掘的预处理的重要的一步,分词完成后,我们可以继续做一些其他

的特征工程。

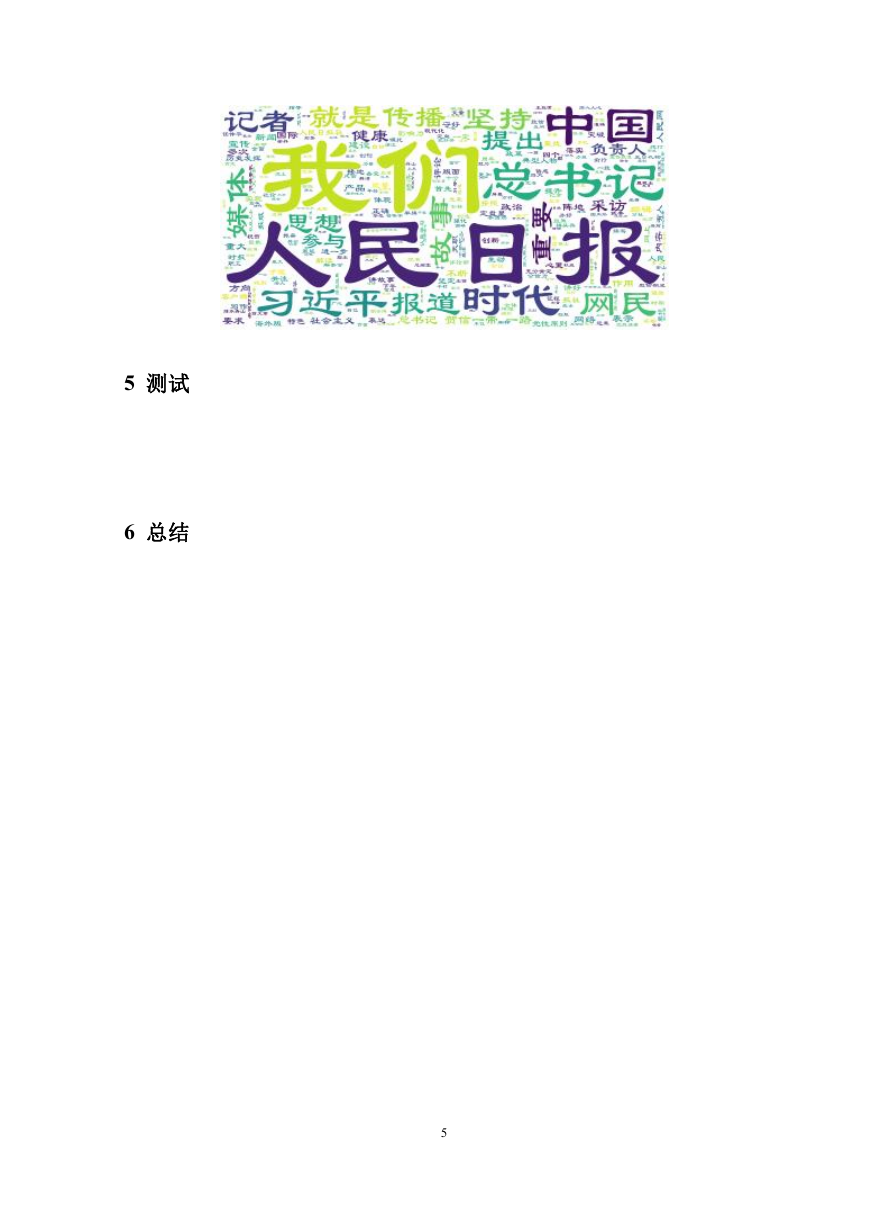

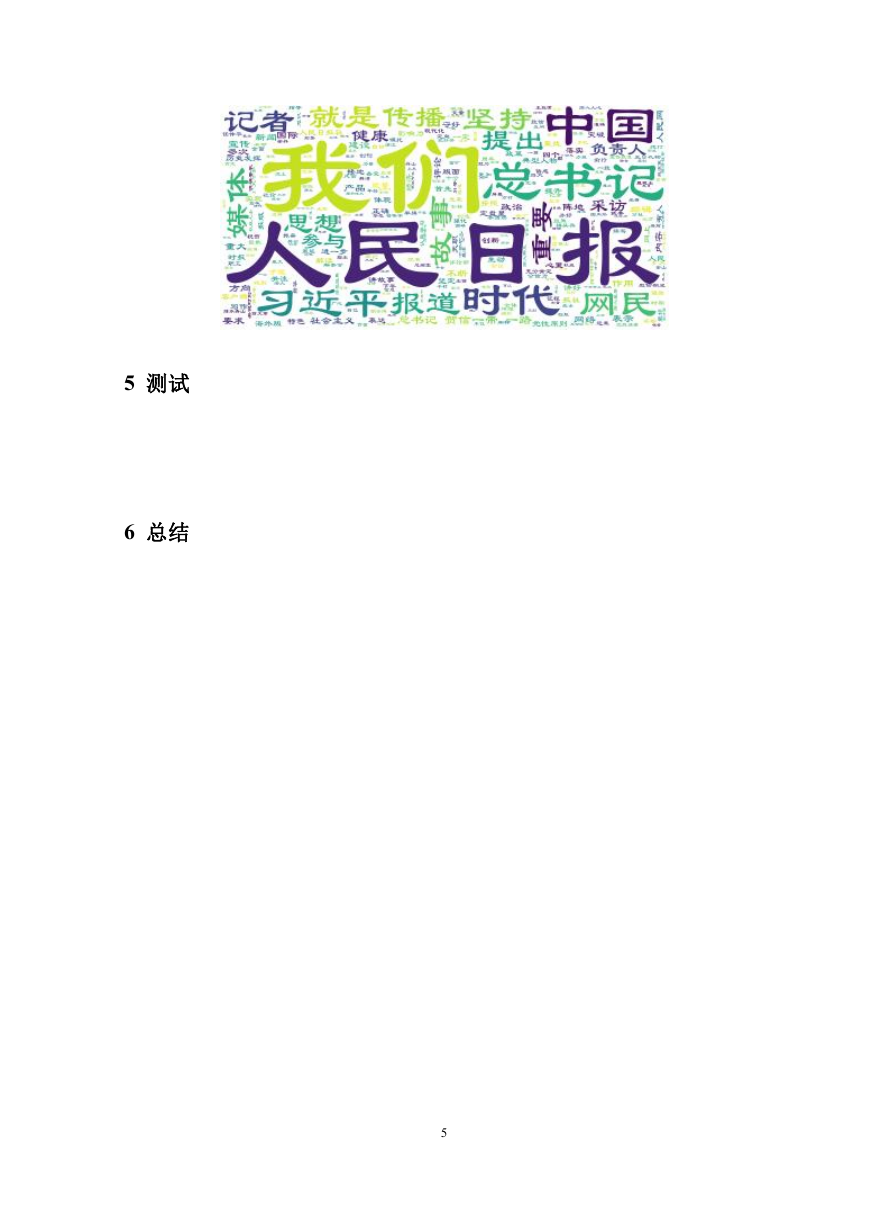

(3)词云展示

词云以词语为基本单位,更加直观和艺术的展示文本,wordcloud 库把词云当作

一个 WordCloud 对象,-wordcloud.WordCloud()代表一个文本对应的词云,可以根据

文本中词语出现的频率等参数绘制词云。

本次课题的任务偏重于新闻文本的爬取,选用 requests 发送 http 数据请求,用

BeautifulSoup 对新闻的 html 文件进行数据提取,

2 总体设计

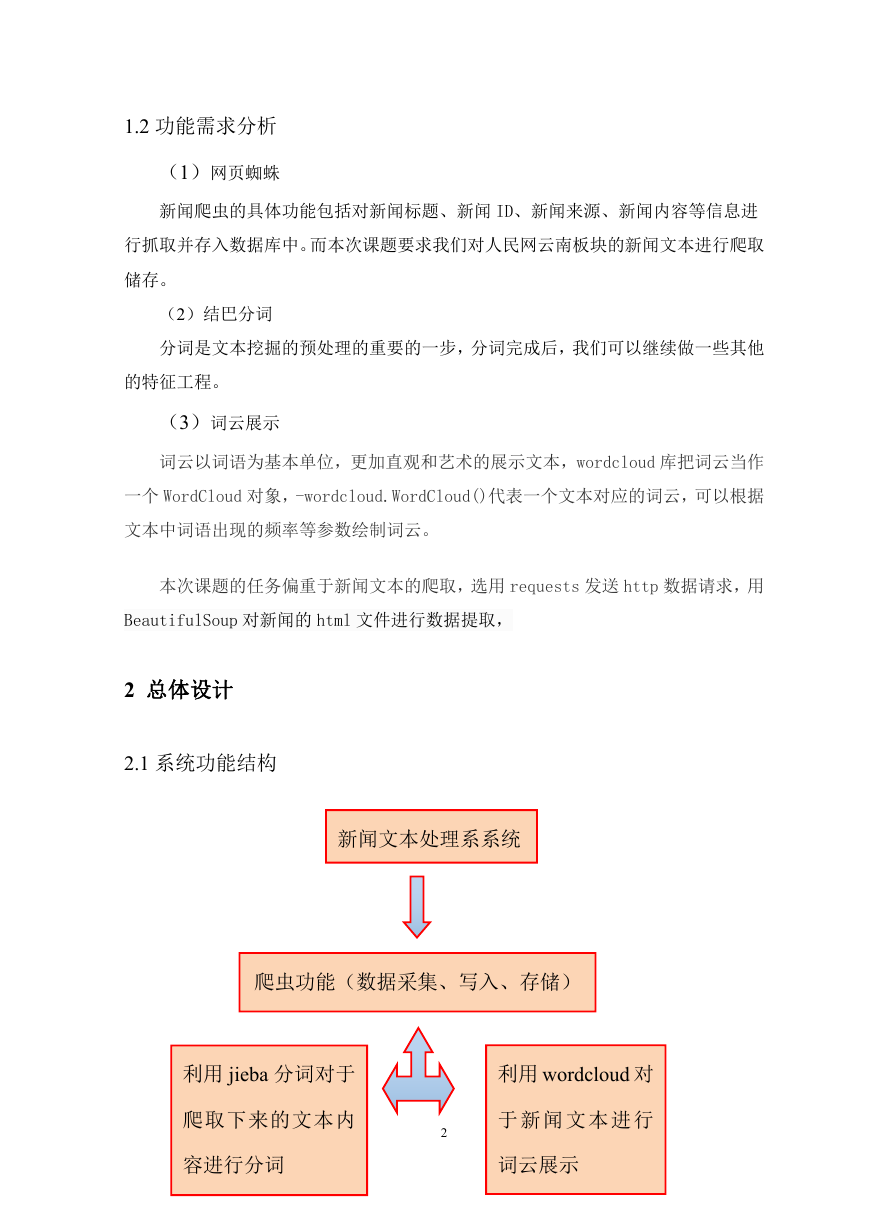

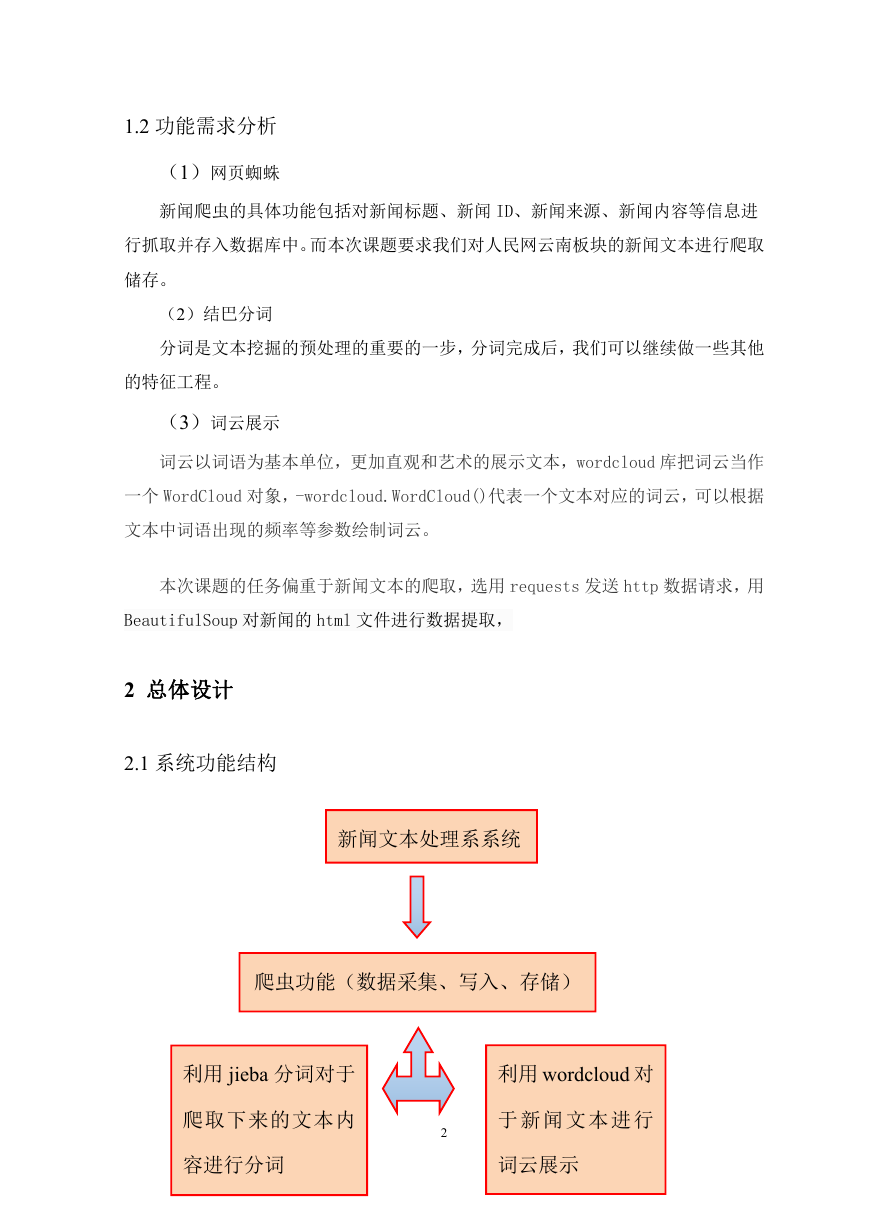

2.1 系统功能结构

新闻文本处理系系统

爬虫功能(数据采集、写入、存储)

利用 jieba 分词对于

爬取下来的文本内

利用 wordcloud 对

于 新 闻 文 本 进 行

2

容进行分词

词云展示

�

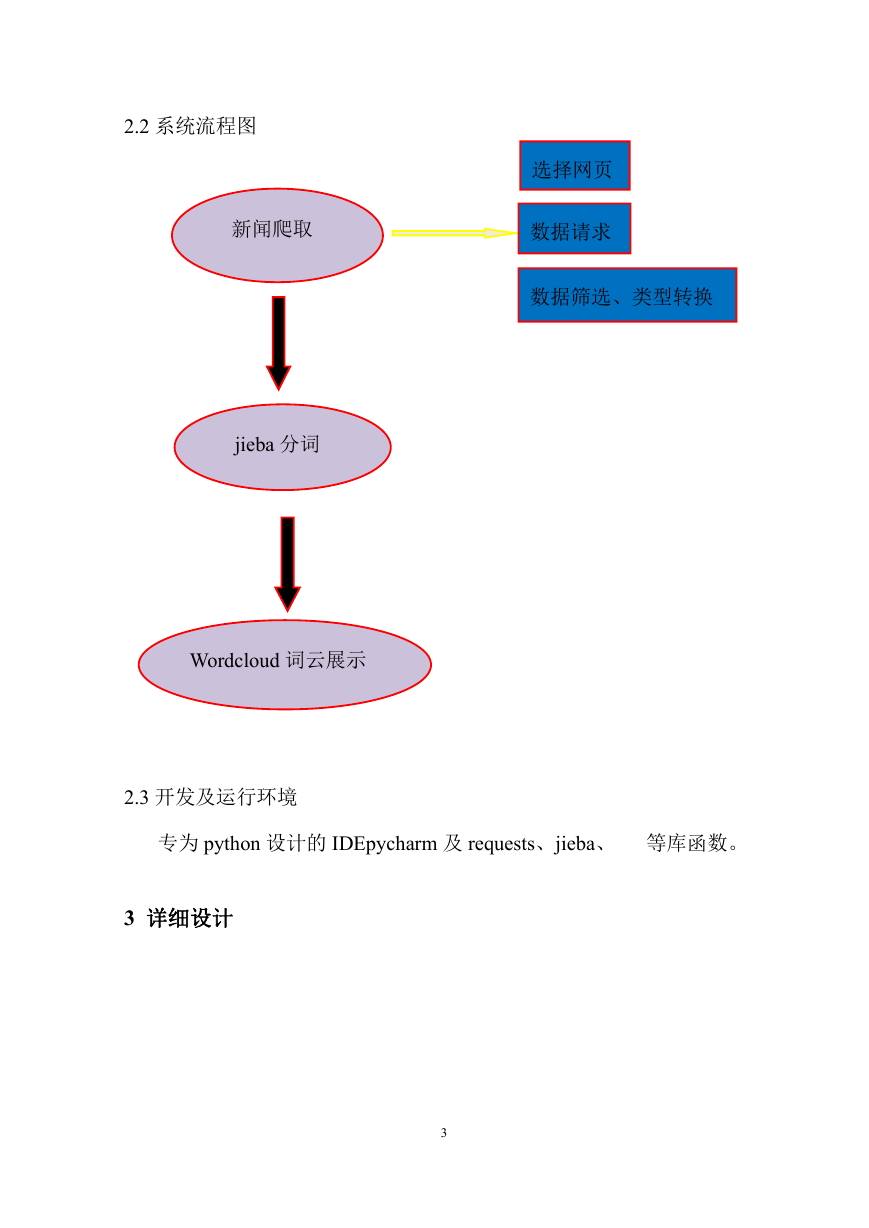

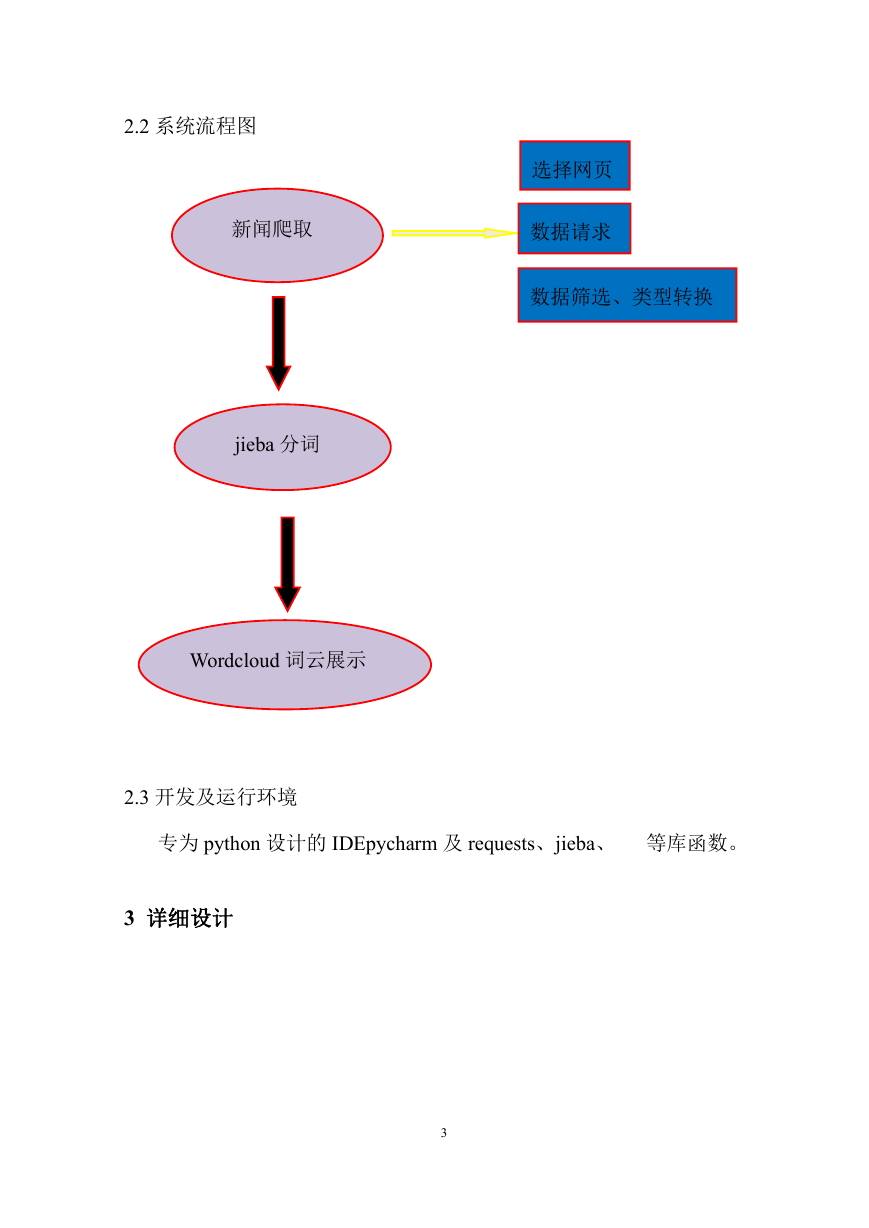

选择网页

数据请求

数据筛选、类型转换

2.2 系统流程图

新闻爬取

jieba 分词

Wordcloud 词云展示

2.3 开发及运行环境

专为 python 设计的 IDEpycharm 及 requests、jieba、 等库函数。

3 详细设计

3

�

4 代码实现

4.1 业务模型图

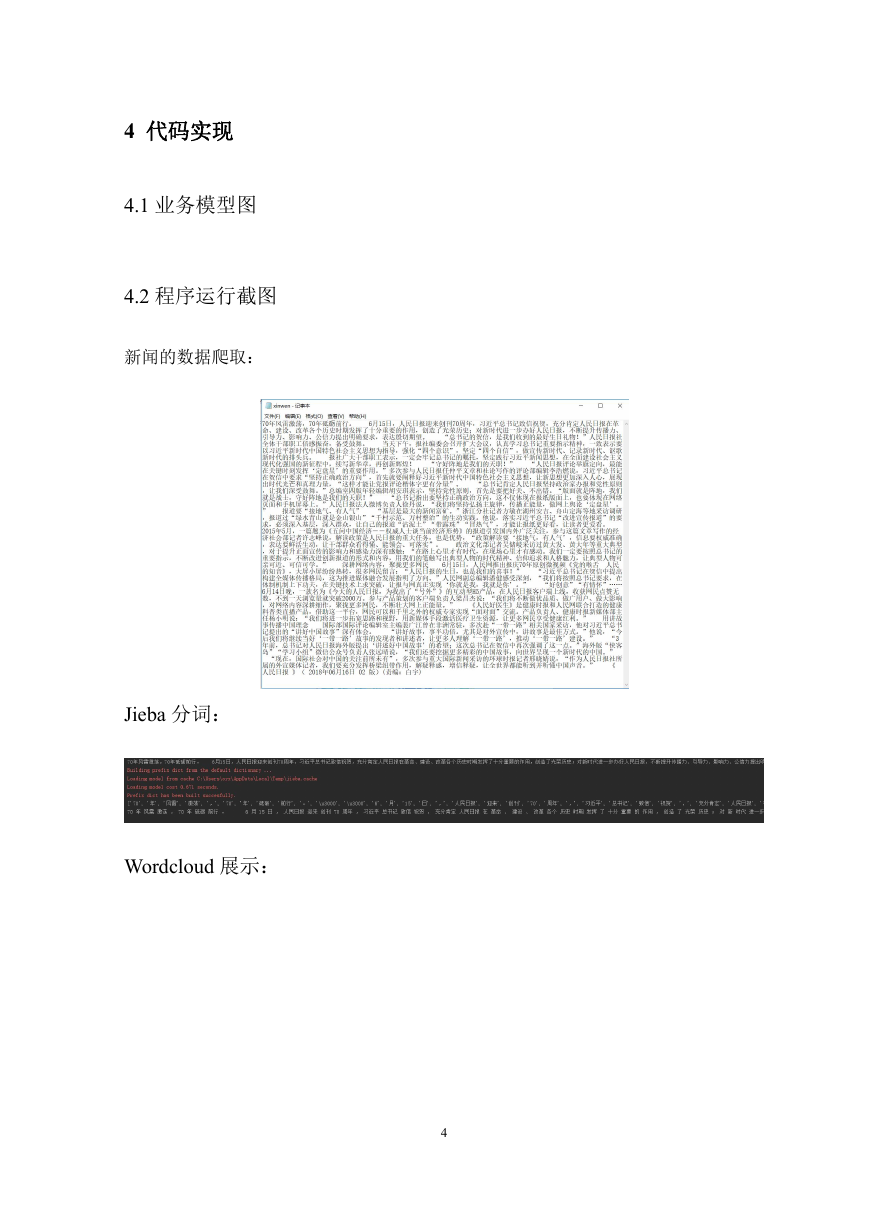

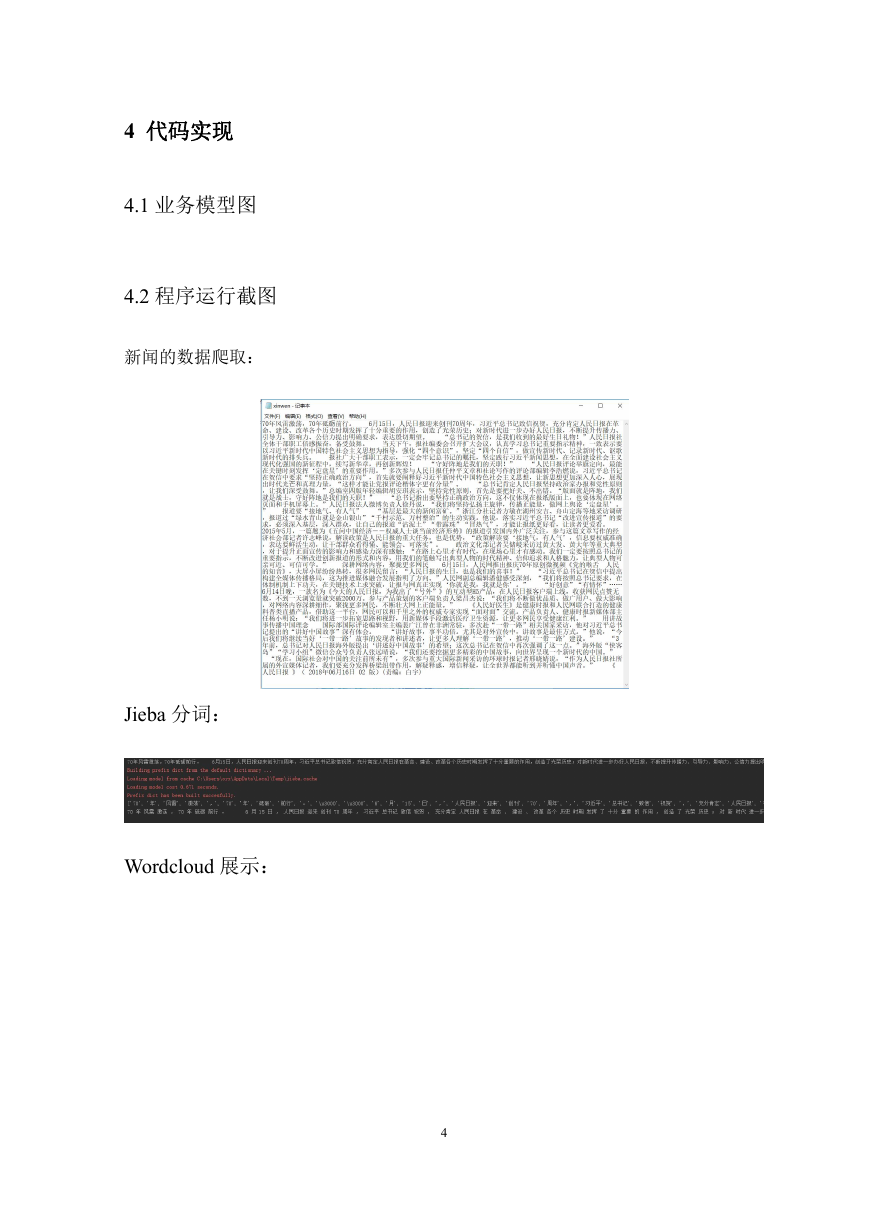

4.2 程序运行截图

新闻的数据爬取:

Jieba 分词:

Wordcloud 展示:

4

�

5 测试

6 总结

5

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc