心智与计算, Vol.4,No.2 (2010),139 - 147

文章编号:MC–2010 - 16

收稿日期:2010-04-01

出版日期:2010-06-30

© 2007 MC– 厦门大学信息与技术学院

心智与计算

139

基于说话人的音频分割与聚类

李稀敏,洪青阳,黄晓丹

(厦门大学智能科学与技术系,福建 厦门 361005)

qyhong@xmu.edu.cn

摘要:说话人分割与聚类主要应用于两个方面的问题,一方面可以用于自动语音识别的说话人自适

应;另一方面可用于说话人检索和富文本转录。主要包括三个过程:有效语音检测、说话人分割以及说

话人聚类。本文主要就这三个方面展开叙述,全面地介绍了各类算法。

关键词:有效语音检测;说话人分割;说话人聚类

中图分类号:TP 391 文献标识码:A

Speaker Segment and Clustering

LI Xi-min, HONG Qing-yang, HUANG Xiao-dan

(Department of Cognitive Science, Xiamen University, Xiamen 361005, China)

qyhong@xmu.edu.cn

Abstract: In the literature one can normally find two main applications for speaker diarization. On one

hand, Automatic Speech Recognition (ASR) systems make use of the speaker homogeneous clusters to adapt

the acoustic models to be speaker dependent and therefore increase recognition performance. On the other hand,

speaker indexing and rich transcription systems use the speaker diarization output as one of (possibly) many

information pieces extracted from a recording, which allow its automatic indexation and other further

processing areas. It mainly contains three processes, which are speech activity detection, speaker segment, and

speaker clustering. This work reviews kinds of algorithms in the three aspects.

Key words: speech activity detection;speaker segment;speaker clustering

1 引 言

随着 IT 技术的发展,各类音频文档的获取途径越来越丰富,数据量呈爆炸式增长,从而对音频文

档的管理也越来越困难。近年来,人们开始研究音频检索技术①,对电话语音、广播语音以及会议语音

等多媒体语音文档进行管理。其中,对会议语音的检索难度最大,因为会议语音文档中包含有多个信道、

更多的说话人。基于说话人的音频分割与聚类,就是将一段有多个人在说话的语音分割成多个片段,并

① 音频检索技术,狭义上讲是结合基于内容和基于说话人的查询、检索已知的说话人和词语的技术。

�

140

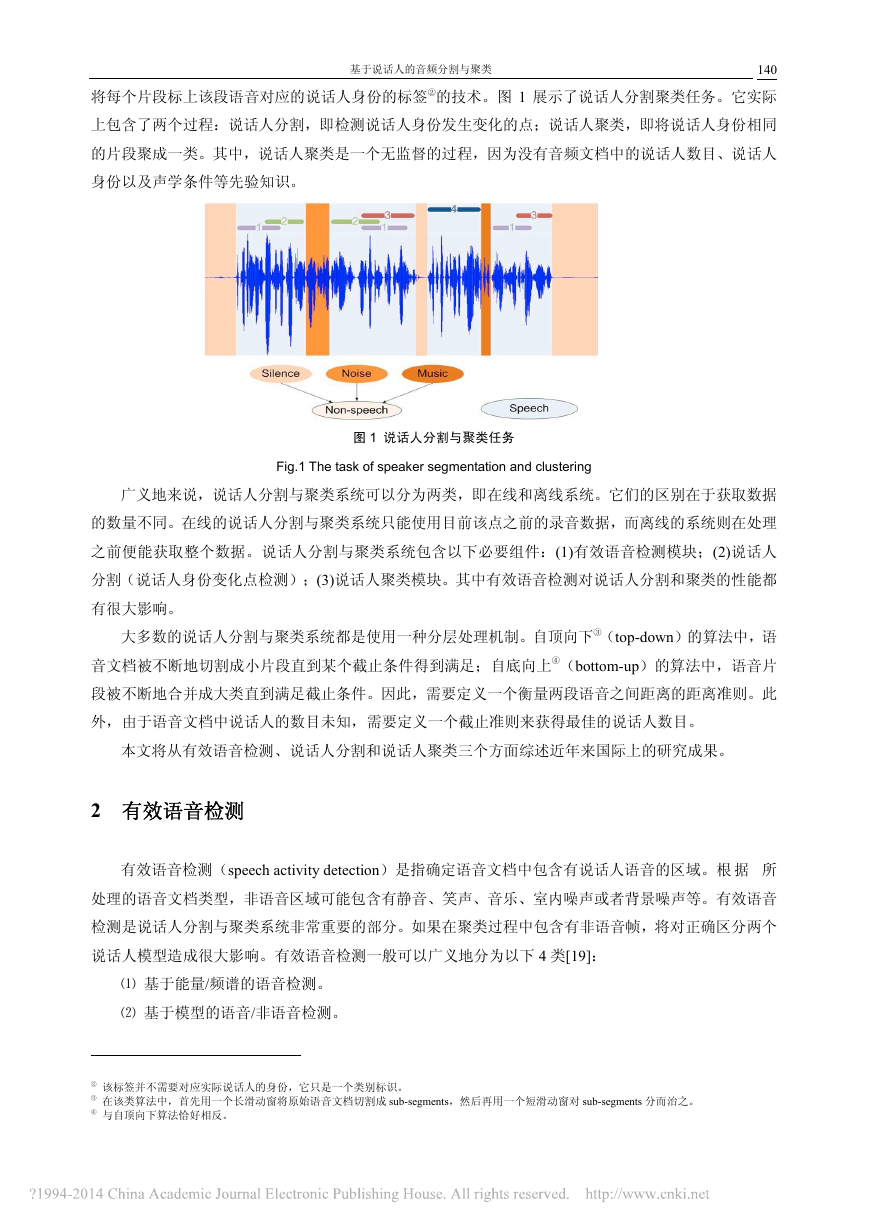

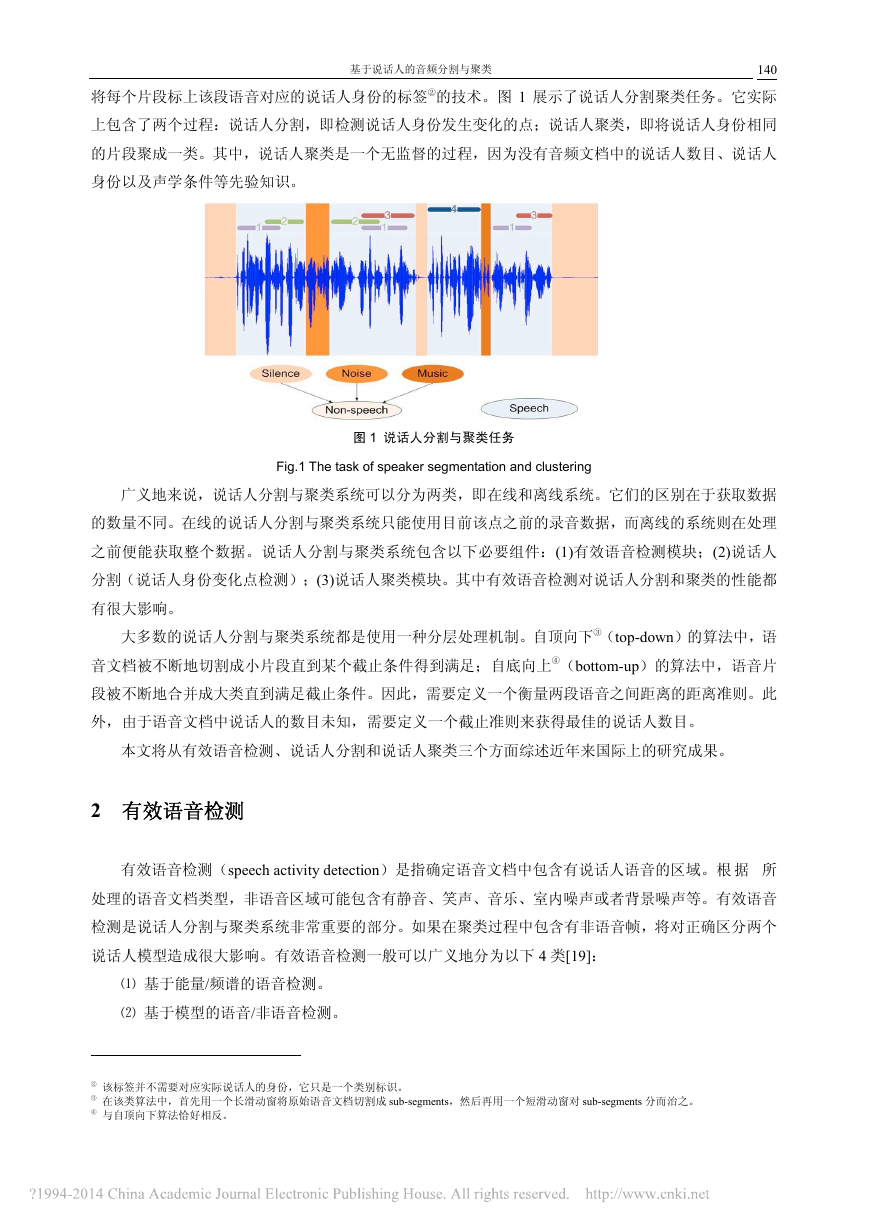

将每个片段标上该段语音对应的说话人身份的标签②的技术。图 1 展示了说话人分割聚类任务。它实际

基于说话人的音频分割与聚类

上包含了两个过程:说话人分割,即检测说话人身份发生变化的点;说话人聚类,即将说话人身份相同

的片段聚成一类。其中,说话人聚类是一个无监督的过程,因为没有音频文档中的说话人数目、说话人

身份以及声学条件等先验知识。

图 1 说话人分割与聚类任务

Fig.1 The task of speaker segmentation and clustering

广义地来说,说话人分割与聚类系统可以分为两类,即在线和离线系统。它们的区别在于获取数据

的数量不同。在线的说话人分割与聚类系统只能使用目前该点之前的录音数据,而离线的系统则在处理

之前便能获取整个数据。说话人分割与聚类系统包含以下必要组件:(1)有效语音检测模块;(2)说话人

分割(说话人身份变化点检测);(3)说话人聚类模块。其中有效语音检测对说话人分割和聚类的性能都

有很大影响。

大多数的说话人分割与聚类系统都是使用一种分层处理机制。自顶向下③(top-down)的算法中,语

音文档被不断地切割成小片段直到某个截止条件得到满足;自底向上④(bottom-up)的算法中,语音片

段被不断地合并成大类直到满足截止条件。因此,需要定义一个衡量两段语音之间距离的距离准则。此

外,由于语音文档中说话人的数目未知,需要定义一个截止准则来获得最佳的说话人数目。

本文将从有效语音检测、说话人分割和说话人聚类三个方面综述近年来国际上的研究成果。

2 有效语音检测

有效语音检测(speech activity detection)是指确定语音文档中包含有说话人语音的区域。根 据 所

处理的语音文档类型,非语音区域可能包含有静音、笑声、音乐、室内噪声或者背景噪声等。有效语音

检测是说话人分割与聚类系统非常重要的部分。如果在聚类过程中包含有非语音帧,将对正确区分两个

说话人模型造成很大影响。有效语音检测一般可以广义地分为以下 4 类[19]:

⑴ 基于能量/频谱的语音检测。

⑵ 基于模型的语音/非语音检测。

② 该标签并不需要对应实际说话人的身份,它只是一个类别标识。

③ 在该类算法中,首先用一个长滑动窗将原始语音文档切割成 sub-segments,然后再用一个短滑动窗对 sub-segments 分而治之。

④ 与自顶向下算法恰好相反。

�

基于说话人的音频分割与聚类

141

⑶ 混合语音/非语音检测。

⑷ 多信道有效语音检测。

基于能量的语音检测通常用于电话语音的有效语音检测,因为在电话语音中,非语音一般只包括静

由于基于能量的语音检测方法的局限,基于模型的有效语音检测方法在许多语音分割与聚类系统中

音和缓变噪声。而在会议录音中,则有各种类型的噪声,比如翻动纸张的噪声、咳嗽、笑声等。

被采用,因为它能够刻画各种声学特征。

在 Wooters 等的系统中[1],只采用语音和非语音这两个模型。而在 Nguyen 等的复杂系统中[2]采用

了区别性别和信道带宽的 4 个模型。在文献[3]和[4]中,Gauvain 和 Zhu 则对噪声和音乐建模,在他们的

系统中,音频文件由 5 部分组成,即语音、音乐、噪声、语音叠加音乐、语音叠加噪声。文献[5]将语音

文档中的语音类型划分得更细。

基于模型的方法也有它的局限之处,即需要用已标注的数据集来训练语音/非语音模型。而且训练集

和测试集数据之间的不匹配会严重系统的泛化性能。

为了解决上述这些问题,引入了混合语音/非语音检测方法。该方法由两步组成:第一步,进行简单

地基于能量的检测;第二步,基于模型的检测,该模型由测试数据本身训练而成,因而不需要额外的训

练数据。在文献[6,7]中,Anguera 首次使用衍生滤波器和有限状态机(Finite State Machine, FSM)来检测语

音和非语音区域。

近年来,随着多信道音频文档的增加,出现了一些针对多信道有效语音检测的方法。在文献[8]中,

Wrigley 将多信道语音划分成 4 个子类:本信道语音、交叉谈话语音、本信道和交叉谈话语音以及非语

音。他们着眼于帧层次上的分类精度,并选择各种语音特征加以分析。他们的实验结果发现,在所分析

过的 20 种语音特征中,来自交叉信道关联(Cross-channel Correlation)的特征效果最佳。在文献[9]中,

Laskowski 提出了一种基于信道交叉作用(Crosscorrelation-based)的方法来处理多说话人有效语音检测

任务。

3 说话人分割算法

说话人分割(Speaker Segment)通常是指说话人改变点检测,即定位语音文档中说话人身份发生改

变的点。一般的做法是,观测并计算相邻语音窗之间的距离⑤,然后基于阈值或惩罚因子来决定这两段

语音是否来自于同一个说话人。而这个阈值或惩罚因子是通过额外的训练集数据凭经验获得。很多文献

提出了各种说话人分割算法,其主要区别就是使用不同的距离准则和阈值决策方法。

在文献[10]中,Siegler 将每个语音窗表示为一个高斯分布,并用 KL2 距离准则来计算相邻语音窗之

间的距离。这样做需要估计音频流中每一段加窗语音的均值和方差。当当前相邻窗之间的距离达到一个

局部极大值时,便获得一个新的分割点。

随后,Chen 和 Gopalakrishman[11]将说话人分割问题归纳为一个模型选择问题,并引入贝叶斯信息

准则(Bayes Information Criteria, BIC)来解决问题。该方法判断相邻窗内的两段语音是否可以用同一个

⑤ 距离准则(Distance Metrics)用来衡量两个语音特征向量之间的差距, 比如 GLR, KL2 等。

�

基于说话人的音频分割与聚类

142

分布来表示,如果可以,则说明这两段语音来自于同一个说话人,语音窗向前移动并继续搜索改变点;

否则,存在改变点,语音窗以改变点为起点并重新搜索。在该论文中,作者引入了一个可调参数,调节

这个参数以获得更好的效果。而在另一篇文献[12]中,Ajmera 提出了一种新的方法,该方法通过调整模

型独立参数的数目代替上述的可调节参数,使得 BIC 方法对未知数据的泛化性能更好。

在文献[11]中,Chen 和 Gopalakrishman 的研究发现,BIC 值随着语音窗长的增加而增大。实际上当

相邻窗之间的窗长不匹配时确实存在问题。因此,Perez-Freire[13]引入了一个依赖于窗长的惩罚权重来

获得更好的鲁棒性。在文献[14]中,Vandecatseyes 对 BIC 的值进行归一化,结果表明效果总是比未归一

化的方法要好。使用 BIC 准则的系统存在以下一些问题:(1)当语音文档中说话人身份变化很快时(2~5s),

会出现高漏报率。因此,将 BIC 准则应用于快速交谈的语音对话场合时,会存在很大问题。(2)计算量

很大(N2

复杂度)。

下面介绍各类常用的距离准则(Distance Metrics)。

3.1 对称 Kullback-Leibler 距离(KL2)

Kullback-Leibler(KL)散度⑥用来衡量两个随机分布 A 和 B 之间的距离。 A 和 B 的 KL 散度表示用基

于 B (不是 A )的最优编码规则来编码 A 时所需的额外比特位。

KL A B

||

(

)

= ∫

∞

−∞

p

A

( )

x

p

log A

p

B

( )

x

( )

x

dx

其中 Ap 和 Bp 分别表示 A 和 B 的概率密度函数。

KL2 是 KL 的一个对称形式,定义如下:

(

KL A B

KL A B

=

2

||

(

)

,

)

+

KL B A

||

(

)

当 A 和 B 都服从高斯分布时,可以获得如下闭式表达式[18]:

A

−

=

)

C

)(

(

(

tr C

1

2

Bμ 分别表示 Ap 和 Bp 的协方差矩阵和均值。

Aμ ,

(

(

tr C

1

−+

C

B

+

)(

1

2

1

−

B

1

−

A

1

−

A

)

)

C

C

−

B

BC ,

其中 AC ,

在文献[21]中,Lu 和 Zhang 使用 KL2 来衡量两个相邻语音窗之间的相似度。

T

)

)

(1)

(2)

(3)

KL

2

(

A B

,

μ μ μ μ

B

−

−

A

B

A

)(

3.2 分歧形状距离(Divergence Shape Distance, DSD)

等式(3)有两部分组成,后者包含了向量均值 Aμ ,

Bμ 。由于向量均值会随录音环境的变化而改变,

鲁棒性差,而分歧形状距离(DSD)就是将这一部分去掉所获得的新的距离准则。其表达式如下:

DSD A B

,

(

)

=

1

2

(

(

tr C

1

−

A

1

−+

C

B

)(

μ μ μ μ

B

−

−

A

B

A

)(

T

)

)

(4)

在文献[19]中,Lie Lu 使用分歧形状距离(DSD)计算 LPC,MFCC 以及 LSP 等语音特征的距离,实

现一个实时系统,获得很好的效果。

⑥ 也称信息增益,相对熵或信息散度

�

基于说话人的音频分割与聚类

143

3.3 广义似然比(General Likelihood Ratio, GLR)

给定两段语音数据 1X 和 2X ,考虑如下两个假设检验:

⑴

0H :

1X 和 2X 来自于同一个说话人

1H :

1X 和 2X 来自于不同的说话人

⑵

假设说话人 K 的特征参数矢量的分布所对应的概率密度函数为 (

M β , kβ 为其参数集。则

)ij

⑴ 在假设下 0H :

X

i

∪

X M β

ij

~

j

(

)

⑵ 在假设下 1H :

GLR 定义为:

)

X M β

~i

(

i

)

X M β

~j

(

j

R

=

(

L X

(

(

L X M

|

i

(

)

∪

X M

|

β

j

i

ij

(

)

)

•

β

L X M

i

|

j

)

(

)

)

β

j

(5)

其中 (

)

L X M 表示已知模型 M 数据集 X 的似然率。GLR 与标准的似然率(Likelihood Ratio, LLR)

|

的区别在于前者没有给定数据集的分布,需要对数据的分布进行估计⑦。参数估计出来后,即可计算 GLR

距离:

GLRd

= −

log

R

(6)

3.4 贝叶斯信息准则(Bayes Information Criteria, BIC)

贝叶斯信息准则是 Schwarz 提出的模型选择方法[15],它从多个的具有不同参数数目的模型中选择

最佳参数的模型。模型 M 的 BIC 值定义为

BIC

M

=

log

(

p X M

|

)

−

(

#

λ

)

M

2

log

N

(7)

其中 (

p X M 表示给定模型 M 的条件下,观测数据 X 的可能性, (

# M 表示模型 M 自由参数的

)

)

|

数目, N 表示 X 中观测数据的数目,λ是一个可调参数,其值取决于开发集数据。

考虑 GLR 中相同的假设,在假设 0H 下,有

)

)

(

L X

BIC

log

∪

X

M

(

=

H

|

i

j

0

(

Mλβ

ij

#

−

(

β

ij

)

)

log

N

(8)

1

2

同理,在假设 1H 下,有

⑦ 通常使用 Expectation-Maximization(EM)算法进行估计。

�

BIC

iM

β

(

)

=

log

log

N

|

基于说话人的音频分割与聚类

(

(

1

λβ

2

1

λβ

2

(

#

(

)

)

)

)

(

(

(

L X M

(

L X M

M

M

#

−

−

|

i

j

i

j

β

j

β

i

)

)

)

)

log

N

BIC

(

jM

β

)

=

log

BIC 距离定义如下:

144

(9)

(10)

(11)

(12)

(13)

d

BIC

=

BIC

−

BIC

H

0

H

1

上面的公式可以重写如下:

d

BIC

=

d

GLR

−

⎛

λ

⎜

⎜

⎝

M

#

⎛

⎜

⎝

)

(

β

i

⎞

⎟

⎠

+

#

M

⎛

⎜

⎝

(

β

j

)

⎞

⎟

⎠

−

#

M

⎛

⎜

⎝

(

β

ij

)

⎞

⎟

⎠

⎞

⎟

⎟

⎠

log

(

N

)

=

GLRd

−

(

λ

M

Δ

ij

)

log

(

N

)

1

2

1

2

其中 ijMΔ 表示模型假设 0H 和 1H 之间参数数目之差。从该公式可以看出,BIC 距离是一种惩罚补

偿的 GLR 距离。特别地,当

ijMΔ

= ,即模型假设 0H 和 1H 之间参数数目相等时,BIC 距 离 就 等

0

于 GLR 距离。

在文献[22]中,Jin 等人提出了一个基于 GLR 距离和 BIC 截止准则的聚类机制。

3.5 交叉释然比(Cross Likelihood Ratio, CLR)

在文献[23]中,Reynolds 首次使用交叉释然比估计来计算两个自适应的说话人模型之间的距离。定

义如下:

d

CLR

=

1

N

i

log

⎛

⎜

⎝

L X M

(

L X M

(

|

|

i

i

(

))

β

i

))

(

β

U

j

L X M

(

L X M

(

|

|

j

(

β

j

(

β

U

))

))

⎞

⎟

⎟

⎠

(14)

+

⎞

⎟

⎠

log

1

N

⎛

⎜

⎜

⎝

)iM β 和 (

j

其中 (

)UM β 表示通用背景模型(UBM), (

)jM β 分别表示说话人i 和 j 的自适应模型。

3.6 归一化的交叉释然比(Normalized Cross Likelihood Ratio, NCLR)

在文献[24]中,Reynolds 对 CLR 进行了修改,在说话人识别系统中用于选择背景模型。定义如下:

d

CLR

=

1

N

i

log

⎛

⎜

⎜

⎝

L X M

(

L X M

(

|

|

i

i

(

))

β

i

))

(

β

j

⎞

⎟

⎟

⎠

+

1

N

j

log

⎛

⎜

⎜

⎝

j

L X M

(

L X M

(

|

|

j

(

))

β

j

(

))

β

i

⎞

⎟

⎟

⎠

(15)

在文献[25]中,Nguyen Trung Hieu 提出 dT 距离,能有效地将说话人自身(Intra-speaker)以及不同说话

人(Inter-speaker)之间的距离区分开。实验表明,CLR、GLR 以及 NCLR 在衡量说话人之间的距离时,对

于说话人自身的特征变化和不同说话人的特征差别,不能很好的区分开,这两者之间存在不同程度的混

叠。

�

4 说话人聚类算法

基于说话人的音频分割与聚类

145

说话人聚类(Speaker Clustering)在说话人分割的基础上,将属于同一个说话人的语音片段

(Segments)合并起来,而说话人的数目未知。

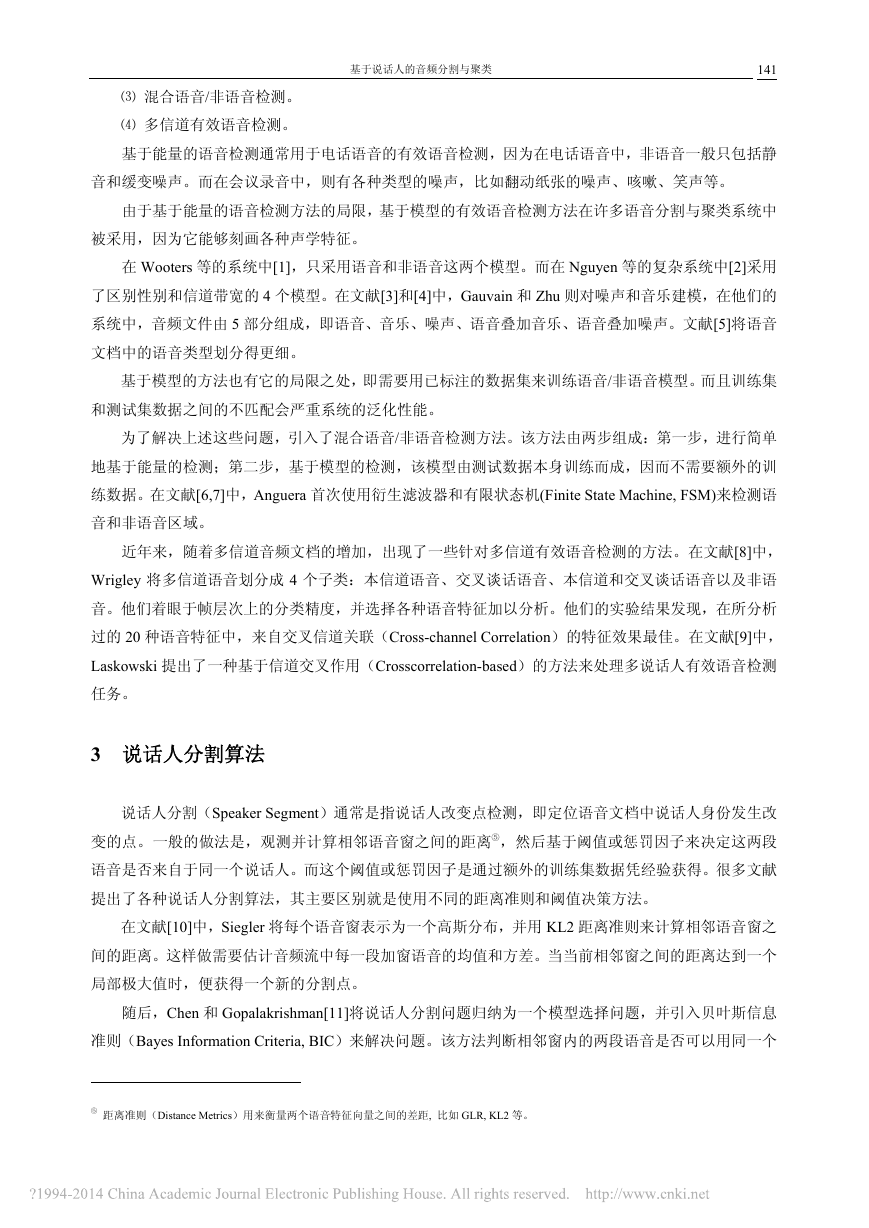

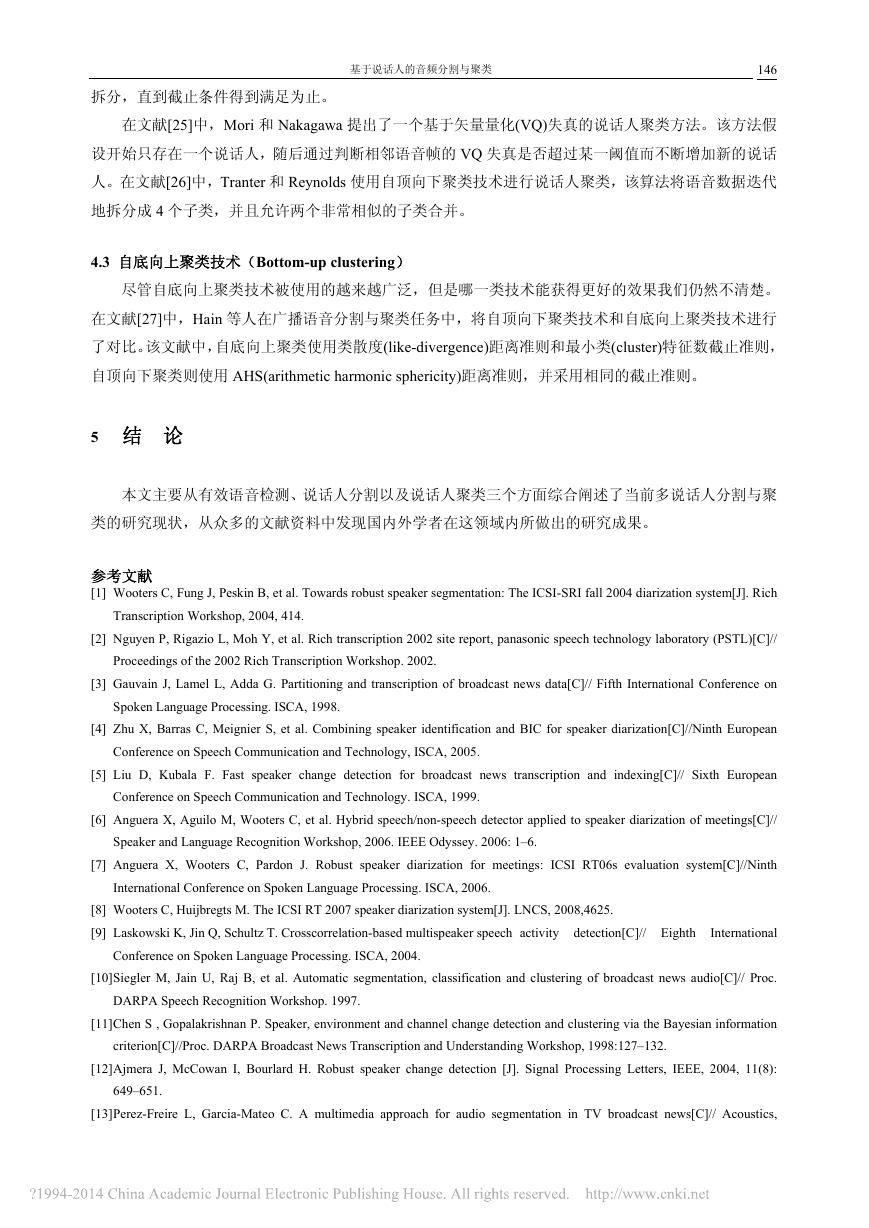

说话人聚类算法一般可分为两类:自顶向下聚类和自底向上聚类。如图 2 所示。两类算法都涉及到

距离准则和截止准则。距离准则用以衡量两段语音之间的相似度;截止准则用于聚类迭代过程何时截止。

图 2 自顶向下和自底向上聚类算法

Fig.2 Top-down and Bottom-up clustering

大多数离线系统都采用这种分层结构机制,其做法是将语音段或者语音类(Clusters)迭代地拆分或者

合并直到获得最佳的说话人数目为止。

4.1 自底向上聚类技术(Bottom-up clustering)

大多数说话人聚类系统都使用自底向上聚类技术(有时也称之为 Agglomerative Clustering)。自底向

上聚类技术在模式识别领域的应用已经非常广泛。

说话人聚类任务中最通用的距离准则是 BIC 准则。在文献[11]提出的自底向上算法中,将说话人分

割所得结果中的每个语音片段当成一类,然后根据 BIC 距离连续地合并最相邻的两类,直到语音片段的

合并不再导致 BIC 的值增加为止。在该文献中,作者引入了一个惩罚权重λ,调整这个λ不仅可以获得

更好的聚类效果,而且在对未知数据进行聚类时也必须调整λ已获得更好的泛化性能。

在文献[16]中,Siegler 引入对称 Kullback-Leibler(简称 KL2)距离准则来进行说话人自适应。KL2

准则用来衡量两个随机变量的概率密度函数(Probability Density Function, PDF)之间的距离,特别地,

当两个随机变量都服从高斯分布式(Gaussian Distribution, GD)时,KL2 具有闭式表达式⑧。在说话人聚

类任务中,KL2 距离较之马氏距离(Mahalanobis distance)效果更好。

在文献[17]中,Zhou and Hansen 使用 KL2 作为距离准则。在他们的工作中,首先使用 GMM 分类器

自动标注语音片段的性别,然后自底向上分别对男女片段进行聚类,并用 BIC 准则确定截止条件。

4.2 自顶向下聚类技术(Bottom-up clustering)

现在很少使用自顶向下技术来进行说话人聚类。在该技术中,从单个说话人模型开始,迭代地将其

⑧ 是指能用初等函数及其组合表达出来的单独式,不含积分符号、微分符号、方程组等。

�

基于说话人的音频分割与聚类

146

拆分,直到截止条件得到满足为止。

在文献[25]中,Mori 和 Nakagawa 提出了一个基于矢量量化(VQ)失真的说话人聚类方法。该方法假

设开始只存在一个说话人,随后通过判断相邻语音帧的 VQ 失真是否超过某一阈值而不断增加新的说话

人。在文献[26]中,Tranter 和 Reynolds 使用自顶向下聚类技术进行说话人聚类,该算法将语音数据迭代

地拆分成 4 个子类,并且允许两个非常相似的子类合并。

4.3 自底向上聚类技术(Bottom-up clustering)

尽管自底向上聚类技术被使用的越来越广泛,但是哪一类技术能获得更好的效果我们仍然不清楚。

在文献[27]中,Hain 等人在广播语音分割与聚类任务中,将自顶向下聚类技术和自底向上聚类技术进行

了对比。该文献中,自底向上聚类使用类散度(like-divergence)距离准则和最小类(cluster)特征数截止准则,

自顶向下聚类则使用 AHS(arithmetic harmonic sphericity)距离准则,并采用相同的截止准则。

5 结 论

本文主要从有效语音检测、说话人分割以及说话人聚类三个方面综合阐述了当前多说话人分割与聚

类的研究现状,从众多的文献资料中发现国内外学者在这领域内所做出的研究成果。

参考文献

[1] Wooters C, Fung J, Peskin B, et al. Towards robust speaker segmentation: The ICSI-SRI fall 2004 diarization system[J]. Rich

Transcription Workshop, 2004, 414.

[2] Nguyen P, Rigazio L, Moh Y, et al. Rich transcription 2002 site report, panasonic speech technology laboratory (PSTL)[C]//

Proceedings of the 2002 Rich Transcription Workshop. 2002.

[3] Gauvain J, Lamel L, Adda G. Partitioning and transcription of broadcast news data[C]// Fifth International Conference on

Spoken Language Processing. ISCA, 1998.

[4] Zhu X, Barras C, Meignier S, et al. Combining speaker identification and BIC for speaker diarization[C]//Ninth European

Conference on Speech Communication and Technology, ISCA, 2005.

[5] Liu D, Kubala F. Fast speaker change detection for broadcast news transcription and indexing[C]// Sixth European

Conference on Speech Communication and Technology. ISCA, 1999.

[6] Anguera X, Aguilo M, Wooters C, et al. Hybrid speech/non-speech detector applied to speaker diarization of meetings[C]//

Speaker and Language Recognition Workshop, 2006. IEEE Odyssey. 2006: 1–6.

[7] Anguera X, Wooters C, Pardon J. Robust speaker diarization for meetings: ICSI RT06s evaluation system[C]//Ninth

International Conference on Spoken Language Processing. ISCA, 2006.

[8] Wooters C, Huijbregts M. The ICSI RT 2007 speaker diarization system[J]. LNCS, 2008,4625.

[9] Laskowski K, Jin Q, Schultz T. Crosscorrelation-based multispeaker speech activity detection[C]// Eighth

International

Conference on Spoken Language Processing. ISCA, 2004.

[10] Siegler M, Jain U, Raj B, et al. Automatic segmentation, classification and clustering of broadcast news audio[C]// Proc.

DARPA Speech Recognition Workshop. 1997.

[11] Chen S , Gopalakrishnan P. Speaker, environment and channel change detection and clustering via the Bayesian information

criterion[C]//Proc. DARPA Broadcast News Transcription and Understanding Workshop, 1998:127–132.

[12] Ajmera J, McCowan I, Bourlard H. Robust speaker change detection [J]. Signal Processing Letters, IEEE, 2004, 11(8):

649–651.

[13] Perez-Freire L, Garcia-Mateo C. A multimedia approach for audio segmentation in TV broadcast news[C]// Acoustics,

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc