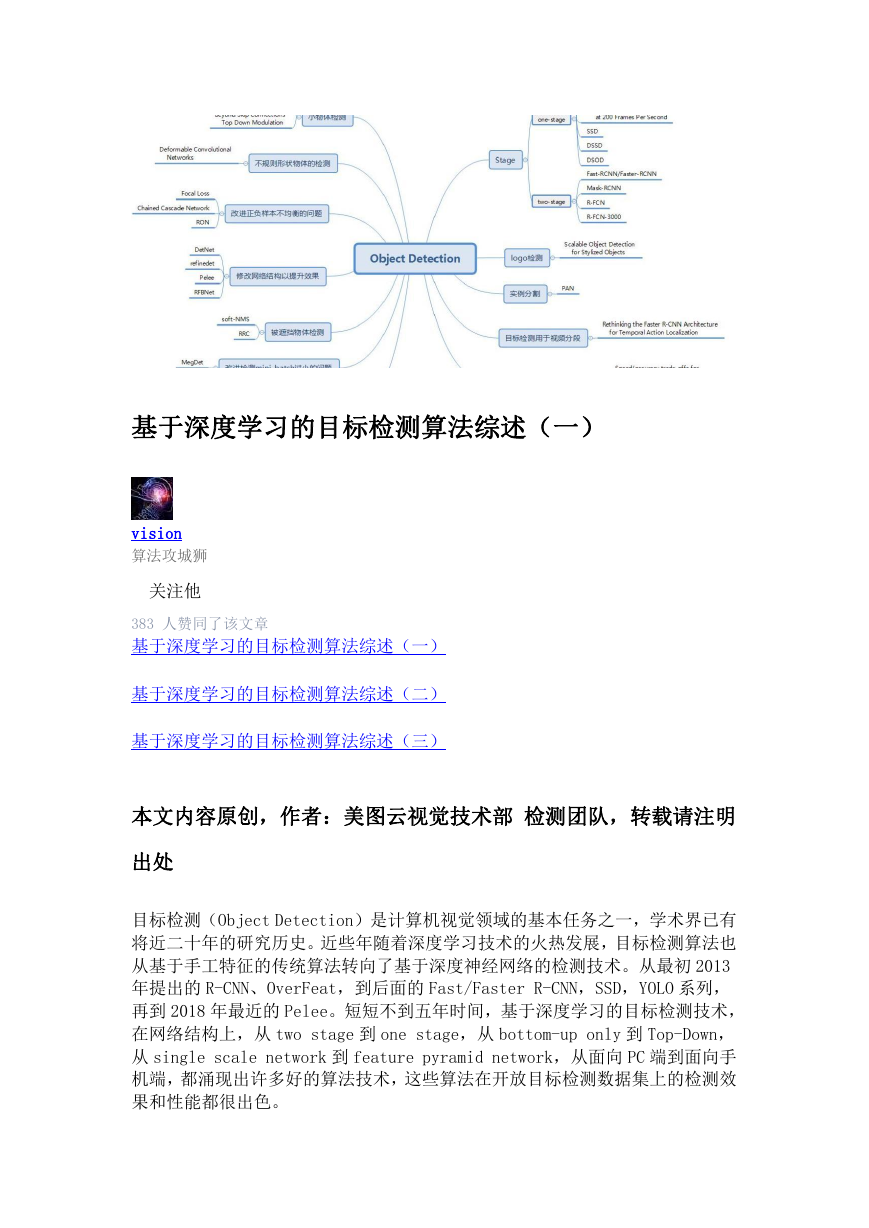

基于深度学习的目标检测算法综述(一)

本文内容原创,作者:美图云视觉技术部 检测团队,转载请注明出处

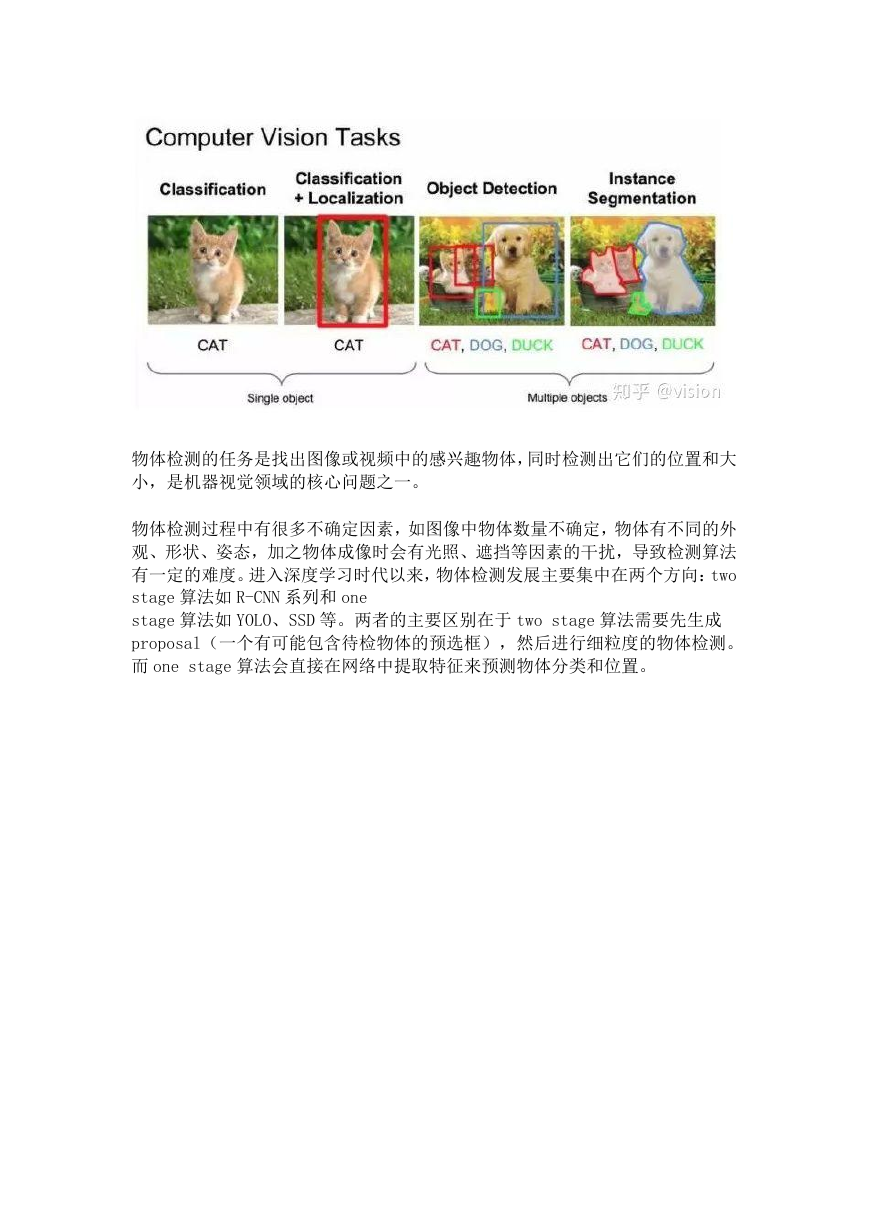

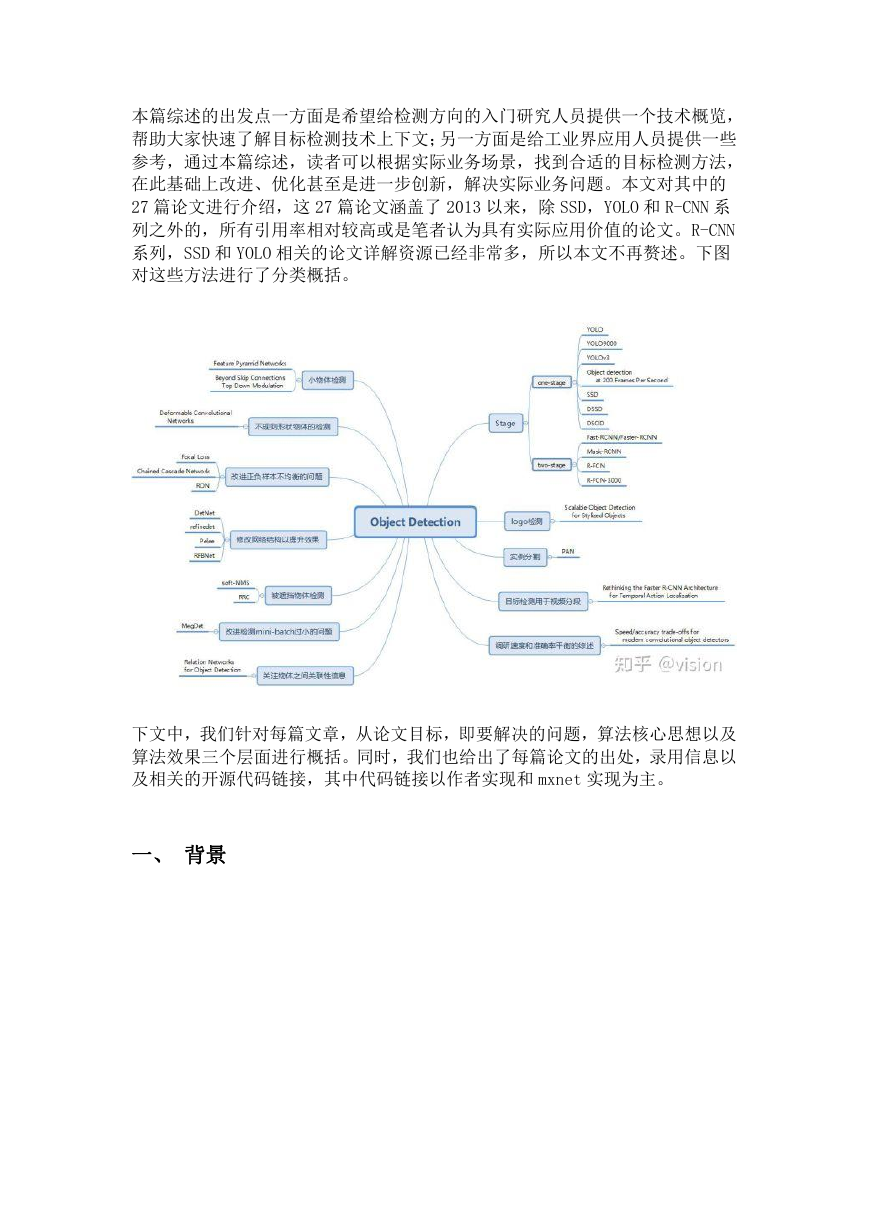

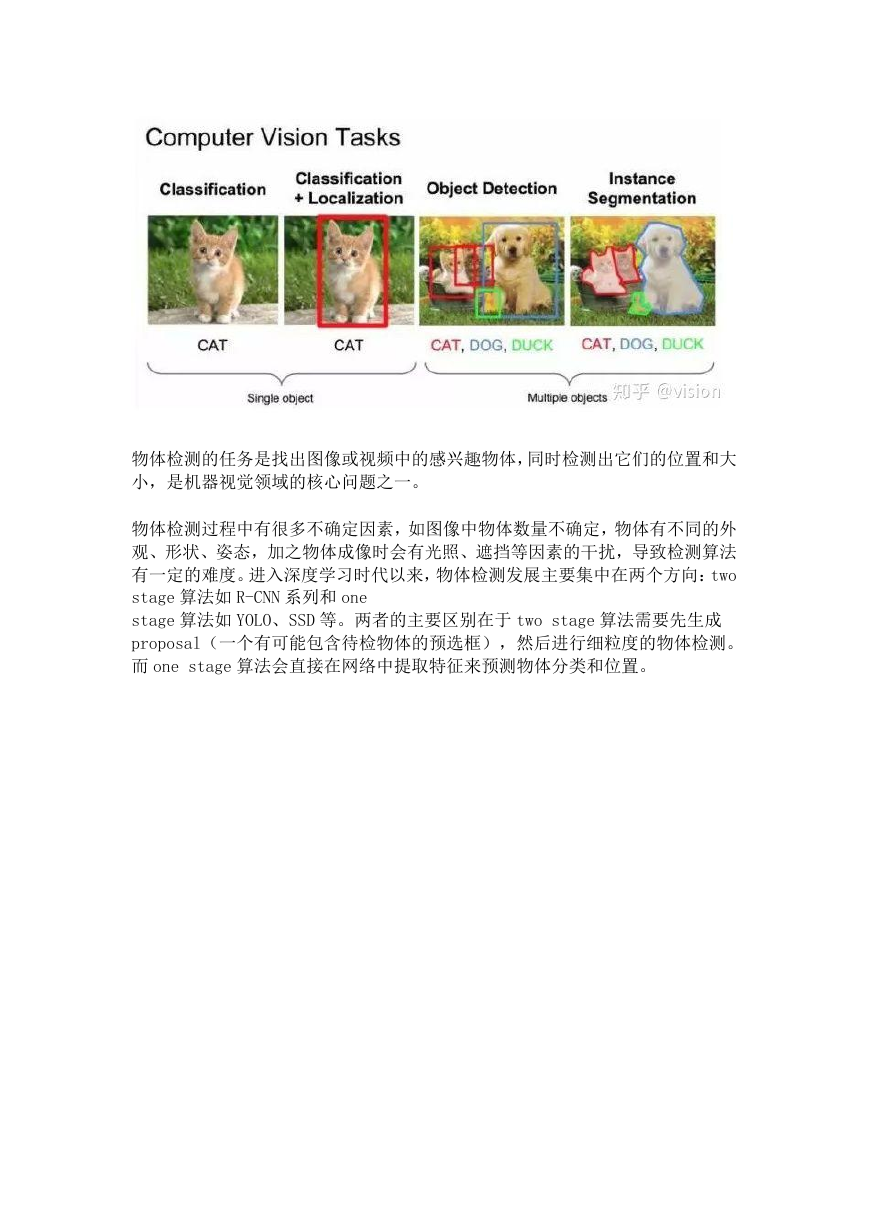

一、 背景

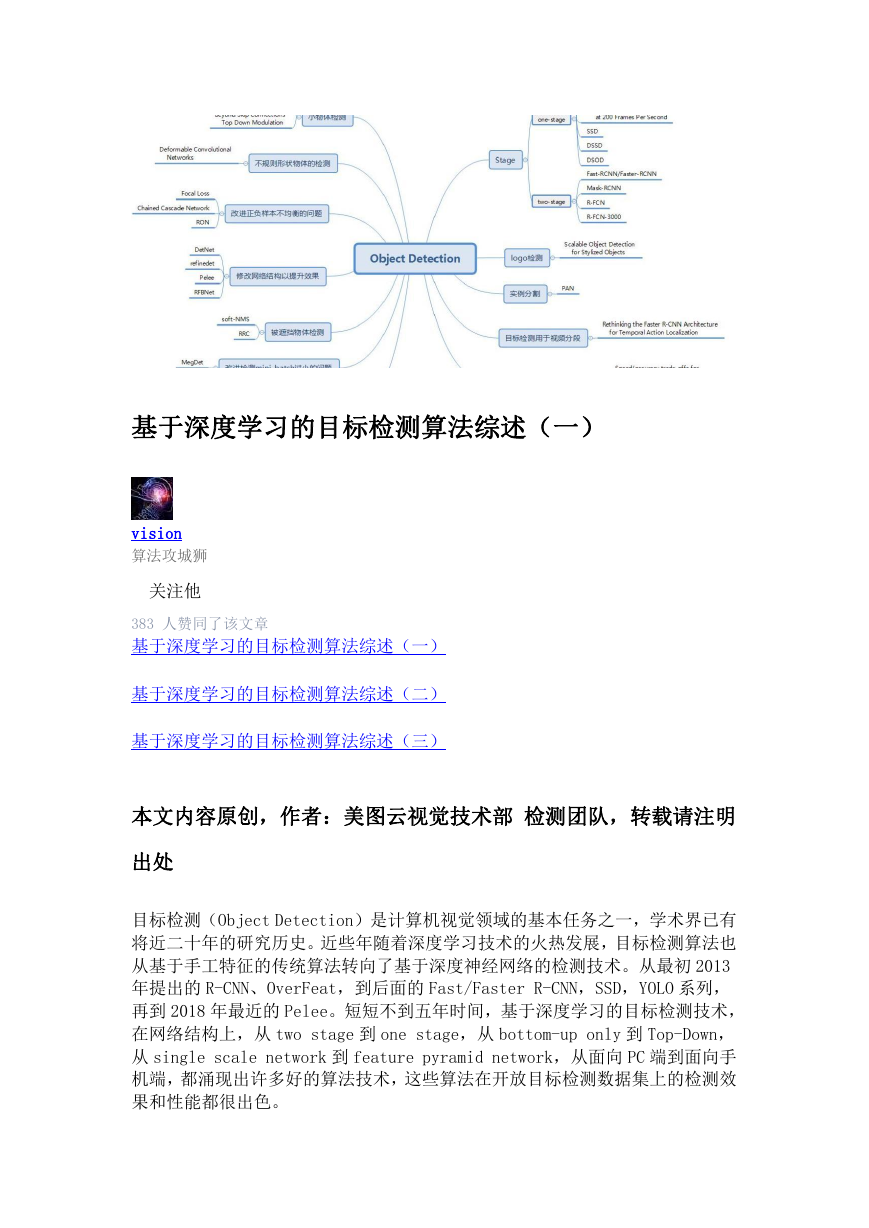

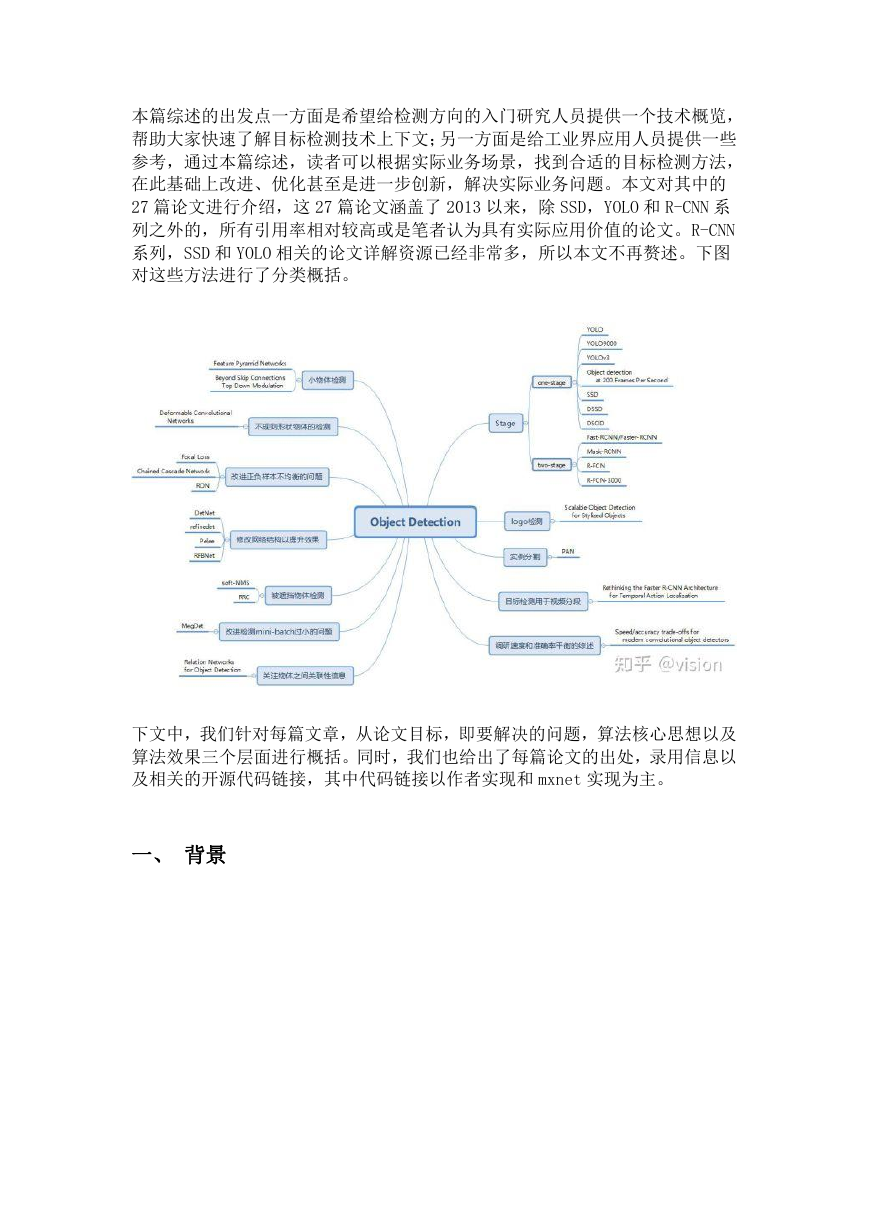

二、创新内容、改进方向

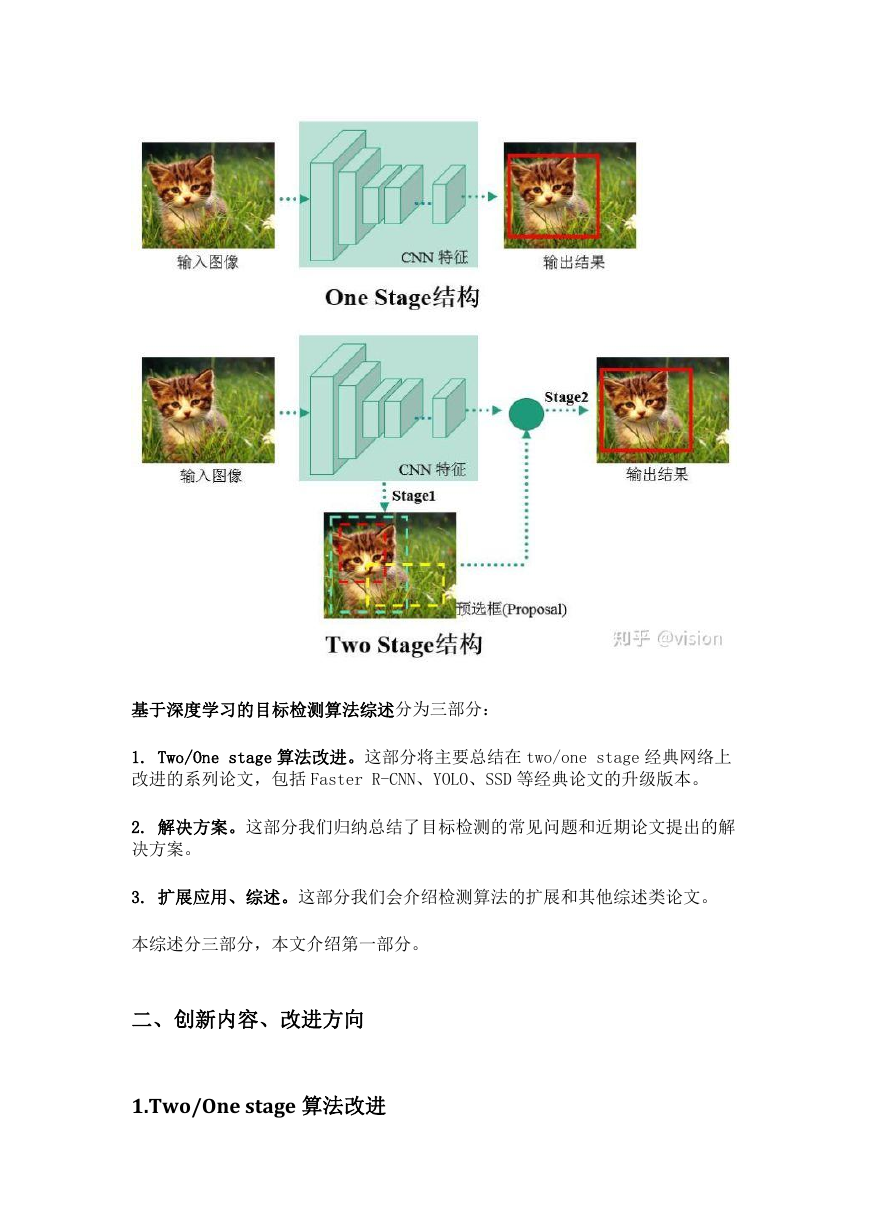

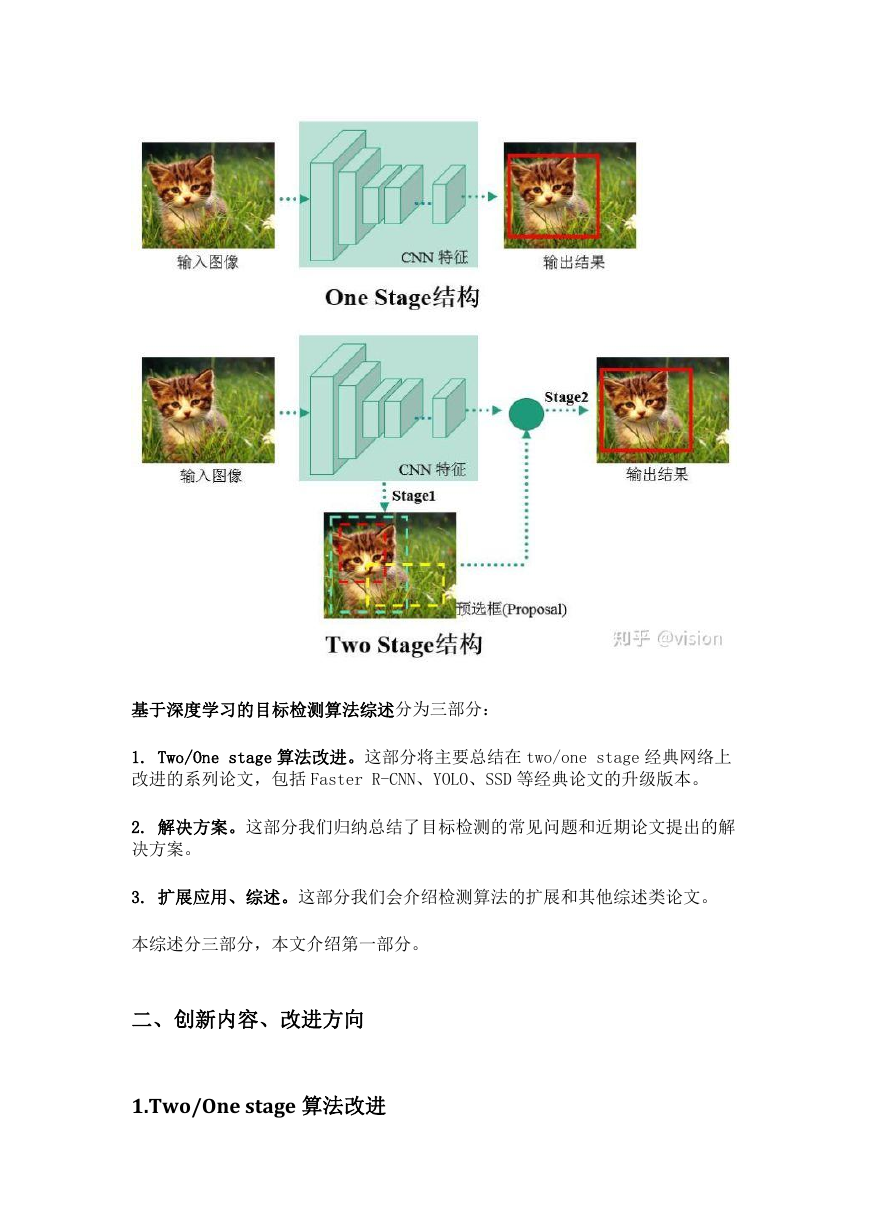

1.Two/One stage算法改进

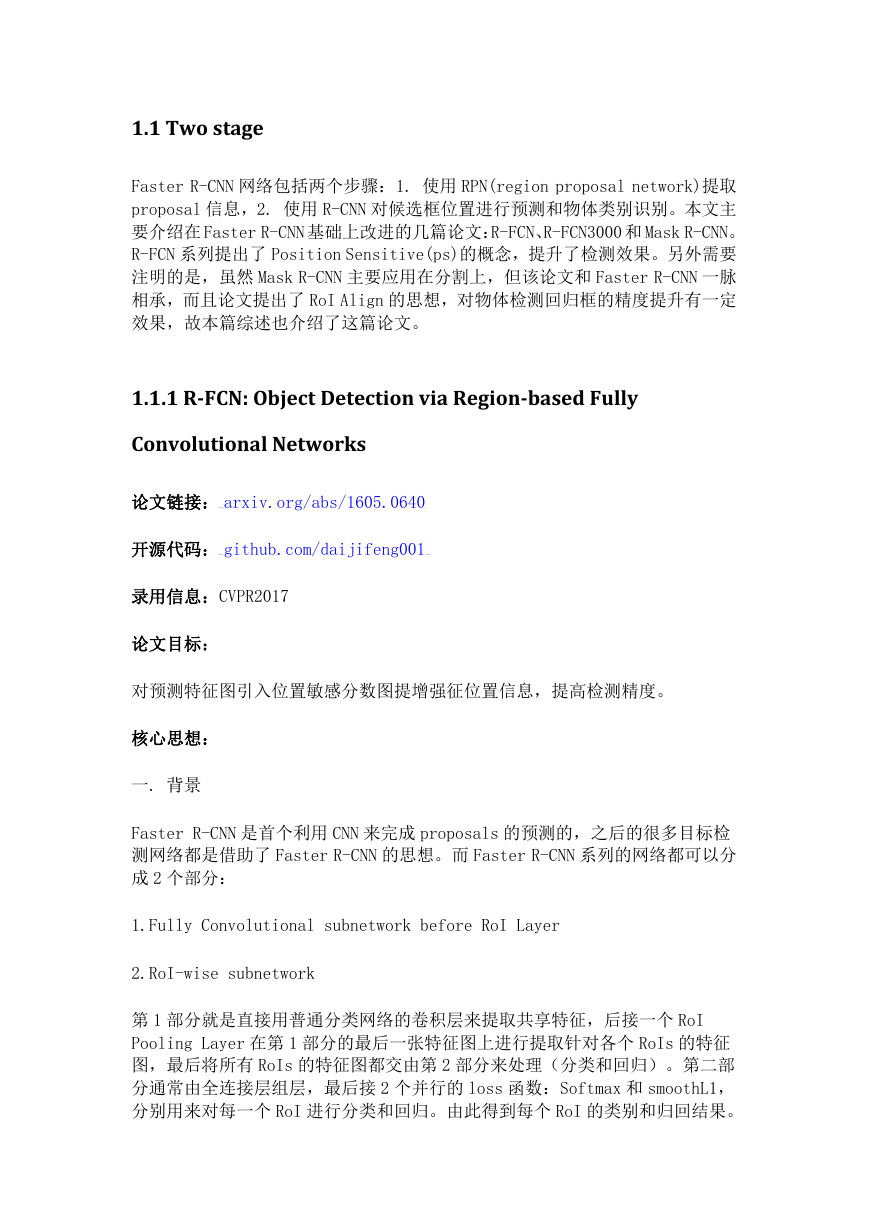

1.1 Two stage

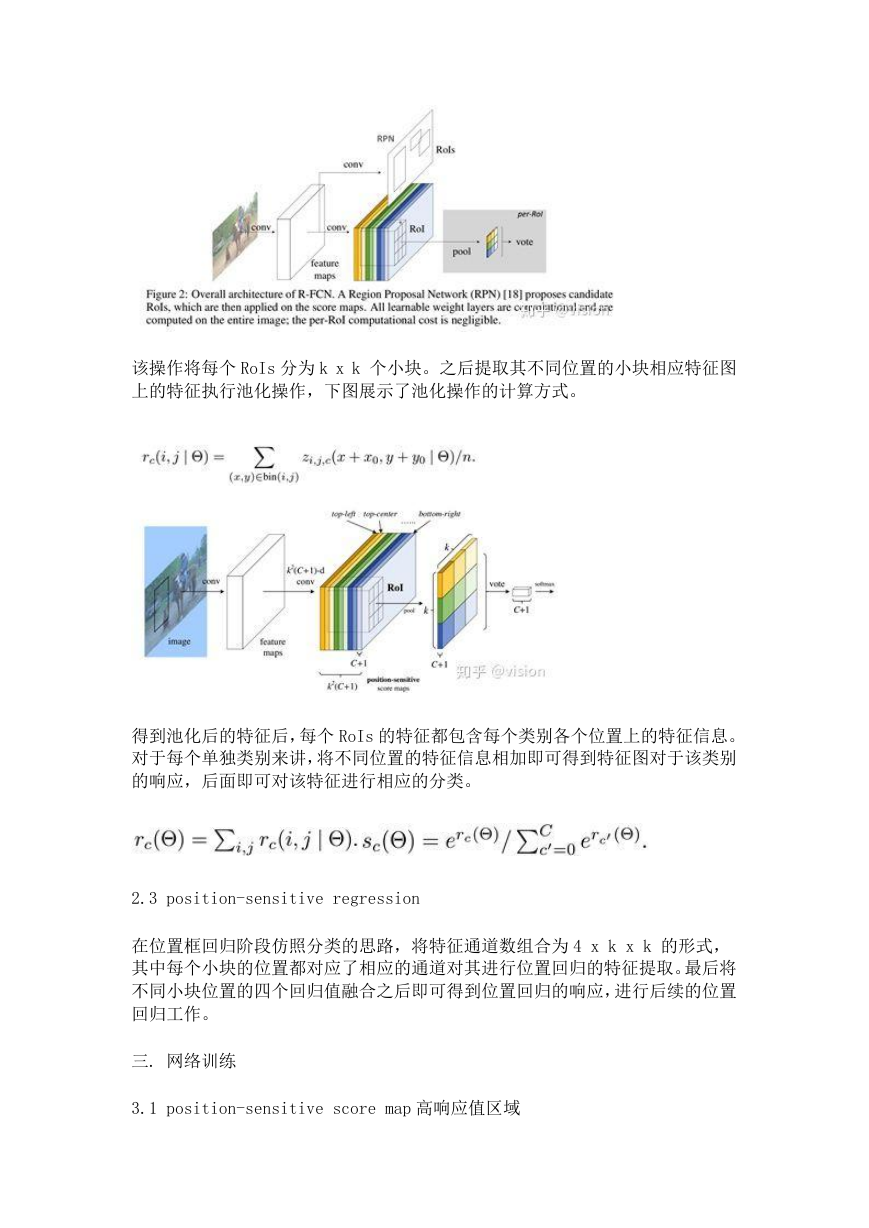

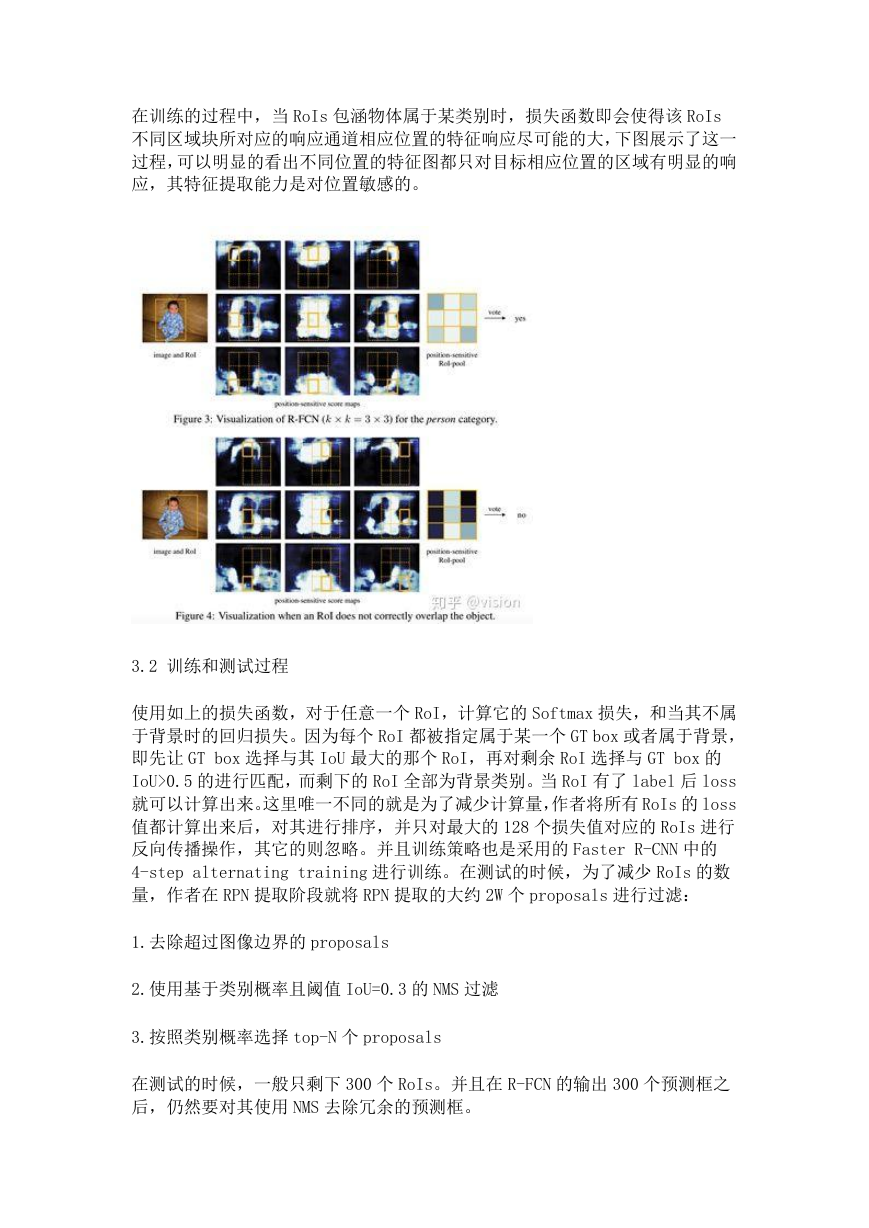

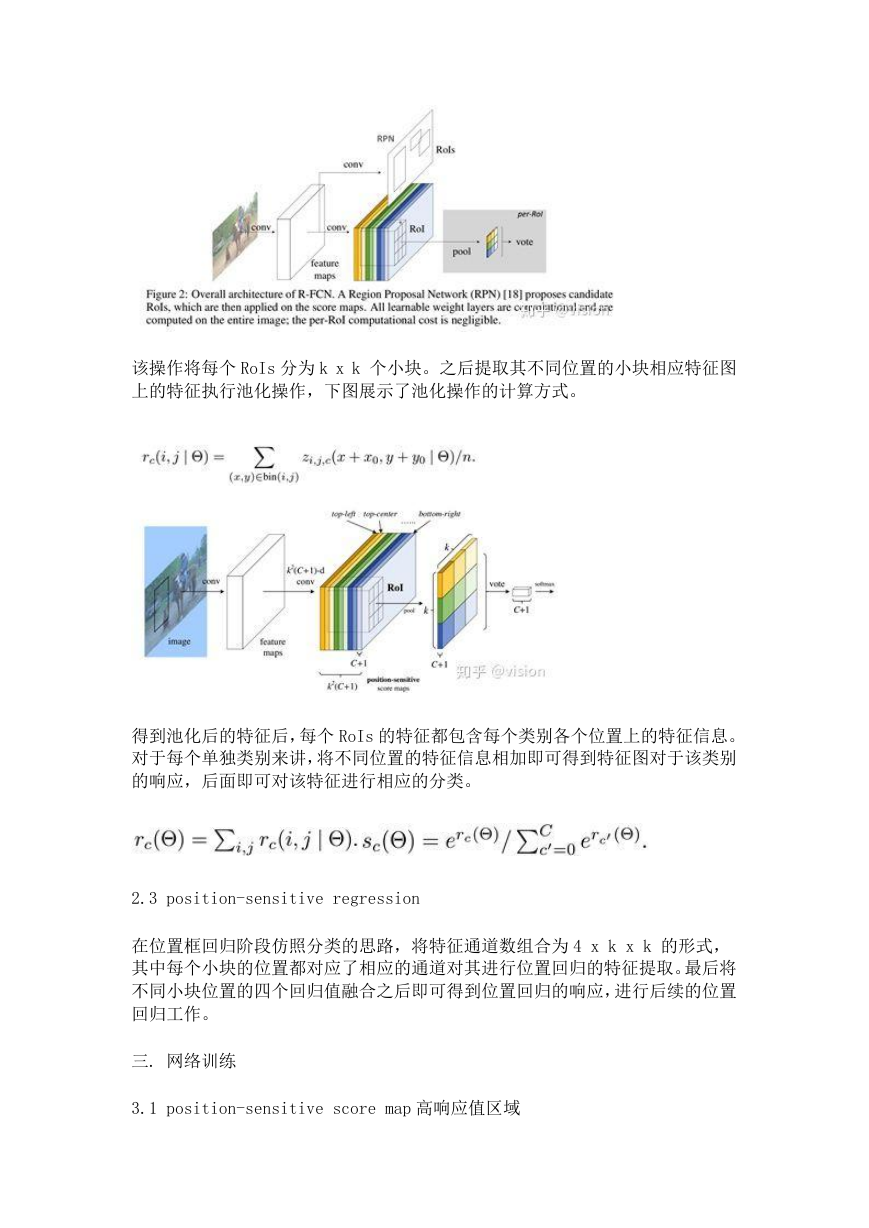

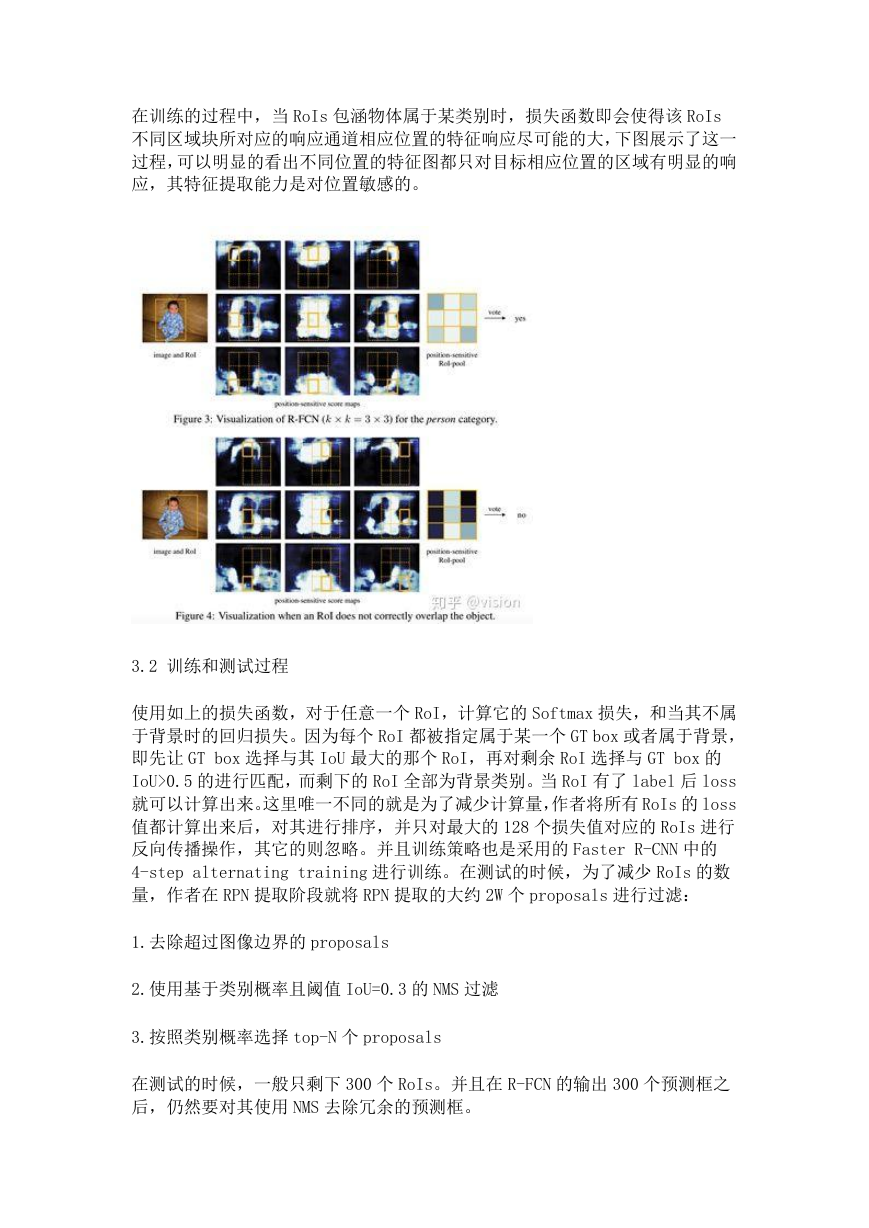

1.1.1 R-FCN: Object Detection via Region-based Ful

1.1.2 R-FCN-3000 at 30fps: Decoupling Detection an

1.1.3 Mask R-CNN

1.2 One stage

1.2.1 YOLO9000: better, faster, stronger

1.2.2 YOLOv3: an incremental improvement

1.2.3 Object detection at 200 Frames Per Second

1.2.4 DSSD: Deconvolutional Single Shot Detector

1.2.5 DSOD : learning deeply supervised object det

本文内容原创,作者:美图云视觉技术部 检测团队,转载请注明出处

2. 解决方案

2.1 小物体检测

2.1.1 Feature Pyramid Networks for Object Detectio

2.1.2 Beyond Skip Connections Top Down Modulation

2.2 不规则形状物体的检测

2.2.1 Deformable Convolutional Networks

2.3 解决正负样本不均衡的问题

2.3.1 Focal Loss for Dense Object Detection

2.3.2 Chained Cascade Network for Object Detection

2.3.3 RON-Reverse Connection with Objectness Prior

2.4 被遮挡物体检测

2.4.1 Soft-NMS -- Improving Object Detection With

2.4.2 RRC: Accurate Single Stage Detector Using Re

2.5 解决检测mini-batch过小的问题

2.5.1 MegDet: A Large Mini-Batch Object Detector

2.6 关注物体之间关联性信息

2.6.1 Relation Networks for Object Detection

2.7 改进网络结构以提升效果

2.7.1 DetNet: A Backbone network for Object Detect

2.7.2 RefineDet:Single-Shot Refinement Neural Netw

2.7.3 Pelee: A Real-Time Object Detection System o

2.7.4 Receptive Field Block Net for Accurate and F

本文内容原创,作者:美图云视觉技术部 检测团队,转载请注明出处

3. 扩展应用、综述

3.1 logo检测:Scalable Object Detection for Stylized

3.2 实例分割:Path Aggregation Network for Instance Seg

3.3 目标检测用于视频分段:Rethinking the Faster R-CNN Archite

3.4 从零训练目标检测网络: Mimicking Very Efficient Network f

3.5 调研速度和准确率平衡的综述:Speed/accuracy trade-offs for mo

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc