大数据分析实验报告

Big Data Analysis Experiment Report

学院:

班级:

学号:

学生姓名:

指导教师:

教 务 处

2020 年 5 月

�

实验一 Hadoop 与 Spark 搭建与应用程序开发

一. 实验目的与要求、

1、要求学生能搭建 Hadoop 和 Spark 环境;

2、要求学生能正确启动 Spark 服务进程;

3、要求学生能实现 Spark 应用程序并正确运行。

二. 实验环境及软件

Virtulbox 虚拟机、unbunt 系统

三. 实验内容

1.安装 ssh

保证虚拟机可以连接外网。

安装成功后,ssh 登录本机。

2.安装 Java

在/usr/lib 目录下新建 jvm 文件夹,把安装包放到/usr/lib/jvm 下,然后解压。

- 1 -

�

JDK 文件解压缩以后,可以执行如下命令到/usr/lib/jvm 目录查看一下:

可以看到,在/usr/lib/jvm 目录下有个 jdk1.8.0_221 目录。下面继续执行如下命令,

设置环境变量:

在.bashrc 文件中添加如下内容:

保存.bashrc 文件并退出 vim 编辑器。然后,继续执行如下命令让.bashrc 文件的配置

立即生效:

这时,可以使用如下命令查看是否安装成功:

3. 安装 Hadoop

将 Hadoop 安装至 /usr/local/ 中:

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示

- 2 -

�

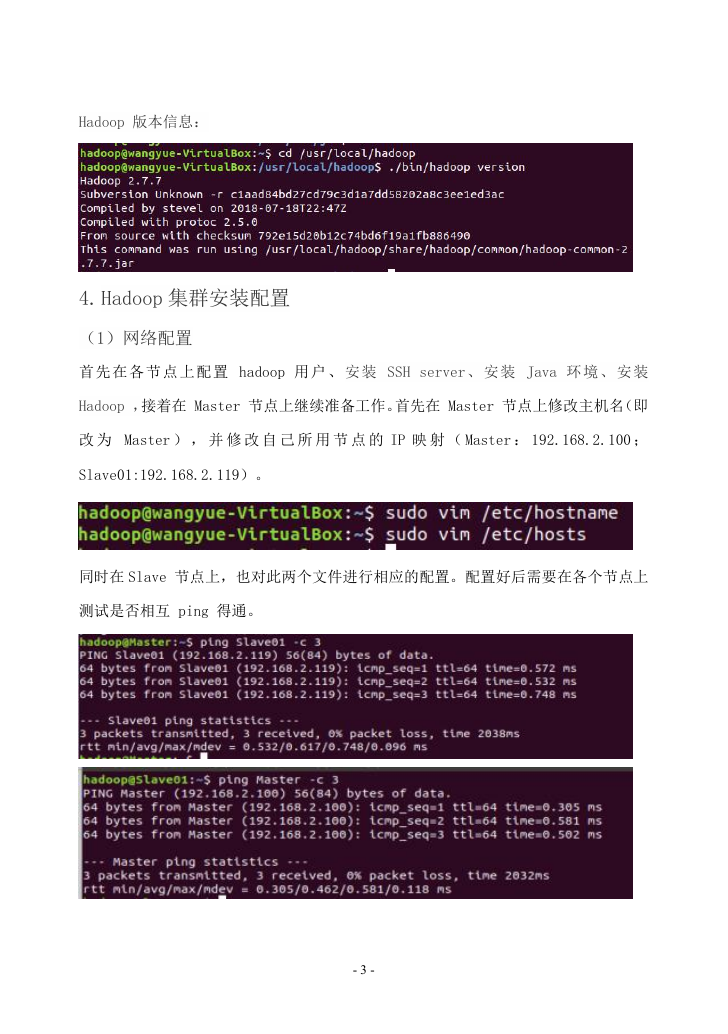

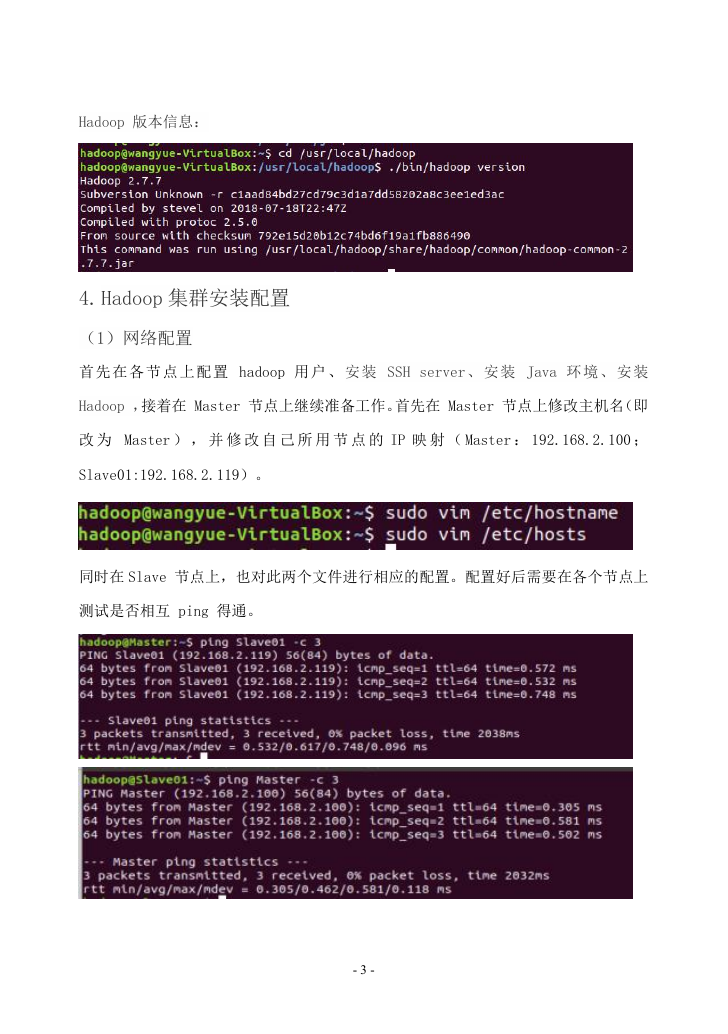

Hadoop 版本信息:

4. Hadoop 集群安装配置

(1)网络配置

首 先 在 各 节 点 上 配 置 hadoop 用 户 、 安 装 SSH server、 安 装 Java 环 境 、 安 装

Hadoop ,接着在 Master 节点上继续准备工作。首先在 Master 节点上修改主机名(即

改 为 Master ) , 并 修 改 自 己 所 用 节 点 的 IP 映 射 ( Master : 192.168.2.100 ;

Slave01:192.168.2.119)。

同时在 Slave 节点上,也对此两个文件进行相应的配置。配置好后需要在各个节点上

测试是否相互 ping 得通。

- 3 -

�

(2)SSH 无密码登陆节点

首先生成 Master 节点的公匙。

为了让 Master 节点需能无密码 SSH 本机,在 Master 节点上执行如下命令并验证,

成功后执行 exit 返回原来的终端。

接着在 Master 节点将上公匙传输到 Slave1 节点:

接着在 Slave1 节点上,将 ssh 公匙加入授权:

这样,在 Master 节点上就可以无密码 SSH 到各个 Slave 节点了,可在 Master 节

点上执行如下命令进行检验。

- 4 -

�

(3)配置环境变量

(4)配置集群环境

在 slaves 中,将作为 DataNode 的主机名写入该文件。

配置 core-site.xml:

配置 hdfs-site.xml:

- 5 -

�

配置 yarn-site.xml:

配置 mapred-site.xml,如果没有就拷贝 mapred-site.xml.template 然后重命名为

mapred-site.xml(cp mapred-site.xml.template mapred-site.xml) 然后进行编辑:

配置好后,将 Master 上的 /usr/local/Hadoop 文件夹复制到各个节点上。在 Master

节点上执行:

- 6 -

�

在 Slave01 节点上执行:

(5)启动 Hadoop 集群

首 次 启 动 需 要 先 在 Master 节 点 执 行 NameNode 的 格 式 化 :

接 着 可 以 启 动 hadoop 了 , 启 动 需 要 在 Master 节 点 上 进 行 :

启动完成后,可以通过命令 jps 来判断是否成功启动。

- 7 -

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc