Journal of Computer Applications

计算机应用,2016,36( 6) : 1735 - 1740

ISSN 1001-9081

CODEN JYIIDU

2016-06-10

http: / / www. joca. cn

文章编号: 1001-9081( 2016) 06-1735-06

DOI: 10. 11772 / j. issn. 1001-9081. 2016. 06. 1735

SMFCC: 一种新的语音信号特征提取方法

汪海彬1 ,余正涛1,2 ,毛存礼1,2 *

,郭剑毅1,2

( 1. 昆明理工大学 信息工程与自动化学院,昆明 650500;

2. 昆明理工大学 智能信息处理重点实验室,昆明 650500)

( * 通信作者电子邮箱 maocunli@ 163. com)

摘 要: 针对说话人识别系统中存在的有效语音特征提取以及噪声影响的问题,提出了一种新的语音特征提取

方法———基于 S 变换的美尔倒谱系数( SMFCC) . 该方法是在传统美尔倒谱系数( MFCC) 的基础上利用 S 变换的二维时

频多分辨率特性,以及奇异值分解( SVD) 方法的二维时频矩阵有效去噪性,并结合相关统计分析方法最终获得语音特

征. 采用 TIMIT 语音数据库,将所提的特征和现有特征进行对比实验. SMFCC 特征的等错误率( EER) 和最小检测代价

( MinDCF) 均小于线性预测倒谱系数( LPCC) 、MFCC 及其结合方法 LMFCC,比 MFCC 的 EER 和 MinDCF08 分别下降了

3. 6% 与 17. 9% . 实验结果表明所提方法能够有效去除语音信号中的噪声,提升局部分辨率.

关键词: S 变换; 奇异值分解; 基于 S 变换的美尔倒谱系数; 高斯混合模型-通用背景模型; 说话人识别

中图分类号: TN912. 34

文献标志码: A

SMFCC: a novel feature extraction method for speech signal

WANG Haibin1 , YU Zhengtao1,2 , MAO Cunli1,2 *

, GUO Jianyi1,2

( 1. Faculty of Information Engineering and Automation, Kunming University of Science and Technology, Kunming Yunnan 650500, China;

2. Intelligent Information Processing Key Laboratory, Kunming University of Science and Technology, Kunming Yunnan 650500, China)

Abstract: Aiming at the problems of effective feature extraction of speech signal and influence of noise in speaker

recognition, a novel method called Mel Frequency Cepstral Coefficients based on S-transform ( SMFCC) was proposed for

speech feature extraction. The speech features were obtained which were based on traditional Mel Frequency Cepstral

Coefficients ( MFCC) , employed the properties of two-dimensional Time-Frequency ( TF) multiresolution in S-transform and

effective denoising of two-dimensional TF matrix with Singular Value Decomposition ( SVD) algorithm, and combined with

other related statistic methods. Based on the TIMIT corpus, the extracted features were compared with the current features by

the experiment. The Equal Error Rate ( EER) and Minimum Detection Cost Function ( MinDCF) of SMFCC were smaller than

those of Linear Prediction Cepstral Coefficient ( LPCC) , MFCC, and LMFCC; especially, the EER and MinDCF08 of SMFCC

were decreased by 3. 6% and 17. 9% respectively compared to MFCC. The experimental results show that the proposed method

can eliminate the noise in the speech signal effectively and improve local speech signal feature resolution.

Key words: S-transform; Singular Value Decomposition ( SVD ) ; Mel Frequency Cepstral Coefficients based on S-

transform ( SMFCC) ; Gaussian Mixture Model-Universal Background Model ( GMM-UBM) ; speaker recognition

0 引言

语音是人们之间用来交流和沟通的最自然、最直接的方

式之一,因此,语音是一种重要的生物特征. 作为一种重要的

身份鉴定技术,目前说话人识别[1] 已广泛运用于国家安全、司

法鉴定、电话银行、门禁安全等领域. 但其仍然有许多问题需

要解决,其中最关键的是用语音信号的哪些特征能最有效、最

可靠地描述说话人,这就涉及到语音特征参数的提取方法.

为了得到有效的语音特征,有些学者提出了一些语音特

征提 取 方 法, 例 如: 文 献[2 - 3 ] 中 的 线 性 预 测 倒谱 系 数

( Linear Prediction Cepstral Coefficient, LPCC) 方法,它是通过

对线性预测系数( Linear Prediction Coefficient, LPC) [4] 求倒谱

运算而获得,它能够比较彻底地去除语音产生过程中的激励

信息,能较好地描述语音信号的共振峰特性,成功地模拟了人

的发声机理. 但由于它基于全极点模型的假设,因此,不能很

好地区分清音和鼻音. 同时,LPCC 对噪声敏感,在外界存在干

扰时识别率会大大 降 低 . 为 了 解 决 上 述 问 题, 有 人 提 出 了

美 尔 倒 谱 系 数 ( Mel Frequency Cepstral Coefficient,

MFCC) [5 - 8] ,它是当前说话人识别领域应用中最有效和最主

流的特征参数. 它主要描述的是语音信号在频率域上的能量

分布,能够较好地模拟人耳听觉系统的感知能力. 与 LPCC 相

比较,MFCC 具有更好的识别性能和鲁棒性. 在历年的美国国

家标准 局 说 话 人 识 别 评 比 ( National Institute of Standards

and Technology Speaker Recognition Evaluation, NIST SRE )

中[9 ] ,领先的识别 系 统 大 多 采 用 MFCC 及 其 派 生 算 法. 例

如,文献[10 - 11 ] 提 出 的 小波包动态系数 ( Wavelet Packet

收稿日期: 2015-11-02; 修回日期: 2016-01-18.

基金项目: 国家自然科学基金资助项目( 61262041,61472168) ; 云南省自然科学基金重点项目( 2013FA030) .

作者简介: 汪海彬( 1988—) ,男,安徽马鞍山人,硕士研究生,主要研究方向: 语音信号处理、语音识别; 余正涛( 1970—) ,男,云南曲靖人,

教授,博士, CCF 会员,主要研究方向: 自然语言处理、信息抽取、语音识别; 毛存礼( 1977—) ,男,云南曲靖人,讲师,博士,CCF 会员,主要研究

方向: 自然语言处理、信息抽取、语音识别; 郭剑毅( 1964—) ,女,云南曲靖人,教授,硕士,CCF 会员,主要研究方向: 自然语言处理、信息抽取、

语音识别.

�

6371

计算机应用

第 36 卷

Dynamic Coefficient, WPDC) 特征提取方法. 它是由小波变换

代替 MFCC 中 的 快 速 傅 里叶 变 换 ( Fast Fourier Transform,

FFT) 和三角滤波器组而获得. 文献[5,12 - 13] 提出了 LPCC

与 MFCC 相结合的特征提取方法 ———LPMFCC,使得这种方

法同时 具 备 了 人 的 发 声 特 性 和 人 耳 的 感 知 特 性. WPDC、

LPMFCC 与 MFCC 相比,它们的抗噪性与识别率都有所提高.

然而,由于 MFCC 的提取中 Mel 滤波器的数量在低频区域多、

在高频区域少,使得 MFCC 随着频率的提高,其计算精度随之

下降. 同时,由于 LPCC 是基于线性频率提取的 ,不能较好地

突出语音的局部特征. 此外,在有噪声环境下其识别率会有所

下降.

语音信号属于典型的非平稳信号,对语音信号处理时,现

有方法将其看作短时稳定信号,也就是说把信号分成多帧,对

每一帧进行处理. 这种方式无形中造成了信号中信息的丢失,

特别是在两帧之间或多帧之间的那些关键信息. 因此对传统

的特征提取方法有必要作一些改进. 常规的傅里叶变换不能

够对非稳定信号进行有效的分析,因为它只是对一段信号的

全局变换,而对语音信号处理而言,每一时刻的频域特征也是

非常重要的. 因此处理语音信号时有必要把它的时域、频域结

合起来. 常用的时频分析方法,如: 短时傅里叶变换( Short Fast

Fourier Transform, SFFT) 、小波变换( Wavelet Transform, WT)

等,由于分辨力固定、不具备自适应等一些原因,处理结果不

是真正的时频谱. S 变换结合了 WT 和 SFFT 的优点,适于处

理非平稳信号. 与 SFFT、WT 等方法比较而言,S 变换在时频

表现方面更加直观,高频部分分解得更加细致,可以提取更多

种特征. 目前 S 变换已应用于分析某些非平稳信号,例如,地

震波[14] 、电能质量信号[15] 、脑电图仪信号 ( ElectroEncephalo-

Graph, EEG) [16] ,以及心音信号[17 - 18] 等方面. 因此本文探索

性用 S 变换对语音信号进行处理,用于说话人识别. 另外,上

面提到, 说 话 人 识 别 率 受 噪 声 环 境影 响 , 而 奇 异 值 分 解

( Singular Value Decomposition, SVD) 降噪方法是一种非线性

滤波方法, 可 以 有 效 抑 制 信 号 中的 宽 带 随 机 噪 声 , 如 Yin

等[18] 用奇异值均方差与单个奇异值占总奇异值比例相结合

的方法对心磁信号进行滤波; Guo 等[19] 运用奇异值差分谱最

后峰值点的方法对滚动轴承故障振动信号降噪处理. 本文提

出用 SVD 对语音信号进行降噪处理. 将 SVD 用于一维语音信

号处理时, 关 键 问 题 之 一 是构 造 合 适 的 数 据 矩 阵 , 而 S 变

换[20] 正好是一种将一维时域变换到二维时频域的信号处理

方法,因此可以推断,S 变换和 SVD 将是一种很好的配对,将

其用于处理语音信号是一次有意义的尝试.

综上所述,本文对语音信号特征处理提出了一种新的思

路. 首先,对语音信号进行 S 变换得到二维时频域信号; 其次,

利用 SVD 对该二维信号进行降噪. 其中,针对奇异值阈值选

取问题,本文提出了一种自适应地选取方法; 再次,利用统计

学分析方法分别对二维时频矩阵的时域、频域进行计算; 最

后,结合 MFCC 的提取方法得到一种新的特征,即 SMFCC.

1

S 变换理论

S 变换是一种将一维时域信号变换到二维时频域的信号

处理方法,由 Stockwell 等[20 - 21] 提出. S 变换继承并发展了短

时傅里叶变换和小波变换的优良特性,适用于非线性、非平稳

信号的分析.

对于给定信号 x( t) ,其 S 变换定义为:

S( τ, f) = ∫

g( τ, f) 为高斯窗函数:

x( t) g( τ - t, f) e -i2πft dt

+∞

-∞

f e -

τ2f2

2

/

2槡 π

g( τ, f) =

S 变换是可逆的,逆变换为:

x( t) = ∫

-∞ ∫

+∞

+∞

-∞

{ S( τ, f) dτ} ei2πft df

( 1)

( 2)

( 3)

其中: 参数 τ 为高斯窗函数中心点( 控制窗口在时间轴上的位

置) ;

f 为频率( 与高斯窗口的宽度成反比关系) .

因此,S 变换可以看成一种加高斯窗的 STFT,使得信号

低频段具有高的频率分辨率,而在高频段具有高的时间分辨

率. S 变换具有多分辨率特性,克服了 STFT 分辨率固定的缺

点,且 S 变换对于信号的高频冲击成分具有较高的敏感性. 所

以基于 S 变换的 MFCC 可以克服对中高频率区域分辨率的不

足,适合处理非平稳的语音信号.

由式 ( 1 ) 可 知, S 变 换 还 可 以 看 成 是 连 续 小 波 变 换

( Continuous WT, CWT) 的一种相位修正,只是把小波变换中

的尺度参数、平移参数作相应的改动,从而弥补了 CWT 缺乏

相位信息的不足.

2 基于 SVD 降噪方法

2. 1 奇异值分解( SVD) 理论

奇异值分解[22 - 23] 是线性代数中一种重要的矩阵分解方

法.

令 A 为 m × n 的矩阵,秩为 r( r ≤ n) ,则存在 m × m 的正

交阵 U 和 n × n 的正交阵 V,使得:

A = UDVT

式中 D 是 m × n 的非负对角阵.

[

]

S 0

0

0

D =

( 4)

( 5)

其 中: S = diag( σ1 ,σ2 ,,σr ) ; σ1 ,σ2 ,,σr

连 同 σr +1 =

σr +1 = = σn = 0 称为 A 的奇异值. U、V 分别称为矩阵 A 的

左右特征矩阵.

2. 2 奇异值选取降噪方法

若 A 表示一个信号矩阵,其中包括有用信号和噪声,那么

矩阵 A 的奇异值 σ1 ,σ2 ,,σi ,,σr

可以反映有用信号和噪

声能量集中的情况. A 的奇异值的大小对应着在信号中所占

比重的大小. 正常情况下,在一段信号中有用的信号所占比重

是远大于噪声的. 如果将 σ1 ,σ2 ,,σi ,,σr

按照递减的顺

序排列起来,即 σ1 ≥ σ2 ≥ ≥ σi ≥ ≥ σr ≥ 0,那么,前

i 个较大的奇异值将主要反映有用信号 ,较小的奇异值 σi +1 ,

则主要反映噪声,把这部分反映噪声的奇异值置

σi +2 ,,σr

零,就可以去除信号中的噪声.

文献[ 17] 中选取不同个数的奇异值对二维时频信号进

行滤波,比较得出当奇异值个数分别为 2、4 时具有较好的局

部滤波效果. 随着所取奇异值个数的增加,还原后的信号中噪

声分量逐渐增加. 到底选取多少个奇异值才能达到最佳滤波

效果?针对以上问题,文献[ 23] 给出答案,奇异值个数的选取

很大程度上由信号本身特点决定,目前并没有完全统一的方

法.

本文求出信号的奇异值矩阵 S,将 S 中对角元素相邻的前

�

第 6 期

汪海彬等: SMFCC: 一种新的语音信号特征提取方法

7371

特征.

一项减后一项得到值 k, 即 ki = σi - σi +1 . ki

组成向量 K =

( k1 ,k2 ,,ki ,,kr -1 ) ,当 K 中的某一元素 ki

最大,则确定 ki

该位置为奇异值矩阵 S 奇异值阈值 σi

以后的值置

零,从而 S 中的某些元素变为零. 再通过式( 4) 反变换重新得

到有用信号矩阵 A.

位置,把 σi

一段语音信号中包含了有用信息和无用信息( 噪声) ,这

里所说的滤波是去除信号中自带的无用信息,而不是人为添

加的一些噪声,因此无法直观地看到滤波效果,可以通过系统

识别率来说明,见表 3 ~ 4.

2. 3 原始信号损失分析和实验

由于一段语音信号中噪声和有用信息混杂在一起 ,根据

SVD 降噪原理可知( 见 2. 2 节) ,在滤波时会有一部分有用信

息被滤除. 由后面的实验 B 可知( 见 4. 3 节) ,被滤除的一部分

有用信息( 含有很少的能量值) 对最终系统的性能影响不大.

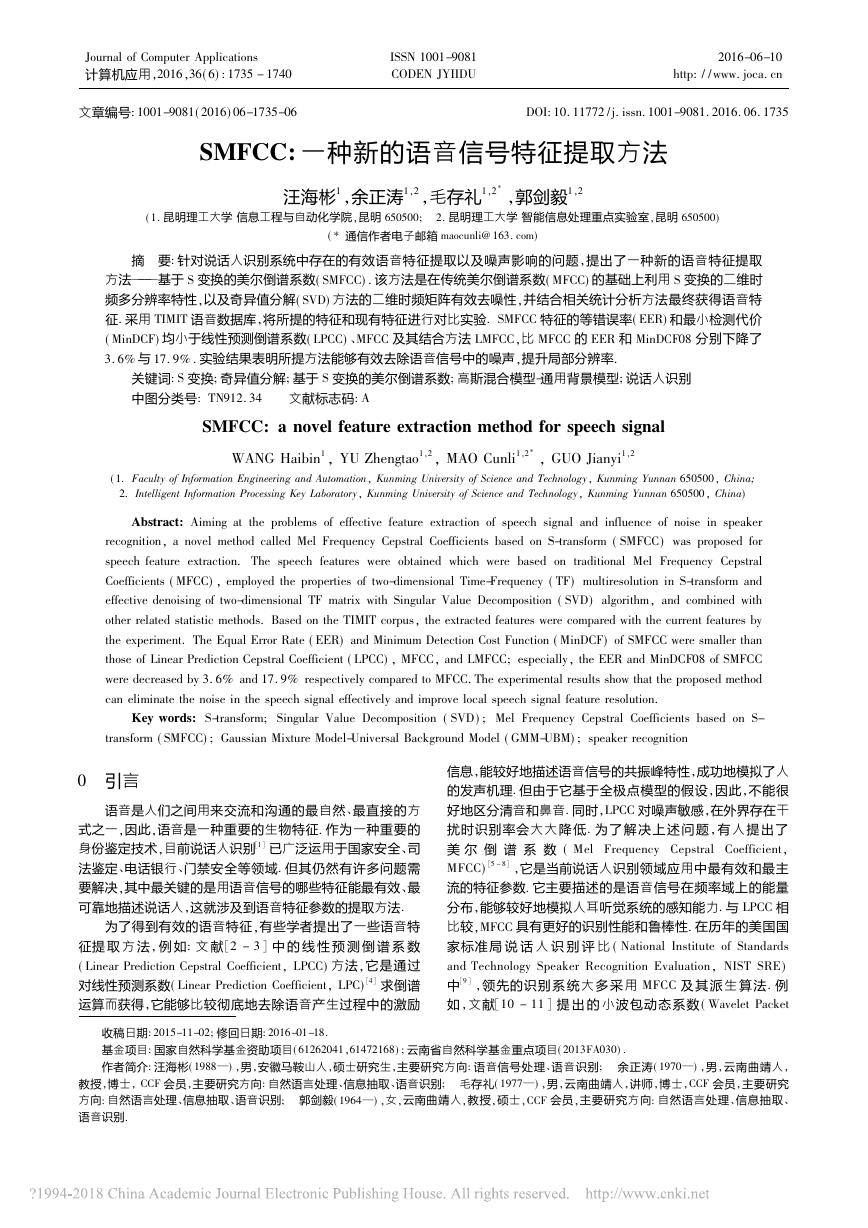

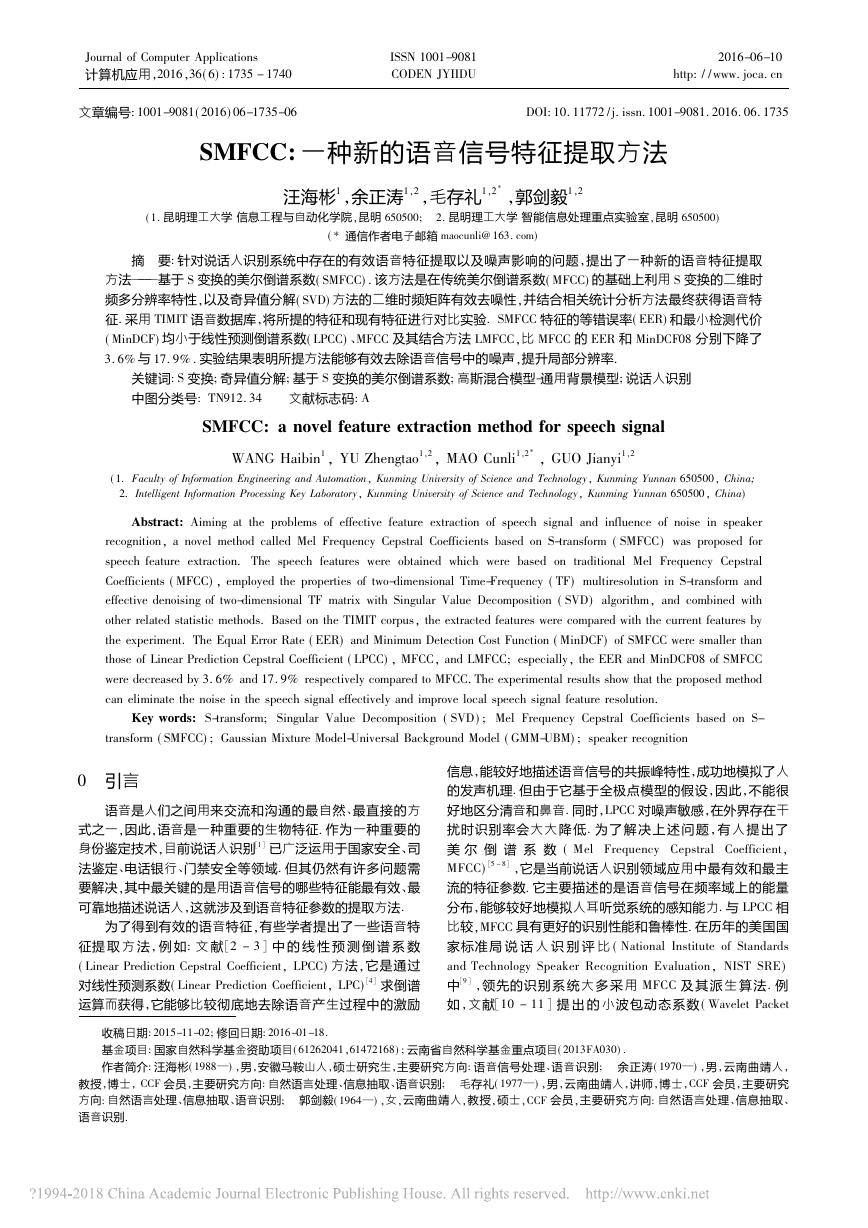

通过 SVD 降噪实验比较,可以看到效果如图 1 和图 2 所示,

降噪后的时频图比原始时频图颜色变浅,即相应的一部分能

量被滤除. 图 2 中可以看出图 2( d) 相比图 2( c) 有一定的损失

( 颜色变浅) ,同时相对应的频率方向、时间方向上的信号成分

更少. 因此,SVD 方法可以有效地滤除语音信号时频矩阵中的

一些( 低能量) 噪声.

图 1 一段语音信号在去噪前后的时域对比

3 基于 S 变换与 SVD 的语音时频域特征提取

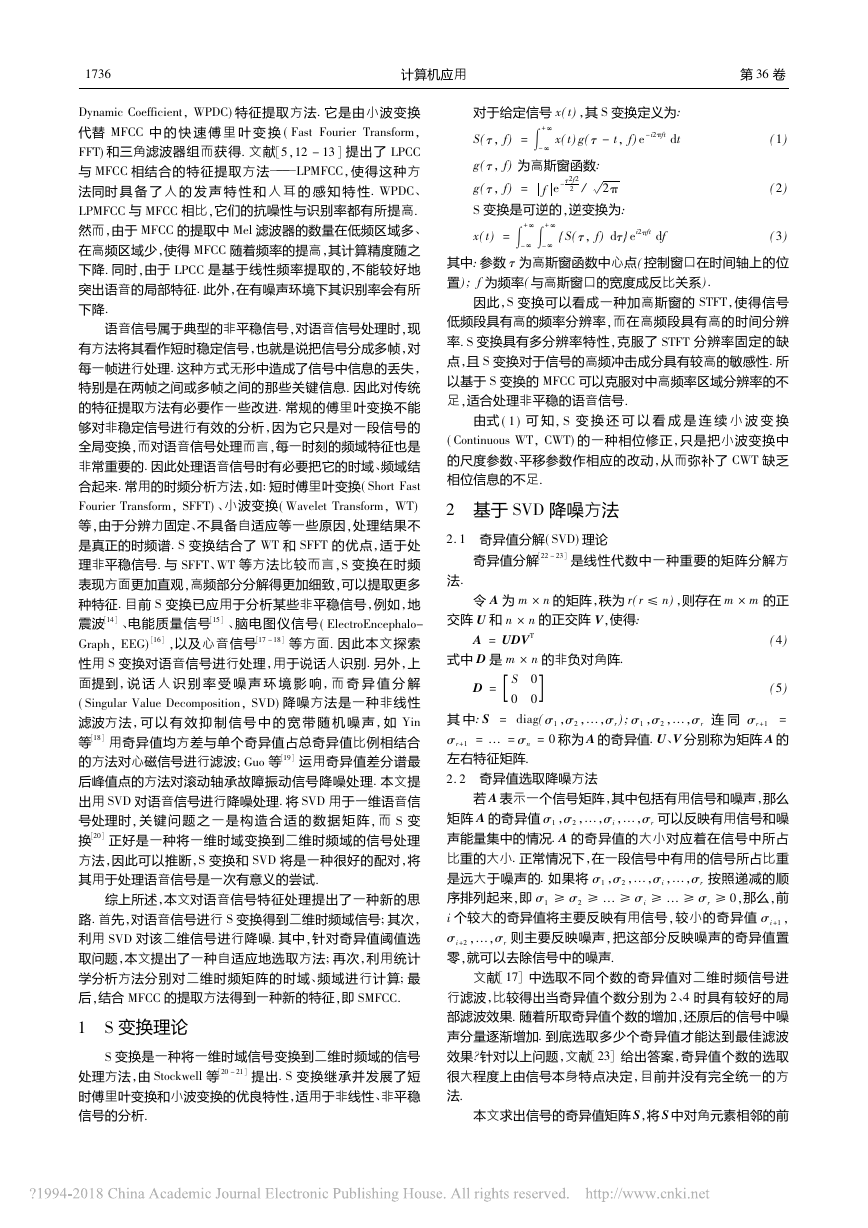

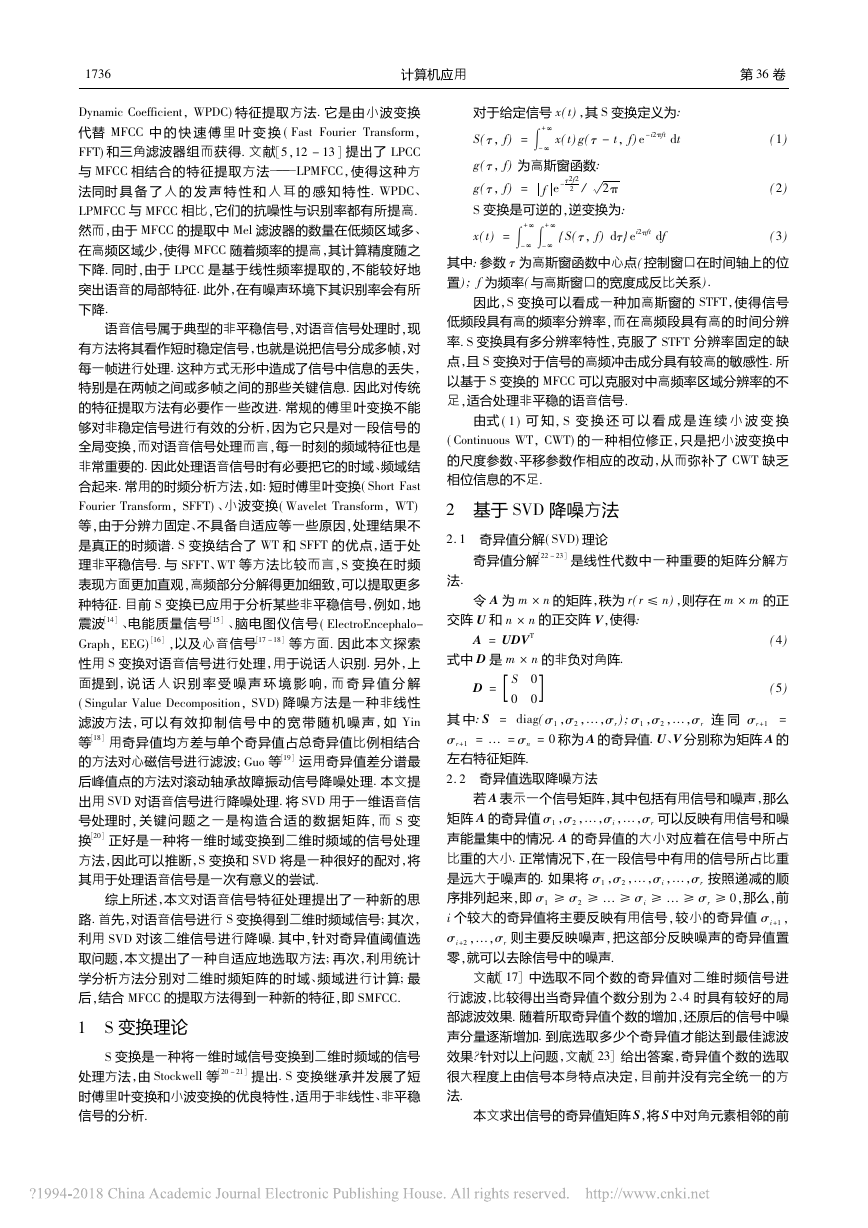

本文对语音信号进行特征提取时,把 MFCC 特征提取中

的傅里叶变换替换成 S 变换和 SVD 后,得到的是一个去噪后

的二维时频域信号. 对这个二维矩阵的每行、每列分别计算其

统计值; 然后通过三个步骤的计算( Mel 滤波器组、求对数能

量及求离散余弦变换( Discrete Cosine Transformation, DCT) 倒

谱) ,最后分别求一阶、二阶差分变化,得到 75 维的 SMFCC 特

征. 原理如图 3 所示,具体提取步骤如下:

1) 对语音信号 x( t) 预处理,对一帧语音信号进行 S 变换,

得到 S 矩阵 A. A 为 N × N 的矩阵,N 为一帧长度. A 的行向量

表示频域,列向量表示时域,元素值表示幅度值.

2) 对矩阵 A 进行 SVD 计算,通过第 2 章所述的奇异值取

舍对 S 矩阵进行降噪处理,得到矩阵 B( 见 2. 2 节,奇异值选取

降噪方法) .

3) 分别对矩阵 B 的行向量、列向量求其统计值,合并得

到一个 2N 维的统计值向量 c. 对矩阵 B 的行向量、列向量分别

处理,意味着是同时对信号的频域、时域同时处理. 通过实验

可知,求其和值可以得到最优的 SMFCC( 见表 3) .

4) 将向量 c 通过 Mel 滤波器组以及求对数能量,求 DCT

倒谱. 再分别求一阶、二阶差分变化,最终得到 75 维的 SMFCC

图 2

SVD 降噪方法去噪效果对比

4 实验及结果

4. 1 实验配置

本实验中的测试数据采用 TIMIT 语音库[24 ] ,其中包括

192 个女性 和 438 个 男 性, 每 人 有 10 句 语 音, 总 共 6 300

句语音. 实验在预处理阶段包括: 有效语音端点检测 ( 短时

能量 与 平 均 过 零 率 相 结 合 的 方 法 ) 、预 加 重 ( 因 子 为 0 .

95 ) 、分帧( 帧长 25 ms,帧移 12. 5 ms) 和加窗. 识别方法为高

斯混合模型-统一背景模型( Gaussian Mixture Model-Universal

Background Model, GMM-UBM) [25] ,高斯混合数为 512,运用 5

300 句语音( 女性 1 620 句语音,男性 3 680 句语音) 训练 UBM

模型. 实验训练数据为 100 人( 30 个女性,70 个男性,每人 9

句语音) ; 测试数据为 100 人( 30 个女性,70 个男性,每人 1 句

语音) .

为了验证本文所提出方法的有效性,设计了四个实验: 实

验 A 为了得到最优的 SMFCC; 实验 B 考察 SVD 降噪的有效

�

8371

计算机应用

第 36 卷

性; 实验 C 是与经典语音特征作比较; 实验 D 是与最近语音

特征作对比. 需要说明的是,该方法不局限于说话人识别,它

还可以运用于语音信号的其他领域,如: 语音识别、说话人情

感识别等.

其中 θ 为 阈 值. 在 说 话 人 识 别 系 统 中, 当 漏 警 率 ( Miss

Probability) 和虚警率 ( FalseAlarm Probability) 相等时,确定为

θ .

NIST SRE 中采用 DET 曲线与 MinDCF 两个指标来评价

各个系统的性能,DET 曲线给出的说话人识别系统的全面性

能评估,MinDCF 可以看成 DET 曲线上最能反映系统性能的

一个点,考察的是识别系统的核心性能. EER 是指当漏警率

和虚警率相等时,DET 曲线的值,主要用于评价系统的整体性

能. MinDCF 与 EER 越小说明系统的性能越好.

检测代价函数计算公式为:

C det = CMiss * PMiss| Target * PTarget +

和 CFalseAlarm

CFalseAlarm * PFalseAlarm| NonTarget * ( 1 - PTarget )

( 7)

和

分别为给定门限 θ 情况下的漏警率和虚警率.

为目标实验的先验概率. 当 PMiss| Target = PFalseAlarm| NonTarget

分别为漏警和虚警的代价; PMiss| Target

其中: CMiss

PFalseAlarm| NonTarget

PTarget

时,EER = Cdet .

表 1 为 MinDCF08 和 MinDCF10 的参数.

表 1 MinDCF08 和 MinDCF10 参数设定

函数

参数

MinDCF08

CMiss

CFalseAlarm

PTarget

值

10

1

0. 01

函数

参数

MinDCF10

CMiss

CFalseAlarm

PTarget

值

1

1

0. 001

4. 3 结果与分析

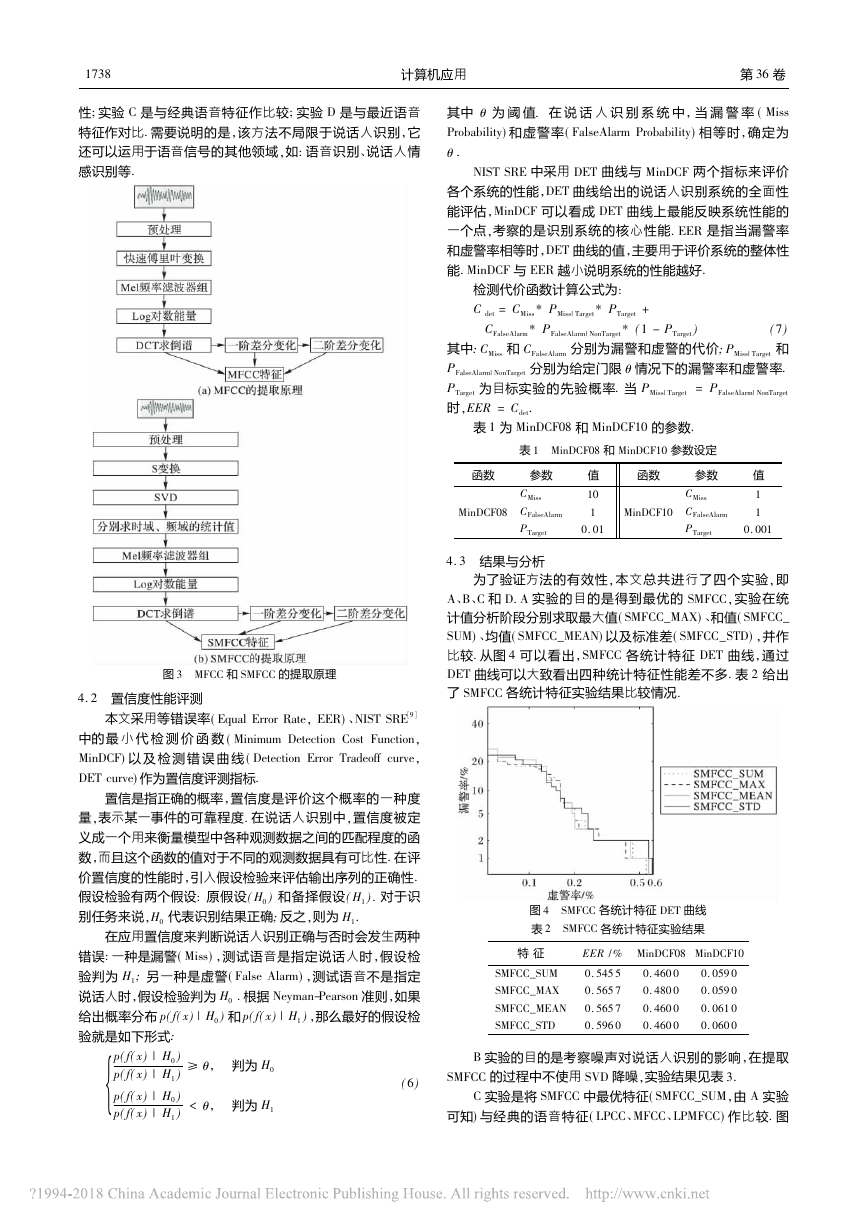

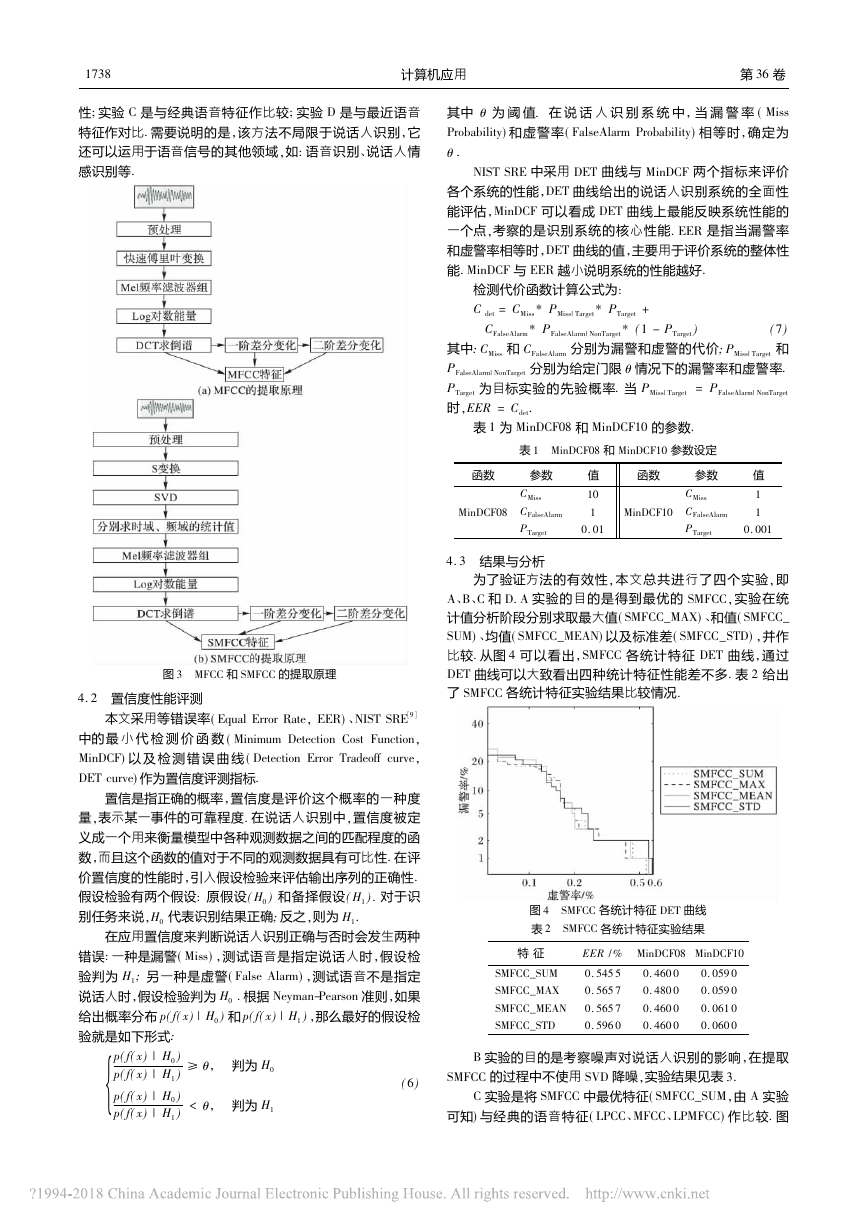

为了验证方法的有效性,本文总共进行了四个实验,即

A、B、C 和 D. A 实验的目的是得到最优的 SMFCC,实验在统

计值分析阶段分别求取最大值( SMFCC_MAX) 、和值( SMFCC_

SUM) 、均值( SMFCC_MEAN) 以及标准差( SMFCC_STD) ,并作

比较. 从图 4 可以看出,SMFCC 各统计特征 DET 曲线,通过

DET 曲线可以大致看出四种统计特征性能差不多. 表 2 给出

了 SMFCC 各统计特征实验结果比较情况.

图 4

表 2

SMFCC 各统计特征 DET 曲线

SMFCC 各统计特征实验结果

特 征

EER / % MinDCF08 MinDCF10

SMFCC_SUM

0. 545 5

0. 460 0

0. 059 0

SMFCC_MAX

0. 565 7

0. 480 0

0. 059 0

SMFCC_MEAN

0. 565 7

0. 460 0

0. 061 0

SMFCC_STD

0. 596 0

0. 460 0

0. 060 0

B 实验的目的是考察噪声对说话人识别的影响,在提取

SMFCC 的过程中不使用 SVD 降噪,实验结果见表 3.

C 实验是将 SMFCC 中最优特征( SMFCC_SUM,由 A 实验

可知) 与经典的语音特征( LPCC、MFCC、LPMFCC) 作比较. 图

图 3 MFCC 和 SMFCC 的提取原理

4. 2 置信度性能评测

本文采用等错误率( Equal Error Rate, EER) 、NIST SRE[9]

中的 最 小 代 检 测 价 函 数 ( Minimum Detection Cost Function,

MinDCF) 以 及 检 测 错 误 曲 线 ( Detection Error Tradeoff curve,

DET curve) 作为置信度评测指标.

置信是指正确的概率,置信度是评价这个概率的一种度

量,表示某一事件的可靠程度. 在说话人识别中,置信度被定

义成一个用来衡量模型中各种观测数据之间的匹配程度的函

数,而且这个函数的值对于不同的观测数据具有可比性. 在评

价置信度的性能时,引入假设检验来评估输出序列的正确性.

假设检验有两个假设: 原假设( H0 ) 和备择假设( H1 ) . 对于识

别任务来说,H0

代表识别结果正确; 反之,则为 H1 .

在应用置信度来判断说话人识别正确与否时会发生两种

错误: 一种是漏警( Miss) ,测试语音是指定说话人时,假设检

验判为 H1 ; 另一种是虚警( False Alarm) ,测试语音不是指定

说话人时,假设检验判为 H0 . 根据 Neyman-Pearson 准则,如果

给出概率分布 p( f( x) | H0 ) 和 p( f( x) | H1 ) ,那么最好的假设检

验就是如下形式:

p( f( x) | H0 )

p( f( x) | H1 )

≥ θ, 判为 H0

( 6)

{

p( f( x) | H0 )

p( f( x) | H1 )

< θ, 判为 H

1

�

第 6 期

汪海彬等: SMFCC: 一种新的语音信号特征提取方法

9371

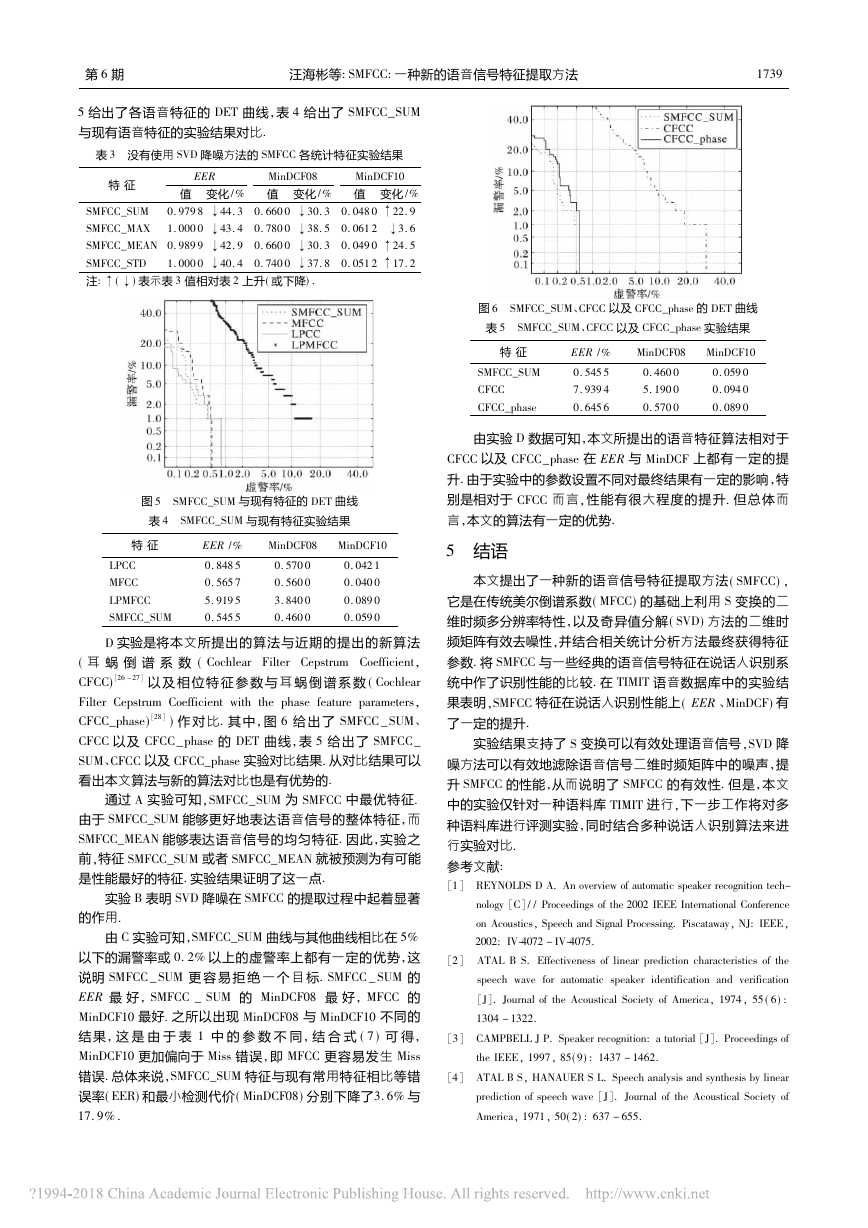

5 给出了各语音特征的 DET 曲线,表 4 给出了 SMFCC_SUM

与现有语音特征的实验结果对比.

表 3 没有使用 SVD 降噪方法的 SMFCC 各统计特征实验结果

特 征

SMFCC_SUM

EER

值 变化 / %

MinDCF10

值 变化 / %

0. 979 8 ↓44. 3 0. 660 0 ↓30. 3 0. 048 0 ↑22. 9

MinDCF08

值 变化 / %

SMFCC_MAX

1. 000 0 ↓43. 4 0. 780 0 ↓38. 5 0. 061 2 ↓3. 6

SMFCC_MEAN 0. 989 9 ↓42. 9 0. 660 0 ↓30. 3 0. 049 0 ↑24. 5

SMFCC_STD

注: ↑( ↓) 表示表 3 值相对表 2 上升( 或下降) .

1. 000 0 ↓40. 4 0. 740 0 ↓37. 8 0. 051 2 ↑17. 2

图 5

表 4

SMFCC_SUM 与现有特征的 DET 曲线

SMFCC_SUM 与现有特征实验结果

特 征

LPCC

MFCC

LPMFCC

SMFCC_SUM

EER / %

MinDCF08

MinDCF10

0. 848 5

0. 565 7

5. 919 5

0. 545 5

0. 570 0

0. 560 0

3. 840 0

0. 460 0

0. 042 1

0. 040 0

0. 089 0

0. 059 0

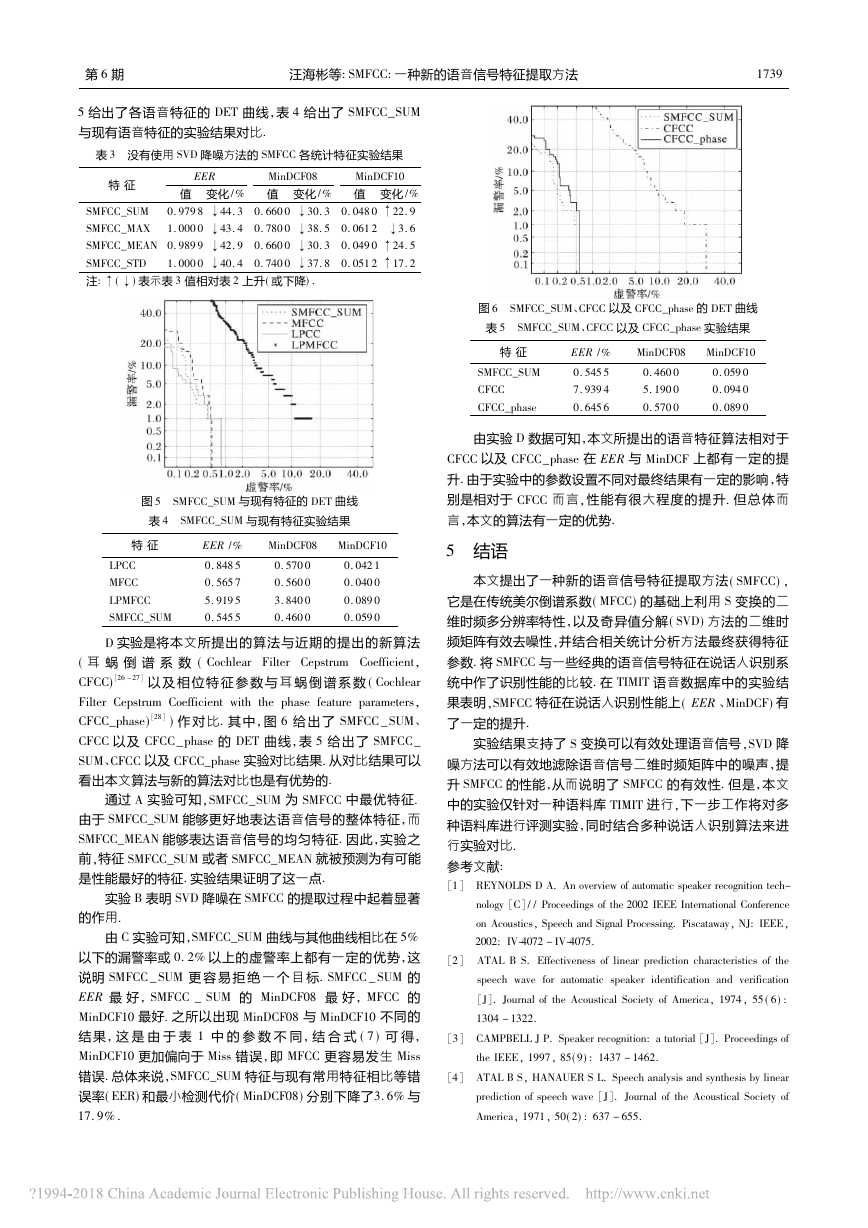

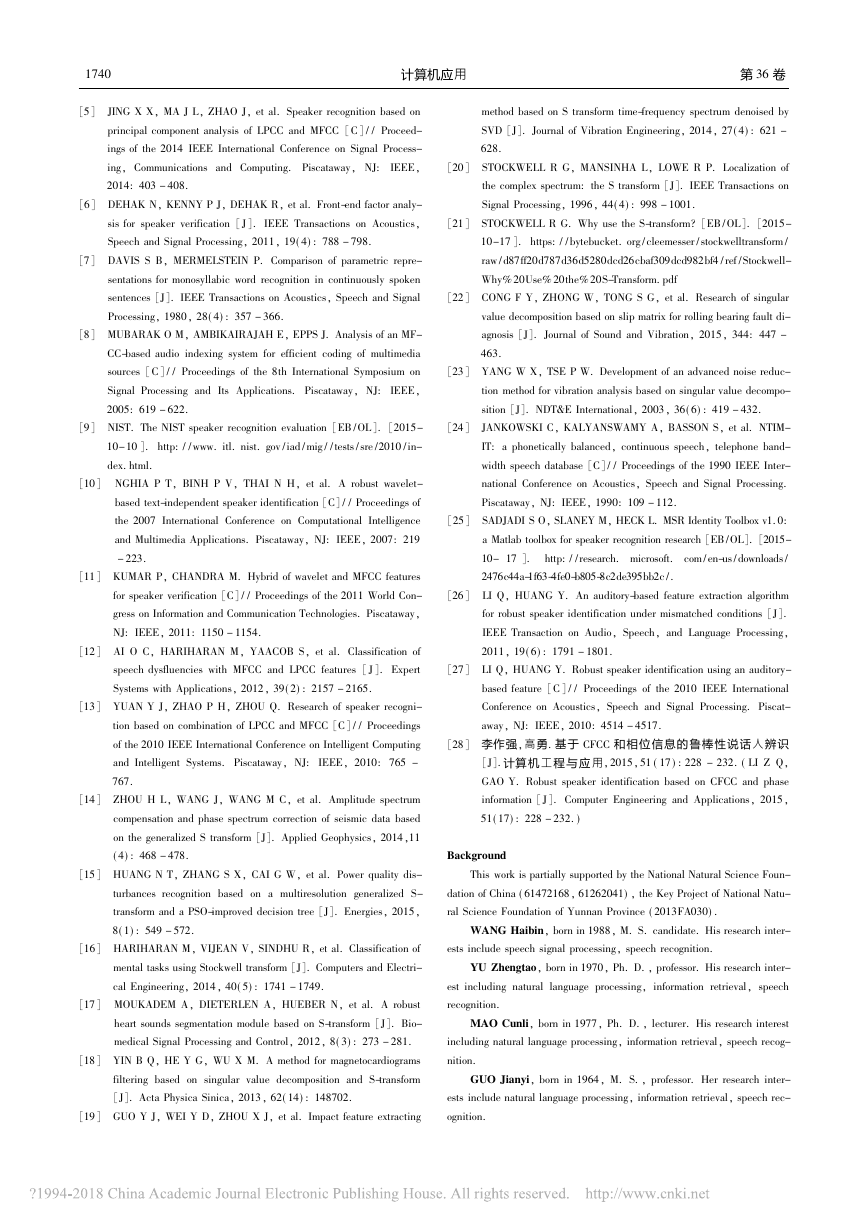

D 实验是将本文所提出的算法与近期的提出的新算法

( 耳 蜗 倒 谱 系 数 ( Cochlear Filter Cepstrum Coefficient,

CFCC) [26 - 27] 以 及 相 位 特 征 参 数 与 耳 蜗 倒 谱 系 数 ( Cochlear

Filter Cepstrum Coefficient with the phase feature parameters,

CFCC_phase) [28] ) 作 对 比. 其 中, 图 6 给 出 了 SMFCC _ SUM、

CFCC 以及 CFCC _ phase 的 DET 曲线, 表 5 给出了 SMFCC _

SUM、CFCC 以及 CFCC_phase 实验对比结果. 从对比结果可以

看出本文算法与新的算法对比也是有优势的.

通过 A 实验可知,SMFCC_SUM 为 SMFCC 中最优特征.

由于 SMFCC_SUM 能够更好地表达语音信号的整体特征,而

SMFCC_MEAN 能够表达语音信号的均匀特征. 因此,实验之

前,特征 SMFCC_SUM 或者 SMFCC_MEAN 就被预测为有可能

是性能最好的特征. 实验结果证明了这一点.

实验 B 表明 SVD 降噪在 SMFCC 的提取过程中起着显著

的作用.

由 C 实验可知,SMFCC_SUM 曲线与其他曲线相比在 5%

以下的漏警率或 0. 2% 以上的虚警率上都有一定的优势 ,这

说明 SMFCC _ SUM 更 容 易 拒 绝 一 个 目 标. SMFCC _ SUM 的

EER 最 好, SMFCC _ SUM 的 MinDCF08 最 好, MFCC 的

MinDCF10 最好. 之所以出现 MinDCF08 与 MinDCF10 不同的

结 果, 这 是 由 于 表 1 中 的 参 数 不 同, 结 合 式 ( 7 ) 可 得,

MinDCF10 更加偏向于 Miss 错误,即 MFCC 更容易发生 Miss

错误. 总体来说,SMFCC_SUM 特征与现有常用特征相比等错

误率( EER) 和最小检测代价( MinDCF08) 分别下降了3. 6% 与

17. 9% .

图 6

表 5

SMFCC_SUM、CFCC 以及 CFCC_phase 的 DET 曲线

SMFCC_SUM、CFCC 以及 CFCC_phase 实验结果

特 征

SMFCC_SUM

CFCC

CFCC_phase

EER / %

MinDCF08

MinDCF10

0. 545 5

7. 939 4

0. 645 6

0. 460 0

5. 190 0

0. 570 0

0. 059 0

0. 094 0

0. 089 0

由实验 D 数据可知,本文所提出的语音特征算法相对于

CFCC 以及 CFCC_phase 在 EER 与 MinDCF 上都有一定的提

升. 由于实验中的参数设置不同对最终结果有一定的影响,特

别是相对于 CFCC 而言,性能有很大程度的提升 . 但总体而

言,本文的算法有一定的优势.

5 结语

本文提出了一种新的语音信号特征提取方法 ( SMFCC) ,

它是在传统美尔倒谱系数 ( MFCC) 的基础上利用 S 变换的二

维时频多分辨率特性,以及奇异值分解( SVD) 方法的二维时

频矩阵有效去噪性,并结合相关统计分析方法最终获得特征

参数. 将 SMFCC 与一些经典的语音信号特征在说话人识别系

统中作了识别性能的比较. 在 TIMIT 语音数据库中的实验结

果表明,SMFCC 特征在说话人识别性能上( EER 、MinDCF) 有

了一定的提升.

实验结果支持了 S 变换可以有效处理语音信号,SVD 降

噪方法可以有效地滤除语音信号二维时频矩阵中的噪声,提

升 SMFCC 的性能,从而说明了 SMFCC 的有效性. 但是,本文

中的实验仅针对一种语料库 TIMIT 进行,下一步工作将对多

种语料库进行评测实验,同时结合多种说话人识别算法来进

行实验对比.

参考文献:

[1] REYNOLDS D A. An overview of automatic speaker recognition tech-

nology [C] / / Proceedings of the 2002 IEEE International Conference

on Acoustics, Speech and Signal Processing. Piscataway, NJ: IEEE,

2002: IV-4072 - IV-4075.

[2] ATAL B S. Effectiveness of linear prediction characteristics of the

speech wave for automatic speaker identification and verification

[J]. Journal of the Acoustical Society of America, 1974, 55 ( 6 ) :

1304 - 1322.

[3] CAMPBELL J P. Speaker recognition: a tutorial [J]. Proceedings of

the IEEE, 1997, 85( 9) : 1437 - 1462.

[4] ATAL B S, HANAUER S L. Speech analysis and synthesis by linear

prediction of speech wave [J]. Journal of the Acoustical Society of

America, 1971, 50( 2) : 637 - 655.

�

0471

计算机应用

第 36 卷

[5]

JING X X, MA J L, ZHAO J, et al. Speaker recognition based on

method based on S transform time-frequency spectrum denoised by

principal component analysis of LPCC and MFCC [C] / / Proceed-

SVD [J]. Journal of Vibration Engineering, 2014, 27( 4) : 621 -

ings of the 2014 IEEE International Conference on Signal Process-

628.

ing, Communications and Computing. Piscataway, NJ:

IEEE,

[20]

STOCKWELL R G, MANSINHA L, LOWE R P. Localization of

2014: 403 - 408.

the complex spectrum:

the S transform [J]. IEEE Transactions on

[6] DEHAK N, KENNY P J, DEHAK R, et al. Front-end factor analy-

Signal Processing, 1996, 44( 4) : 998 - 1001.

sis for speaker verification [J].

IEEE Transactions on Acoustics,

[21]

STOCKWELL R G. Why use the S-transform? [EB / OL]. [2015-

Speech and Signal Processing, 2011, 19( 4) : 788 - 798.

10-17 ]. https: / / bytebucket. org / cleemesser / stockwelltransform /

[7] DAVIS S B, MERMELSTEIN P. Comparison of parametric repre-

raw / d87ff20d787d36d5280dcd26cbaf309dcd982bf4 / ref / Stockwell-

sentations for monosyllabic word recognition in continuously spoken

Why% 20Use% 20the% 20S-Transform. pdf

sentences [J]. IEEE Transactions on Acoustics, Speech and Signal

[22] CONG F Y, ZHONG W, TONG S G, et al. Research of singular

Processing, 1980, 28( 4) : 357 - 366.

value decomposition based on slip matrix for rolling bearing fault di-

[8] MUBARAK O M, AMBIKAIRAJAH E, EPPS J. Analysis of an MF-

agnosis [J]. Journal of Sound and Vibration, 2015, 344: 447 -

CC-based audio indexing system for efficient coding of multimedia

463.

sources [C] / / Proceedings of the 8th International Symposium on

[23] YANG W X, TSE P W. Development of an advanced noise reduc-

Signal Processing and Its Applications. Piscataway, NJ:

IEEE,

tion method for vibration analysis based on singular value decompo-

2005: 619 - 622.

sition [J]. NDT&E International, 2003, 36( 6) : 419 - 432.

[9] NIST. The NIST speaker recognition evaluation [EB / OL]. [2015-

[24]

JANKOWSKI C, KALYANSWAMY A, BASSON S, et al. NTIM-

10-10 ]. http: / / www. itl. nist. gov / iad / mig / / tests / sre /2010 / in-

IT: a phonetically balanced, continuous speech, telephone band-

dex. html.

width speech database [C] / / Proceedings of the 1990 IEEE Inter-

[10] NGHIA P T, BINH P V, THAI N H, et al. A robust wavelet-

national Conference on Acoustics, Speech and Signal Processing.

based text-independent speaker identification [C] / / Proceedings of

Piscataway, NJ: IEEE, 1990: 109 - 112.

the 2007 International Conference on Computational Intelligence

[25]

SADJADI S O, SLANEY M, HECK L. MSR Identity Toolbox v1. 0:

and Multimedia Applications. Piscataway, NJ: IEEE, 2007: 219

a Matlab toolbox for speaker recognition research [EB / OL]. [2015-

- 223.

10- 17 ].

http: / / research. microsoft.

com / en-us / downloads /

[11] KUMAR P, CHANDRA M. Hybrid of wavelet and MFCC features

2476c44a-1f63-4fe0-b805-8c2de395bb2c / .

for speaker verification [C] / / Proceedings of the 2011 World Con-

[26] LI Q, HUANG Y. An auditory-based feature extraction algorithm

gress on Information and Communication Technologies. Piscataway,

for robust speaker identification under mismatched conditions [J].

NJ: IEEE, 2011: 1150 - 1154.

IEEE Transaction on Audio, Speech, and Language Processing,

[12] AI O C, HARIHARAN M, YAACOB S, et al. Classification of

2011, 19( 6) : 1791 - 1801.

speech dysfluencies with MFCC and LPCC features [ J ]. Expert

[27] LI Q, HUANG Y. Robust speaker identification using an auditory-

Systems with Applications, 2012, 39( 2) : 2157 - 2165.

based feature [C] / / Proceedings of the 2010 IEEE International

[13] YUAN Y J, ZHAO P H, ZHOU Q. Research of speaker recogni-

Conference on Acoustics, Speech and Signal Processing. Piscat-

tion based on combination of LPCC and MFCC [C] / / Proceedings

away, NJ: IEEE, 2010: 4514 - 4517.

of the 2010 IEEE International Conference on Intelligent Computing

and Intelligent Systems. Piscataway, NJ:

IEEE, 2010: 765 -

[28] 李作强,高勇. 基于 CFCC 和相 位 信 息 的 鲁 棒 性 说 话 人 辨 识

[J]. 计算 机 工 程 与 应 用,2015,51 ( 17 ) : 228 - 232. ( LI Z Q,

767.

GAO Y. Robust speaker identification based on CFCC and phase

[14] ZHOU H L, WANG J, WANG M C, et al. Amplitude spectrum

information [J]. Computer Engineering and Applications, 2015,

compensation and phase spectrum correction of seismic data based

51( 17) : 228 - 232. )

on the generalized S transform [J]. Applied Geophysics, 2014,11

( 4) : 468 - 478.

Background

[15] HUANG N T, ZHANG S X, CAI G W, et al. Power quality dis-

This work is partially supported by the National Natural Science Foun-

turbances recognition based on a multiresolution generalized S-

dation of China ( 61472168, 61262041) , the Key Project of National Natu-

transform and a PSO-improved decision tree [J]. Energies, 2015,

ral Science Foundation of Yunnan Province ( 2013FA030) .

8( 1) : 549 - 572.

WANG Haibin, born in 1988, M. S. candidate. His research inter-

[16] HARIHARAN M, VIJEAN V, SINDHU R, et al. Classification of

ests include speech signal processing, speech recognition.

mental tasks using Stockwell transform [J]. Computers and Electri-

YU Zhengtao, born in 1970, Ph. D. , professor. His research inter-

cal Engineering, 2014, 40( 5) : 1741 - 1749.

est including natural language processing, information retrieval, speech

[17] MOUKADEM A, DIETERLEN A, HUEBER N, et al. A robust

recognition.

heart sounds segmentation module based on S-transform [J]. Bio-

MAO Cunli, born in 1977, Ph. D. , lecturer. His research interest

medical Signal Processing and Control, 2012, 8( 3) : 273 - 281.

including natural language processing, information retrieval, speech recog-

[18] YIN B Q, HE Y G, WU X M. A method for magnetocardiograms

nition.

filtering based on singular value decomposition and S-transform

GUO Jianyi, born in 1964, M. S. , professor. Her research inter-

[J]. Acta Physica Sinica, 2013, 62( 14) : 148702.

ests include natural language processing, information retrieval, speech rec-

[19] GUO Y J, WEI Y D, ZHOU X J, et al. Impact feature extracting

ognition.

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc