第 42卷 第 4 期

2020 年4 月

电 子 与 信 息 学 报

Journal of Electronics & Information Technology

Vol. 42No. 4

Apr. 2020

基于深度学习的手语识别综述

张淑军* 张 群 李 辉

(青岛科技大学信息科学技术学院 青岛 266061)

摘 要:手语识别涉及计算机视觉、模式识别、人机交互等领域,具有重要的研究意义与应用价值。深度学习技

术的蓬勃发展为更加精准、实时的手语识别带来了新的机遇。该文综述了近年来基于深度学习的手语识别技术,

从孤立词与连续语句两个分支展开详细的算法阐述与分析。孤立词识别技术划分为基于卷积神经网络(CNN)、

3维卷积神经网络(3D-CNN)和循环神经网络(RNN) 3种架构的方法;连续语句识别所用模型复杂度更高,通常需

要辅助某种长时时序建模算法,按其主体结构分为双向长短时记忆网络模型、3维卷积网络模型和混合模型。归

纳总结了目前国内外常用手语数据集,探讨了手语识别技术的研究挑战与发展趋势,高精度前提下的鲁棒性和实

用化仍有待于推进。

关键词:深度学习;手语识别;卷积网络;循环神经网络;长时序建模

中图分类号:TP391

DOI: 10.11999/JEIT190416

文献标识码:A

文章编号:1009-5896(2020)04-1021-12

Review of Sign Language Recognition Based on Deep Learning

ZHANG Shujun ZHANG Qun LI Hui

(College of Information Science and Technology, Qingdao University of

Science and Technology, Qingdao 266061, China)

Abstract: Sign language recognition involves computer vision, pattern recognition, human-computer interaction,

etc. It has important research significance and application value. The flourishing of deep learning technology

brings new opportunities for more accurate and real-time sign language recognition. This paper reviews the sign

language recognition technology based on deep learning in recent years, formulates and analyzes the algorithms

from two branches - isolated words and continuous sentences. The isolated-word recognition technology is

divided into three structures: Convolutional Neural Network (CNN), Three-Dimensional Convolutional Neural

Network (3D-CNN) and Recurrent Neural Network (RNN) based method. The model used for continuous

sentence recognition has higher complexity and is usually assisted with certain kind of long-term temporal

sequence modeling algorithm. According to the major structure, there are three categories: the bidirectional

LSTM, the 3D convolutional network model and the hybrid model. Common sign language datasets at home

and abroad are summarized. Finally, the research challenges and development trends of sign language

recognition technology are discussed, concluding that the robustness and practicality on the premise of high-

precision still requires to be promoted.

Key words: Deep learning; Sign language recognition; Convolutional Neural Network (CNN); Recurrent Neural

Network (RNN); Long-term temporal sequence modeling

1 引言

手语是一种重要的人类肢体语言表达方式,包

含信息量多,是聋哑人和健听人之间沟通的主要方

收稿日期:2019-06-06;改回日期:2019-11-20;网络出版:2020-01-18

*通信作者: 张淑军 lindazsj@163.com

基金项目:国家自然科学基金(61702295, 61672305),山东省重点

研发计划项目(2017GGX10127)

Foundation Items: The National Natural Science Foundation of

China (61702295, 61672305), The Key Research & Development

Plan Project of Shandong Province (2017GGX10127)

式。手语识别涉及视频采集和处理、计算机视觉、

人机交互、模式识别、自然语言处理等多个研究领

域,是一项具有高难度的挑战性课题。手语识别技

术可用于手语翻译、日常交流、研发手语教学机器

人,促进手语教学、培训和推广,可以拓宽到其他

手势指令相关的领域,如交警手势识别、军事手势

识别及智能家电控制等。由于手语语义丰富、动作

幅度相比其他人体行为具有局部性和细节性,同时

又受到光照、背景、运动速度等影响,使用传统模

式识别或机器学习方法所能达到的精度与鲁棒性已

�

1022

电 子 与 信 息 学 报

第 42 卷

达到瓶颈期,往往局限于静态手势识别或粗粒度的

动态手势识别。自2006年Hinton等人[1]提出深度学

习方法以来,手语识别迎来了新的机遇。

手语识别是借助计算机自动将手语信号转换为

文本或语音的过程[2],其研究可以追溯到20世纪

90年代。根据手语获取方式的不同,分为基于数据

手套和基于视觉的手语识别,前者可以实时采集手

势的3维运动信息和时序变化,然后应用识别算法

进行处理,识别速度快,准确率高,但是设备复

杂,价格昂贵,且对操作者有约束,佩戴不方便,

因此基于视觉的手语识别成为主流。从历史沿革

上,又可分为传统识别方法和基于深度学习的研究

方法两大类,而从研究对象上又可分为孤立词和连

续语句。2016年之前,基于视觉的传统手语识别技

术研究较为广泛,详见文献[3]。传统方法能够解决

一定数据规模下的手语识别问题,但算法复杂、泛

化性不高,且面向的数据量与模式种类受限,无法

将人类对于手语的智能理解完全表述。因此,在当

前大数据飞速发展的时代背景下,基于深度学习、

挖掘人类视觉与认知规律的手语识别技术成为必

然。根据具体研究对象的不同,所采用的深度学习

网络和算法有所不同,一般从数据输入、网络架构

和融合方式3部分进行改进,其中网络架构对研究

工作的区分度较大,不同的网络架构可有相同或近

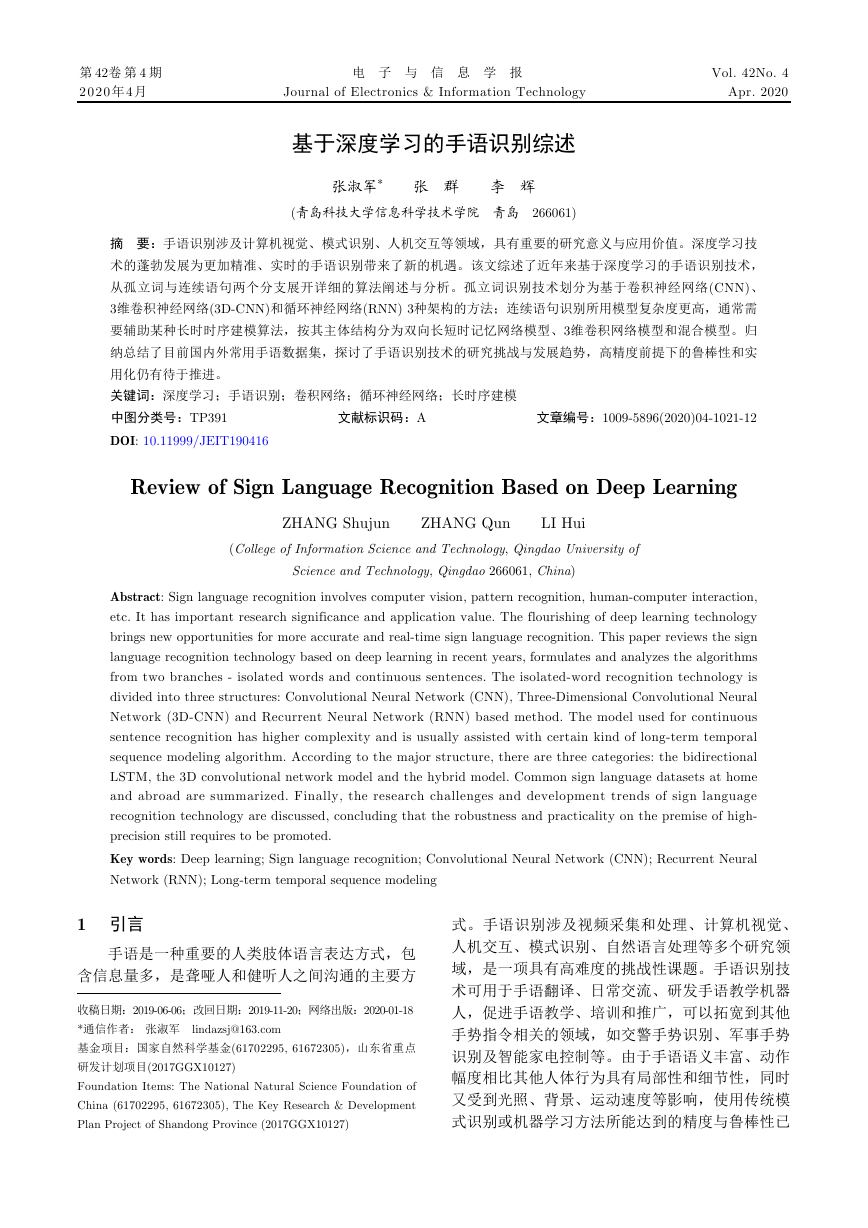

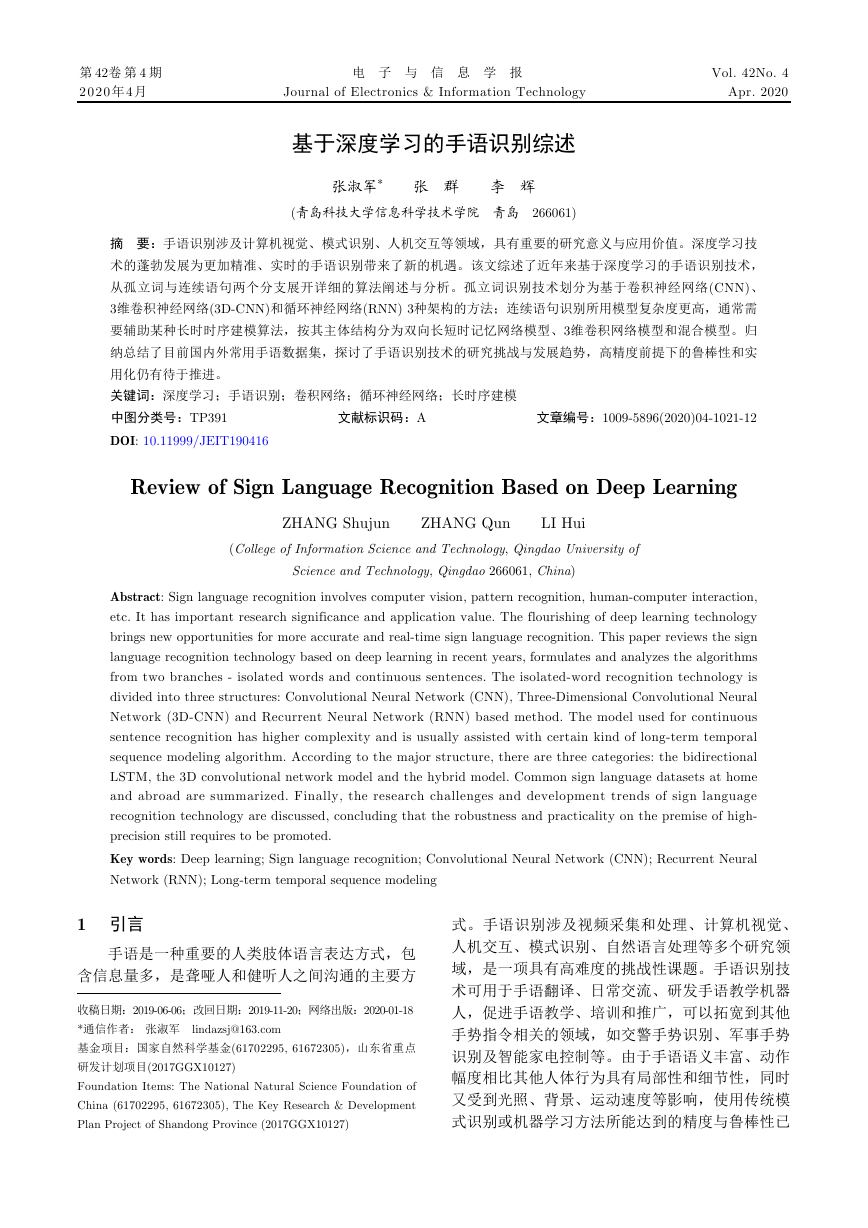

似的数据输入和融合方式。因此,本文的技术分类

主要立足于主干网络架构,总体分类如图1所示。

本文第2节与第3节将分别阐述基于深度学习的

孤立词手语识别与连续语句手语识别,第4节归纳

总结了目前国内外常用手语数据集及评估标准,最

后探讨了研究挑战与未来发展趋势。

2 基于深度学习的孤立词手语识别

孤立词手语识别的对象是以视频表达的单个孤

立手语词汇相对连续语句而言,孤立词手语视频时

长较短,语义简单明确,识别主要围绕如何更有效

地描述手语的底层特征、降低误判率展开。从时序

信息的处理上,将技术方法分为基于卷积神经网

络、3维卷积神经网络或循环神经网络3种网络的主

体框架。此方面的研究国内以中国科学院计算所、

中国科学院自动化所、中国科学技术大学、西安电

子科技大学等比较活跃,国外以亚琛工业大学、根

特大学等成果较多。

2.1 卷积神经网络

由于卷积神经网络(CNN)在深度学习网络中的

基础地位,自2013年至今一些研究团队进行了一系

列基于CNN的孤立词手语识别研究,主要是加入

多模态数据(包括深度、骨架、人体关键点等)、关

注手部姿态特征、特征融合(卷积层的特征集合)等

相关优化策略,实现了较好的识别效果。

数据输入主要涉及进入网络之前数据层的融

合,该融合方式对于数据集的依赖性较强,预处理

较为复杂,但也一定程度上提高了识别准确率。文

献[4–7]提出基于多模态数据、利用多尺度捕获各层

级图像特征的CNN网络自动学习手部图像特征的

手语识别方法。关注手部姿态特征是手语识别中较

为主要的特征设计部分,文献[8,9]提出了一种重点

关注手型变化的CNN网络用于手语识别,将手型

特征送入一个端到端的弱监督分类框架完成识别,

并能对小规模孤立词手语数据集进行实时识别。联

合目标检测网络对手部进行检测跟踪也是近年来手

语识别研究中一个较为主要的方法,通过对手部检

测跟踪,更好地定位手部。Kim等人[10,11]通过目标

检测网络对手部关键特征进行ROI分割预处理,并

联合原始手语视频特征送入CNN网络,在准确率

提高的同时训练时间也减少了一半。Kopuklu等

人[12]在CVPR2018会议上提出了一种将运动信息融

合到静态图像的数据级融合策略,并将融合后的时

空特征送入到CNN网络用于后续分类,取得了较

好的识别效果。手部关节点及全身骨架数据为手语

图 1 总体分类图

�

第 4 期

张淑军等:基于深度学习的手语识别综述

1023

视频特征的提取起到辅助作用,Konstantinidis等

人[13]提出了一种从RGB手语视频序列提取手部和

全身骨架数据的手语识别方法,Devineau等人[14]提

出了一种基于手部骨架数据的CNN用于3维动态手

势的识别,采用并行卷积处理手部骨骼关节的位置

序列,提取手部关节点,取得了较高的识别精度。

2.2 3维卷积网络

CNN虽具有较强的特征提取能力,但仅限于

单帧图像数据的输入,手语识别还需要辅助一些挖

掘 帧 间 相 关 性 的 方 法 ,3维 卷 积 神 经 网 络( 3 D -

CNN)应运而生。3D-CNN可以同时对视频级的手

语时空特征建模,以捕捉从多个连续帧得到的运动

信息,实现更具全局意义的识别。

不 同 融 合 方 式 、 时 空 注 意 力 机 制 以 及 双 流

3D-CNN是基于3维卷积网络手语识别研究的3大突

破点。不同于数据融合方式,特征融合是对多模态

数据进行特征提取后的卷积层融合,该融合方式使

用较多。随着近几年注意力机制在分类任务中的应

用,3D-CNN中加入注意力机制的思想也越来越多,

时空注意力机制能捕捉手语视频中最为重要的手语

动作,获得较高的识别精度。双流3D-CNN是一种

两路的网络组织形式,通过构建双流3D-CNN,

实现对两路分类结果的得分融合。NVIDIA研究院

Molchanov等人[15]在CVPR2015会议上首次提出了

将3D-CNN用于动态手势识别,将多尺度数据作为

网络输入,构建两路子网络用于提取手势的时空特

征集合,最后对两路分类结果进行得分融合,在自

动驾驶场景中实现了较好的识别效果。Wu等人[16]

提出了一种基于多通道数据融合的3D-CNN用于动

态手势识别,将RGB和深度数据堆叠并入一路送

入3D-CNN,引入HMM模型进行短时序建模,在

Charlearn数据集取得了不错的识别结果。

中国科学技术大学Huang等人[17,18]于2015年针

对数据融合问题提出了一种基于多模态数据输入的

3D-CNN网络。2018年又提出一种基于时空注意力

机制的3D-CNN网络用于大词汇量的手语识别,在

训练3D-CNN捕捉时空特征时,将空间注意力融入

网络,聚焦感兴趣的手部特征,特征提取后,利用

时间注意机制进行重要手语动作的分类。西安电子

科技大学近几年对于手语识别的一系列研究都是围

绕3D-CNN展开的,在多模态数据输入、数据增

强及关键帧的选取等方面都取得了显著的研究成

果,在2016年、2017年Chalearn LAP国际大规模

独立手势识别竞赛中名列前茅。文献[19–21]在

ICPR2016上,提出了一种基于3D-CNN网络和大

规模RGB-D数据的手势识别算法,将RGB和深度

视频分别送入到C3D模型中提取时空特征,最后用

SVM进行分类,次年在Chalearn手势比赛中以

56.9%的准确率取得第1名。在TCSVT2017上Miao

等人[21]提出了一种将显著性特征与3D-CNN结合的

手势识别框架,利用频域变换生成的显著图增强手

部特征,在Chalearn数据集上识别精度达到59.43%。

同年,他们在ICCV上提出了一种基于ResC3D网络

的手势识别方法,其关键思想是找到一种紧凑而有

效的视频序列表示方法,采用神经网络和中值滤波

等视频增强技术来消除输入视频中的光照变化和噪

声,并采用加权帧一致策略对关键帧进行采样。在

此基础上,结合3D残差网络,提出了一种基于正

则相关分析的特征融合方法用于视频特征的提取,

在Chalearn数据集上准确率达到67.71%。

ElBadawy等人[22]提出了一种仅由RGB数据输

入的3D-CNN网络用于阿拉伯手语孤立词的识别,

并将其研发为手语识别系统,实现了一定识别率前

提下的应用。Ye等人[23]提出了一种捕获手语视频

片段中时间和空间信息的3DRCNN网络模型,能

够识别和定位不同视频长度的语义信息,提升了识

别精度。Liang等人[24]提出了一种基于多模态数据

和3D-CNN网络的手语识别算法,并对多种数据进

行卷积融合,在大规模数据集上验证了其有效性,

但是在大多仅由RGB数据组成的手语数据集上泛

化性不高。

2.3 循环神经网络

相比于以上所述的两种网络架构,循环神经网

络(RNN)是一类用于处理序列数据的神经网络,更

善于捕捉长时间的上下文语义信息。因此,近年来

基于循环神经网络进行手语识别的研究也很广泛。

Cate等人[25]利用RNN对手语视频特征进行时

序建模,实现了对95类手语孤立词的识别。Chai等

人[2 6]于2016年提出了一种双流的RNN网络(2S-

RNN),首先将连续手势分割成孤立手势,将RGB

数据用于网络的一路输入,并提取骨架数据和梯度

直方图特征,然后将提取的特征融合送入另一路

RNN网络,两路网络进行得分融合,在当年Chalearn

手势识别挑战赛中排名第一。

中国科学技术大学于2016年起基于RNN网络

进行了一系列手语识别的研究,主要是加入轨迹数

据、骨架关节点数据、建立手型描述符以及关键帧

筛选等方法。文献[27]针对手工设计特征的不确定

性,将用于表示上下文信息的长短时记忆(LSTM)

网络加入到手语识别的研究中,并将4个骨架关节

点的运动轨迹作为网络输入,在中国孤立词手语数

据集上取得了不错的识别效果。针对手语识别的单

�

1024

电 子 与 信 息 学 报

第 42 卷

一数据输入问题,Li等人[28]于2017年提出了新的手

型描述符,并对这些描述符进行基于LSTM的时序

建模,在100类中国手语孤立词上实现了准确的识

别结果,但是骨架数据的获取比较困难。Huang等

人[29]于2018年针对冗余信息影响识别精度的问题,

提出了基于关键帧视频序列的手语识别算法,将关

键帧算法嵌入到RNN网络中,从而允许对输入数

据进行不同关注,取得了显著的识别效果。北京工

业大学于2017年对中国手语识别进行了相关研究,

主要是利用RNN对手语视频进行时序建模,在自

己构建的数据集上取得了不错的识别效果。Yang

等人[3 0,3 1]提出了将CNN与LSTM相结合,并将

RGB和光流数据作为两路输入,最后进行全连接

层的融合,输出分类结果。在构建的小规模手语数

据集上进行了评估,并满足小规模手语识别系统的

实时性要求。

Lin等人[32]于2018年提出了一种将带有掩膜的

Res-C3D网络和用于骨架数据建模的LSTM网络相

结合,同时处理RGB-D视频数据,在Chalearn数

据集上取得了68.42%的识别精度,本文将分割算法

与分类网络结合在一起用于手语识别的研究,提高

了识别精度,但是前期掩码的建立过程较为耗时。

Halim等人[33]提出一种基于SIBI词形变化的双向

RNN网络,用于印尼语词根孤立词的识别,并将

识 别 模 型 扩 展 到 多 个 设 备 , 可 拓 展 性 较 强 。 文

献[34]和文献[35]提出了一种基于Inception模型的

RNN网络用于手语识别。Konstantinidis等人[36]提

出了基于RGB和骨架数据的RNN网络的手语识别

框架,并将脸部表情融入到手语特征中,探讨分析

了不同的数据融合方案,验证了骨架数据对于手语

识别的鲁棒性。文献[37]将CNN和LSTM结合用于

美国手语孤立词的识别,并利用一种缩放、平滑等

的数据增强技术来改进网络模型的泛化性。Liao等

人[38]于2019年提出了一种基于BLSTM网络的手语

识别框架,首先使用检测网络对手部进行分割,然

后将分割后的手部特征与原始RGB数据一起送入

到LSTM,实现动态长时序特征建模,最后输出分

类结果,实现了在两个大型中国手语孤立词数据集

上的准确识别。

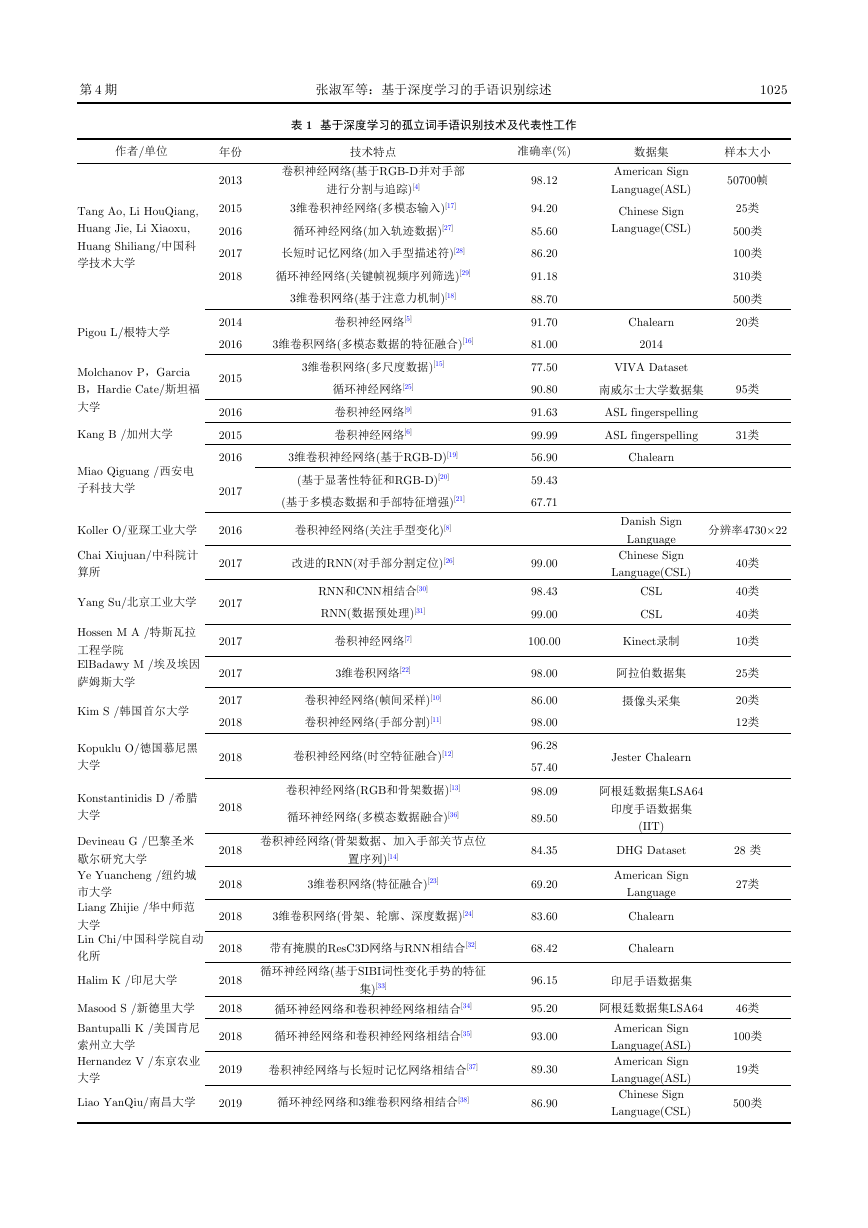

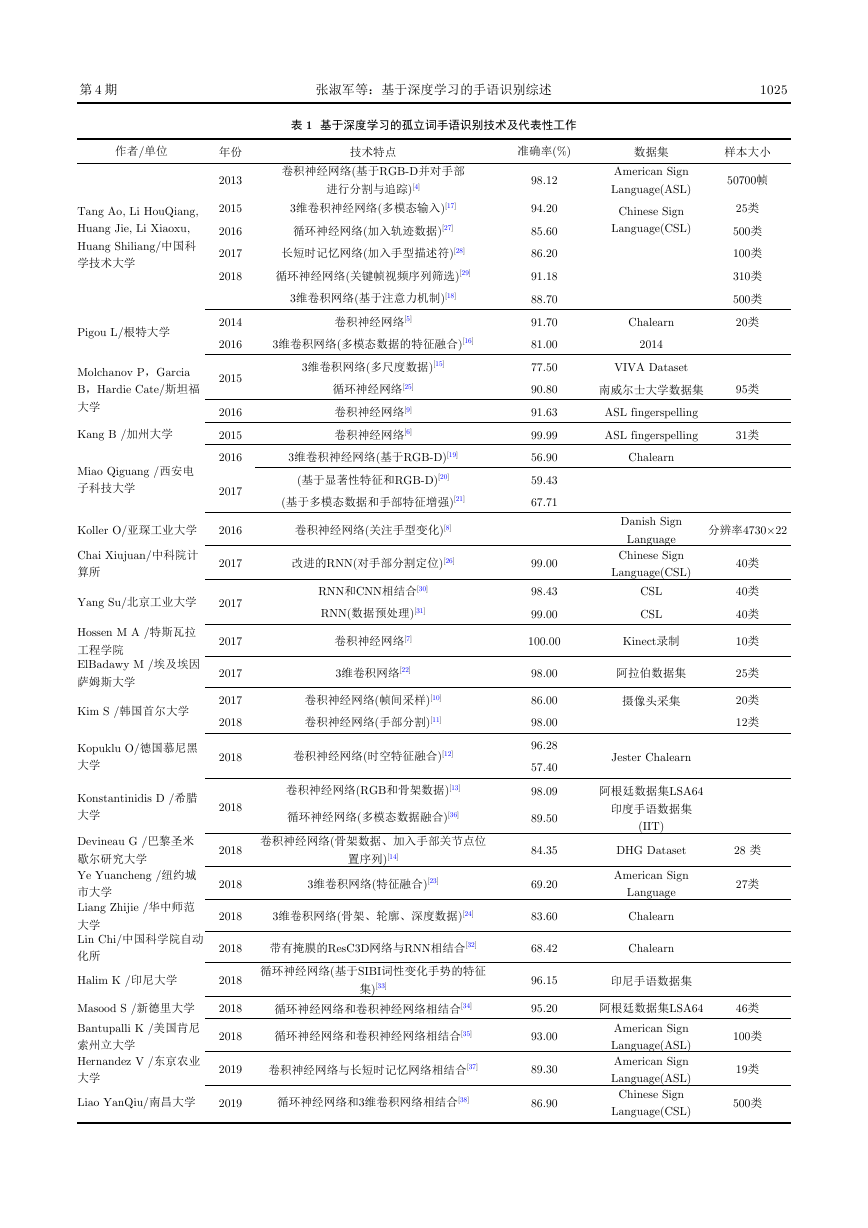

基于深度学习的孤立词手语识别技术及代表性

工作如表1所示。

3 基于深度学习的连续语句手语识别

相比于孤立词手语识别,连续语句的识别需要

建立更为可靠的长期时序依赖。最初的连续语句识

别是在单个孤立词识别的基础上进行研究,需要用

到时序分割的相关算法,但由于时序分割过程复

杂、误判率高等问题,近年来学者们逐渐绕开了时

序分割,将语音识别的时序对齐算法及编解码网络

用于本领域的研究,其中包括基于CTC时序算法

和用于长时序建模的编解码网络,在此基础上实现

连续语句的手语识别。

3.1 双向长短时记忆网络模型

连续语句的手语识别更为复杂,长期的时序

性要求更强,而近年来由于双向长短时记忆网络

(BLSTM)能更好地对手语长时序序列进行上下文

语义信息的建模,因此较为广泛地应用于连续语句

手语识别的研究。

亚琛工业大学Camgoz等人[39]在ICCV2017会议

上提出了一种利用BLSTM网络来解决端到端的手

语识别问题,将LSTM分解为一系列子网络,然后

对这些子网络之间进行基于BLSTM网络的时序关

系建模,并将用于语音识别的CTC算法用于本研

究任务,在RWTH数据集上实现了不错的效果。

本方法借鉴语音识别的时间连接时序分类(CTC)算

法用于手语连续语句识别的标签对齐,绕开了时序

分割,提高了识别精度,但是算法实现较为复杂。

清 华 大 学Cui等 人[4 0]于2018年 提 出 了 一 种 基 于

BLSTM的手语识别框架,并融入光流、RGB-D数

据,在基准的连续语句手语数据集上取得了不错的

效果。Shi等人[41]于2018年提出了一种在低帧率和

视角不同条件下的基于注意力的LSTM网络用于连

续手语识别,在美国连续手语数据集上取得了较好

的效果。此算法对于数据集的泛化性较强,可以接

受多视角下的数据,识别效果较好。Ko等人[42]提

出了一种基于LSTM的人体关键点检测的手语识别

方法,利用人脸、手部和身体部位提取人体关键

点,开发了一套手语识别系统,提取的人体关键点

向量通过关键点的均值进行标准化,然后将提取的

关键点特征输入到LSTM网络中。结果表明了其识

别算法的鲁棒性。Zhang等人[43]、Mittal等人[44]提

出一种改进的BLSTM模型,用于连续手语句子的

识别。该方法将连续句子分解为单词向量,在连续

语句的手语数据集上实现了准确的识别结果。

3.2 3维卷积网络模型

相比于BLSTM网络模型的复杂度,基于3维卷

积网络模型的连续手语识别避开了BLSTM网络的

复杂建模,在同样能进行时序建模的基础上节省了

复杂的计算量。

亚琛工业大学Camgoz等人[45]提出了一种基于

3维卷积神经网络的连续手语识别模型,该网络通

过3维卷积,从RGB数据中提取时空相关特征,通

�

第 4 期

张淑军等:基于深度学习的手语识别综述

1025

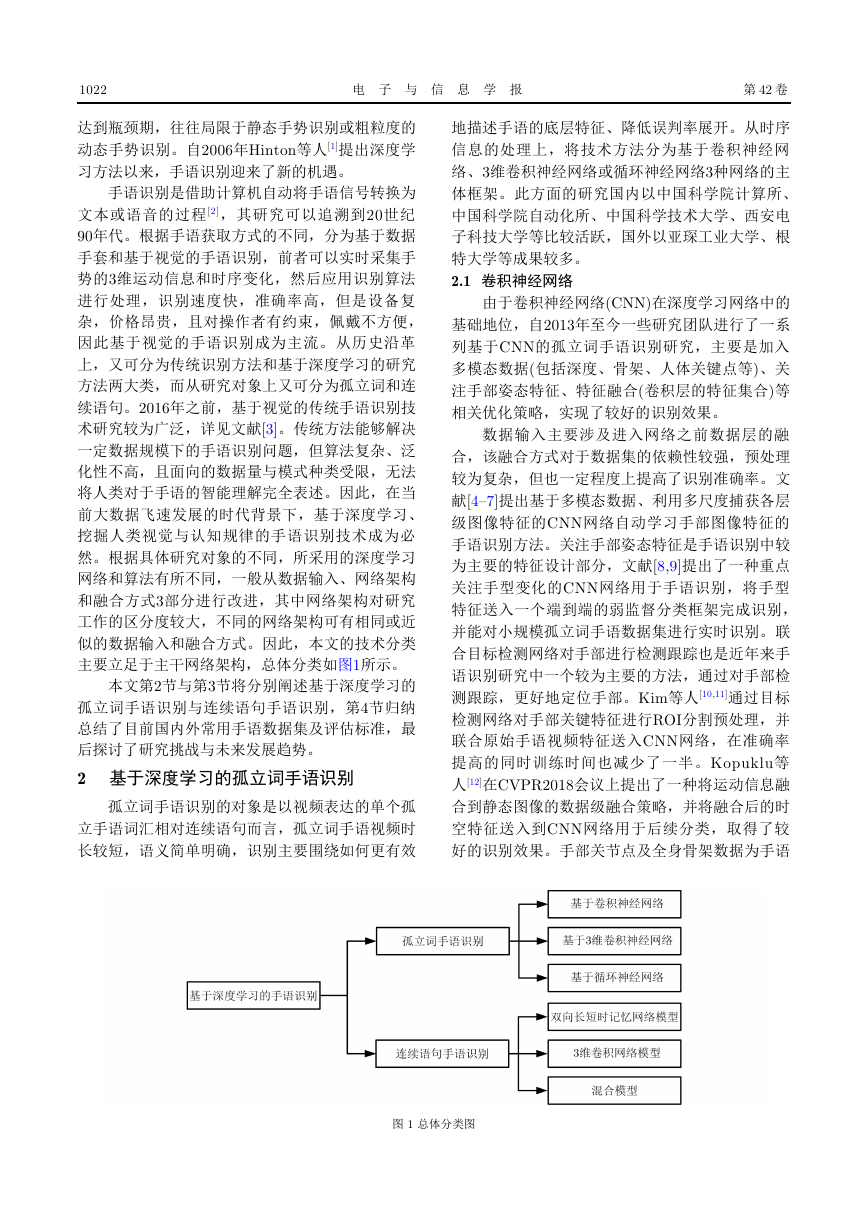

表 1 基于深度学习的孤立词手语识别技术及代表性工作

技术特点

准确率(%)

数据集

样本大小

98.12

94.20

85.60

86.20

91.18

88.70

91.70

81.00

77.50

90.80

91.63

99.99

56.90

59.43

67.71

99.00

98.43

99.00

100.00

98.00

86.00

98.00

96.28

57.40

98.09

89.50

84.35

69.20

83.60

68.42

96.15

95.20

93.00

89.30

86.90

American Sign

Language(ASL)

Chinese Sign

Language(CSL)

Chalearn

2014

VIVA Dataset

50700帧

25类

500类

100类

310类

500类

20类

南威尔士大学数据集

95类

ASL fingerspelling

ASL fingerspelling

31类

Chalearn

分辨率4730×22

40类

40类

40类

10类

25类

20类

12类

28 类

27类

Danish Sign

Language

Chinese Sign

Language(CSL)

CSL

CSL

Kinect录制

阿拉伯数据集

摄像头采集

Jester Chalearn

阿根廷数据集LSA64

印度手语数据集

(IIT)

DHG Dataset

American Sign

Language

Chalearn

Chalearn

印尼手语数据集

阿根廷数据集LSA64

46类

American Sign

Language(ASL)

American Sign

Language(ASL)

Chinese Sign

Language(CSL)

100类

19类

500类

作者/单位

Tang Ao, Li HouQiang,

Huang Jie, Li Xiaoxu,

Huang Shiliang/中国科

学技术大学

Pigou L/根特大学

Molchanov P,Garcia

B,Hardie Cate/斯坦福

大学

Kang B /加州大学

Miao Qiguang /西安电

子科技大学

年份

2013

2015

2016

2017

2018

2014

2016

2015

2016

2015

2016

2017

卷积神经网络(基于RGB-D并对手部

进行分割与追踪)[4]

3维卷积神经网络(多模态输入)[17]

循环神经网络(加入轨迹数据)[27]

长短时记忆网络(加入手型描述符)[28]

循环神经网络(关键帧视频序列筛选)[29]

3维卷积网络(基于注意力机制)[18]

卷积神经网络[5]

3维卷积网络(多模态数据的特征融合)[16]

3维卷积网络(多尺度数据)[15]

循环神经网络[25]

卷积神经网络[9]

卷积神经网络[6]

3维卷积神经网络(基于RGB-D)[19]

(基于显著性特征和RGB-D)[20]

(基于多模态数据和手部特征增强)[21]

Koller O/亚琛工业大学 2016

卷积神经网络(关注手型变化)[8]

Chai Xiujuan/中科院计

算所

2017

改进的RNN(对手部分割定位)[26]

Yang Su/北京工业大学 2017

RNN和CNN相结合[30]

RNN(数据预处理)[31]

卷积神经网络[7]

3维卷积网络[22]

卷积神经网络(帧间采样)[10]

卷积神经网络(手部分割)[11]

卷积神经网络(时空特征融合)[12]

卷积神经网络(RGB和骨架数据)[13]

循环神经网络(多模态数据融合)[36]

卷积神经网络(骨架数据、加入手部关节点位

置序列)[14]

3维卷积网络(特征融合)[23]

3维卷积网络(骨架、轮廓、深度数据)[24]

2017

2017

2017

2018

2018

2018

2018

2018

2018

2018

带有掩膜的ResC3D网络与RNN相结合[32]

2018

2018

2018

2019

循环神经网络(基于SIBI词性变化手势的特征

集)[33]

循环神经网络和卷积神经网络相结合[34]

循环神经网络和卷积神经网络相结合[35]

卷积神经网络与长短时记忆网络相结合[37]

Hossen M A /特斯瓦拉

工程学院

ElBadawy M /埃及埃因

萨姆斯大学

Kim S /韩国首尔大学

Kopuklu O/德国慕尼黑

大学

Konstantinidis D /希腊

大学

Devineau G /巴黎圣米

歇尔研究大学

Ye Yuancheng /纽约城

市大学

Liang Zhijie /华中师范

大学

Lin Chi/中国科学院自动

化所

Halim K /印尼大学

Masood S /新德里大学

Bantupalli K /美国肯尼

索州立大学

Hernandez V /东京农业

大学

Liao YanQiu/南昌大学 2019

循环神经网络和3维卷积网络相结合[38]

�

1026

电 子 与 信 息 学 报

第 42 卷

过汇聚每层提取的特征进行时空不变性编码。在

Chalearn2016手势识别挑战赛和德国手语数据集上

都 达 到 了 较 高 的 识 别 精 度 。 中 国 科 学 技 术 大 学

Pu等人[46]于2018年提出了一种基于3维残差网络和

膨胀卷积网络的连续语句手语识别框架,并提出了

一种基于CTC算法的迭代优化策略,在德国基准

数据集上证明了此方法的有效性和优越性。针对以

往研究工作的不足,Huang等人[47]在AAAI2018会

议上提出了一种新的无需时间分割且带有潜在空间

的分层注意力网络(LS-HAN)用于手语识别,将双

流3维卷积神经网络用于连续语句的识别中,并设

计分析了不同联合损失函数对识别的影响,在中国

手语数据集上验证了其方法的有效性。同年Wang

等人[48]提出了一种由时域卷积模块、双向递归单元

模块和融合层模块组成的混合深层结构,设计了一

种基于CTC损失的联合优化方法和一种基于深度

分类分数的融合策略来生成最终的语句,通过融合

时域卷积模块捕获的邻近视频片段特征上的短期时

序信息和递归单元模块跨时间维度上的长期上下文

时序信息,得到了很好的识别效果,但是网络架构

较为复杂,对硬件以及时间的要求比较高。

3.3 混合模型

相对于以上两种主干网络模型架构,基于混合

网络模型的连续语句手语识别研究最为广泛,充分

利用了卷积神经网络的特征提取能力和循环神经网

络时序分类优势,实现更为准确的识别。

Koller等人[49]为代表的德国亚琛工业大学在

2009~2012年基于德国手语数据集进行了一系列的

连续手语识别的研究,并在2016年联合萨里大学提

出了一种基于CNN和HMM的混合模型用于德国连

续手语的识别,在两个公开的大规模基准手语数据

集上取得了很好的识别效果,但是容易过拟合。针

对数据过拟合问题,他们于2017年提出了一种基于

CNN+BLSTM+HMM混合模型,用于连续手语识

别的研究[50],该文提出了一种迭代的重新对齐方法

用于解决视频序列和标签的对应关系,首先是用

CNN+BLSTM训练一个初始化模型,然后通过提

出的Re-alignment算法不断进行参数调整,最后接

入HMM模型用于分类结果的输出。并于2018年发

表在计算机视觉国际期刊上[51],实现了手语连续语

句的自动识别。

Pigou等人[52]在ICCV2017会议上提出了一种将

3维残差网络与LSTM相结合用于连续手语的识

别,在ChaLearn手势识别大赛中取得了优异的成

绩。Cui等人[53]在CVPR2017会议上针对视频序列

和标签序列的对齐问题,提出了一种基于CNN+

BLSTM+CTC+DetectionNet网络的连续手语识别

3阶 段 优 化 模 型 。Ariesta等 人[5 4]提 出 了 将3D-

CNN与RNN网络相结合,用于视频级的连续手语

识别,3D-CNN从图像帧中提取特征,双向RNN从

视频帧的序列行为中提取时序特征。Guo等人[55]于

AAAI2018会议上提出了一种分层的HLSTM编解

码模型,通过传输帧、剪辑和视素单元之间的时空

转换来处理不同粒度的手语识别。首先利用3维卷

积网络挖掘视频片段的时空特征,然后利用自适应

可变长在线关键片段挖掘方法选取关键帧序列,并

提出了一种时间注意加权机制来平衡视频时序位置

之间的内在关系。最后,利用两层LSTM进行解码

网络。该算法既保留了原始视频特征,又得到了高

级特征,在中国手语数据集中取得了不错的识别效

果,但模型复杂,不易实现。

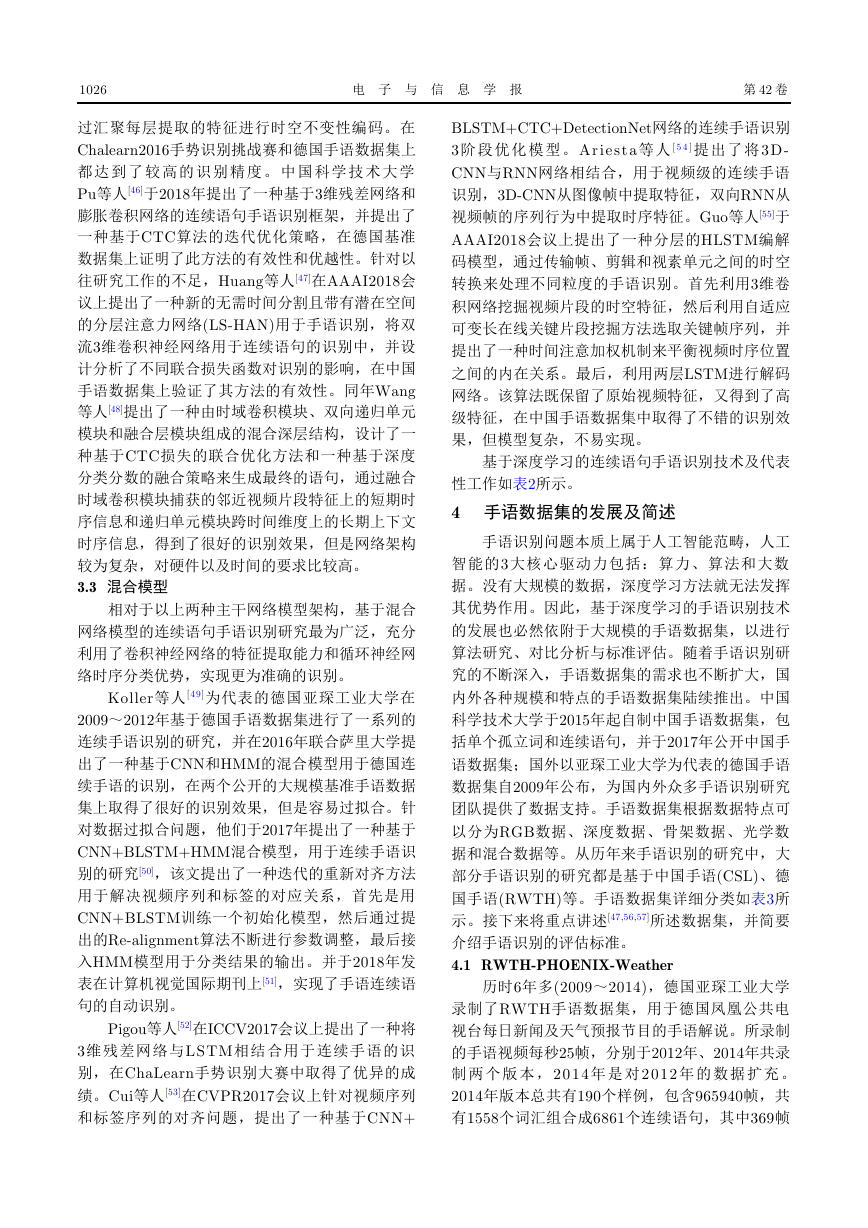

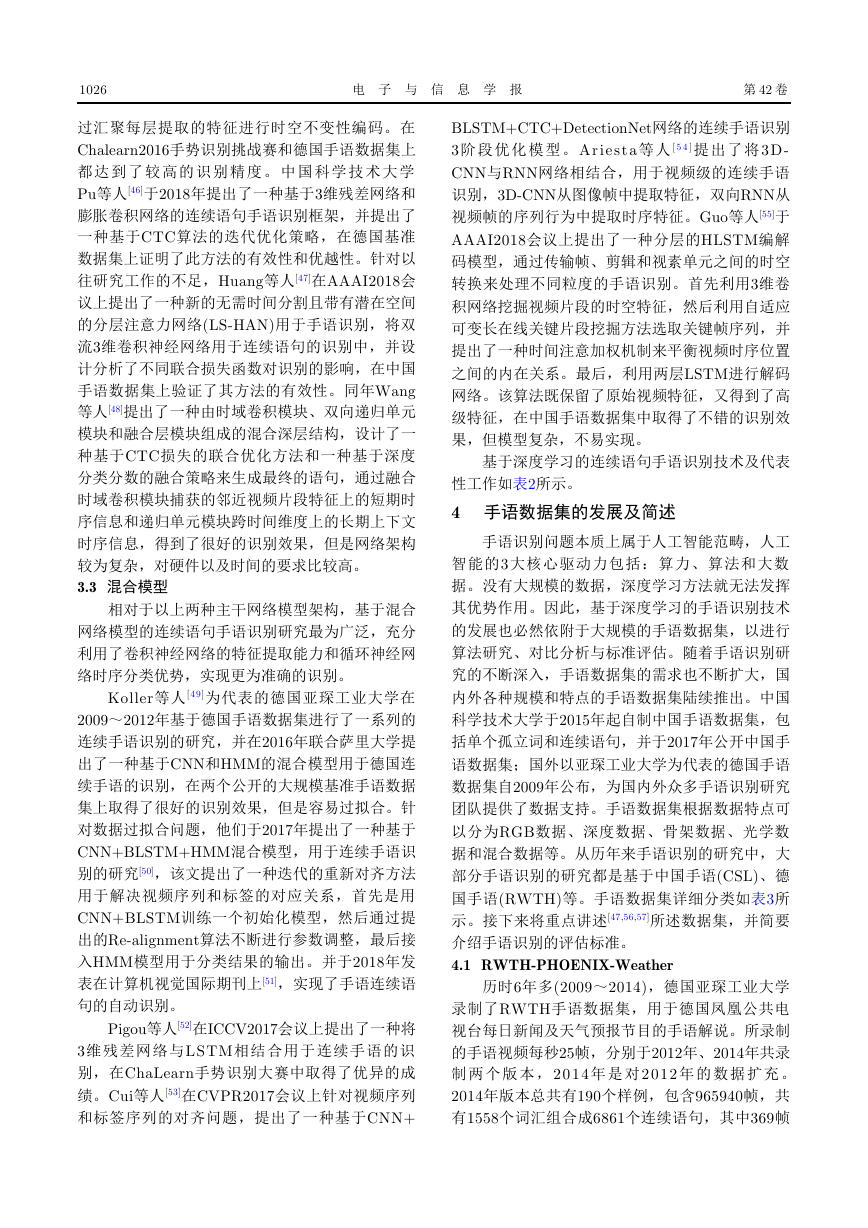

基于深度学习的连续语句手语识别技术及代表

性工作如表2所示。

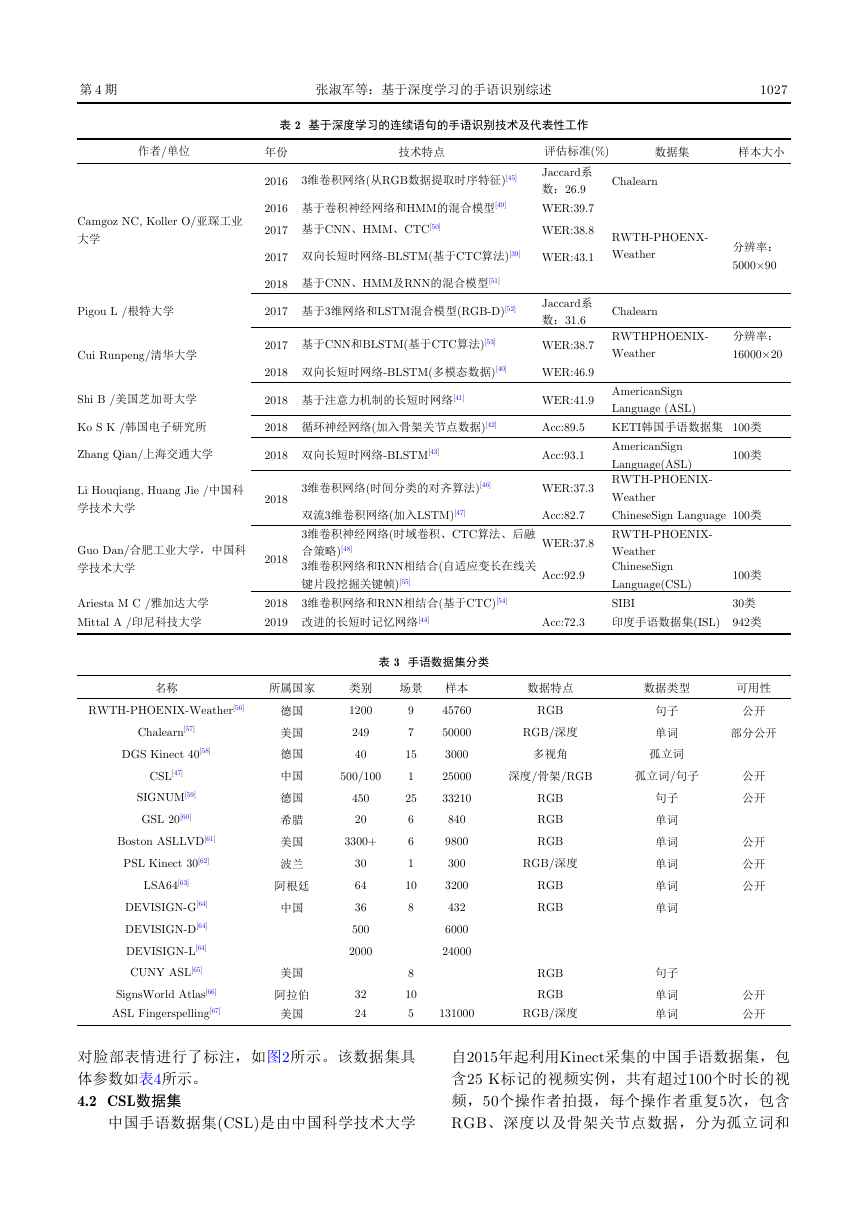

4 手语数据集的发展及简述

手语识别问题本质上属于人工智能范畴,人工

智能的3大核心驱动力包括:算力、算法和大数

据。没有大规模的数据,深度学习方法就无法发挥

其优势作用。因此,基于深度学习的手语识别技术

的发展也必然依附于大规模的手语数据集,以进行

算法研究、对比分析与标准评估。随着手语识别研

究的不断深入,手语数据集的需求也不断扩大,国

内外各种规模和特点的手语数据集陆续推出。中国

科学技术大学于2015年起自制中国手语数据集,包

括单个孤立词和连续语句,并于2017年公开中国手

语数据集;国外以亚琛工业大学为代表的德国手语

数据集自2009年公布,为国内外众多手语识别研究

团队提供了数据支持。手语数据集根据数据特点可

以分为RGB数据、深度数据、骨架数据、光学数

据和混合数据等。从历年来手语识别的研究中,大

部分手语识别的研究都是基于中国手语(CSL)、德

国手语(RWTH)等。手语数据集详细分类如表3所

示。接下来将重点讲述[47,56,57]所述数据集,并简要

介绍手语识别的评估标准。

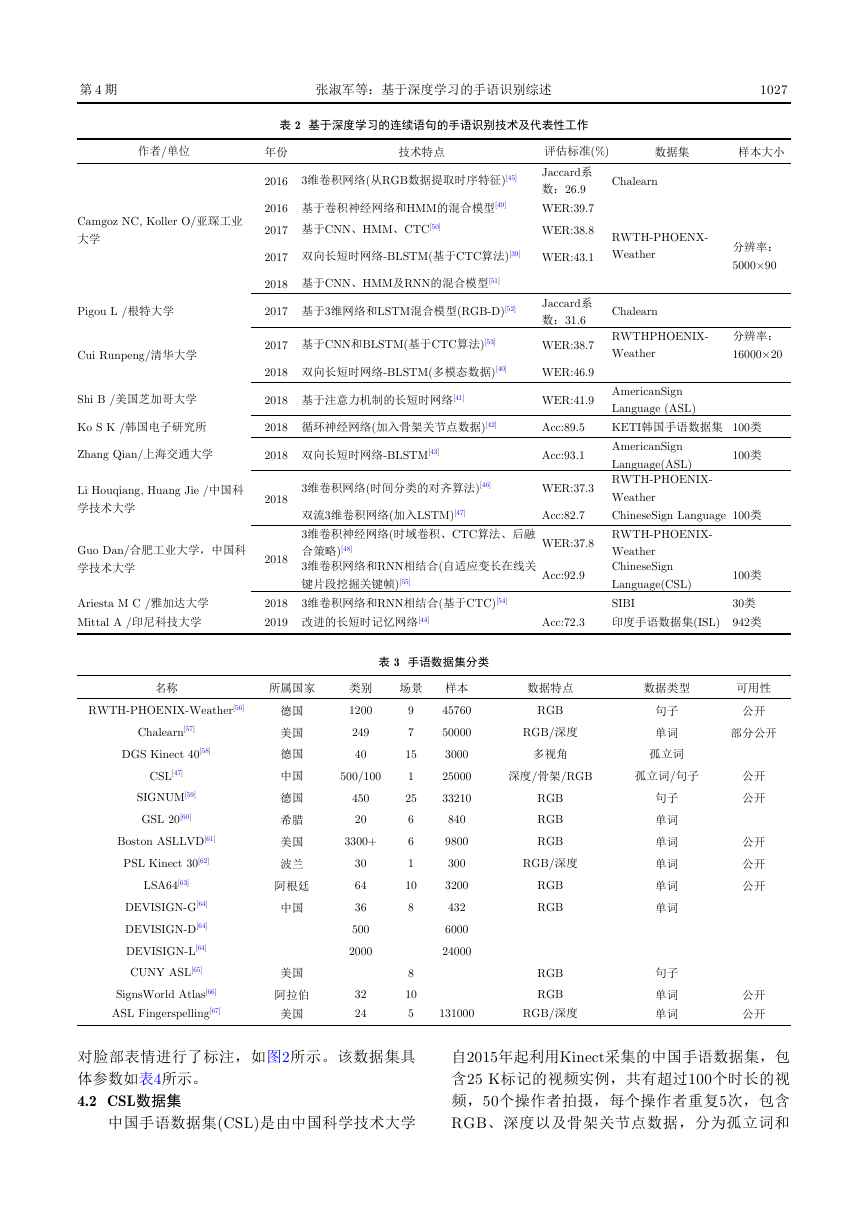

4.1 RWTH-PHOENIX-Weather

历时6年多(2009~2014),德国亚琛工业大学

录制了RWTH手语数据集,用于德国凤凰公共电

视台每日新闻及天气预报节目的手语解说。所录制

的手语视频每秒25帧,分别于2012年、2014年共录

制 两 个 版 本 ,2014年 是 对2012年 的 数 据 扩 充 。

2014年版本总共有190个样例,包含965940帧,共

有1558个词汇组合成6861个连续语句,其中369帧

�

第 4 期

张淑军等:基于深度学习的手语识别综述

1027

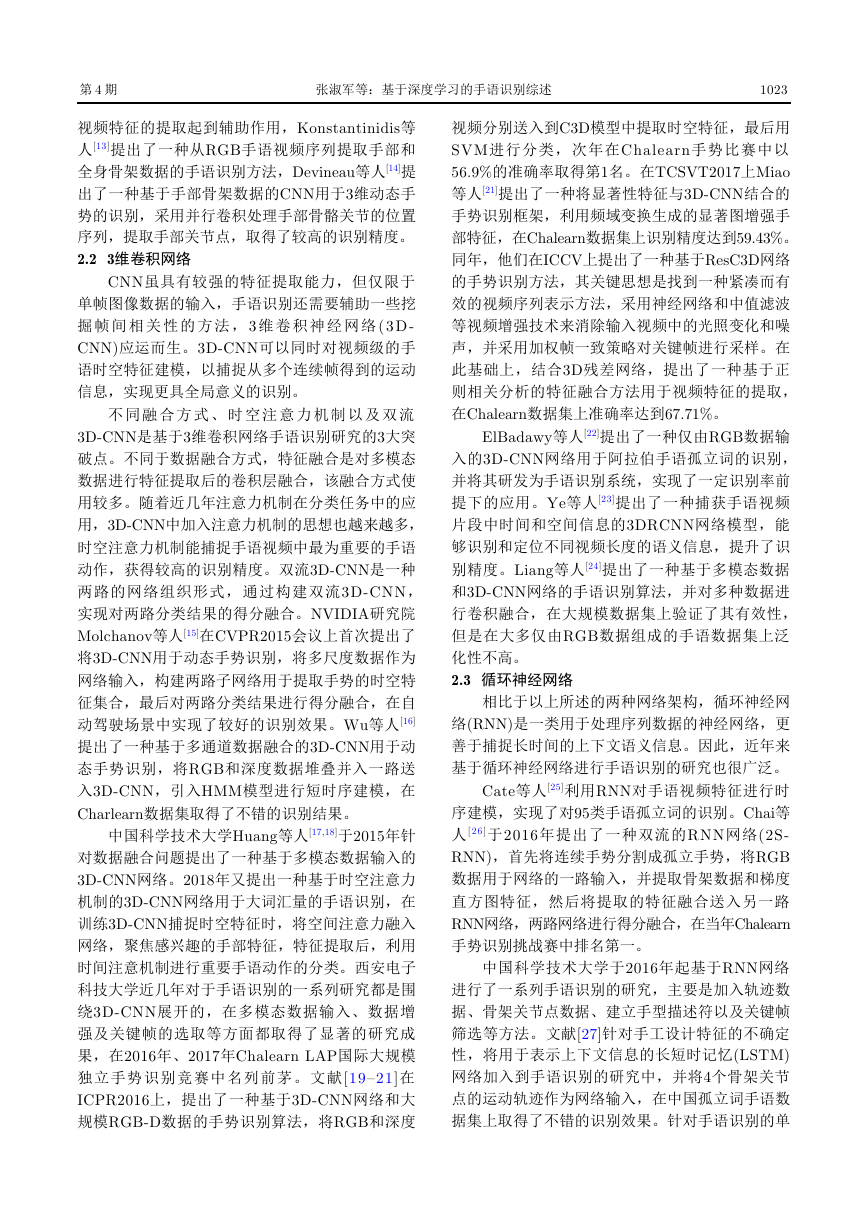

表 2 基于深度学习的连续语句的手语识别技术及代表性工作

作者/单位

年份

技术特点

评估标准(%)

数据集

样本大小

Camgoz NC, Koller O/亚琛工业

大学

2016

3维卷积网络(从RGB数据提取时序特征)[45]

2016 基于卷积神经网络和HMM的混合模型[49]

2017 基于CNN、HMM、CTC[50]

Jaccard系

数:26.9

WER:39.7

WER:38.8

2017 双向长短时网络-BLSTM(基于CTC算法)[39] WER:43.1

2018 基于CNN、HMM及RNN的混合模型[51]

Chalearn

RWTH-PHOENX-

Weather

分辨率:

5000×90

Pigou L /根特大学

2017 基于3维网络和LSTM混合模型(RGB-D)[52]

Cui Runpeng/清华大学

2017 基于CNN和BLSTM(基于CTC算法)[53]

Jaccard系

数:31.6

WER:38.7

Chalearn

RWTHPHOENIX-

Weather

分辨率:

16000×20

2018 双向长短时网络-BLSTM(多模态数据)[40]

WER:46.9

Shi B /美国芝加哥大学

2018 基于注意力机制的长短时网络[41]

WER:41.9

Ko S K /韩国电子研究所

2018 循环神经网络(加入骨架关节点数据)[42]

Zhang Qian/上海交通大学

2018 双向长短时网络-BLSTM[43]

Acc:89.5

Acc:93.1

Li Houqiang, Huang Jie /中国科

学技术大学

2018

Guo Dan/合肥工业大学,中国科

学技术大学

2018

3维卷积网络(时间分类的对齐算法)[46]

WER:37.3

双流3维卷积网络(加入LSTM)[47]

3维卷积神经网络(时域卷积、CTC算法、后融

合策略)[48]

3维卷积网络和RNN相结合(自适应变长在线关

键片段挖掘关键帧)[55]

3维卷积网络和RNN相结合(基于CTC)[54]

Acc:82.7

WER:37.8

Acc:92.9

Acc:72.3

Ariesta M C /雅加达大学

Mittal A /印尼科技大学

2018

2019 改进的长短时记忆网络[44]

100类

AmericanSign

Language (ASL)

KETI韩国手语数据集 100类

AmericanSign

Language(ASL)

RWTH-PHOENIX-

Weather

ChineseSign Language 100类

RWTH-PHOENIX-

Weather

ChineseSign

Language(CSL)

SIBI

印度手语数据集(ISL)

30类

942类

100类

表 3 手语数据集分类

场景 样本

数据特点

数据类型

可用性

RGB

RGB/深度

多视角

句子

单词

孤立词

公开

部分公开

深度/骨架/RGB

孤立词/句子

句子

单词

单词

单词

单词

单词

句子

单词

单词

公开

公开

公开

公开

公开

公开

公开

名称

所属国家

RWTH-PHOENIX-Weather[56]

Chalearn[57]

DGS Kinect 40[58]

CSL[47]

SIGNUM[59]

GSL 20[60]

Boston ASLLVD[61]

PSL Kinect 30[62]

LSA64[63]

DEVISIGN-G[64]

DEVISIGN-D[64]

DEVISIGN-L[64]

CUNY ASL[65]

SignsWorld Atlas[66]

ASL Fingerspelling[67]

德国

美国

德国

中国

德国

希腊

美国

波兰

阿根廷

中国

美国

阿拉伯

美国

类别

1200

249

40

500/100

450

20

3300+

30

64

36

500

2000

32

24

9

7

15

1

25

6

6

1

10

8

8

10

5

45760

50000

3000

25000

33210

840

9800

300

3200

432

6000

24000

RGB

RGB

RGB

RGB/深度

RGB

RGB

RGB

RGB

131000

RGB/深度

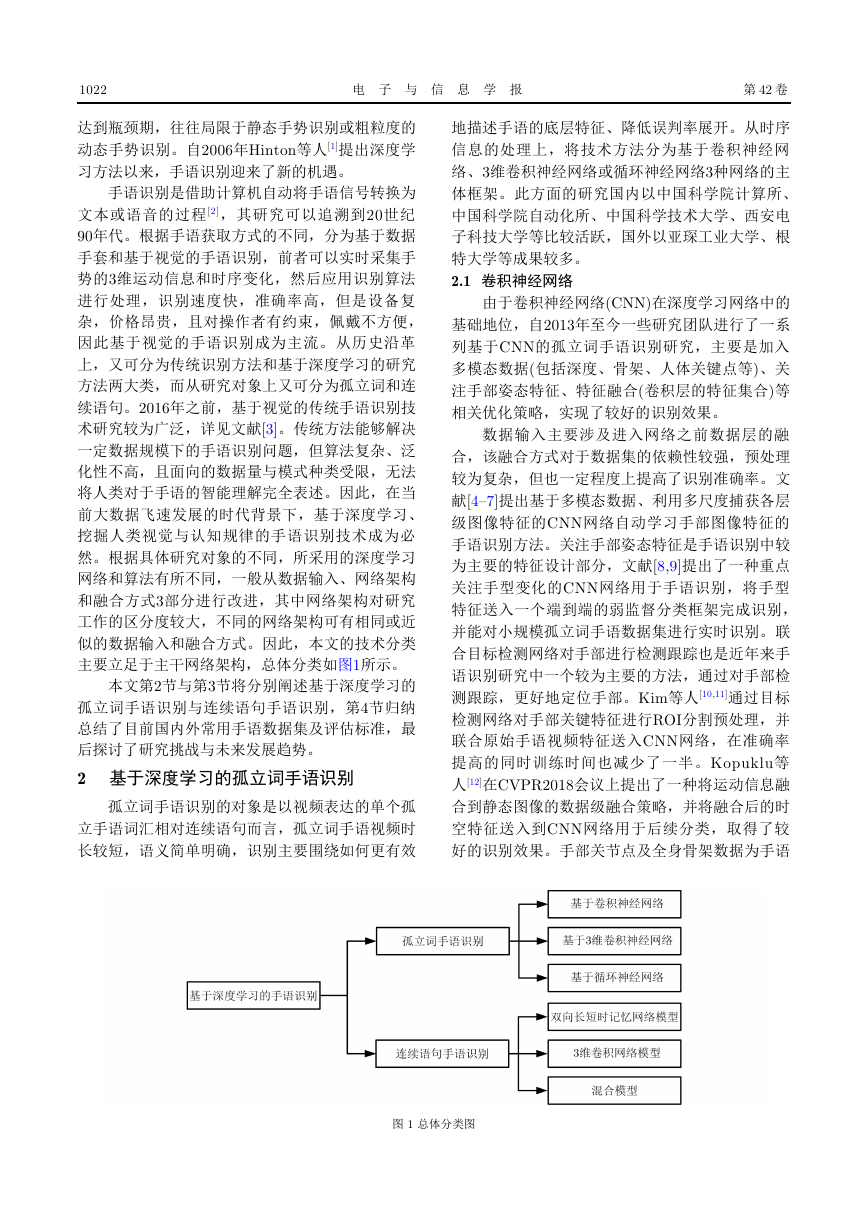

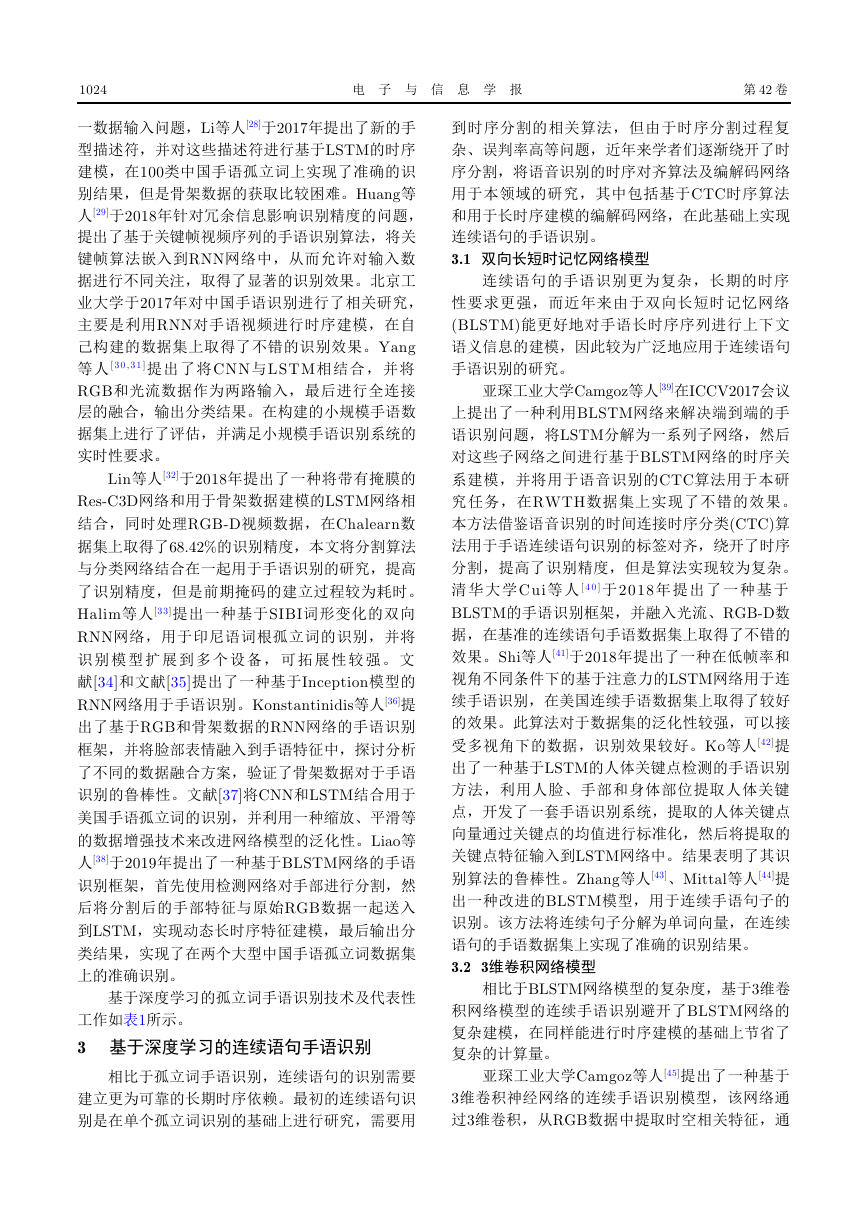

对脸部表情进行了标注,如图2所示。该数据集具

体参数如表4所示。

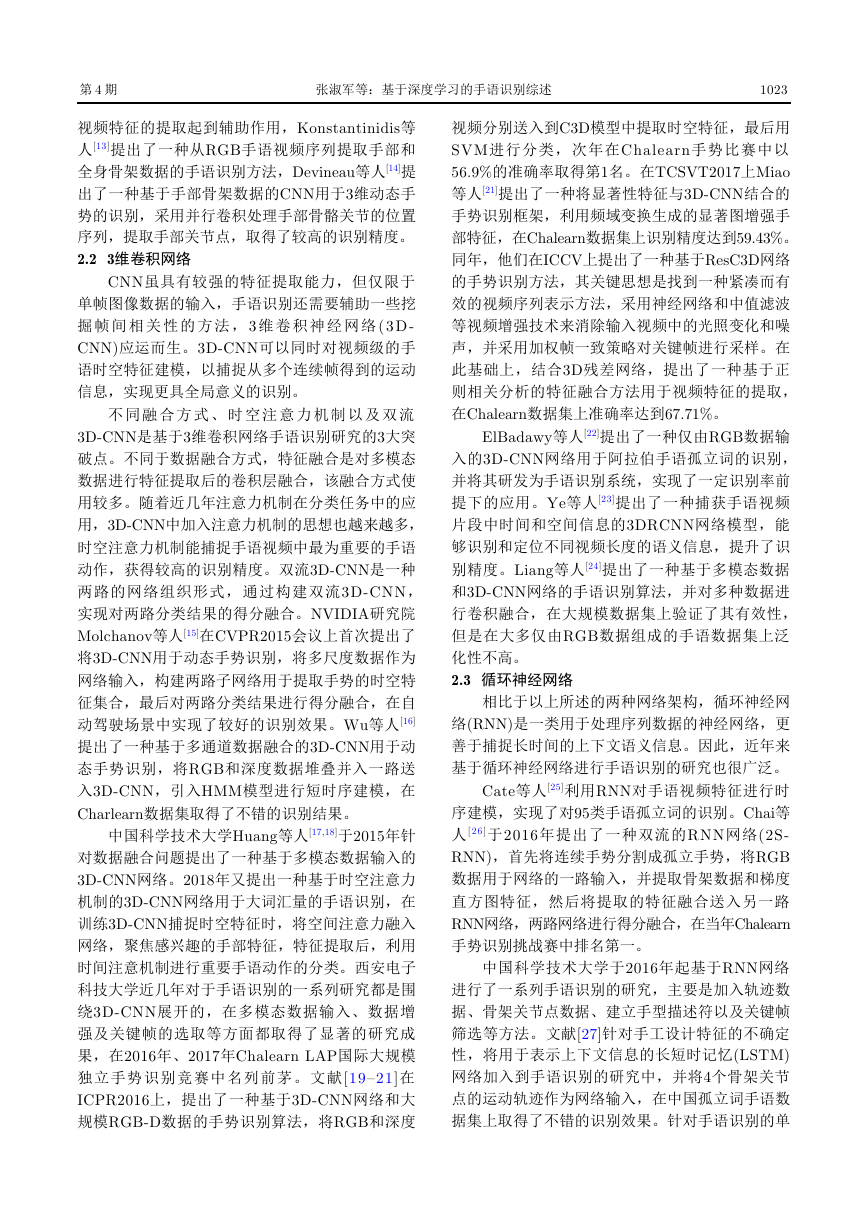

4.2 CSL数据集

中国手语数据集(CSL)是由中国科学技术大学

自2015年起利用Kinect采集的中国手语数据集,包

含25 K标记的视频实例,共有超过100个时长的视

频,50个操作者拍摄,每个操作者重复5次,包含

RGB、深度以及骨架关节点数据,分为孤立词和

�

电 子 与 信 息 学 报

第 42 卷

图 2 RWTH德国手语数据样例

表 4 RWTH-PHOENIX-Weather参数

参数

2012年版

2014年版

# 操作者数量

# 样例

# 帧数

# 语句数量

# 词汇量

# 分辨率

7

190

293077

1980

911

9

645

965940

6861

1558

210×260

720×576

连续语句,其中单词有500类,每类含250个样例,

包含21个骨架关节点坐标序列;句子有100个,共

有5000个视频,每一个句子平均包含4~8个单词。

每一个视频实例都由专业的中国手语老师进行标

注。具体的CSL数据集参数如表5所示,数据集样

例如图3所示。

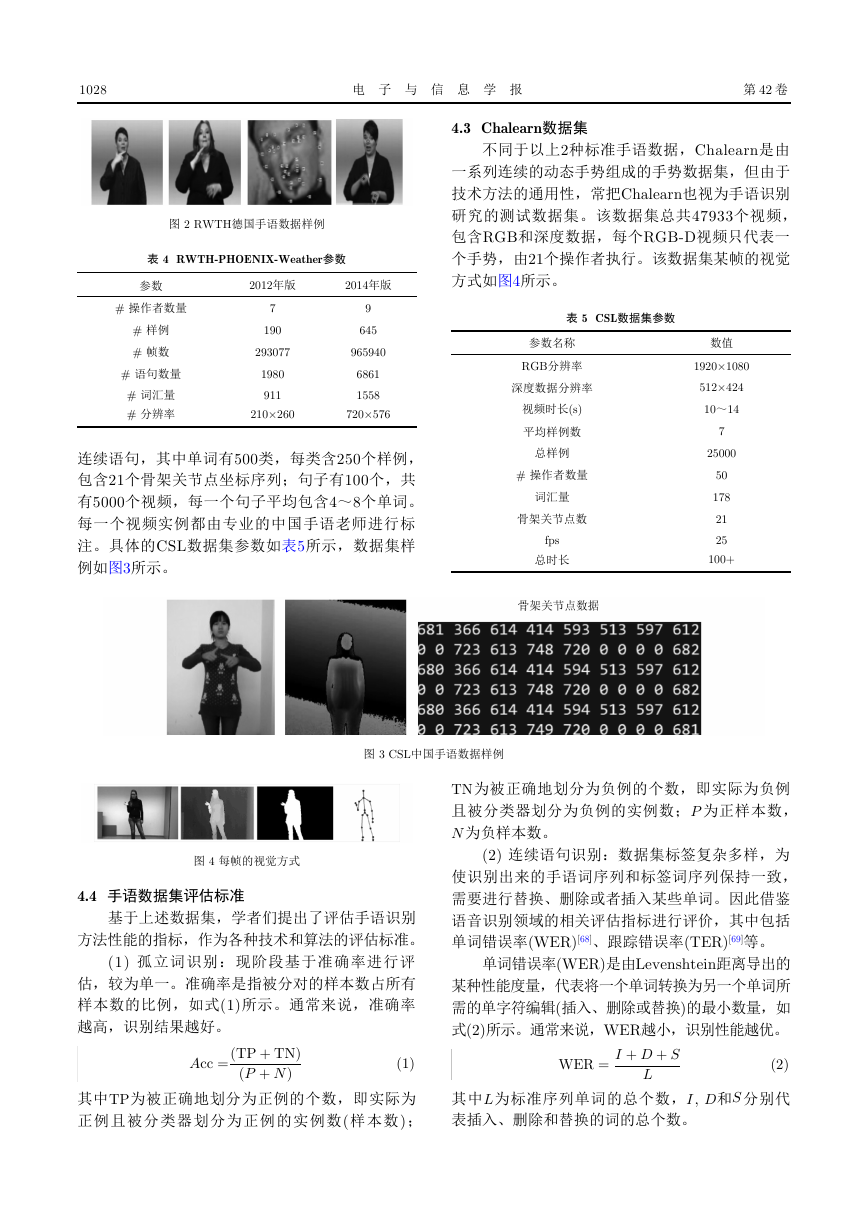

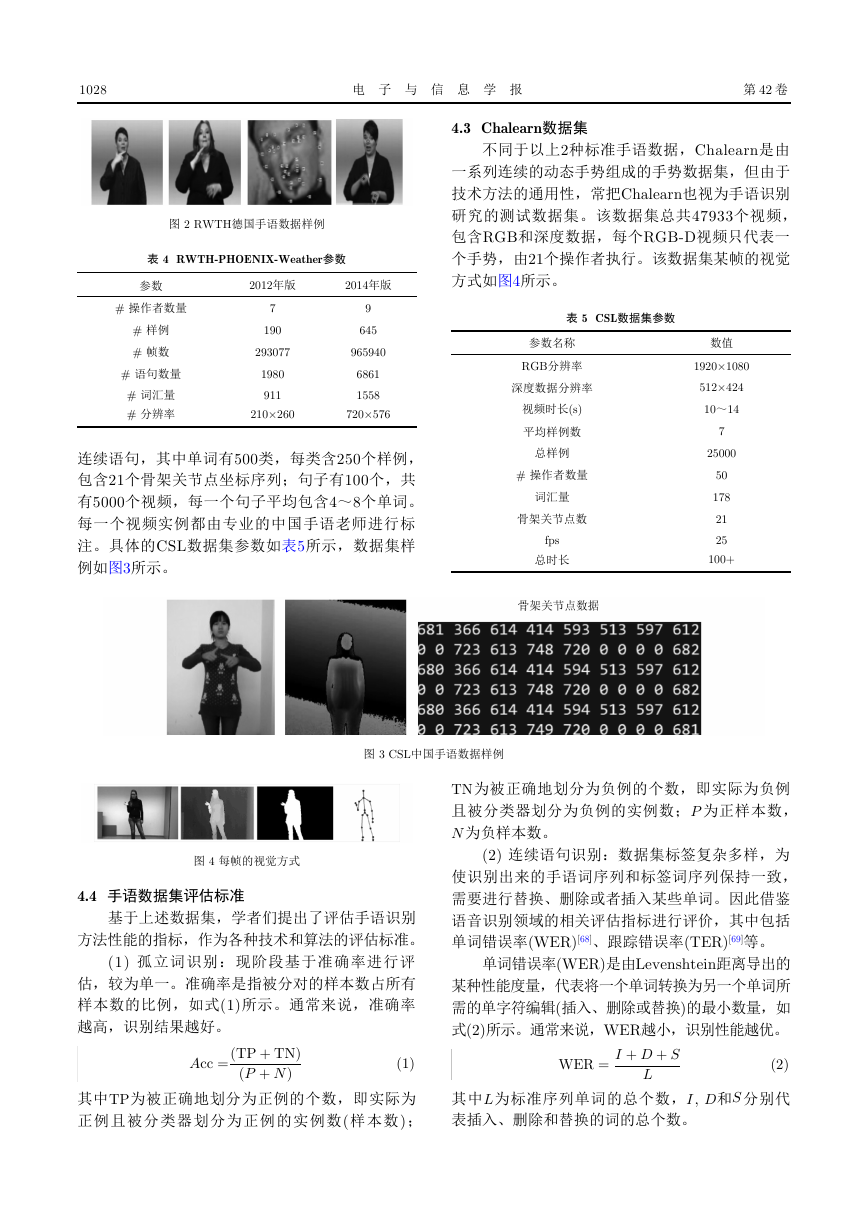

4.3 Chalearn数据集

不同于以上2种标准手语数据,Chalearn是由

一系列连续的动态手势组成的手势数据集,但由于

技术方法的通用性,常把Chalearn也视为手语识别

研究的测试数据集。该数据集总共47933个视频,

包含RGB和深度数据,每个RGB-D视频只代表一

个手势,由21个操作者执行。该数据集某帧的视觉

方式如图4所示。

表 5 CSL数据集参数

参数名称

RGB分辨率

深度数据分辨率

视频时长(s)

平均样例数

总样例

# 操作者数量

词汇量

骨架关节点数

fps

总时长

数值

1920×1080

512×424

10~14

7

25000

50

178

21

25

100+

1028

图 3 CSL中国手语数据样例

图 4 每帧的视觉方式

4.4 手语数据集评估标准

基于上述数据集,学者们提出了评估手语识别

方法性能的指标,作为各种技术和算法的评估标准。

(1) 孤立词识别:现阶段基于准确率进行评

估,较为单一。准确率是指被分对的样本数占所有

样本数的比例,如式(1)所示。通常来说,准确率

越高,识别结果越好。

为被正确地划分为负例的个数,即实际为负例

且被分类器划分为负例的实例数; 为正样本数,

为负样本数。

(2) 连续语句识别:数据集标签复杂多样,为

使识别出来的手语词序列和标签词序列保持一致,

需要进行替换、删除或者插入某些单词。因此借鉴

语音识别领域的相关评估指标进行评价,其中包括

单词错误率(WER)[68]、跟踪错误率(TER)[69]等。

单词错误率(WER)是由Levenshtein距离导出的

某种性能度量,代表将一个单词转换为另一个单词所

需的单字符编辑(插入、删除或替换)的最小数量,如

式(2)所示。通常来说,WER越小,识别性能越优。

其中 为被正确地划分为正例的个数,即实际为

正例且被分类器划分为正例的实例数(样本数);

其中 为标准序列单词的总个数, , 和 分别代

表插入、删除和替换的词的总个数。

Acc=(TP+TN)(P+N)(1)TPTNPNWER=I+D+SL(2)LIDS�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc