DOI:10.16186/j.cnki.1673-9787.2014.04.023

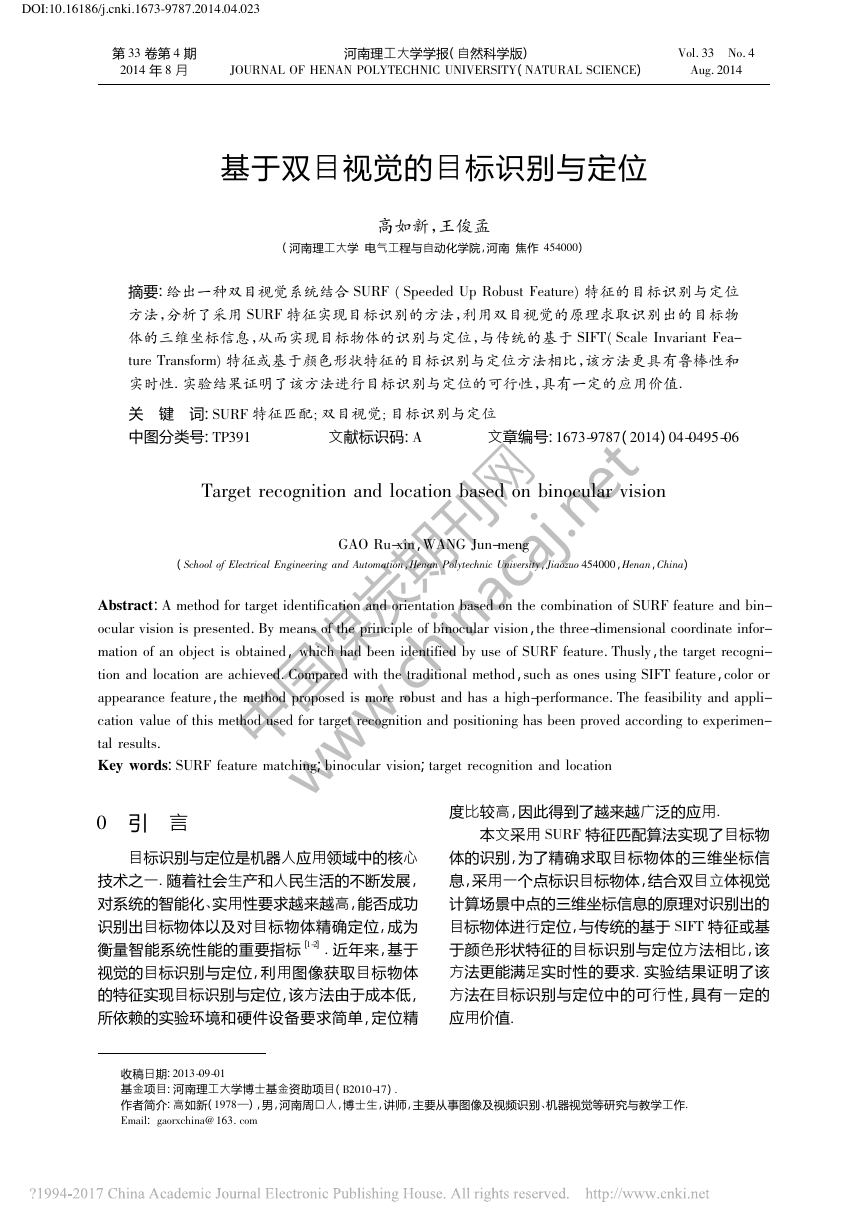

基于双目视觉的目标识别与定位高如新,王俊孟(河南理工大学电气工程与自动化学院,河南焦作454000)*摘要:给出一种双目视觉系统结合SURF(SpeededUpRobustFeature)特征的目标识别与定位方法,分析了采用SURF特征实现目标识别的方法,利用双目视觉的原理求取识别出的目标物体的三维坐标信息,从而实现目标物体的识别与定位,与传统的基于SIFT(ScaleInvariantFea-tureTransform)特征或基于颜色形状特征的目标识别与定位方法相比,该方法更具有鲁棒性和实时性.实验结果证明了该方法进行目标识别与定位的可行性,具有一定的应用价值.关键词:SURF特征匹配;双目视觉;目标识别与定位中图分类号:TP391文献标识码:A文章编号:1673-9787(2014)04-0495-06TargetrecognitionandlocationbasedonbinocularvisionGAORu-xin,WANGJun-meng(SchoolofElectricalEngineeringandAutomation,HenanPolytechnicUniversity,Jiaozuo454000,Henan,China)Abstract:AmethodfortargetidentificationandorientationbasedonthecombinationofSURFfeatureandbin-ocularvisionispresented.Bymeansoftheprincipleofbinocularvision,thethree-dimensionalcoordinateinfor-mationofanobjectisobtained,whichhadbeenidentifiedbyuseofSURFfeature.Thusly,thetargetrecogni-tionandlocationareachieved.Comparedwiththetraditionalmethod,suchasonesusingSIFTfeature,colororappearancefeature,themethodproposedismorerobustandhasahigh-performance.Thefeasibilityandappli-cationvalueofthismethodusedfortargetrecognitionandpositioninghasbeenprovedaccordingtoexperimen-talresults.Keywords:SURFfeaturematching;binocularvision;targetrecognitionandlocation0引言目标识别与定位是机器人应用领域中的核心技术之一.随着社会生产和人民生活的不断发展,对系统的智能化、实用性要求越来越高,能否成功识别出目标物体以及对目标物体精确定位,成为衡量智能系统性能的重要指标[1-2].近年来,基于视觉的目标识别与定位,利用图像获取目标物体的特征实现目标识别与定位,该方法由于成本低,所依赖的实验环境和硬件设备要求简单,定位精度比较高,因此得到了越来越广泛的应用.本文采用SURF特征匹配算法实现了目标物体的识别,为了精确求取目标物体的三维坐标信息,采用一个点标识目标物体,结合双目立体视觉计算场景中点的三维坐标信息的原理对识别出的目标物体进行定位,与传统的基于SIFT特征或基于颜色形状特征的目标识别与定位方法相比,该方法更能满足实时性的要求.实验结果证明了该方法在目标识别与定位中的可行性,具有一定的应用价值.第33卷第4期2014年8月河南理工大学学报(自然科学版)JOURNALOFHENANPOLYTECHNICUNIVERSITY(NATURALSCIENCE)Vol.33No.4Aug.2014*收稿日期:2013-09-01基金项目:河南理工大学博士基金资助项目(B2010-17).作者简介:高如新(1978—),男,河南周口人,博士生,讲师,主要从事图像及视频识别、机器视觉等研究与教学工作.Email:gaorxchina@163.com中国煤炭期刊网 www.chinacaj.net�

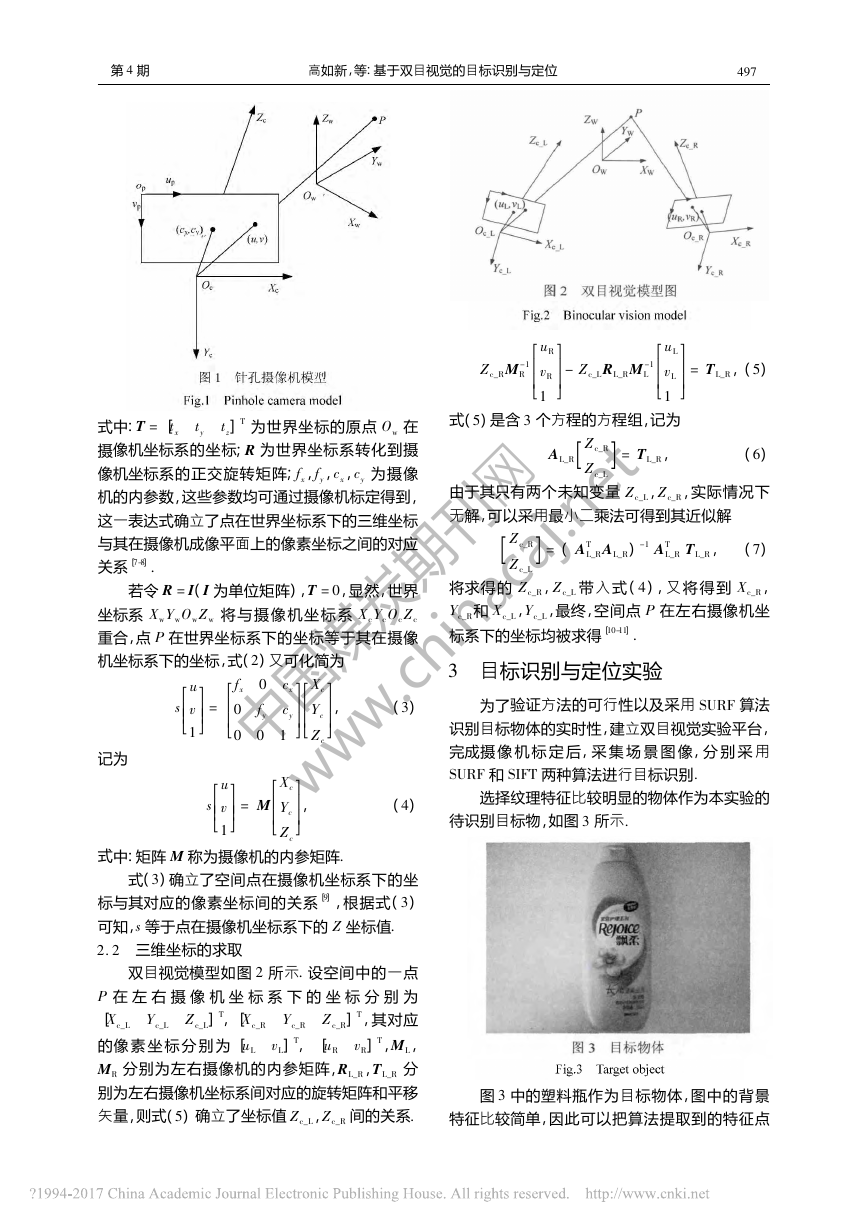

1基于SURF特征的目标识别基于不变特征的目标识别方法由于具有很好的鲁棒性,计算量小,速度快等特点,逐渐成为目标识别研究的主流方向.SURF算法是一种高鲁棒性的局部特征点检测器,SURF特征具有尺度、旋转等不变特性,因此常用于图像拼接、三维建模、视频跟踪、目标识别等,由HerbertBay等人在2006年提出,该算法采用积分图像、Haar小波变换和近似的Hessian矩阵运算提高运算速度,采用Haar小波变换增加鲁棒性,与SIFT算法相比,SURF算法更具有鲁棒性和实时性[3-4].1.1SURF特征匹配SURF特征匹配分为3个步骤:提取特征点,构建特征描述符,快速特征匹配.1.1.1提取特征点SURF算法通过计算图像像素点的Hessian矩阵提取图像特征点,这需要图像和高斯函数做卷积运算,根据卷积运算性质,图像与高斯函数的卷积可以转化为积分图像与高斯二阶导数模板的卷积运算,而高斯二阶导数模板实际上只是一些简单的权重区域的组合,这样卷积运算就变成了积分图像的加减运算,因此,可以提高图像特征点提取的速度.SURF算法采用盒子滤波器近似高斯二阶偏导数,最终获得了近似的Hessian矩阵,通过改变盒滤波器的模板大小建立尺度图像金字塔.Hes-sian矩阵的行列式的局部最大值点即为特征点.1.1.2构建特征描述符对于提取到的特征点,建立特征向量对其进行描述,SURF算法在特征点圆形区域内通过Haar小波响应确定一个主方向,使特征向量具有旋转不变性,再以特征点为中心,构建正方形区域,经过Haar小波响应最终生成一个64维的特征向量.1.1.3特征匹配对于待匹配图像与参考图像特征点的匹配,SURF算法采用最近领域匹配方法,首先计算待匹配图像上的特征点特征向量到参考图像上所有特征点特征向量的欧氏距离,得到一个距离集合,其次通过对距离集合进行比较运算得到最小欧氏距离d1和次最小欧式距离d2,即d1d2<T,(1)式中:T为设定的阈值,一般为0.6.当最小欧氏距离d1和次最小欧式距离d2的比值小于该阈值时,认为特征点与对应最小欧氏距离的特征点是匹配的,否则没有点与该特征点相匹配.设定的阈值越小,匹配越稳定,但匹配点数目相应越少.1.2目标物体识别为了从复杂的场景中识别出目标物体,首先需要建立该目标物体的特征数据集,以具有简单特征的场景作为背景,采集目标物体的图像,利用SURF算法提取图像的特征点,保存特征点特征向量数据集,由于背景特征简单,该数据集基本上都是目标物体的特征描述.将目标物体置于其他场景中,采集场景图像,提取图像的特征点,让其与目标物体的特征描述进行匹配,如果匹配点的数目达到了一定数量,就认为该目标物体在此场景中,这就实现了目标物体的识别.1.3目标物体的定位安装有双目视觉系统的机器人,对某个场景进行拍照,采集图像,提取采集到的图像对的SURF特征点,与目标物体特征数据集进行匹配,当确认采集到的左右图像上均含有目标物体时,利用双目视觉的原理,求取目标物体的三维坐标信息,实现目标物体的定位.2双目立体视觉双目立体视觉模拟人眼对看到的场景具有深度感知的能力,利用两台摄像机同时获取同一场景的立体图像对,找到图像对中相对应的匹配点,再利用双目视觉成像原理,将图像像素点所对应的场景中点的三维坐标计算出来,场景中点的位置信息就确定了.双目视觉系统一般包括立体标定、立体匹配、三维坐标计算等步骤[5-6].2.1针孔摄像机模型针孔摄像机模型一般包含4个坐标系:世界坐标系XwYwOwZw,摄像机坐标系XcYcOcZc,图像坐标系XOY,图像像素坐标系upopvp,如图1所示.若采用齐次坐标,则空间某点P的世界坐标[XwYwZw1]T与该点对应的投影点像素坐标[uv1]T间的关系为suv1=fx0cx00fycy00010RT0T[]1XwYwZw1,(2)694河南理工大学学报(自然科学版)2014年第33卷中国煤炭期刊网 www.chinacaj.net�

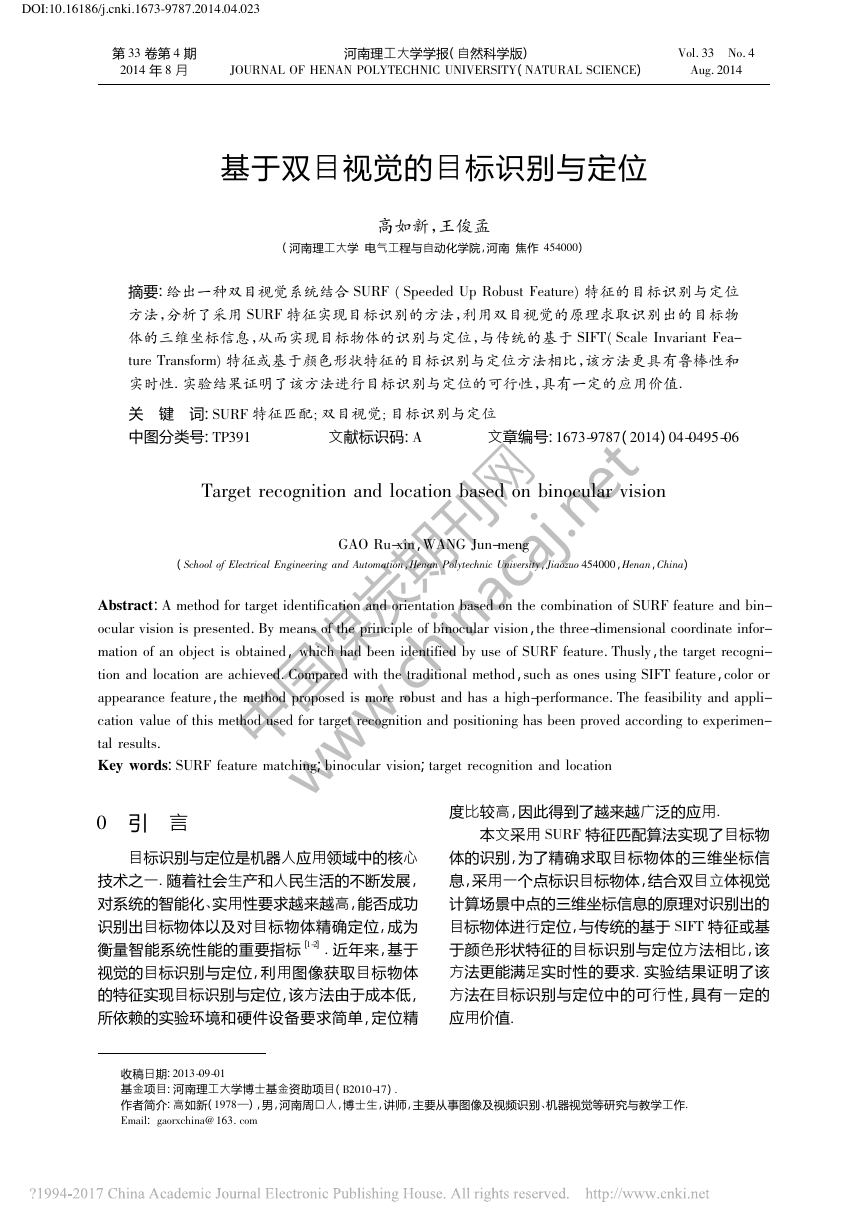

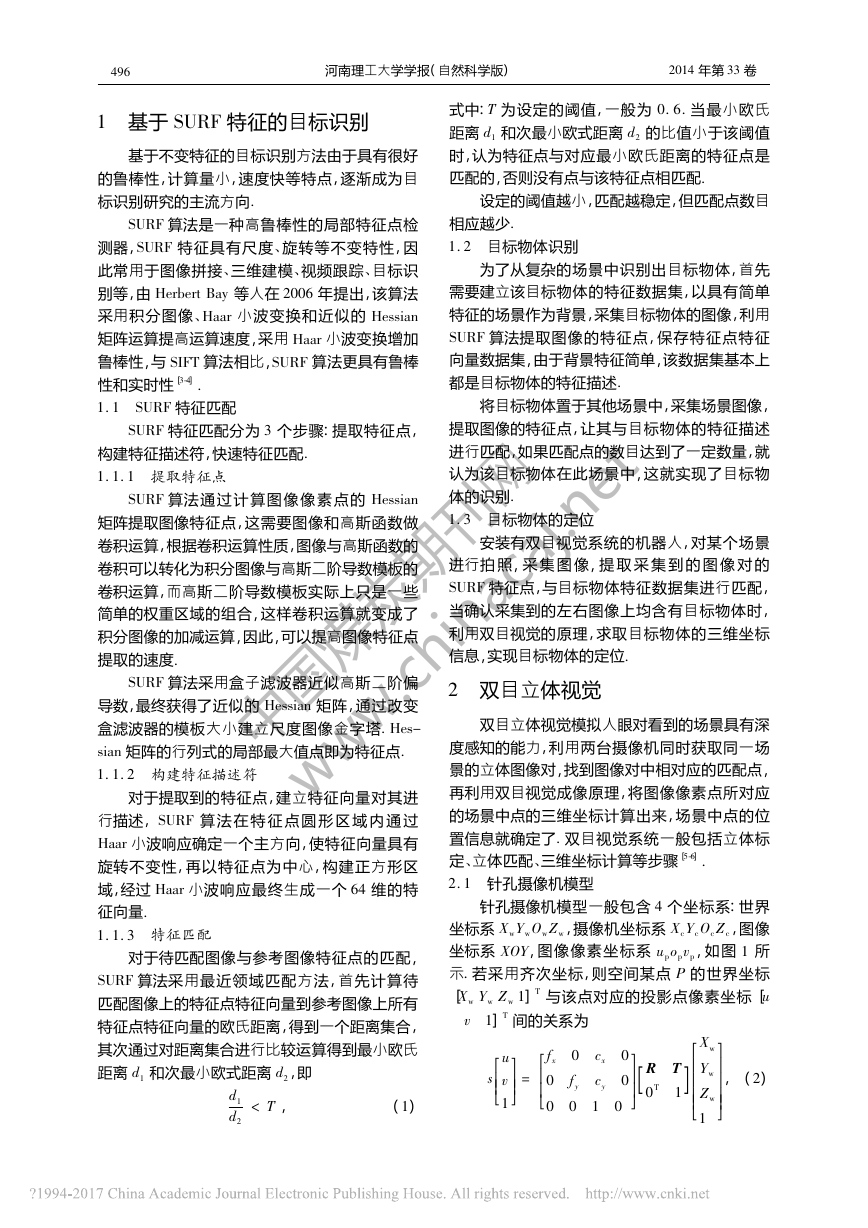

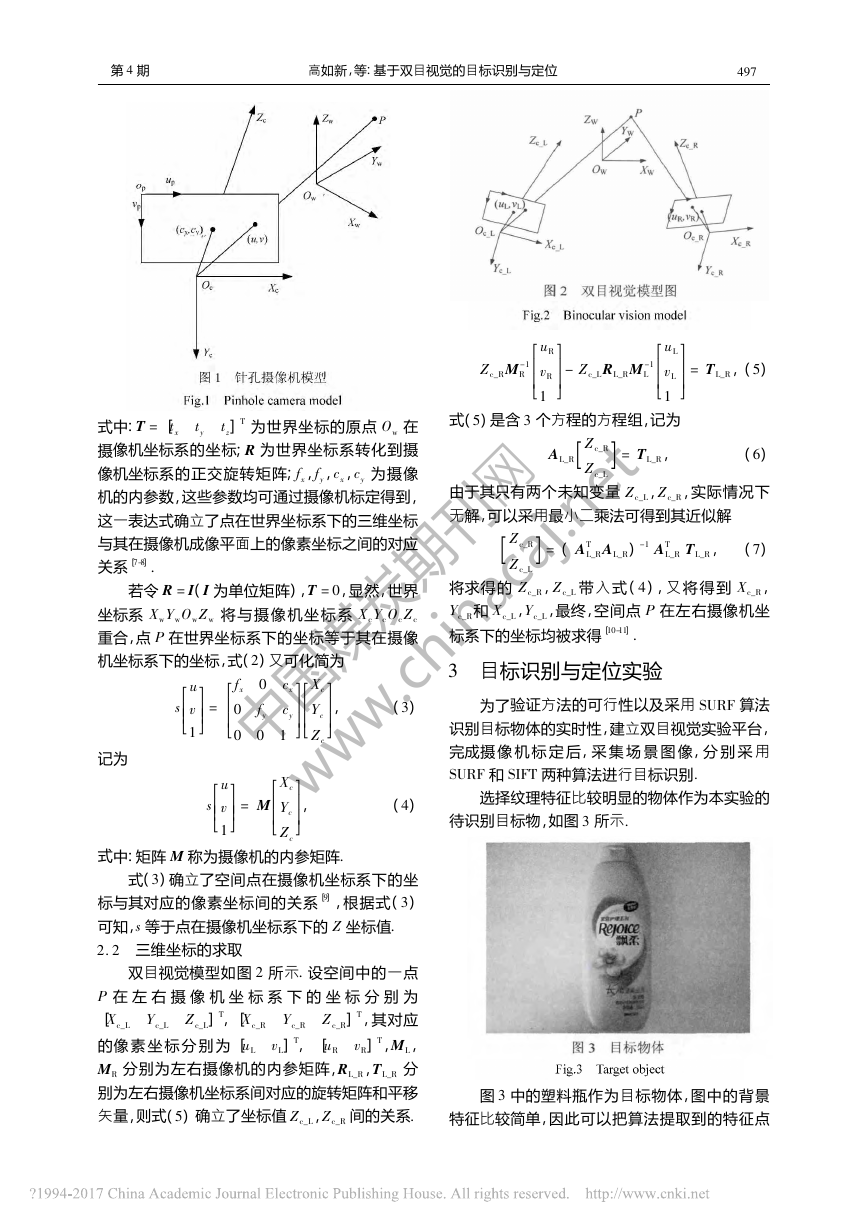

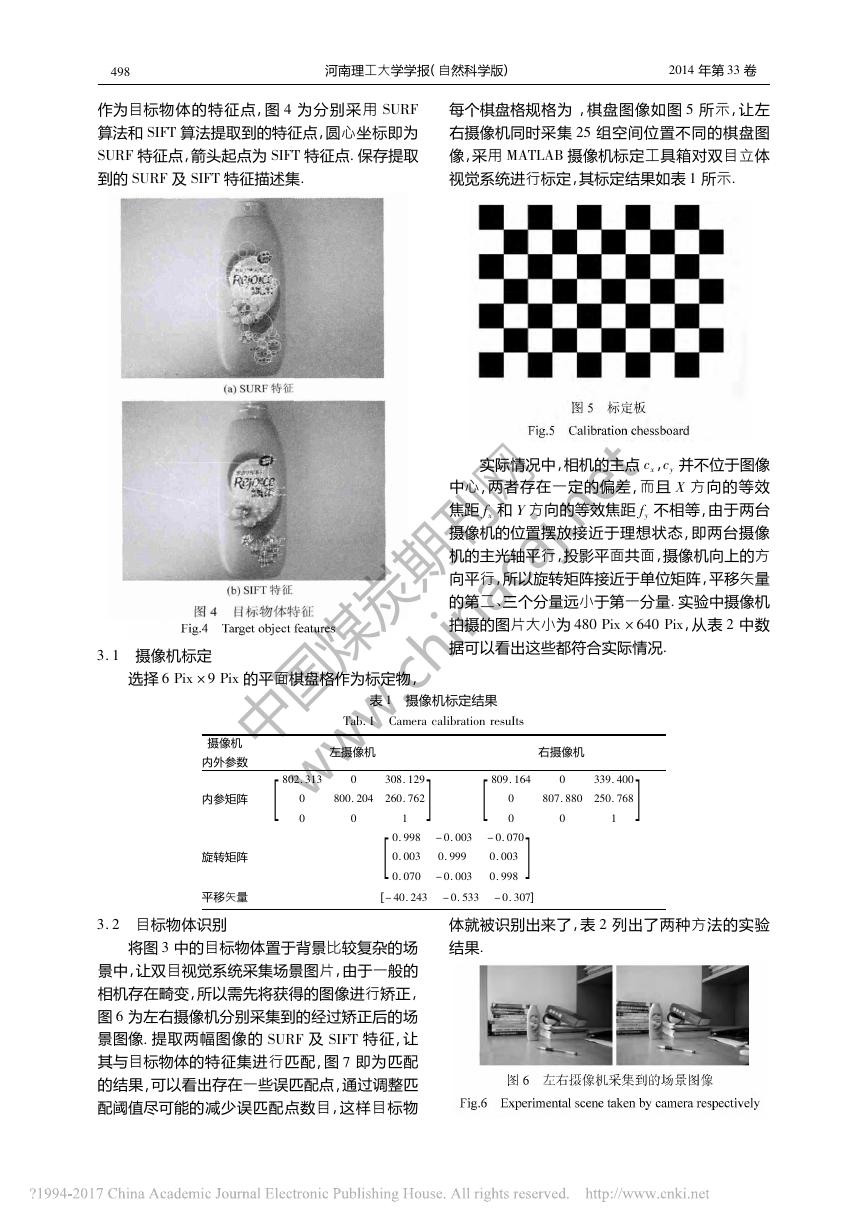

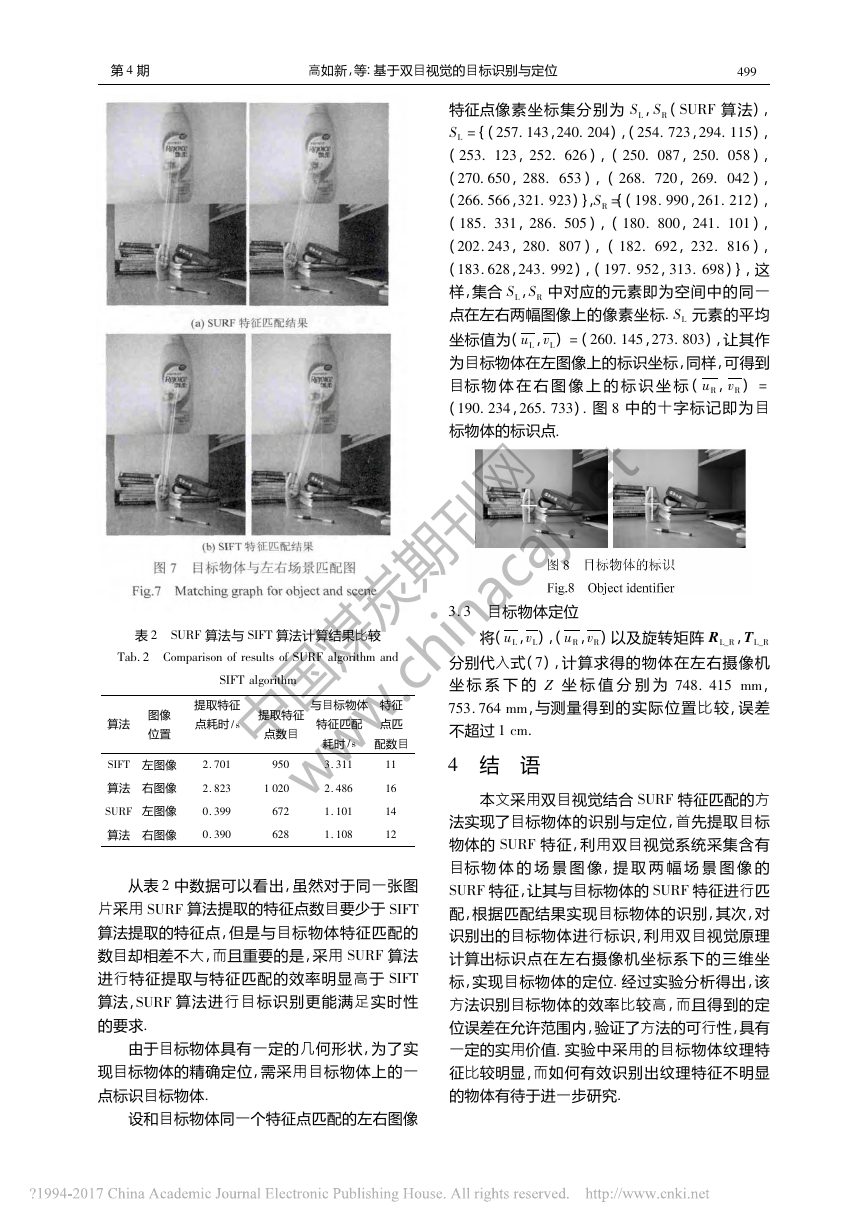

式中:T=[txtytz]T为世界坐标的原点Ow在摄像机坐标系的坐标;R为世界坐标系转化到摄像机坐标系的正交旋转矩阵;fx,fy,cx,cy为摄像机的内参数,这些参数均可通过摄像机标定得到,这一表达式确立了点在世界坐标系下的三维坐标与其在摄像机成像平面上的像素坐标之间的对应关系[7-8].若令R=I(I为单位矩阵),T=0,显然,世界坐标系XwYwOwZw将与摄像机坐标系XcYcOcZc重合,点P在世界坐标系下的坐标等于其在摄像机坐标系下的坐标,式(2)又可化简为suv1=fx0cx0fycy001XcYcZc,(3)记为suv1=MXcYcZc,(4)式中:矩阵M称为摄像机的内参矩阵.式(3)确立了空间点在摄像机坐标系下的坐标与其对应的像素坐标间的关系[9],根据式(3)可知,s等于点在摄像机坐标系下的Z坐标值.2.2三维坐标的求取双目视觉模型如图2所示.设空间中的一点P在左右摄像机坐标系下的坐标分别为[Xc_LYc_LZc_L]T,[Xc_RYc_RZc_R]T,其对应的像素坐标分别为[uLvL]T,[uRvR]T,ML,MR分别为左右摄像机的内参矩阵,RL_R,TL_R分别为左右摄像机坐标系间对应的旋转矩阵和平移矢量,则式(5)确立了坐标值Zc_L,Zc_R间的关系.Zc_RM-1RuRvR1-Zc_LRL_RM-1LuLvL1=TL_R,(5)式(5)是含3个方程的方程组,记为AL_RZc_RZ[]c_L=TL_R,(6)由于其只有两个未知变量Zc_L,Zc_R,实际情况下无解,可以采用最小二乘法可得到其近似解Zc_RZ[]c_L=(ATL_RAL_R)-1ATL_RTL_R,(7)将求得的Zc_R,Zc_L带入式(4),又将得到Xc_R,Yc_R和Xc_L,Yc_L,最终,空间点P在左右摄像机坐标系下的坐标均被求得[10-11].3目标识别与定位实验为了验证方法的可行性以及采用SURF算法识别目标物体的实时性,建立双目视觉实验平台,完成摄像机标定后,采集场景图像,分别采用SURF和SIFT两种算法进行目标识别.选择纹理特征比较明显的物体作为本实验的待识别目标物,如图3所示.图3中的塑料瓶作为目标物体,图中的背景特征比较简单,因此可以把算法提取到的特征点794第4期高如新,等:基于双目视觉的目标识别与定位中国煤炭期刊网 www.chinacaj.net�

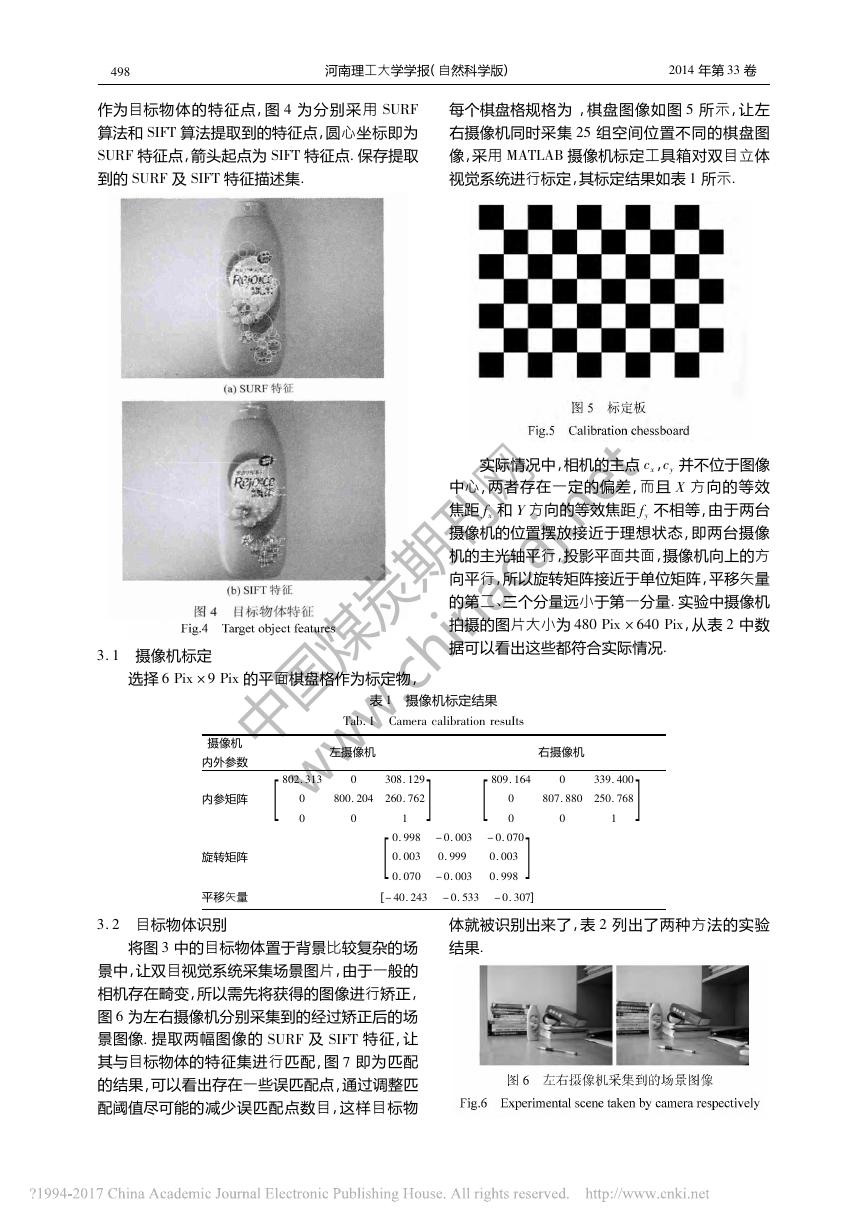

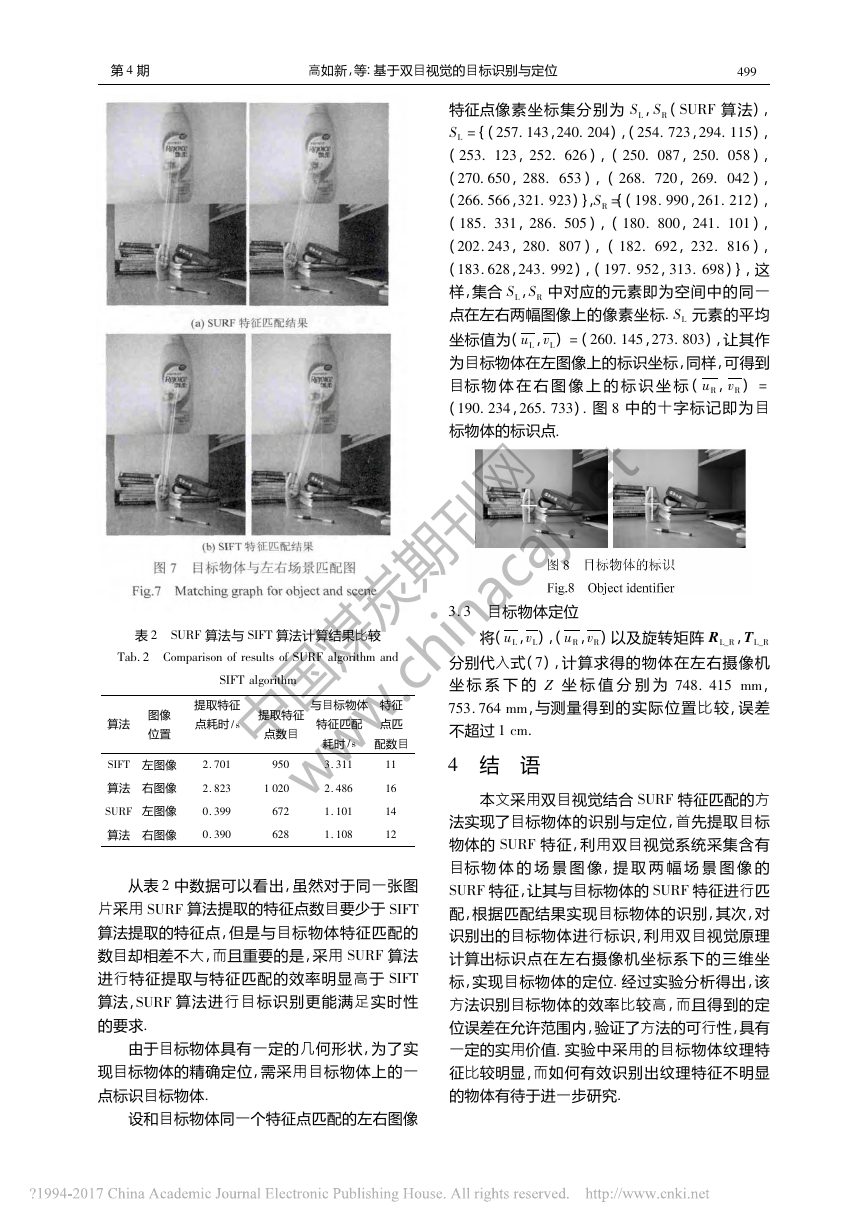

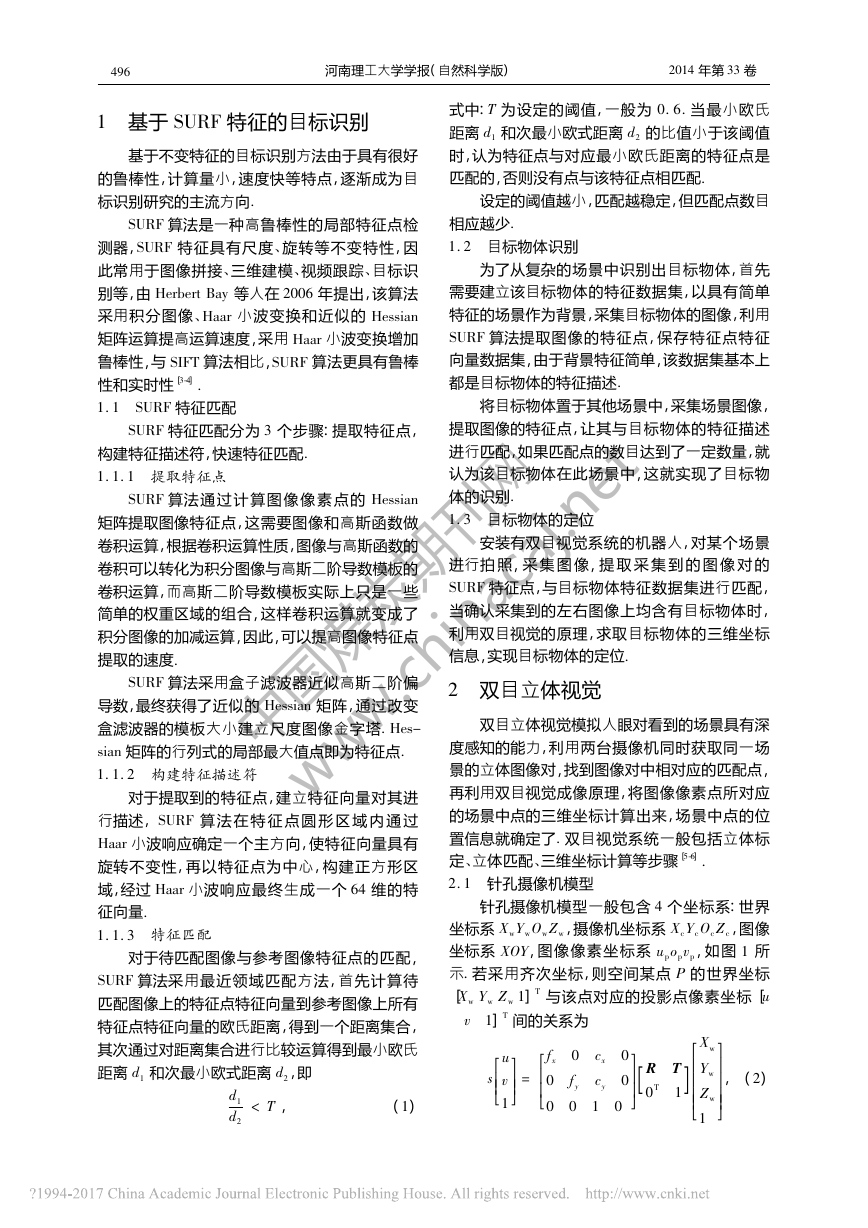

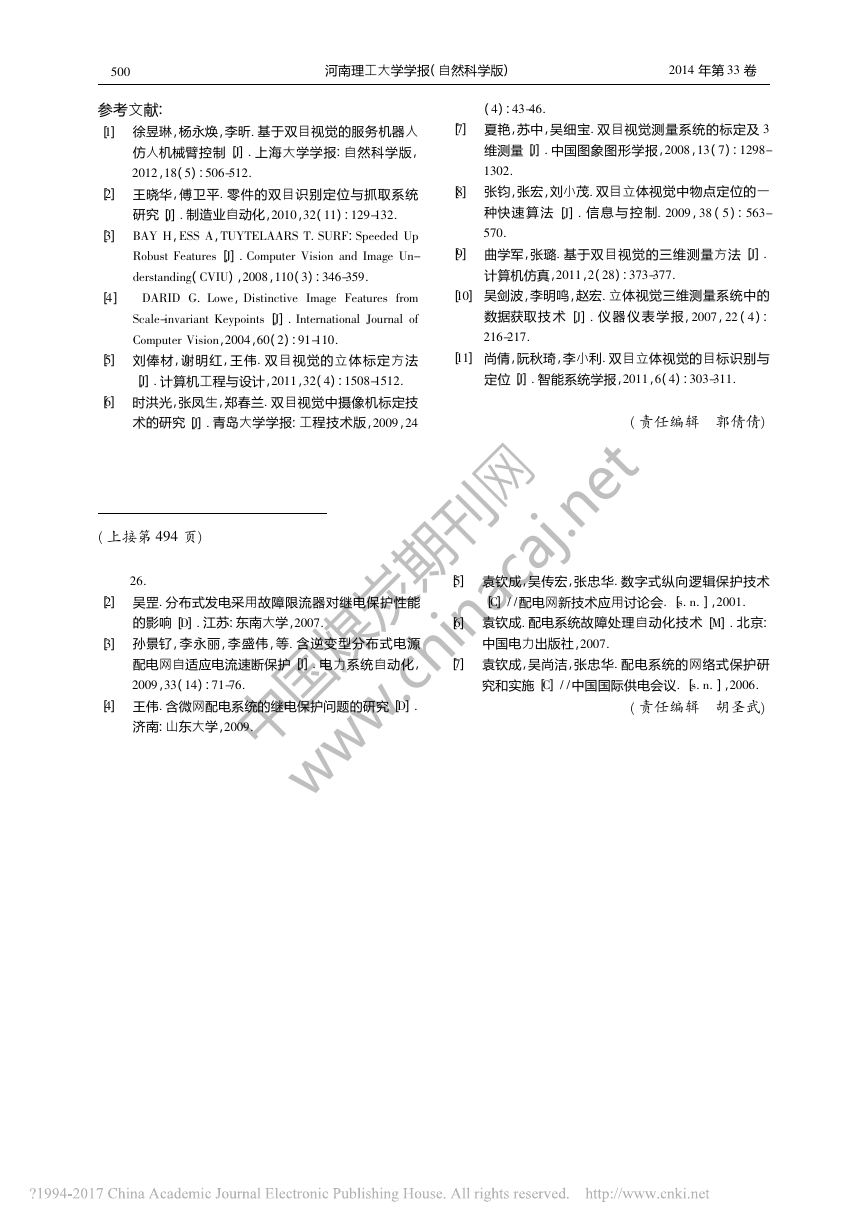

作为目标物体的特征点,图4为分别采用SURF算法和SIFT算法提取到的特征点,圆心坐标即为SURF特征点,箭头起点为SIFT特征点.保存提取到的SURF及SIFT特征描述集.3.1摄像机标定选择6Pix×9Pix的平面棋盘格作为标定物,每个棋盘格规格为,棋盘图像如图5所示,让左右摄像机同时采集25组空间位置不同的棋盘图像,采用MATLAB摄像机标定工具箱对双目立体视觉系统进行标定,其标定结果如表1所示.实际情况中,相机的主点cx,cy并不位于图像中心,两者存在一定的偏差,而且X方向的等效焦距fx和Y方向的等效焦距fy不相等,由于两台摄像机的位置摆放接近于理想状态,即两台摄像机的主光轴平行,投影平面共面,摄像机向上的方向平行,所以旋转矩阵接近于单位矩阵,平移矢量的第二、三个分量远小于第一分量.实验中摄像机拍摄的图片大小为480Pix×640Pix,从表2中数据可以看出这些都符合实际情况.表1摄像机标定结果Tab.1CameracalibrationresuIts摄像机内外参数左摄像机右摄像机内参矩阵802.3130308.1290800.204260.762[]001809.1640339.4000807.880250.768[]001旋转矩阵0.998-0.003-0.0700.0030.9990.003[]0.070-0.0030.998平移矢量[-40.243-0.533-0.307]3.2目标物体识别将图3中的目标物体置于背景比较复杂的场景中,让双目视觉系统采集场景图片,由于一般的相机存在畸变,所以需先将获得的图像进行矫正,图6为左右摄像机分别采集到的经过矫正后的场景图像.提取两幅图像的SURF及SIFT特征,让其与目标物体的特征集进行匹配,图7即为匹配的结果,可以看出存在一些误匹配点,通过调整匹配阈值尽可能的减少误匹配点数目,这样目标物体就被识别出来了,表2列出了两种方法的实验结果.894河南理工大学学报(自然科学版)2014年第33卷中国煤炭期刊网 www.chinacaj.net�

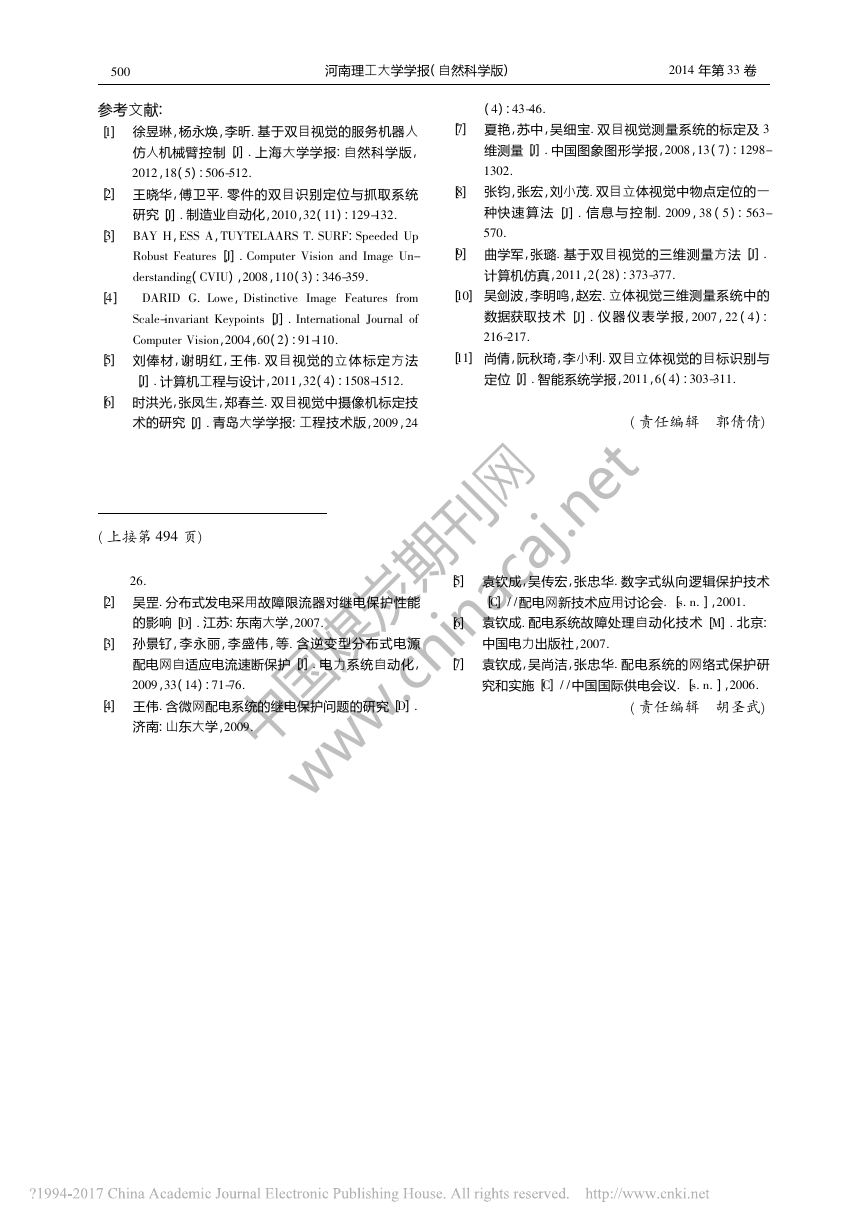

表2SURF算法与SIFT算法计算结果比较Tab.2ComparisonofresultsofSURFalgorithmandSIFTalgorithm算法图像位置提取特征点耗时/s提取特征点数目与目标物体特征匹配耗时/s特征点匹配数目SIFT左图像2.7019503.31111算法右图像2.82310202.48616SURF左图像0.3996721.10114算法右图像0.3906281.10812从表2中数据可以看出,虽然对于同一张图片采用SURF算法提取的特征点数目要少于SIFT算法提取的特征点,但是与目标物体特征匹配的数目却相差不大,而且重要的是,采用SURF算法进行特征提取与特征匹配的效率明显高于SIFT算法,SURF算法进行目标识别更能满足实时性的要求.由于目标物体具有一定的几何形状,为了实现目标物体的精确定位,需采用目标物体上的一点标识目标物体.设和目标物体同一个特征点匹配的左右图像特征点像素坐标集分别为SL,SR(SURF算法),SL={(257.143,240.204),(254.723,294.115),(253.123,252.626),(250.087,250.058),(270.650,288.653),(268.720,269.042),(266.566,321.923)},SR={(198.990,261.212),(185.331,286.505),(180.800,241.101),(202.243,280.807),(182.692,232.816),(183.628,243.992),(197.952,313.698)},这样,集合SL,SR中对应的元素即为空间中的同一点在左右两幅图像上的像素坐标.SL元素的平均坐标值为(uL,vL)=(260.145,273.803),让其作为目标物体在左图像上的标识坐标,同样,可得到目标物体在右图像上的标识坐标(uR,vR)=(190.234,265.733).图8中的十字标记即为目标物体的标识点.3.3目标物体定位将(uL,vL),(uR,vR)以及旋转矩阵RL_R,TL_R分别代入式(7),计算求得的物体在左右摄像机坐标系下的Z坐标值分别为748.415mm,753.764mm,与测量得到的实际位置比较,误差不超过1cm.4结语本文采用双目视觉结合SURF特征匹配的方法实现了目标物体的识别与定位,首先提取目标物体的SURF特征,利用双目视觉系统采集含有目标物体的场景图像,提取两幅场景图像的SURF特征,让其与目标物体的SURF特征进行匹配,根据匹配结果实现目标物体的识别,其次,对识别出的目标物体进行标识,利用双目视觉原理计算出标识点在左右摄像机坐标系下的三维坐标,实现目标物体的定位.经过实验分析得出,该方法识别目标物体的效率比较高,而且得到的定位误差在允许范围内,验证了方法的可行性,具有一定的实用价值.实验中采用的目标物体纹理特征比较明显,而如何有效识别出纹理特征不明显的物体有待于进一步研究.994第4期高如新,等:基于双目视觉的目标识别与定位中国煤炭期刊网 www.chinacaj.net�

参考文献:[1]徐昱琳,杨永焕,李昕.基于双目视觉的服务机器人仿人机械臂控制[J].上海大学学报:自然科学版,2012,18(5):506-512.[2]王晓华,傅卫平.零件的双目识别定位与抓取系统研究[J].制造业自动化,2010,32(11):129-132.[3]BAYH,ESSA,TUYTELAARST.SURF:SpeededUpRobustFeatures[J].ComputerVisionandImageUn-derstanding(CVIU),2008,110(3):346-359.[4]DARIDG.Lowe,DistinctiveImageFeaturesfromScale-invariantKeypoints[J].InternationalJournalofComputerVision,2004,60(2):91-110.[5]刘俸材,谢明红,王伟.双目视觉的立体标定方法[J].计算机工程与设计,2011,32(4):1508-1512.[6]时洪光,张凤生,郑春兰.双目视觉中摄像机标定技术的研究[J].青岛大学学报:工程技术版,2009,24(4):43-46.[7]夏艳,苏中,吴细宝.双目视觉测量系统的标定及3维测量[J].中国图象图形学报,2008,13(7):1298-1302.[8]张钧,张宏,刘小茂.双目立体视觉中物点定位的一种快速算法[J].信息与控制.2009,38(5):563-570.[9]曲学军,张璐.基于双目视觉的三维测量方法[J].计算机仿真,2011,2(28):373-377.[10]吴剑波,李明鸣,赵宏.立体视觉三维测量系统中的数据获取技术[J].仪器仪表学报,2007,22(4):216-217.[11]尚倩,阮秋琦,李小利.双目立体视觉的目标识别与定位[J].智能系统学报,2011,6(4):303-311.(责任编辑郭倩倩)(上接第494页)26.[2]吴罡.分布式发电采用故障限流器对继电保护性能的影响[D].江苏:东南大学,2007.[3]孙景钌,李永丽,李盛伟,等.含逆变型分布式电源配电网自适应电流速断保护[J].电力系统自动化,2009,33(14):71-76.[4]王伟.含微网配电系统的继电保护问题的研究[D].济南:山东大学,2009.[5]袁钦成,吴传宏,张忠华.数字式纵向逻辑保护技术[C]//配电网新技术应用讨论会.[s.n.],2001.[6]袁钦成.配电系统故障处理自动化技术[M].北京:中国电力出版社,2007.[7]袁钦成,吴尚洁,张忠华.配电系统的网络式保护研究和实施[C]//中国国际供电会议.[s.n.],2006.(责任编辑胡圣武)005河南理工大学学报(自然科学版)2014年第33卷中国煤炭期刊网 www.chinacaj.net�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc