1、准备工作

1.1 创建 hadoop 用户

如果你安装 CentOS 的时候不是用的 “hadoop” 用户,那么需要增加一个名为

hadoop 的用户。

首先点击左上角的 “应用程序” -> “系统工具” -> “终端”,首先在终端中输入 su ,

按回车,输入 root 密码以 root 用户登录,接着执行命令创建新用户 hadoop:

1. su # 上述提到的以 root 用户登录

2. useradd -m hadoop -s /bin/bash # 创建新用户hadoop

Shell 命令

如下图所示,这条命令创建了可以登陆的 hadoop 用户,并使用 /bin/bash 作

为 shell。

CentOS 创建 hadoop 用户

接着使用如下命令修改密码,按提示输入两次密码,可简单的设为 “hadoop”(密

码随意指定,若提示“无效的密码,过于简单”则再次输入确认就行):

1. passwd hadoop

Shell 命令

可为 hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手

的权限问题,执行:

1. visudo

Shell 命令

如下图,找到 root ALL=(ALL) ALL 这行(应该在第 98 行,可以先按一下键盘

上的 ESC 键,然后输入 :98 (按一下冒号,接着输入 98,再按回车键),可以直

�

接跳到第 98 行 ),然后在这行下面增加一行内容:hadoop ALL=(ALL) ALL (当

中的间隔为 tab),如下图所示:

为 hadoop 增加 sudo 权限

sudo 是 linux 系统管理指令,是允许系统管理员让普通用户执行一些或者全部的 root 命令的一

个工具

添加上一行内容后,先按一下键盘上的 ESC 键,然后输入 :wq (输入冒号还有 wq,

这是 vi/vim 编辑器的保存方法),再按回车键保存退出就可以了。

最后注销当前用户(点击屏幕右上角的用户名,选择退出->注销),在登陆界面使

用刚创建的 hadoop 用户进行登陆。(如果已经是 hadoop 用户,且在终端中

使用 su 登录了 root 用户,那么需要执行 exit 退出 root 用户状态)

使用 hadoop 用户登录后,还需要安装几个软件才能安装 Hadoop。

CentOS 使用 yum 来安装软件,需要联网环境,首先应检查一下是否连上了网

络。如下图所示,桌面右上角的网络图标若显示红叉,则表明还未联网,应点击

选择可用网络。

检查是否联网

连接网络后,需要安装 SSH 和 Java。

1.2 安装 SSH、配置 SSH 无密码登陆

集群、单节点模式都需要用到 SSH 登陆(类似于远程登陆,你可以登录某台

Linux 主机,并且在上面运行命令),一般情况下,CentOS 默认已安装了 SSH

client、SSH server,打开终端执行如下命令进行检验:

�

1. rpm -qa | grep ssh

Shell 命令

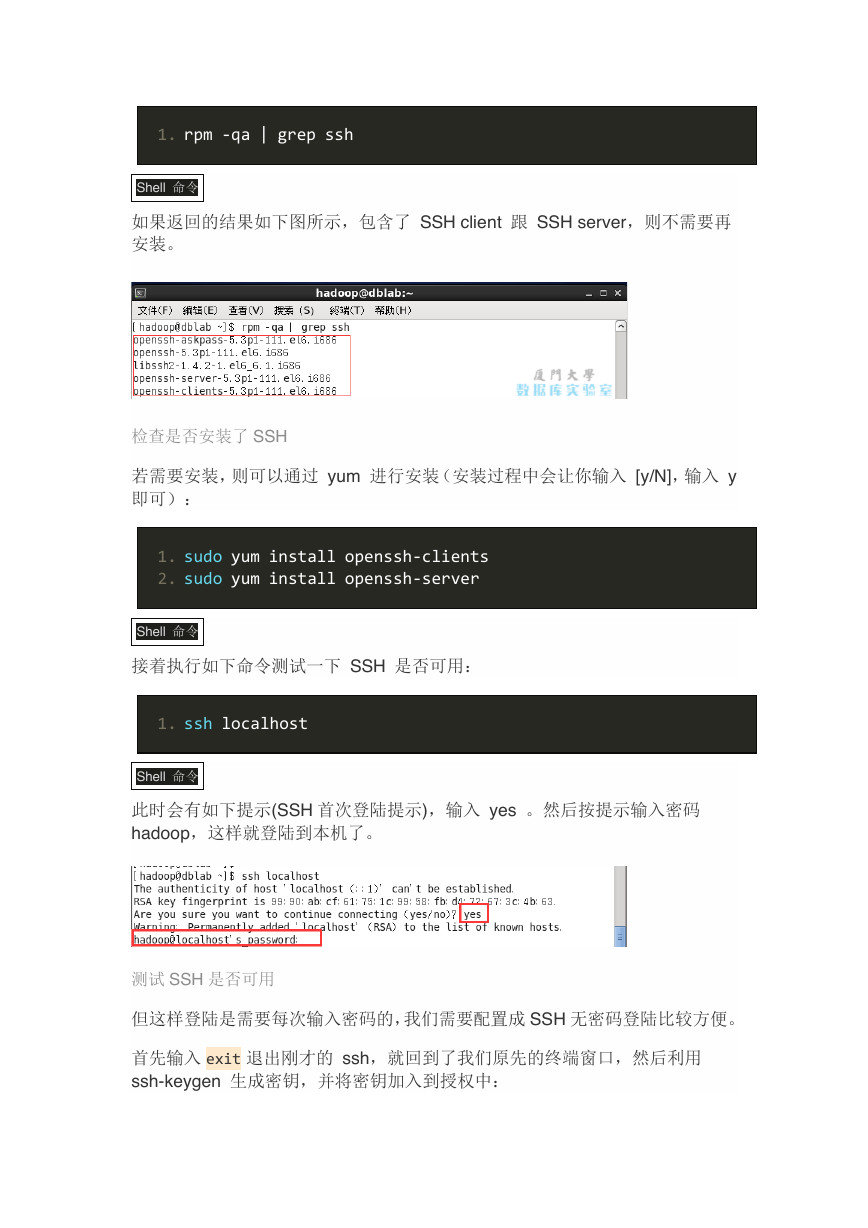

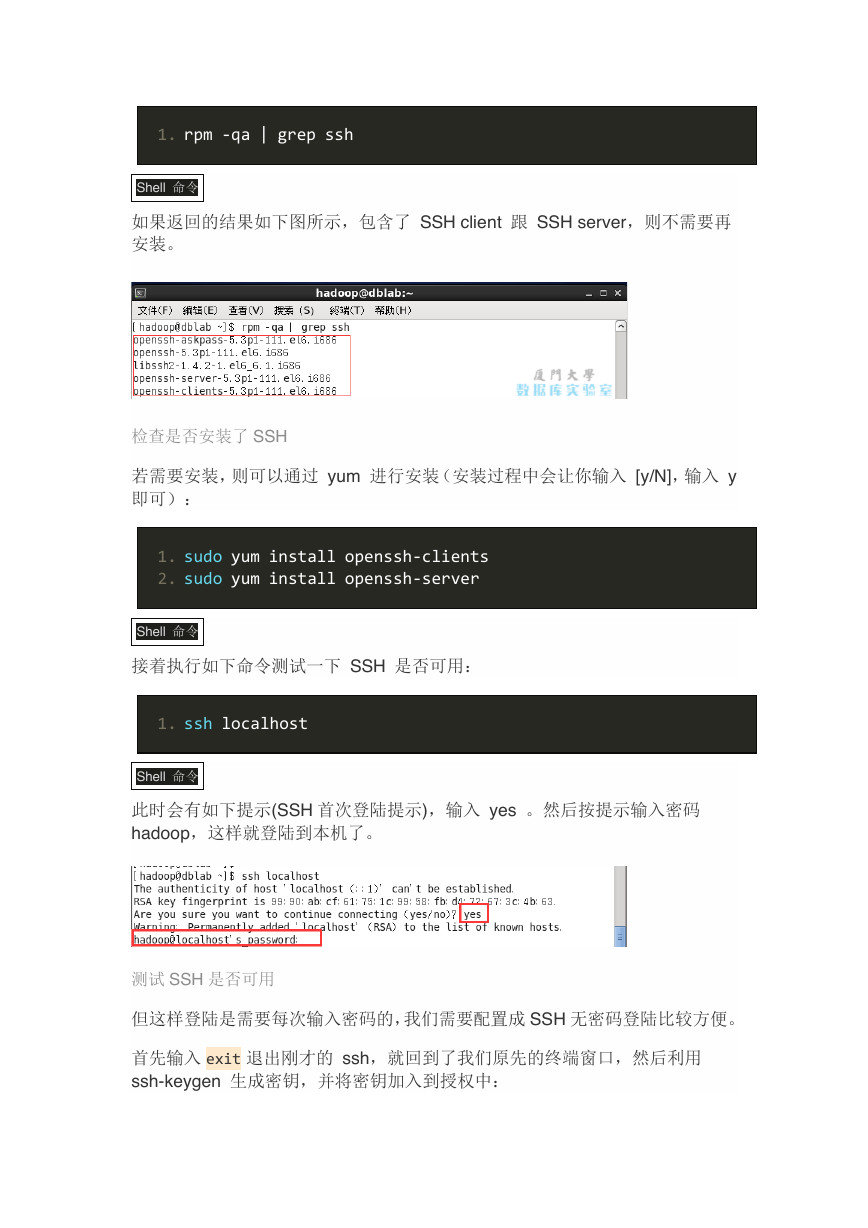

如果返回的结果如下图所示,包含了 SSH client 跟 SSH server,则不需要再

安装。

检查是否安装了 SSH

若需要安装,则可以通过 yum 进行安装(安装过程中会让你输入 [y/N],输入 y

即可):

1. sudo yum install openssh-clients

2. sudo yum install openssh-server

Shell 命令

接着执行如下命令测试一下 SSH 是否可用:

1. ssh localhost

Shell 命令

此时会有如下提示(SSH 首次登陆提示),输入 yes 。然后按提示输入密码

hadoop,这样就登陆到本机了。

测试 SSH 是否可用

但这样登陆是需要每次输入密码的,我们需要配置成 SSH 无密码登陆比较方便。

首先输入 exit 退出刚才的 ssh,就回到了我们原先的终端窗口,然后利用

ssh-keygen 生成密钥,并将密钥加入到授权中:

�

1. exit # 退出刚才的 ssh localhost

2. cd ~/.ssh/ # 若没有该目录,请先执行一次ss

h localhost

3. ssh-keygen -t rsa # 会有提示,都按回车就可以

4. cat id_rsa.pub >> authorized_keys # 加入授权

5. chmod 600 ./authorized_keys # 修改文件权限

Shell 命令

~的含义

在 Linux 系统中,~ 代表的是用户的主文件夹,即 “/home/用户名” 这个目录,

如你的用户名为 hadoop,则 ~ 就代表 “/home/hadoop/”。 此外,命令中的 #

后面的文字是注释。

此时再用 ssh localhost 命令,无需输入密码就可以直接登陆了,如下图所示。

SSH 无密码登录

1.3 安装 Java 环境

Java 环境可选择 Oracle 的 JDK,或是 OpenJDK,现在一般 Linux 系统默

认安装的基本是 OpenJDK,如 CentOS 6.4 就默认安装了 OpenJDK 1.7。

按 http://wiki.apache.org/hadoop/HadoopJavaVersions 中说的,Hadoop 在

OpenJDK 1.7 下运行是没问题的。需要注意的是,CentOS 6.4 中默认安装的

只是 Java JRE,而不是 JDK,为了开发方便,我们还是需要通过 yum 进行安

装 JDK,安装过程中会让输入 [y/N],输入 y 即可:

1. sudo yum install java-1.7.0-openjdk java-1.7.0-openjdk-de

vel

Shell 命令

通过上述命令安装 OpenJDK,默认安装位置为 /usr/lib/jvm/java-1.7.0-openjdk

(该路径可以通过执行 rpm -ql java-1.7.0-openjdk-devel | grep

'/bin/javac' 命令确定,执行后会输出一个路径,除去路径末尾的 “/bin/javac”,

剩下的就是正确的路径了)。OpenJDK 安装后就可以直接使用 java、javac 等

命令了。

�

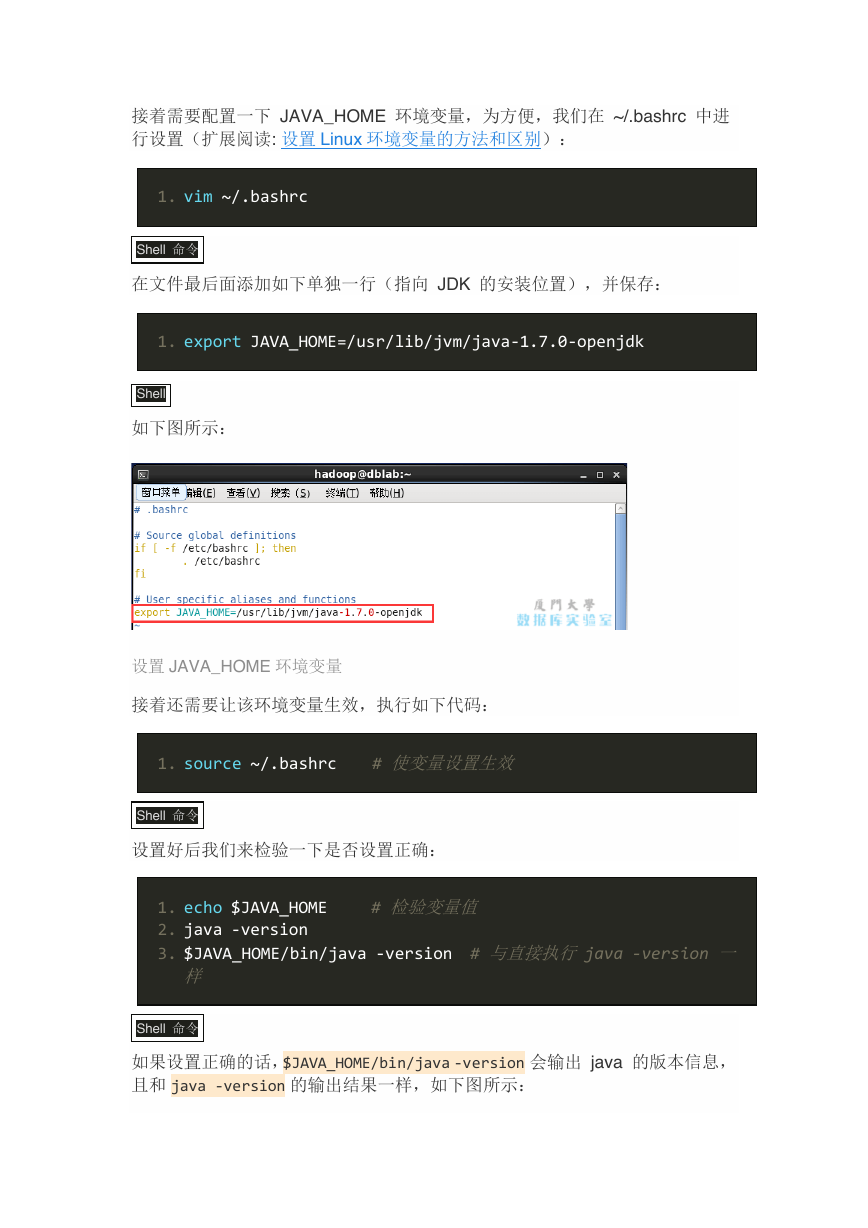

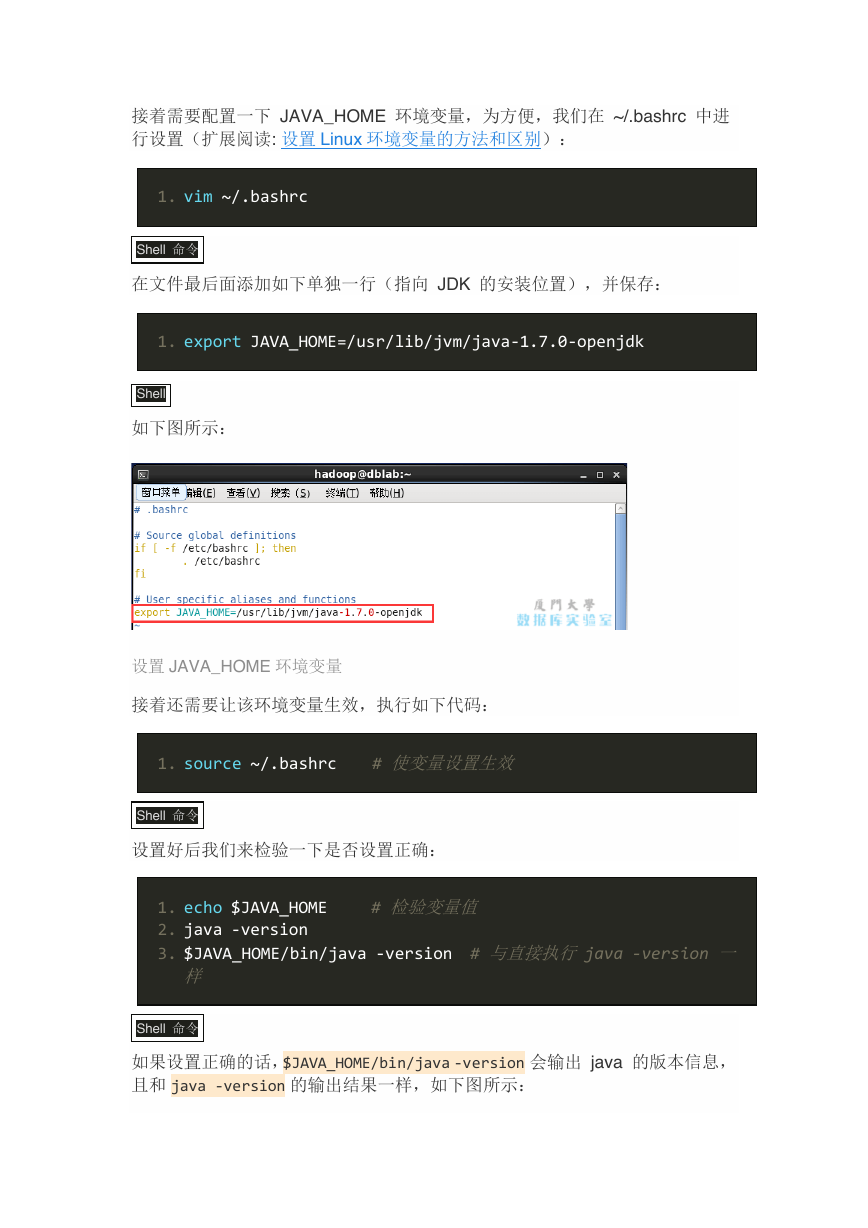

接着需要配置一下 JAVA_HOME 环境变量,为方便,我们在 ~/.bashrc 中进

行设置(扩展阅读: 设置 Linux 环境变量的方法和区别):

1. vim ~/.bashrc

Shell 命令

在文件最后面添加如下单独一行(指向 JDK 的安装位置),并保存:

1. export JAVA_HOME=/usr/lib/jvm/java-1.7.0-openjdk

Shell

如下图所示:

设置 JAVA_HOME 环境变量

接着还需要让该环境变量生效,执行如下代码:

1. source ~/.bashrc # 使变量设置生效

Shell 命令

设置好后我们来检验一下是否设置正确:

1. echo $JAVA_HOME # 检验变量值

2. java -version

3. $JAVA_HOME/bin/java -version # 与直接执行 java -version 一

样

Shell 命令

如果设置正确的话,$JAVA_HOME/bin/java -version 会输出 java 的版本信息,

且和 java -version 的输出结果一样,如下图所示:

�

成功设置 JAVA_HOME 环境变量

这样,Hadoop 所需的 Java 运行环境就安装好了。

3、安装 Hadoop 2

3.1 下载安装文件

Hadoop 2 可以通过 http://mirror.bit.edu.cn/apache/hadoop/common/ 或

者 http://mirrors.cnnic.cn/apache/hadoop/common/下载,本教程选择的是

2.6.0 版本,下载时请下载 hadoop-2.x.y.tar.gz 这个格式的文件,这是编译好

的,另一个包含 src 的则是 Hadoop 源代码,需要进行编译才可使用。

下载时强烈建议也下载 hadoop-2.x.y.tar.gz.mds 这个文件,该文件包含了检验

值可用于检查 hadoop-2.x.y.tar.gz 的完整性,否则若文件发生了损坏或下载不

完整,Hadoop 将无法正常运行。

本文涉及的文件均通过浏览器下载,默认保存在 “下载” 目录中(若不是请自行

更改 tar 命令的相应目录)。另外,如果你用的不是 2.6.0 版本,则将所有命

令中出现的 2.6.0 更改为你所使用的版本。

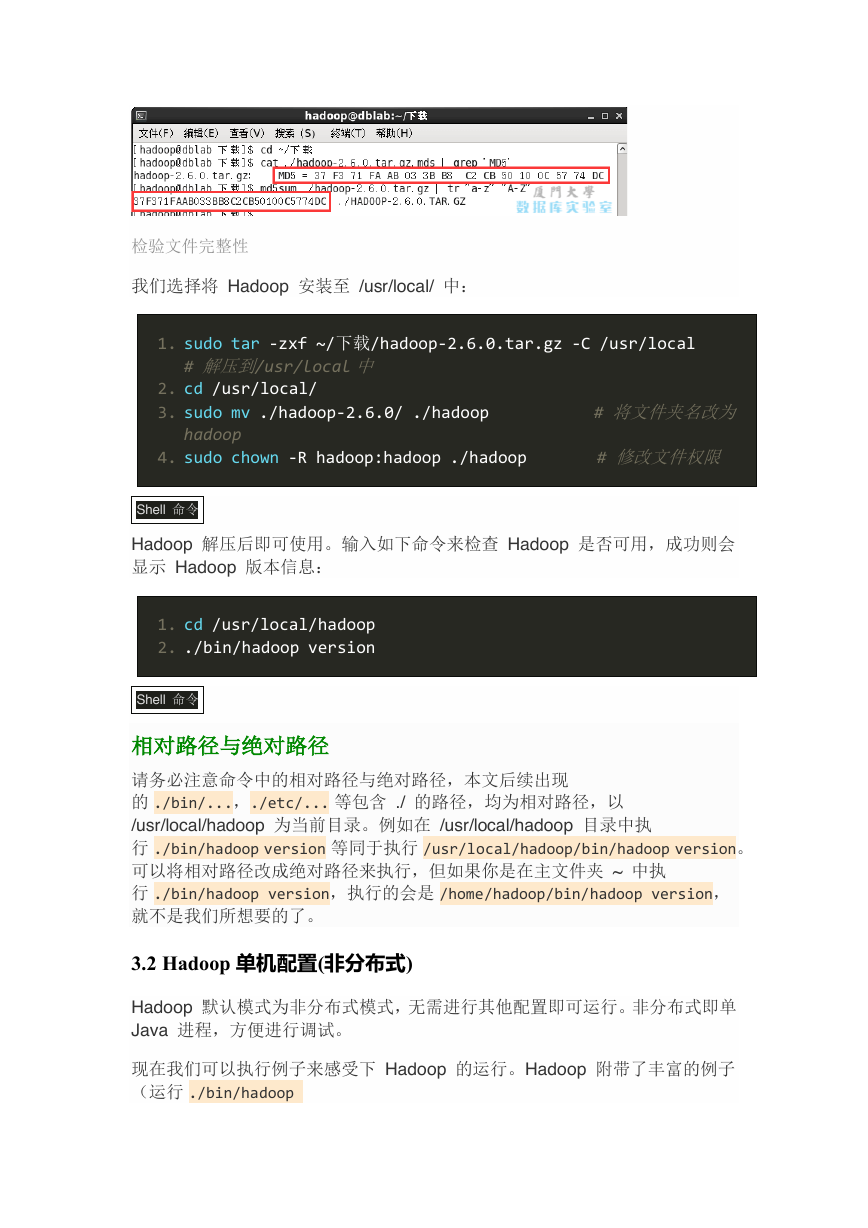

1. cat ~/下载/hadoop-2.6.0.tar.gz.mds | grep 'MD5' # 列出md5

检验值

2. # head -n 6 ~/下载/hadoop-2.7.1.tar.gz.mds # 2.7.1 版本格式

3. md5sum ~/下载/hadoop-2.6.0.tar.gz | tr "a-z" "A-Z" # 计算m

变了,可以用这种方式输出

d5 值,并转化为大写,方便比较

Shell 命令

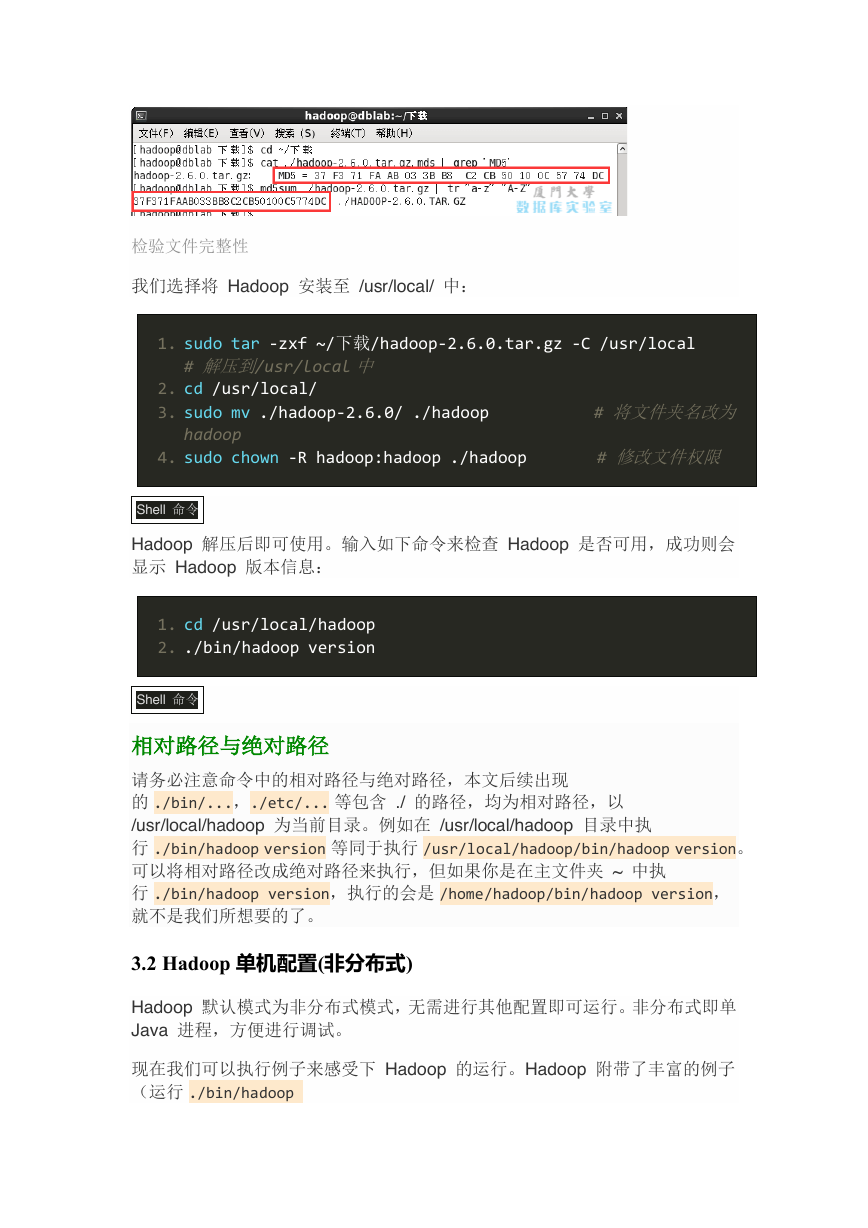

若文件不完整则这两个值一般差别很大,可以简单对比下前几个字符跟后几个字

符是否相等即可,如下图所示,如果两个值不一样,请务必重新下载。

�

检验文件完整性

我们选择将 Hadoop 安装至 /usr/local/ 中:

1. sudo tar -zxf ~/下载/hadoop-2.6.0.tar.gz -C /usr/local

# 解压到/usr/local 中

2. cd /usr/local/

3. sudo mv ./hadoop-2.6.0/ ./hadoop # 将文件夹名改为

hadoop

4. sudo chown -R hadoop:hadoop ./hadoop # 修改文件权限

Shell 命令

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会

显示 Hadoop 版本信息:

1. cd /usr/local/hadoop

2. ./bin/hadoop version

Shell 命令

相对路径与绝对路径

请务必注意命令中的相对路径与绝对路径,本文后续出现

的 ./bin/...,./etc/... 等包含 ./ 的路径,均为相对路径,以

/usr/local/hadoop 为当前目录。例如在 /usr/local/hadoop 目录中执

行 ./bin/hadoop version 等同于执行 /usr/local/hadoop/bin/hadoop version。

可以将相对路径改成绝对路径来执行,但如果你是在主文件夹 ~ 中执

行 ./bin/hadoop version,执行的会是 /home/hadoop/bin/hadoop version,

就不是我们所想要的了。

3.2 Hadoop 单机配置(非分布式)

Hadoop 默认模式为非分布式模式,无需进行其他配置即可运行。非分布式即单

Java 进程,方便进行调试。

现在我们可以执行例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子

(运行 ./bin/hadoop

�

jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.6.0.jar 可以

看到所有例子),包括 wordcount、terasort、join、grep 等。

在此我们选择运行 grep 例子,我们将 input 文件夹中的所有文件作为输入,

筛选当中符合正则表达式 dfs[a-z.]+ 的单词并统计出现的次数,最后输出结果

到 output 文件夹中。

1. cd /usr/local/hadoop

2. mkdir ./input

3. cp ./etc/hadoop/*.xml ./input # 将配置文件作为输入文件

4. ./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduc

e-examples-*.jar grep ./input ./output 'dfs[a-z.]+'

5. cat ./output/* # 查看运行结果

Shell 命令

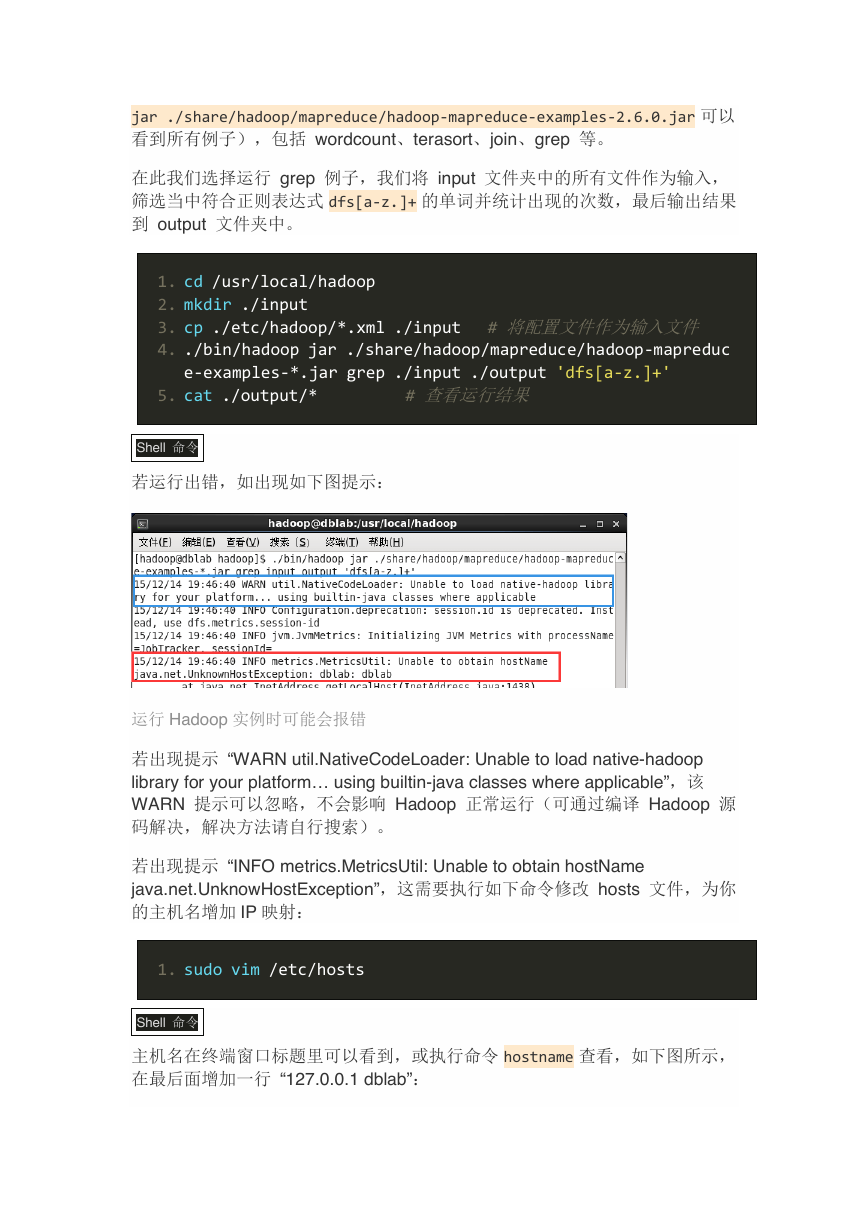

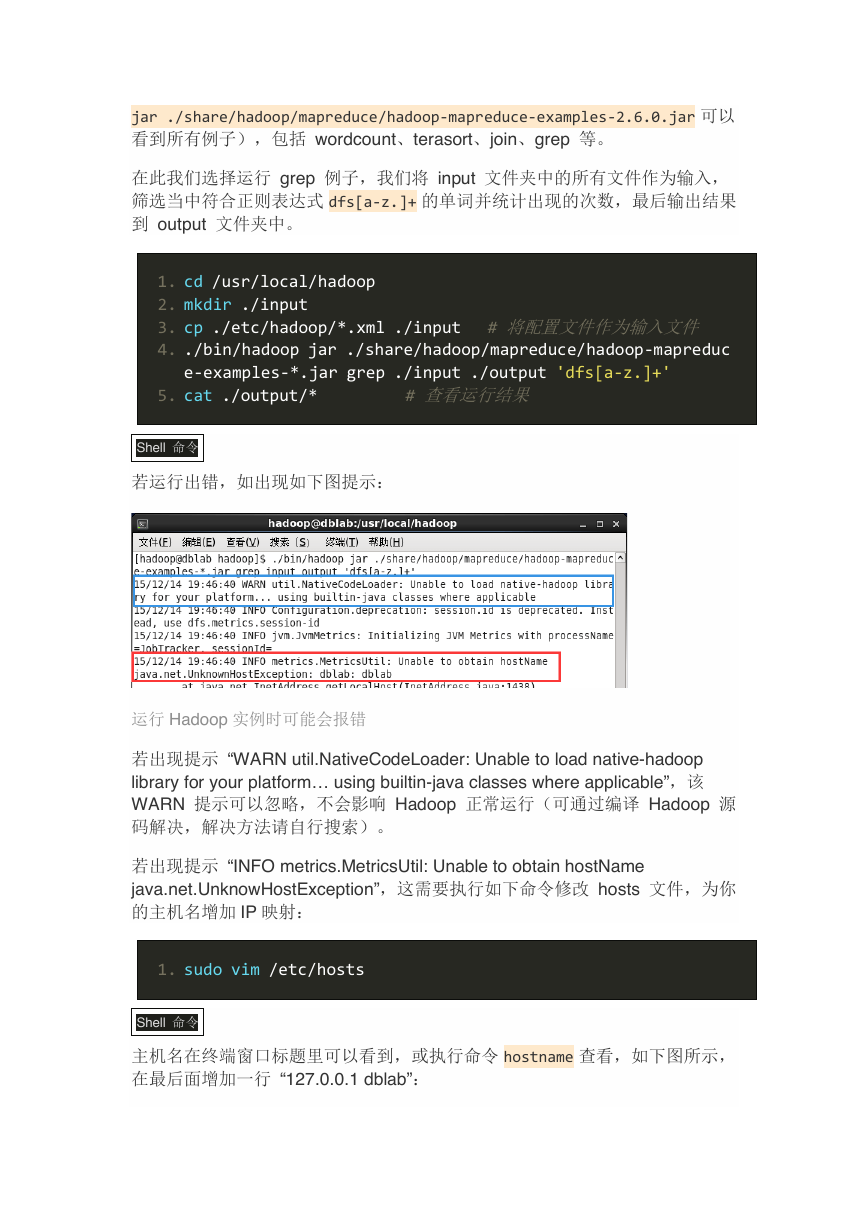

若运行出错,如出现如下图提示:

运行 Hadoop 实例时可能会报错

若出现提示 “WARN util.NativeCodeLoader: Unable to load native-hadoop

library for your platform… using builtin-java classes where applicable”,该

WARN 提示可以忽略,不会影响 Hadoop 正常运行(可通过编译 Hadoop 源

码解决,解决方法请自行搜索)。

若出现提示 “INFO metrics.MetricsUtil: Unable to obtain hostName

java.net.UnknowHostException”,这需要执行如下命令修改 hosts 文件,为你

的主机名增加 IP 映射:

1. sudo vim /etc/hosts

Shell 命令

主机名在终端窗口标题里可以看到,或执行命令 hostname 查看,如下图所示,

在最后面增加一行 “127.0.0.1 dblab”:

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc