《信息理论与编码》习题参考答案

第 1 章

1. 信 息 是什 么 ?信 息 与消 息 有 什 么 区别 和 联 系 ?

答 :信 息 是对 事 物 存 在 和运 动 过 程 中 的不 确 定 性 的 描述 。信息就是各种消息符号所包含

的具有特定意义的抽象内容,而消息是信息这一抽象内容通过语言、文字、图像和数据等的具体

表现形式。

2. 语 法 信息 、 语 义 信 息和 语 用 信 息 的定 义 是 什 么 ?三 者 的 关 系 是什 么 ?

答 : 语 法 信息 是 最 基 本 最抽 象 的 类 型 ,它 只 是 表 现 事物 的 现 象 而 不考 虑 信息 的 内 涵 。

语 义 信 息 是 对 客 观 现 象 的 具 体 描 述 , 不 对 现 象 本 身 做 出 优 劣 判 断 。 语 用 信 息 是 信 息 的 最

高 层 次。它 以 语法 、语 义 信息 为 基 础 ,不 仅 要考 虑 状 态 和 状态 之 间 关 系 以及 它 们 的 含 义,

还 要 进 一 步 考 察 这 种 关 系 及 含 义 对 于 信 息 使 用 者 的 效 用 和 价 值 。 三 者 之 间 是 内 涵 与 外 延

的 关 系。

第 2 章

1. 一个布袋内放 100 个球,其中 80 个球是红色的,20 个球是白色的,若随机摸取一个球,

猜测其颜色,求平均摸取一次所能获得的自信息量?

答:依据题意,这一随机事件的概率空间为

X

P

x

x

1

2

0.8 0.2

其中: 1x 表示摸出的球为红球事件, 2x 表示摸出的球是白球事件。

a)如果摸出的是红球,则获得的信息量是

log

log 0.8

I x

1

p x

1

(比特)

b)如果摸出的是白球,则获得的信息量是

log

I x

2

p x

2

log 0.2

(比特)

c) 如果每次摸出一个球后又放回袋中,再进行下一次摸取。则如此摸取 n 次,红球出现的

次数为

1

np x 次,白球出现的次数为

np x 次。随机摸取 n 次后总共所获得信息量为

np x I x

1

np x

I x

2

1

2

2

d)则平均随机摸取一次所获得的信息量为

H X

np x I x

1

1

1

n

log

p x

1

0.72

比特/次

p x

np x

log

2

2

I x

p x

2

2

p x

1

2. 居住某地区的女孩中有 25%是大学生,在女大学生中有 75%是身高 1.6 米以上的,而女孩

中身高 1.6 米以上的占总数的一半。假如我们得知“身高 1.6 米以上的某女孩是大学生”的消息,

问获得多少信息量?

答 : 设 事件 A 为 女 孩是 大 学 生 ; 设事 件 B 为 女 孩身 高 1.6 米 以 上。

�

根 据 题意 , 则 知 :

P A

0.25

P B

0.50

P B A

0.75

而“身 高 1.6 米 以 上的 某 女 孩 是 大学 生 ”这 消 息表 明 是 在 B 事 件 发生 的 条 件 下,A 事 件 发

生 。 所以 其 概 率 为

P A B

根 据 贝叶 斯 定 律 可 得

P A B

P AB

P B

P A P B A

P B

0.25 0.75

0.5

0.375

则 得 知“ 身 高 1.6 米 以 上的 某 女 孩 是 大学 生 ” 这 消 息, 能 获 得 的 信息 量

I A B

log

P A B

log 0.375 1.415

( 比 特)

3. 设一个系统传送 10 个数字:0,1,2,…,9。奇数在以 0.5 的概率传送时,接收端有可能错误地

判断成为另外的奇数,而其他数字完全正确地接收。求收到一个数字后平均得到的信息量?

答:发 送 集合

X

0,1,

… 接 收 集合

,9 ,

Y

0,1,

…

,9 ,

其 中

p y

i

1

10

i

0,2,4,6,8

p y

p y

i x

i x

j

j

1

8

1

2

i

,

i

,

j

1,3,5,7,9

i

j

j

1,3,5,7,9

i

j

)

i

p x

j p y

i x

j

1

10

i

,

j

1,3,5,7,9

i

,

j

因 为

所 以

(

p y

最后得:

H Y

9

i

0

p y

i

log

p y

i

log10 3.232

( 比 特 /符 号 )

4. 某一无记忆信源的符号集为{0,1},已知信源的概率空间为

X

P

0

3

4

1

1

4

。

(1) 求信源熵。

(2) 求由 m 个“0”和(100- m )个“l”构成的某一特定序列的自信息量的表达式。

(3) 计算由 100 个符号构成的符号序列的熵。

答:

2

�

(1) 信 源熵 为

1

4

(2) 该 特定 序 列 用 A 表 示 则

H X

log 4

3

4

log

4

3

0.8113

比特/符号

I

A

log

1

4

m

100

m

(3) 因 为信 源 是 无 记 忆信 源 , 所 以

3

4

m

41.5 1.585 (bit)

H X

100

100

H X

81.13

比特/符号序列

5. 有一离散无记忆信源,其输出为

X

0,1,2

,相应的概率为 0

p , 1 1/ 4

p , 2

1/ 4

p ,

1/ 2

设计两个独立实验去观察它,其结果分别为

Y

1

0,1

,

Y

2

0,1

。

已知条件概率如表 2-4 所示。

p y x

1

0

1

表 2-4 习 题 5 表

x

p y

2

0

1

0

1

2

1

0

1/2

0

1

1/2

0

1

2

1

1

0

0

0

1

(1) 求

I X Y 和

1;

2;

I X Y ,并判断作哪一个实验好些。

(2) 求

2

1

I X Y Y ,并计算作 Y1和 Y2 两个实验比作 Y1或 Y2中的一个实验各可多得多少关于 X

;

,

的信息。

(3) 求

I X Y Y 和

;

1

2

1

2

I X Y Y ,并解释它们的含义。

;

答:

( 1)

I X Y H Y

1

=

;

1

H Y X

1

1P Y X 已 知 。

I X Y H Y

2

=

;

2

H Y X

2

2P Y X 已 知 。

由

P XY

1

P X P Y X

1

,要 求

1H Y 和

1H Y X 需 要 先求

1P Y ,

P XY ,

1

,要 求

2H Y 和

2H Y X 需 要 先求

2P Y ,

P XY ,

2

及 联 合 概 率 分 布 与 边 缘 概 率 分 布 的 关 系 可 得

1

P XY

及

1P Y , 如 表 2-1 所 示 :

表 2-1

3

�

1Y

1

P XY

X

0

1

2

1P Y

2Y

2

P XY

X

0

1

2

2P Y

1

0

1/4

1/4

1/2

0

1/4

0

1/4

1/2

0

1/4

1/4

0

1/2

1

0

0

1/2

1/2

所 以

比特/符号

1

H Y

1

4

log1

1

log 2

2

1

4

1

2

1

4

H Y X

log1

1

H Y

1

log 2

log 2 1

1

log 2

4

1

1

1

=

2

2

比特/符号

1

2

比特/符号

H Y X

1

;

I X Y

1

同 样 可求 出

P XY 及

2P Y , 如 表 2-2 所 示 :

2

所 以

H Y X

2

H Y

1

4

;

I X Y

2

2

1

2

log1

log 2

1

4

1

2

log1

1

2

H Y X

2

H Y

2

log 2 1

比特/符号

比特/符号

log1 0

1

比特/符号

因 此 第二 个 实 验 好 些。

( 2 )

I X YY

1 2

;

H Y Y

2 2

H Y Y X

2 2

P XYY 。 由 于 1Y 、 2Y 是 相 互独 立 的 实 验 ,所 以

1 2

P YY X

1 2

, 因 此 要 求 出

P YY X 和

1 2

1 2

P YY ,

=

P Y X P Y X 。

1

2

1

P Y X

P Y X

2

P YY X

1 2

P XYY

1 2

P YY

1 2

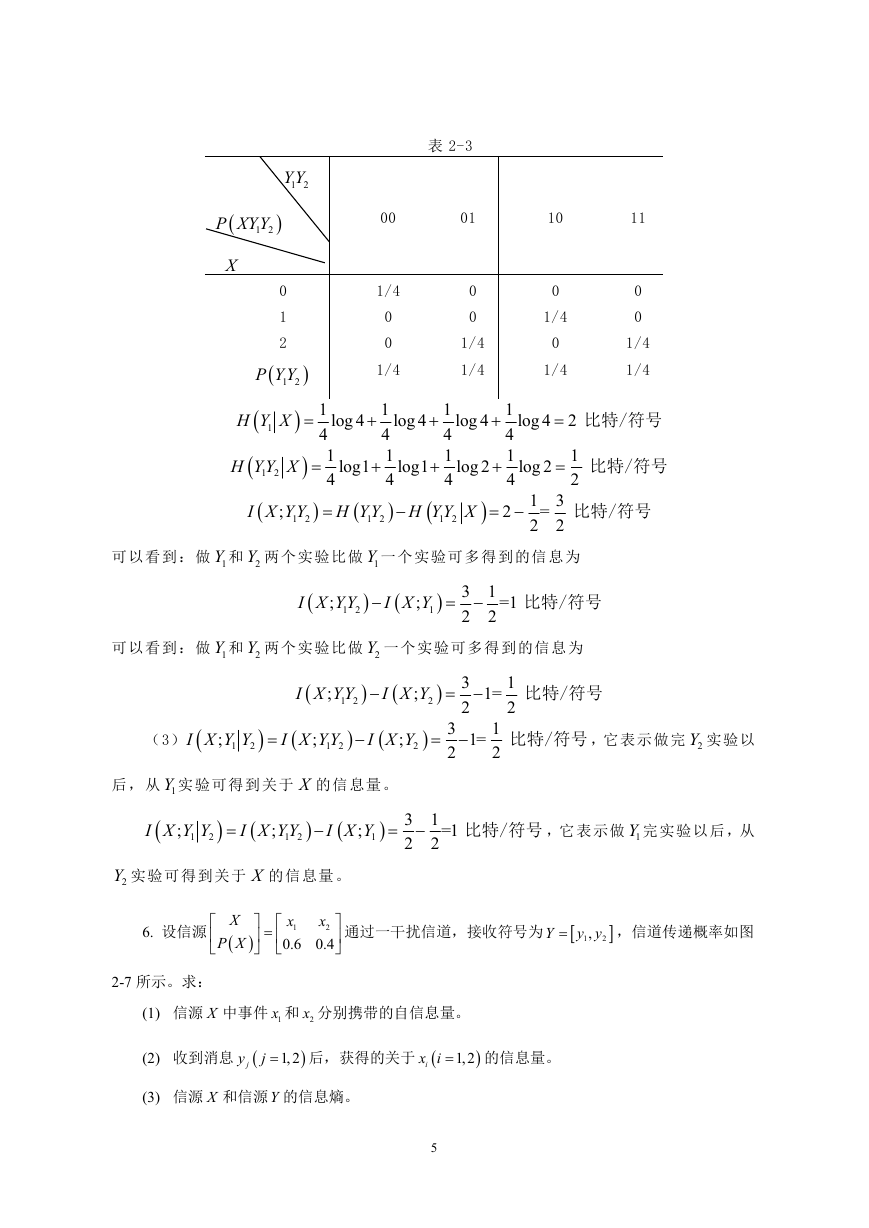

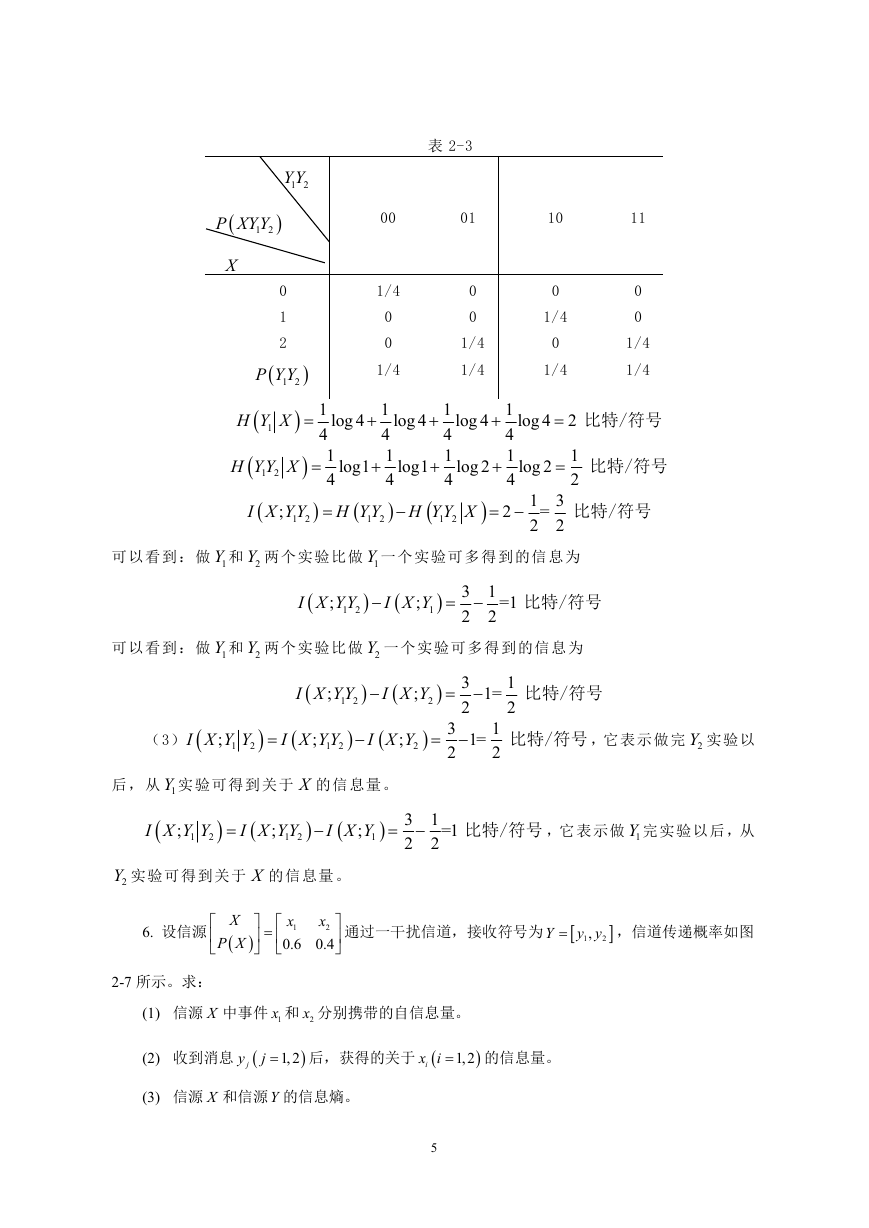

( 见 表 2-2 和 表 2-3)

表 2-2

P YY X

1 2

X

1 2YY

0

1

2

00

01

10

11

1

0

0

0

0

1/2

4

0

1

0

0

0

1/2

�

1 2YY

P XYY

1 2

X

0

1

2

P YY

1 2

表 2-3

00

01

10

11

0

1/4

0

1/4

0

0

1/4

1/4

1/4

0

0

1/4

0

0

1/4

1/4

log 4

log 2

1

H Y X

1

log 4

4

1

H YY X

4

I X YY

1 2

1 2

;

log1

H YY

1 2

1

4

1

4

1

log 4

4

1

4

log1

H YY X

1 2

1

4

1

4

2

log 4

比特/符号

比特/符号

2

1

2

3

=

比特/符号

2

log 2

1

2

可 以 看到 : 做 1Y 和 2Y 两 个 实验 比 做 1Y 一 个 实验 可 多 得 到 的信 息 为

I X YY

1 2

;

;

I X Y

1

3

2

1

2

=1

比特/符号

可 以 看到 : 做 1Y 和 2Y 两 个 实验 比 做 2Y 一 个 实验 可 多 得 到 的信 息 为

I X YY

1 2

;

;

I X Y

2

(3)

I X Y Y

2

;

1

I X YY

1 2

;

;

I X Y

2

比特/符号

1

3

1=

2

2

1

1=

比特/符号 ,它 表 示做 完 2Y 实 验 以

2

3

2

后 , 从 1Y 实 验 可得 到 关 于 X 的 信 息量 。

I X Y Y

2

;

1

I X YY

1 2

;

;

I X Y

1

3

2

1

2

=1

比特/符号 ,它 表 示做 1Y 完 实 验以 后 ,从

2Y 实 验 可得 到 关 于 X 的 信 息量 。

X

6. 设信源

P X

x

x

1

2

0.6 0.4

2-7 所示。求:

通过一干扰信道,接收符号为

Y

,

y y

1

2

,信道传递概率如图

(1) 信源 X 中事件 1x 和 2x 分别携带的自信息量。

(2) 收到消息

jy

j 后,获得的关于

1,2

ix i

1,2

的信息量。

(3) 信源 X 和信源Y 的信息熵。

5

�

(4) 损失熵

H X Y 和噪声熵

H Y X 。

(5) 接收到消息Y 后获得的平均互信息。

图 2-7 习 题 6 图

P x

1

0.6

P x

2

0.4

I x

1

log 0.6 0.737

(比特)

I x

2

log 0.4 1.322

(比特)

答:(1)

因为

所以

(2)

收到消息 iy 的概率为:

2

0.2

所以收到消息 jy 后获得的关于 ix 的信息量即

P x P

P y

1

P y

1

P y

1

i

1

2

i

y

i

I x y 为:

,i

j

x

i

0.6*

5

6

0.4*

3

4

0.8

,

I x y

1

1

log

,

I x y

1

2

log

,

I x y

1

2

log

P y x

1

1

P y

1

log

P y

2

P y

x

1

2

P y x

1

P y

1

2

log

log

,

I x y

2

2

log

P y

2

P y

2

x

2

5

6

0.8

1

6

0.2

3

4

0.8

1

4

0.2

0.059

(比特/符号)

0.263

0.093

(比特/符号)

(比特/符号)

log

0.322

(比特/符号)

(3)

H X

2

i

1

P x

i

log

P x

i

0.6*log 0.6 0.4*log 0.4

0.971

(比特/符号)

6

�

2

i

1

H Y

(4)

其中

P y

i

log

P y

i

0.8*log 0.8 0.2*log 0.2

0.722

(比特/符号)

H Y X

,

X Y

,

P X Y

log

1

YP

X

,

P x y

1

1

,

P x y

1

2

,

P x y

1

2

,

P x y

2

2

P x P y x

1

1

1

0.6*

P x P y

1

x

1

0.6*

2

0.5

0.1

P x P y x

2

1

2

0.4*

P x P y

2

x

2

2

0.4*

0.3

0.1

5

6

1

6

3

4

1

4

所以噪声熵:

H Y X

0.5*log

1

5 6

0.1*log

1

1 6

0.3*log

1

3 4

0.1*log

1

1 4

]

损失熵:

0.715

(比特/符号)

H X Y

H X

0.964

(比特/符号)

H Y X

H Y

0.971 0.715 0.722

(5)接收到消息Y 后所获得的平均互信息量为:

,

I X Y

H X

H X Y

0.971 0.964 0.007

(比特/符号)

7. 某信源的消息符号集的概率分布和二进制代码如题表 2-5 所示。

表 2-5 习 题 7 表

信源符号

0u

1u

2u

3u

概率

代码

1/2

0

1/4

10

1/8

110

1/8

111

试求:

(1) 消息的符号熵。

(2) 平均每个消息符号所需要的二进制码元的个数或平均代码长度结果求码序列中的一个二

进制码元的熵。

(3) 消息是由符号序列组成的,若各符号之间相互独立,假设其对应的二进码序列中出现“0”

和“1”的无条件概率为 0p 和 1p ,求相邻码间的条件概率

p

0 1

、

p

1 0

答:

7

、

p 、

p

11

0 0

。

�

( 1) 信 源熵 为

H U

1

2

log 2

1

4

log 4

1

4

log8

( 2) 设 平均 代 码 长 度 为 L , 则

比特/符号

7

4

L 二进制码元/符号

2

1

3

3

1

2

1

4

1

8

1

8

7

4

二 进 制码 元 的 熵 为

1

比特/二进制码元

H U

L

( 3) 由 于符 号 间 相 互 独立 , 因 此

1

4

L

0

1

2

p

1

8

,

1

p

1

2

1

p

0

1

2

为 求 相邻 码 元 间 的 条件 概 率 , 先 求相 邻 码 元 间 的联 合 概 率 :

p

1,1

1 1

8 8

2

1

8

L

1

4

1

8

1

4

所 以

同 理

11

p

0 1

p

1

1,1

p

1

p

11

p

1

2

1

2

1

4

1 1

2 2

1 1

4 2

1 1

8 2

p

0,0

p

0 0

p

p

1 0

p

1

p

0 0

L

0,0

0

1

2

1

2

8. 二次扩展信源的熵为

H X ,而一阶马尔可夫信源的熵为

2

H X X ,试比较两者的大小,

2

1

并说明原因。

答:

H X

2

2

H X

H X

H X X

2

1

二 次 扩展 信 源 的 熵 是一 个 联 合 熵 ,其 值 应该 大 于 单 符 号信 源 熵 ,而 马 尔可 夫 信 源 的 熵

8

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc