矩阵低秩分解理论及其应用分析

成科扬

2013年9月4日

�

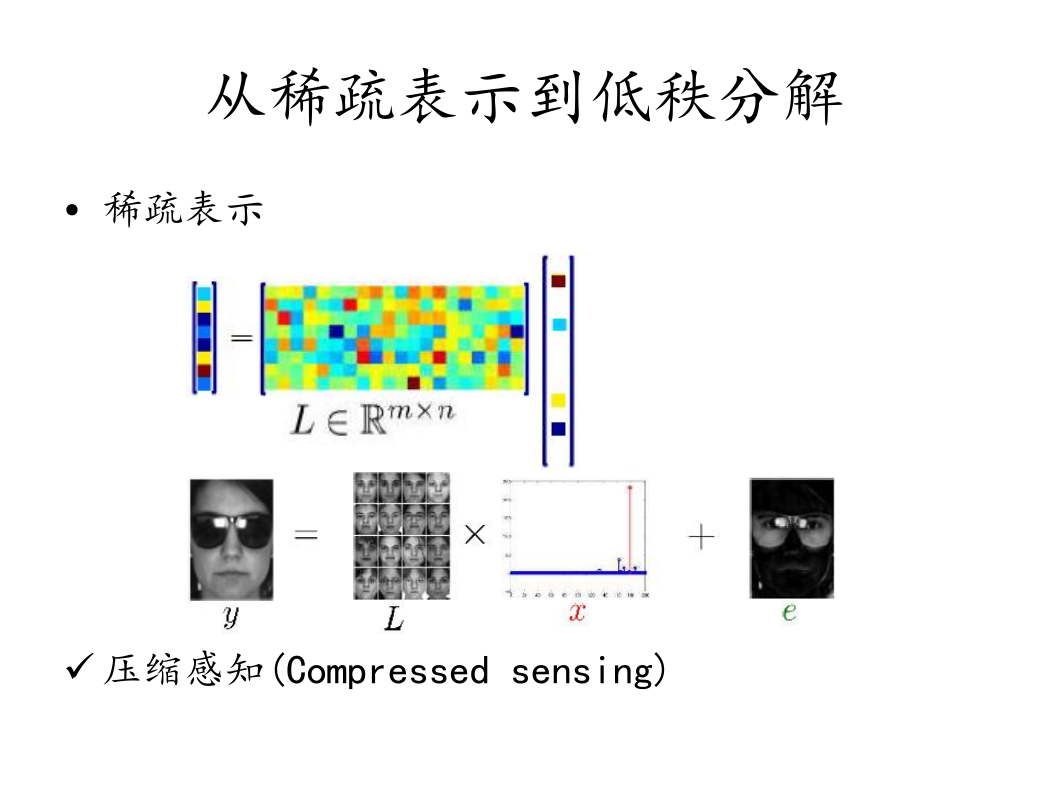

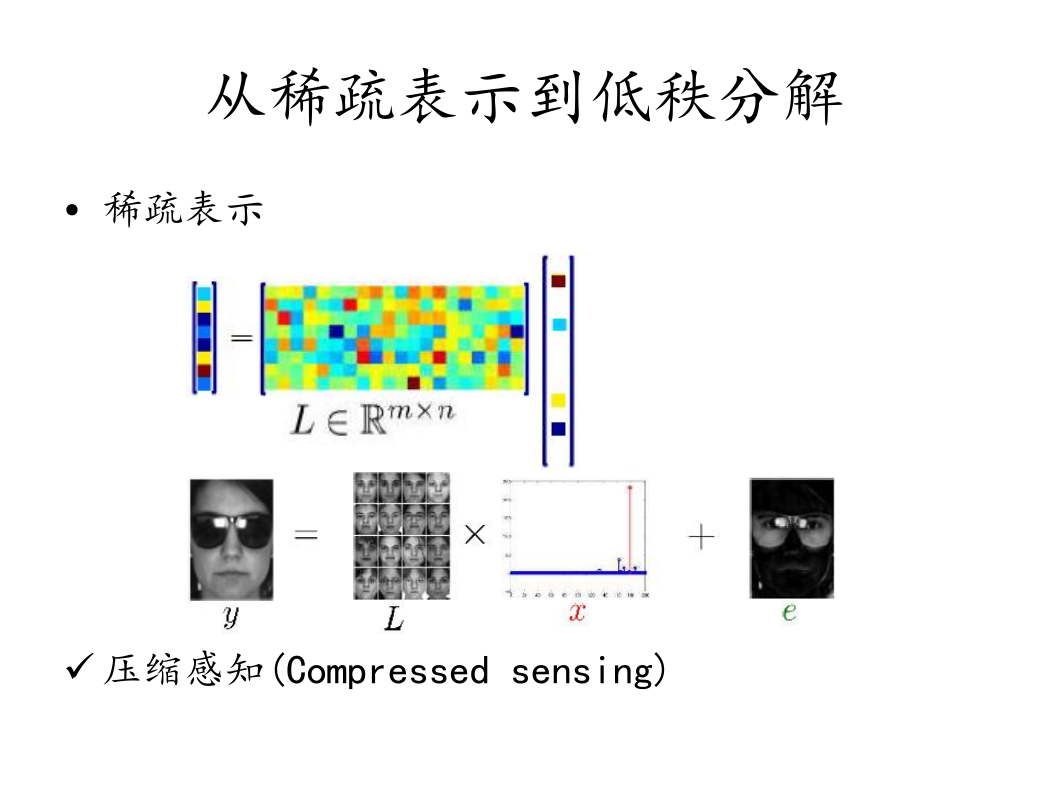

从稀疏表示到低秩分解

• 稀疏表示

ü 压缩感知(Compressed sensing)

�

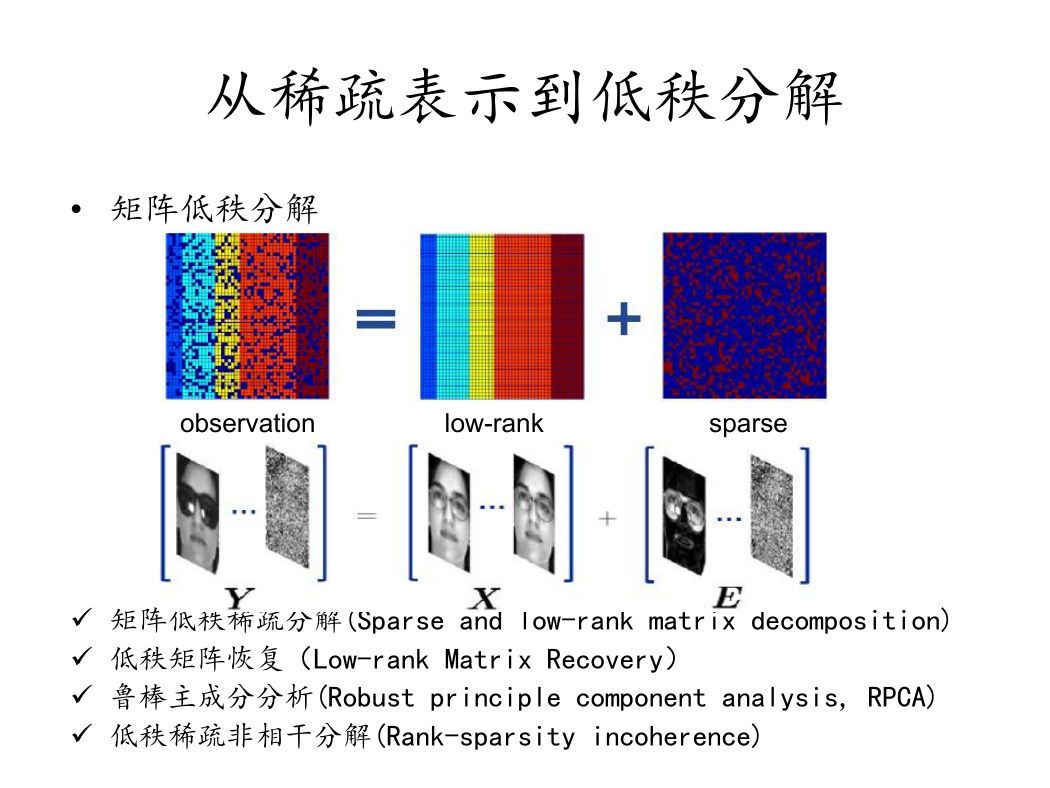

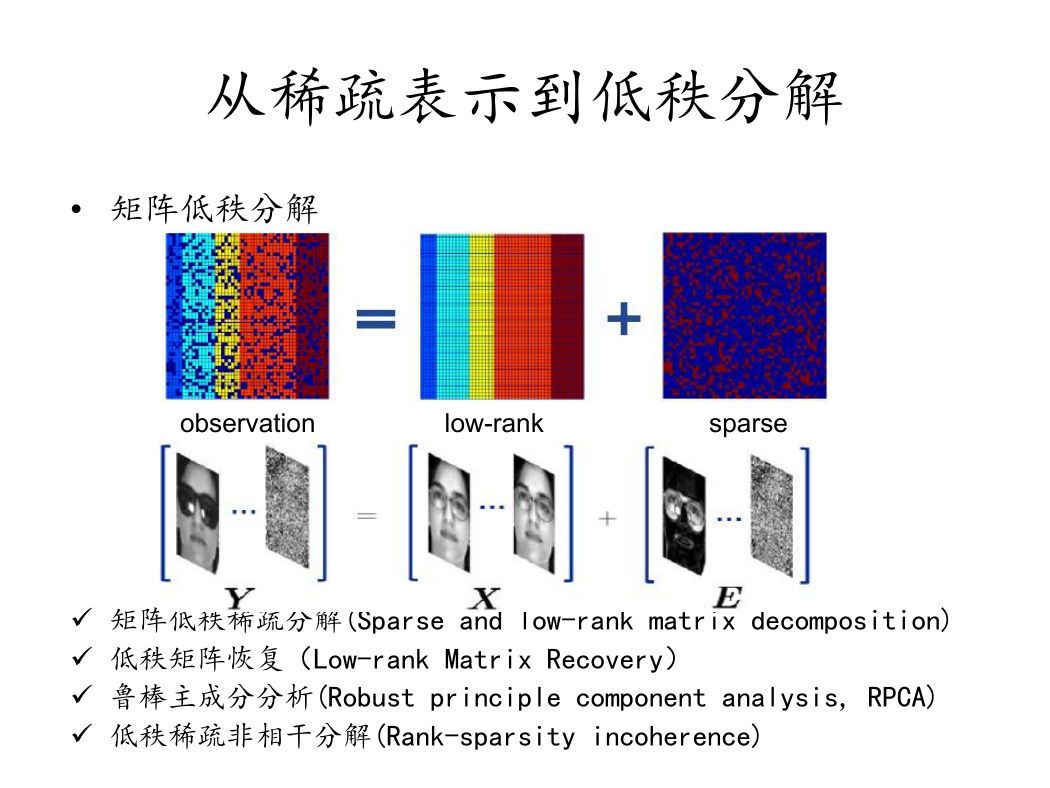

从稀疏表示到低秩分解

• 矩阵低秩分解

observation

low-rank

sparse

ü 矩阵低秩稀疏分解(Sparse and low-rank matrix decomposition)

ü 低秩矩阵恢复(Low-rank Matrix Recovery)

ü 鲁棒主成分分析(Robust principle component analysis, RPCA)

ü 低秩稀疏非相干分解(Rank-sparsity incoherence)

�

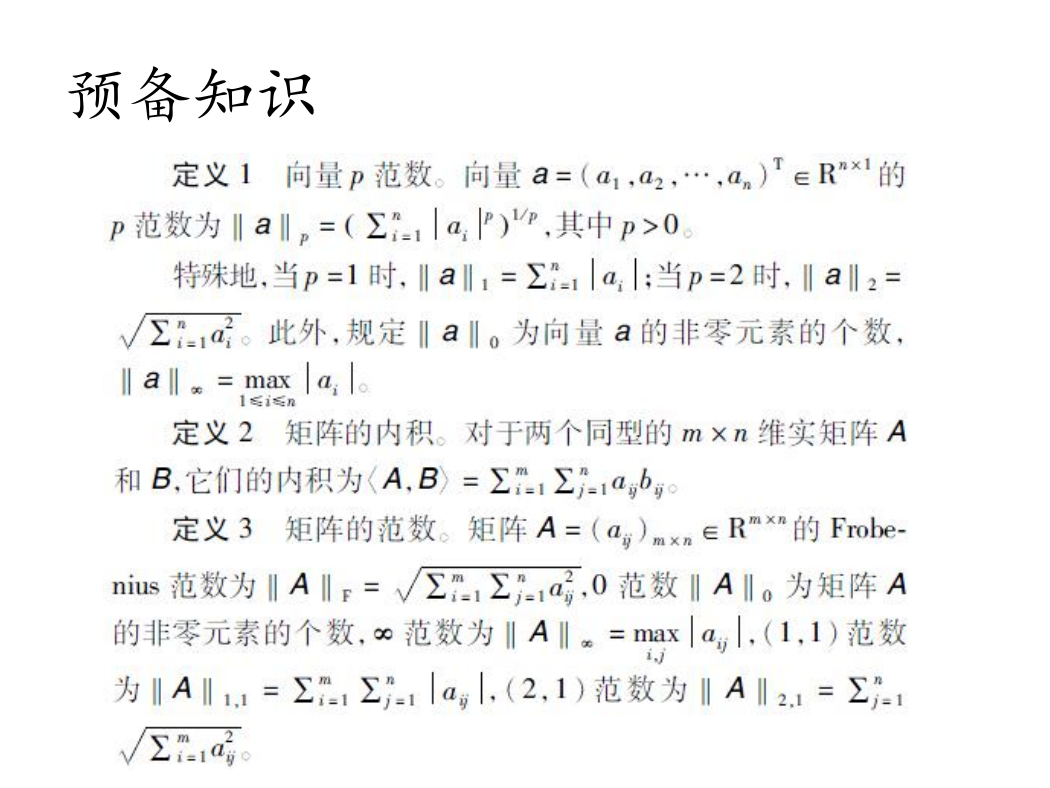

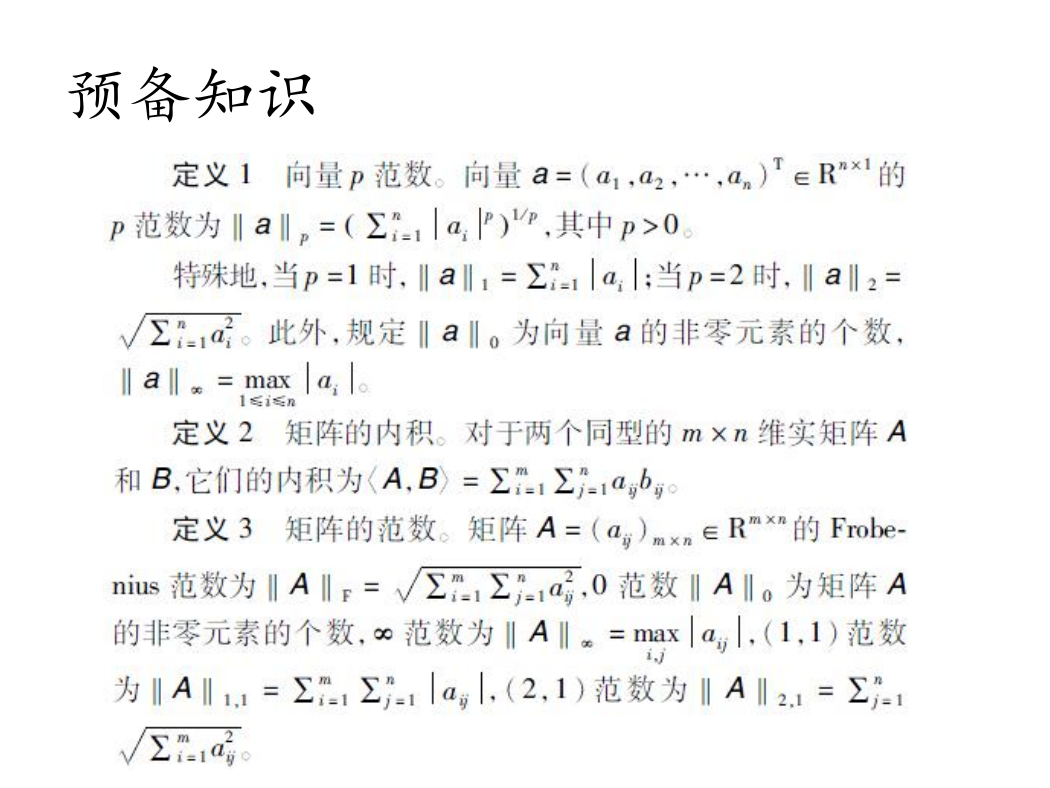

预备知识

�

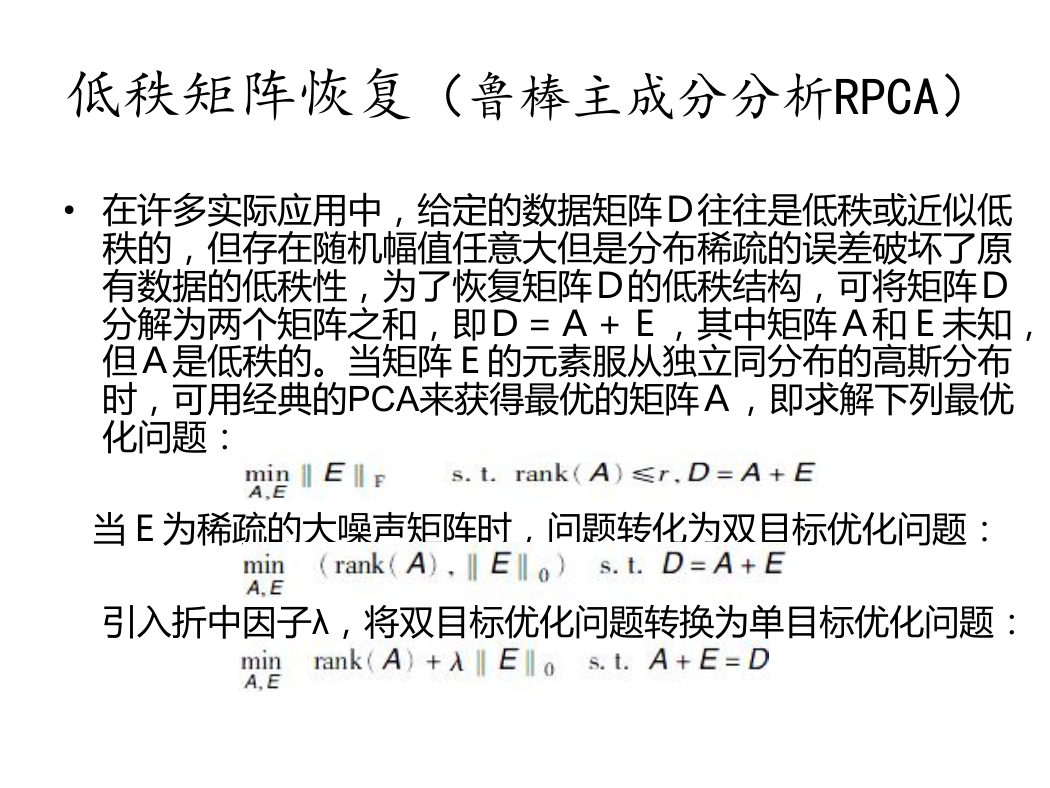

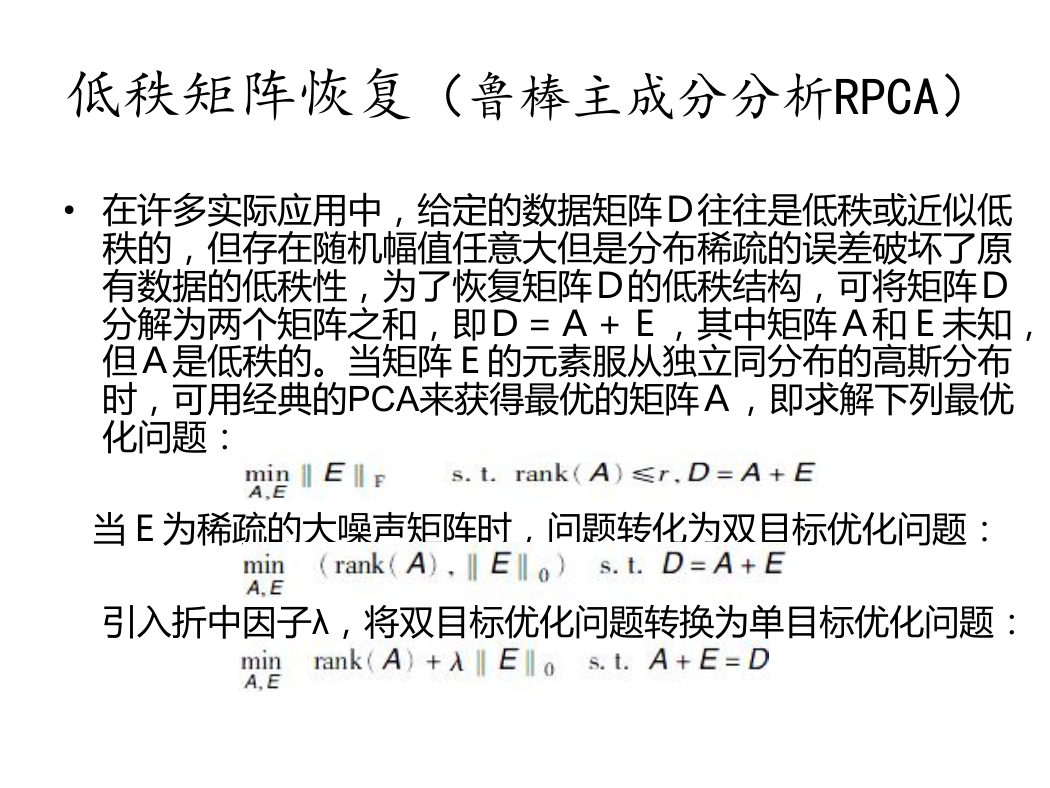

低秩矩阵恢复(鲁棒主成分分析RPCA)

• 在许多实际应用中,给定的数据矩阵D往往是低秩或近似低

秩的,但存在随机幅值任意大但是分布稀疏的误差破坏了原

有数据的低秩性,为了恢复矩阵D的低秩结构,可将矩阵D

分解为两个矩阵之和,即D=A+E,其中矩阵A和E未知,

但A是低秩的。当矩阵E的元素服从独立同分布的高斯分布

时,可用经典的PCA来获得最优的矩阵A,即求解下列最优

化问题:

当E为稀疏的大噪声矩阵时,问题转化为双目标优化问题:

引入折中因子λ,将双目标优化问题转换为单目标优化问题:

�

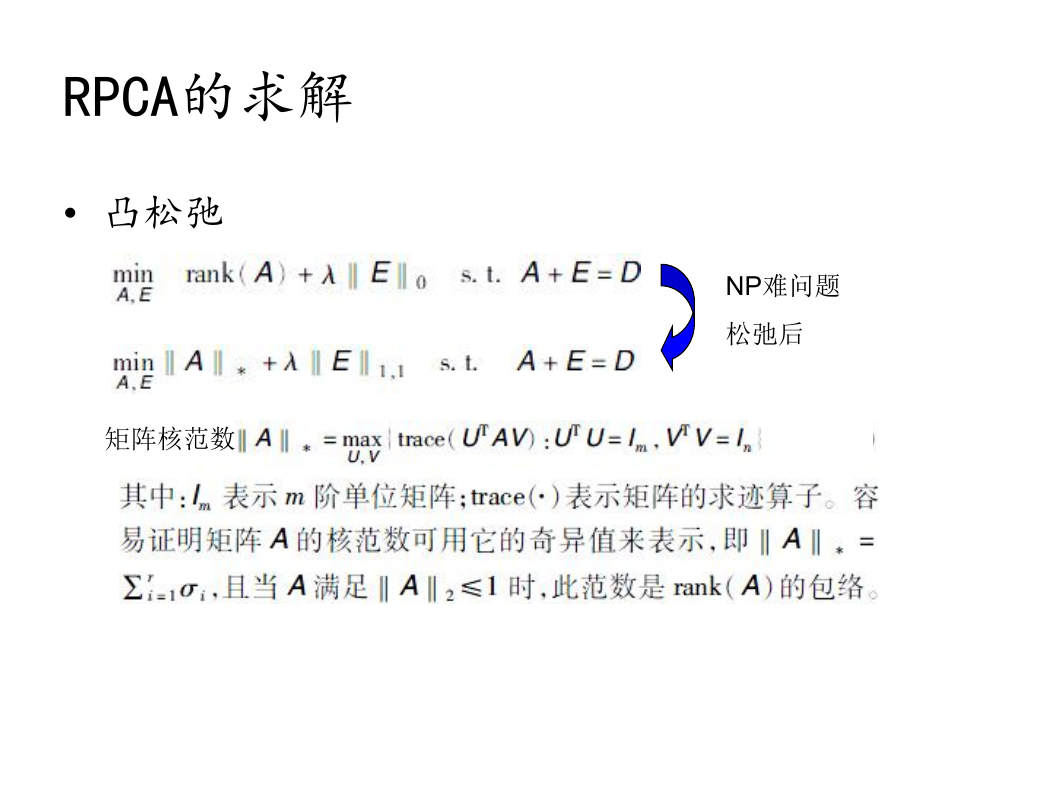

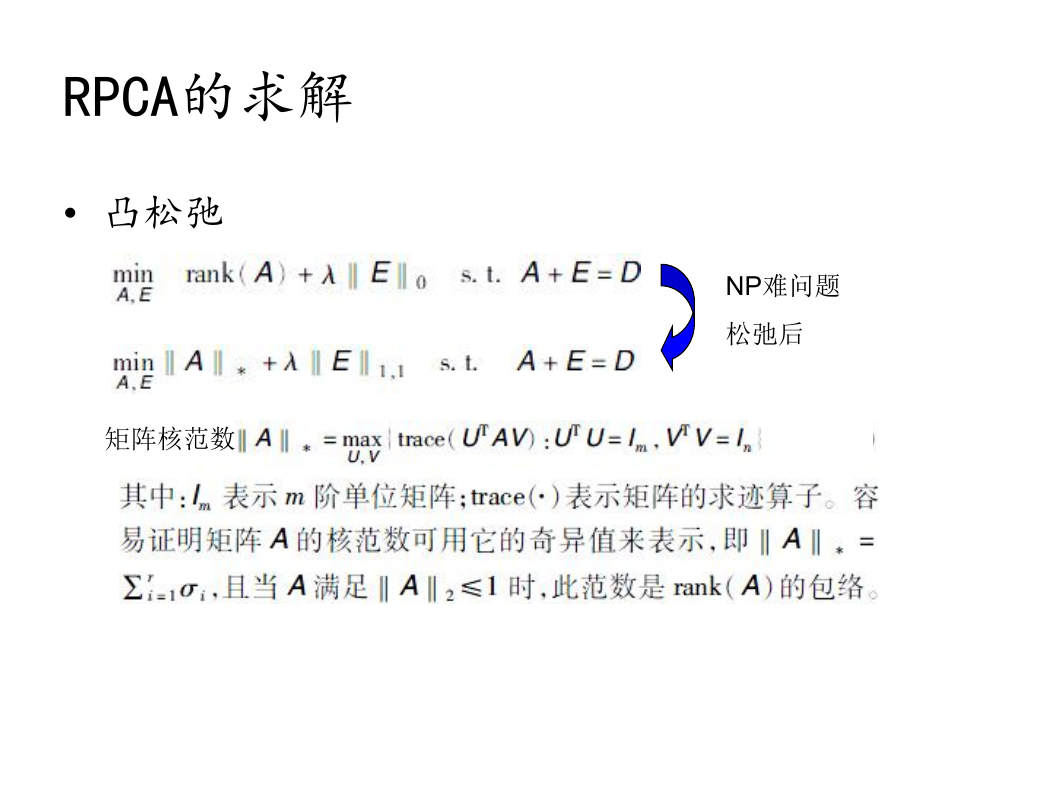

RPCA的求解

• 凸松弛

矩阵核范数

NP难问题

松弛后

�

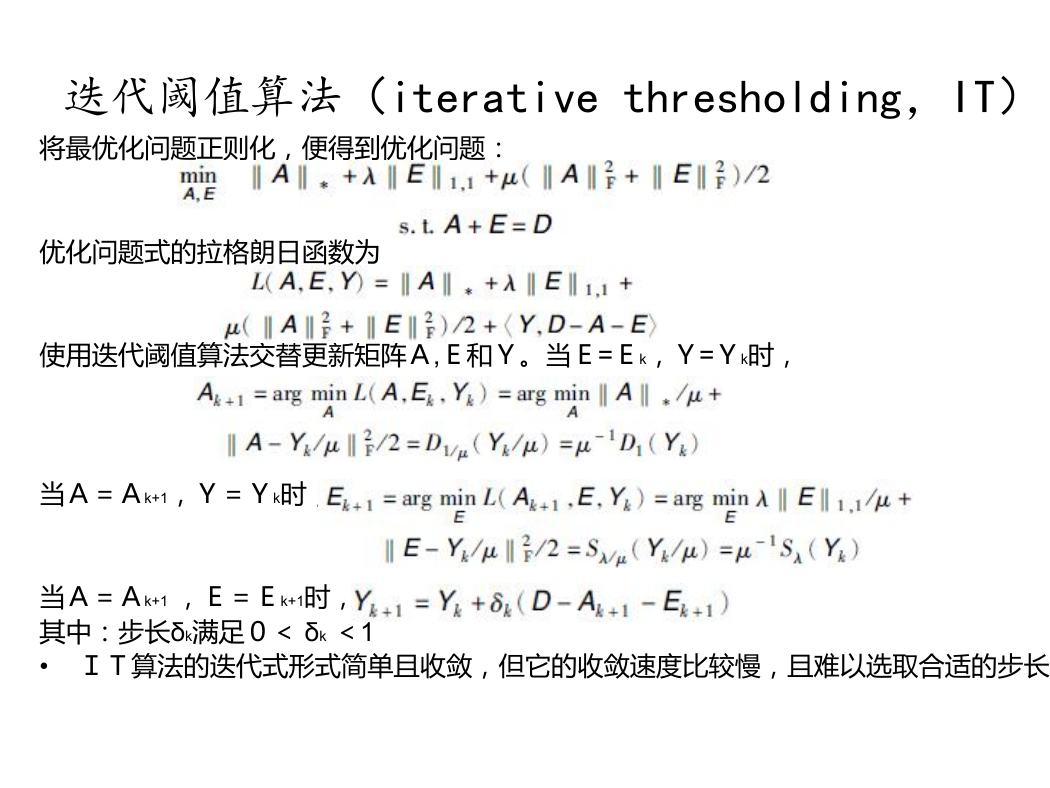

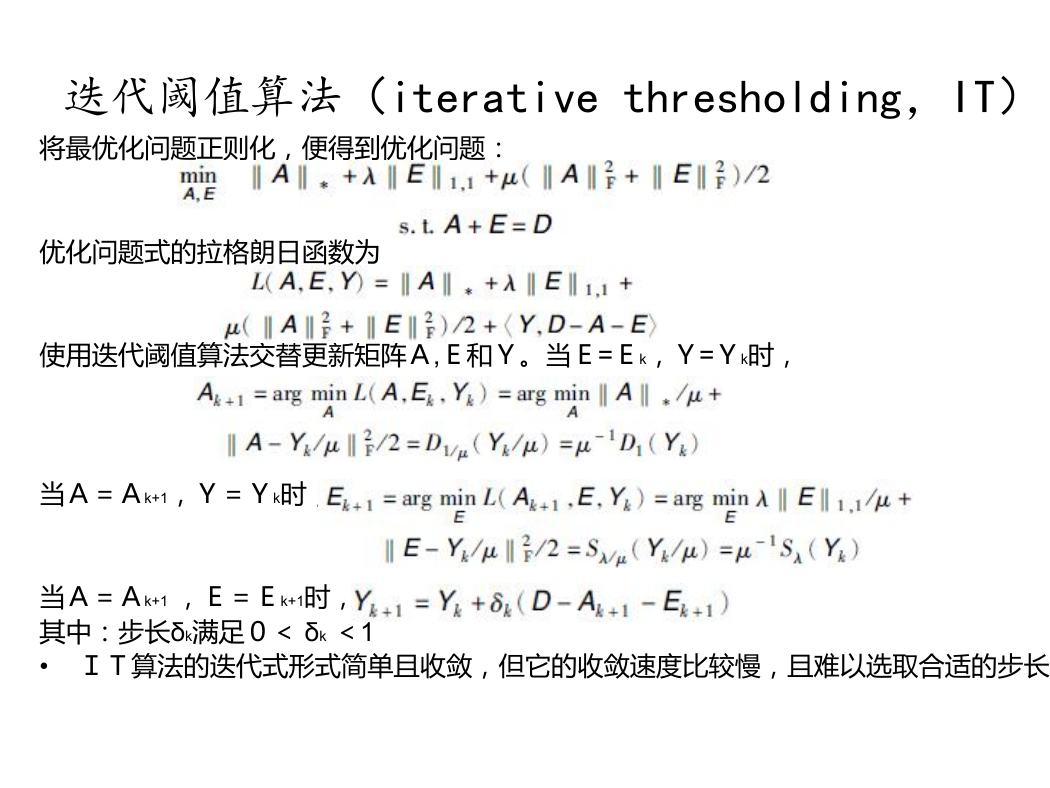

迭代阈值算法(iterative thresholding,IT)

将最优化问题正则化,便得到优化问题:

优化问题式的拉格朗日函数为

使用迭代阈值算法交替更新矩阵A,E和Y。当E=Ek,Y=Yk时,

当A=Ak+1,Y=Yk时,

当A=Ak+1 ,E=Ek+1时,

其中:步长δk满足0< δk <1

• IT算法的迭代式形式简单且收敛,但它的收敛速度比较慢,且难以选取合适的步长

�

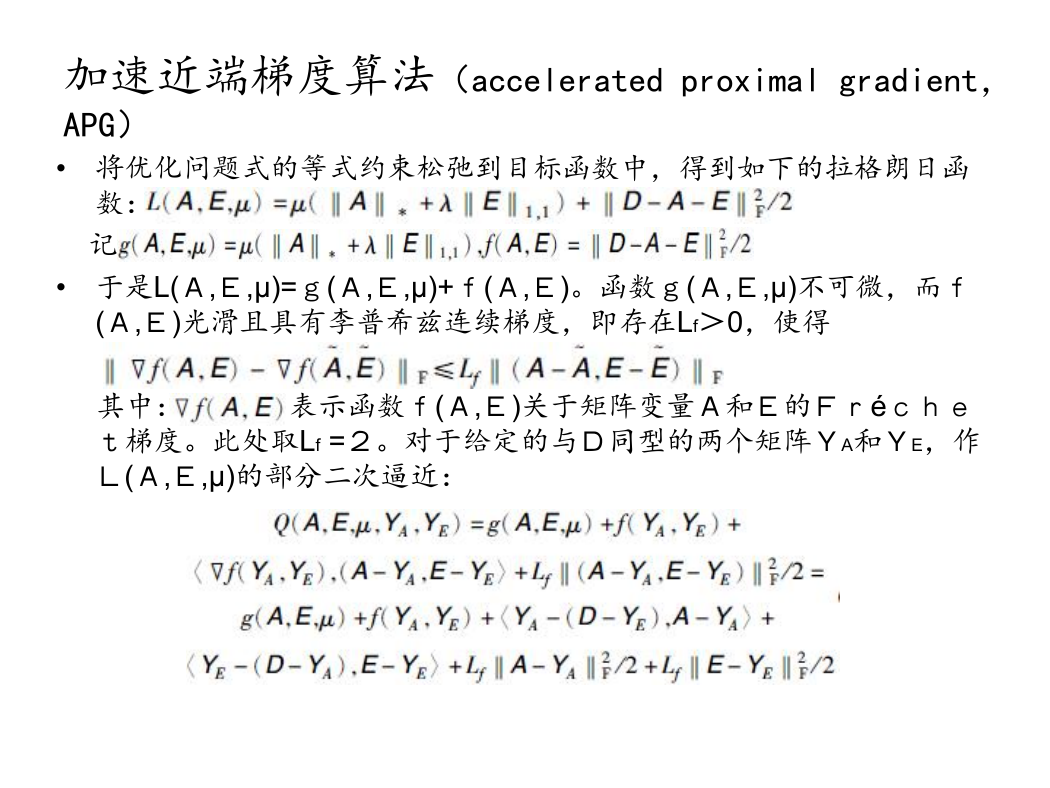

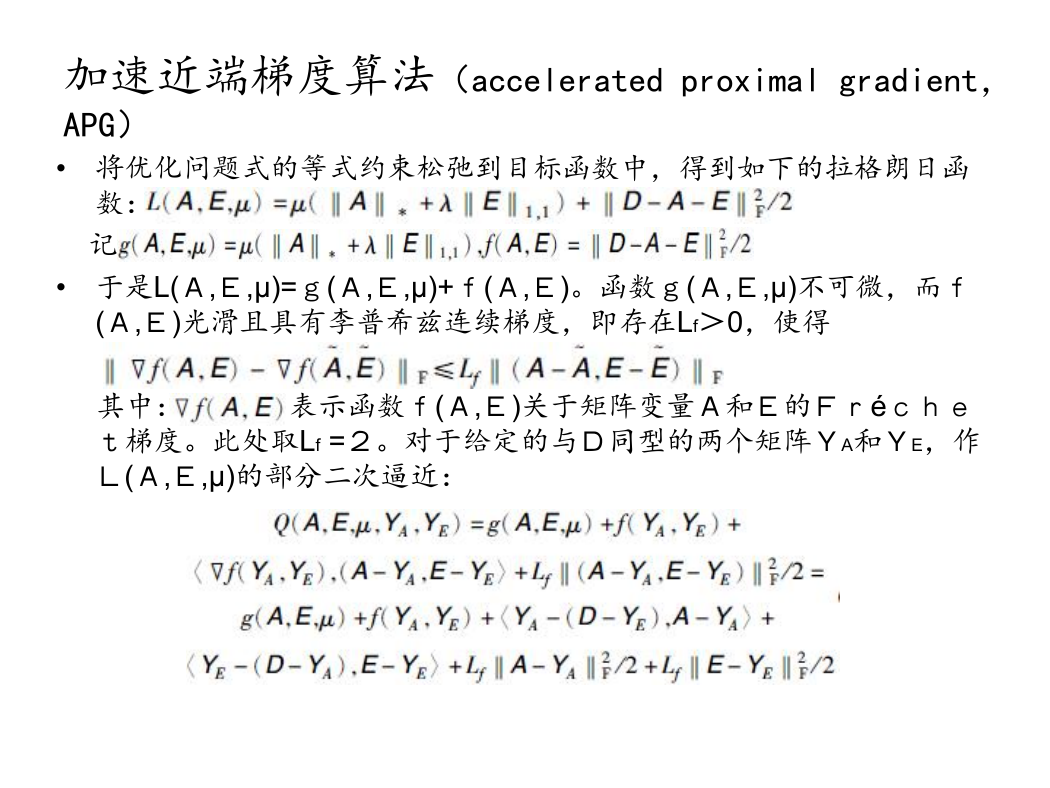

加速近端梯度算法(accelerated proximal gradient,

APG)

• 将优化问题式的等式约束松弛到目标函数中,得到如下的拉格朗日函

数:

记

• 于是L(A,E,μ)=g(A,E,μ)+f(A,E)。函数g(A,E,μ)不可微,而f

(A,E)光滑且具有李普希兹连续梯度,即存在Lf>0,使得

其中: 表示函数f(A,E)关于矩阵变量A和E的Fréche

t梯度。此处取Lf =2。对于给定的与D同型的两个矩阵YA和YE,作

L(A,E,μ)的部分二次逼近:

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc