阿

希

夫

:

19

11

.0

90

70

v6

[c

s。

简

历

】

高效检测:可伸缩、高效的对象检测

明兴谭若明庞国乐

谷歌研究,大脑团队

{tanmingxing,rpang,qvl}@google.com

摘要

高效的 DET-D7

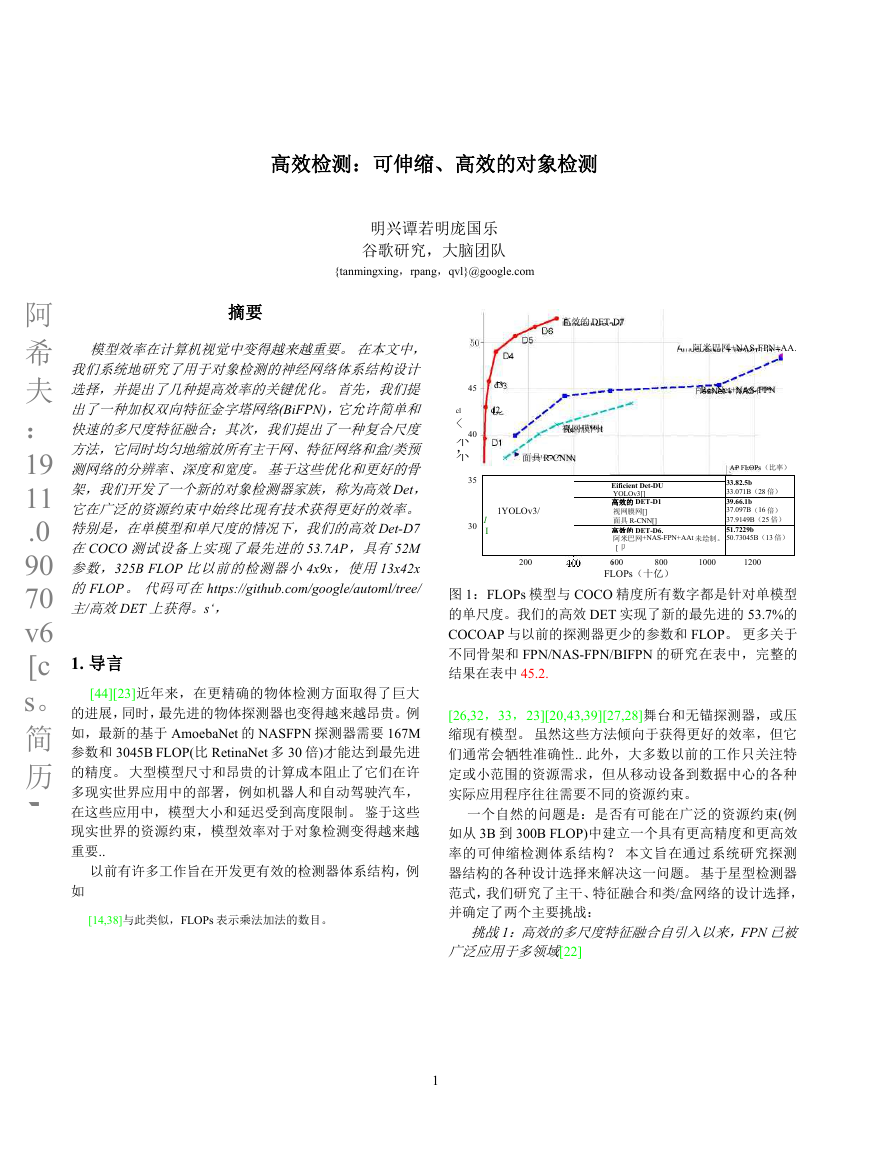

模型效率在计算机视觉中变得越来越重要。在本文中,

我们系统地研究了用于对象检测的神经网络体系结构设计

选择,并提出了几种提高效率的关键优化。首先,我们提

出了一种加权双向特征金字塔网络(BiFPN),它允许简单和

快速的多尺度特征融合;其次,我们提出了一种复合尺度

方法,它同时均匀地缩放所有主干网、特征网络和盒/类预

测网络的分辨率、深度和宽度。基于这些优化和更好的骨

架,我们开发了一个新的对象检测器家族,称为高效Det,

它在广泛的资源约束中始终比现有技术获得更好的效率。

特别是,在单模型和单尺度的情况下,我们的高效Det-D7

在COCO 测试设备上实现了最先进的53.7AP,具有52M

参数,325B FLOP 比以前的检测器小4x9x,使用13x42x

的FLOP。代码可在https://github.com/google/automl/tree/

主/高效DET 上获得。s‘,

1. 导言

[44][23]近年来,在更精确的物体检测方面取得了巨大

的进展,同时,最先进的物体探测器也变得越来越昂贵。例

如,最新的基于 AmoebaNet 的 NASFPN 探测器需要 167M

参数和 3045B FLOP(比 RetinaNet 多 30 倍)才能达到最先进

的精度。 大型模型尺寸和昂贵的计算成本阻止了它们在许

多现实世界应用中的部署,例如机器人和自动驾驶汽车,

在这些应用中,模型大小和延迟受到高度限制。 鉴于这些

现实世界的资源约束,模型效率对于对象检测变得越来越

重要..

以前有许多工作旨在开发更有效的检测器体系结构,例

如

[14,38]与此类似,FLOPs 表示乘法加法的数目。

d3

d2

45

cl

<

不

,

不

40

35

视网膜网

面具 R-CNN

1YOLOv3/

30

1

I

200

阿米巴网+NAS-FPN+AA.

Res Net+NAS-FPN

Eificient Det-DU

YOLOv3[]

高效的 DET-D1

视网膜网[]

面具 R-CNN[]

高效的 DET-D6.

阿米巴网+NAS-FPN+AAt 未绘制。

[卩

600

800

FLOPs(十亿)

1000

AP FLOPs(比率)

33.82.5b

33.071B(28 倍)

39.66.1b

37.097B(16 倍)

37.9149B(25 倍)

51.7229b

50.73045B(13 倍)

1200

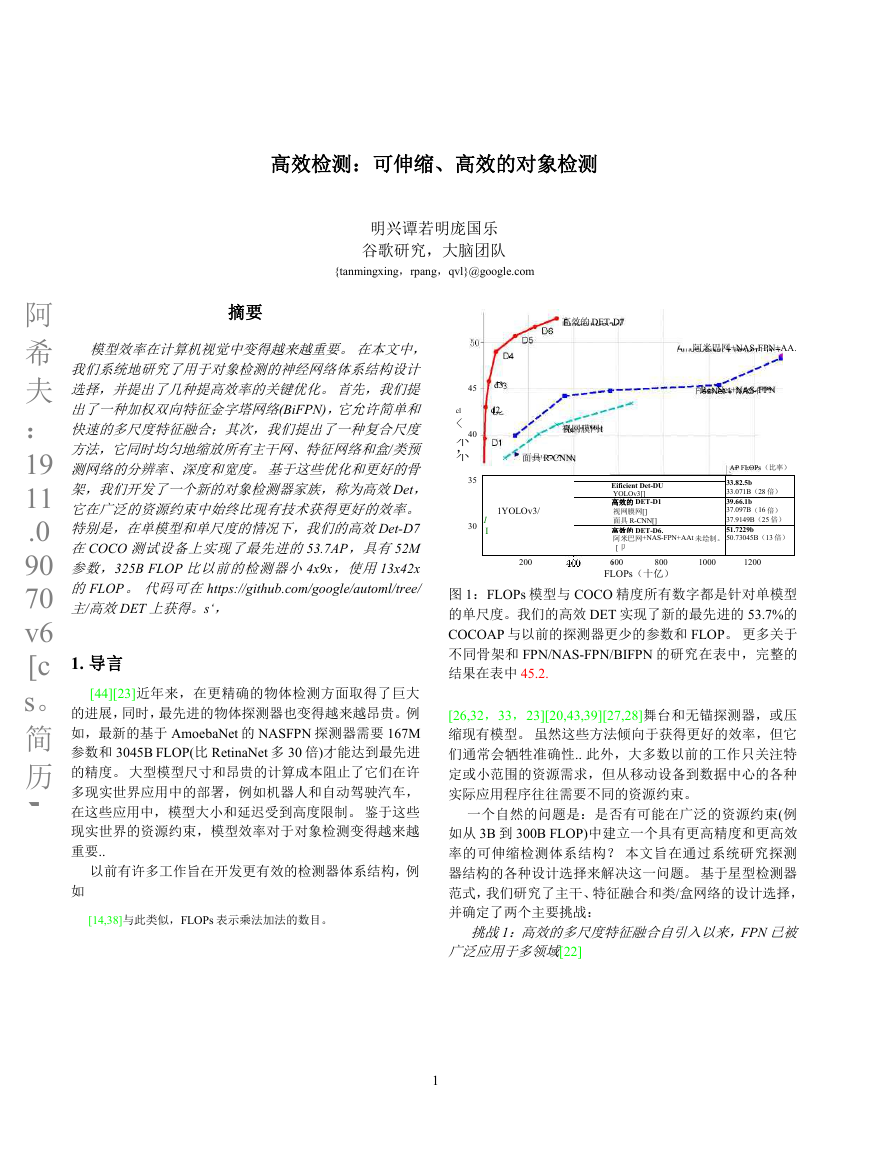

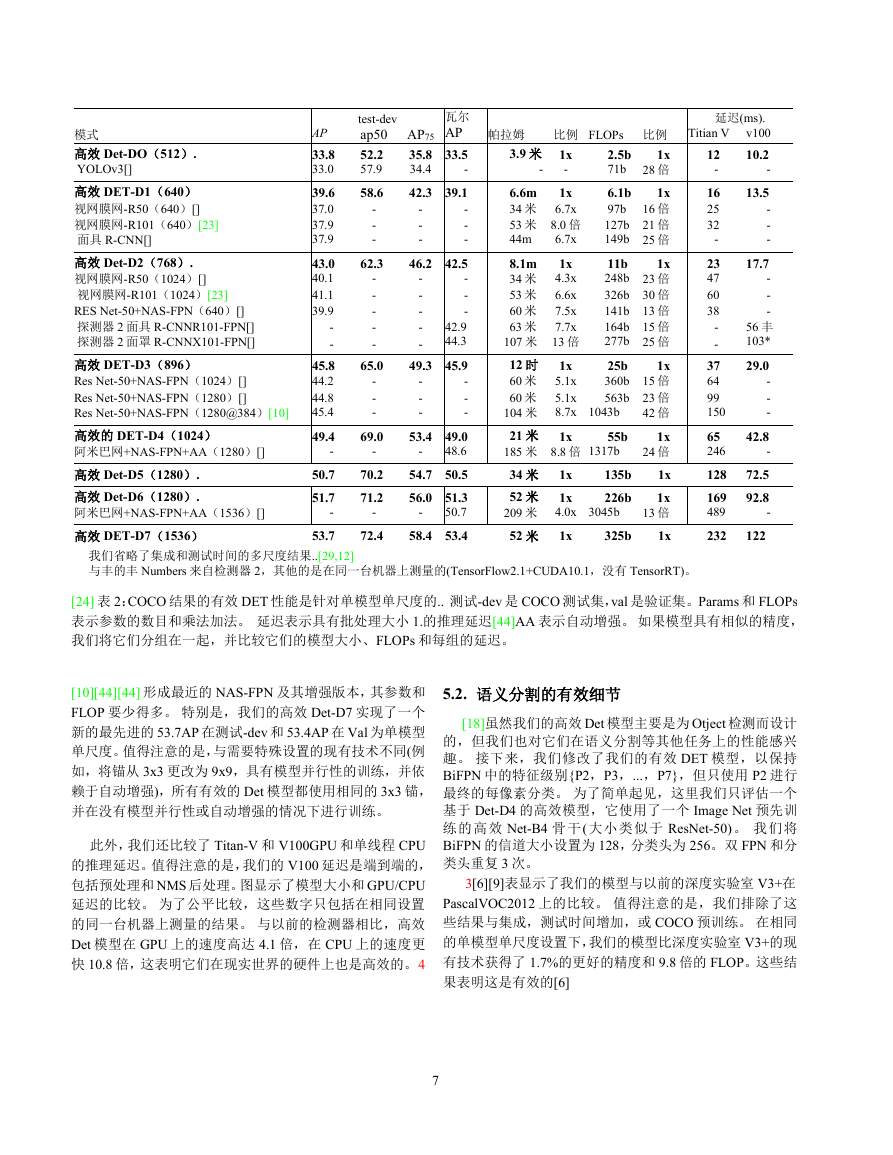

图 1:FLOPs 模型与 COCO 精度所有数字都是针对单模型

的单尺度。我们的高效 DET 实现了新的最先进的 53.7%的

COCOAP 与以前的探测器更少的参数和 FLOP。 更多关于

不同骨架和 FPN/NAS-FPN/BIFPN 的研究在表中,完整的

结果在表中 45.2.

[26,32,33,23][20,43,39][27,28]舞台和无锚探测器,或压

缩现有模型。 虽然这些方法倾向于获得更好的效率,但它

们通常会牺牲准确性.. 此外,大多数以前的工作只关注特

定或小范围的资源需求,但从移动设备到数据中心的各种

实际应用程序往往需要不同的资源约束。

一个自然的问题是:是否有可能在广泛的资源约束(例

如从 3B 到 300B FLOP)中建立一个具有更高精度和更高效

率的可伸缩检测体系结构? 本文旨在通过系统研究探测

器结构的各种设计选择来解决这一问题。 基于星型检测器

范式,我们研究了主干、特征融合和类/盒网络的设计选择,

并确定了两个主要挑战:

挑战1:高效的多尺度特征融合自引入以来,FPN 已被

广泛应用于多领域[22]

1

�

2

�

[25][10][19,17,41]尺度特征融合。最近,PANET、NAS-FPN

等研究开发了更多的跨尺度特征融合网络结构。 在融合不

同的输入特征的同时,大多数以前的工作只是不加区分地总

结它们;然而,由于这些不同的输入特征具有不同的分辨率,

我们观察到它们通常对融合的输出特征作出不平等的贡献。

为了解决这一问题,我们提出了一种简单而高效的加权双向

特征金字塔网络(BiFPN),它引入可学习的权重来学习不同

输入特征的重要性,同时反复应用自上而下和自下而上的多

尺度特征融合。

多尺度特征.. 遵循这一思想,PANET 在 FPN 之上增加了一

个额外的自下而上的路径聚合网络;STDL 提出了一个尺度

转移模块来利用跨尺度特征;M2DET 提出了一个 U 形模块

来融合多尺度特征,G-FRNet 引入了门单元来控制跨特征的

信息流。 最近,NAS-FPN 利用神经结构搜索自动设计特征

网络拓扑。虽然它获得了更好的性能,但 NAS-FPN 在搜索

过程中需要数千 GPU 小时,由此产生的特征网络是不规则

的,因此难以解释。 本文旨在以一种更直观、更有原则的

方式优化多尺度特征融合。

模型缩放:为了获得更好的精度,通常使用更大的骨干网

络 ( 例 如 , 从 移 动 尺 寸 模 型 和 ResNet , 到 ResNeXt 和

AmoebaNet)或增加输入图像大小(例如,从 512x512)来放大

基线检测器[37,15][14][40][31]

[23]

[44][10,44][38]至 1536x1536)。 最近的一些工作表明,

增加信道大小和重复特征网络也可以导致更高的精度。 这

些缩放方法主要集中在单个或有限的缩放维度上。 最近,

通过联合扩展网络宽度、深度和分辨率,证明了图像分类的

显著模型效率。 我们提出的目标检测的复合标度方法大多

受到启发。[38]

3. Bi FPN

在这一部分中,我们首先制定了多尺度特征融合问题,

然后介绍了我们提出的 BiFPN 的主要思想:高效的双向跨

尺度连接和加权特征融合。

3.1. 问题的提出

多尺度特征融合旨在聚合不同分辨率的特征。 形式上,

给定多尺度特征列表 P. =(p;普,...),其中 P:;表示 l

级的特征:,我们的目标是找到一个转换 f,它可以有效地

聚合不同的特征并输出一个新特征列表:P 出去 =f(P.)。 作

为一个具体的例子,

[23,34,33,10][13,44][38]挑战 2:模型缩放虽然以前的

工作主要依靠更大的骨干网络或更大的输入图像大小来获

得更高的精度,但我们观察到,在考虑精度和效率时,扩展

特征网络和框/类预测网络也是至关重要的.. 在最近的工作

的启发下,我们提出了一种对象检测器的复合缩放方法,该

方法联合缩放所有主干、特征网络、框/类预测网络的分辨

率/深度/宽度。

[38]最后,我们还观察到,最近引入的高效网比以前常用

的骨干获得了更好的效率。 将高效网络骨架与我们提出的

BiFPN 和复合尺度相结合,我们开发了一种新的对象检测器

家族,称为高效 Det,它始终以比以前的对象检测器更少的

参数和 FLOP 来获得更好的精度。 图和图形显示 COCO 数

据集上的性能比较。在类似的精度约束下,我们的有效 DET

使用的 FLOP 比 YOLOv3 少 28 倍,FLOP 比 RetinaNet 少 30

倍,FLOP 比最近基于 ResNet 的 NAS-FPN 少 19 倍。 特别

是,在单模型和单测试时间尺度下,我们的高效 Det-D7 实

现了最先进的 53.7AP 和 52M 参数和 325B FLOP,在 1.5AP

的情况下优于以前最好的检测器,而在 4 倍小和使用 13 倍

少的 FLOP。我们的高效 DET 在 GPU/CPU 上也比以前的检

测器快 4 倍至 11 倍。 14[24][33][23][10][44]

通过简单的修改,我们还证明了我们的单模型单尺度有

效 Det 在 PascalVOC2012 语义分割上以 18B FLOPs 实现了

81.74%的 IOU 精度,比 DeepLabV3+高 1.7%,而 FLOPs 较

少 9.8 倍。[6]

2. 相关工作

[11,34,5,13][35,26,32,23][16][20,41,43]一段检测器:

现有的对象检测器主要按它们是否有兴趣区域建议步骤(两

阶段)(初始)进行分类。虽然两级探测器往往更灵活和更准

确,但一级探测器通常被认为是更简单和更有效的利用预定

义的锚。 近年来,单级探测器由于其效率和简单性而引起

了人们的广泛关注。 在本文中,我们主要遵循一阶段检测

器设计,我们表明,通过优化的网络体系结构,可以实现更

好的效率和更高的精度。

多尺度特征表示:目标检测的主要难点之一是有效地表示和

处理多尺度特征。 早期的检测器通常直接执行基于从骨干

网络中提取的金字塔特征层次的预测。 特征金字塔网络

(FPN)作为开创性的作品之一.[4,26,35]

[22]

[25][42][41][2][10]提出了一种自上而下的途径来结合

3

�

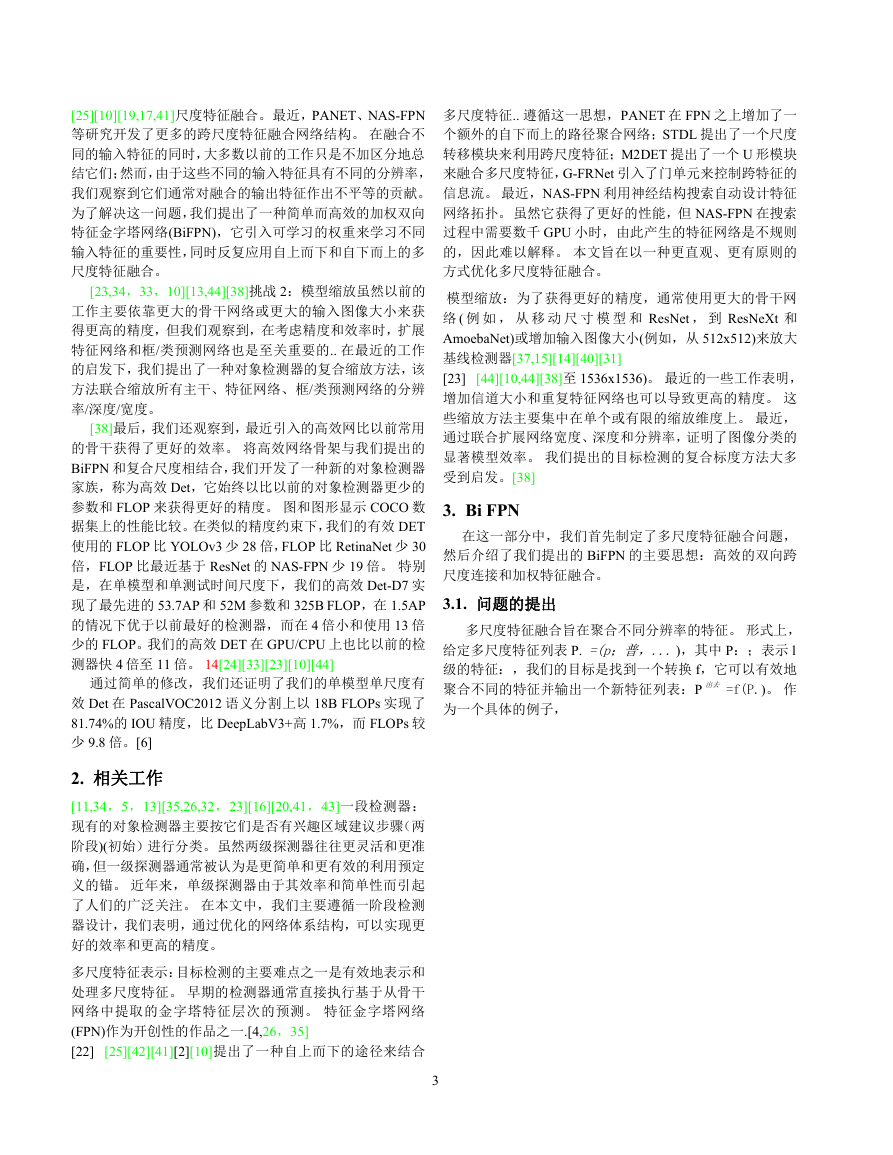

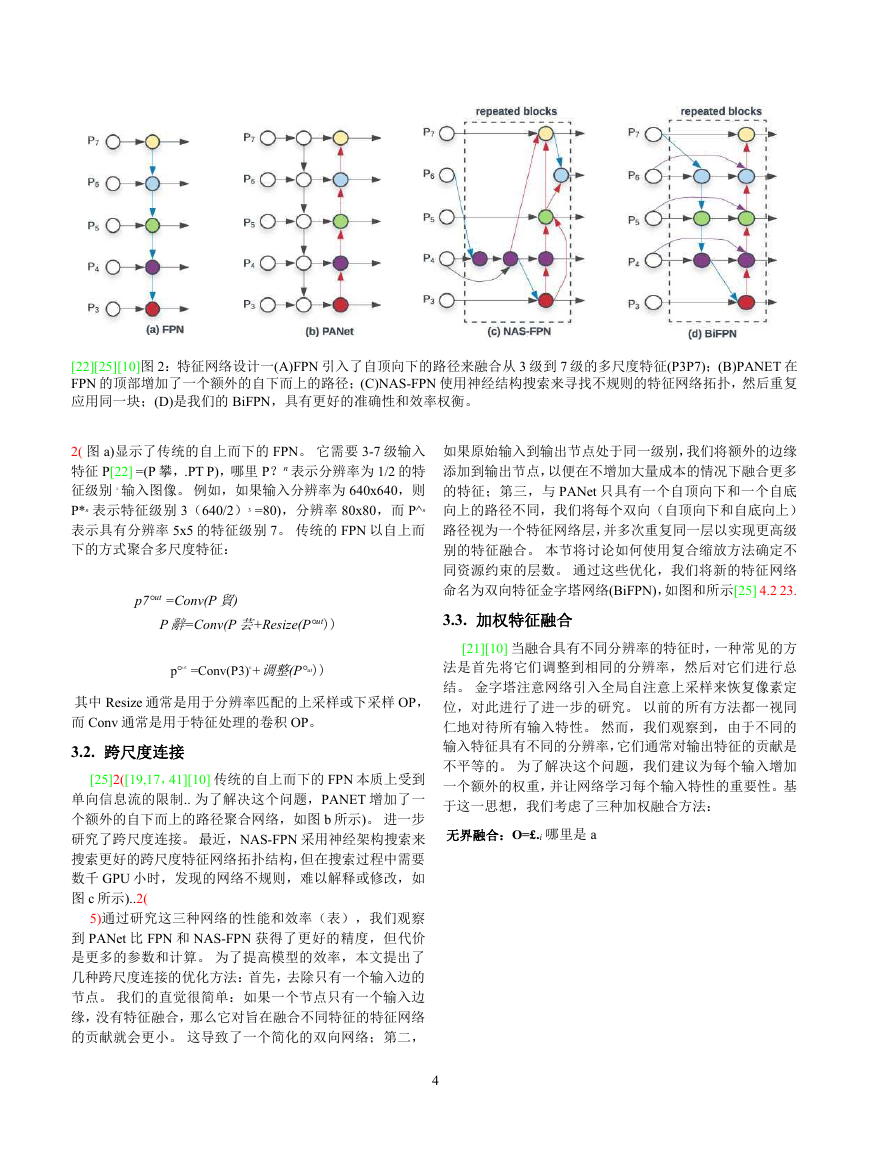

[22][25][10]图 2:特征网络设计一(A)FPN 引入了自顶向下的路径来融合从 3 级到 7 级的多尺度特征(P3P7);(B)PANET 在

FPN 的顶部增加了一个额外的自下而上的路径;(C)NAS-FPN 使用神经结构搜索来寻找不规则的特征网络拓扑,然后重复

应用同一块;(D)是我们的 BiFPN,具有更好的准确性和效率权衡。

如果原始输入到输出节点处于同一级别,我们将额外的边缘

添加到输出节点,以便在不增加大量成本的情况下融合更多

的特征;第三,与 PANet 只具有一个自顶向下和一个自底

向上的路径不同,我们将每个双向(自顶向下和自底向上)

路径视为一个特征网络层,并多次重复同一层以实现更高级

别的特征融合。 本节将讨论如何使用复合缩放方法确定不

同资源约束的层数。 通过这些优化,我们将新的特征网络

命名为双向特征金字塔网络(BiFPN),如图和所示[25] 4.2 23.

3.3. 加权特征融合

[21][10] 当融合具有不同分辨率的特征时,一种常见的方

法是首先将它们调整到相同的分辨率,然后对它们进行总

结。 金字塔注意网络引入全局自注意上采样来恢复像素定

位,对此进行了进一步的研究。 以前的所有方法都一视同

仁地对待所有输入特性。 然而,我们观察到,由于不同的

输入特征具有不同的分辨率,它们通常对输出特征的贡献是

不平等的。 为了解决这个问题,我们建议为每个输入增加

一个额外的权重,并让网络学习每个输入特性的重要性。基

于这一思想,我们考虑了三种加权融合方法:

无界融合:O=£.i 哪里是 a

2( 图 a)显示了传统的自上而下的 FPN。 它需要 3-7 级输入

特征 P[22] =(P 攀,.PT P),哪里 P?n 表示分辨率为 1/2 的特

征级别 z 输入图像。 例如,如果输入分辨率为 640x640,则

P*n 表示特征级别 3(640/2)3 =80),分辨率 80x80,而 P^n

表示具有分辨率 5x5 的特征级别 7。 传统的 FPN 以自上而

下的方式聚合多尺度特征:

p7°ut =Conv(P 貿)

P 辭=Conv(P 芸+Resize(P°ut))

p°ut =Conv(P3)n+调整(P°ut))

其中 Resize 通常是用于分辨率匹配的上采样或下采样 OP,

而 Conv 通常是用于特征处理的卷积 OP。

3.2. 跨尺度连接

[25]2([19,17,41][10] 传统的自上而下的 FPN 本质上受到

单向信息流的限制.. 为了解决这个问题,PANET 增加了一

个额外的自下而上的路径聚合网络,如图 b 所示)。 进一步

研究了跨尺度连接。 最近,NAS-FPN 采用神经架构搜索来

搜索更好的跨尺度特征网络拓扑结构,但在搜索过程中需要

数千 GPU 小时,发现的网络不规则,难以解释或修改,如

图 c 所示)..2(

5)通过研究这三种网络的性能和效率(表),我们观察

到 PANet 比 FPN 和 NAS-FPN 获得了更好的精度,但代价

是更多的参数和计算。 为了提高模型的效率,本文提出了

几种跨尺度连接的优化方法:首先,去除只有一个输入边的

节点。 我们的直觉很简单:如果一个节点只有一个输入边

缘,没有特征融合,那么它对旨在融合不同特征的特征网络

的贡献就会更小。 这导致了一个简化的双向网络;第二,

4

�

可学习的权重,可以是标量(每特征)、向量(每通道)或多维

张量(每像素)。 我们发现一个尺度可以达到与其他方法相

当的精度,以最小的计算成本。 然而,由于标量权重是无

界的,它可能会导致训练不稳定。 因此,我们采用权重归

一化来约束每个权重的值范围。

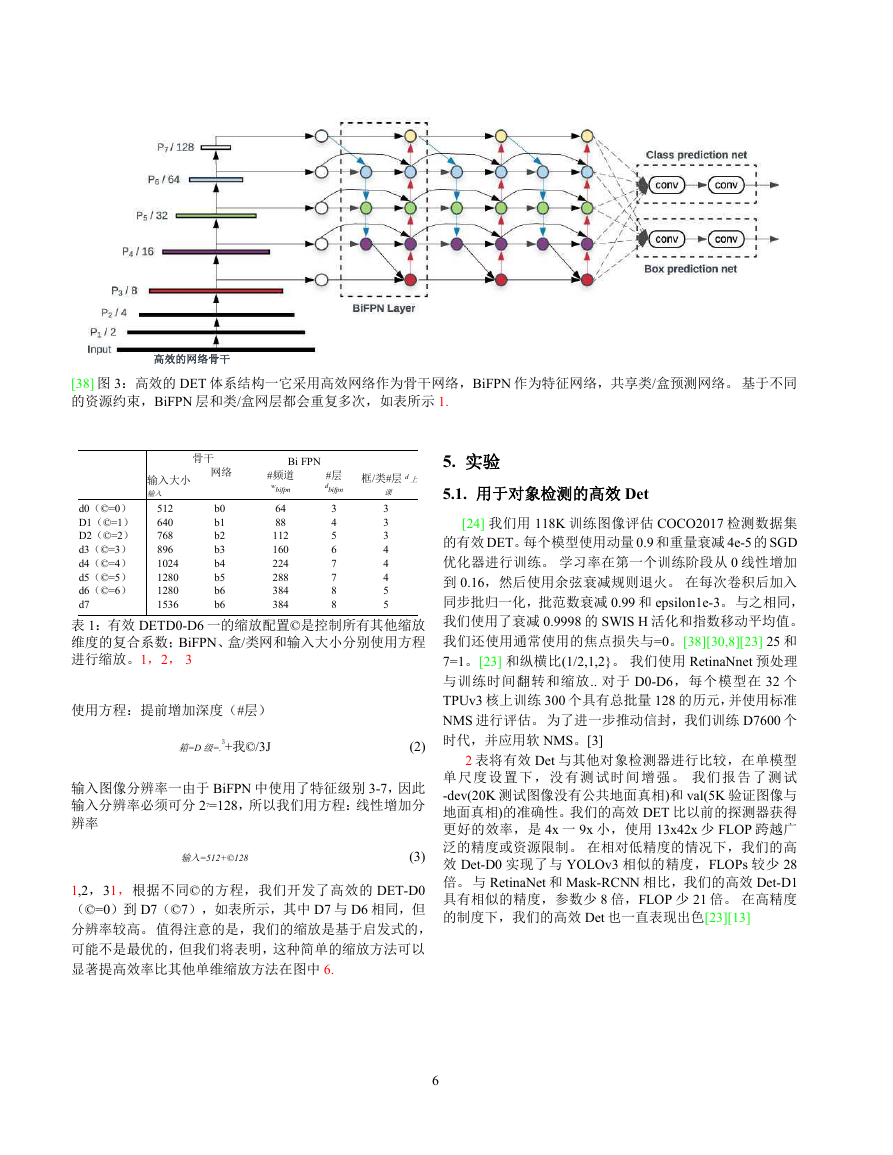

骨干网络中获取 3-7 级特征{琢 P^R、P、P7},并反复应用

自顶向下和自下而上的双向特征融合。 这些融合的特征被

馈送到类和盒网络中,分别产生对象类和包围盒预测。 类

似地,类和框网络权重在所有级别的特性之间共享。[23]

4.2. 复合缩放

为了优化精度和效率,我们希望开发一系列能够满足广

泛资源约束的模型。 这里的一个关键挑战是如何扩大基线

高效 Det 模型。

[40][31][10][38][10,38][38]以前的工作主要是通过使用

更大的骨干网络(例如 ResNeXt 或 AmoebaNet)、使用更大的

输入图像或堆叠更多的 FPN 层来扩展基线检测器。 这些方

法通常是无效的,因为它们只关注单个或有限的缩放维度。

最近的工作表明,通过联合缩放网络宽度、深度和输入分辨

率的所有维度,图像分类具有显著的性能。 在这些工作的

启发下,我们提出了一种新的目标检测复合标度方法,它使

用一个简单的复合系数©来联合缩放主干、BiFPN、类/盒网

络和分辨率的所有维度。 与之不同的是,与图像分类模型

相比,otject 检测器具有更多的缩放维度,因此对所有维度

的网格搜索是昂贵的。 因此,我们使用了一种基于启发式

的缩放方法,但仍然遵循联合缩放所有维度的主要思想。

骨干网络,我们重用相同的宽度/深度缩放系数的有效网络

-B0 到 B6,这样我们可以很容易地重用他们的图像网络解

释检查点。[38]

我们线性增加了 BiFPN 深度 Dh如果pn (#层)因为深度需要

四舍五入到小整数。 对于 BiFPN 宽度 WbIFPn (#通道),双

FPN 宽度 W 呈指数增长 bIFPn[38](#频道)类似。 具体地,

我们在值列表(1.2、1.25、1.3、1.35、1.4、1.45}上执行网格

搜索,并选择最佳值 1.35 作为 BiFPN 宽度缩放因子。 形式

上,BiFPN 的宽度和深度用以下方程缩放:

dbIFPn =3+©

wbIFPn =64•(1.35。),

⑴

盒/类预测网络我们将它们的宽度固定为与 BiFPN(即 WP)

始终相同红色的=Wbifpn),但林

基于 Softmax 的融合:O=EI

i

ew

e 叱 Ii.直觉

思想是将 Softmax 应用于每个权

重,使所有权重归一化为一个值

范围为 0 到 1 的概率,表示每个输

入的重要性。 然

而,正如我们在章节中的消融研究所示,额外的 Softmax 导

致 GPU 硬件的显著放缓。 为了最小化额外的延迟成本,我

们进一步提出了一种快速融合方法。6.3,

快速归一化融合:O=EI.-------------------- ---------- 伊,在哪里

e+jwj

Wi

通过在每个 Wi 之后应用 Relu 来确保 Wi>0,并且 e=0。

为了避免数值不稳定,0001 是一个很小的值。 同样,每个

归一化权重的值也在 0 到 1 之间,但由于这里没有 Softmax

操作,所以效率要高得多。 我们的消融研究表明,这种快

速融合方法与基于 Softmax 的融合具有非常相似的学习行

为和准确性,但在 GPU 上运行速度高达 30%(表)。6)

我们的最终 BiFPN 集成了双向交叉尺度连接和快速归一

化融合。 作为一个具体的例子,这里我们描述了两个融合

特征在 6 级的 BiFPN,如图所示):2(

d=Conv(w r“ +w“Reme(P7n)

+w2+e

丿

=C°nv(wl:也+w2:堂

+w·Resized 炒)w;

+w2+w

W1+W2+e

其中 P“是自顶向下路径

上 6 级的中间特征,

P0ut 是自下而上路径上 6 级

的 输 出 特

征。所有其他特征都是以类

似的方式构

造的。 值得注意的是,为了进一步提高效率,我们使用深

度可分离卷积进行特征融合,并在每次卷积后添加批归一化

和激活。[7,36]

w;+w2+w3+e

4. 高效的探员

基于我们的 BiFPN,我们开发了一个新的检测模型家族,

称为高效 Det。在本节中,我们将讨论网络体系结构和一种

新的高效 Det 复合缩放方法。

4.1. 高效的 Det 架构

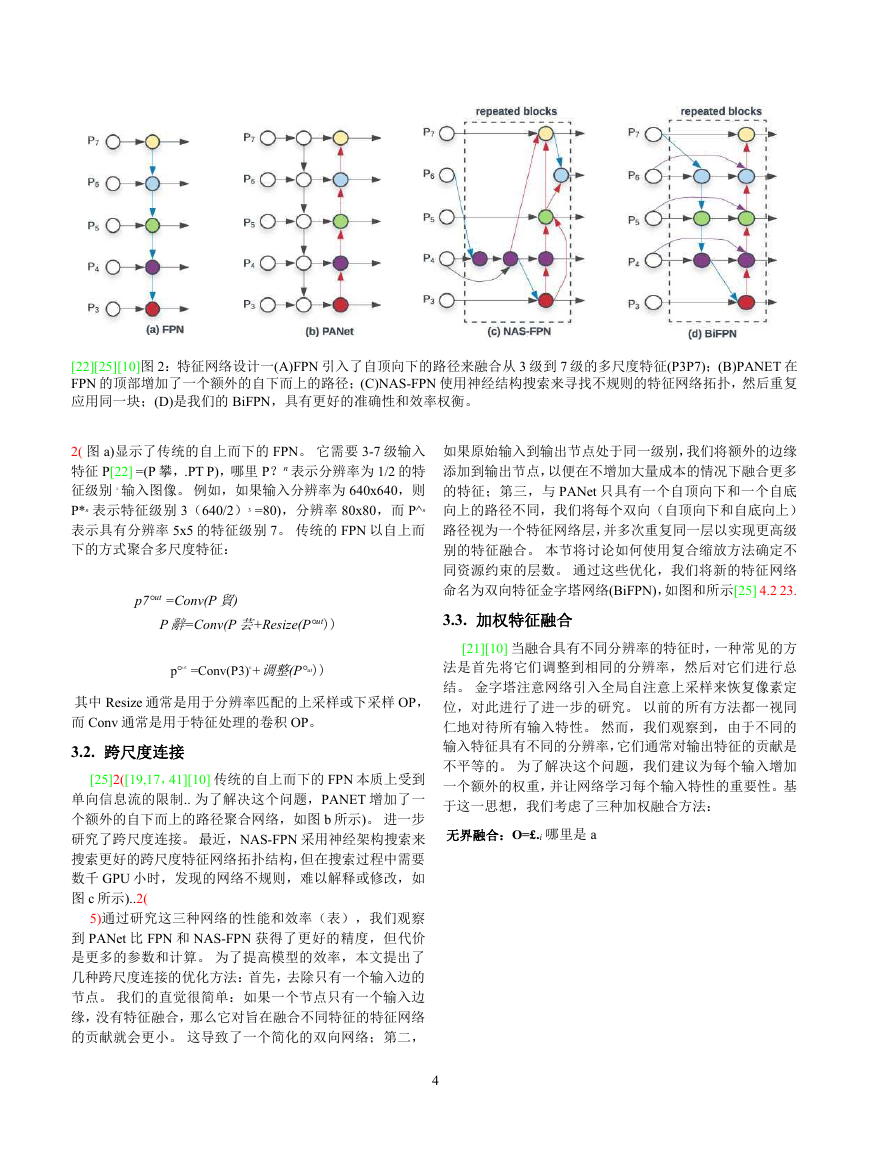

3[26,32,22,23] 数字显示了高效 Det 的总体架构,它

主要遵循一阶段检测器范式。 我们采用图像网络解释有效

网作为骨干网络。 我们提出的 BiFPN 作为特征网络,它从

5

�

高效的网络骨干

[38] 图 3:高效的 DET 体系结构一它采用高效网络作为骨干网络,BiFPN 作为特征网络,共享类/盒预测网络。 基于不同

的资源约束,BiFPN 层和类/盒网层都会重复多次,如表所示 1.

5. 实验

5.1. 用于对象检测的高效 Det

[24] 我们用 118K 训练图像评估 COCO2017 检测数据集

的有效 DET。每个模型使用动量 0.9 和重量衰减 4e-5 的 SGD

优化器进行训练。 学习率在第一个训练阶段从 0 线性增加

到 0.16,然后使用余弦衰减规则退火。 在每次卷积后加入

同步批归一化,批范数衰减 0.99 和 epsilon1e-3。与之相同,

我们使用了衰减 0.9998 的 SWIS H 活化和指数移动平均值。

我们还使用通常使用的焦点损失与=0。[38][30,8][23] 25 和

7=1。[23] 和纵横比(1/2,1,2}。 我们使用 RetinaNnet 预处理

与训练时间翻转和缩放.. 对于 D0-D6,每个模型在 32 个

TPUv3 核上训练 300 个具有总批量 128 的历元,并使用标准

NMS 进行评估。 为了进一步推动信封,我们训练 D7600 个

时代,并应用软 NMS。[3]

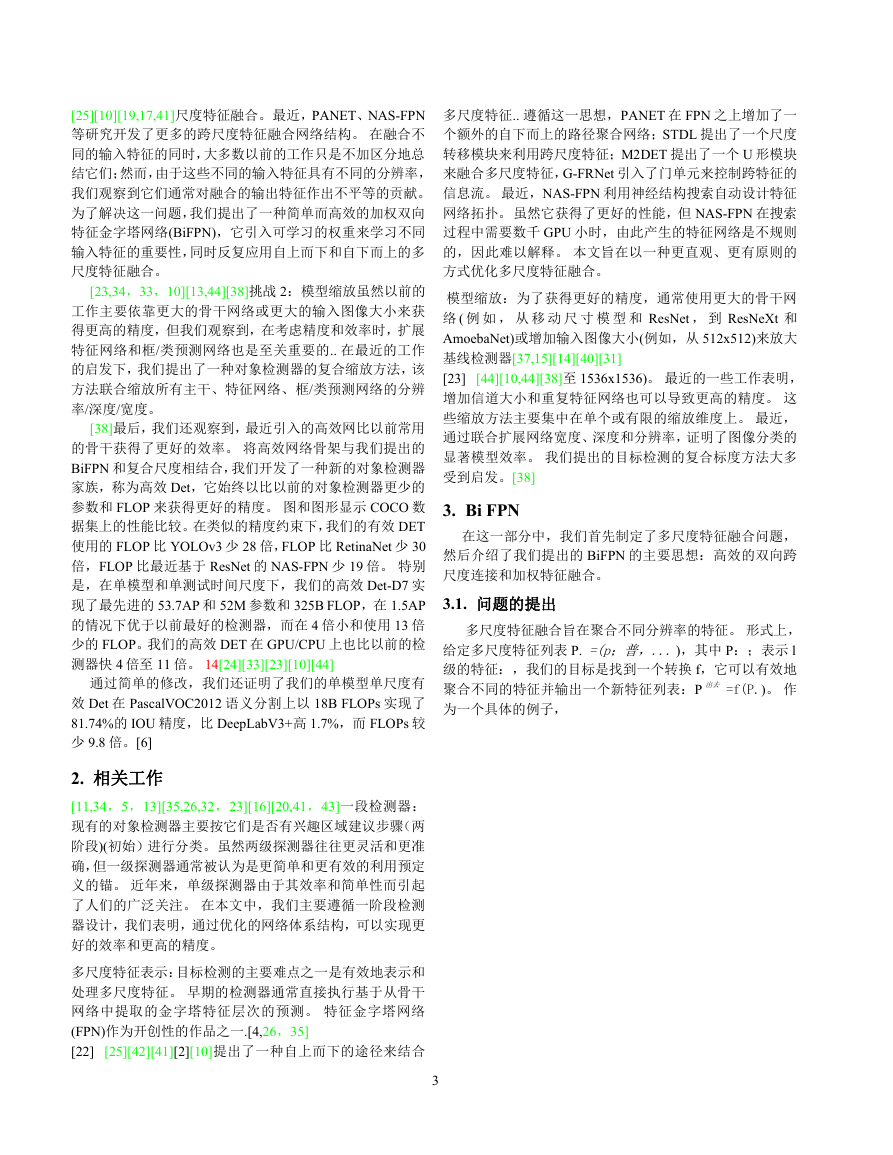

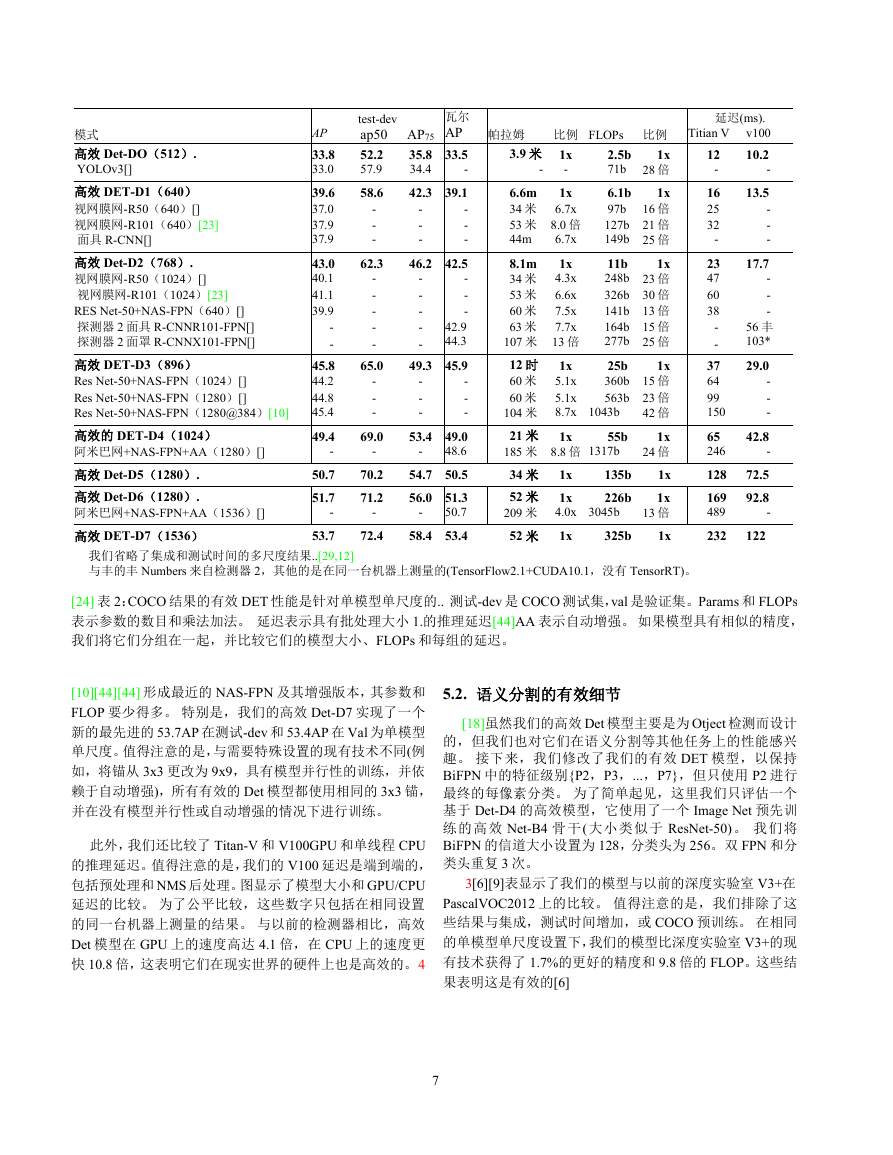

2 表将有效 Det 与其他对象检测器进行比较,在单模型

单尺度设 置下,没有测 试时间增强。 我们报告 了测试

-dev(20K 测试图像没有公共地面真相)和 val(5K 验证图像与

地面真相)的准确性。我们的高效 DET 比以前的探测器获得

更好的效率,是 4x 一 9x 小,使用 13x42x 少 FLOP 跨越广

泛的精度或资源限制。 在相对低精度的情况下,我们的高

效 Det-D0 实现了与 YOLOv3 相似的精度,FLOPs 较少 28

倍。 与 RetinaNet 和 Mask-RCNN 相比,我们的高效 Det-D1

具有相似的精度,参数少 8 倍,FLOP 少 21 倍。 在高精度

的制度下,我们的高效 Det 也一直表现出色[23][13]

骨干

网络

输入大小

输入

Bi FPN

框/类#层 d 上

b0

b1

b2

b3

b4

b5

b6

b6

512

640

768

896

1024

1280

1280

1536

d0(©=0)

D1(©=1)

D2(©=2)

d3(©=3)

d4(©=4)

d5(©=5)

d6(©=6)

d7

表 1:有效 DETD0-D6 一的缩放配置©是控制所有其他缩放

维度的复合系数;BiFPN、盒/类网和输入大小分别使用方程

进行缩放。1,2, 3

课

3

3

3

4

4

4

5

5

#频道

wbifpn

64

88

112

160

224

288

384

384

#层

dbifpn

3

4

5

6

7

7

8

8

使用方程:提前增加深度(#层)

箱=D 级=.3+我©/3J

(2)

输入图像分辨率一由于 BiFPN 中使用了特征级别 3-7,因此

输入分辨率必须可分 27=128,所以我们用方程:线性增加分

辨率

输入=512+©128

(3)

1,2,31,根据不同©的方程,我们开发了高效的 DET-D0

(©=0)到 D7(©7),如表所示,其中 D7 与 D6 相同,但

分辨率较高。 值得注意的是,我们的缩放是基于启发式的,

可能不是最优的,但我们将表明,这种简单的缩放方法可以

显著提高效率比其他单维缩放方法在图中 6.

6

�

模式

高效 Det-DO(512).

YOLOv3[]

高效 DET-D1(640)

视网膜网-R50(640)[]

视网膜网-R101(640)[23]

面具 R-CNN[]

高效 Det-D2(768).

视网膜网-R50(1024)[]

视网膜网-R101(1024)[23]

RES Net-50+NAS-FPN(640)[]

探测器 2 面具 R-CNNR101-FPN[]

探测器 2 面罩 R-CNNX101-FPN[]

高效 DET-D3(896)

Res Net-50+NAS-FPN(1024)[]

Res Net-50+NAS-FPN(1280)[]

Res Net-50+NAS-FPN(1280@384)[10]

高效的 DET-D4(1024)

阿米巴网+NAS-FPN+AA(1280)[]

高效 Det-D5(1280).

高效 Det-D6(1280).

阿米巴网+NAS-FPN+AA(1536)[]

高效 DET-D7(1536)

AP

33.8

33.0

39.6

37.0

37.9

37.9

43.0

40.1

41.1

39.9

-

-

45.8

44.2

44.8

45.4

49.4

-

50.7

51.7

-

53.7

-

-

-

-

-

-

-

-

test-dev

ap50 AP75

52.2

57.9

58.6

-

-

-

62.3

-

-

-

-

-

65.0

-

-

-

69.0

-

70.2

71.2

-

72.4

瓦尔

AP

35.8 33.5

34.4

-

42.3 39.1

-

-

-

46.2 42.5

-

-

-

42.9

44.3

49.3 45.9

-

-

-

53.4 49.0

48.6

54.7 50.5

56.0 51.3

50.7

58.4 53.4

-

-

-

-

-

帕拉姆

-

比例 FLOPs 比例

1x

28 倍

1x

16 倍

21 倍

25 倍

1x

23 倍

30 倍

13 倍

15 倍

25 倍

1x

15 倍

23 倍

42 倍

1x

24 倍

1x

1x

13 倍

1x

3.9 米 1x

2.5b

71b

-

6.1b

6.6m

1x

34 米 6.7x

97b

53 米 8.0 倍 127b

149b

44m

6.7x

8.1m

11b

1x

248b

34 米 4.3x

326b

53 米 6.6x

60 米 7.5x

141b

164b

63 米 7.7x

277b

107 米 13 倍

12 时 1x

25b

360b

60 米 5.1x

60 米 5.1x

563b

104 米 8.7x 1043b

21 米 1x

55b

185 米 8.8 倍 1317b

34 米 1x

52 米 1x

209 米 4.0x 3045b

52 米 1x

135b

226b

325b

延迟(ms).

Titian V v100

10.2

-

13.5

-

-

-

17.7

-

-

-

56 丰

103*

29.0

-

-

-

42.8

-

72.5

92.8

-

12

-

16

25

32

-

23

47

60

38

-

-

37

64

99

150

65

246

128

169

489

232

122

我们省略了集成和测试时间的多尺度结果..[29,12]

与丰的丰 Numbers 来自检测器 2,其他的是在同一台机器上测量的(TensorFlow2.1+CUDA10.1,没有 TensorRT)。

[24] 表 2:COCO 结果的有效 DET 性能是针对单模型单尺度的.. 测试-dev 是 COCO 测试集,val 是验证集。Params 和 FLOPs

表示参数的数目和乘法加法。 延迟表示具有批处理大小 1.的推理延迟[44]AA 表示自动增强。 如果模型具有相似的精度,

我们将它们分组在一起,并比较它们的模型大小、FLOPs 和每组的延迟。

[10][44][44] 形成最近的 NAS-FPN 及其增强版本,其参数和

FLOP 要少得多。 特别是,我们的高效 Det-D7 实现了一个

新的最先进的 53.7AP 在测试-dev 和 53.4AP 在 Val 为单模型

单尺度。值得注意的是,与需要特殊设置的现有技术不同(例

如,将锚从 3x3 更改为 9x9,具有模型并行性的训练,并依

赖于自动增强),所有有效的 Det 模型都使用相同的 3x3 锚,

并在没有模型并行性或自动增强的情况下进行训练。

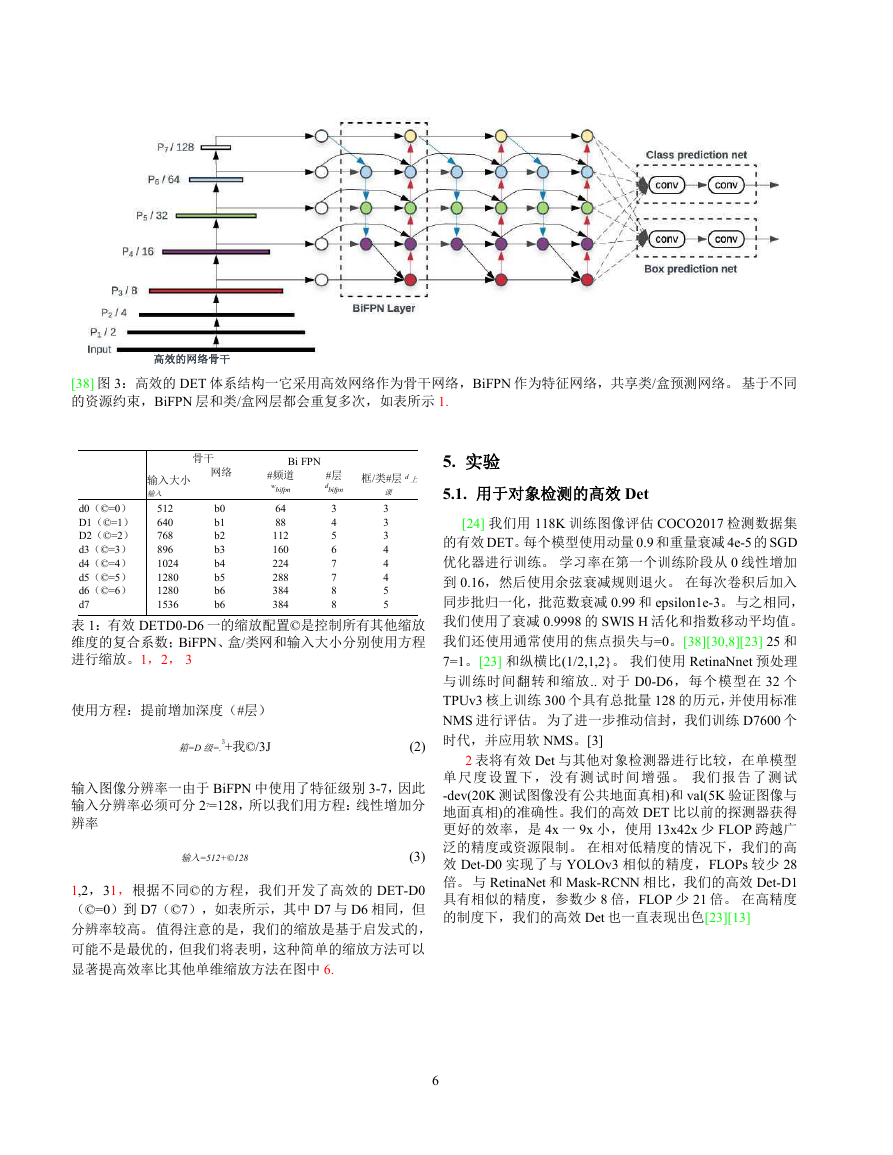

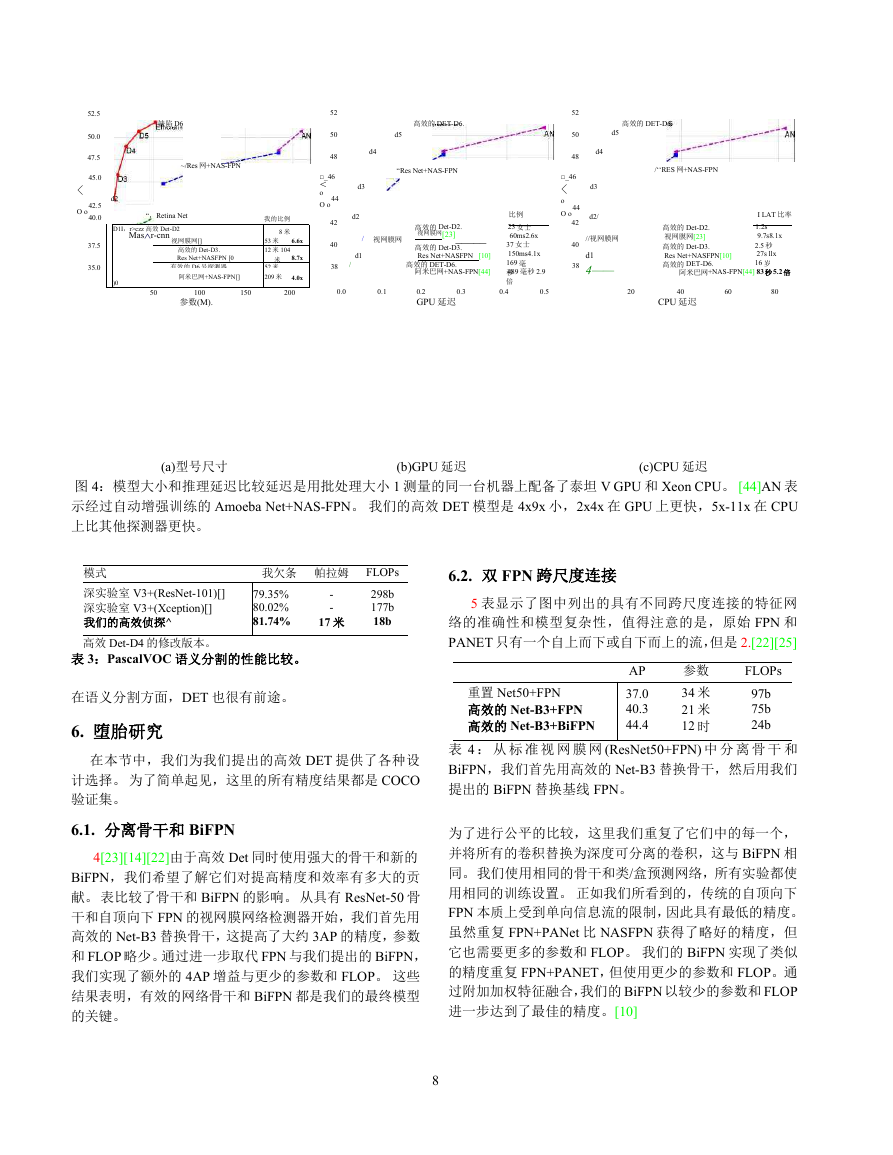

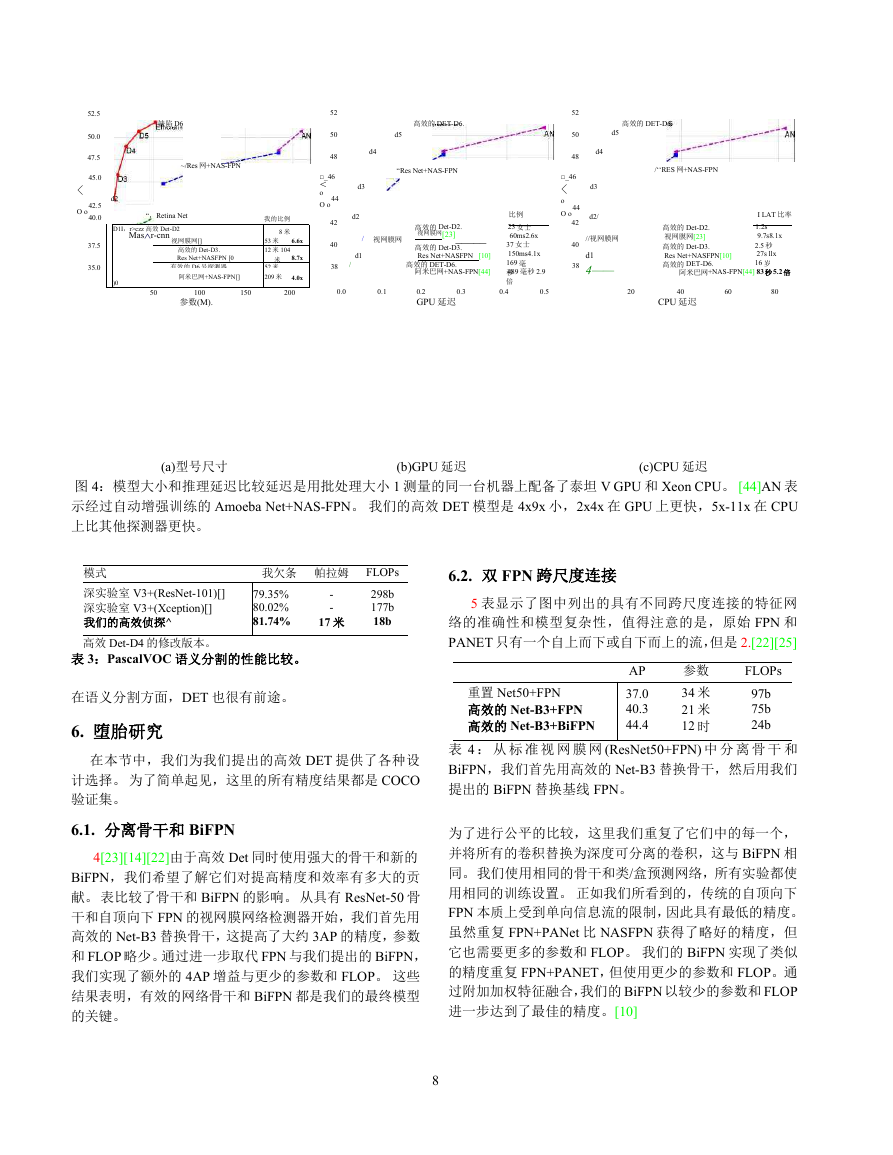

此外,我们还比较了 Titan-V 和 V100GPU 和单线程 CPU

的推理延迟。值得注意的是,我们的 V100 延迟是端到端的,

包括预处理和 NMS 后处理。图显示了模型大小和 GPU/CPU

延迟的比较。 为了公平比较,这些数字只包括在相同设置

的同一台机器上测量的结果。 与以前的检测器相比,高效

Det 模型在 GPU 上的速度高达 4.1 倍,在 CPU 上的速度更

快 10.8 倍,这表明它们在现实世界的硬件上也是高效的。4

5.2. 语义分割的有效细节

[18]虽然我们的高效 Det 模型主要是为 Otject 检测而设计

的,但我们也对它们在语义分割等其他任务上的性能感兴

趣。 接下来,我们修改了我们的有效 DET 模型,以保持

BiFPN 中的特征级别{P2,P3,...,P7},但只使用 P2 进行

最终的每像素分类。 为了简单起见,这里我们只评估一个

基于 Det-D4 的高效模型,它使用了一个 Image Net 预先训

练的高效 Net-B4 骨干(大小类似于 ResNet-50)。 我们将

BiFPN 的信道大小设置为 128,分类头为 256。双 FPN 和分

类头重复 3 次。

3[6][9]表显示了我们的模型与以前的深度实验室 V3+在

PascalVOC2012 上的比较。 值得注意的是,我们排除了这

些结果与集成,测试时间增加,或 COCO 预训练。 在相同

的单模型单尺度设置下,我们的模型比深度实验室 V3+的现

有技术获得了 1.7%的更好的精度和 9.8 倍的 FLOP。这些结

果表明这是有效的[6]

7

�

52.5

50.0

47.5

45.0

<

O o

42.5

40.0

d2

缺陷 D6

~/Res 网+NAS-FPN

“,Retina Net

我的比例

D1I,r>czz 高效 Det-D2

Mas^r-cnn 视网膜网[]

37.5

35.0

)0

高效的 Det-D3.

Res Net+NASFPN [0

有效的 D6 号探测器

阿米巴网+NAS-FPN[]

50

100

参数(M).

8 米

53 米 6.6x

12 米 104

米 8.7x

52 米

209 米 4.0x

52

50

48

□_46

<

o

O o

44

42

40

38

高效的 DET-D6.

d5

d4

“Res Net+NAS-FPN

d3

d2

/ 视网膜网

d1

/

高效的 Det-D2.

视网膜网[23]_____

高效的 Det-D3.

Res Net+NASFPN [10]

高效的 DET-D6.

阿米巴网+NAS-FPN[44]

高效的 DET-D6.

52

50

48

d5

d4

□_46

<

o

O o

44

42

d3

d2/

40

38

//视网膜网

d1

4——

/‘‘RES 网+NAS-FPN

高效的 Det-D2.

视网膜网[23]

高效的 Det-D3.

Res Net+NASFPN[10]

高效的 DET-D6.

阿米巴网+NAS-FPN[44]

I LAT 比率

1.2s

9.7s8.1x

2.5 秒

27s llx

16 岁

83秒 5.2 倍

20

40

CPU 延迟

60

80

比例

23 女士

60ms2.6x

37 女士

150ms4.1x

169 毫

秒489 毫秒 2.9

倍

0.4

0.5

150

200

0.0

0.1

0.2

GPU 延迟

0.3

(a)型号尺寸

(b)GPU 延迟

(c)CPU 延迟

图 4:模型大小和推理延迟比较延迟是用批处理大小 1 测量的同一台机器上配备了泰坦 V GPU 和 Xeon CPU。 [44]AN 表

示经过自动增强训练的 Amoeba Net+NAS-FPN。 我们的高效 DET 模型是 4x9x 小,2x4x 在 GPU 上更快,5x-11x 在 CPU

上比其他探测器更快。

模式

深实验室 V3+(ResNet-101)[]

深实验室 V3+(Xception)[]

我们的高效侦探^

高效 Det-D4 的修改版本。

我欠条 帕拉姆 FLOPs

298b

177b

18b

79.35%

80.02%

81.74%

17 米

-

-

表 3:PascalVOC 语义分割的性能比较。

在语义分割方面,DET 也很有前途。

6. 堕胎研究

在本节中,我们为我们提出的高效 DET 提供了各种设

计选择。 为了简单起见,这里的所有精度结果都是 COCO

验证集。

6.1. 分离骨干和 BiFPN

4[23][14][22]由于高效 Det 同时使用强大的骨干和新的

BiFPN,我们希望了解它们对提高精度和效率有多大的贡

献。 表比较了骨干和 BiFPN 的影响。 从具有 ResNet-50 骨

干和自顶向下 FPN 的视网膜网络检测器开始,我们首先用

高效的 Net-B3 替换骨干,这提高了大约 3AP 的精度,参数

和 FLOP 略少。通过进一步取代 FPN 与我们提出的 BiFPN,

我们实现了额外的 4AP 增益与更少的参数和 FLOP。 这些

结果表明,有效的网络骨干和 BiFPN 都是我们的最终模型

的关键。

8

6.2. 双 FPN 跨尺度连接

5 表显示了图中列出的具有不同跨尺度连接的特征网

络的准确性和模型复杂性,值得注意的是,原始 FPN 和

PANET 只有一个自上而下或自下而上的流,但是 2.[22][25]

重置 Net50+FPN

高效的 Net-B3+FPN

高效的 Net-B3+BiFPN

AP

37.0

40.3

44.4

参数

34 米

21 米

12 时

FLOPs

97b

75b

24b

表 4 : 从 标 准 视 网 膜 网 (ResNet50+FPN) 中 分 离 骨 干 和

BiFPN,我们首先用高效的 Net-B3 替换骨干,然后用我们

提出的 BiFPN 替换基线 FPN。

为了进行公平的比较,这里我们重复了它们中的每一个,

并将所有的卷积替换为深度可分离的卷积,这与 BiFPN 相

同。我们使用相同的骨干和类/盒预测网络,所有实验都使

用相同的训练设置。 正如我们所看到的,传统的自顶向下

FPN 本质上受到单向信息流的限制,因此具有最低的精度。

虽然重复 FPN+PANet 比 NASFPN 获得了略好的精度,但

它也需要更多的参数和 FLOP。 我们的 BiFPN 实现了类似

的精度重复 FPN+PANET,但使用更少的参数和 FLOP。通

过附加加权特征融合,我们的 BiFPN 以较少的参数和 FLOP

进一步达到了最佳的精度。[10]

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc