o79061Sli.分类弓UDC密级学号020443东南硕士掌大学位论文基于VQ与GMM的说话人识别研究生姓名:处鳇导师姓名:昱锺扬塾攫申请学位级别王堂亟±论文提交日期2鱼堕生i目!§目学位授予单位盔直态堂答辩委员会主席学科专业名称焦呈生信皇墅理论文答辩L]期!QQ§玺旦旦学位授了日期呈鱼生旦旦评阅人2005年3月15目�

摘要说话人识别的研究始丁20世纪30年代,有着极为广阔的应用前景。本文分析了说话人识别中的主要技术,从特征参数的获取到各种识别方法的应用,重点介绍了矢莓量化(vQ)和高斯混合模型(GMM)两种基于模板的识别方法。并实现了一个主要基于VQ的说话人识别系统,在闭集测试中取得了较好的效果。在VQ方法的训练中,提出了一+种基丁逐点搜索的改进的LBG算法,较好地解决了传统LBG算法在迭代过程中会产生空胞腔、无法适用于多种距离测度等问题。并设计r一种对VQ量化误差进行规格化处理的方法,使规格化后的量化误差更加适台对说话人进行判决。对GMM方法的框架进行了初步的研究,并对EM算法中迭代初值的选定、方差的限定及模型馄合数对识别结果的影响进行了’+定程度的讨论。在预处理方面,提出了一种基丁基音轮廓抖动的去除语音中噪音段和静音段的方法,取得了很好的实际效果。最终的识别系统针对8KHz的单声道语音,采用了lo阶的线性预测系数、lo阶的线性预测倒谱系数以及基音参数构建了一个主要采用VQ方法的说话人识别系统,在1i个说话人的闭集测试中取得了接近loo%。这个系统被进一步扩展到在多人对话场景下的自动分段说话人识*U,也取得了一定的识别效果。关键词:说话人识别矢量量化高斯混合模型LBG算法EM算法去噪声方法�

AbstractAutomaticspeakerrecognitionresearchbeganinthe1930’sIthasabroadapplicationforegroundInthispaper,basiccomponentsofitarereviewed,includingtheacquirementofspeechfeatureparametersanddifferentmethodologiesappliedTwotemplatebasedmethods,vectorquantization(VQ)andGaussianMixtureModel(GMM),arestudiedindetoilAndanautomaticspeakeridentification(ASI)system,mainlybasedonVQ,isimplemented.Thissystemachievesgoodperformancesinclosesettests.inVQmethod,animprovedLBGalgorithmisproposed,whichiscapableofsolvingproblemsthattraditionalLBGalgorithmencounters,includingthegenerationofnullpartitionandthedifficultywhenhandlingdifferentdistortionmeasuFeotherthanEuclideandistanceAnormalizationschemeisdesignedasapost-processonVQerror.ThenormalizedVQerrorprovidesamoreproperbasisformakingspeakerjudgmentGMMIsalsostudied.discussionjsmadeontheselectionofinitiaIvalueInEMrecursivealgorithm,thelimitationonindividualvarianceandthenumberofmixturecomponentsAmethodwhichremovesnoiseandsilencesegmentsfromspeechisestablished.ThemethodisbasedonthepitchcontourditheringandleadstoasatisfyingresultThesystemimplementedhandles8KHzmonodigitalspeech.FeaturesusedincludeLPC.LPCCandpitchparameters.ItismainlybasedonVQmethodandachievessatisfyingperformancesThesystemisextendedtoworkonmulti-speakerdialogaswell.Keyword=speakerrecognitionvectorquantizationGaussianmixturemodelLBGalgorithmEMalgorithmnoise—removalmethod�

东南大学学位论文独创性声明本人声明所呈交的学位论文是我个人在导师指导卜进行的研究工作及取得的研究成果。尽我所知,除了文中特别加以标注和致谢的地方外,论文中不包含其他人已经发表或撰写过的研究成果,也不包含为获得东南大学或其它教育机构的学位或证书而使用过的材料。与我一同工作的同志对本研究所做的任何贡献均已在论文中作了明确的、兑明并表示了谢意。研究生签名:‘亟二逮::日期:—200—5.3东南大学学位论文使用授权声明东南大学、中国科学技术信息研究所、国家图书馆有权保留本人所送交学位论文的复印件和电子文档,可以采用影印、缩印或其他复制手段保存论文。本人电子文档的内容和纸质论文的内容相一致。除在保密期内的保密论文外,允许论文被查阅和借阆,可以公布(包括刊登)论文的全部或部分内容。论文的公布(包括刊登)授权东南大学研究生院办理。研究生签名:妾:建导师签名:墨亟鱼日期:导师签名:/k钵1∥日期:2005.3�

1.1课题研究背景第一章绪论随着计算机技术的发展,人们越来越不满足于传统的依赖于键盘和鼠标的人机交互方式,而希望计算机提供一个更加友好的界面,使我们以自己更为习惯的交流方式来实现人机交互。我们希望计算机能够理解和判断人在日常生活中所发出的自然信息,这些信息包括视觉上,触觉l二和听觉上的。视觉上,我们希望计算机可以读懂人的表情和动作,做出相应的反应;触觉上,目前广泛使用的触摸屏是一个不错的例子。而听觉上,我们希望计算机可以理解我们的自然语言。自然语言所传递的信息包括说话的内容、说话的人以及说话时的情绪等等。本文将主要研究计算机对说话人的识别,即自动说话人识别(automaticspeakerrecognition.ASR)。说话人识别又可以分说话人鉴别(automaticspeakeridentification,ASI)和说话人验证(automaticspeakerverification,ASV)两种模式。ASI是指对一段语音,判决是否是某些感兴趣的说话人中的一个所发出;ASV则指对一段语音,语音的发出者已经声明自己是某人,让系统来判决真伪。可以看出两者的区别在于ASI的判定范围是所有感兴趣的说话人,是一个集合,而ASV的判定范围则集中到一个人,即被声明的那个人。显然,要达到同样的识别准确率,ASl的实现难度要超过ASV。而ASV则可以看成ASI在判定范围集合人小为1时的一个特例。我的论文工作将构建一个ASI系统,可以基于这一系统,方便地实现ASV。就ASI系统米说,又可以分为特定内容(text—dependent)的ASI与非特定内容-(text-independent)的ASI。前者要求待辨识人说指定内容的一段话来进行识别,而后者则对待辨识人的说话内容无任何限制。显然,后者更具一般性,在实现难度上也更大。本次课题构建的系统所选择的正是这种更具一般性的|F特定内容的ASI。模拟语音在被计算机识别之前,首先要进行数字化。这就牵涉到采样率和采样精度的问题,构建的ASI系统面向的是采样率为8KHz,16bit线性采样精度,单声道的数字语音。这种配置符合电话信道中单路语音的配置,具有广泛的适用性;更高采样率、采样精度和提供更多声道数的数字语音将提供比当前配置更多的信息,因此容易在当前系统中加以扩展。说话人识别有着广阔的市场应用前景,如安全系统的语音开启,公安系统的语音验证,电话网络上的呼叫者自动辨认等,在互联网上则可应用于信息监测、语音邮件,电子商务,信息服务、远程登陆等诸多领域。1.2说话人识别技术的主要方法及其发展概况在日常生活中,我们要依靠听觉识别一个人的声音,必须事先要对这个人的声音足够熟悉。对计算机来说也是一样,任何说话人识别的方法都是先为计算机提供足够的特定说话人的语音样本,让计算机来“熟悉”这个说话人的声音。对多个说话人识别系统,就要提供~组这样的语音样本。1�

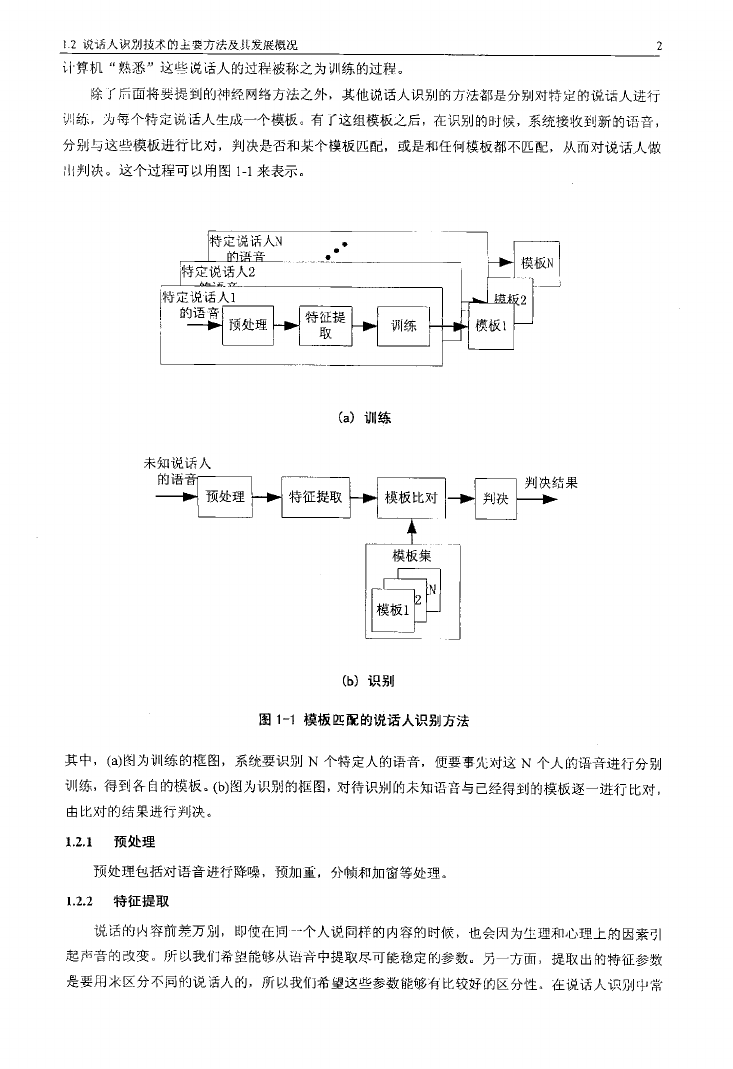

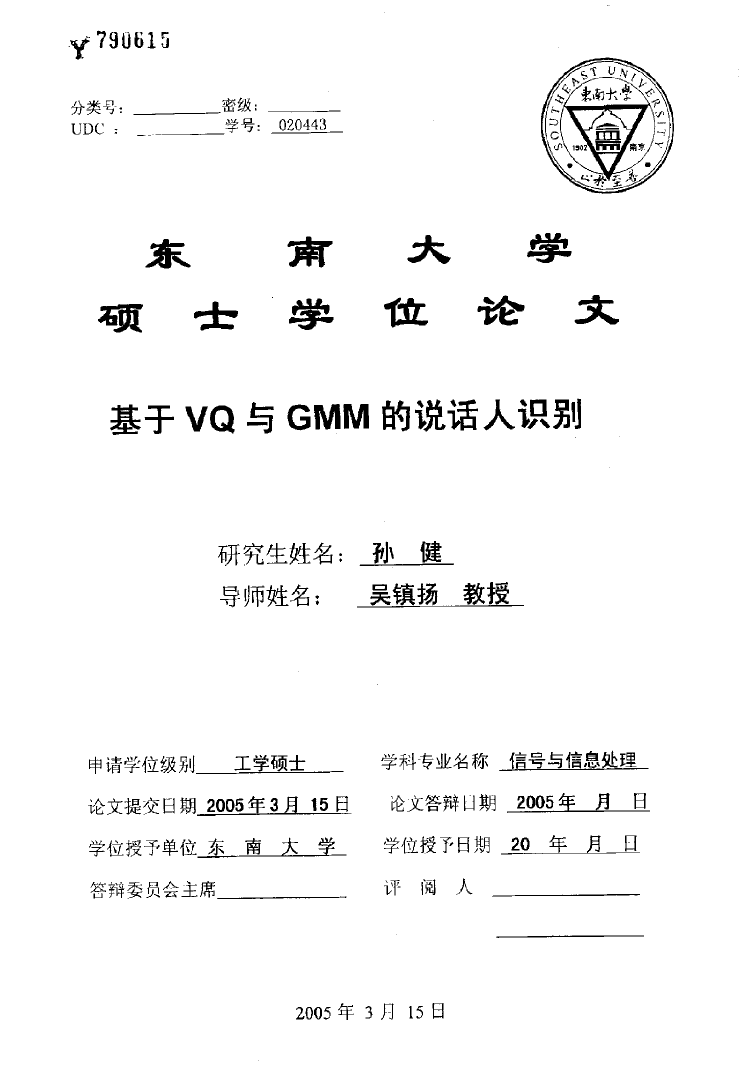

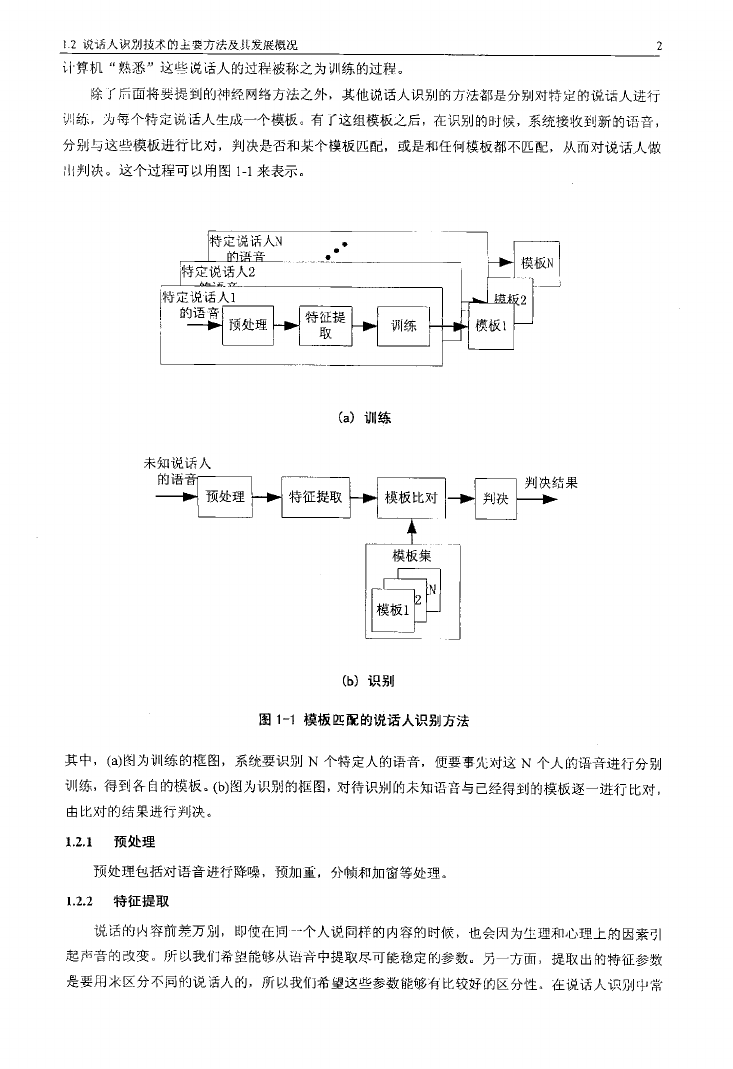

2说话入识别技术的主要方法及30发袋概况2计算机“熟悉”这些说话人的过程被称之为训练的过程。除r后面将要提到的神经网络方法之外,其他说话人识别的方法都是分别对特定的说话人进行训约、,为每个特定说话人生成一个模板。有r这组模板之后,在识别的时候,系统接收到新的语音,分别与这些模板进行比对,判决是否和某个模板匹配,或是和任何模板都不匹配,从而对说话人做…判决。这个过程可以用图1—1来表示。未知说话人(b)识别图1—1模板匹配的说话人识别方法果其中,(a)矧为训练的框图,系统要识别N个特定人的语音,便要事九对这N个人的语音进行分别训I练,得到各自的模板。(b)圈为识别的框图,对待识别的未知语音与己经得到的模板逐一进行比对,由比对的结果进行判决。1.2,1预处理预处理包括对语音进行降噪,预加重,分帧和加窗等处理。1.2.2特征提取说话的内容前差万刷,即使在同一个人说同样的内容的时候,电会冈为生理和心理上的因素引起声音的改变。所以我们希望能够从语音中提取尽可能稳定的参数。另一方而,提取出的特征参数是要用米区分不同的说话人的,所以我们希望这些参数能够有比较好的区分性。在说话人识别中常�

2说话人识别技术的丰要万往及其发展概况3用的特征包括:11基音Pitch人们通过声道(包括咽,喉,151,舌等器官)发出声音。语音被分为清音和浊音,在芨清音时,声道不发生振动,保持畅通。而在发浊音时,声道振动,发出声门脉冲,这个脉冲由一系列谐波函数替加而成,其基颁列应的周期被称为基音。基音反映了一个人辟!有的发音特征而与说话的内窖无关。白1972年被引入到说话人识别领域以来【4],得到了广泛的应川。不过由于它容易被模仿,所以常与其他参数组合后使用。2)线性预测系数(LPC)及其派生系数上世纪50年代后期,语音声源模型被提出。这个模型对人发声的模型进行了近似,以周期性的脉冲激励和白噪声序列来分别模仿清音和浊音的声道激励,而以一个缓慢时变的线性滤波器来模仿声道的物理特性。这个线性滤波器后来广泛地采用全极点的AR模型和线性预测方法加以建模。得到的滤波器系数被称为线性预测系数(LPC)。LPC可以用基于Durbin递归的自相关方法求}l【[2],算法复杂度低,适合应用。LPC在1974年最早被引入说话人识别领域【5]。[6]e0就LPC提出了一种新的距离测度,ltakura—Satio距离,使其在此领域获得了巨火成功。LPC还经常被进行各种变换,生成其他一些在感知学上更有意义的参数来进行说话人识别,这些参数包括反射系数(Rc),对数面积比率(LAR),线谱对(LSP)系数以及LPC倒谱(LPCC)。3)MeI倒谱系数(MFCC)Mel标度是对物理频率的‘个映射,这个映射在IKHz以下接近线性映射,而在1KHz以上接近对数映射。人耳对声音的在频率上分辨能力是非线性的,对低频的分辨率较高,1m对高频的分辨率较低。进一步的研究发现,可以将频率域划分为若干个部分,当声压恒定时,在某个带宽内的一个具有复杂包络的信号的响度等价于在这个带宽中心频率位置上的一个纯音的响度,而与信号本身的频率分布无关。这种划分得到的子带被称为临界子带(CriticalBand)。研究表明临界子带在Mel标度下呈现均匀的跨度。将语音通过带宽分布符合临界带宽的滤波器组(Mel滤波器组),得到一组输出,再进行一系列的变换处理,便可以得到Mel倒谱系数。Me]倒谱系数反映r入对声音的感知特性,自1980年Davis和Mermelstein在[7]中首次将其引入语音识别领域以来,己被广泛应用并取得了很好的识别效果。1.2.3基于不同模板的方法对话音进行预处理和特征提取后,得到一个特征参数的集合,从统计学的观点来看,这是一个观测样本集合,下面简称它为样本集,其中每一个特征参数是一个样点。回顾图1.1,基于模板的方法都是对训练语音的样本集进行处理,为每个特定说活人建立一个模板。存识别时.对待识别语音的样点分别与每一个模板进行比较,根据某种方法得到一个匹配度评价,再综合对所有模扳的匹配度评价做最后的说话人判决。根据实现模板的不同方法.这类型的方法叮卧作如下分类。�

2说话人议刷技术的主要方法及其发展概况411概率统计方法对语音的一些短时特征,如基音,短时频谱等进行统计分析,得到这些特征参数的均值和方差1。在识别的时候,用同样的短时特征来和先前的均值和方差进行比较分析,再进行分类判决。这里,一个均值和一个方差对应一个特定人的模板,匹配度评价通常是计算新的特征参数样本与模板的均值的距离,再与模板方差比较而得到的。21VQ方法欠量量化(VectorQuantization)技术基丁聚类分析,最早用于数据压缩编码技术。1985年,这项技术被引入说话人识别领域[8]。VQ方法在训练时对特定说话人语音的样本集进行聚类,将样本空间划分为有限个子空间,各个子空间的中心所组成的集合被称为码本。这里,每个码本对应一个特定说话人的模板。识别时将新的样本用按此码本进行量化编码,以编码产生的失真度作为匹配度评价的标准。3)GMM方法高斯混台模型(GaussianMixtureModel,GMM)将~个特定人的语音样本集看作是一个随机分布,并认为这个随机分布是由若干个高斯分布线性叠加而得到的。1990年,这一模型被引入说话人识别领域[91,GMM模型具有较强的鲁棒性,能够对复杂的概率密度分布做精确的建模。这里,每个高斯混合密度分布对应一个特定说话人的模板。识别的时候将新的语音样本代入这个混合密度分布函数,得到一个似然概率,以这个概率作为匹配度评价的标准。4)HMM方法隐形马尔可夫模型(HiddenMarkovModel,HMM)是比GMM更进一步的模型,它将语音作为一个随机过程来建模。它与前面所有建模方法最大的不同在于它是对--N样本点序列而不是独立的样本点来进行建模。它假设说话人处于一些可能的说话状态之中,每个状态下样本集符合某种概率密度分布函数,而状态之间的转移符合马尔可夫链的定义。这里,各个状态所对应的物理意义并没有被明确指出,而是被“隐藏”在状态背后,这也是模型被命名为隐马尔可夫模型的原因。如果HMM的状态数为1,并且在此状态下的概率分布满足一组高斯分布的线性组合,那么HMM模型便退化成GMM模型。这一方法在70年代首先被Baker[10】和Jelinek[11]应用到语音处理领域。HMM方法里,每个隐马尔可夫链对应一个特定说话人的模板,识别的时候计算未知语音的一组样本序列在在每个隐马尔可夫链F产生的概率,以此作为匹配度评价的标准。由于对语音做了迄今为止昂为精确的建模,所以目前广义的语音识别系统已经“全盘采用HMM算法框架,以及非常细致地将声学、语音学和语言学的知识引入并改善这个框架”[21。1.2.4人工神经网络方法说话人识别从外延上来说属于模式识别问题,鉴于人工神经网络(NeuralNetwork,NN)在模式判决领域的成功应用,将其应Hj到说话人识别上来是很自然的事情。NN片j于说话人识别,依然要先进{N)/I练,但与自U面的方法所不同的是,它并不是为每一个感兴趣的说话人分别生成模板,而是。这里特征参数既iJ能是标量,也口J能是矢量,为叙述卜的简洁统称它们为特征参数,对参数标量来说,其均值和方差姐是一个标量;对参数矢量来说,其“均值”电是。个矢量.而其“方差”则扩展成西方差矩阵。�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc