三、实验方法设计

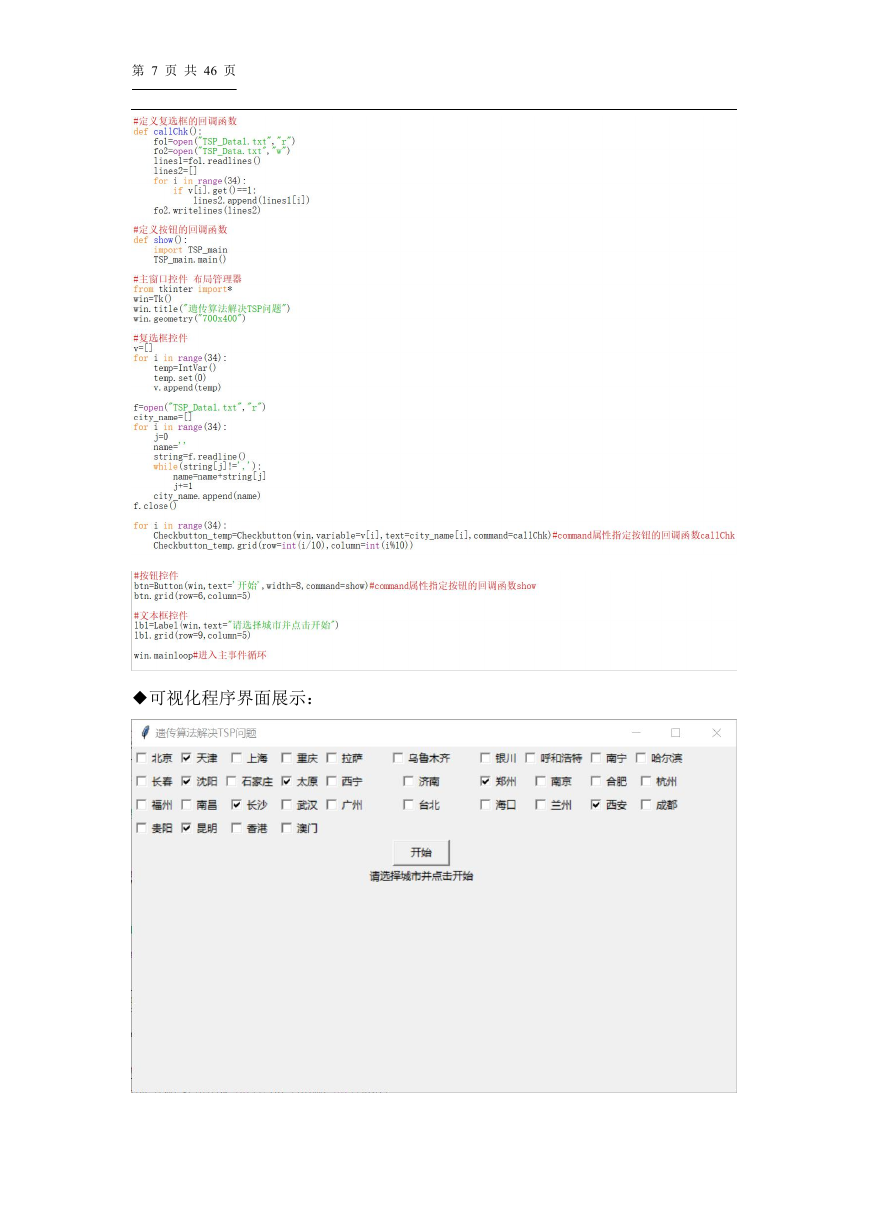

四、实验结果展示

总结:

随着变异概率的增大,最优解会逐渐偏离好的状态,交叉部分越来越多,这可能是因为变异算法变异幅度过大或者

五、实验总结及心得

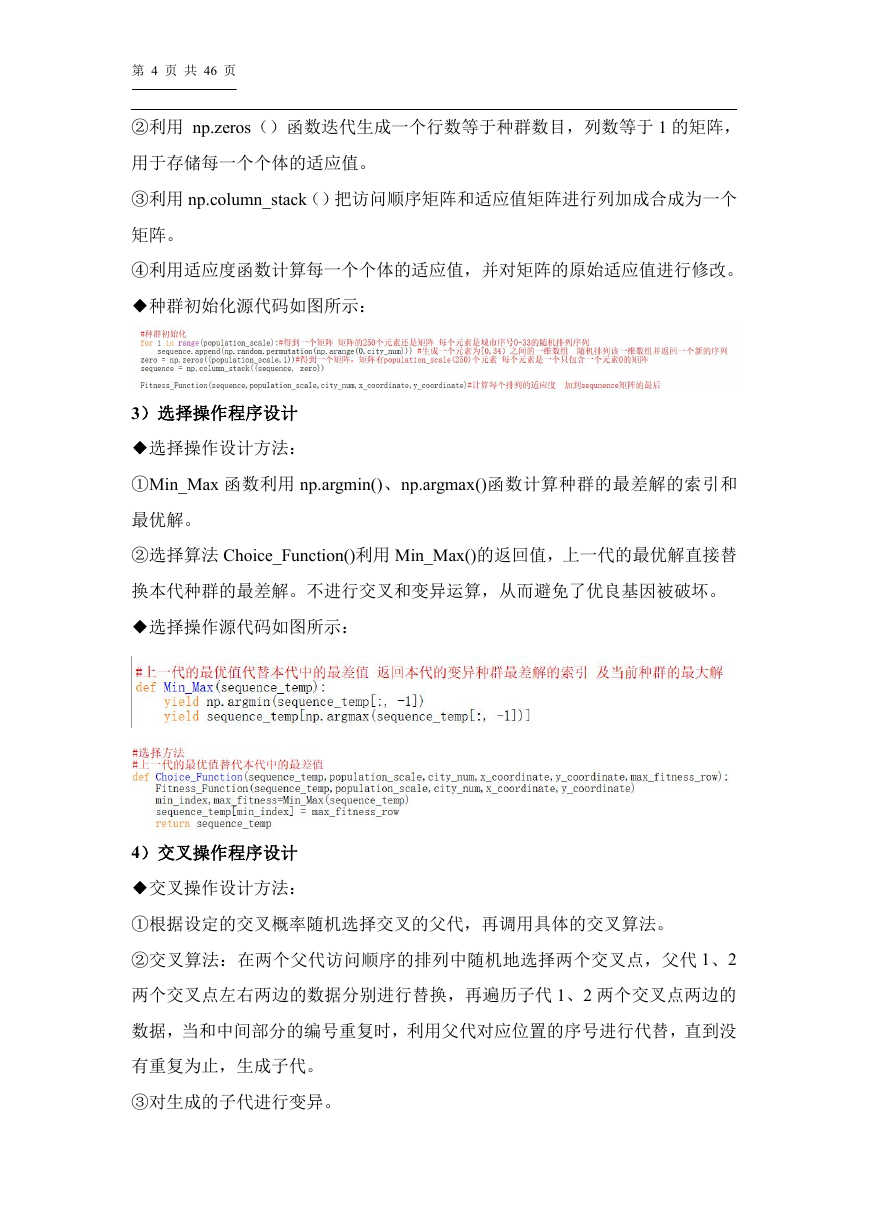

◆ numpy.random.permutation()随机排列一个序列,生成并返回该序列。

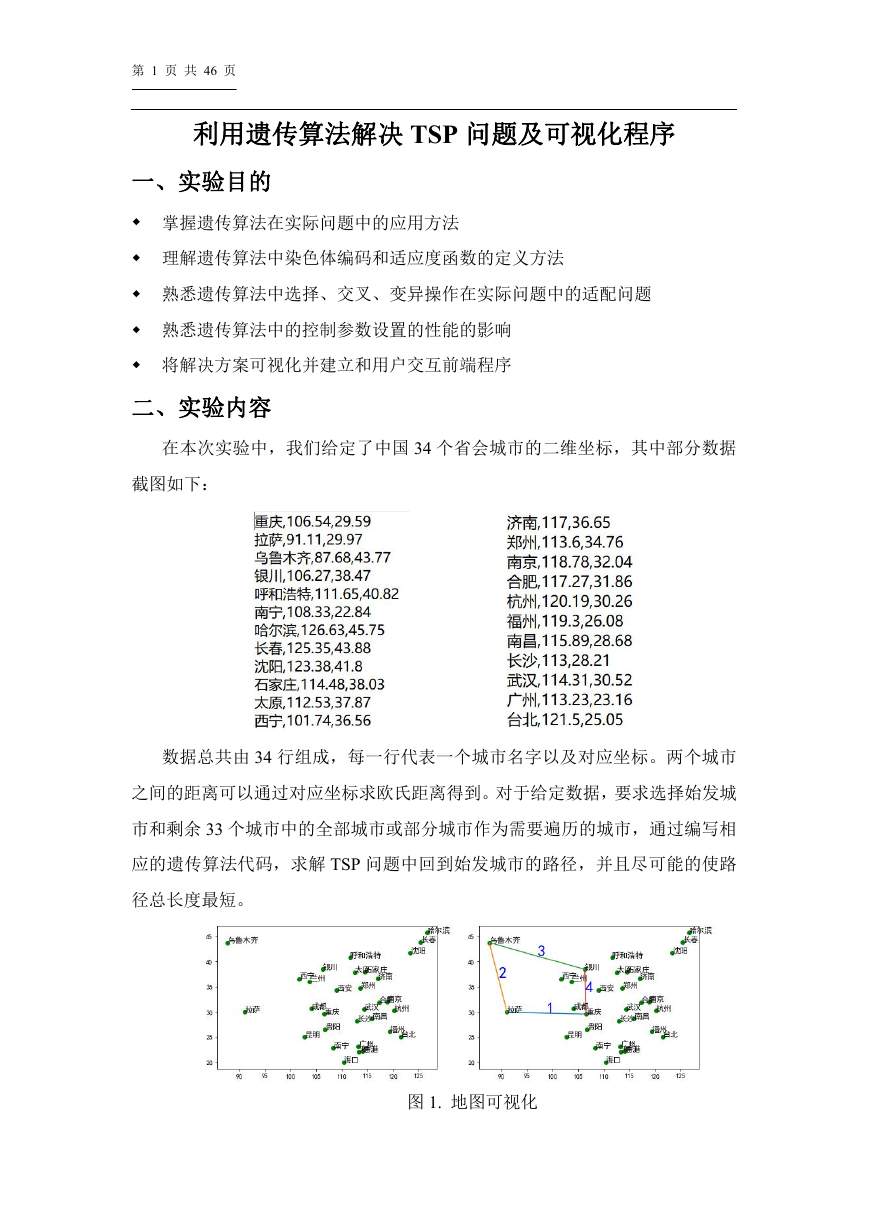

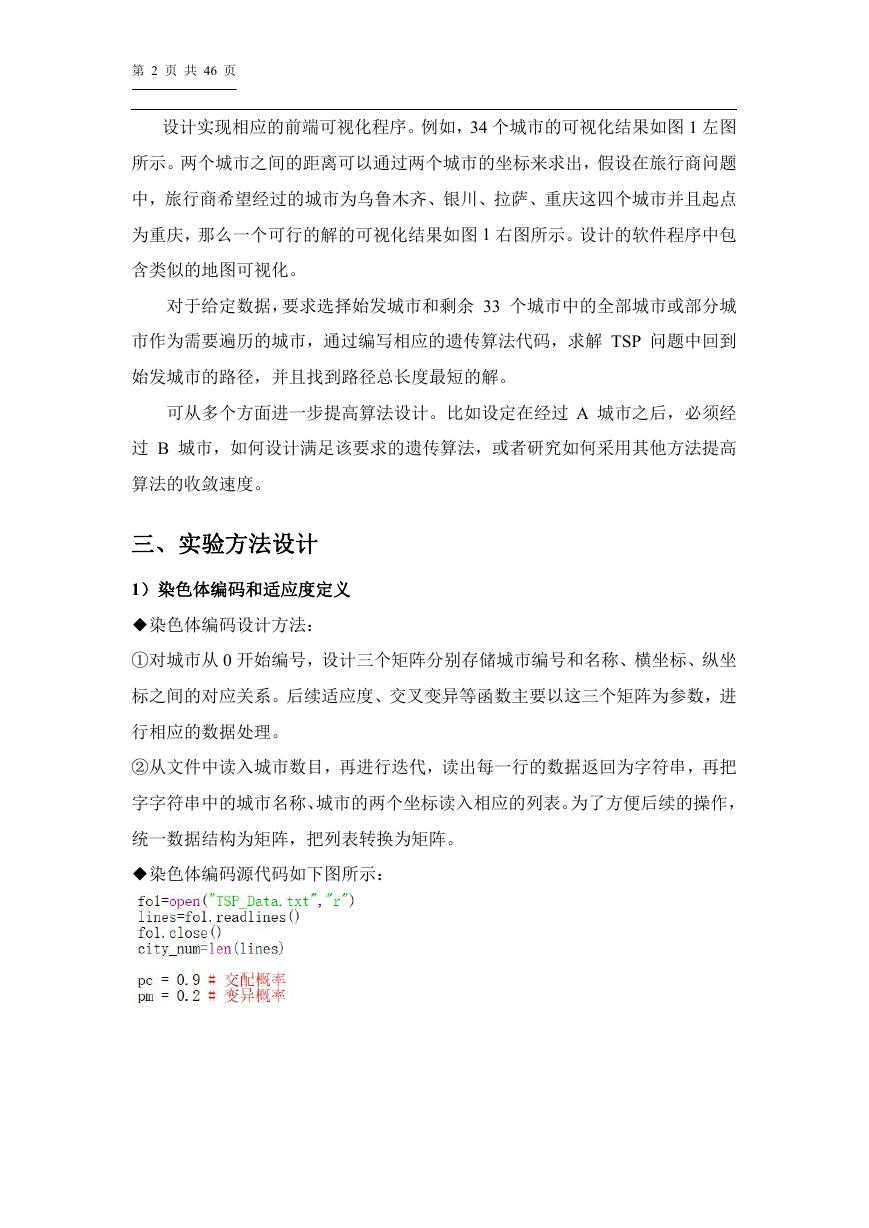

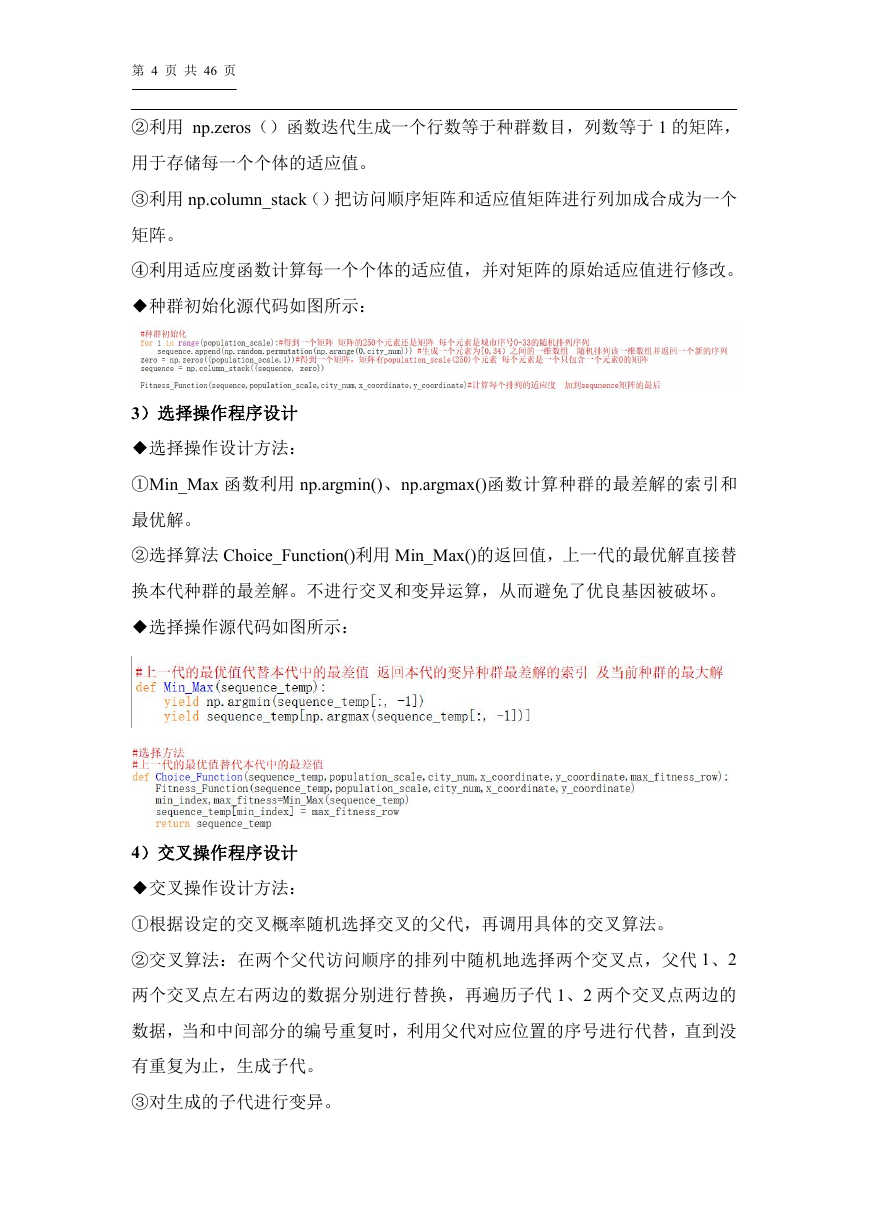

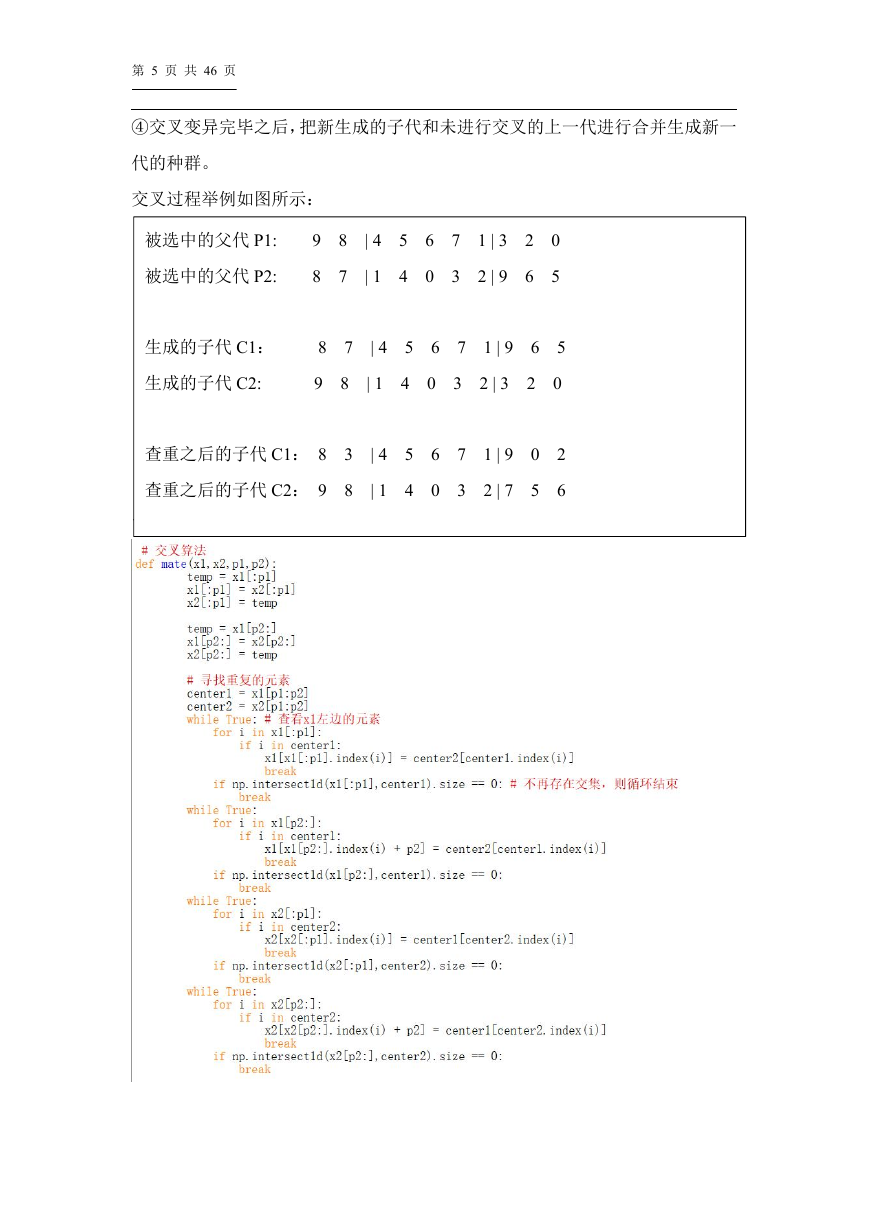

三、实验方法设计

③使用tf.nn.sparse_softmax_cross_entropy_with_logits计

④使用tf.reduce_mean(cross_entropy)+regularization,通过

四、实验结果展示

五、实验总结及心得

①实验时本来想用卷积神经网络来进行建模,但出现了一些不会调的错误改用了单隐藏层的神经网络进行建模。

②这次实验调用了很多tensorflow的库,也了解了很多的函数和方法,tensorflow是很方便

③实验中简单划分的准确率反而比其他划分的准确率高,可能是因为模型的其他缺陷造成的,虽然准确率比较高,

④从上面的分析可以看出,一个模型的好坏是需要从不同的角度去思考和测试的,这期间可能需要加上自己的逻辑

六、附录

实验过程涉及python一些库的使用,相关函数和方法总结如下:

◆numpy使用ndarray对象来处理多维数组,该对象是一个快速而灵活的大数据容器。numpy是专

◆numpy matrix必须是2维的,但是 numpy arrays (ndarrays) 可以是

在numpy中matrix的主要优势是:相对简单的乘法运算符号。例如,a和b是两个matrices,

matrix 和 array 都可以通过objects后面加.T 得到其转置。但是 matrix o

相反的是在numpy里面arrays遵从逐个元素的运算,所以array:c 和d的c*d运算相当于m

◆arange([start,] stop[, step,], dtype=None):根据star

◆numpy.random.permutation()随机排列一个序列,生成并返回该序列。

◆np.argmax(a, axis=0):竖着比较,返回行号(二维)。

◆np.argmax(a, axis=1):横着比较,返回列号(二维)。

◆yield:一个带有 yield 的函数就是一个 generator,虽然执行流程仍按函数的流程执

◆tf.truncated_normal(shape, mean, stddev) :shape表示

◆tf.nn.relu(features, name = None):计算激活函数 relu,即 m

◆tf.matmul(a,b):将矩阵 a 乘以矩阵 b,生成a*b,输入必须在任何转换之后是 ra

◆ tf.placeholder占位符,是TensorFlow中特有的一种数据结构。类似动态变量,函

◆tf.train.ExponentialMovingAverage():这个函数用于更新参数,就是

◆tf.nn.sparse_softmax_cross_entropy_with_logits():

◆tf.contrib.layers.l2_regularizer():规则化防止过度配合,提高模型

◆tf.reduce_mean():可跨越维度的计算张量各元素的平均值。

◆tf.train.GradientDescentOptimizer():学习率不能过高也不能过低。

◆tf.control_dependencies():指定某些操作执行的依赖关系。

◆tf.equal(A, B):对比两个矩阵或者向量的元素,如果相等,那就返回True,否则,返回F

◆random.randint(a, b),用于生成一个指定范围内的整数。其中参数a是下限,参数b是

◆tf.cast(x, dtype, name=None),将x的数据格式转化成dtype。

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc