年 月

系统 工 程 理 论 与 实践

第 期

神 经 网络 模 型 的 改 进

高 洪 深

陶 有 德

北 方 工 业 大 学 , 北 京

信 阳 师 范 学 院 , 河 南

摘 要 本 文 在 深 入研 究

理 方法 , 并 通 过 仿真 试验 实践 表明 , 这 些 改进 和 技 术处 理 方 法 是 有 效 的

神 经 网络 模 型 的基 础 上 , 提 出 了 对 该 模 型 的 若 干 改 进 技 术 处

,

〕

叮

,

,

,

,

一

,

’,

引 言

在 神经 网络模 型 中 , 其 中最 具 有代表意 义和 广泛 用 途 的是

神经 网络模 型

神经 网络模

型 是 由输入层 、 输 出层 和 若 干 隐含层组成 的前 向连接模 型 , 同层 各 神 经 元 互 不 连接 , 相 邻层 的神 经 元

通 过 权连接 , 最基本 的

神经 网 络是 三 层 前馈 网 络 ,

神 经 网络模 型 的逆 传 播 算 法

具 有思路 清 晰 、 结 构

严谨 、 可 操 作 性 强 等特 点 , 并 且 由于 隐含节 点 的 引入 , 使得 一 个三层 的 具 有

神 经 元 的 非 线

性 网络 可 以 以 任意精度逼 近 任 何连 续 函 数 , 因而在很 多领域 中都得 到 了广 泛 的应用 但 是 , 这 种算法

也存在 以下 缺 点

从数学上 看 它 归纳 为一 非线性梯度 优化 问题 , 因此不 可 避 免地 存 在 有局 部 极 小 问题

学 习 算法 的收 敛 速度很 慢 , 通 常需要 上 千 次迭 代或者 更 多

网 络 的 结构 为 前 向结构 , 没 有反馈 连 接 , 因此 它 是 一 个 非 线 性 映射 系统

网络 隐含 节 点 的个 数 尚无理 论 上 的指 导

对 新加 入 的样 本要 影 响 己经 学 完 的样本 , 刻划 每 个输入 样 本 的特 征 的数 目也 要 求 必须 相 同

为 了克 服

神 经 网 络 的 上 述缺 点 , 提 高 模 型 的收敛 速 度 和 预 测 精度 , 我 们 在

神经 网络模

型 的逆 传 播算 法 的 基础 上 进 行 了若 干 改 进 , 获 得 了很 好 的效 果

本 文 于

年 月

日收 到 ,

�

系统 工 程 理 论 与 实践

年 月

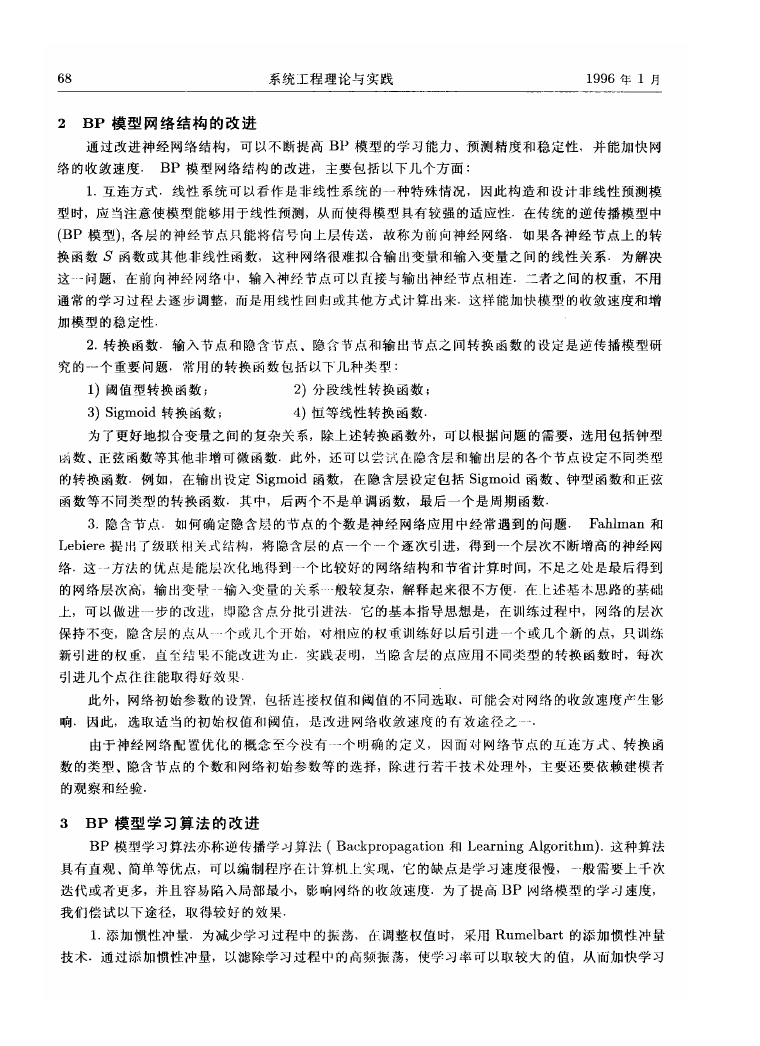

模 型 网 络 结 构 的 改 进

通 过 改 进 神经 网 络 结构 , 可 以 不 断提 高

模 型 的学 习 能 力 、 预 测 精 度 和 稳 定 性 , 并 能 加 快 网

络 的收 敛 速 度

模 型 网 络 结构 的 改 进 , 主 要 包 括 以下 几个 方面

互 连 方 式 线 性 系统 可 以 看 作 是 非 线 性 系 统 的 一 种 特 殊 情 况 , 因此 构 造 和 设 计 非 线 性 预 测模

型 时 , 应 当注 意 使模 型 能 够用 于 线性 预 测 , 从而 使得 模 型 具 有 较 强 的适 应性 在传 统 的逆 传 播模 型 中

模 型 , 各 层 的神 经 节 点 只 能 将 信 号 向上 层 传 送 , 故 称 为 前 向神 经 网 络 如 果 各 神 经 节 点 上 的转

换 函 数 函 数或 其 他 非 线 性 函 数 , 这 种 网 络 很 难 拟 合 输 出变量 和 输入 变 量 之 间 的线 性 关 系 为 解 决

这 一 问题 , 在 前 向神 经 网 络 中 , 输 入 神经 节 点 可 以 直接 与 输 出神经 节 点 相 连 二 者 之 间 的 权 重 , 不用

通 常 的学 习 过 程 去逐 步 调 整 , 而 是 用 线 性 回 归 或 其他 方 式 计 算 出 来 这 样 能 加 快 模 型 的收敛 速 度和 增

加模 型 的稳 定性 ,

转换 函 数 输入 节 点 和 隐 含 节 点 、 隐含 节 点 和 输 出节 点 之 间转换 函 数 的 设 定 是 逆 传 播模 型 研

究 的 一 个 重 要 问题 常 用 的转 换 函 数 包 括 以 下 几 种 类 型

阑值 型 转换 函 数

转换 函 数

分 段线 性 转 换 函 数

恒 等 线 性 转 换 函 数 ·

为 了 更好地拟 合变量 之 间 的复 杂 关 系 , 除上 述 转 换 函 数外 , 可 以 根 据 问题 的 需 要 , 选 用 包 括 钟型

函 数 、 正 弦 函数 等 其他 非增 可 微 函数 此 外 , 还 可 以尝试 在 隐 含层 和 输 出层 的 各个 节 点 设 定不 同类 型

的转换 函 数 例 如 , 在输 出设 定

函 数 等 不 同类 型 的转 换 函数 其 中 , 后 两 个 不 是 单调 函 数 , 最 后 一 个 是 周 期 函 数

函 数 , 在 隐含 层 设定 包 括

函 数 、 钟 型 函 数 和 正 弦

, 隐 含 节 点 如 何 确 定 隐 含层 的节 点 的 个数 是 神经 网 络应 用 中经 常遇 到 的 问题

和

提 出 了 级 联 相 关 式 结构 , 将 隐含 层 的 点 一 个 一 个 逐 次 引进 , 得 到一 个层 次不 断增 高 的神 经 网

络 这 一 方 法 的优 点是 能 层 次 化地 得 到 一 个 比较 好 的 网 络 结构和 节 省计算 时 间 , 不 足 之 处 是 最 后 得 到

的 网 络 层 次高 , 输 出变量 一 输 入变 量 的 关 系 一 般较 复 杂 , 解 释 起 来很 不 方 便 在 述基 本 思路 的基础

上 , 可 以 做进 一 步 的 改 进 , 即 隐 含点 分 批 引进法 它 的基 本 指 导思 想 是 , 在 训 练 过 程 中 , 网 络 的层 次

保持 不 变 , 隐含层 的 点 从 一 个 或 几 个开 始 , 对相 应 的权 重 训练 好 以后 引进 一 个 或 几 个 新 的 点 , 只 训练

新 引进 的 权 重 , 直 至 结 果 不 能 改 进 为 止 实践 表 明 , 当隐 含层 的 点应用 不 同类 型 的转换 函数 时 , 每 次

引进 儿 个 点 往 往 能 取 得 好 效 果

此 外 , 网 络初 始参 数 的设 置 , 包 括 连接 权 值 和 阑值 的 不 同 选取 , 可 能 会对 网络 的 收 敛 速 度 产 生 影

响 因此 , 选取 适 当 的 初 始 权 值 和 阑值 , 是 改 进 网 络 收 敛 速 度 的 有 效 途 径 之 一

由于 神经 网 络 配 置 优 化 的概 念 至 今 没 有 一 个 明确 的 定义 , 因 而 对 网 络 节 点 的 互 连 方 式 、 转 换 函

数 的类 型 、 隐 含 节 点 的 个数和 网 络 初 始参 数 等 的选 择 , 除 进 行 若 干 技 术 处 理 外 , 主 要 还 要 依 赖 建 模者

的观 察 和 经 验

模 型 学 习 算 法 的 改 进

模 型 学 习 算法亦称 逆 传 播学 习 算 法

和

这 种 算法

具 有直 观 、 简单等优 点 , 可 以编 制 程 序 在 计 算机 实现 , 它 的缺 点是 学 习 速度很慢 ,

一 般 需要 上 千 次

迭 代 或 者 更 多 , 并 且 容 易 陷入局 部 最 小 , 影 响 网 络 的 收 敛 速 度 为 了 提 高

我 们 偿 试 以 下 途径 , 取 得较 好 的 效 果

网 络模 型 的学 习 速 度 ,

添 加 惯 性 冲 量 为 减少 学 习 过 程 中 的 振 荡 , 在 调整 权 值 时 , 采 用

的添 加 惯 性 冲 量

技 术 通 过 添 加 惯 性 冲量 , 以滤 除 学 习 过 程 中 的 高 频 振 荡 , 使学 习 率 可 以取 较 大 的值 , 从 而加 快 学 习

�

第 期

神 经 网 络 模 罕 的 改 进

速度 此 时 , 权值 调整 的 般 形 式 为

△诚 , 艺

二 毕 娜 · 仇 斗一 印 八 诚 。娜

其 中 △诚 价 为 节 点 二 与节 点 匀 在 时 刻 艺 的 连 接 权 值 的 改 变 量 , 刀

和 ‘喷性 因子 , 石对 为节 点 劣 , 的 误差 ,

杯 为节 点 八 的输 出或 输入 ·

和 。

分 别 为 学 习 率

批 处 理 学 习 样 本 在 传 统 的

学 习 算 法 中 , 每给 网 络提 供 一 个学 习 样 本 , 都计算误 差 函 数

并进 行 连 续 连 接 权值 调 整 批 处 理 学 习 样本 则是 当所 有 的样 本都提 交 给 网 络 后 , 根 据输 出错 误 的平均

一 方面减少 了 网络 学 习 的时 问 , 另 一 方 面 避 免 了 因 逐 个样本变

值 统 一 对 网络进 行 一 次调 整 这 样 ,

更 而 产 生 的权 值 过 调 现象 , 从 而 加 快 了 网 络 的学 习 速度 当样本 足 够 多 时 , 学 习 样本 的批 处 理 方 法 ,

能 够 体现样 本 的统 计 规律性

跳跃 学 习 在学 习 过 程 中 可 能 有 一 些 样 本 率先 达 到很 小 的误 差 , 如 果 这 时仍 然 对 它 们 进 行 前

向传 播 和 逆 向传 播 的 计 算 势 必 造 成 时 间 浪 费 , 进 而 影 响 网 络 的学 习 速 度 因 为 它们 对 网 络性 能 的 改

变 贡 献 很 小 , 甚 至 是 不 利 的 , 可 能 使 网络 对 这 些 样 本 的针 对性 过 强 为 了 防止 这 一 现 象 , 可 以 设 置 一

个最 小 误 差 , 若 某 样 本 产 生 的输 出误 差 小 于 这 个 给 定 的最 小 误 差 , 则 不 对 它 进 行 逆 向传 播 的计算

考 虑 到 网 络变 化 的连 续 性 ,

一 次学 习 时连 前 向传 播 计 算 也 略去 , 而径直给 这 样 本 的误 差 加 上 一 个很

小 的值 作 为 它 新 的误 差 这 一 处 理 方 法 称作跳跃 学 习 , 跳 跃 学 习 直 至 其误 差 超 过 最 小误 差 , 再 次进 行

权值修 正

基 于 模 拟 退 火 的 方法 为 使 误 差 函 数 曲面 迅 速 跳 出局 部 最 小 并 达 到 全 部 最 小 , 可 以 采用基 于

模拟 退 火 的方 法 该方法 的基 本 指导 思想 是 , 先赋给学 习 率 以较 大 的数 值 , 使 得 网络 的权值 获取 较大

的 改 变 量 , 进 血 使 得 网 络 获取 较 大 的误 差 , 从而 跳 出局 部 最 小 然 后 逐 渐减 小学 习 率 , 使 网 络 平 稳地

达 到 全 局 最 小 这 种 学 习 率 先 大 后 小 的方 式 与金 属 构件 退 火 过 程 类 似 , 但 区 别 于 模 拟 退 火 方法 , 因此

称作 基 于模 拟 退 火 的方 法

误 差

动 态 调整 学 习 率 , 和 ‘赓性因 子 。 这 种 方 法 的基 本 思 路 是 , 依据 第 之 次迭 代 后 占 个 样 本 总 的

与第 扭一 次迭 代 后 百 个样 本 总 的误 差 扛一 的改变 量 △ 约 的符 号 判 定 第 次迭

代 的性 质 , 即 判 定 第 云 次迭 代 是 有 效迭 代 还 是 无 效迭 代 , 然 后 采用 不 同 的规 则 动 态 调 整 叮 和 。 进而

调 整 各 神经 节 点 的 连 接 权 值 和 团 信 由 于在学 习 过 程 中 , 消 除 了无 效迭 代 , 从而 加快 了 网络 的学 习 速

度

动 态 调 整 学 习 刀 和 惯 性 因 子 。 的 具 体 步 骤 如 下

二

令 万

若 △刃 〔幻 二 刀

一 君 汁 一

。, 则表 明 第 忿 次迭 代是 有 效迭 代 , 此 时 , 按 下 式 调 整 ”和

, , 艺

二 , 孟

入刀

入 〔

食 艺斗一

。

入。 亡

入 任

,

,

同 时对 连接 权 值 作 下 述 调 整

诚 , 艺

二 诚 , 艺

。 十

·

万,

,

, 、十一 。 ‘

· 诚 、‘ 一 诚 、‘ 一

若 △ 劝

约一 召 。一

全 , 则 表 明 第 艺 次迭 代 是 无 效迭 代 , 此 时 , 按 下式 调 整 刀 和

叮

刀 亡 一 入刀 艺

入 任

,

�

系统 工 程 理 论 与 实践

年 月

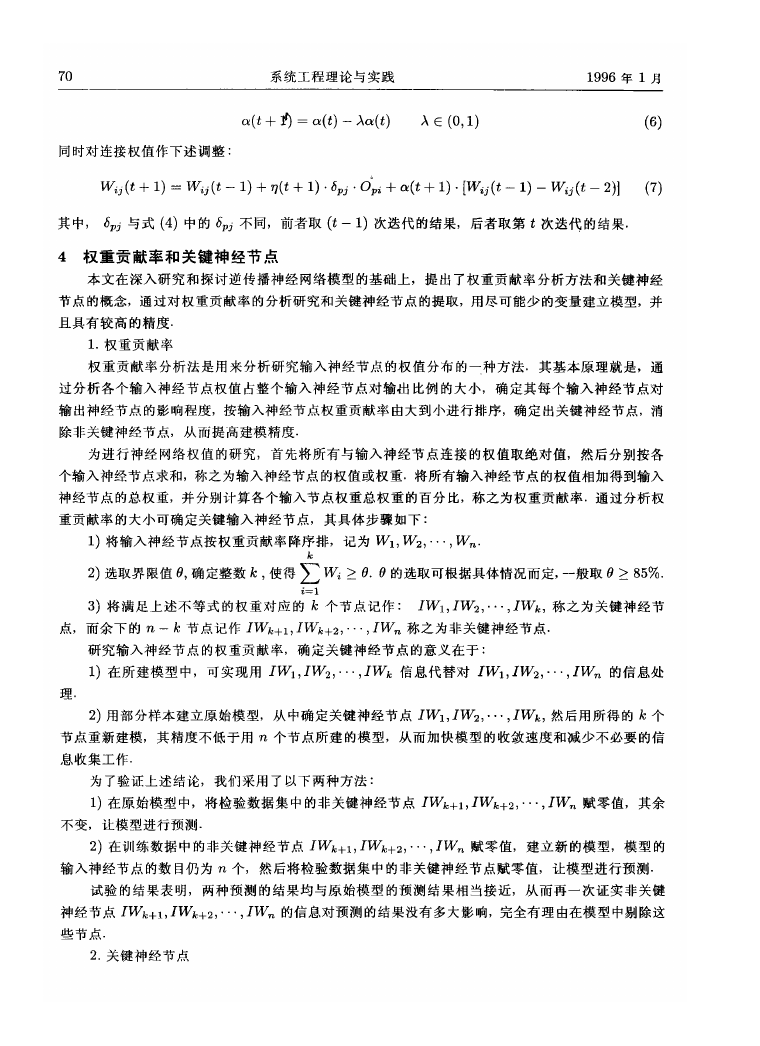

同时对 连接 权值 作下述 调 整

。 巧 。 。 一 入。

入 任

,

城 , ‘

诚 , ‘ 一

刀 ‘

· 场 ·

,

‘

· 诚 , ‘ 一

一 城 , 一 」

其 中 , 好, 与 式

中的 好, 不 同 , 前者取 一 次迭 代 的结果 , 后 者取第 艺次迭 代 的结 果

权 重 贡 献 率 和 关 键 神 经 节 点

本 文 在 深入研 究 和 探 讨 逆 传 播神经 网 络模 型 的基础 上 , 提 出 了权 重 贡 献 率 分析 方法和 关键神经

节 点 的概念 , 通 过对 权 重 贡献 率 的 分 析 研 究和 关键神经 节 点 的提取 , 用 尽 可 能 少 的变量 建立模 型 , 并

且 具 有较高 的精 度

权 重 贡 献 率

权 重 贡 献 率 分 析 法 是 用 来 分 析 研 究 输 入 神 经 节 点 的权 值 分 布 的 一 种 方 法 其基 本原 理 就 是 , 通

过 分 析 各 个输入 神 经 节 点权 值 占整 个输入 神 经 节 点对 输出 比例 的大 小 , 确 定其每 个输入神经 节 点对

输 出神 经 节 点 的 影 响程度 , 按输入 神经 节 点 权 重 贡 献 率 由大 到小进行排序 , 确 定 出关键 神经节 点 , 消

除 非关键神 经 节 点 , 从 而 提 高 建模 精度

为 进 行 神经 网 络 权 值 的研 究 , 首 先 将 所 有 与输入 神 经 节 点连接 的权 值 取绝 对 值 , 然后 分 别按 各

个输入神经 节 点求和 , 称之 为 输入神 经 节点 的权 值 或 权 重 将所 有输入 神经 节 点 的权 值相 加得 到输入

神 经 节 点 的总 权 重 , 并分别 计算 各 个输入节 点 权重 总权 重 的百 分 比 , 称 之 为权重贡献 率 通 过 分 析权

重贡 献 率 的大 小 可 确 定关键输入神经 节 点 , 其具体步骤 如下

将 输入神 经 节 点按 权 重贡 献 率 降序排 , 记 为

币飞, …月飞

无

选取界 限值 “, 确 定整数 “ , 使得 艺 诚 全 “· ”的选取可 根据具体情 况而 定 , 一 般取 “ 全

·

葱

将 满 足 上 述 不 等 式 的权 重 对 应 的 个 节 点 记 作

, 几 , … , 币飞, 称 之 为 关 键 神 经 节

点 , 而 余下 的 一 节 点 记 作

, 不尹飞 , … , 环佑 称之 为 非 关键 神经 节 点

研 究 输入 神 经 节 点 的权 重 贡 献 率 , 确 定关键 神 经 节 点 的 意 义在 于

在 所 建 模 型 中 , 可 实 现用

,

, … , 下 信 息 代 替对

, 叭 , … , 城 , 的信 息 处

理

用 部 分 样本 建 立原 始模 型 , 从 中确 定关键 神经 节 点

, 币飞, … ,

瓦, 然 后 用 所得 的 个

节 点重 新建模 , 其精度不 低 于 用 几 个节 点所 建 的模 型 , 从而 加 快模 型 的收敛 速度和 减 少 不 必 要 的信

息 收 集工 作

为 了验 证上 述结 论 , 我 们 采用 了 以下 两 种 方法

在 原 始模 型 中 , 将检 验 数据集 中的 非关键神经 节 点 环飞 , 环气 , … , 功心 赋 零值 , 其余

不 变 , 让模 型进 行预 测

在 训 练 数据 中 的 非关键 神 经 节 点 下花几 , 环飞 , … ,

, 赋 零 值 , 建 立 新 的模 型 , 模 型 的

输入神经 节 点 的数 目仍 为 个 , 然 后 将检 验数据 集 中的 非 关键神经 节 点赋 零 值 , 让模 型 进 行预 测

试验 的 结 果 表 明 , 两 种 预 测 的 结 果 均 与原 始模 型 的预 测 结 果 相 当接 近 , 从而 再 一 次 证 实 非 关键

神 经 节 点 币币认 , 环飞 , … , 下犷 的信 息对预 测 的 结 果 没 有 多大 影 响 , 完全 有理 由在模 型 中剔 除这

些 节 点

关 键 神 经 节 点

�

第 期

神 经 网 络 模 型 的 改 进

如 上所述 , 通 过对输入神 经 节 点 权值 的研 究 , 按 着 权 重贡 献率 的大 小 , 确 定 出关键 神 经 节 点 和 非

关键神 经 节 点 利 用 关键 神经 节 点重 新建 模 , 其精 度不 低 于 原 始模型 为 提 高模 型 精度 , 加快 收敛速

度 , 可 以考虑在新 的模 型 中继 续提取关 键 神经 节 点 , 并 建 立 新 的 网络模 型 这 就 是关键 神经 节 点提取

法 的 基本思 想

由于 原 始模 型 中输入 神 经 节 点 的数 目是 有 限 的 , 因而 关键神 经 节 点 的提取 不 可 能 无 限 制 地 进行

下 去 , 在 经 过有 限次 提取 以后 必 须终 止 提取关键神经 节 点 的终止原 则 是 剔 除任 一 节 点后 , 如 果余

下 节 点要 权绝 对 值 之 和 占输入 神 经 节 点权 值 总 和 的 比例 小 于界 限值

, 则 终 止 提取

关键神经 节 点提取 的一 般步 骤 为

建立基 于

将 各输入神经 节 点按权 重贡 献 大 小 降序排 列 , 记 为

网络 非 线性预 测 模 型 , 并计算 各个输入 神经 节 点 的权 重 贡 献 率

讼, … , 诚

若 存在 正 整数 “ 使得 艺 诚 全

艺

, 则 提取 “ 个关键神 经 节 点 , 并 重 复 上 述 步骤 ,

,

否 则 , 转

终 止 提取 ·

综 上 所 述 , 提取 关键神 经 节 点方法 可 使用 尽 可 能 少 的变 量建立模型 , 并且 具 有较 高 的预测精 度

并 且 在 一 定程度上 实现在 信 息残缺 的情 况 下 作 出正 确 的预 测

结 束 语

神经 网 络模 型 及 其算法 , 在 许多领 域 已得 到 广泛 的应 用 , 但 是 也 存在着 严 重 缺 陷 因此 , 国

内外 的许 多学者 对此 做 了许 多工 作 , 也 作 了一 些 改进 本 文 在他 们 所 做 工 作 的基础 上 , 作 了大 量 的有

神 经 网 络模 型 若 干 改 进 和 技 术处 理 方 法 , 并进 行 仿真试验 仿真 结果

益 的探 索和 研 究 , 提 出 了对

及 方法 另发 实践 表 明 , 本 文 所提 及 的改 进 与 技 术处 理 方法 是有 效 的 , 提 高 了

网络模型 的学 习

速度 , 加快 了 网 络 的收 敛 , 改 善 了模 型 的预 测 精 度

参考文 献

孔

,

,

,

,

,

戴 汝 为 · 从 定性 到 定量 的综合 集 成 技术 , 模 式 识 别 与人 工 智 能 ,

,

杜利 民 , 候 自强 · 多层 前馈 神 经 网 络快 速 学 习 算 法 的实 现 , 电子 学 报 ,

一

,

一

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc