统计决策方法(贝叶斯)

最小错误率贝叶斯决策:在类条件概率 p(x|c)以及类别先验概率 p(c)已知的情况下,

通过贝叶斯公式比较样本属于两类的后验概率,然后依据最小概率准则分类。

假设样本 x 真实类别为 c,一个模型的决策为 P(c|x),那么模型在样本上的错误率

P(e|x)= 1- P(c|x)。

在样本集的错误率为 P(e)=∫P(x)P(e|x)dx。

最小错误率准则:求得一种决策满足 minP(e)。

对于样本 x,如果其真实类别为 j,但是判别其预测其为类别 i,那么此时的损失为ηij。那么

对于样本 x 预测类别 i 的期望损失为 R(i|x)= ∑ηijp(i|x)。样本 x 的类别即为期望损失

最小对应的类别。(最小风险贝叶斯决策)

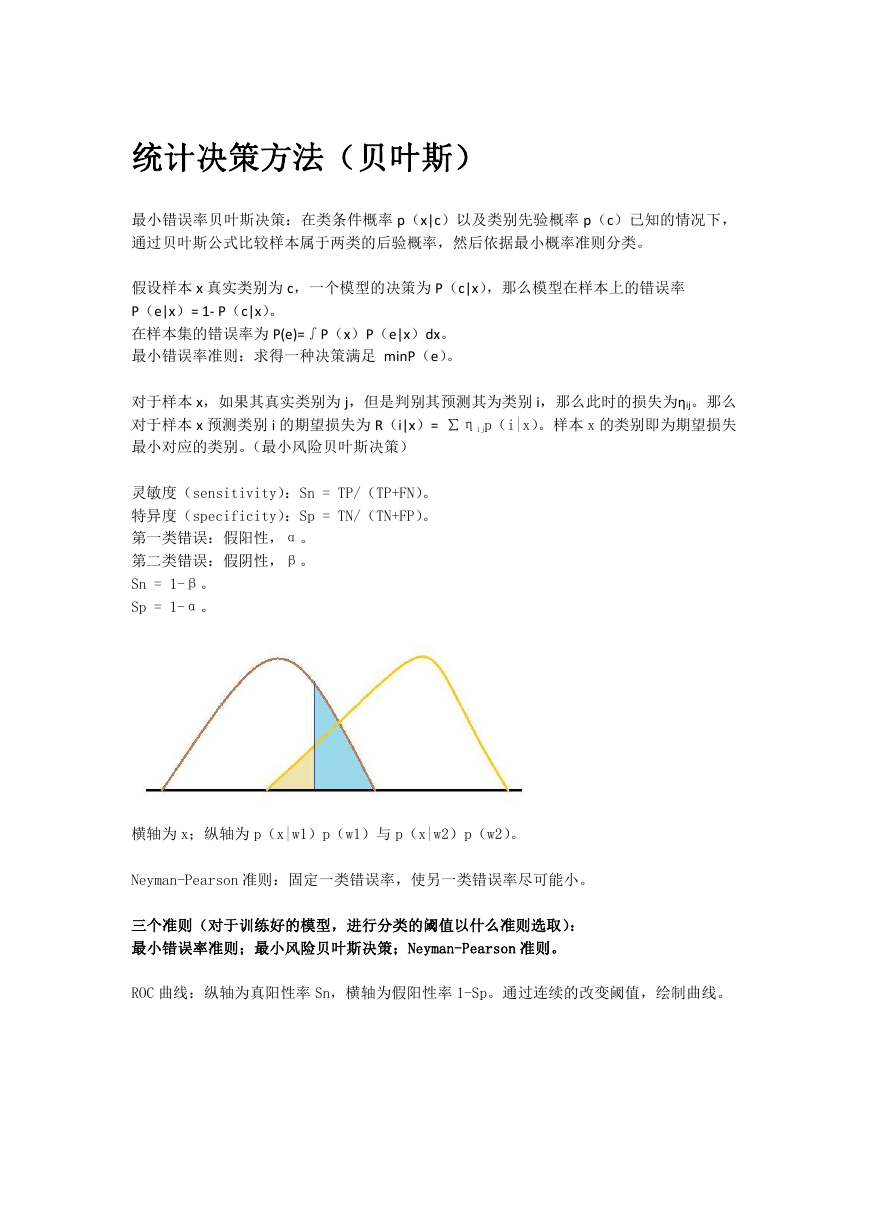

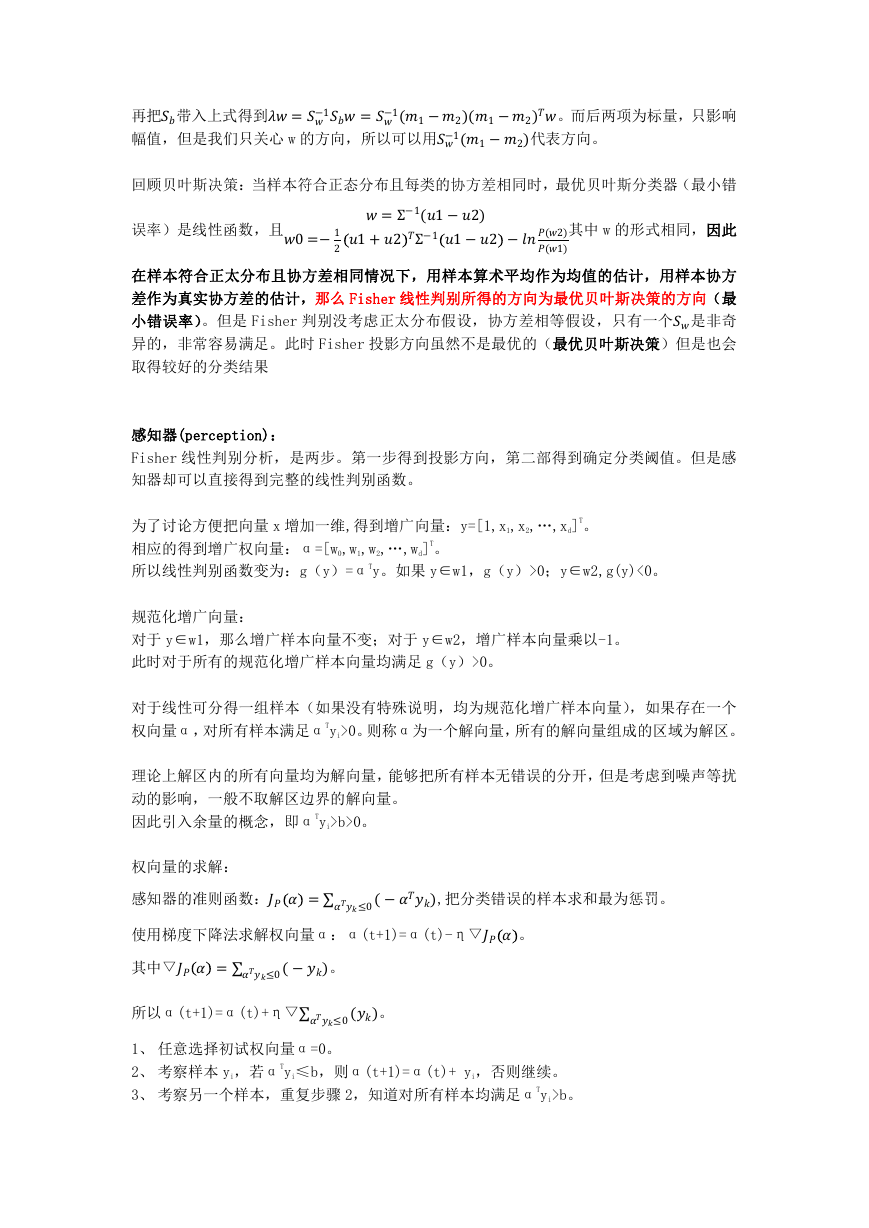

灵敏度(sensitivity):Sn = TP/(TP+FN)。

特异度(specificity):Sp = TN/(TN+FP)。

第一类错误:假阳性,α。

第二类错误:假阴性,β。

Sn = 1-β。

Sp = 1-α。

横轴为 x;纵轴为 p(x|w1)p(w1)与 p(x|w2)p(w2)。

Neyman-Pearson 准则:固定一类错误率,使另一类错误率尽可能小。

三个准则(对于训练好的模型,进行分类的阈值以什么准则选取):

最小错误率准则;最小风险贝叶斯决策;Neyman-Pearson 准则。

ROC 曲线:纵轴为真阳性率 Sn,横轴为假阳性率 1-Sp。通过连续的改变阈值,绘制曲线。

�

正太分布时的统计决策:(本质:判断 p(x|w1)p(w1)与 p(x|w2)p(w2)大小)

1、 p(x)=

(2)/2|Σ|1/2 −12(−)Σ−1−

1

2、 独立性 p(xy)=p(x)p(y)。

3、 不相关性 E(xy)=E(x)E(y)。

4、 正太分布的不相关性等价于独立性,一般分布独立性可推出不相关,但反过来不一定成

立。

5、 正太分布的边缘分布和条件分布仍为正太分布。

6、 线性变化的正态性:若 x 为多元正太分布,均值为 u,非负定协方差矩阵为∑,对 x 做

线性变换 y=Ax,那么 p(y)=N(Au,A∑AT).其中 A 为非奇异矩阵。

7、 线性组合的正态性:若 x 为多元正太分布,均值为 u,非负定协方差矩阵为∑,对 x 做

线性组合 y=aTx,那么 y 为一维正太随机变量 p(y)=N(aTu,aT∑a).

错误率的计算:

�

P(e)=−∞ 2

�

=−∞ (2)|2

�

+ ∞1

�

+ ∞(1)|1

=P(w2)P2(e) + P(w1)P1(e)

由于错误率在选择决策方法时的重要性以及上述公式计算的复杂性,因此有下列三种对错误

率的计算以及估计方法:

1、 按理论公式计算。(正太分布下计算)

A、 正太分布且各类的协方差矩阵相等时。

B、 高维独立随机变量(d 维随机变量 x 的分量间相互独立),在 d 比较大的情况下,由

中心极限定理可求得错误率。

2、 计算错误率上界。(不讨论)

3、 实验估计。(第十章讨论)

离散概率模型下的统计决策:

在贝叶斯决策中,P(w|x)除了连续的概率模型(正太分布等),也可以是离散模型(马尔

可夫,隐马尔科夫等)。

�

概率密度函数的估计:

概率密度函数估计方法:

1、 参数估计(概率密度函数形式已知,但参数未知,使用样本估计这些参数)

A、 最大似然估计

B、 贝叶斯估计

2、 非参数估计(概率密度函数形式未知,或概率密度函数不符合目前研究的任何分布模型,

因此用样本把密度函数数值化的估计出来)

A、 直方图法

B、 Kn 近邻法

C、 Parzen 窗法

判断估计量好坏的标准:

1、 无偏性:E(�) = θ

2、 有效性:Var(�)小

3、 一致性:lim→∞ �− > =0

最大似然估计(maximum likelihood estimation):

假设

1、 要估计的参数为θ,确定但未知的量,这与把它看作随机量的方法是不同的。

2、 每类的样本均为独立同分布的(与马尔可夫模型不同)。

3、 类条件概率密度 P(x|w)具有特定的函数形式。

4、 各类样本只包含本类的分布信息,即不同类别的参数是独立的,这样便可以分别对每一

类单独处理。

在似然函数满足连续、可微的条件下,可以使用导数为零,利用极值点求得最大似然估计;

但是当概率密度形式在最大似然处无零斜率时,上述方法不可以用(均匀分布)。

正太分布下,最大似然估计为:

�=1=1

�

Σ�=1=1

−�

−�

�

贝叶斯估计与贝叶斯学习:

假设

1、 估计参数为随机变量,需要根据观测数据对参数的分布进行估计。

2、 其余与最大似然类似。

�

贝叶斯估计(Bayesian estimation):

把待估计参数θ看作具有先验分布密度 p(θ)的随机变量,其取值与样本集有关,我们要做

的是根据样本集估计最优的θ。

用于分类的贝叶斯决策中,最优的条件为最小错误率或最小风险;这里对于连续的θ,我们

所以:

由样本 x 下的条件风险非负,所以最优θ等价于:

∗=�

假定把其估计为�所带来的损失为λ(�−θ),即损失函数。

R� =

Θλ�−θpθxpxdθdx

��

使在样本 x 下的条件风险为:R�| = Θλ�−θpθxdθ

�

R� = R�|()

�

�−

(�|)=�

�

可以证明,当损失函数为(−�)2时,最优估计为 Θ

�

�

2、 由于样本独立同分布,因此 p(X|θ)= =1 (|)

3、 利用贝叶斯公式求得θ的后验分布pθX =()

() 。

4、 根据最有估计计算式,求得估计量�。

�

接得到样本的概率密度函数pxX = Θ

均值,绝对值误差得到参数的???)

因此此时贝叶斯估计的步骤为:

1、 对于问题的认识,得到θ的先验分布密度函数。

。

.

。(平方误差得到参数的

通过上面的步骤,在得到参数的后验概率 p(θ|X)后,无需求得最优的参数估计量。可以直

同时参数后验概率 p(θ|X)的形状完全由 p(X|θ)和 p(θ)决定,分母的 p(X)起到归

一化的作用。

p(X|θ)在不同参数取值下得到观测样本的可能性。

p(θ)代表人对参数分布的先验知识或者主观观测。

1、 当先验为均匀分布时,参数的后验概率 p(θ|X)完全由似然 p(X|θ)决定。但是与极

大似然最大的不同是,极大似然得到参数的最优点估计后,直接用∗计算新样本 x 的概

率;而贝叶斯是Θ

2、 当先验为脉冲函数时δ(0),等价于直接使用0计算出新样本 x 的概率。

3、 当先验介于两个极限情况之间时,有一种常见情况,似然函数在θ=�处会有一个尖峰,

在θ=�处,此时由损失函数(−�)2得到的贝叶斯估计与最大似然估计接近。新样本

x 的概率密度pxX 也基本等价于最大似然下的概率密度。

那么如果先验概率在最大似然估计处不为零且变化比较平缓,参数的后验概率便会集中

对所有参数取值下新样本 x 的概率的加权平均。

�

�

贝叶斯学习:(下面的学习过程)

pθ =

−1

�

Θ−1

概率密度估计的非参数方法:

直方图估计法:(还有自适应体积大小的直方图方法,体积随样本分布而变化)

1、 把样本 x 的每个分量在其取值范围内分成 k 的小窗。共 kd 个小体积。每个小体积的体积

为 V。

2、 统计样本 X,落入每个小体积的样本数 qi。

3、 把每个体积的概率密度作为常数,并记为 qi/NV。N 为样本总数。

其中每个体积的概率密度常数的估计,可由二项分布求得(为啥用均值作为概率常数的估计)。

Parzen 窗方法(parzen window method//kernel density estimation):(将位于小窗内的

样本对新样本 x 概率密度估计的贡献进行平均)

1、 假设 x 为 d 维向量,并假设每个小舱为边长为 h 的超立方体,那么 V=hd。

2、 通过如下窗函数计算每个小舱内落入的样本数目。

φ 1,2,…, = 1,若 <12

0

�

3、 所以落入以 x 为中心的超立方体内的样本数为= =1 (−ℎ )

4、 因此样本 x 的概率密度估计为� = 1 =1 −ℎ

�

�

= 1 =1 1(−ℎ )

5、 另一个角度解读,核函数Kx, =1(−ℎ ),所以� = 1 =1 Kx,

�

A、 高斯窗函数:Kx, 以样本 x 为均值,协方差矩阵∑=2的多元正态分布。

B、 超球窗函数:Kx, = −1,− <

其余几个核函数/窗函数:

。

。

。

。

0

Parzen 窗方法在核函数以及其参数满足一定条件下是渐进无偏以及平方误差一致的:

1、 核函数对称且满足概率的非负性以及归一性。

2、 有界,不可去穷大。

3、 核函数取值随着距离增大而迅速减小。

4、 小舱体积应随样本数而减小,且体积缩减速度不能太快应慢于 1/N 趋于零的速度。

kN 近邻估计法:(自适应体积大小的小舱方法)

1、 根据总样本个数 N,确定参数 kN 即每个小舱内拥有的样本个数。

2、 在求样本 x 的概率密度时,我们调整小舱的体积,使得其刚好包含 kN 个样本。并利用

kN/NV 计算概率密度估计。

�

基于样本直接设计分类器的三个基本要素:

1、 分类器即判别函数的类型,从什么样的判别函数类中去求解。

2、 分类器设计的目标/准则,确定准则后,便是在该准则下从判别函数类中选择最优的函

数。

3、 如何设计算法,利用样本搜索到最优的函数参数。

线性分类器:

判别函数集为线性函数,使用不同的准则,不同的求解算法,得到不同的线性判别方法。

Fisher 线性判别分析(linear discriminant analysis,LDA):

选择投影方向,使得投影后两类相隔尽可能远,同时每一类内部的样本尽可能的聚集。

原空间:

。

投影后的一维空间:

类内离散度(不是矩阵,而是一个值):

。

�

�

类均值向量:= 1

�

(−)(−)

类内离散度矩阵:= 1

总类内离散度:=11+22。

类间离散度:=(1−2)(1−2)。

类均值向量:�=。

2�=1(−�)(−�)

总类内离散度:�=1�1+2�2=。

类间离散度:�= �1−�2 �1−�2 =。

Fisher 准则: =��=

。此表达式在数学上称为广义 Rayleigh 商。我们注

.. =

通过拉格朗日乘子法,进行求解:Lw,λ =−(−)

求导并等于零得到:−=0。假设是非奇异的(样本数大于维数通常为非奇异)

可以得到−1=。因此 w 为矩阵的特征向量。

意到,我们本意即是寻找一个投影方向,而与向量 w 的幅值无关,因此可以固定 Fisher 准

则中分母为一个非零常数,然后最大化分子:

=1(−�)2

�

�

回顾贝叶斯决策:当样本符合正态分布且每类的协方差相同时,最优贝叶斯分类器(最小错

再把带入上式得到=−1=−1(1−2)(1−2)。而后两项为标量,只影响

幅值,但是我们只关心 w 的方向,所以可以用−1(1−2)代表方向。

0=−12 1+2 Σ−11−2 −(2)

(1)其中 w 的形式相同,因此

小错误率)。但是 Fisher 判别没考虑正太分布假设,协方差相等假设,只有一个是非奇

在样本符合正太分布且协方差相同情况下,用样本算术平均作为均值的估计,用样本协方

差作为真实协方差的估计,那么 Fisher 线性判别所得的方向为最优贝叶斯决策的方向(最

异的,非常容易满足。此时 Fisher 投影方向虽然不是最优的(最优贝叶斯决策)但是也会

取得较好的分类结果

=Σ−1(1−2)

误率)是线性函数,且

感知器(perception):

Fisher 线性判别分析,是两步。第一步得到投影方向,第二部得到确定分类阈值。但是感

知器却可以直接得到完整的线性判别函数。

为了讨论方便把向量 x 增加一维,得到增广向量:y=[1,x1,x2,…,xd]T。

相应的得到增广权向量:α=[w0,w1,w2,…,wd]T。

所以线性判别函数变为:g(y)=αTy。如果 y∈w1,g(y)>0;y∈w2,g(y)<0。

规范化增广向量:

对于 y∈w1,那么增广样本向量不变;对于 y∈w2,增广样本向量乘以-1。

此时对于所有的规范化增广样本向量均满足 g(y)>0。

对于线性可分得一组样本(如果没有特殊说明,均为规范化增广样本向量),如果存在一个

权向量α,对所有样本满足αTyi>0。则称α为一个解向量,所有的解向量组成的区域为解区。

理论上解区内的所有向量均为解向量,能够把所有样本无错误的分开,但是考虑到噪声等扰

动的影响,一般不取解区边界的解向量。

因此引入余量的概念,即αTyi>b>0。

,把分类错误的样本求和最为惩罚。

权向量的求解:

�

感知器的准则函数: = ≤0(−)

使用梯度下降法求解权向量α:α(t+1)=α(t)-η▽ 。

其中▽ = ≤0(−)

�

所以α(t+1)=α(t)+η▽ ≤0()

�

。

。

1、 任意选择初试权向量α=0。

2、 考察样本 yi,若αTyi≤b,则α(t+1)=α(t)+ yi,否则继续。

3、 考察另一个样本,重复步骤 2,知道对所有样本均满足αTyi>b。

�

通常对于线性可分的样本集,经过此步骤迭代后,一定可以得到一个解向量α。进一步加速

收敛的,可以对于分错样本 yi 的步长η不为 1,而是为|()|

||||2 。

当样本线性不可分时,算法不会收敛,此时如果强制结束算法,得到的不一定是可用的解。

一种比较常用的做法是,在梯度下降过程中,使用一定的启发式规则使步长逐渐缩小,这样

可以强制算法收敛,并且能得到可用的解。

最小平方误差判别():

此方法可应用于线性不可分样本集中。

对于线性不可分样本集,一种直观方法为求解一个α,使得不满足αTyi>0 的样本个数尽量

少。这种方法可通过解线性不等式组来最小化错分样本数目,通常采用搜索算法求解。

但是求解不等式组时不太方便,因此引入一系列待定常数,把不等式组转化为方程组(体会

其中问题转化的思想,SVM 中也有问题转化思想):

αTyi = bi>0 Yα= b(矩阵形式)。

一般样本数目 多与 未知数个数,属于矛盾方程组,无法球的精确解。

所以引入最小平方误差准则(MSE): =||−||2。求解方法有伪逆法和梯度下降法。

梯度下降法中可以参照感知器中的单样本修正法来更新权重。

对于常数 b 的选择:

1、 如果对应同一类样本的 bi 选择相同,那么最小平方误差方法的解等价于 Fisher 线性判

别分析的解。特别的当第一类样本对应的 bi=N/N1;第二类样本对应的 bi=N/N2 时,阈值

为总体样本的均值在 Fisher 投影方向的投影。

2、 如果对所有样本都取 bi=1,那么当样本数 N 趋于无穷时,MSE 的解α(伪逆法求出的解)

是贝叶斯判别函数的最小平方误差逼近也就是判别函数α Ty 与贝叶斯判别函数

g(x)=P(w1|x)-P(w2|x)逼近。

均方误差逼近:2= − 2

�

最优分类超平面与线性支持向量机(support vector machine,SVM):

这里采用原始的样本向量表示而不采用增广向量。

最优分类超平面/最大间隔超平面:一个超平面可以将训练样本没有错误的分开,并且两类

训练样本中离超平面的最近的样本与超平面的距离最大。

分类超平面: =x+b

最优超平面分类函数:fx =sgn(x+b)。

样本 x 距离最优超平面的距离:|()|

||||1

注意到当 w,b 同时放缩时,不会影响最优超平面的分类决策,也不会影响样本到最优平面

的距离,因此解不唯一。

引入两个与分类超平面平行的平面 g(x)=1,g(x)=-1。使得所有样本满足 yg(x)≥1。然后最

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc