5

10

15

20

25

30

35

40

中国科技论文在线

http://www.paper.edu.cn

基于响应热力图后处理的手部姿态估计

梁宇,肖波**

(北京邮电大学信息与通信工程学院,北京 100876)

摘要:手部姿态估计是经典的计算机视觉任务,现有主流算法中主要集中在 3D 维度姿态估

计,而随着移动互联网的发展以及人机交互的需求,2D 手部姿态估计的研究越发有意义。

现有的 2D 手部姿态估计主要利用热力响应图的最大响应值来回归关键点坐标,本文提出一

种对响应热力图做 Softmax 后处理的方法,并加以联合损失函数的设计,能够有效提高关键

点坐标的回归精度。本文在常用数据集 RHD 上进行实验,实验结果表明本文提出的方法在

该数据集上的 AUC 及 EPE 性能指标有明显提升,并且在实际数据上有不错效果。

关键词:模式识别与智能系统;手部姿态估计;深度学习;热力图

中图分类号:TP181

Heatmap Post-precessing on Hand Pose Estimation

(School of Information and Communication Engineering, Beijing University of Posts and

Telecommunications, Beijing 100876)

Liang Yu, Xiao Bo

Abstract: Hand pose estimation is a classic task inthefield of computer vision.The existing mainstream

algorithms mainly focus on 3D dimensional pose estimation.With the development of mobile internet

and the demand of human-computer interaction, the research of 2D hand pose estimation becomes more

and more meaningful.The existing 2D hand pose estimation mainly uses the maximum response value of

the heatmap to regress the key point coordinates.In this paper, a method of heatmap post-precessing is

proposed to improve the coordinate precision of key points, and using the joint loss function.In this

paper,experiments are carried out on the RHD dataset which is commonly used.The results show that the

proposed method has a significant improvement in the AUC and EPE performance indicators on the data

set, and has a good effect on the actual data.

Keywords: Pattern recognition and intelligent system; Hand pose estimation; Deep learning; Heatmap

0 引言

近年来较为火爆的虚拟现实(VR)技术中,人机之间的交互回归到手势这一最为原始

的手段,这一交互手段的实现关键在于对于手势的识别。由于基于可穿戴设备的手势识别存

在设备成本高、使用不便而无法大规模进行推广的问题,基于图像处理的手势识别便成为近

年来计算机视觉领域中较为关注的任务。

基于图像处理的手势识别,从任务类别上可以分为两种,分类和回归。分类任务仅仅针

对特定的手势进行图像分类,利用较为经典的分类网络便能取得不错的效果,但需要针对特

定的场景进行单独的训练;回归任务则是精确回归出手部若干关键点的位置,对于回归得到

的关键点进行有向的连接,进而还原出手部姿态。回归任务不针对特定手势,具有较强的泛

化能力,类比与人体姿态估计任务,该任务称为手部姿态估计。

现如今,手部姿态估计任务的重点集中在对于手部若干关键点的坐标回归,坐标的回归

精度决定了模型的性能。对于 3D 姿态估计,利用 RGB-D 摄像头采集的图像,一定的空间

信息有助于 3D 姿态的重建;而在 2D 姿态估计中,采集到的 RGB 图像不含深度信息,因此

作者简介:梁宇(1992-),男,硕士研究生,主要研究方向:模式识别

通信联系人:肖波(1975-),男,硕士生导师、副教授,主要研究方向:数据挖掘、网络搜索、网络管理.

E-mail: xiaobo@bupt.edu.cn

- 1 -

�

http://www.paper.edu.cn

中国科技论文在线

主要是利用对手部响应热力图 heatmap 来定位相应的关键点位置。本文主要是对 RGB 图像

中 2D 手部姿态估计算法进行研究,基于响应热力图(heatmap)后处理的方式提高模型精

度。

1 相关工作

45

50

55

60

65

70

75

基于图像的手部姿态估计大致可以分为生成方法和判别方法。生成方法基于手的模型,

首先创建大量手的姿态模版,随后使用模板匹配当前手势,例如文献[1]中定义了自由度为

26 的手的模型,其中 6 个自由度代表了全局姿态,20 个姿态代表了每根手指姿态,目标函

数为模版与当前手势的相似性,使用了基于梯度的随机优化方法。判别方法则是基于手部的

特征,学习手部图像特征到手部姿态的映射,根据当前手部的特征推导出手的特征,例如文

献[2]提出了一种以非监督方式学习到手拓扑结构的模型,并据此提出一种基于森林的判别

框架 LRF(Latent Regression Forest)来避免判别模型误差的积累,文献[3]中利用 CNN 提取

特征,并为关节位置生成小的响应热力图,随后利用特征和小的响应热力图使用反向运动学

相关先验知识去推导手的姿态,文献[4]在[2,3]的基础上加入了一个分支网络输出手的关节

点,并通过迭代的方式对于每个关节点都进行了修正。对比两种方法,生成方法使用的匹配

代价函数计算量较为巨大,且精确度很依赖于人为设计的函数,而判别方法中则是受限于手

部特征的提取。

在深度学习流行之前,传统的图像处理对于手部特征的提取有限,应用场景大多为带有

深度信息的 3D 手势估计,在计算复杂度和精确度上两种方法不相上下,在 CNN 卷积网络

大放异彩之后,海量的训练数据以及 CNN 对图像信息的高效提取使得近年来提出的手势估

计方法大多偏向于判别方法,或者是两种方法的结合(在判别模型之后利用生成方法中的模

版或运动学约束去校准手势)。

从应用维度上看,由于 2D 手势估计在 RGB 图像上精确标注出各个关键点的具体坐标以

及是否可见等信息,因此人工成本巨大,且误差较大,因此主流算法中,3D 手势估计的算

法居多,文献[2,3,4,5]都是基于 RGB-D 图像的手势估计。随着移动互联网时代的到来,在实

际应用中,普通的移动智能设备只能采集到不带深度信息的 RGB 图像,因而,2D 手势估计

的算法日益增多。类比于人体姿态估计算法中的 CPM 网络[6],文献[7]提出了一种由 RGB

图像估计 3D 姿态估计的方法,将 2D 关键点的回归和 3D 姿态估计作为两个子任务分别进

行,随后整合到一个端对端的网络中。此外,文献[8]结合深度学习中最新 GAN 和运动学

3D 模型,使用了合成和真实数据集对于手势的估计也有不错的效果。

因此,目前的研究集中在对 3D 手部姿态的估计,主流的算法流程为,先利用 CNN 网络

提取手部特征,随后直接学习特征到关键点的映射,或者先回归到 2D 维度上的关键点位置

再进行 2D 到 3D 的映射。由 RGB 图像直接得到手部的姿态估计,不论是作为 3D 手势估计

的子任务,还是在 2D 场景下的独立任务,其研究具有重要意义。本文将以文献[7]中 2D 手

部姿态估计性能指标作为参考。

2 模型结构及解析

2.1 基于 CPM 网络的 HandPoseNet

CPM 网络于 2016 年提出,用于人体姿态估计,在 RGB 图像中回归出人体上若干关节

- 2 -

�

http://www.paper.edu.cn

中国科技论文在线

点的坐标位置,其主要思想有以下几点:

1) 使用每个关节点的响应响应图 heatmap 来表示各个关节点之间的空间约束;

2) 将特征图和响应图都视为数据在网络中传递;

3) 在处理关节点响应图时,使用多个阶段的 CNN 网络用以监督训练。

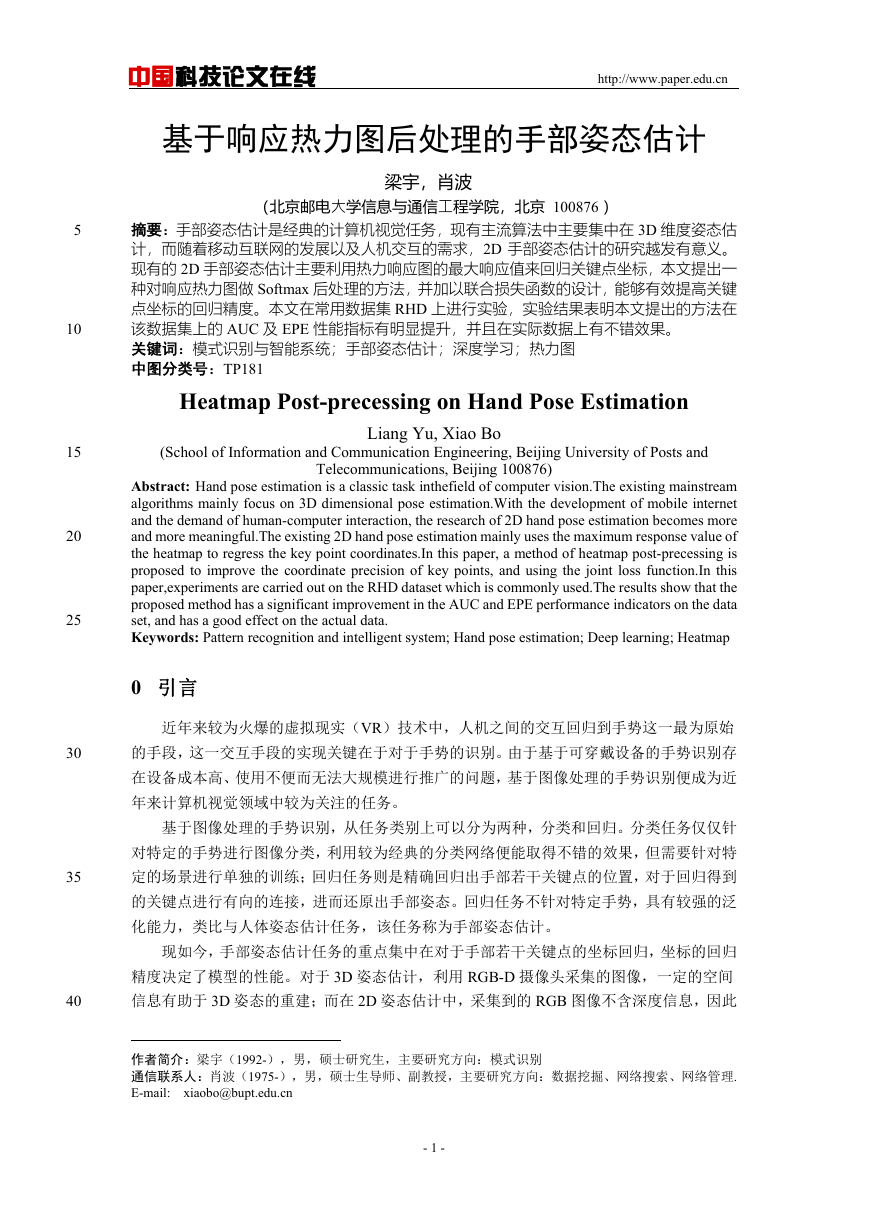

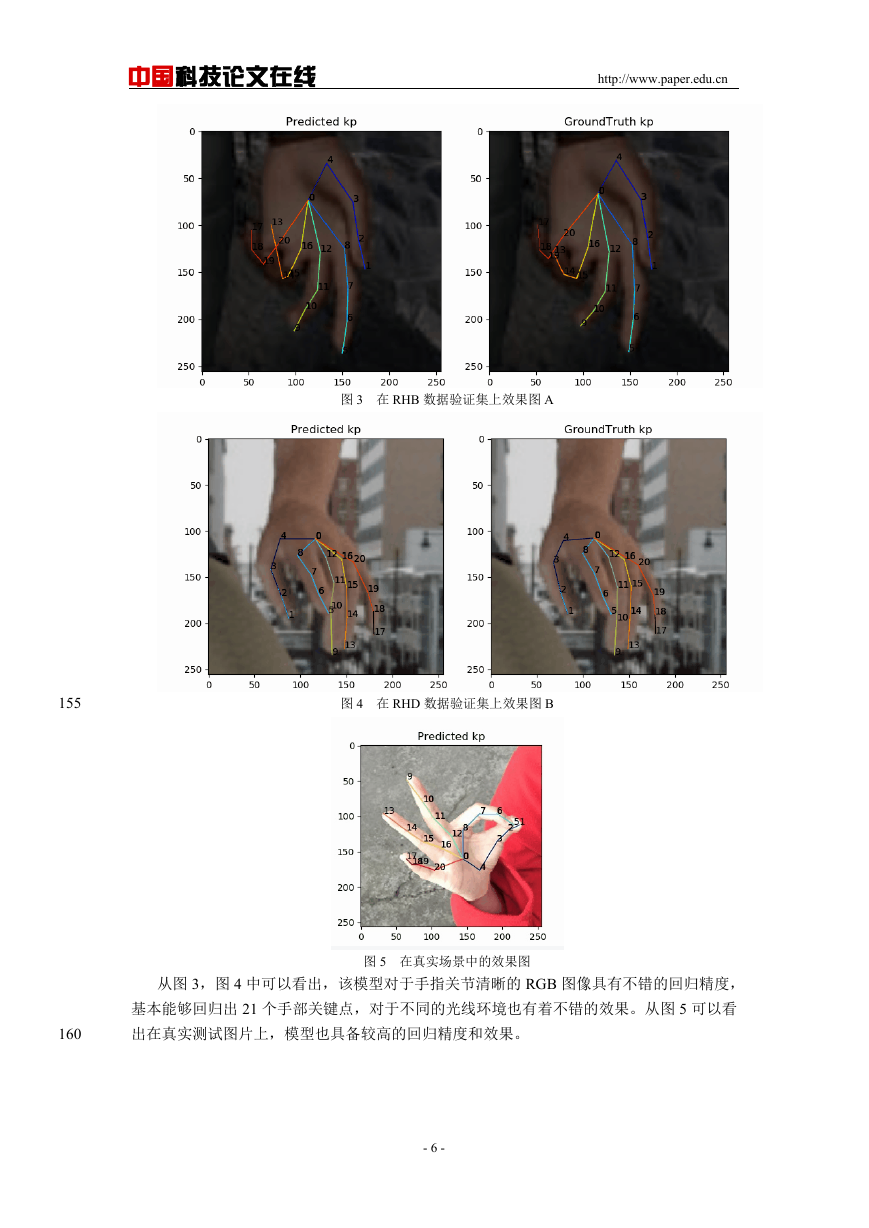

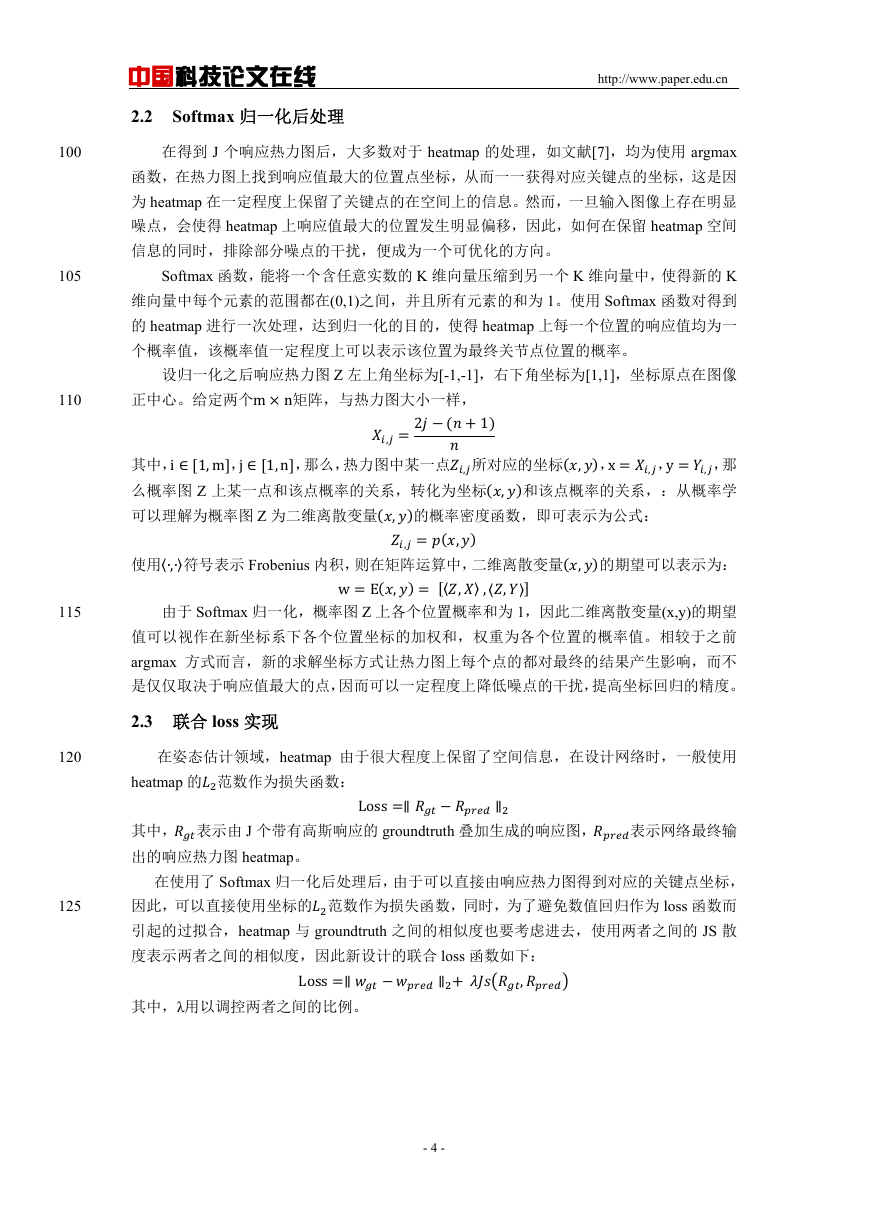

迁移到手部姿态估计时,定义手部关键点坐标由集合=,组成,其中i∈[1,J],

手部关键点如图 1,J=21,root 节点选择腕部。

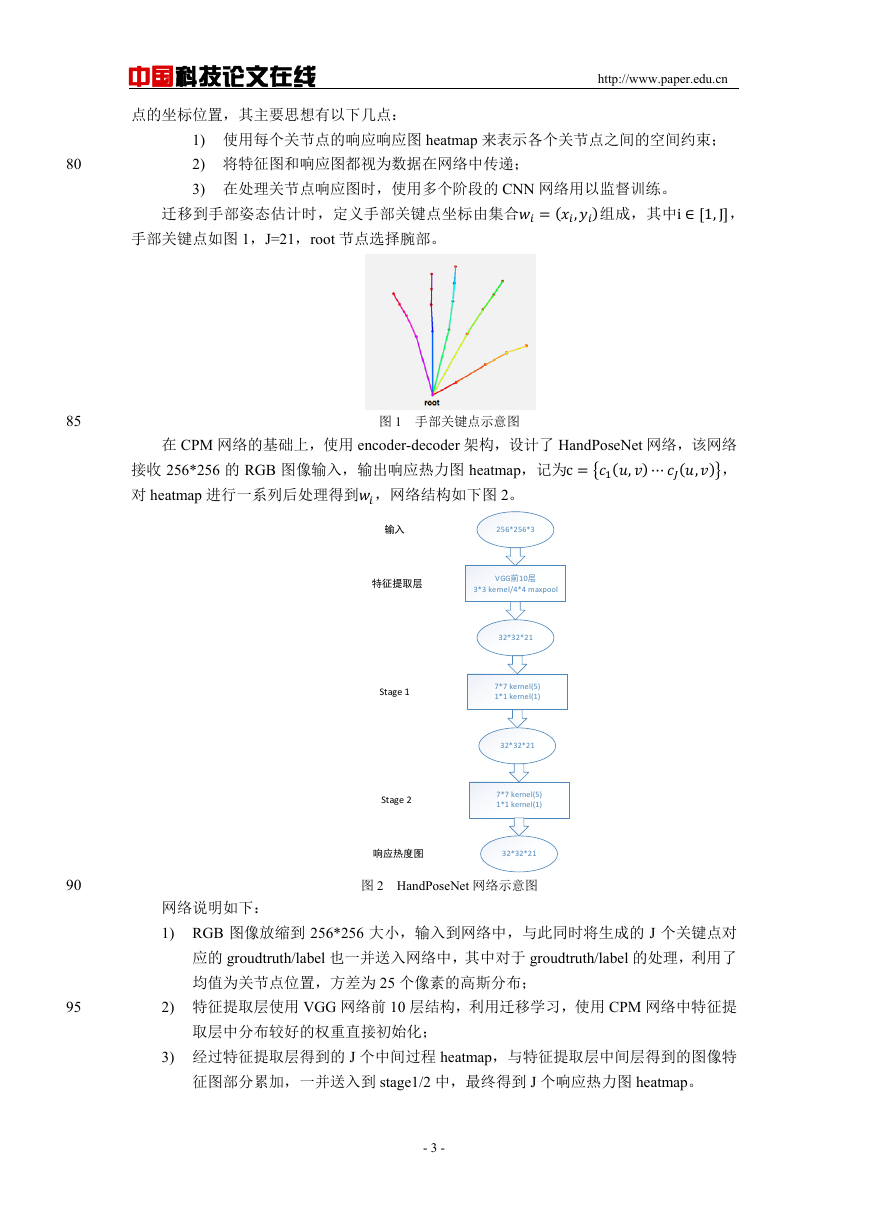

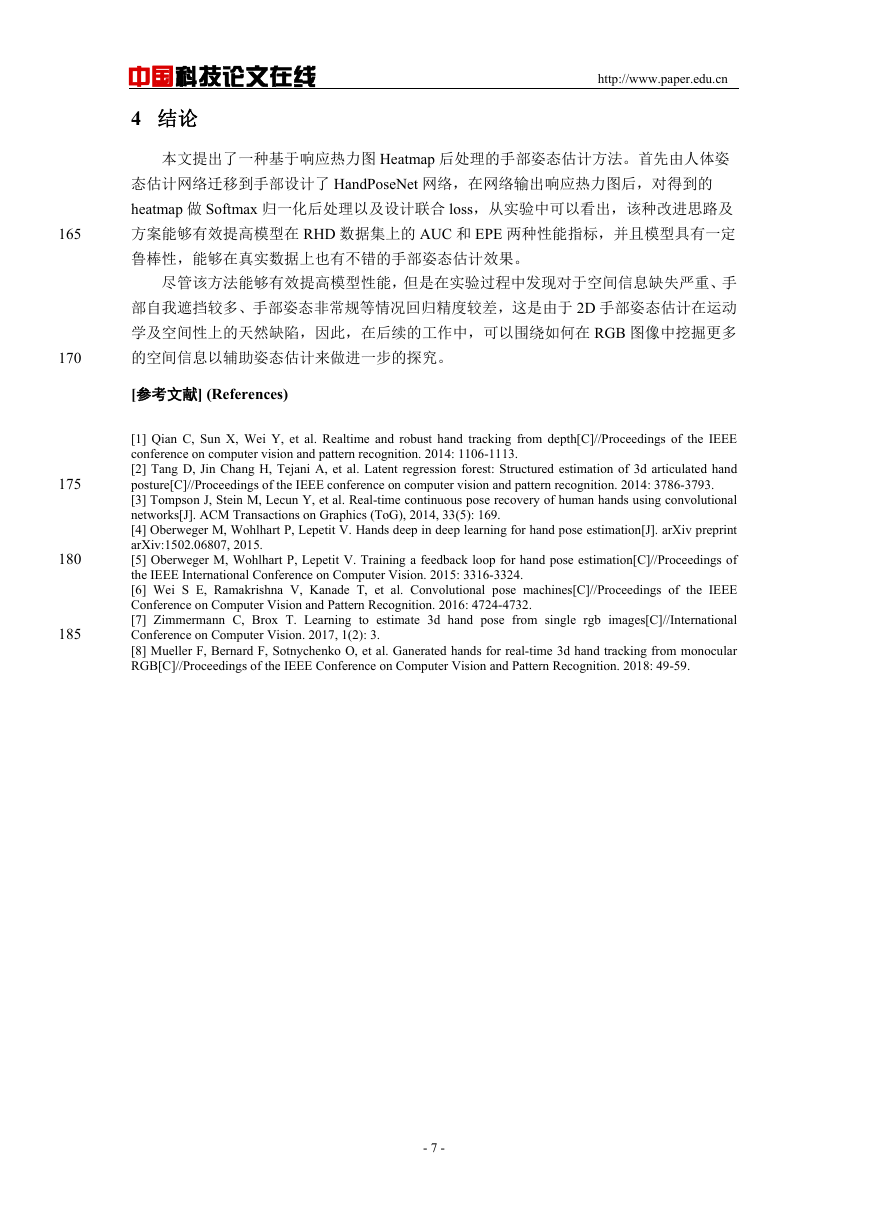

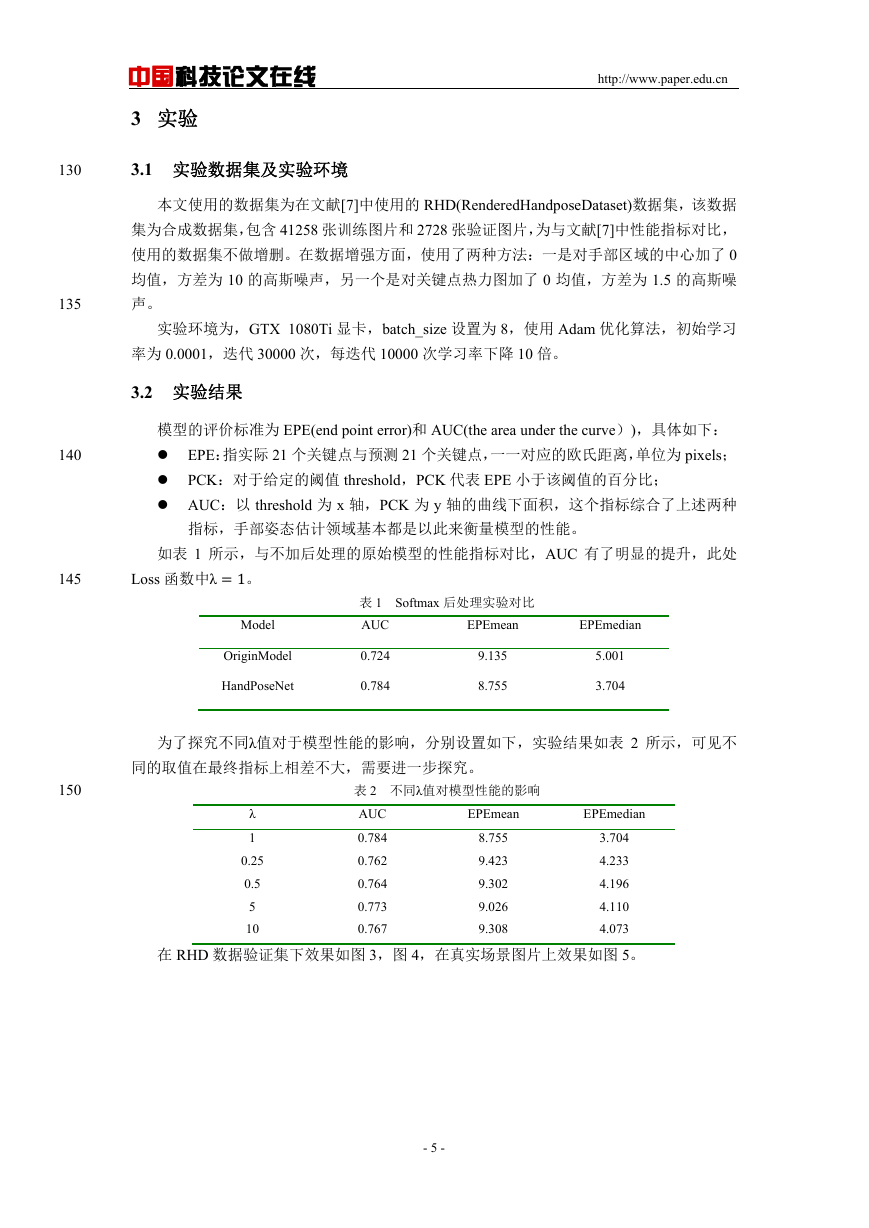

在 CPM 网络的基础上,使用 encoder-decoder 架构,设计了 HandPoseNet 网络,该网络

接收 256*256 的 RGB 图像输入,输出响应热力图 heatmap,记为c=,⋯,,

对 heatmap 进行一系列后处理得到,网络结构如下图 2。

图 1 手部关键点示意图

输入

256*256*3

特征提取层

VGG前10层

3*3 kernel/4*4 maxpool

Stage 1

32*32*21

7*7 kernel(5)

1*1 kernel(1)

32*32*21

Stage 2

7*7 kernel(5)

1*1 kernel(1)

响应热度图

32*32*21

图 2 HandPoseNet 网络示意图

80

85

90

网络说明如下:

1) RGB 图像放缩到 256*256 大小,输入到网络中,与此同时将生成的 J 个关键点对

应的 groudtruth/label 也一并送入网络中,其中对于 groudtruth/label 的处理,利用了

均值为关节点位置,方差为 25 个像素的高斯分布;

95

2) 特征提取层使用 VGG 网络前 10 层结构,利用迁移学习,使用 CPM 网络中特征提

取层中分布较好的权重直接初始化;

3) 经过特征提取层得到的 J 个中间过程 heatmap,与特征提取层中间层得到的图像特

征图部分累加,一并送入到 stage1/2 中,最终得到 J 个响应热力图 heatmap。

- 3 -

�

100

105

110

115

120

125

http://www.paper.edu.cn

中国科技论文在线

2.2 Softmax 归一化后处理

在得到 J 个响应热力图后,大多数对于 heatmap 的处理,如文献[7],均为使用 argmax

函数,在热力图上找到响应值最大的位置点坐标,从而一一获得对应关键点的坐标,这是因

为 heatmap 在一定程度上保留了关键点的在空间上的信息。然而,一旦输入图像上存在明显

噪点,会使得 heatmap 上响应值最大的位置发生明显偏移,因此,如何在保留 heatmap 空间

信息的同时,排除部分噪点的干扰,便成为一个可优化的方向。

设归一化之后响应热力图 Z 左上角坐标为[-1,-1],右下角坐标为[1,1],坐标原点在图像

Softmax 函数,能将一个含任意实数的 K 维向量压缩到另一个 K 维向量中,使得新的 K

维向量中每个元素的范围都在(0,1)之间,并且所有元素的和为 1。使用 Softmax 函数对得到

的 heatmap 进行一次处理,达到归一化的目的,使得 heatmap 上每一个位置的响应值均为一

个概率值,该概率值一定程度上可以表示该位置为最终关节点位置的概率。

正中心。给定两个m×n矩阵,与热力图大小一样,

,=2−+1

其中,i∈[1,m],j∈[1,n],那么,热力图中某一点,所对应的坐标,,x=,,y=,,那

么概率图 Z 上某一点和该点概率的关系,转化为坐标,和该点概率的关系,:从概率学

可以理解为概率图 Z 为二维离散变量,的概率密度函数,即可表示为公式:

,=,

使用〈∙,∙〉符号表示 Frobenius 内积,则在矩阵运算中,二维离散变量,的期望可以表示为:

w=E,= [〈,〉 ,〈,〉]

由于 Softmax 归一化,概率图 Z 上各个位置概率和为 1,因此二维离散变量(x,y)的期望

值可以视作在新坐标系下各个位置坐标的加权和,权重为各个位置的概率值。相较于之前

argmax 方式而言,新的求解坐标方式让热力图上每个点的都对最终的结果产生影响,而不

是仅仅取决于响应值最大的点,因而可以一定程度上降低噪点的干扰,提高坐标回归的精度。

2.3 联合 loss 实现

heatmap 的范数作为损失函数: Loss=∥−∥

其中,表示由 J 个带有高斯响应的 groundtruth 叠加生成的响应图,表示网络最终输

因此,可以直接使用坐标的范数作为损失函数,同时,为了避免数值回归作为 loss 函数而

出的响应热力图 heatmap。

在使用了 Softmax 归一化后处理后,由于可以直接由响应热力图得到对应的关键点坐标,

在姿态估计领域,heatmap 由于很大程度上保留了空间信息,在设计网络时,一般使用

引起的过拟合,heatmap 与 groundtruth 之间的相似度也要考虑进去,使用两者之间的 JS 散

度表示两者之间的相似度,因此新设计的联合 loss 函数如下:

Loss=∥−∥+ ,

其中,λ用以调控两者之间的比例。

- 4 -

�

http://www.paper.edu.cn

中国科技论文在线

3 实验

130

3.1 实验数据集及实验环境

135

140

145

150

本文使用的数据集为在文献[7]中使用的 RHD(RenderedHandposeDataset)数据集,该数据

集为合成数据集,包含 41258 张训练图片和 2728 张验证图片,为与文献[7]中性能指标对比,

使用的数据集不做增删。在数据增强方面,使用了两种方法:一是对手部区域的中心加了 0

均值,方差为 10 的高斯噪声,另一个是对关键点热力图加了 0 均值,方差为 1.5 的高斯噪

声。

实验环境为,GTX 1080Ti 显卡,batch_size 设置为 8,使用 Adam 优化算法,初始学习

率为 0.0001,迭代 30000 次,每迭代 10000 次学习率下降 10 倍。

3.2 实验结果

模型的评价标准为 EPE(end point error)和 AUC(the area under the curve)),具体如下:

EPE:指实际 21 个关键点与预测 21 个关键点,一一对应的欧氏距离,单位为 pixels;

PCK:对于给定的阈值 threshold,PCK 代表 EPE 小于该阈值的百分比;

AUC:以 threshold 为 x 轴,PCK 为 y 轴的曲线下面积,这个指标综合了上述两种

指标,手部姿态估计领域基本都是以此来衡量模型的性能。

如表 1 所示,与不加后处理的原始模型的性能指标对比,AUC 有了明显的提升,此处

Loss 函数中λ=1。

Model

OriginModel

HandPoseNet

表 1 Softmax 后处理实验对比

AUC

EPEmean

0.724

0.784

9.135

8.755

EPEmedian

5.001

3.704

为了探究不同λ值对于模型性能的影响,分别设置如下,实验结果如表 2 所示,可见不

同的取值在最终指标上相差不大,需要进一步探究。

λ

1

0.25

0.5

5

10

EPEmean

表 2 不同λ值对模型性能的影响

AUC

0.784

0.762

0.764

0.773

0.767

8.755

9.423

9.302

9.026

9.308

EPEmedian

3.704

4.233

4.196

4.110

4.073

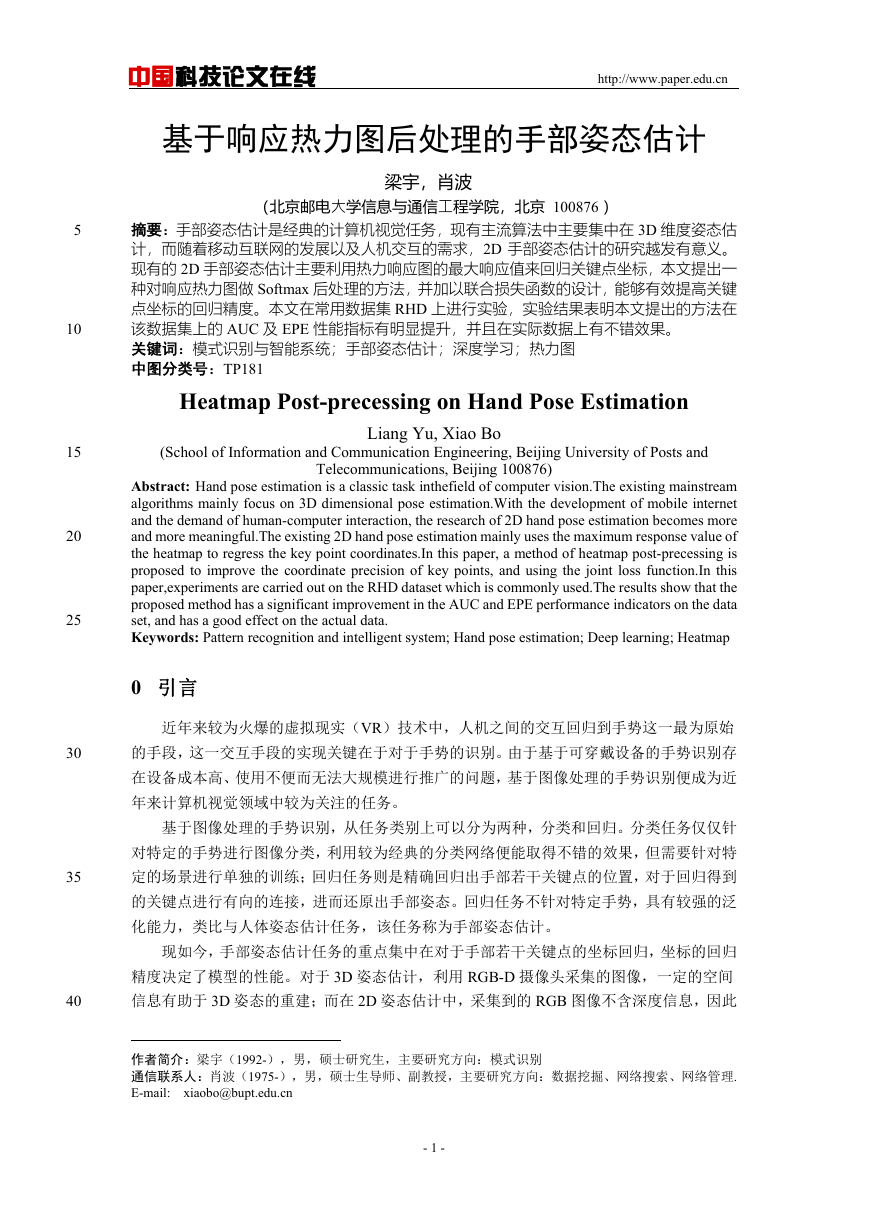

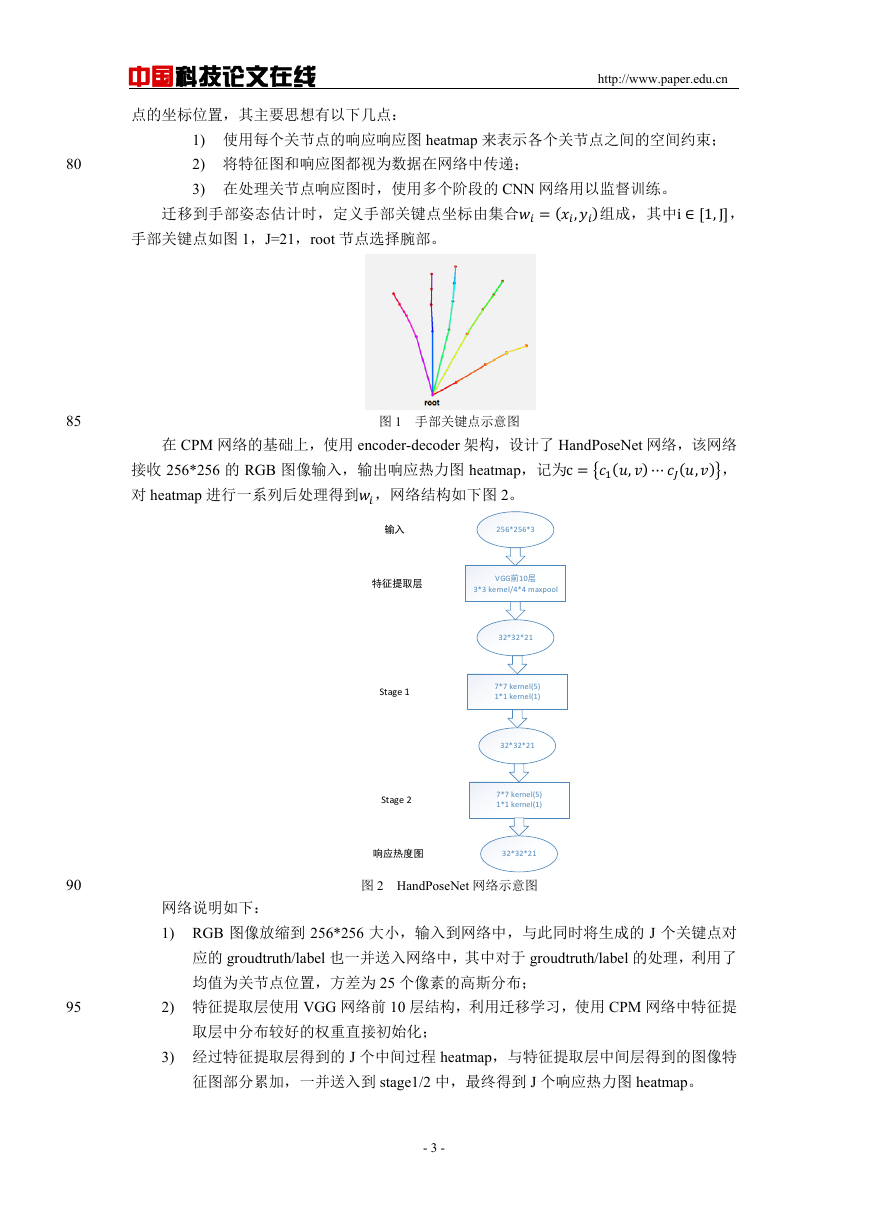

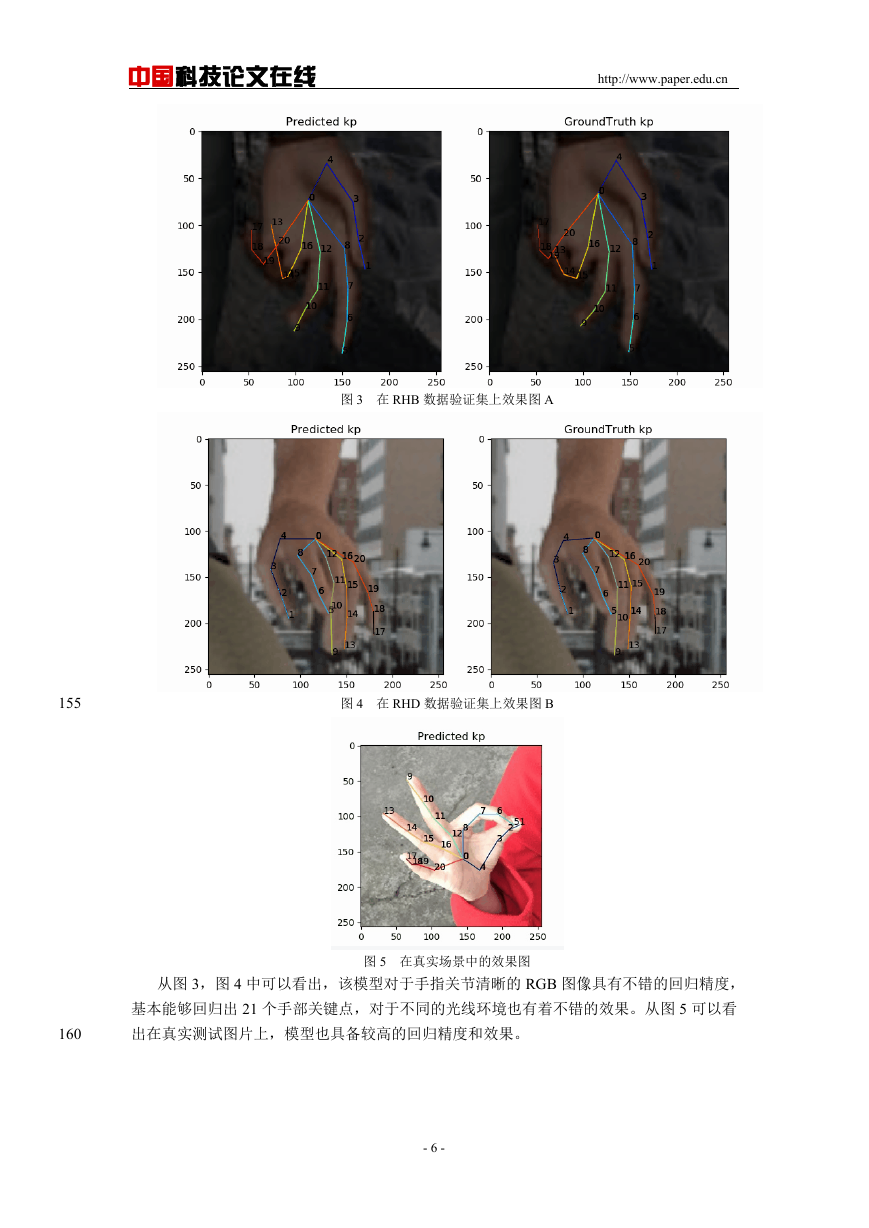

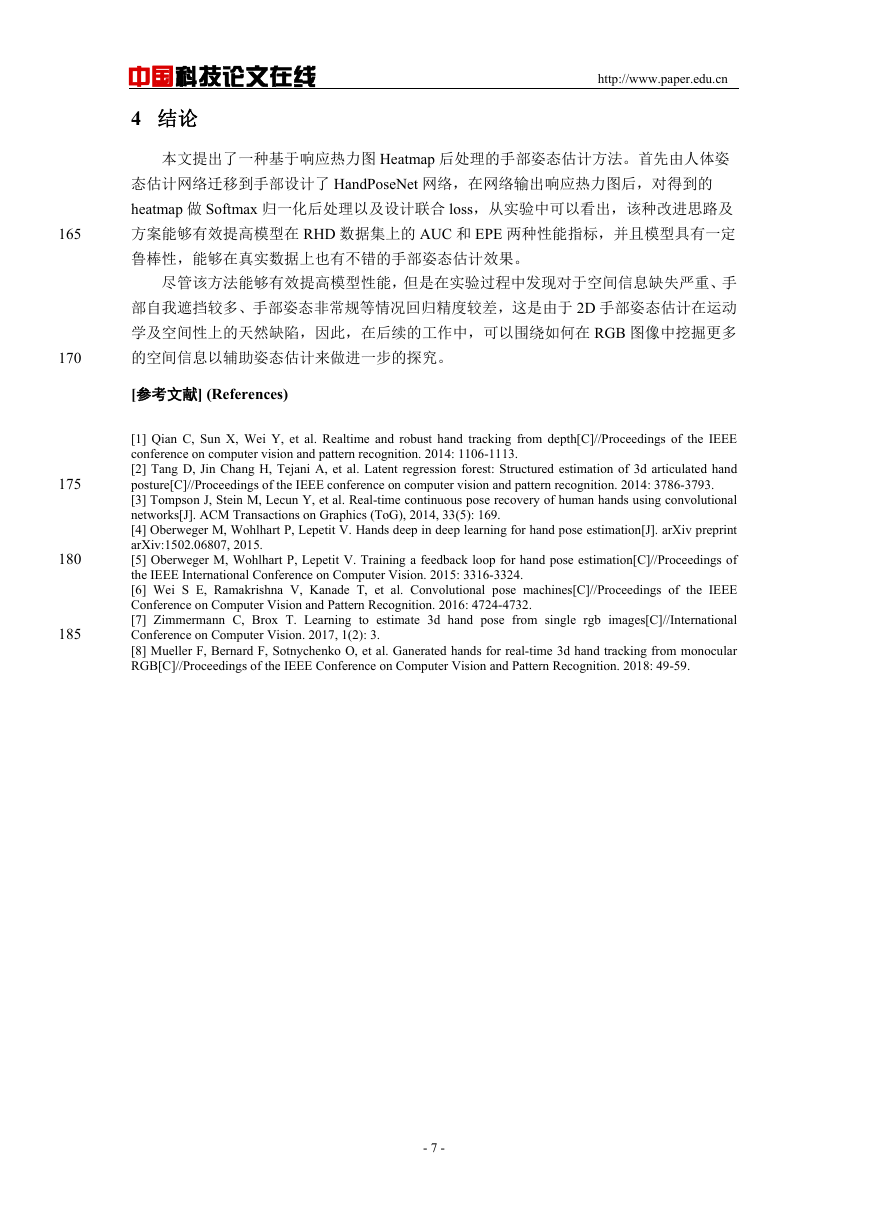

在 RHD 数据验证集下效果如图 3,图 4,在真实场景图片上效果如图 5。

- 5 -

�

中国科技论文在线

http://www.paper.edu.cn

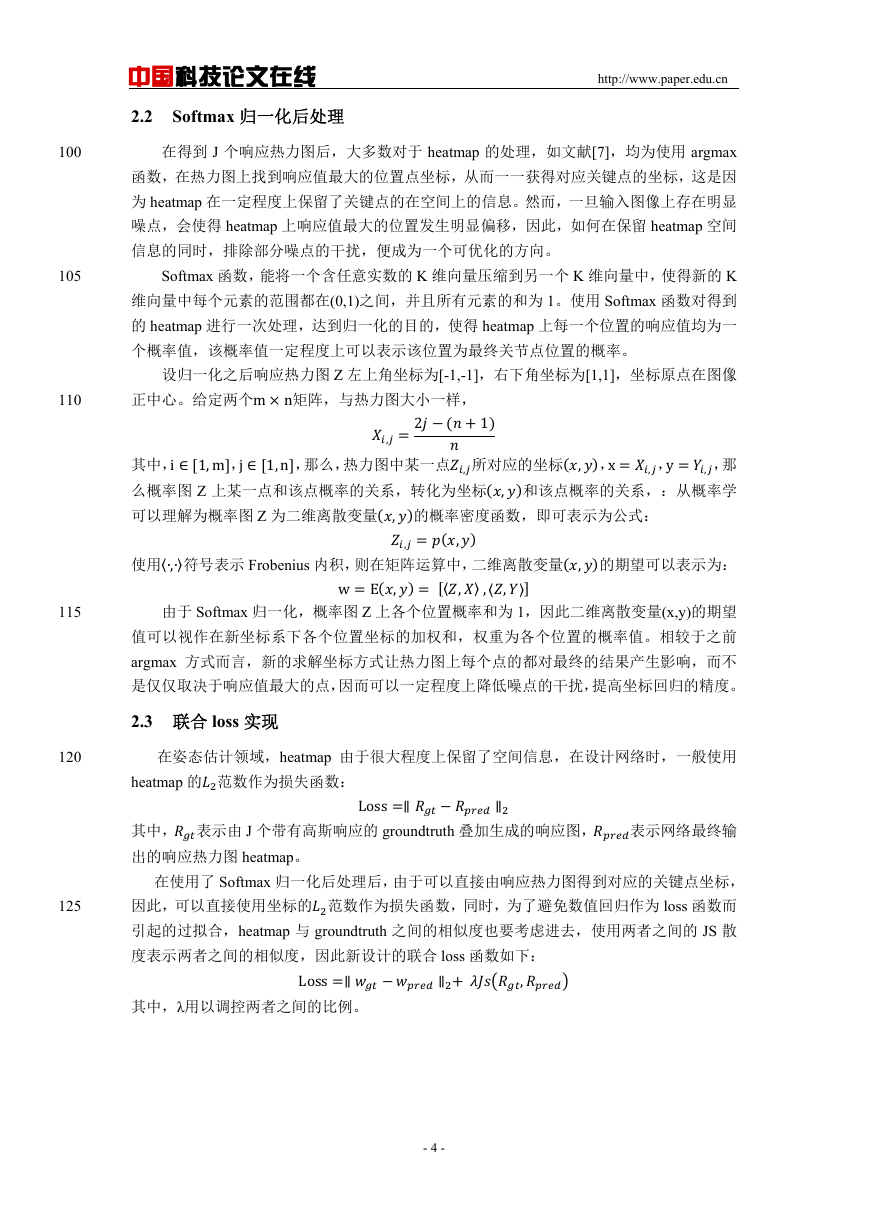

图 3 在 RHB 数据验证集上效果图 A

155

图 4 在 RHD 数据验证集上效果图 B

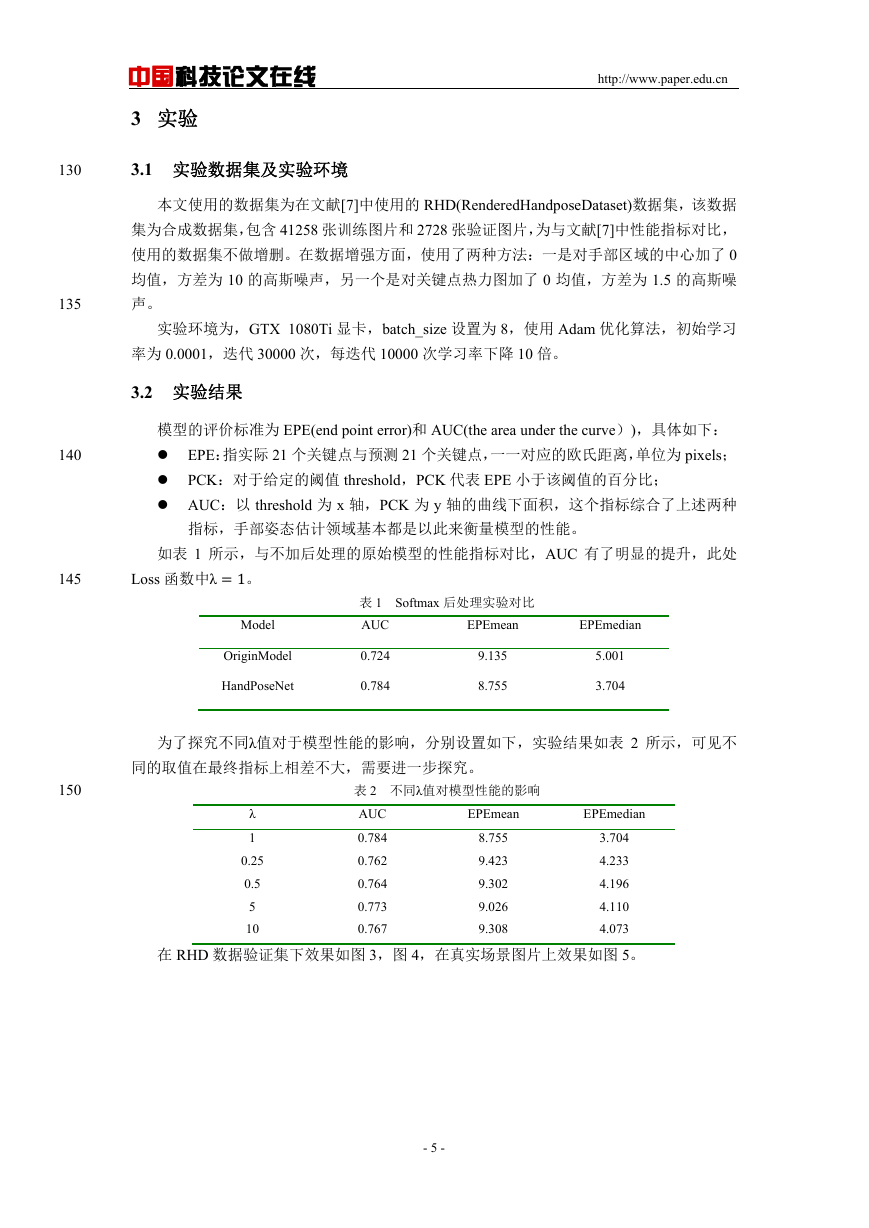

图 5 在真实场景中的效果图

从图 3,图 4 中可以看出,该模型对于手指关节清晰的 RGB 图像具有不错的回归精度,

基本能够回归出 21 个手部关键点,对于不同的光线环境也有着不错的效果。从图 5 可以看

出在真实测试图片上,模型也具备较高的回归精度和效果。

160

- 6 -

�

http://www.paper.edu.cn

中国科技论文在线

4 结论

本文提出了一种基于响应热力图 Heatmap 后处理的手部姿态估计方法。首先由人体姿

态估计网络迁移到手部设计了 HandPoseNet 网络,在网络输出响应热力图后,对得到的

heatmap 做 Softmax 归一化后处理以及设计联合 loss,从实验中可以看出,该种改进思路及

方案能够有效提高模型在 RHD 数据集上的 AUC 和 EPE 两种性能指标,并且模型具有一定

鲁棒性,能够在真实数据上也有不错的手部姿态估计效果。

尽管该方法能够有效提高模型性能,但是在实验过程中发现对于空间信息缺失严重、手

部自我遮挡较多、手部姿态非常规等情况回归精度较差,这是由于 2D 手部姿态估计在运动

学及空间性上的天然缺陷,因此,在后续的工作中,可以围绕如何在 RGB 图像中挖掘更多

的空间信息以辅助姿态估计来做进一步的探究。

[参考文献] (References)

[1] Qian C, Sun X, Wei Y, et al. Realtime and robust hand tracking from depth[C]//Proceedings of the IEEE

conference on computer vision and pattern recognition. 2014: 1106-1113.

[2] Tang D, Jin Chang H, Tejani A, et al. Latent regression forest: Structured estimation of 3d articulated hand

posture[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2014: 3786-3793.

[3] Tompson J, Stein M, Lecun Y, et al. Real-time continuous pose recovery of human hands using convolutional

networks[J]. ACM Transactions on Graphics (ToG), 2014, 33(5): 169.

[4] Oberweger M, Wohlhart P, Lepetit V. Hands deep in deep learning for hand pose estimation[J]. arXiv preprint

arXiv:1502.06807, 2015.

[5] Oberweger M, Wohlhart P, Lepetit V. Training a feedback loop for hand pose estimation[C]//Proceedings of

the IEEE International Conference on Computer Vision. 2015: 3316-3324.

[6] Wei S E, Ramakrishna V, Kanade T, et al. Convolutional pose machines[C]//Proceedings of the IEEE

Conference on Computer Vision and Pattern Recognition. 2016: 4724-4732.

[7] Zimmermann C, Brox T. Learning to estimate 3d hand pose from single rgb images[C]//International

Conference on Computer Vision. 2017, 1(2): 3.

[8] Mueller F, Bernard F, Sotnychenko O, et al. Ganerated hands for real-time 3d hand tracking from monocular

RGB[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2018: 49-59.

165

170

175

180

185

- 7 -

�

2023年江西萍乡中考道德与法治真题及答案.doc

2023年江西萍乡中考道德与法治真题及答案.doc 2012年重庆南川中考生物真题及答案.doc

2012年重庆南川中考生物真题及答案.doc 2013年江西师范大学地理学综合及文艺理论基础考研真题.doc

2013年江西师范大学地理学综合及文艺理论基础考研真题.doc 2020年四川甘孜小升初语文真题及答案I卷.doc

2020年四川甘孜小升初语文真题及答案I卷.doc 2020年注册岩土工程师专业基础考试真题及答案.doc

2020年注册岩土工程师专业基础考试真题及答案.doc 2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc

2023-2024学年福建省厦门市九年级上学期数学月考试题及答案.doc 2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc

2021-2022学年辽宁省沈阳市大东区九年级上学期语文期末试题及答案.doc 2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc

2022-2023学年北京东城区初三第一学期物理期末试卷及答案.doc 2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc

2018上半年江西教师资格初中地理学科知识与教学能力真题及答案.doc 2012年河北国家公务员申论考试真题及答案-省级.doc

2012年河北国家公务员申论考试真题及答案-省级.doc 2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc

2020-2021学年江苏省扬州市江都区邵樊片九年级上学期数学第一次质量检测试题及答案.doc 2022下半年黑龙江教师资格证中学综合素质真题及答案.doc

2022下半年黑龙江教师资格证中学综合素质真题及答案.doc